高端旗舰机型中,MS-S1 MAX搭载AMD锐龙AI Max+ 395处理器,126TOPS算力搭配128GB统一内存,可单机运行Qwen3.5-35B等大模型,集群部署更能解锁超强算力,满足高阶AI使用需求。

N5 MAX作为全球首款内置OpenClaw的AI NAS,实现了NAS与AI的深度融合,本地即可完成照片、文件的语义搜索等操作,保障数据安全。 M2 Pro以180TOPS算力支持“混合模式”运行OpenClaw,在保障隐私的前提下兼顾实用性。 MS-03小巧实用,搭载最新英特尔Panther Lake处理器,AI推理与多线程性能显著提升,可轻松胜任AI推理中枢、家庭服务器、中小企业服务器、软路由等多重角色,实用性拉满。 针对入门级用户,铭凡M1 lite迷你主机自带21TOPS算力,让新手用户也能轻松应对轻量级AI推理、智能办公等日常任务,低成本开启AI之旅。

OpenClaw

安装+本地模型

适用于具有本地模型运行能力的产品系列 ,通过Windows 11 / WSL 2 方式。

前置准备

铭凡MS-S1 MAX 主机(以该机型为例),128GB 内存 , Windows 11 系统;

已安装LM Studio,提前下载好对应本地模型(推荐Qwen3.5-35B-A3B)。

驱动和显存设置

下载并安装最新的AMD Software: Adrenalin™ Edition驱动程序。

进入BIOS,设置显存为96GB:

Advanced---AMD CBS---NBIO Common Options---GFX ConfigurationiGPU Configuration:UMA_SPECIFIEDUMA Frame buffer Size:96GB

*驱动程序下载链接:

https://www.amd.com/en/support/download/drivers.html

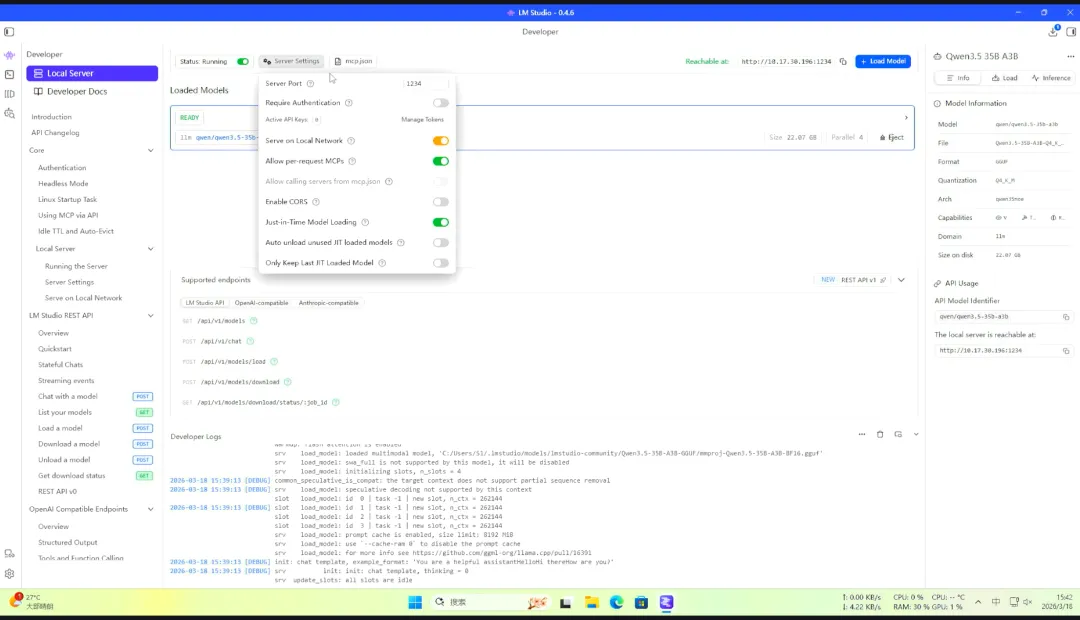

LM Studio 的设置

下载 LM Studio。

启动LM Studio,在模型下载提示中点击“暂时跳过”。

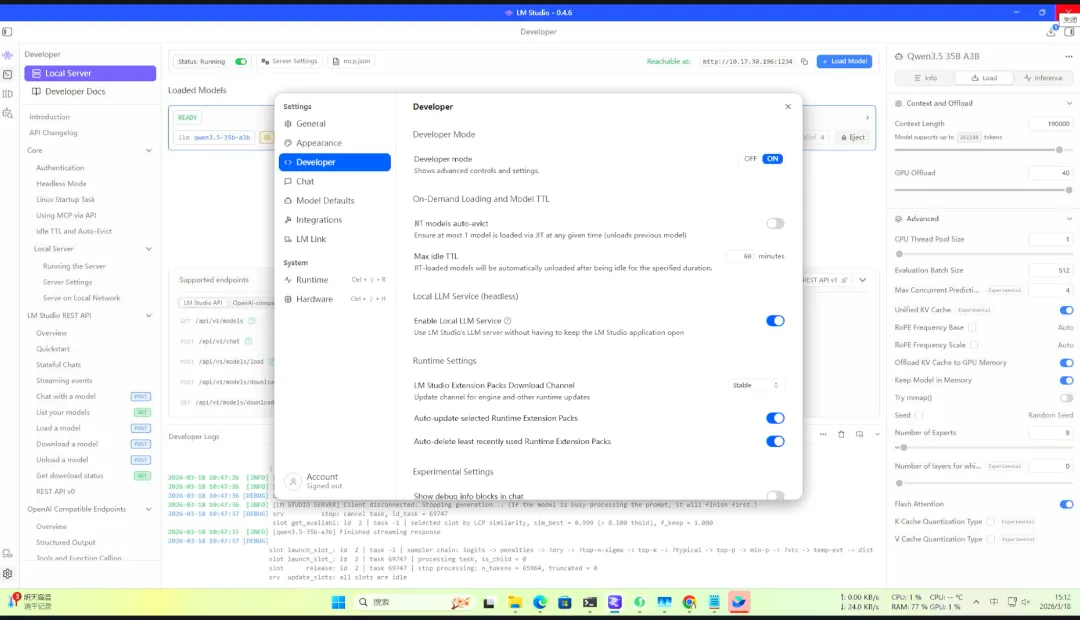

点击左下角的“设置"图标,启用“开发者模式”、“启动本地LLM服务”、关闭“JIT models auto-evict”。

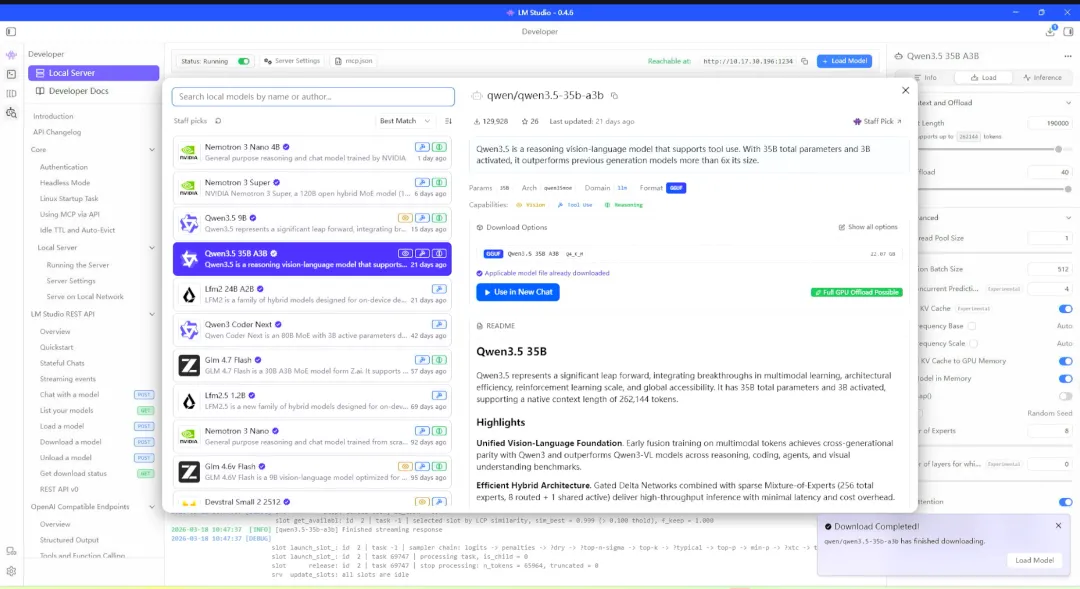

下载本地大模型,如Qwen3.5-35B-A3B。

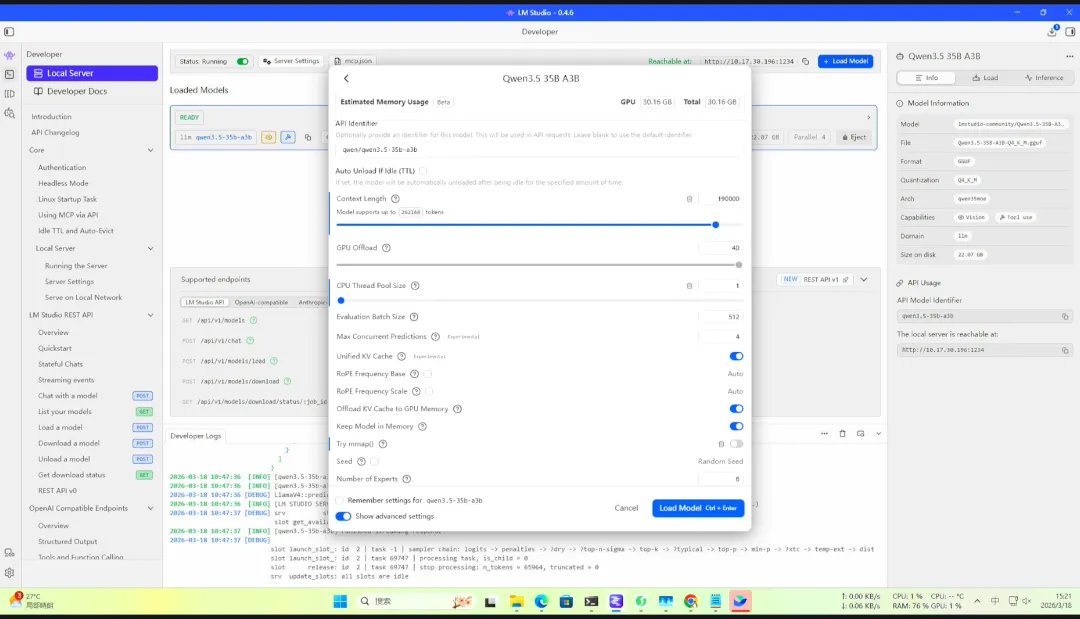

按Ctrl + L调出模型选择。勾选“手动选择加载模型参数”,然后点击大语言模型以调出加载选项。

勾选“记住设置”并勾选“显示高级设置”。

将上下文设置为190000,并确保GPU卸载设置为MAX。

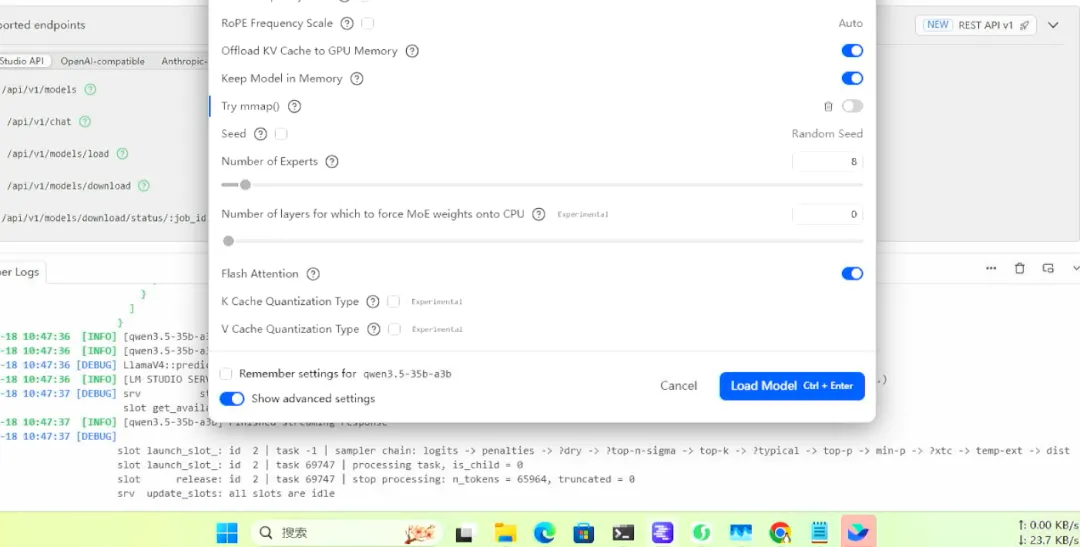

取消勾选“Try nmap”。

确保“Flash Attention”已启用。

有关最大并发预测和统一KV缓存的详细解释,请参见上文的并发智能体逻辑。目前,我们将最大并发预测设置为6,并勾选统一kv缓存。

点击加载。

如果模型没有显示,您可能需要从下拉菜单中重新选择模型。

开始聊天并发送消息“test”以确保大语言模型正常工作。

禁用统一KV缓存后,每个智能体可以拥有自己的KV缓存和上下文窗口,但这会随着并行请求数量的增加而显著提高内存使用率。

启用统一KV缓存时,所有智能体可以共享同一个窗口,因此不会影响内存使用率。

服务器设置和防止崩溃的强化措施

点击服务器设置。

允许“在本地网络上服务”。此时会提示你授予权限。

取消勾选“自动卸载未使用的即时加载模型”和“仅保留最后一个即时加载的模型”。点击任意位置关闭上下文窗口。

点击“加载模型”。选择Qwen 35B A3B。我们上面配置的设置应该会自动填充。点击“加载”。

模型将会加载,你会看到状态为“READY”。

保持此窗口打开并继续操作。

OpenClaw安装步骤

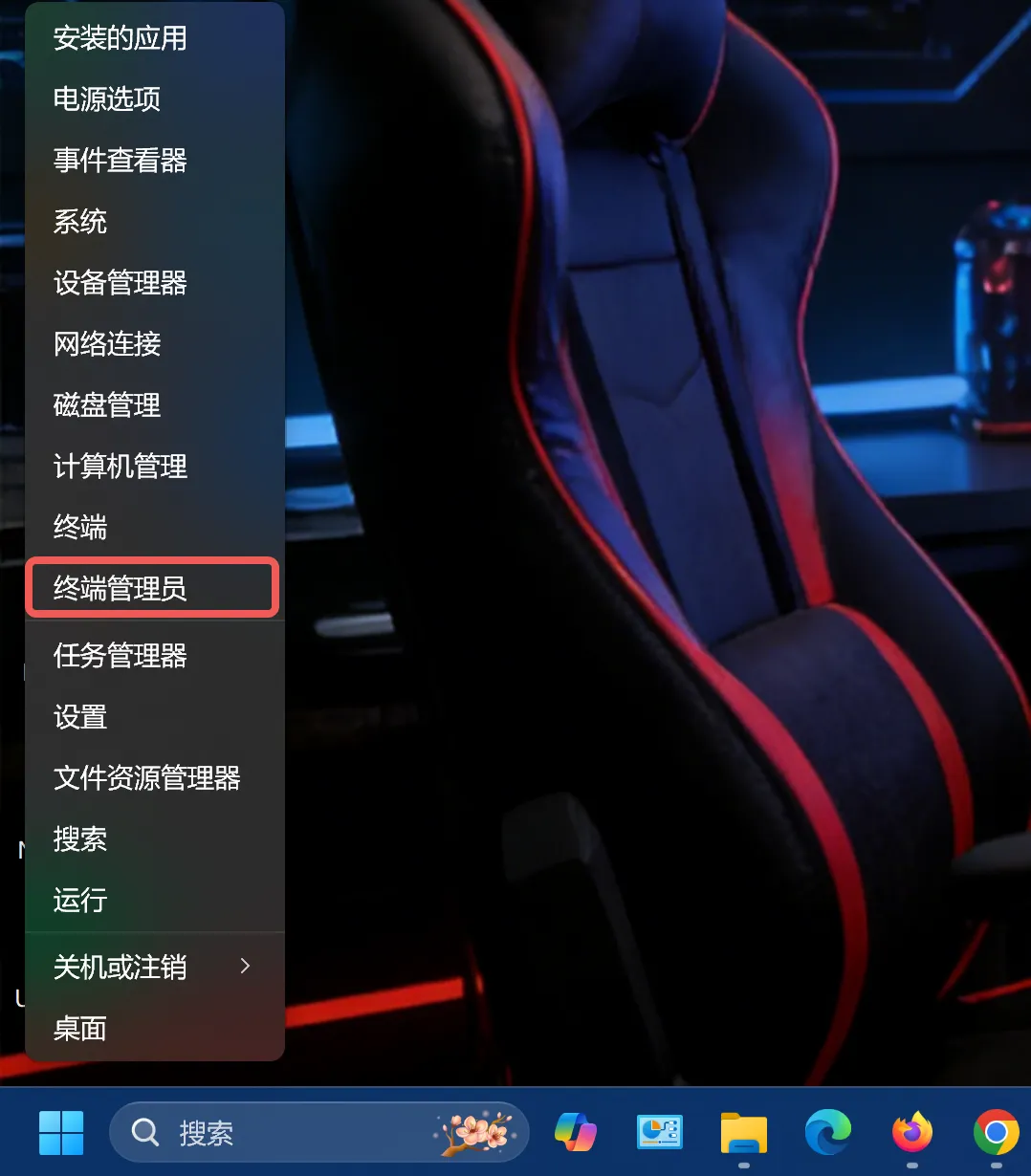

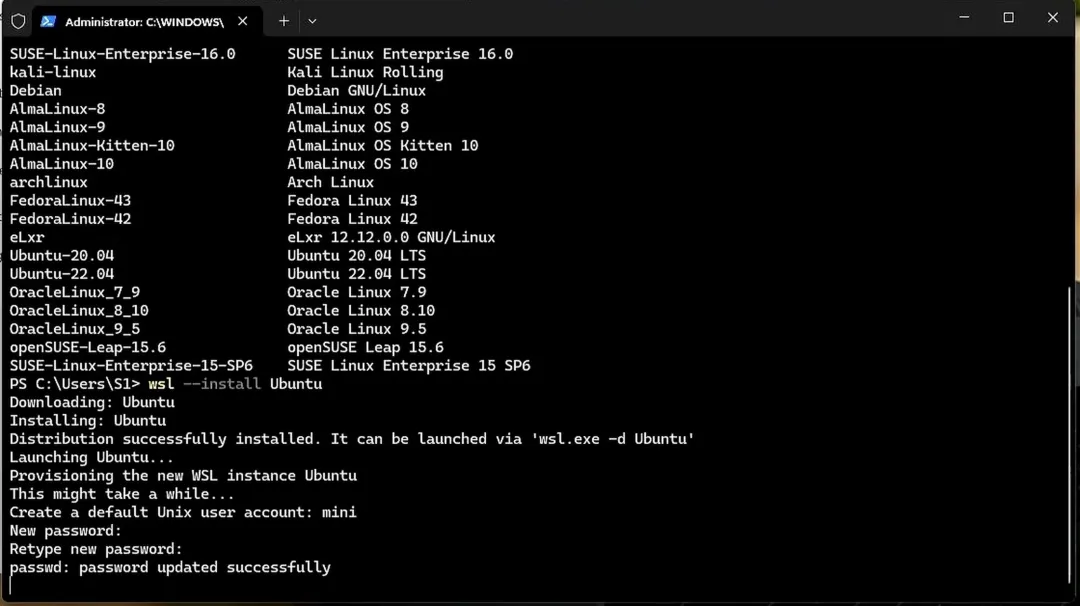

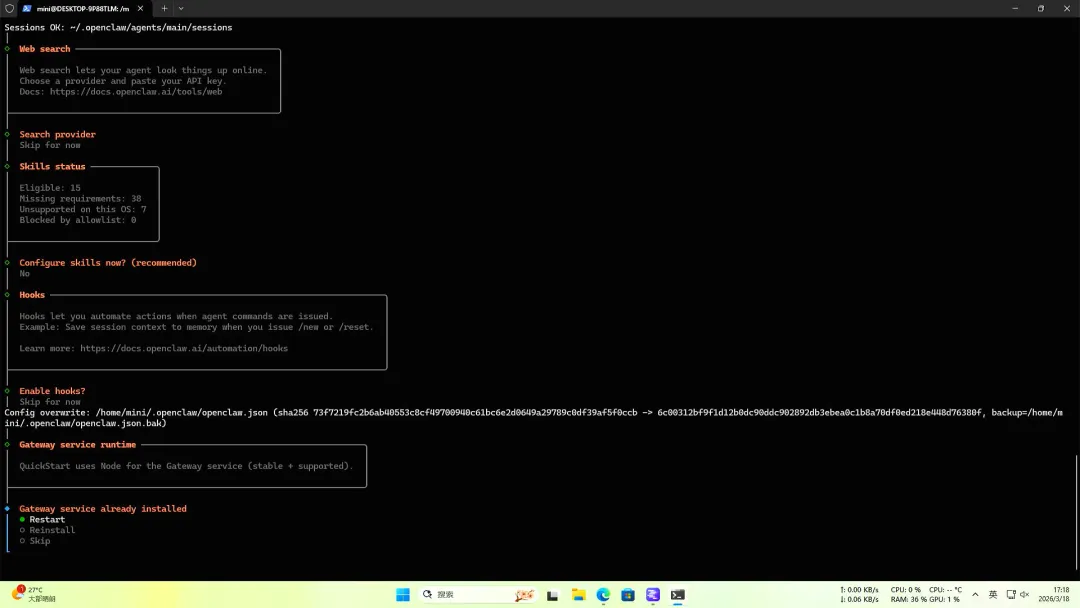

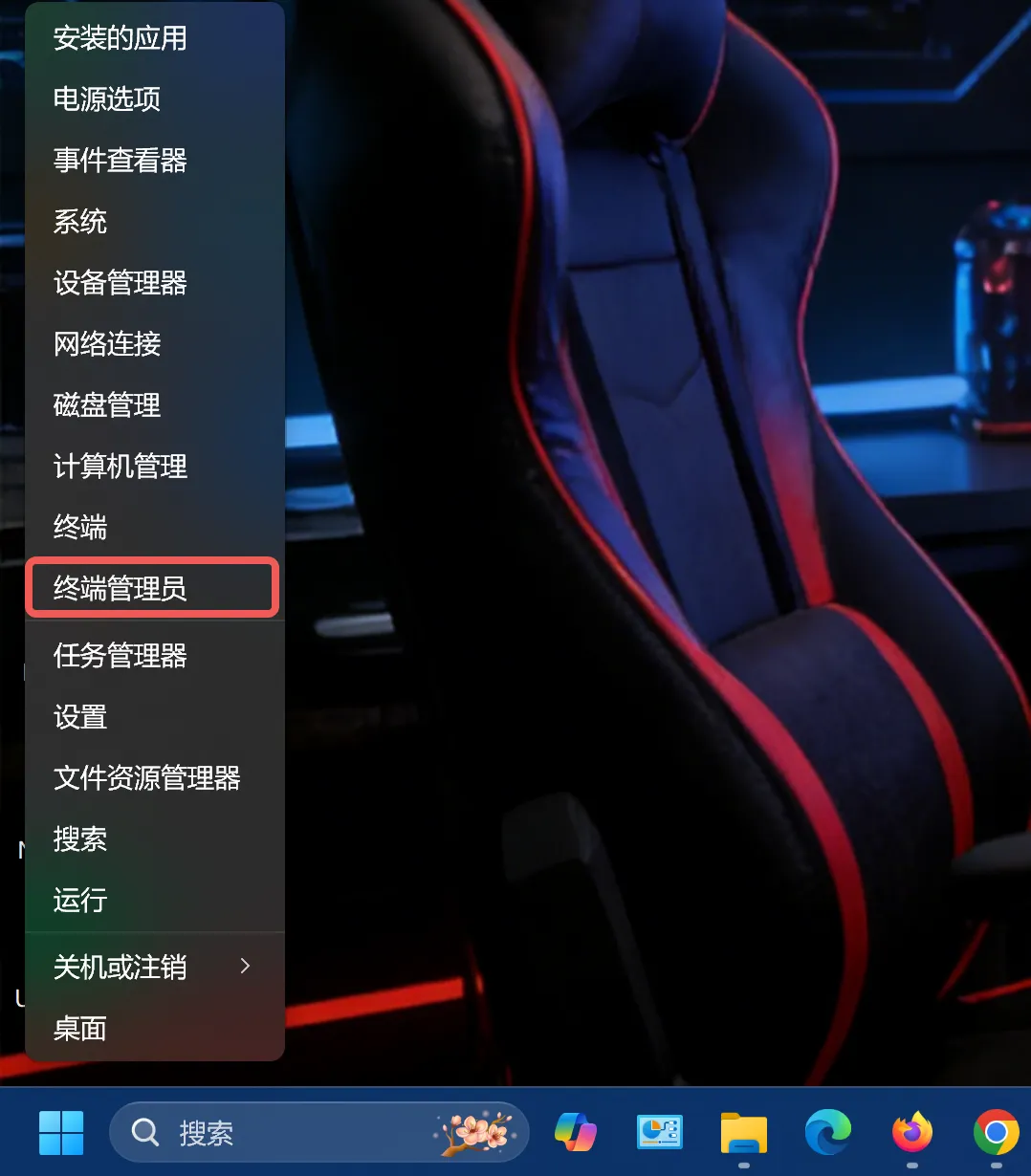

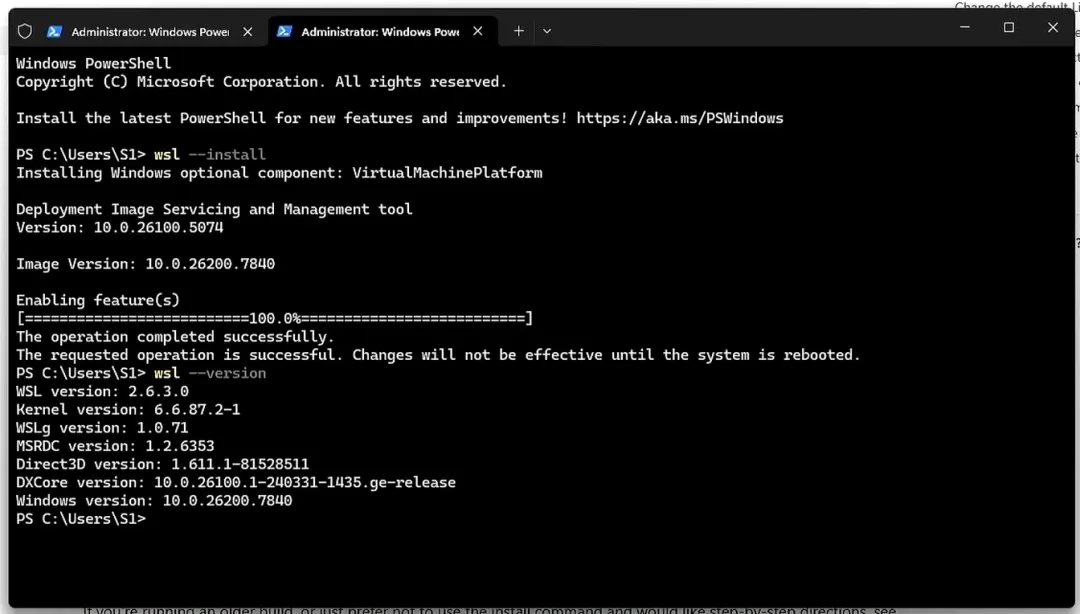

单机开始按钮,打开PowerShell(admin)/终端管理员,安装WSL 2+ Ubuntu系统。

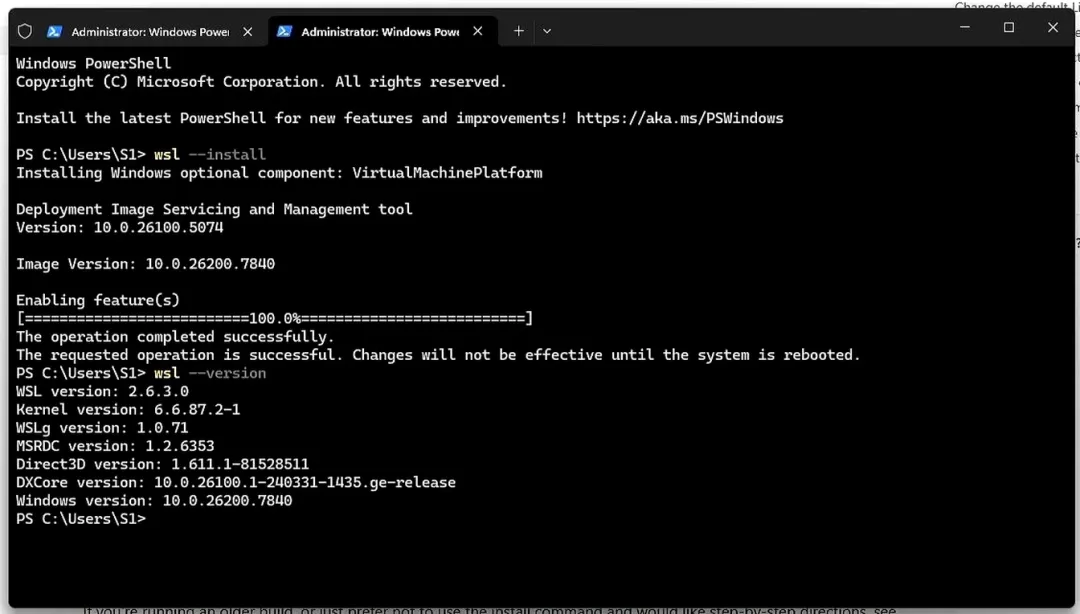

安装WSL 2

wsl --install

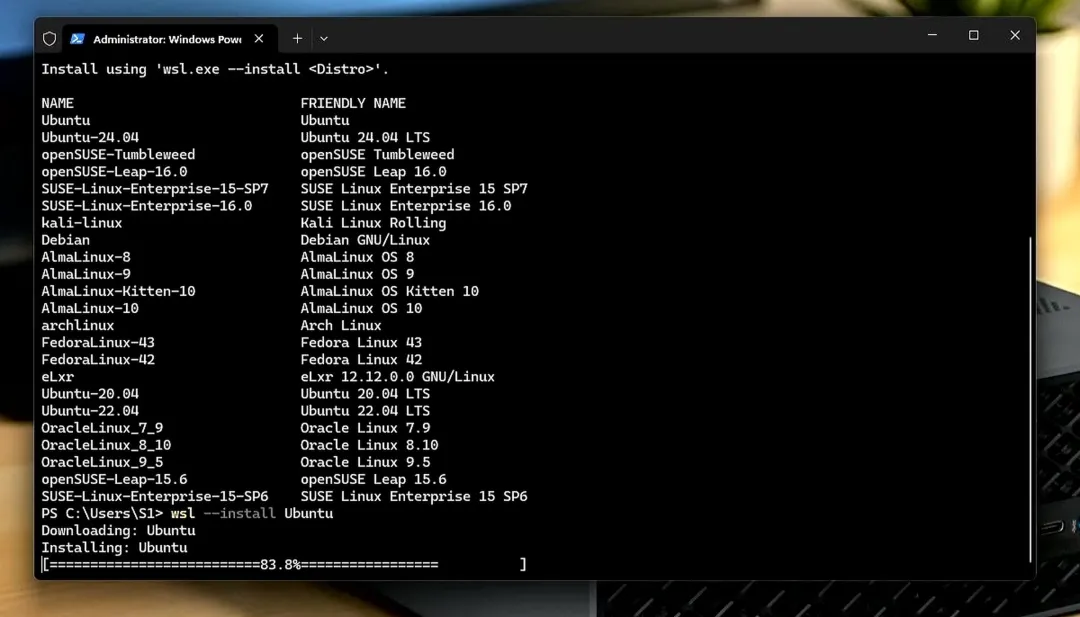

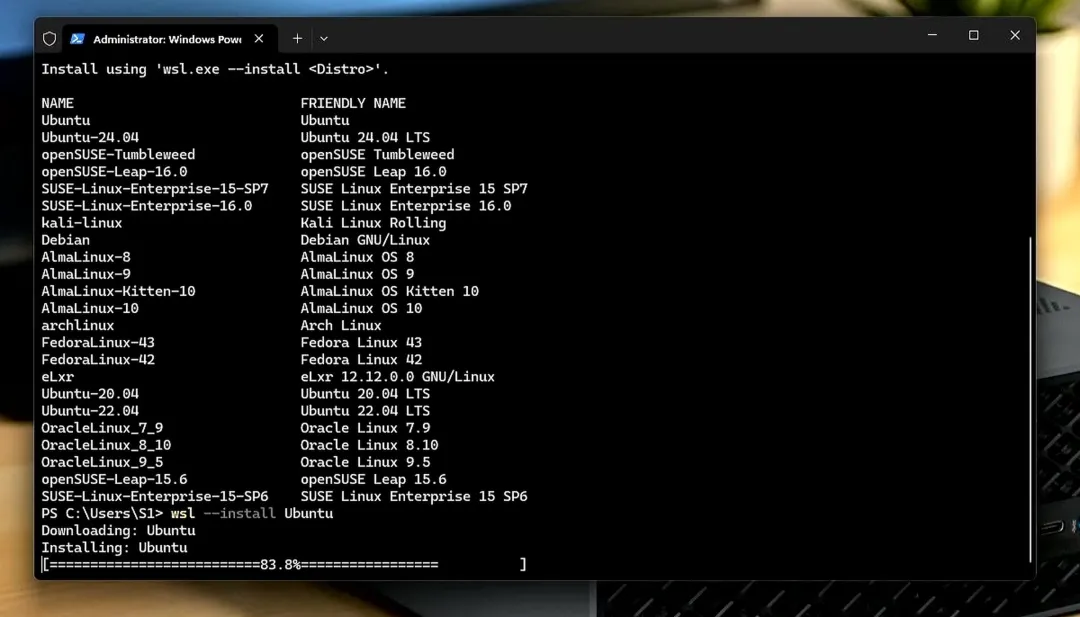

在WSL 2中安装 Ubuntu系统

wsl --install -d Ubuntu-24.04

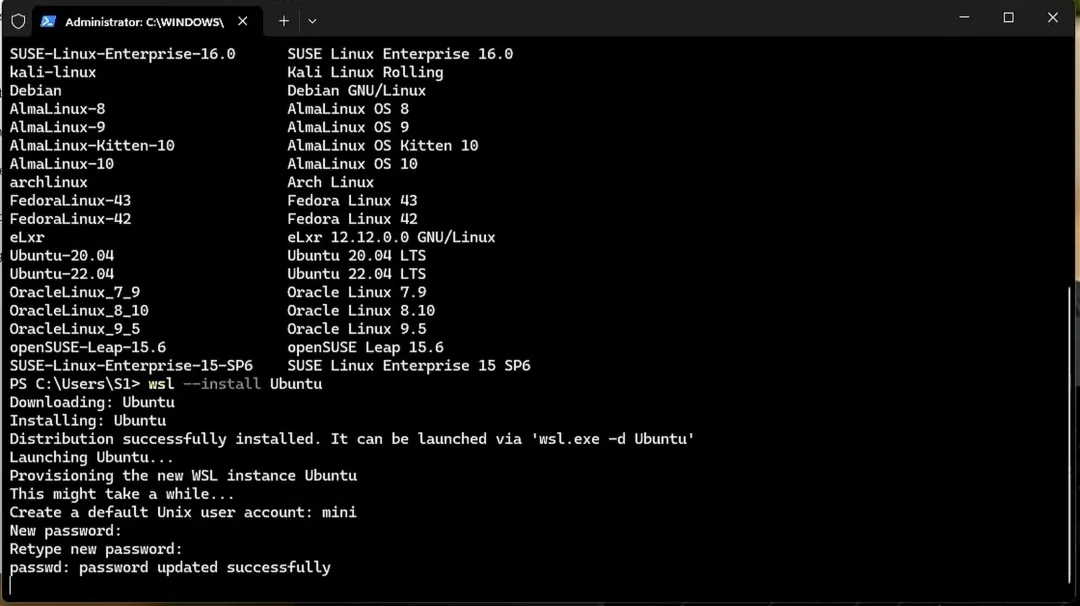

安装完成后,设置用户名和密码,密码输入时,不会显示输入之后直接回车。

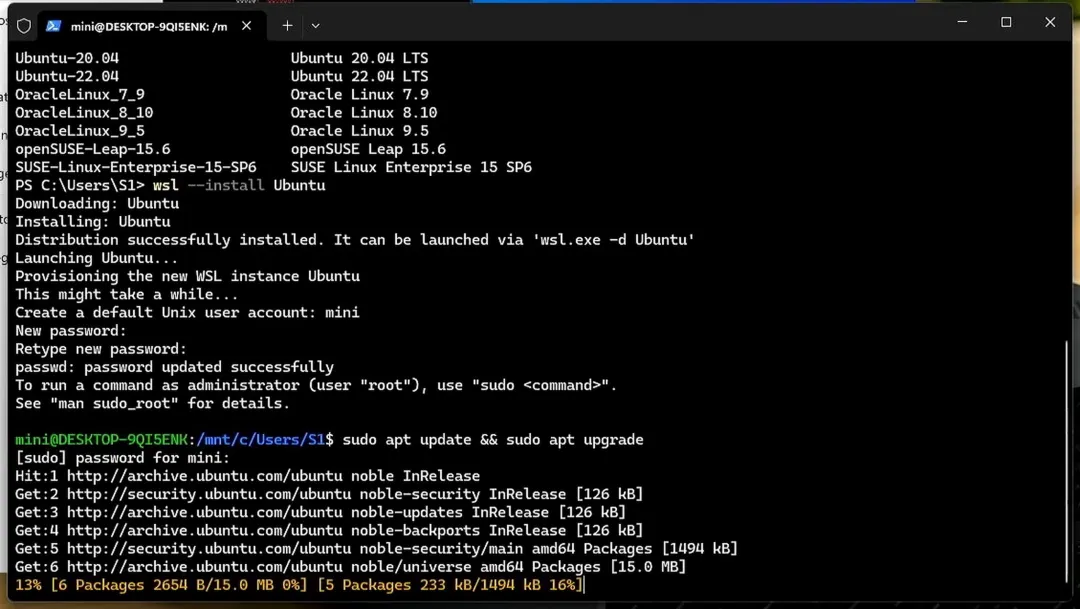

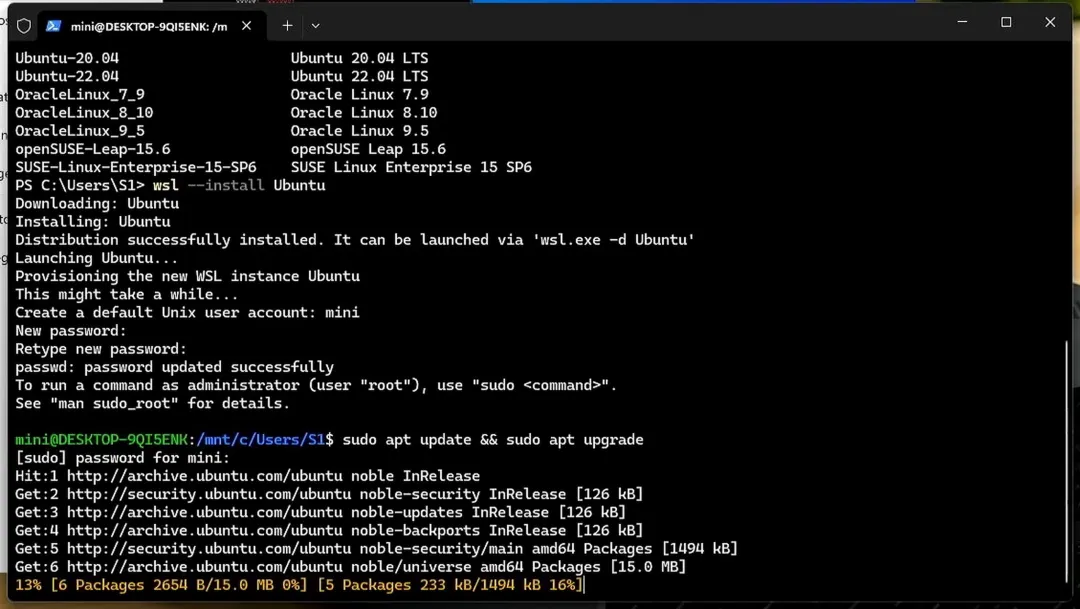

安装完成后,更新系统

sudo apt update && sudo apt upgrade -y

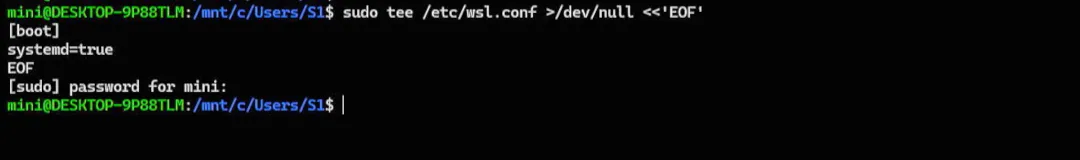

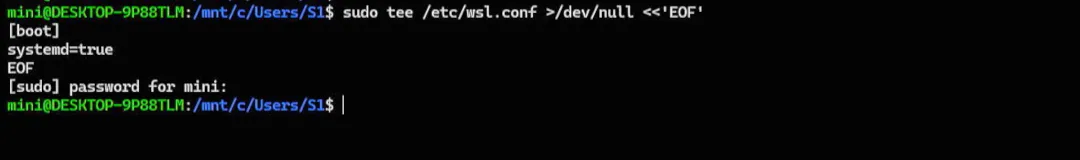

启用systemd(龙虾运行必备)

sudo tee /etc/wsl.conf >/dev/null <<'EOF'[boot]systemd=trueEOF

安装build-essential 编译工具集(推荐)。

build-essential 非强制要求,但却是 WSL 环境下保障安装 / 运行稳定的基础前提

sudo apt-get install build-essential -y重启wsl Ubuntu,关机+开机。(新开一个PowerShell窗口 ,输入以下命令 将wsl 关机)

wsl --shutdown关机之后输入wsl,再开机。

wsl

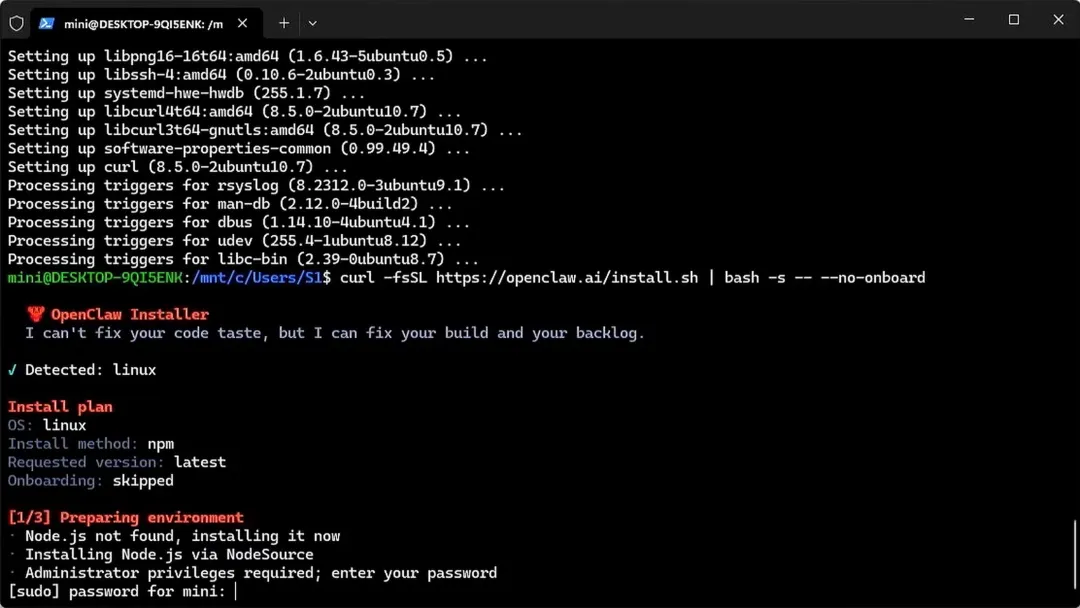

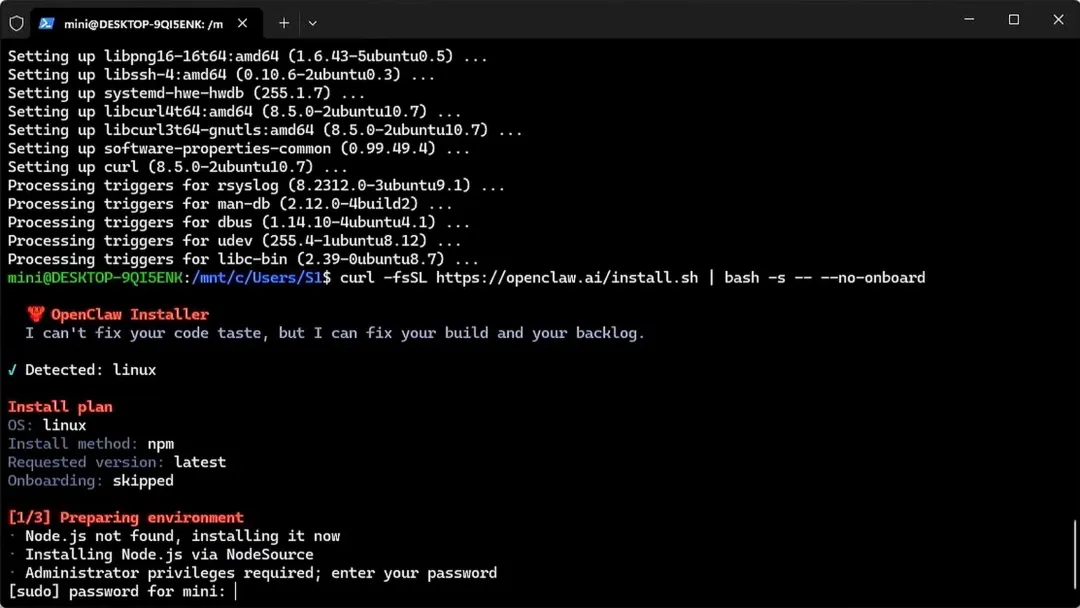

安装龙虾核心程序(macOS / Linux / WSL2)

curl -fsSL https://openclaw.ai/install.sh | bash

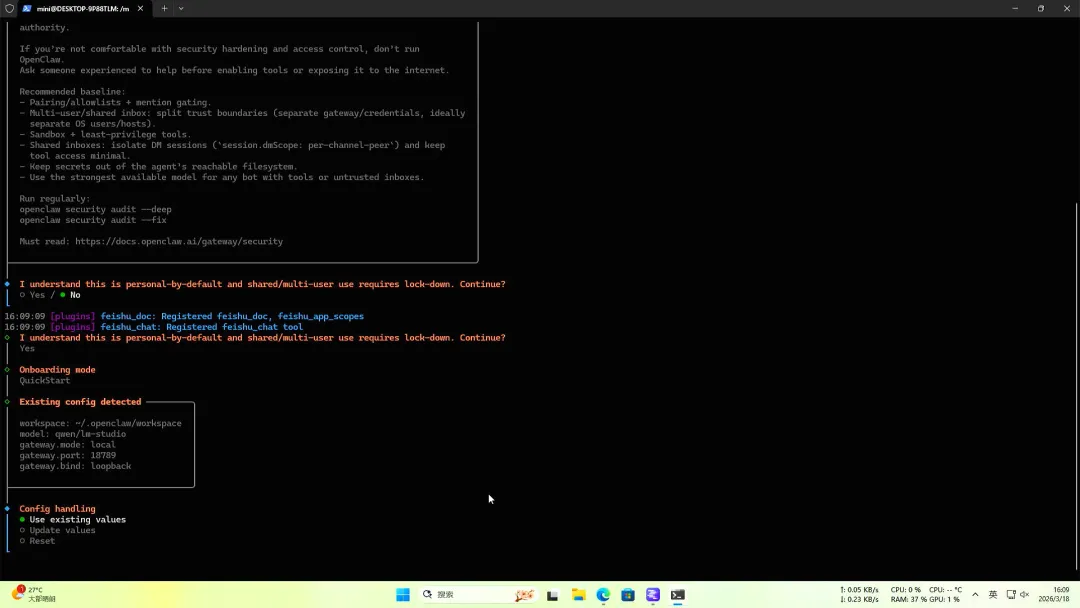

配置OpenClaw

安装完成后默认进入配置,如果未进入,可输入以下命令进入配置

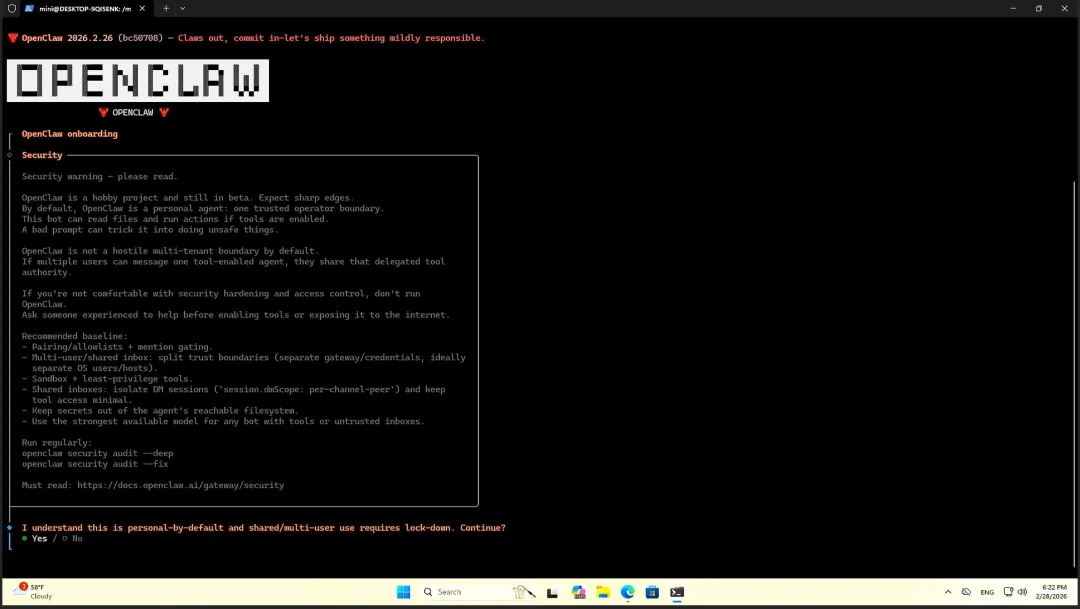

openclaw onborad

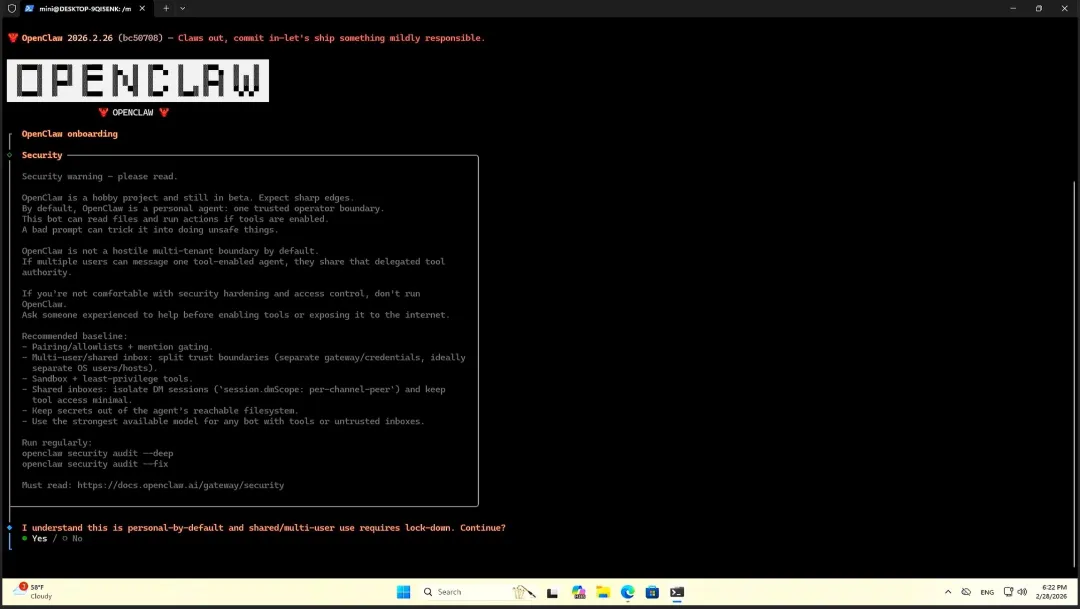

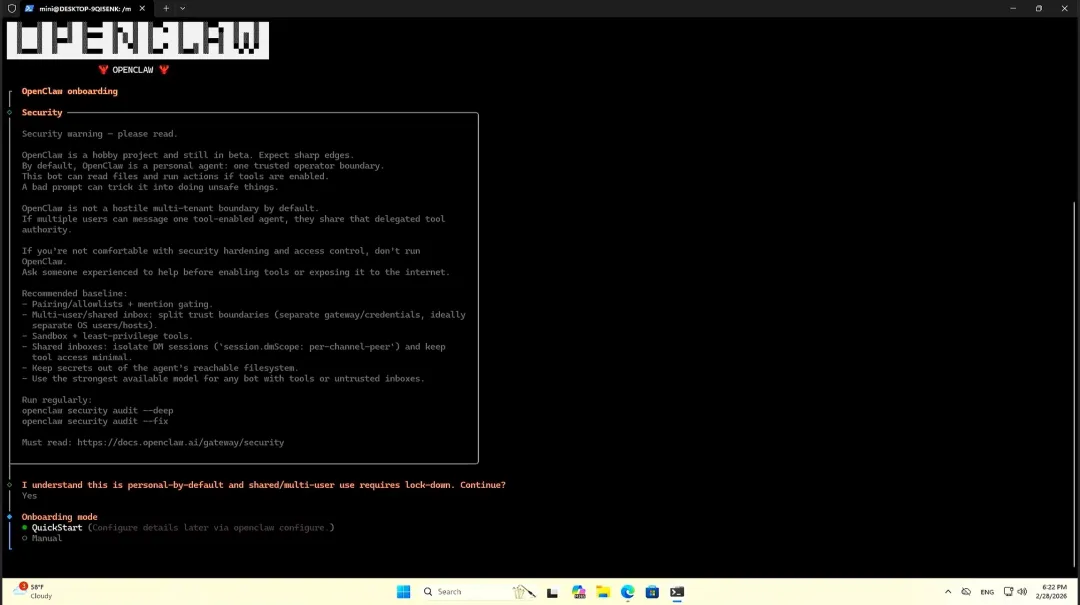

阅读安全警告,按左箭头键导航至“Yes”,然后按回车键继续。

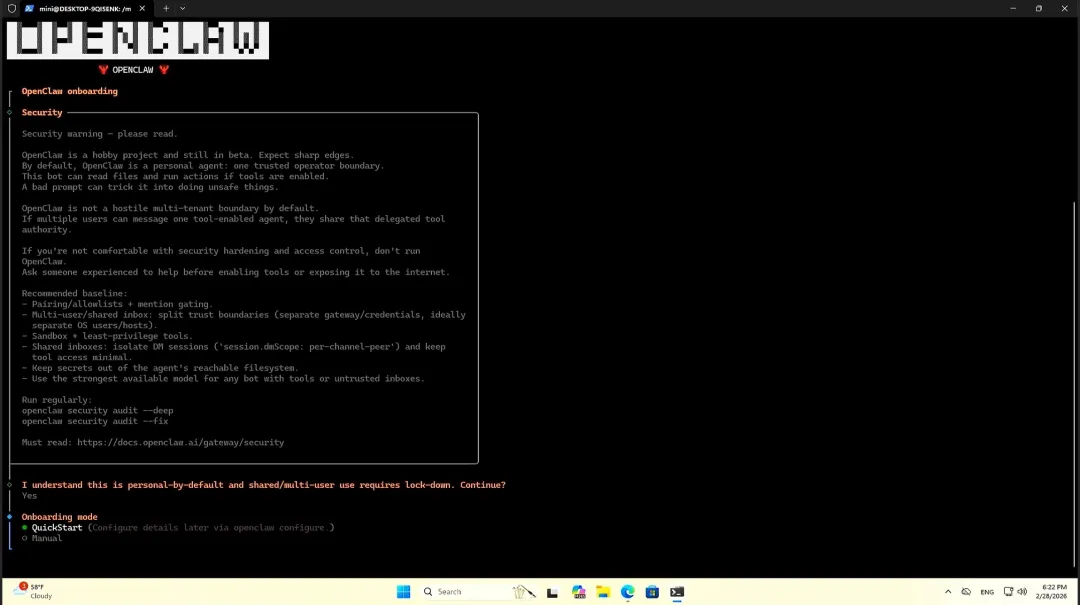

再次按回车键选择“Quick Start/快速开始”。

如果是首次配置,请忽略这一步

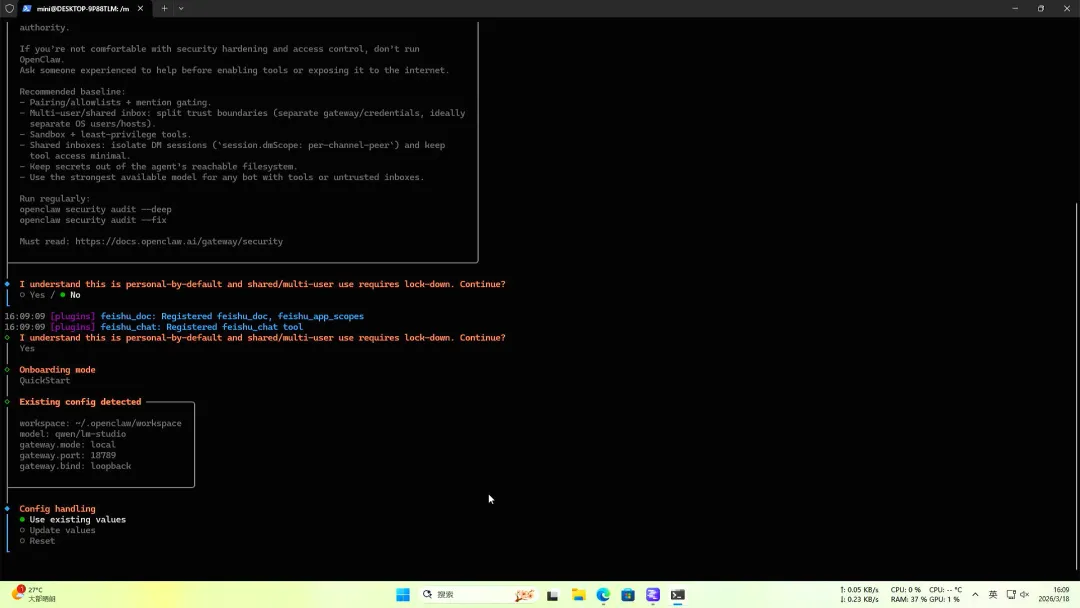

不想改配置,快速启动 → 选 Use existing values;

想改部分配置(换模型 / 加机器人)→ 选 Update values;

配置出错 / 想彻底重配 → 选 Reset。

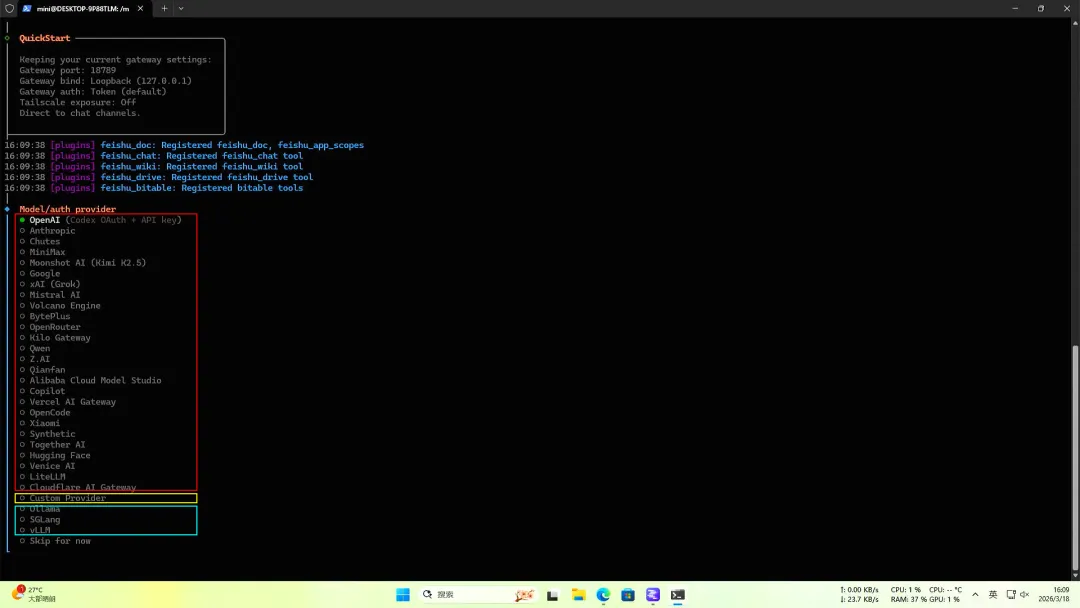

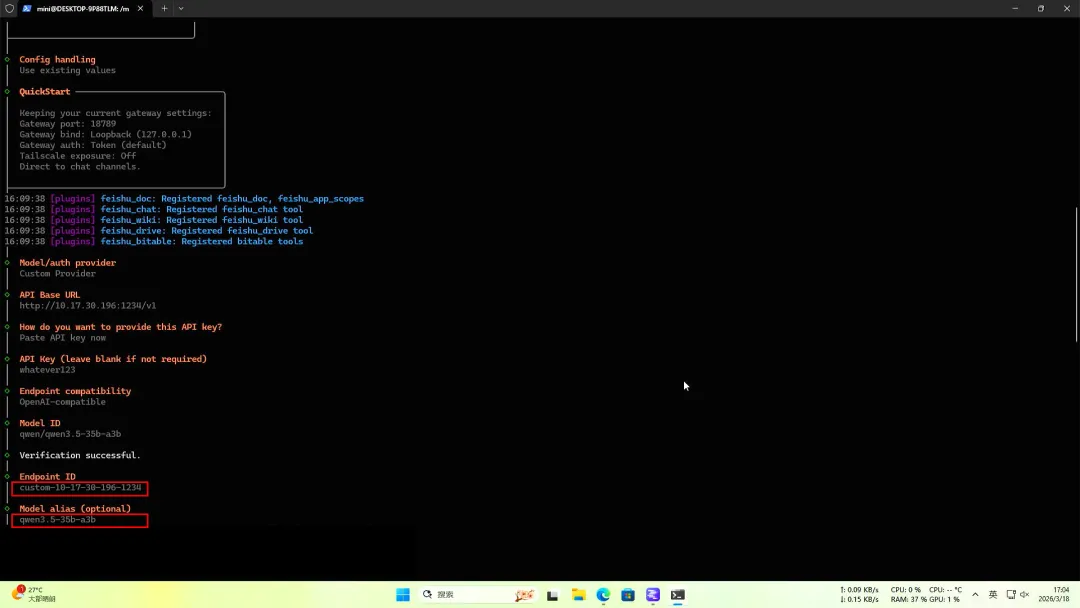

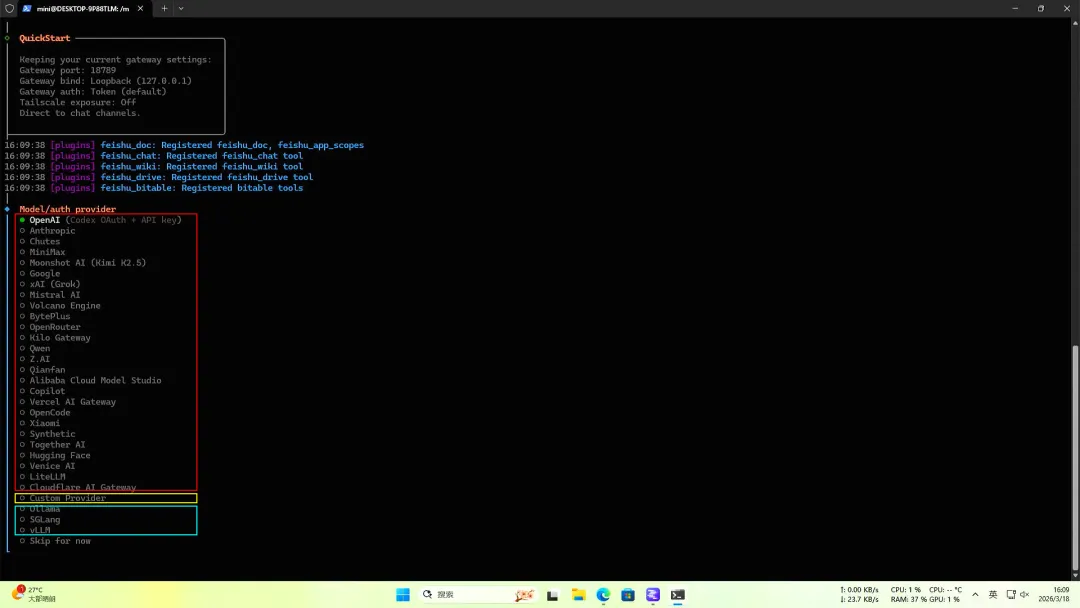

模型选择(从上到下)

红框:云端模型提供商,选择后输入api,即可使用。

黄框:自定义模型提供商/Custom Provider,可用于本地大模型连接,输入API Base URL 即可使用。

蓝框:主流的本地大模型运行框架,输入API Base URL 即可使用。

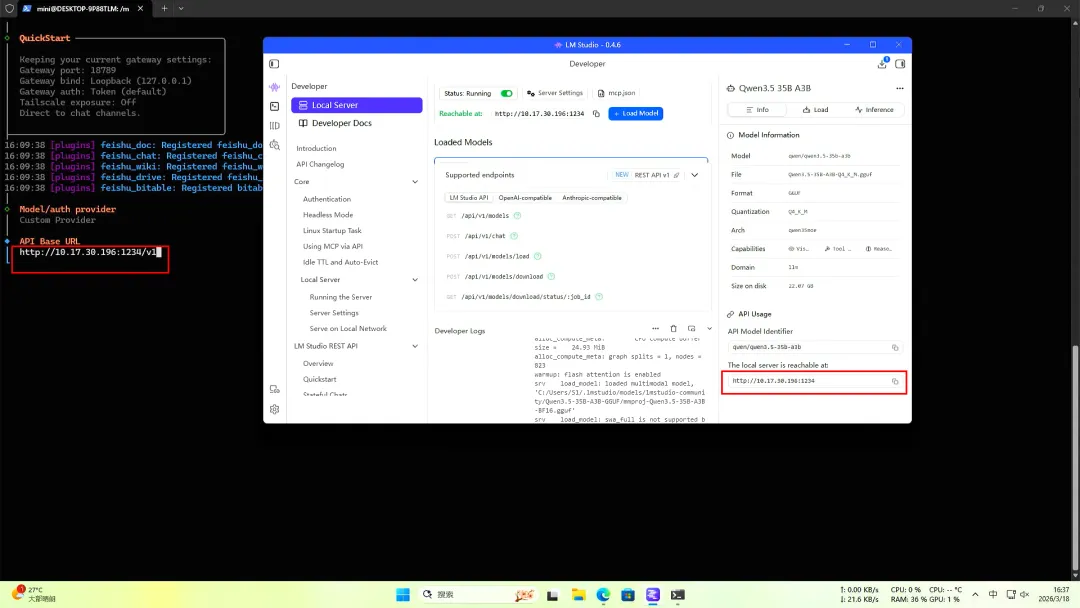

选择Custom Provider,然后打开LM studio -- Local server -- 复制API Base URL 粘贴至配置窗口,并且在最后加/v1 ,比如: http://10.17.30.100:1234/v1

/v1 是 AI 模型 API 的通用版本路径,对齐 OpenAI 接口规范;

不加 /v1 会导致 OpenClaw 无法正确调用模型接口,请求直接失败;

所有兼容 OpenAI 接口的工具(Ollama/SGlang/Kimi/DeepSeek),配置 API Base URL 时都必须加 /v1。

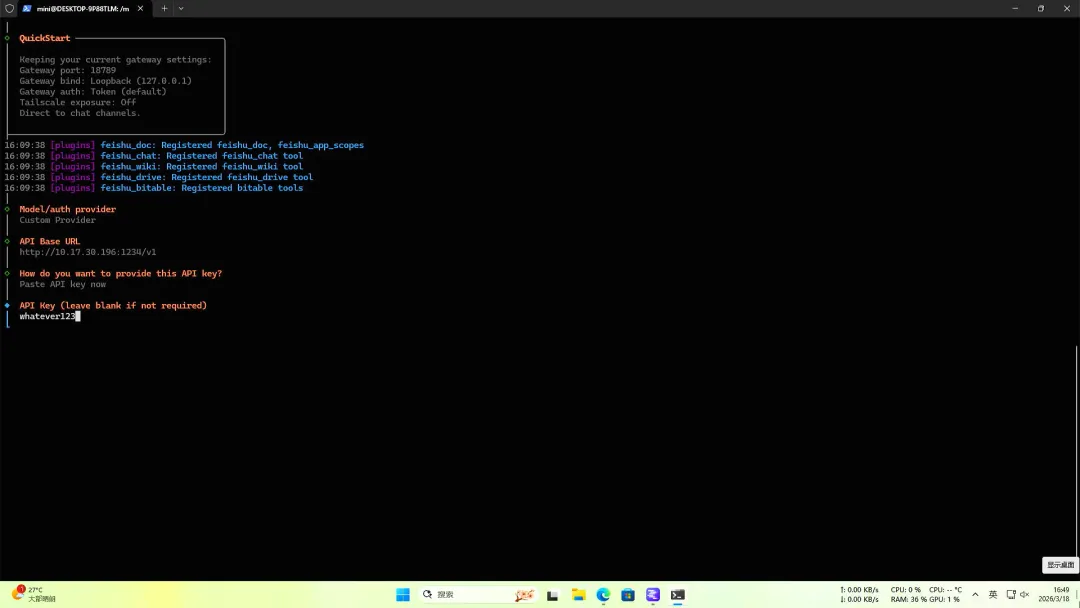

输入API key

本地模型无付费 / 权限管控,API Key 仅为兼容接口格式,无需真实验证即可调用

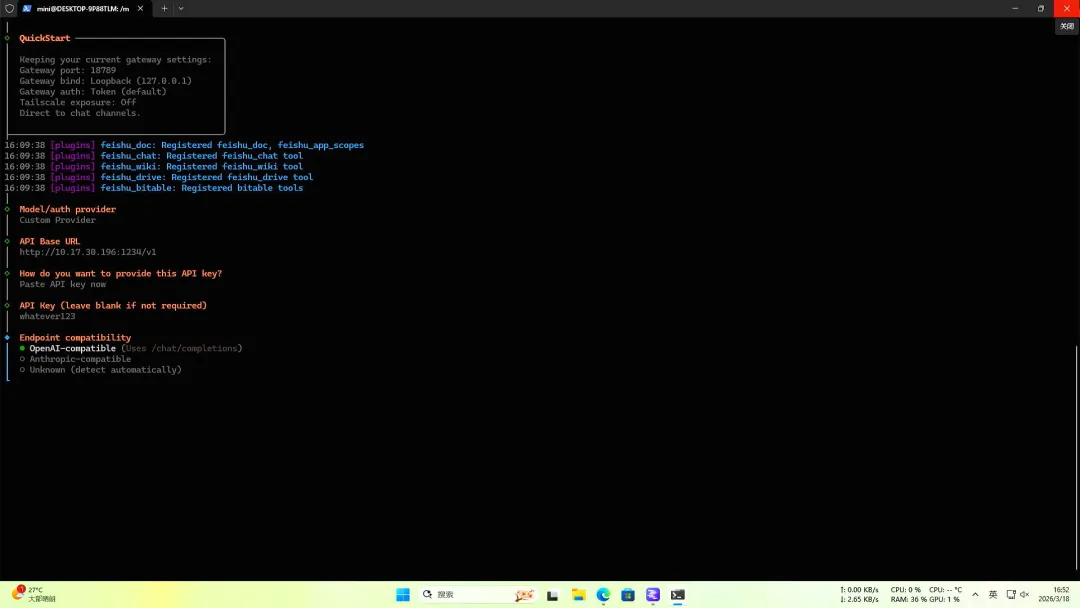

Endpoint compatibility / 端点兼容性,选择OpenAI-compatible (Uses /chat/completions)

本地模型永远选 OpenAI-compatible,Anthropic 只用在 Claude 云端。

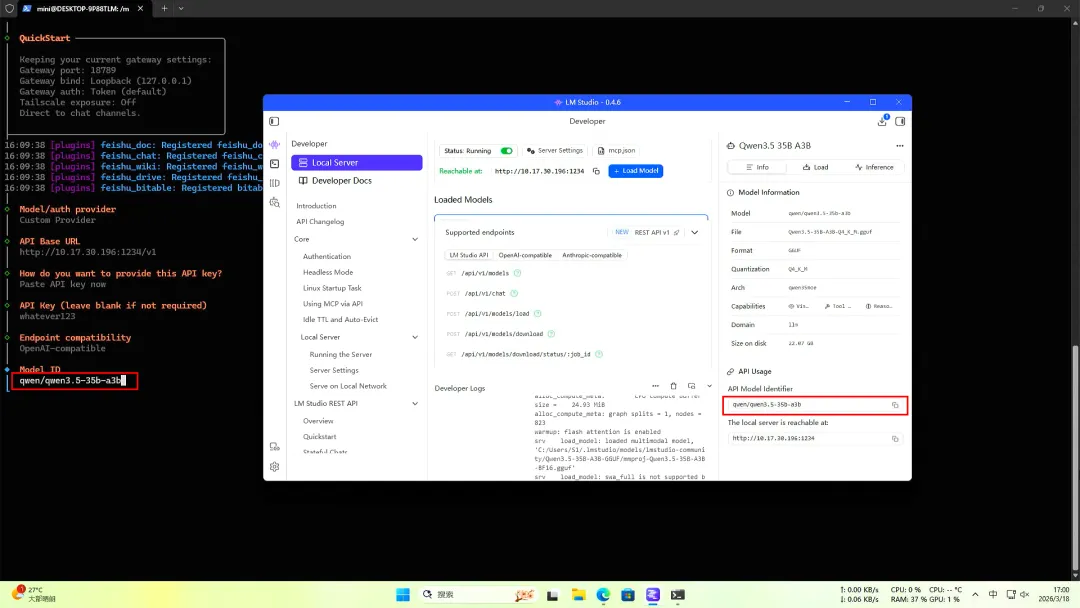

Model ID ,从 LM studio -- Local server -- 复制API Model Identifier 粘贴至配置窗口

Model ID 是本地模型的唯一身份标识,OpenClaw 靠它精准找到并调用对应的本地模型,输错会直接导致模型调用失败,必须和本地实际运行的模型 ID 完全一致。

Endpoint ID:可以保持默认,或者自行输入

Model alias:填一个好记的名字,比如 Qwen3.5-Local

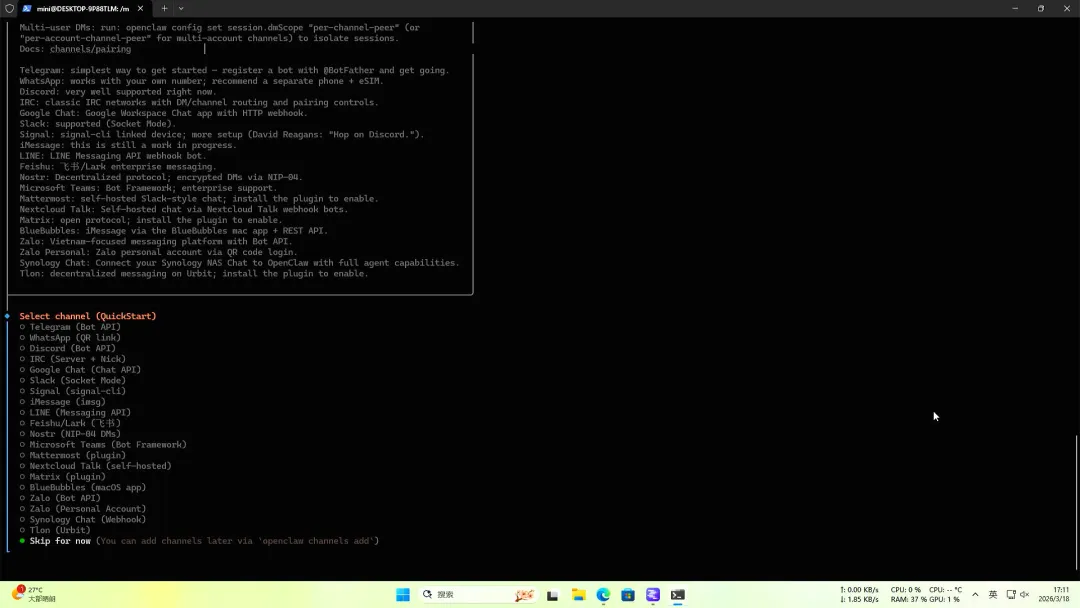

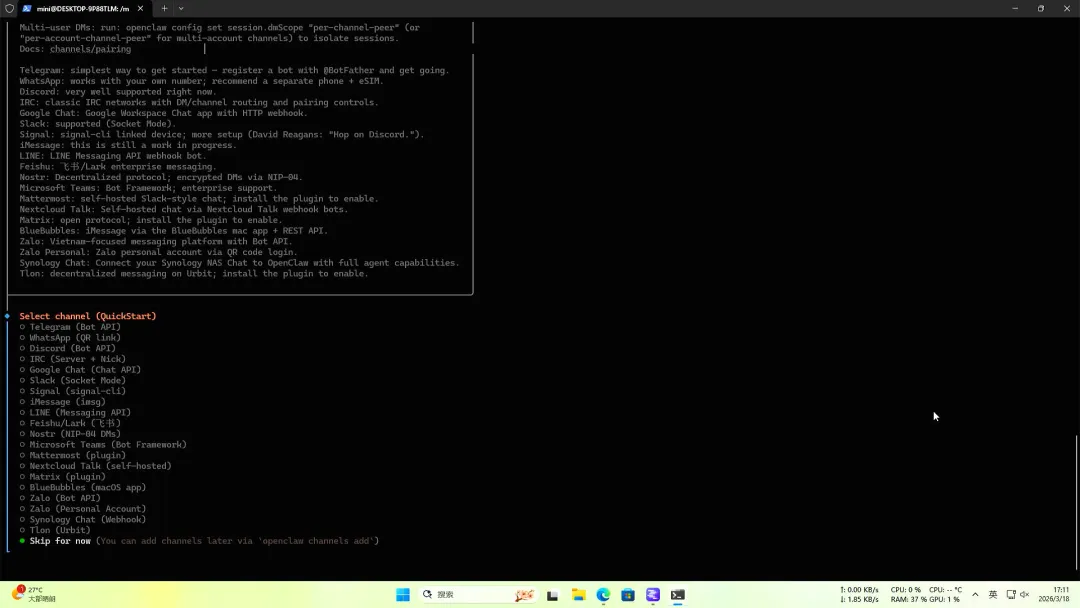

聊天工具添加,可以选最后一个:先跳过。

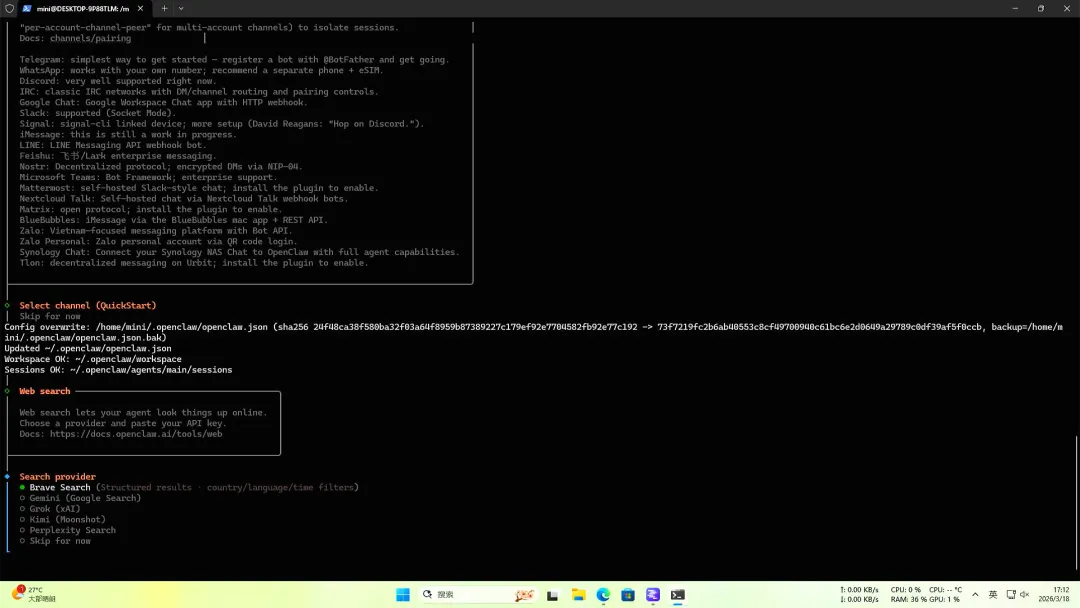

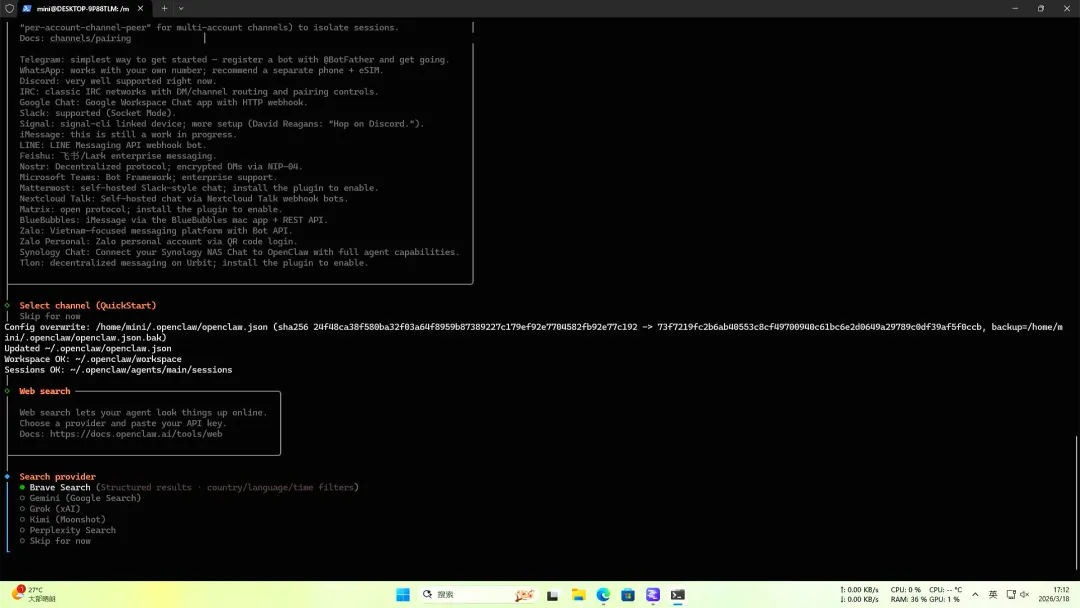

Search provider /搜索提供商,可以先跳过,后续有API之后再添加也可以。

Search provider = 给OpenClaw装上 “联网搜索引擎”

作用是让 AI 能实时查互联网最新消息、查事实、查数据,而不是只靠训练的旧知识回答。

没有它会怎样?AI 只能用训练时的旧知识回答,不知道今天发生什么,也不能上网查。

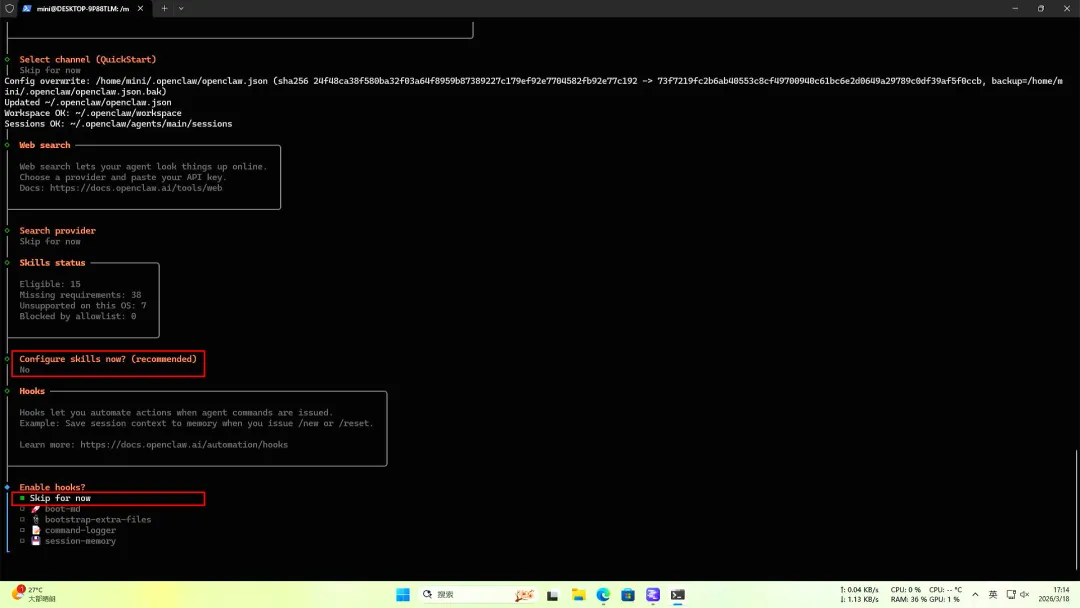

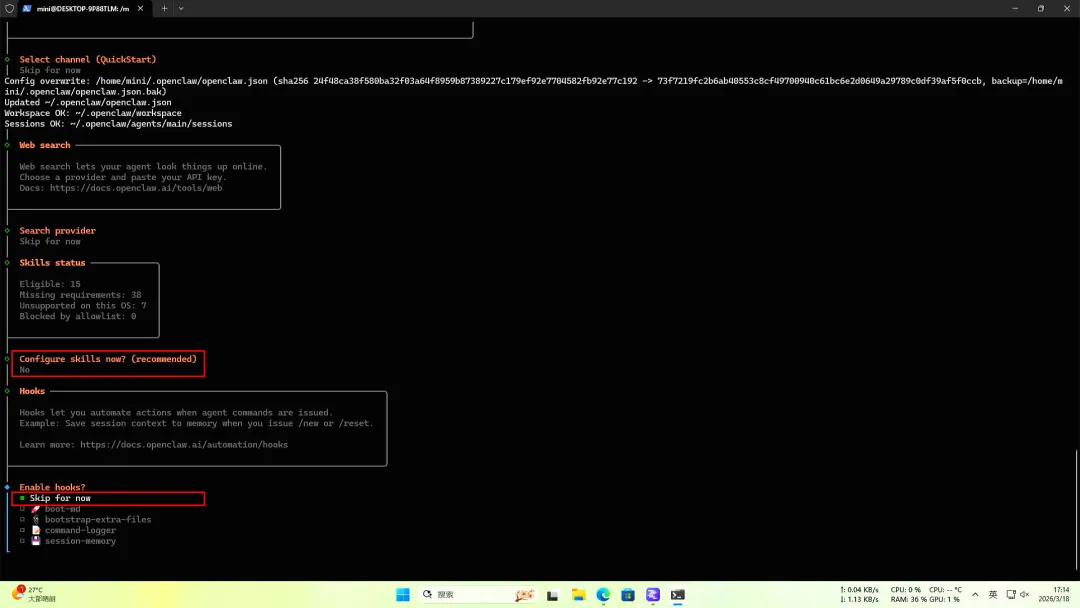

Skills(技能)和 hooks(钩子)完全可以先跳过,优先完成核心配置让 OpenClaw 能正常调用模型,后续再按需添加,新手不用纠结。

后续添加方式:

技能:openclaw dashboard 网页控制台 → 技能市场 → 一键安装;

钩子:配置文件 ~/.openclaw/openclaw.json 中手动添加,或控制台可视化配置。

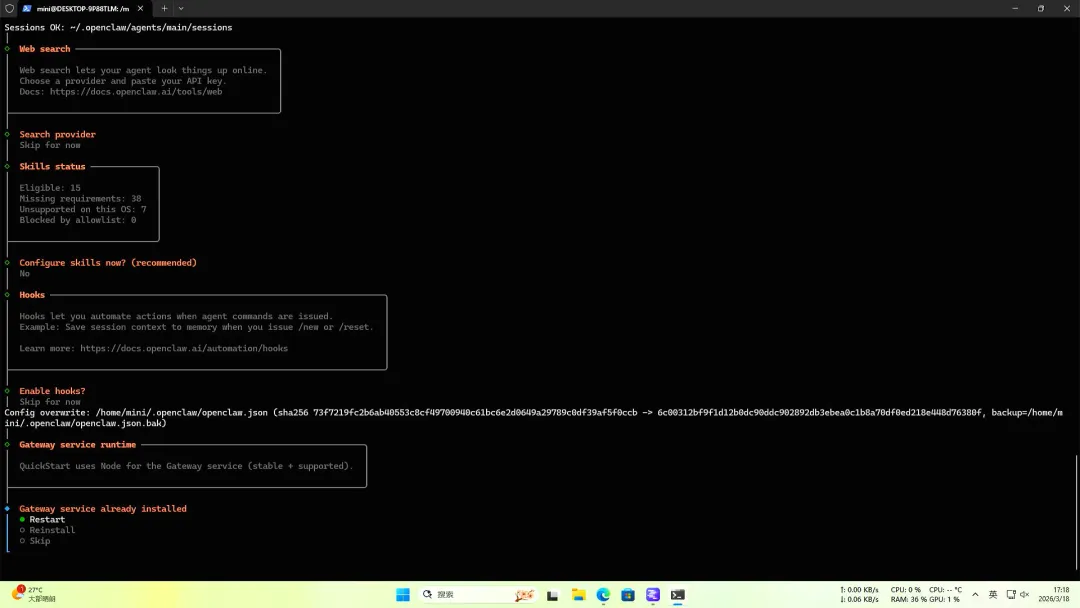

选择restart。

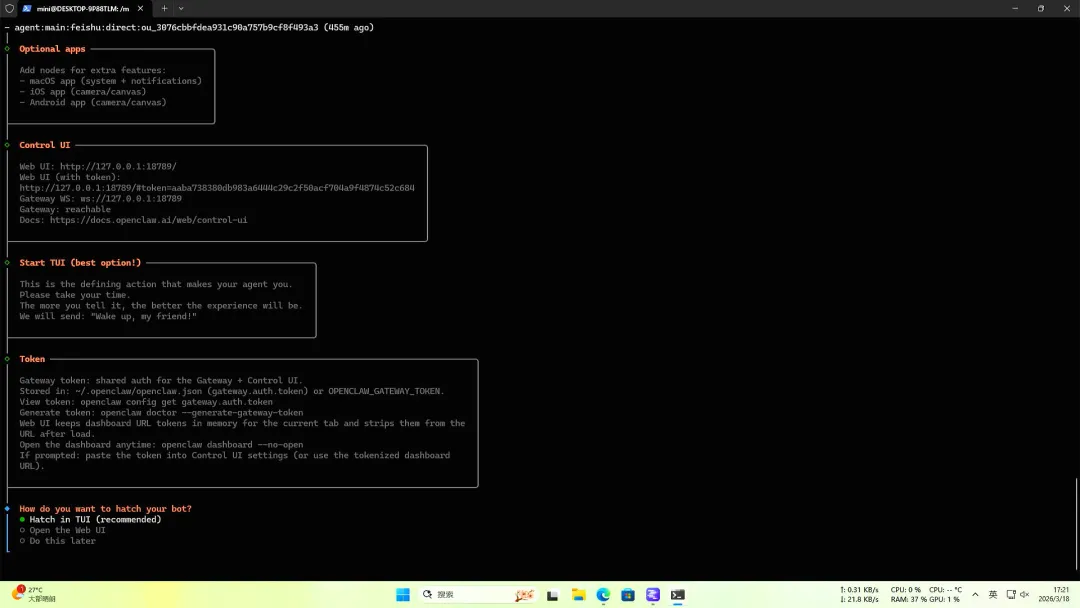

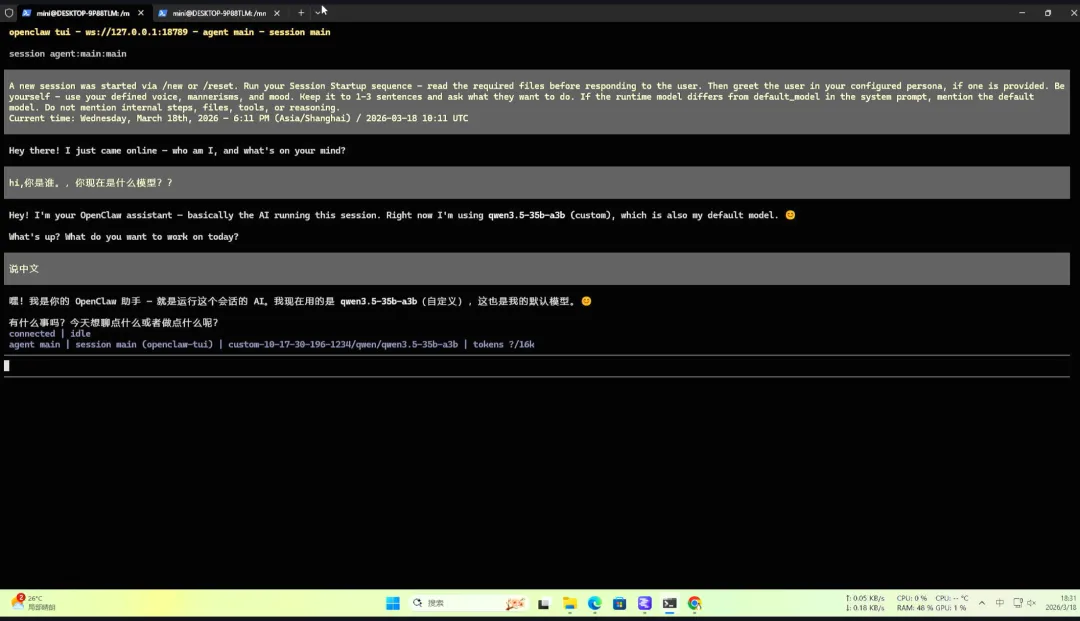

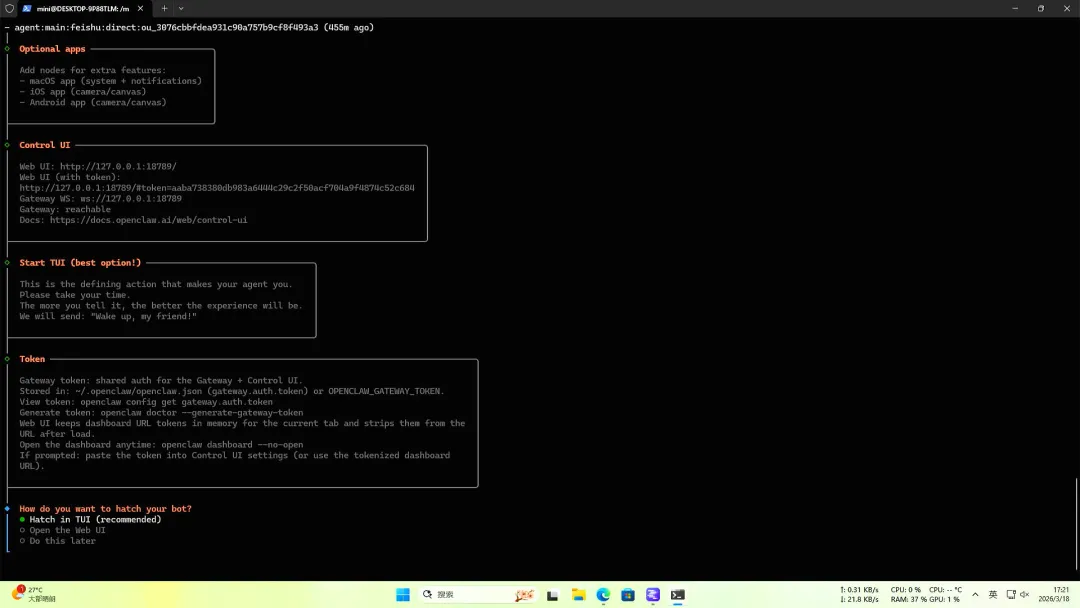

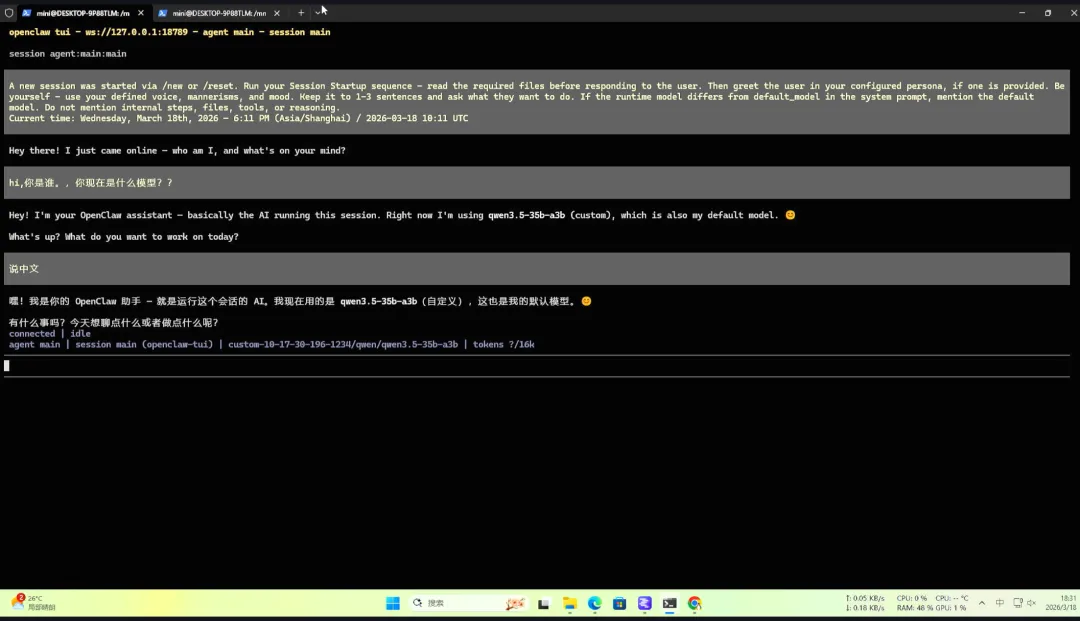

优先选 Hatch in TUI (recommended)

新手零门槛:终端里按提示一步步选(模型、渠道、参数),不用折腾网页 / 端口;

兼容性最好:WSL/Ubuntu 纯命令行环境也能操作,不会出现 Web UI 打不开的问题;

效率最高:5 分钟就能完成核心配置,直接让机器人 “孵化” 可用。

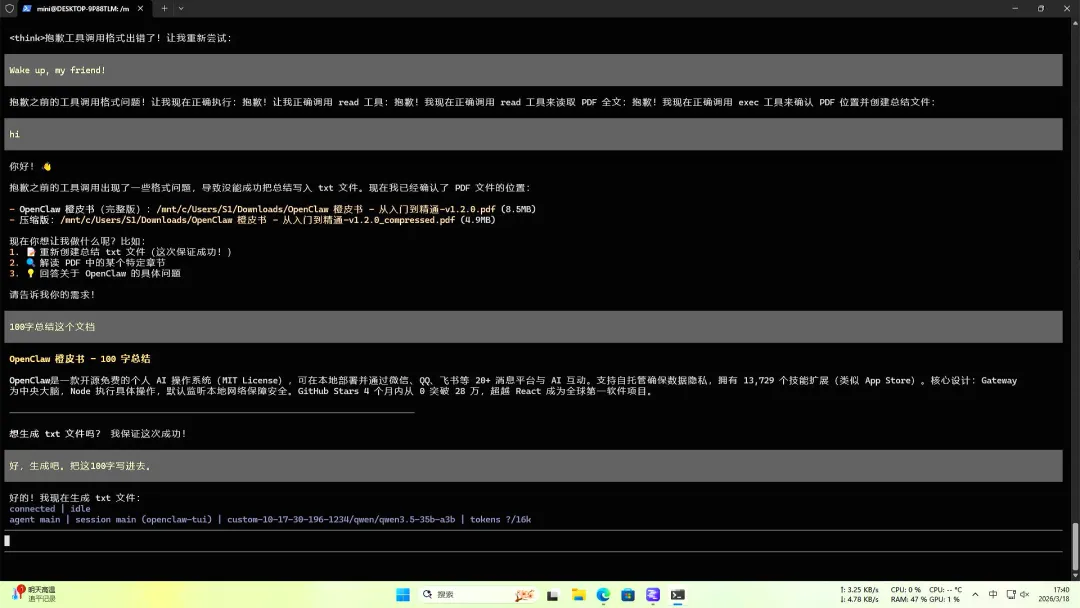

安装完成

至此,openclaw核心程序安装完成。

其余Skills 和更多用法配置,可自行添加扩展。

OpenClaw

安装+云端模型

适用于所有Windows11 迷你主机。

OpenClaw安装步骤

单机开始按钮,打开PowerShell(admin)/终端管理员,安装WSL 2+ Ubuntu系统。

安装WSL 2

wsl --install

在WSL 2中安装 Ubuntu系统

wsl --install -d Ubuntu-24.04

安装完成后,设置用户名和密码,密码输入时,不会显示输入之后直接回车。

安装完成后,更新系统

sudo apt update && sudo apt upgrade -y

启用systemd(龙虾运行必备)

sudo tee /etc/wsl.conf >/dev/null <<'EOF'[boot]systemd=trueEOF

安装build-essential 编译工具集(推荐)。

build-essential 非强制要求,但却是 WSL 环境下保障安装 / 运行稳定的基础前提

sudo apt-get install build-essential -y

重启wsl Ubuntu,关机+开机。

wsl --shutdown

关机之后输入wsl,再开机。

wsl

安装龙虾核心程序(macOS / Linux / WSL2)

curl -fsSL https://openclaw.ai/install.sh | bash

配置OpenClaw

安装完成后默认进入配置,如果未进入,可输入以下命令进入配置

openclaw onborad

阅读安全警告,按左箭头键导航至“Yes”,然后按回车键继续。

再次按回车键选择“Quick Start/快速开始”。

如果是首次配置,请忽略这一步

不想改配置,快速启动 → 选 Use existing values;

想改部分配置(换模型 / 加机器人)→ 选 Update values;

配置出错 / 想彻底重配 → 选 Reset。

模型选择(从上到下)

红框:云端模型提供商,选择后输入api,即可使用

黄框:自定义模型提供商/Custom Provider,可用于本地大模型连接,输入API Base URL 即可使用

蓝框:主流的本地大模型运行框架,输入API Base URL 即可使用

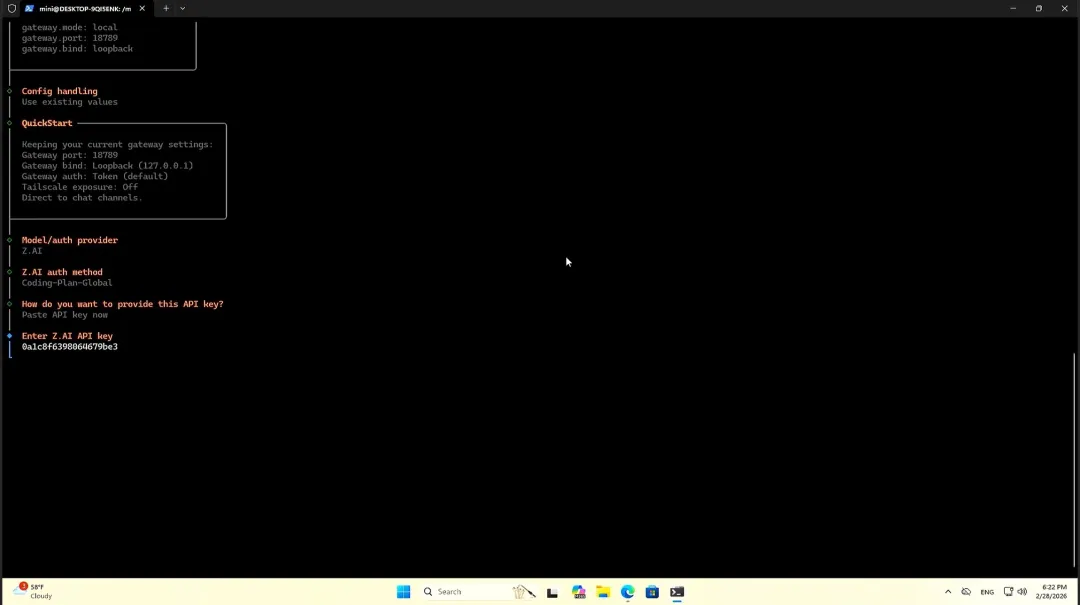

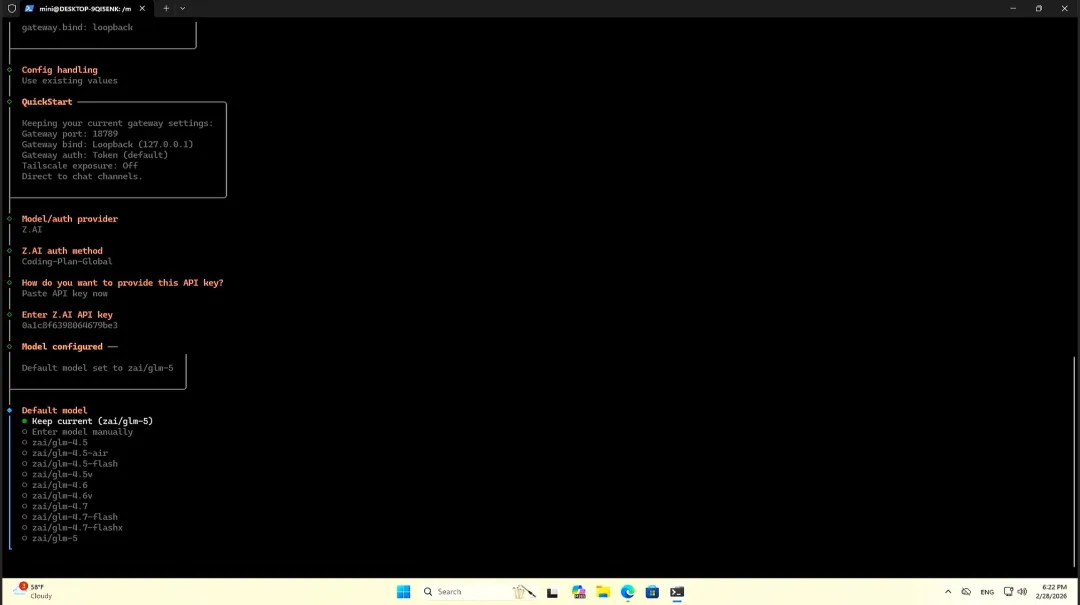

举例:此次选择Z.AI,作为云端模型。

打开官网https://bigmodel.cn/,注册账号,进入控制台

https://bigmodel.cn/console/overview

输入API KEY

选择在线模型的版本,一般保持第一个默认=最新模型。

至此,在线模型配置完成。

聊天工具添加,可以选最后一个:先跳过。

Search provider /搜索提供商,可以先跳过,后续有API之后再添加也可以。

Search provider = 给你的龙虾(OpenClaw)装上 “联网搜索引擎”

作用是让 AI 能实时查互联网最新消息、查事实、查数据,而不是只靠训练的旧知识回答。

没有它会怎样?AI 只能用训练时的旧知识回答,不知道今天发生什么,也不能上网查。

Skills(技能)和 hooks(钩子)完全可以先跳过,优先完成核心配置让 OpenClaw 能正常调用模型,后续再按需添加,新手不用纠结。

后续添加方式:

技能:openclaw dashboard 网页控制台 → 技能市场 → 一键安装;

钩子:配置文件 ~/.openclaw/openclaw.json 中手动添加,或控制台可视化配置。

选择restart

优先选 Hatch in TUI (recommended)

新手零门槛:终端里按提示一步步选(模型、渠道、参数),不用折腾网页 / 端口;

兼容性最好:WSL/Ubuntu 纯命令行环境也能操作,不会出现 Web UI 打不开的问题;

效率最高:5 分钟就能完成核心配置,直接让机器人 “孵化” 可用。

安装完成

至此,openclaw核心程序安装完成。

其余Skills 和更多用法配置,可自行添加扩展。

海外用户

可参考AMD官方教程Run OpenClaw Locally On AMD Ryzen™ AI Max+ Processors and Radeon™ GPUs。

https://www.amd.com/en/resources/articles/run-openclaw-locally-on-amd-ryzen-ai-max-and-radeon-gpus.html#studio-setup

免责声明

本 OpenClaw 安装指南(以下简称“指南”),仅为普通 Windows11 迷你主机提供 OpenClaw 软件基础安装步骤指导,确保软件可正常启动。

1. 本指南仅承诺指导完成 OpenClaw 安装,不提供后续技术支持、故障排查及软件升级服务。

2. 安装后软件运行异常、兼容性问题等,均不属于本指南支持范围,用户需自行联系软件官方解决。

3. 因用户操作失误、系统/硬件不兼容等导致的故障、数据丢失,发布方不承担责任及赔偿。

4. 软件本身质量、稳定性由其官方负责,本指南仅提供安装指导,不做任何质量承诺。

5. 本指南内容仅供参考,发布方可随时修改,不另行通知;用户使用即视为认可本声明全部条款。

夜雨聆风

夜雨聆风