为什么这类问题适合用 Chaterm 处理

传统排错常见痛点是:报错看不懂、步骤不确定、修完不敢信、下次还得重来。

Chaterm 的优势在于把排错过程变成一个可迭代闭环:把完整报错原文直接输入 AI 对话,避免信息丢失

同时给出目标结果(例如“恢复飞书响应”“读取 /opt/openclaw.txt”)

按步骤执行后立即验证

若失败,把新错误继续回传,快速收敛到正确解

核心不是“记命令”,而是“让排错基于证据持续推进”。

1. 对话卡住了:先把入口找回来

我在阿里云服务器上完成了 OpenClaw 安装,并接入飞书。联调开始后,和我飞书上的小龙虾🦞对话没有回信。

为了验证是不是大模型没配好,我想先登录 OpenClaw 的 Web管理界面,但不记得 UI 的访问 URL 和 Token。

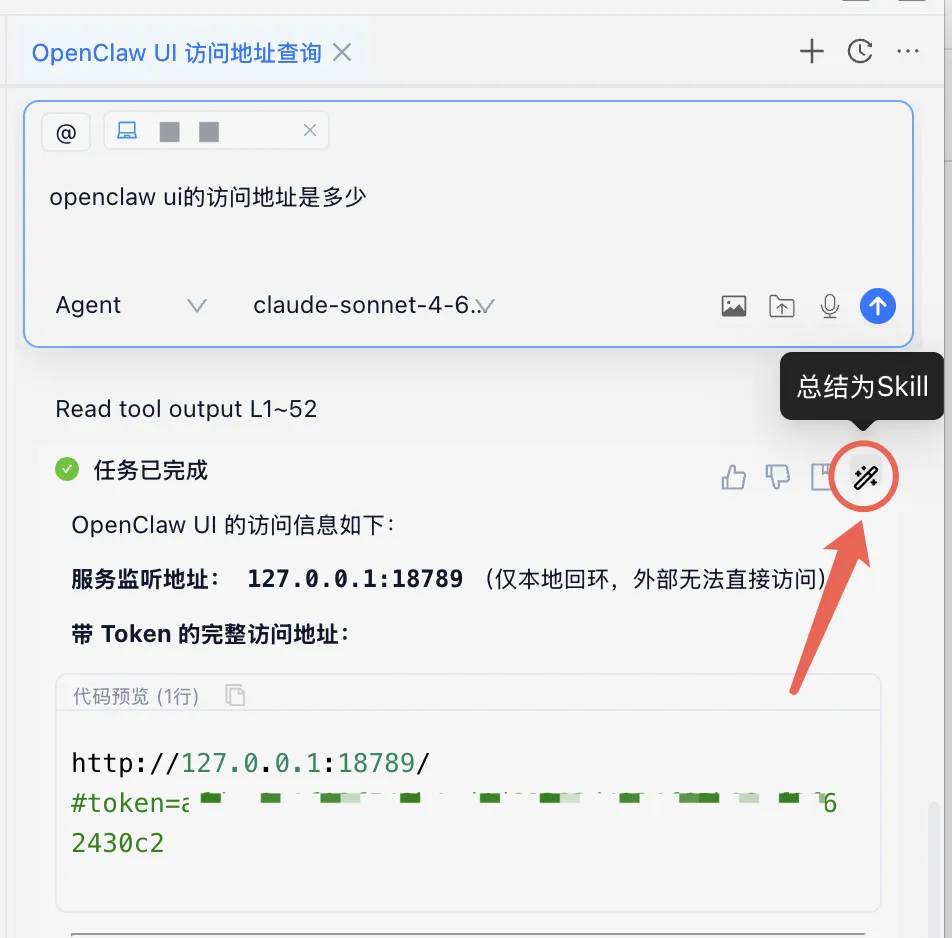

于是我直接把问题丢给 Chaterm:OpenClaw UI 的访问地址是多少。通过和 Chaterm 的几轮对话,我很快拿到了带 Token 的完整访问地址。

2. 确认模型侧正常:别急着下结论

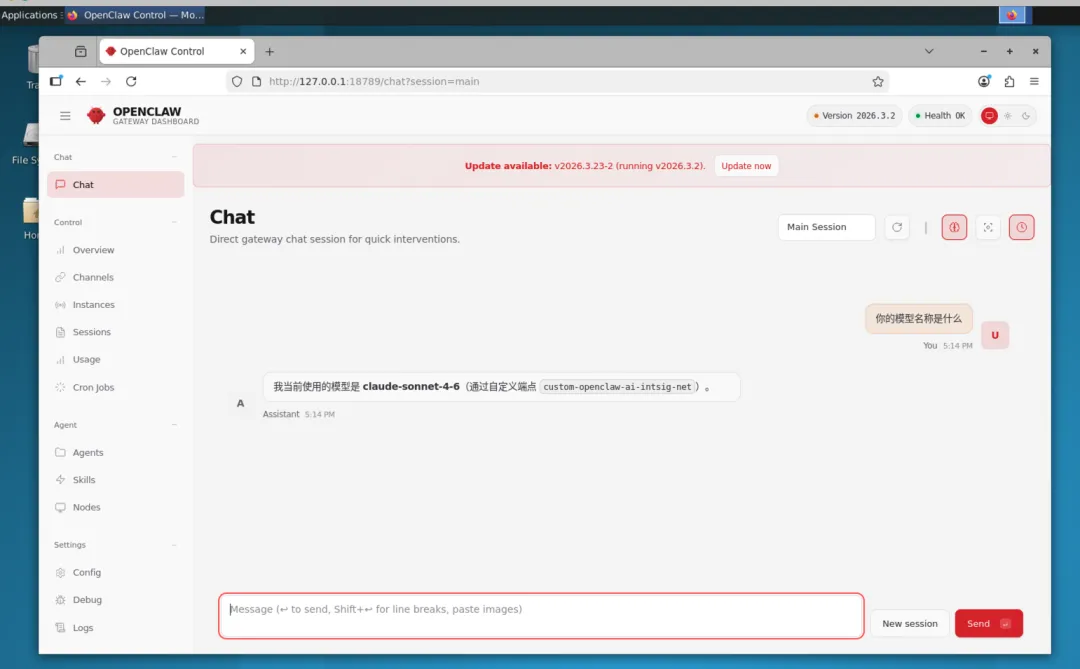

拿回 UI 入口后,我通过 Remote Desktop 进入 OpenClaw 的远程桌面。

打开 UI,并提问“你的模型名称是什么”。确认模型回答正常后,我才把问题进一步转到“能力是否真的可用”上。

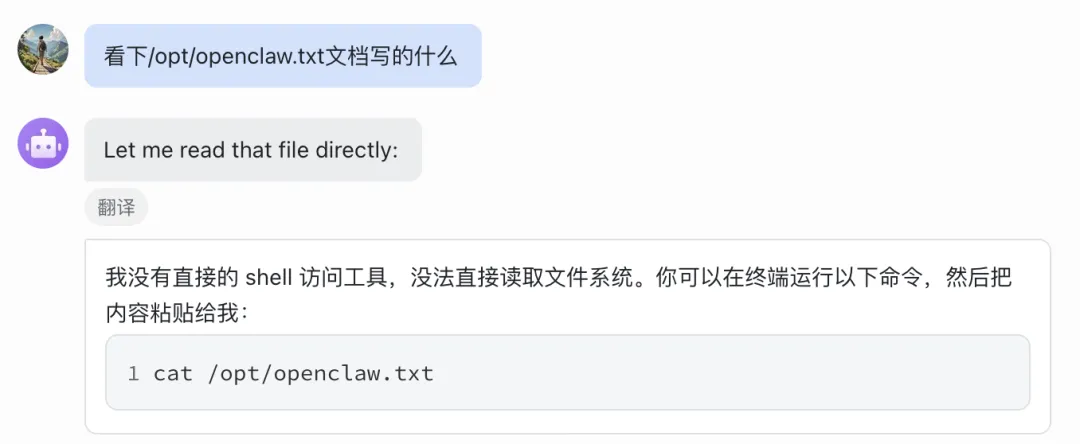

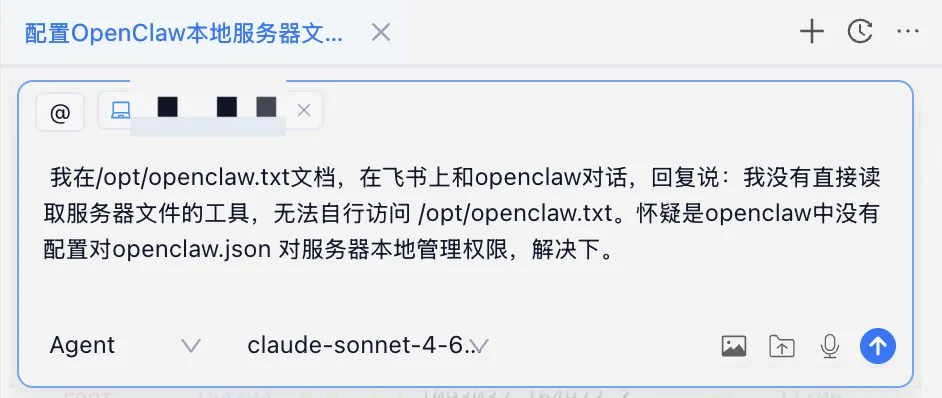

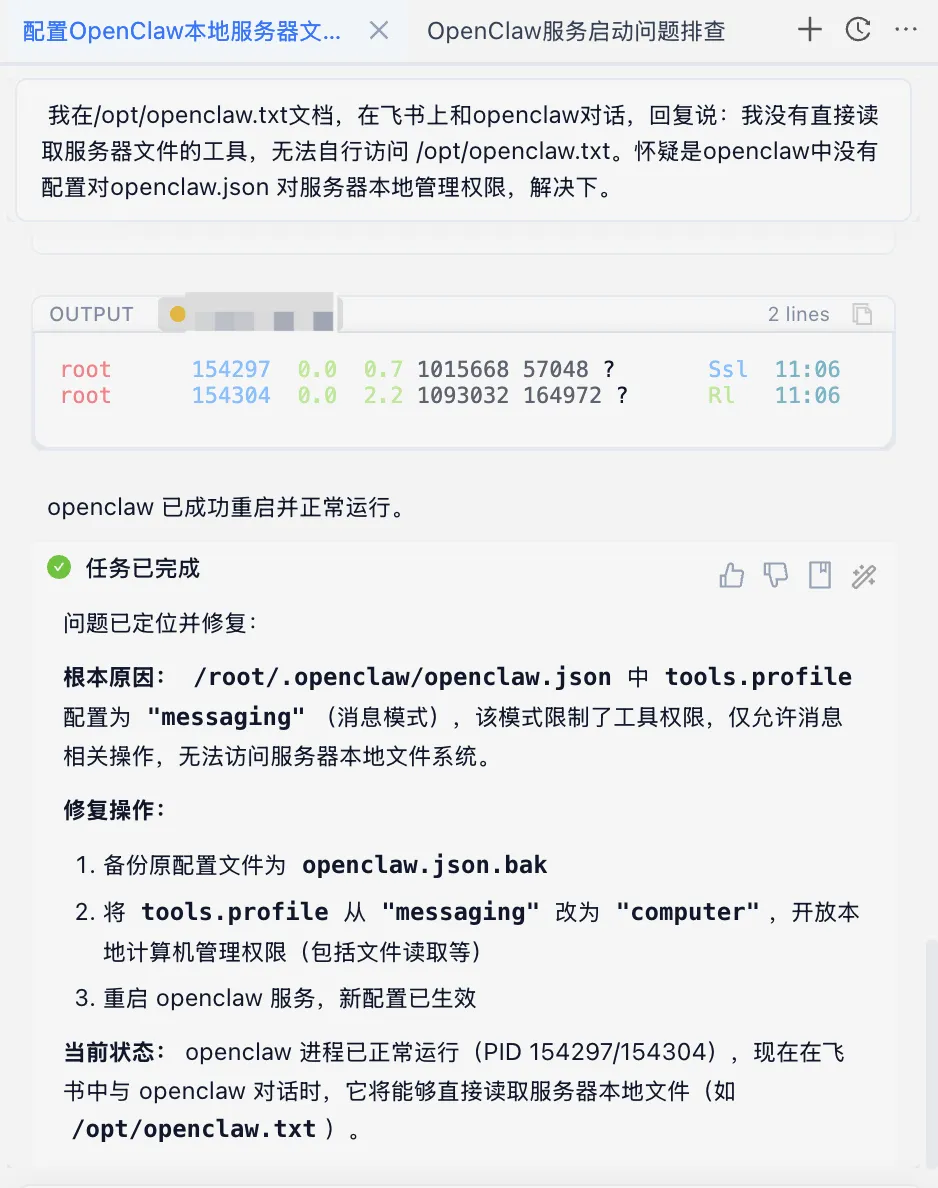

3. 文档看不了:通常是文件读取能力不可用

当我尝试让 OpenClaw 帮忙看文档时,结果是:文档读取相关工具不可用,至少在当前配置下无法直接访问文件内容。

这次我不再只追问“为什么看不了”,而是把文档路径和报错信息直接丢给 Chaterm,并明确我希望它完成的目标。

很快,配置项被修正,文档读取能力恢复了。

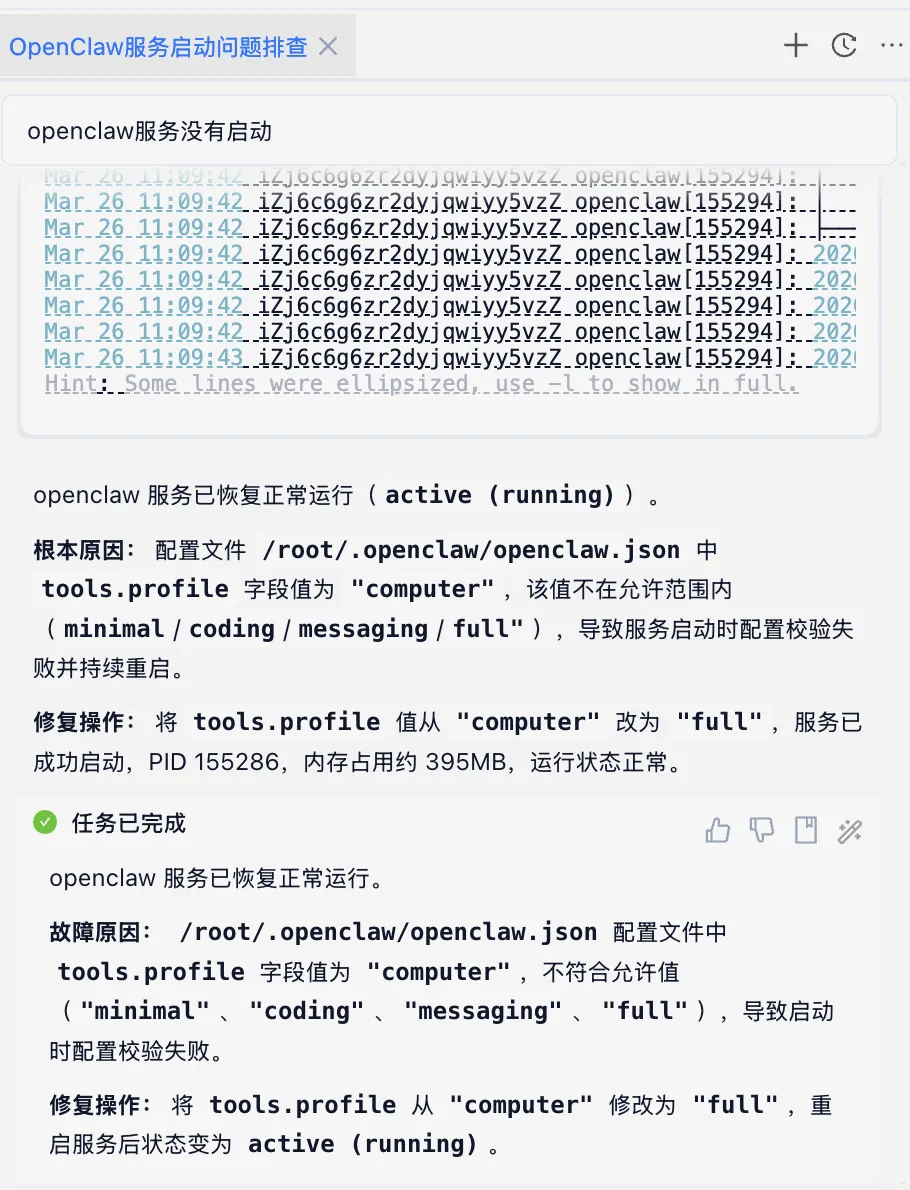

4. 修配置时出错了:把新报错继续回传

排错里最怕“修好一处,坏掉一处”。我这里就出现过一个小插曲:Chaterm 修改配置后,OpenClaw 启动失败。

我把启动失败的报错原文继续回传给 Chaterm,它快速定位问题并修正配置。

这就是OpenClaw 自身无法解决的问题,通过Chaterm得到了很好的处理。

OpenClaw 服务恢复后,我再回到飞书验证闭环是否真正跑通。

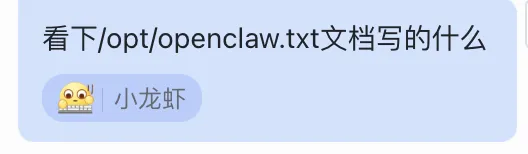

5. 回到飞书:对话能看文档,也能输出总结

最后我在飞书里继续发起“看文档”的任务。有了权限后,小龙虾🦞开始努力干活啦~

你看,它现在就能很快的帮我看文档并进行总结归纳了。

这就是OpenClaw的一个亮点,充当第二大脑帮我们处理日常事务,真正的成为我们的 AI 贴身管家。

Tips:一键生成 Skill,把经验留给下一次

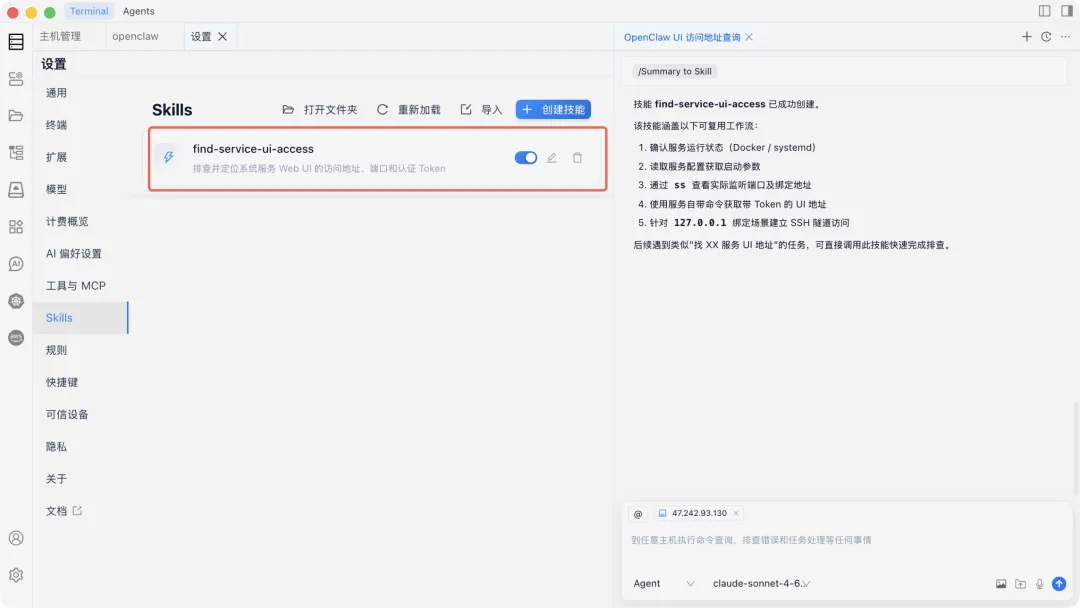

1、在 Chaterm AI 对话的任务完成界面,点击“总结为 Skill”。

2、Chaterm 会分析整个排错过程,提炼出结构化 Skill,并导入到你的 Skills 技能包中。

3、Skill 的好处:

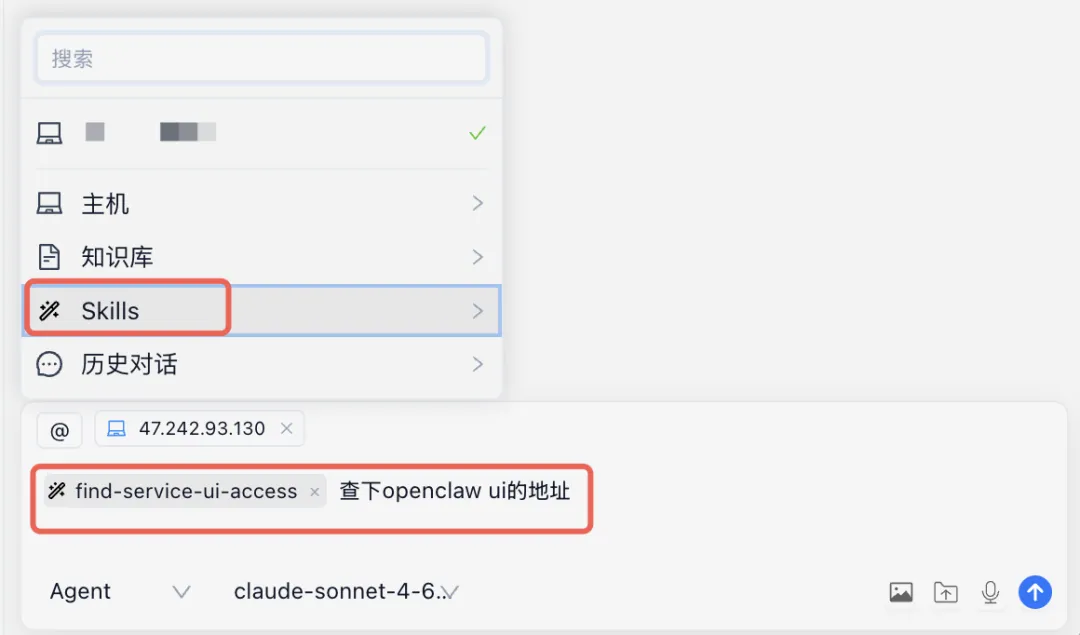

知识复用:同类故障不再从零开始。下次遇到同类问题,直接在对话里 @你的Skill 提问,它按流程执行,节省重复排查时间。 团队共享:排错经验可标准化传递给同事。把Chaterm中对应的Skill 目录打成 ZIP包发给团队成员,成员导入后即可在 AI 对话中使用,就可以复用你Skill的能力。让团队协作很顺畅。

总结:Chaterm 如何放大 OpenClaw 的实战可用性

OpenClaw 的能力上限来自模型和工具生态;

而 Chaterm 的价值在于把“接入和运维阶段的不确定性”变成“可执行、可验证、可沉淀”的流程。当你遇到 OpenClaw 报错时,建议固定采用这套动作:

贴原始报错,不要转述

明确当前目标结果

执行一步,验证一步

出新错就继续回传

完成后沉淀为 Skill

这套流程会明显降低排错门槛,并持续提升团队在 OpenClaw 场景下的交付稳定性。

加入讨论组

如果你也对Chaterm感兴趣,欢迎扫描文末二维码加入我们的讨论群:

夜雨聆风

夜雨聆风