欢迎点击下方👇关注我,记得星标哟~

文末会有重磅福利赠送

引言:我的“养龙虾”方法论

最近两周一直在折腾我的个人 AI Agent —— OpenClaw。之前提到过,我的OpenClaw 跑在 Kubernetes 集群里,所以在很多技术实现上会比直接跑在本地电脑上更有些难度。不过截至目前,我的“龙虾”也已经可以每天定时帮我总结 AI 和云原生行业热点、生成日报,并自动分发到知识星球和小红书等社交平台。

但这个过程,要“养大且养聪明”这只龙虾并不容易:它需要持续的功能迭代、定制化的技能(Skills)编写以及高效的K8s运维工作。今天,和大家分享下我是如何利用 AI 编程工具 Windsurf(底层调用强大的 Claude 模型),来完成 OpenClaw 的部署、技能进化与日常排错的。

一、用AI实现“基础设施即代码” (IaC)

我部署的OpenClaw 的核心架构非常云原生。在 Kubernetes 中,我通过自定义资源(CRD)OpenClawInstance来定义 Agent 的行为。

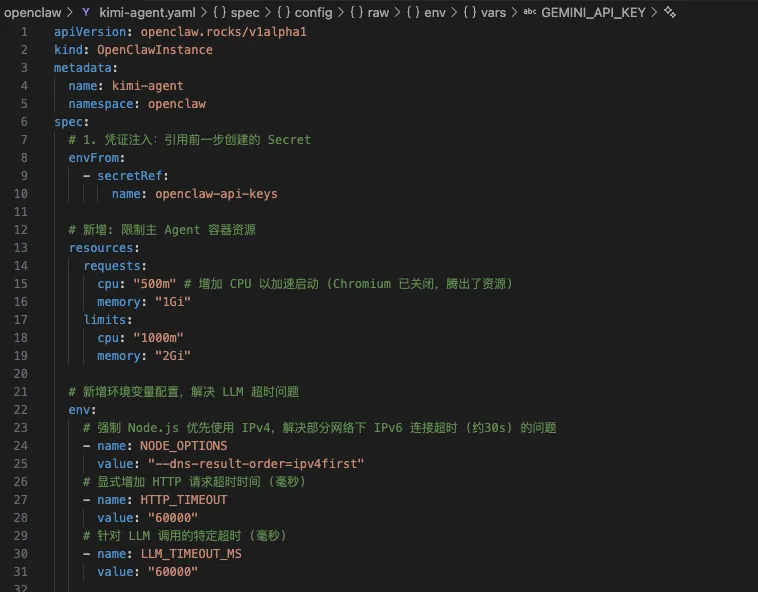

借助AI IDE(我主要使用Windsurf),我只需要用自然语言描述需求,AI 就能帮我精准修改 agent.yaml配置文件,并自动执行 kubectl apply部署生效。

举个例子:动态调整大模型路由与容灾

OpenClaw 在运行时极度依赖 LLM API。有时候主模型会因为 Rate Limit 报错,导致整个流程阻塞 3 分钟之久。我直接让 Windsurf 帮我优化调度策略,它迅速帮我修改了 YAML 文件:

agents: defaults: timeoutSeconds: 90 # 从 180s 缩短,快速失败 model: primary: "minimax-cn/MiniMax-M2.7" # 国产大模型主力 fallbacks: - "openrouter/stepfun/step-3.5-flash:free" - "openrouter/stepfun/step-3.5-flash" - "openrouter/xiaomi/mimo-v2-flash"通过 Windsurf 快速修改配置,OpenClaw 获得了秒级的模型 Fallback 能力,并自动对接到 Telegram Bot 控制端。原本需要翻阅文档查找字段的配置工作,现在只需一句话搞定。

二、Token 经济学:“执行”靠国产,“创造”靠 Claude

这里不得不提一个现实问题:个人购买的 API Token 实在不够用,执行复杂任务消耗不起。

作为一个 24 小时运行的Agent,OpenClaw 每天要执行大量的自动化跑批任务:全网热点扫描、长文总结、日报生成等。如果全用顶配的Claude大模型,钱包根本扛不住。

为了控制成本,我做了一个算力分层策略:在 OpenClaw 的运行环境里,我把主模型配置为国产的高性价比模型(比如 GLM、MiniMax)。它们在执行常规的信息汇总、中文文章生成任务时,表现非常优秀且成本极低。GLM、MiniMax 目前都有性价比不错的包月token计划。

但是,“执行”可以靠国产,但“创造”还得看 Claude。

在为这只“龙虾”编写底层技能代码、设计复杂的浏览器控制逻辑时,很多疑难杂症依然需要极强的代码推理和纠错能力。于是,我把绝大部分的核心代码开发和架构优化工作,都交给了我工作电脑上的AI编程工具(此处感谢公司每月分配的充足 AI 额度,确实用不完 😉)。这种“富养开发环境,穷养运行环境”的搭配,是我目前找到的“养龙虾”最佳消耗Token的打开方式了。

三、结对编程:让 AI 帮我写出健壮的 Agent Skills

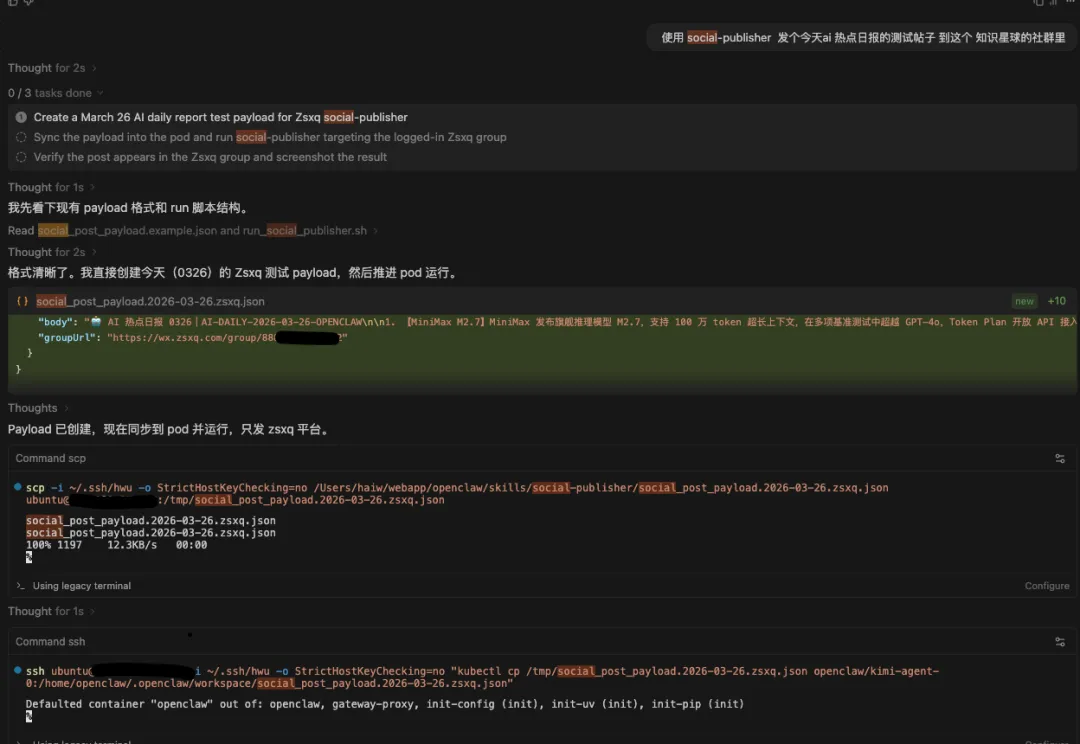

个人专属“龙虾”要变得更聪明,定制化的Skill必不可少, 以我最近给 OpenClaw 写的 social-publisher技能为例,这是一个通过 Playwright 连接 Chromium CDP 协议,自动把内容发布到“知识星球”或者“小红书”的脚本。整个优化过程完全由AI Claude驱动,它帮我填了无数个坑:

1. 攻克“假阳性”的发布漏洞

一开始,脚本点击“发布”按钮后就直接报 Success 退出,但我去社区一看,帖子根本没发出来。我让 Claude帮我诊断,它敏锐地指出:页面可能弹出了“手机号绑定”或“实名认证”拦截框,脚本被遮罩层挡住了。

它帮我重构了校验逻辑,不仅增加了对各种阻断弹窗的 DOM 嗅探,还严格验证了“发布成功后,富文本编辑器必须被清空”这个底层逻辑。

2. 目标群组修复

在定位知识星球目标群时,网络环境和 UI 结构经常会导致寻找群聊失败。Claude帮我设计了一套丝滑的降级路由策略:优先读取 Payload 传入的 groupUrl直达目标 -> 其次通过 groupName去主页搜索列表 -> 最终降级到 agent.yaml中配置的兜底群链接。几百行的 Node.js 控制逻辑,它在几秒钟内就帮我重构得严丝合缝。

四、Openclaw自动化排错与运维

除了写技能,我的AI助手也基本接管了我的Openclaw日常运维工作。

在折腾 OpenClaw 的过程中,我遇到过不少棘手的环境和网络问题。如果没有 AI 的辅助,这些问题往往需要在茫茫的容器日志和网络抓包中耗费几个小时。

真实案例 1:排查“切到 MiniMax 后,龙虾变迟钝了”前两天我把 OpenClaw 的主模型切到了 MiniMax,结果发现它回答问题变得特别慢,动辄卡住 3 分钟。我怀疑是 Chromium sidecar 拖垮了 Pod 的 CPU。我在Windsurf 对Claude 描述了现象,它立刻展开了跨主机自动排查:

1. 它先通过 SSH 远控服务器执行 kubectl top pod,发现 CPU 利用率只有 4m,排除了本地资源瓶颈。2. 接着它自动拉取了容器尾部日志: kubectl logs --tail=300 | grep error,瞬间揪出了真凶——由于 API 速率限制(Rate Limit)触发了 180 秒的死等超时,导致整个 Fallback 链路被严重拖慢。3. 查明原因后,它直接帮我把 agent.yaml里的 LLM_TIMEOUT_MS和timeoutSeconds从 180 秒缩短到 60 秒,并精简了冗长的 fallback 模型列表。重新部署后,龙虾立刻恢复了敏捷。

真实案例 2:跨容器的文件备份与迁移之前想要备份 Pod 里面的定时任务(Cron)配置,我需要频繁地在终端里敲复杂的 kubectl exec和 tar命令。现在,我只需要说:“帮我把 OpenClaw 的 cron 定义备份到本地”。

Claude 会自动理解上下文,生成时间戳目录,并在终端中利用管道流将远程 K8s 里的目录无缝拉取到我的 Mac 本地:

# Windsurf 自动生成并执行的跨端备份命令ts=$(date +%Y%m%d_%H%M%S)dest="/Users/haiw/webapp/openclaw/backups/openclaw_cron_${ts}"# 聪明的它知道用 tar 管道流跨机器拉取文件,连中转临时文件都省了ssh ubuntu@ip -i ~/.ssh/hwu "kubectl exec -n openclaw agent-0 -c openclaw -- tar -C /home/openclaw/.openclaw -cf - cron" | tar -xf - -C "$dest"它能精准找到 OpenClaw 隐藏在 .openclaw/cron下的 jobs.json和运行日志,并以时间戳归档到我的本地目录,甚至会主动把这些备份文件归纳成一份易读的 Markdown 报告交给我。

有了这样的 AI 结对编程伙伴,我一个人就拥有了一支包含架构师、Node.js 开发和 K8s 运维工程师的微型技术团队。

结语

在构建我个人AI Agent的路上,大模型的组合拳是现阶段的最优解。

让高智商但昂贵的模型(如AI IDE背后的 Claude)作为架构师和开发工程师,负责基础设施搭建、疑难 Bug 修复和 DevOps 运维;让高性价比的模型(如 MiniMax、GLM)跑在业务环境里,作为执行者完成日常任务。

接下来,我还会继续为这只“龙虾”接入更多有趣的技能,我们下期见!

重磅!!

公众号配套学习网站已经上线,欢迎大家体验:https://k8s.sredevops.top/

往期回顾

K8S工具推荐,Kargo:下一代 GitOps 持续交付工具

K8S工具推荐:Bufstream-唯一通过 Jepsen 验证的云原生 Kafka 实现

K8S工具推荐: 使用 Kubemark 进行 Kubernetes 大规模集群模拟实践

K8S工具推荐:使用Argo Rollouts实现GitOps自动化测试与回滚

K8S工具推荐:告别复杂认证!Kubernetes登录神器kubelogin指南

K8S工具推荐:Kubernetes资源优化神器KRR:一键诊断集群资源浪费

Kubernetes工具推荐:使用 k8s-pod-restart-info-collector简化故障排查

K8S工具推荐:动态无缝的Kubernetes多集群解决方案-Liqo

夜雨聆风

夜雨聆风