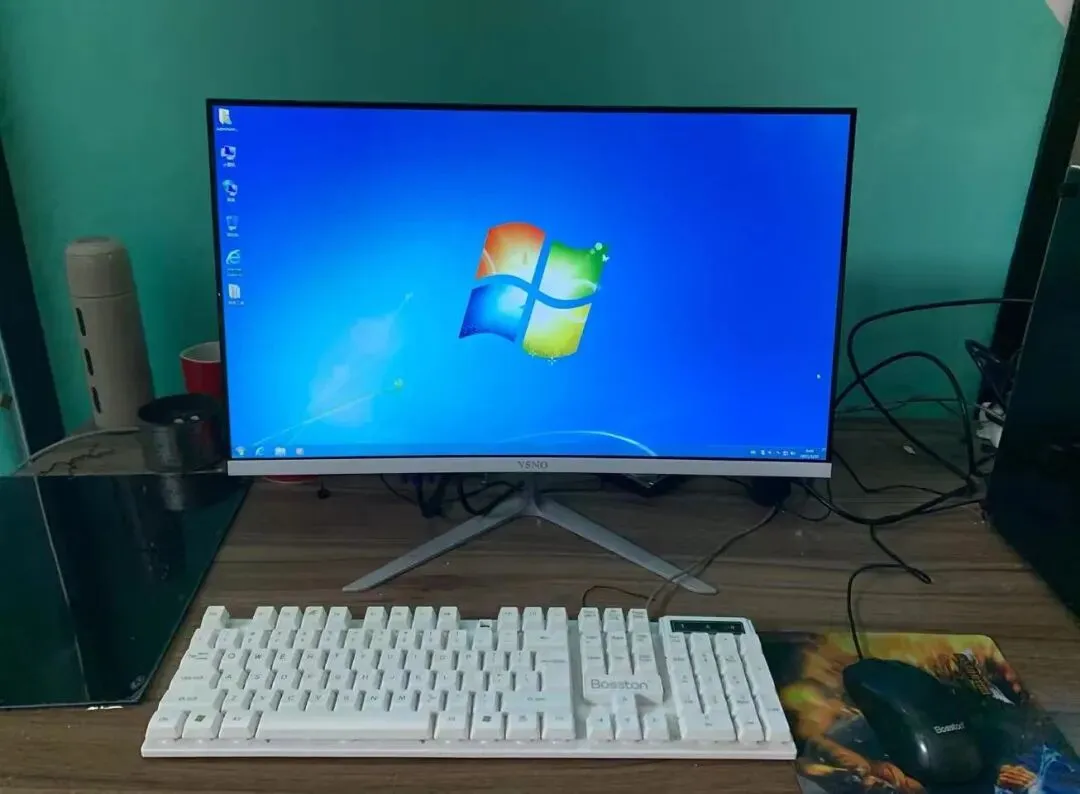

家里那台老电脑,扔了可惜,卖了百来块钱,放着吃灰好几年。配置是十年前的i3,8G内存,没有独立显卡,开机都要转悠半天。说实话,我都快忘了它的存在。

直到上个月,我把它翻了出来。

你猜怎么着?这台老古董,现在成了我最得力的“员工”。24小时在线,从不请假,不要工资,还任劳任怨。这一切,就因为我给它装了个本地AI模型。

零成本,这才是真正的免费

很多人一提到AI,第一反应就是:“又要充会员?”“API又要花钱了吧?”

真不用。

我用的这些开源模型,像Ollama、Llama、通义千问的轻量版,统统免费。不用买显卡,不用升级配置,我那台老i3愣是跑得挺欢。电费?待机状态下几乎可以忽略不计。

算下来唯一的成本,就是当初买电脑的钱——早就花过了。这叫真·零成本。

它到底能干啥?

说白了,它就是一个24小时在线的智能助手。

写文案?半夜三点来了灵感,敲两行字,它立马帮你润色、扩写、生成多个版本。我最近接的几个公众号软文,都是它帮着搭框架,我改改细节就交差。

整理资料?扔给它一堆乱七八糟的笔记,自动分类、总结要点、生成目录。以前一下午的活儿,现在喝杯咖啡的功夫就完事。

我甚至用脚本让它定时扒拉行业动态,每天早晨准时推送一份简报给我。竞争对手发了什么、行业有什么新趋势,一目了然。

隐私问题?不存在的

用云端AI,最担心的就是数据隐私。你的文档、你的聊天记录、你的商业思路,都上传到别人的服务器。

本地部署就不一样了。所有数据都在自己电脑里,断网也能用。商业方案、客户信息、个人隐私,踏踏实实放在本地,不用怕泄露。

说干就干

别觉得这事儿多复杂。下载个Ollama或者kimi、qwen,一行命令装个模型,再配上个简单的Web界面,半小时搞定。网上教程一大堆,跟着走就行。

我这台老i3,虽然跑不动那些几百亿参数的大模型,但7B级别的模型绰绰有余。日常写作、翻译、总结、代码辅助,完全够用。

写在最后

说实话,以前总觉得AI离普通人很远,又是显卡又是算力的,门槛高得吓人。真上手了才发现,手里那台吃灰的老电脑,可能就是最好的入场券。

不用花钱,不用升级硬件,不用操心隐私。一台旧电脑,一个免费模型,你也能拥有一个24小时不睡觉的“AI员工”。

省下的会员费,多出来的效率,还有那份“废物利用”的成就感——这事儿,真挺香的。

夜雨聆风

夜雨聆风