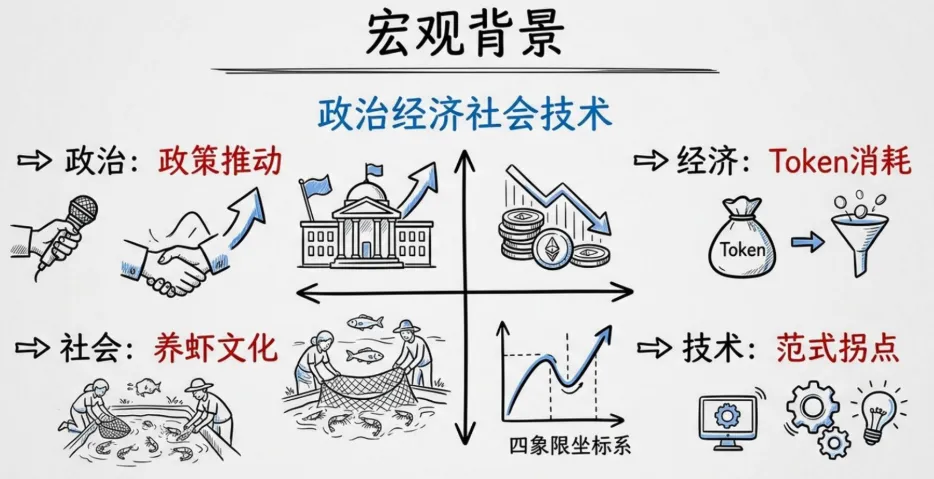

当 AI 不再只是被动输出答案的工具,而是能自主执行复杂任务、自我迭代优化时,人与 AI 的关系正迎来全新拐点。以 “龙虾” 生态为核心,通过系统的权限分级与架构拆解,为我们揭开 AI 智能体从 “人工驯化” 到 “自主进化” 的底层逻辑。

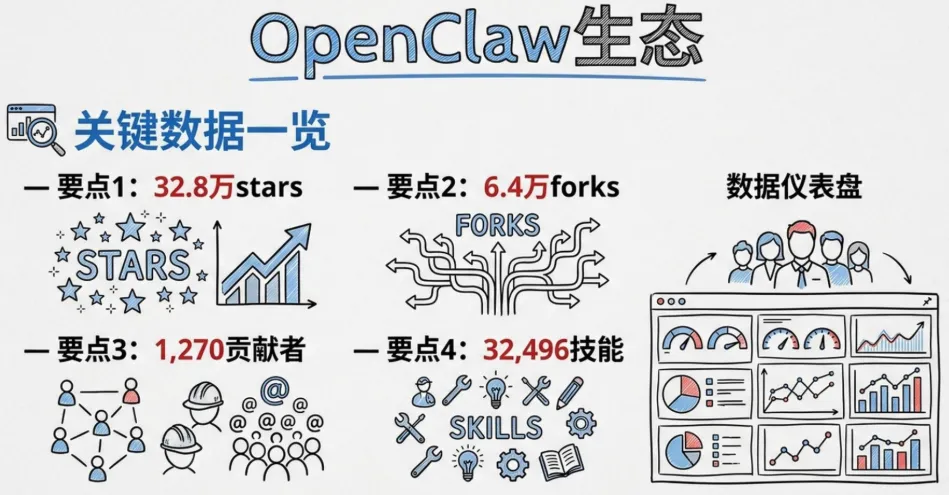

一、OpenClaw 生态:32.8 万星标背后的 AI 新范式

作为当前热度飙升的开源 AI 智能体项目,OpenClaw 已构建起庞大的技术生态:32.8 万 stars、6.4 万 forks、1270 名贡献者,累计沉淀 32496 项技能,覆盖文件操作、网络请求、业务自动化等全场景。不同于传统大模型仅聚焦推理能力,OpenClaw 以 Gateway+Agent+Skill 三层架构为核心,打通 LLM 与本地系统、第三方软件的壁垒,实现 “意图解析→决策执行→结果反馈” 的全流程自动化,被业内视为 “AI Agent 工业化落地的标杆”。

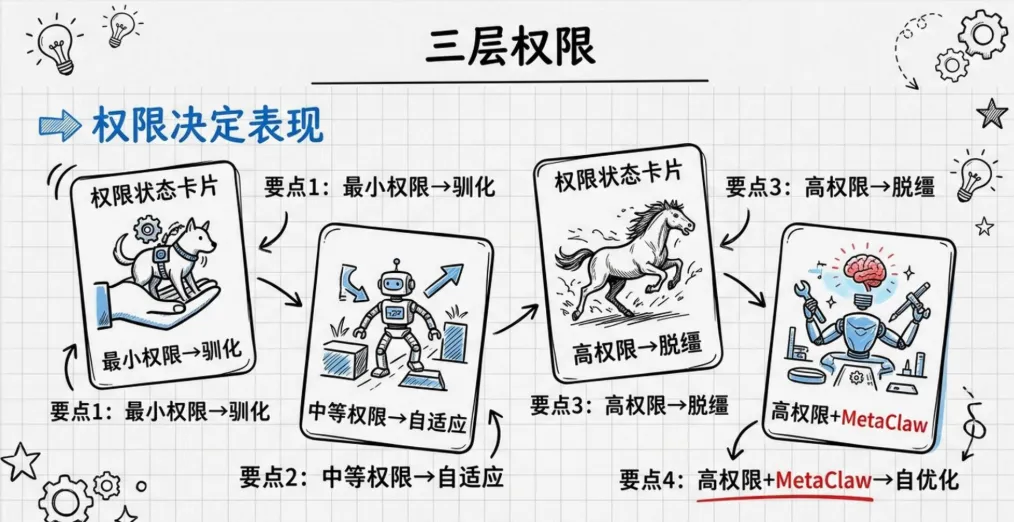

二、核心命题:权限决定 AI 的 “生存形态”

最核心的洞见,是打破 “驯化 vs 进化” 的二元对立,提出 “权限决定边界”的核心主张:同一套 AI 系统,权限配置不同,呈现的状态截然不同。这一逻辑构建起 “驯化 - 自适应 - 自优化” 的三层权限光谱,清晰勾勒出 AI 的进化路径。

1. 底层:驯化层 —— 最小权限下的 “受控助手”

在最小权限模式下,AI 处于驯化层,核心规则是 “人握缰绳”。此时 AI 仅能被动执行指令,所有输出需经过人工审核,通过 AGENTS.md、SOUL.md 等文件体系与 SQLite 本地存储实现记忆管控。这一阶段的 AI 更像 “训练有素的助手”,虽能完成文档生成、数据整理等基础任务,但行为完全受控,不存在自主决策与迭代空间。

当前行业实践中,约 70% 的 OpenClaw 应用处于这一阶段。驯化层的核心价值在于建立信任:通过细粒度权限管理、操作日志审计与风险熔断机制,让人类逐步掌握 AI 的行为边界,为后续放权奠定基础。

2. 中层:自适应层 —— 中等权限的 “自我调整”

当权限逐步放开,AI 进入自适应层,占比约 20% 的应用已迈入此阶段。此时 AI 可自主修改工作区配置、记录学习经验、甚至搭建新技能,无需全程人工审核。就像熟练的工匠能微调工具参数,AI 能在预设范围内优化执行流程,但并未触碰 “核心规则”—— 仅调整配置文件,而非更新模型权重。

自适应层的关键在于 “平衡”:既赋予 AI 自主探索的空间,又通过版本控制、Review 机制保留人工兜底权限,避免行为失控。清华团队提出的 “减法治理、验证先于晋升” 原则,正是为了在放权过程中规避记忆污染、行为劫持等风险。

3. 顶层:自优化层 —— 高权限的 “自主进化”

仅 10% 的应用触及自优化层,这是 AI 进化的终极形态。搭配 MetaClaw 机制,AI 能自主修改行为指令、更新模型权重,甚至合成新策略、升级核心能力,真正实现 “自然选择” 式的进化。此时的 AI 不再是被动的工具,而是具备自我迭代能力的 “数字生命体”—— 能根据任务反馈自动优化流程、修复漏洞,甚至衍生出超越预设的新能力。

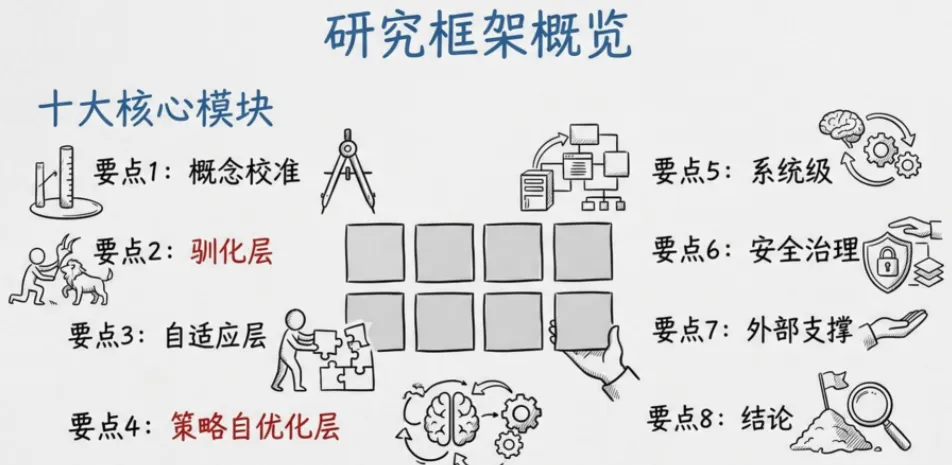

三、安全与进化:先驯化,后进化

OpenClaw 的研究并非盲目推崇 “快速进化”,而是强调 “先驯化,后进化” 的渐进逻辑。报告指出,AI 的进化不是一蹴而就的跳跃,而是连续的权限升级过程:

从驯化层到自适应层,需完成记忆体系搭建、技能库完善与风险排查;从自适应层到自优化层,更需建立严格的安全治理体系 —— 针对驯化层的供应链攻击、自适应层的行为劫持、自优化层的权重偏离,构建 “版本控制、审批机制、回滚能力” 三重防护。

四、未来图景:AI 进化的文明启示

OpenClaw 的进化逻辑,本质上是人类与 AI 关系的重构:从 “工具使用者” 到 “权限管理者”,从 “控制 AI” 到 “引导 AI 进化”。AI 的进化不是对人类的替代,而是与人类形成共生关系—人类通过驯化建立规则,AI 通过进化提升效率,最终实现 “人机协作的效能倍增”。

对于产业而言,OpenClaw 的三层架构与权限分级思路,为 AI Agent 的落地提供了可复制的范式:无论是企业内部流程自动化,还是个人高效办公,都可遵循 “先驯化筑牢基础,再放权实现自适应,最后逐步解锁自优化” 的路径,让 AI 真正融入生产生活的核心环节。

AI 的进化之路,从来不是 “失控” 的冒险,而是 “可控放权” 的智慧。OpenClaw 用清晰的权限逻辑告诉我们:真正的 AI 进化,始于严谨的驯化,成于科学的放权。而这条路径,必将重塑未来的人机协作格局,开启 AI 智能体发展的全新纪元。

夜雨聆风

夜雨聆风