这也许才是OpenClaw的完美形态!手把手教你如何“一虾两吃”

哈喽小伙伴们好,我是Stark-C~

最近“养虾热”实在是火的不行!我也算是最早一批业余“养虾人”了,从去年一开始OpenClaw刚发布不久,我就陆续为大家分享过各种OpenClaw的搭建与玩法,粗算一下也有十来篇了吧!

不过说来惭愧~,我虽天天教别人养虾,但我自己养废的虾貌似也不在少数。除了部署的时候各种踩坑,还有就是养虾的材料(tokens)真的是烧不起啊!

🔺不过我最近貌似找到了就目前来说,应该算是一个非常完美的“养虾方案”。那就是我在我的『零刻GTi15 Ultra』小主机上开始养虾了,不仅做到了OpenClaw的开箱即用,而且还做到了本地模型和云端模型双开,可谓是“一虾两吃”!

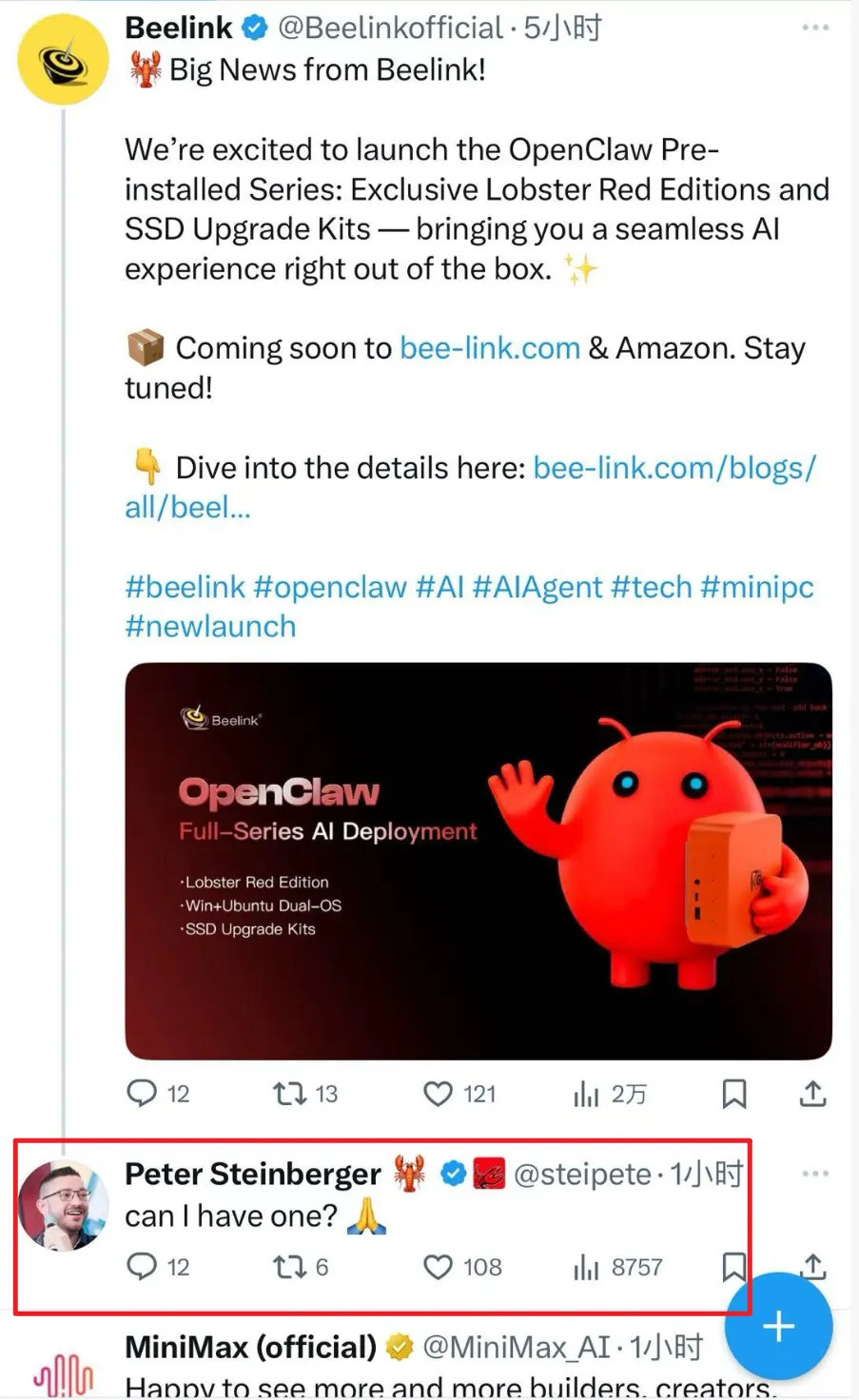

🔺可能会有小伙伴疑惑:用零刻小主机养虾适合吗?我也不给你们解释太多,看看零刻海外社交平台,OpenClaw的创始人都来寻求零刻养虾平台了,你还有什么话说?

接下来,我就将自己在零刻GTi15 Ultra上的养虾心得,以及详细的“一虾两吃”完整流程,手把手的分享给小伙伴们!

开箱即用的OpenClaw

🔺先来说说我如何在零刻GTi15 Ultra上做到OpenClaw的开箱即用,原来就是这根零刻主机专属的福利--一根「预装OpenClaw」的M.2 SSD固态硬盘!这根M.2 SSD固态硬盘已经为我们搭建好了现成的OpenClaw,我们只要将这根硬盘插到我们的零刻小主机上,开机就能体验到“原汁原味”的小龙虾,所以就做到了”开箱即用“。

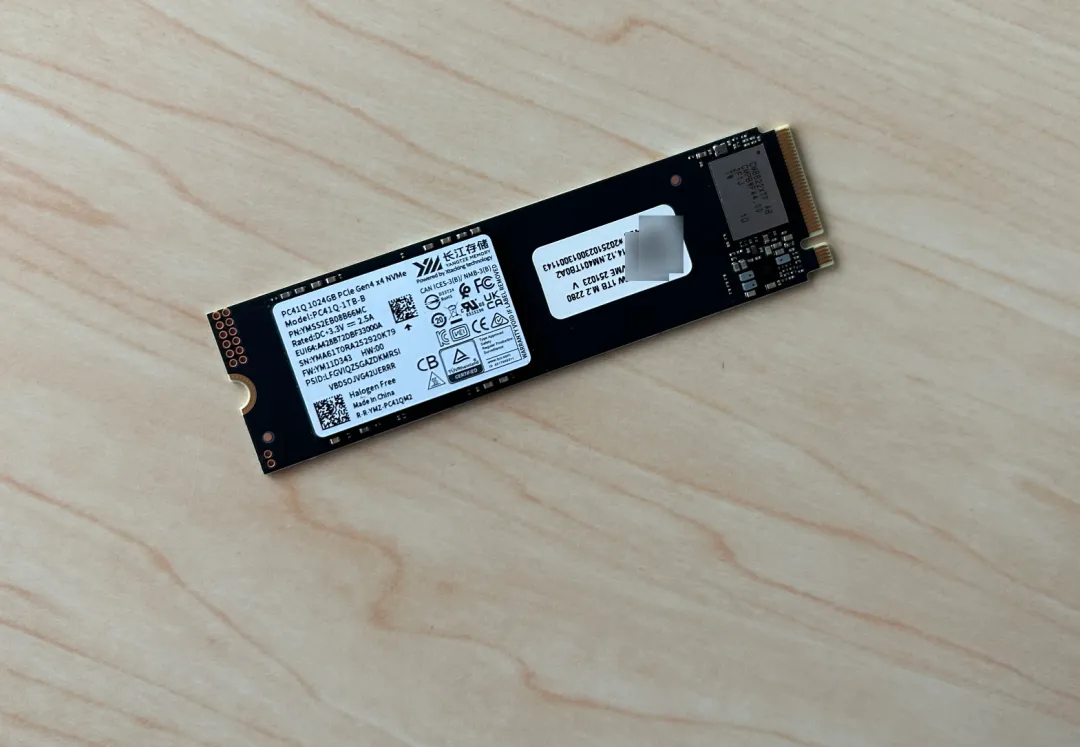

🔺我手上的这款专属硬盘来自长江存储,采用 PCIe 4.0 x4 接口,容量为 1TB,顺序读取速度可达 5700 MB/s。除了 1TB 版本外,它还提供 2TB 和 4TB 两种更大容量可选,其中 2TB 与 4TB 版本的读取速度进一步提升至 7000 MB/s。此外,4TB 版本还采用了镁光颗粒,规格也更高。

🔺硬盘内部包装有对硬盘的专属保护,同时还附送了一张OpenClaw使用指南的说明书。我也不给你们展示说明书的内容了,稍后直接为你实机演示。

🔺硬盘倒是没啥特别的,设计也挺简单,1TB版本采用的是单面两颗粒设计,电源规格为3.3V-2.5A,算是中规中矩吧!

开机体验

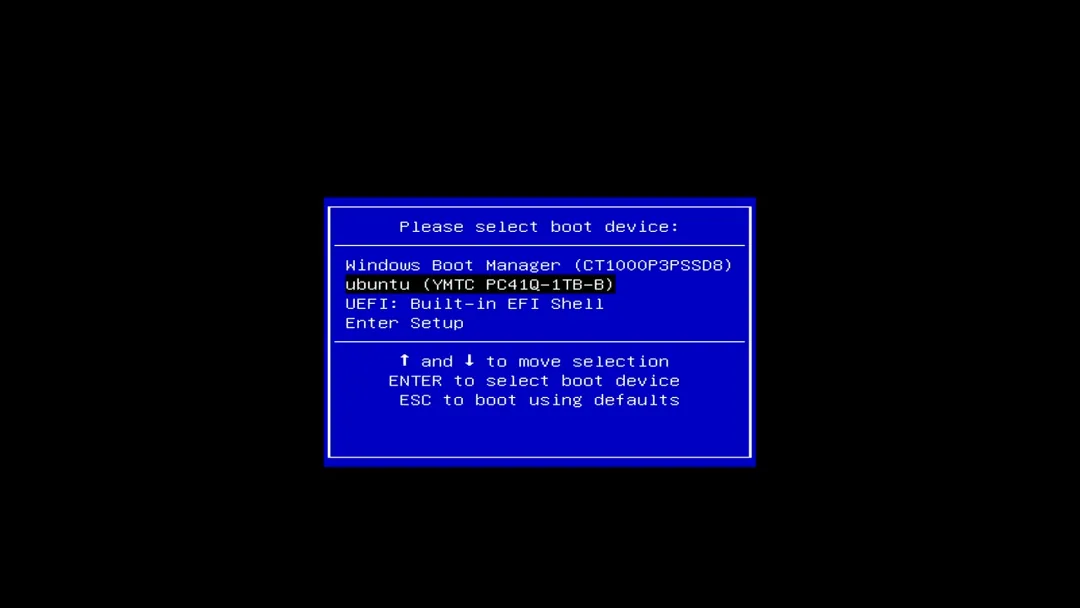

先说一下,我的零刻GTi15 Ultra因为之前一直使用的是Windows系统,所以已经有一根M.2硬盘占据了一个硬盘插槽,所以这根预装OpenClaw的M.2 SSD固态硬盘我只能装在另外一个硬盘插槽上了,但是这并不妨碍我愉快养虾。

🔺我们仅需在零刻主机开机的那一刻连续按F7进入启动菜单,然后选择预装OpenClaw的M.2 SSD固态硬盘,也就是显示“ubuntu”名称的硬盘。

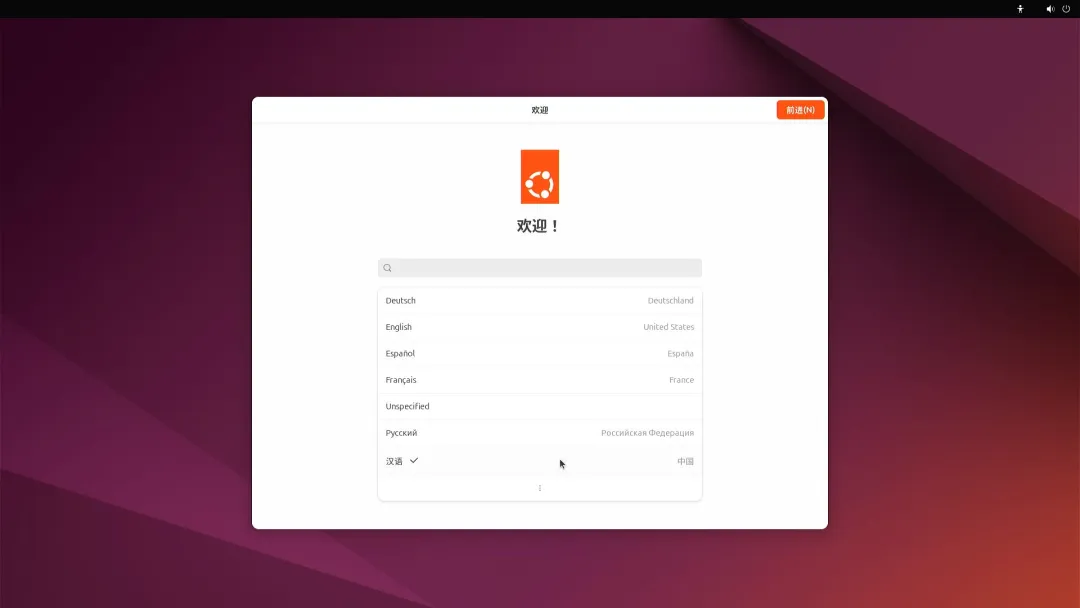

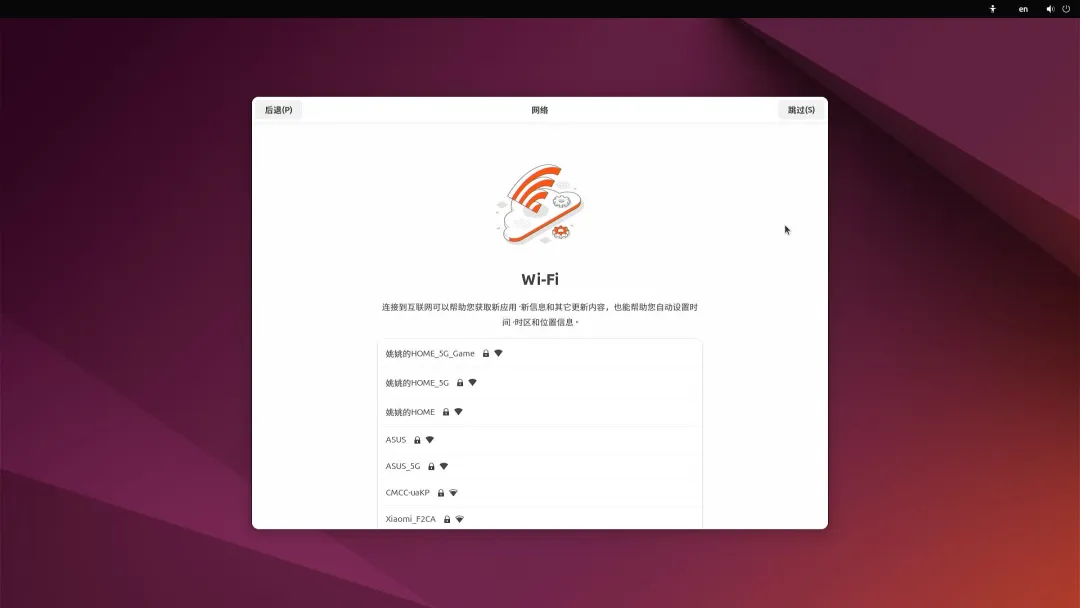

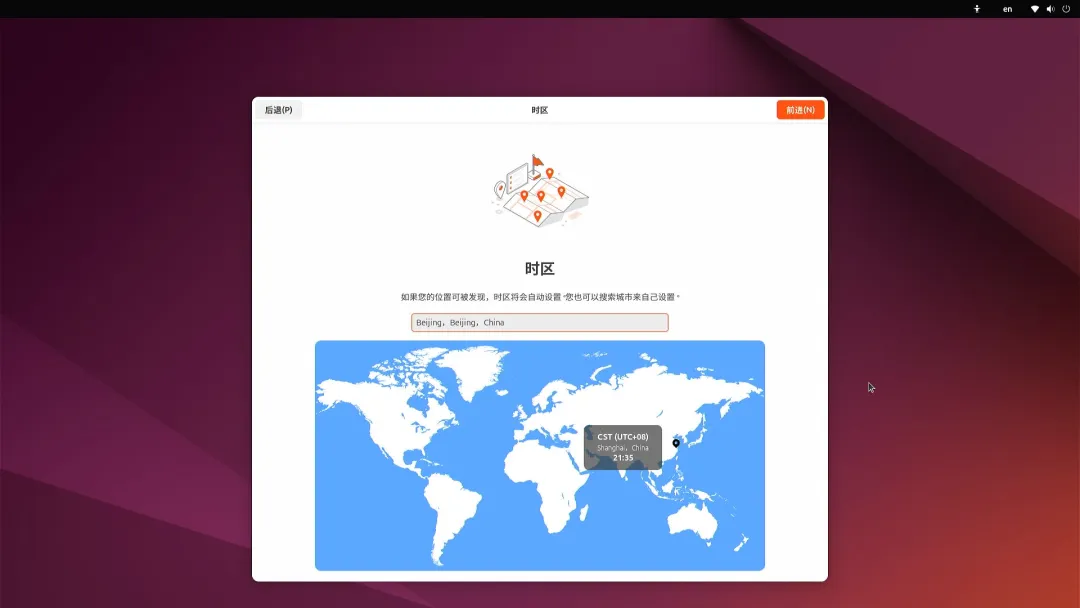

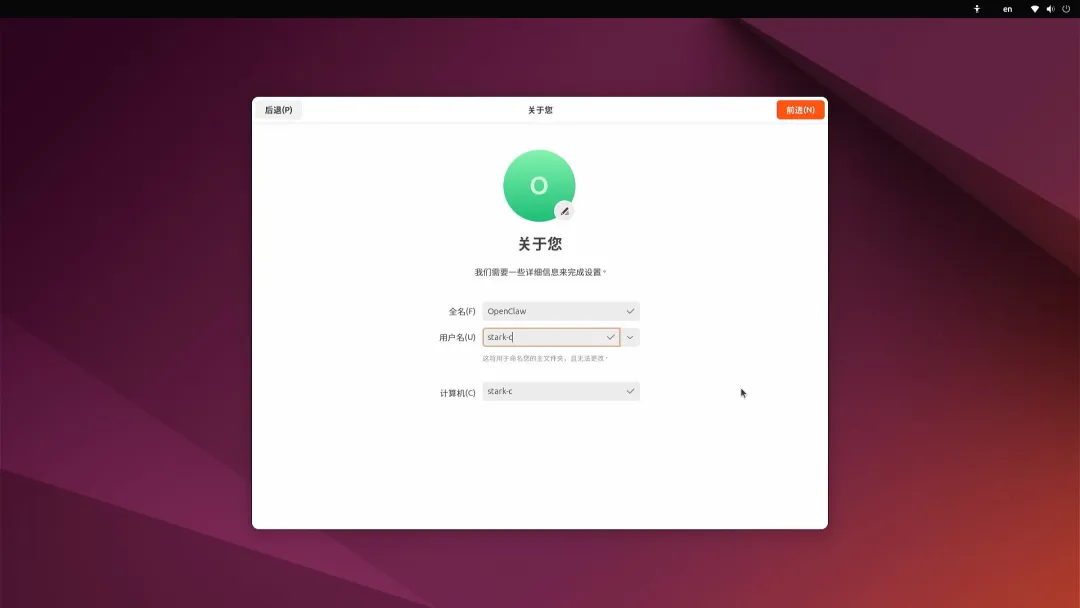

🔺然后就会自动开始全新系统的初始化设置。接下来的操作基本就是跟着设置向导无脑“下一步”了。

🔺初始化的第一步当然是选择“汉语”。

🔺零刻GTi15 Ultra我因为是一直在无线使用,所以在ubuntu系统初始化时的网络设置中,它也能正确的识别并连接Wi-Fi网络。

🔺选择时区这里记得手动选择“Beijing,China”。

🔺用户名这里也需要自己手动设置。

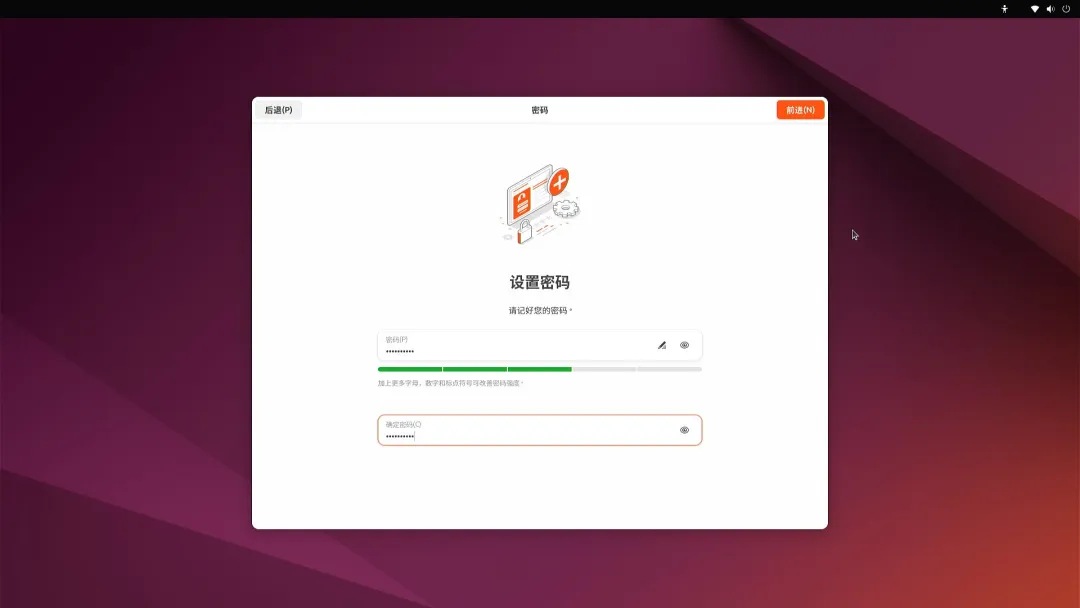

🔺还有这里的密码。注意了,这个密码不仅是我们系统的开机密码,系统中的授权操作、以及打开隐藏文件夹都会要求我们输入这里的密码,所以这里的密码请务必记住了!

🔺看到此画面,说明初始化设置完成。

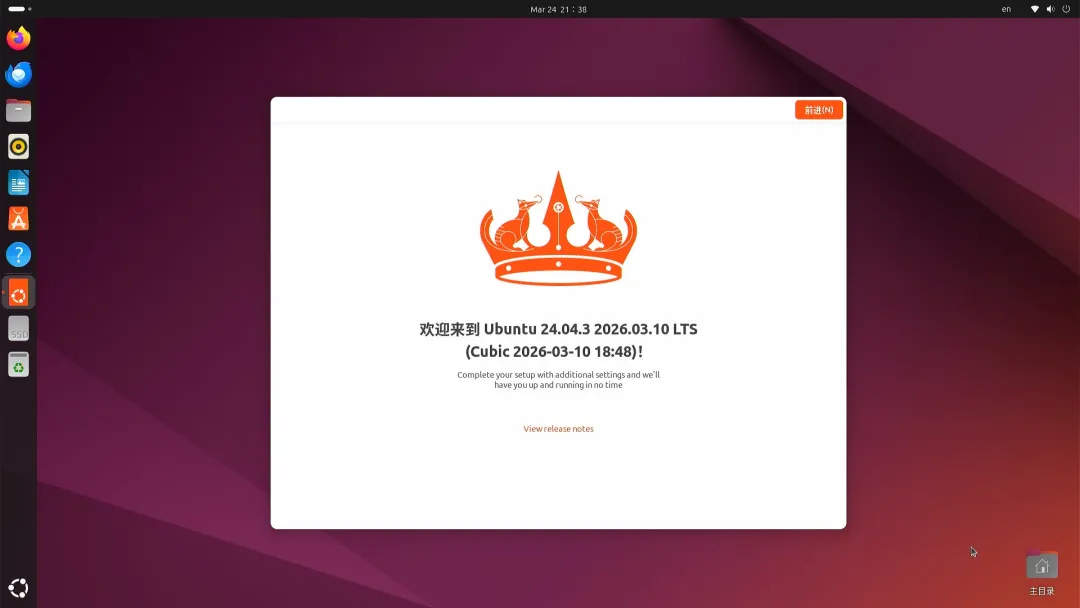

🔺然后就正式进入了ubuntu系统桌面了!新桌面上会有一个提示升级ubuntu Pro的弹窗,我们直接忽略就可以了。

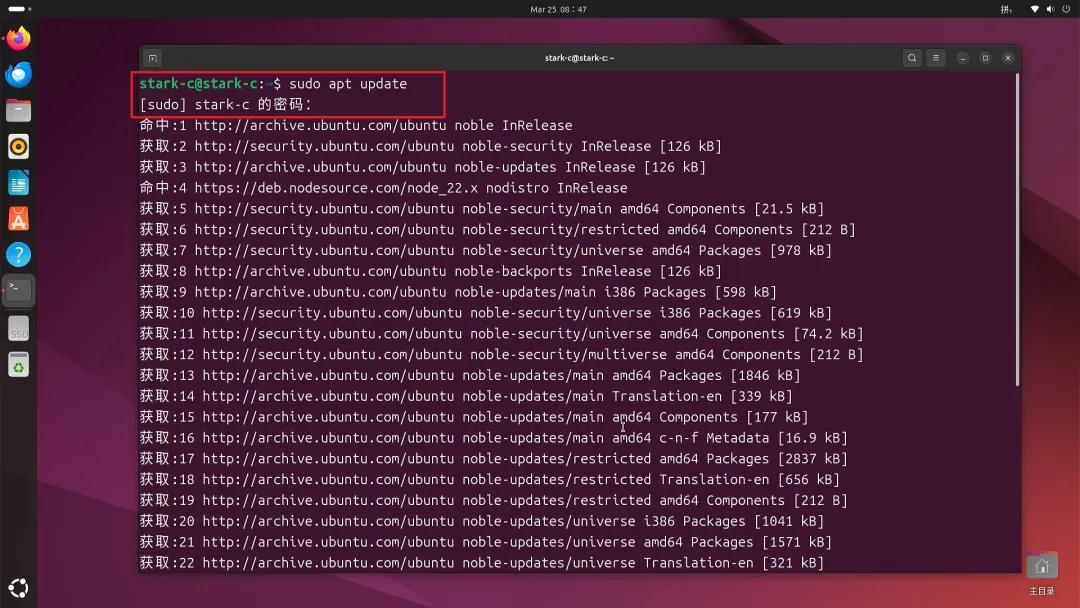

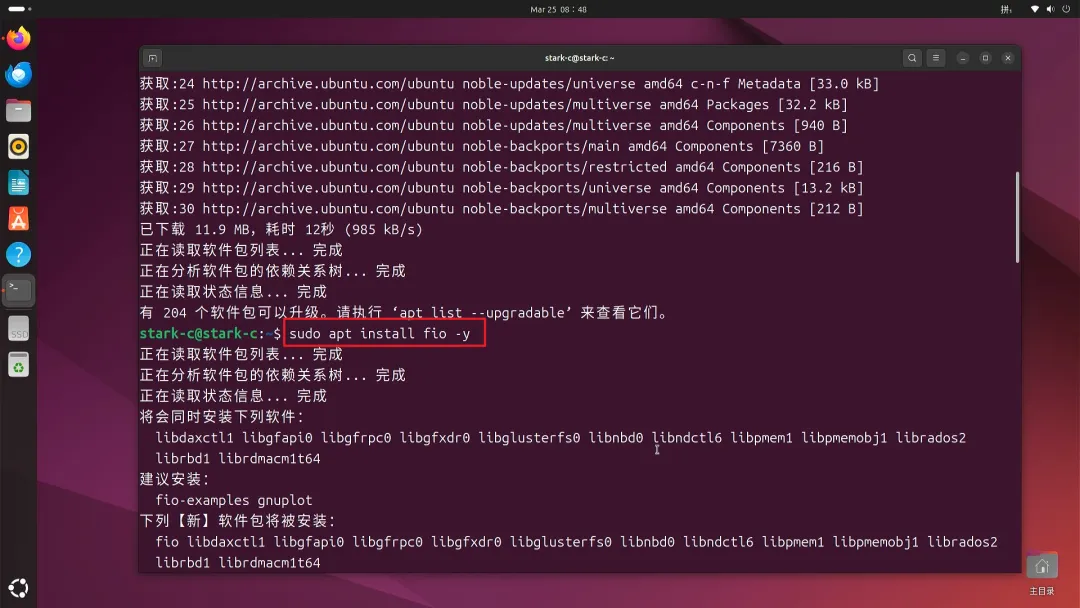

🔺进来之后我先简单的使用FIO工具测试下这块硬盘在当前系统下的表现。方法是进入终端,输入更新系统软件包列表命令“sudo apt update”,然后提示输入密码,这里的密码就是我前面提到的那个系统初始化设置的密码,输入密码的时候没有显示,输完密码之后直接回车即可,然后系统就会自动执行所有当前系统软件更新的操作。

🔺完了之后再买输入FIO工具的安装命令“sudo apt install fio -y”,等待安装完成即可。

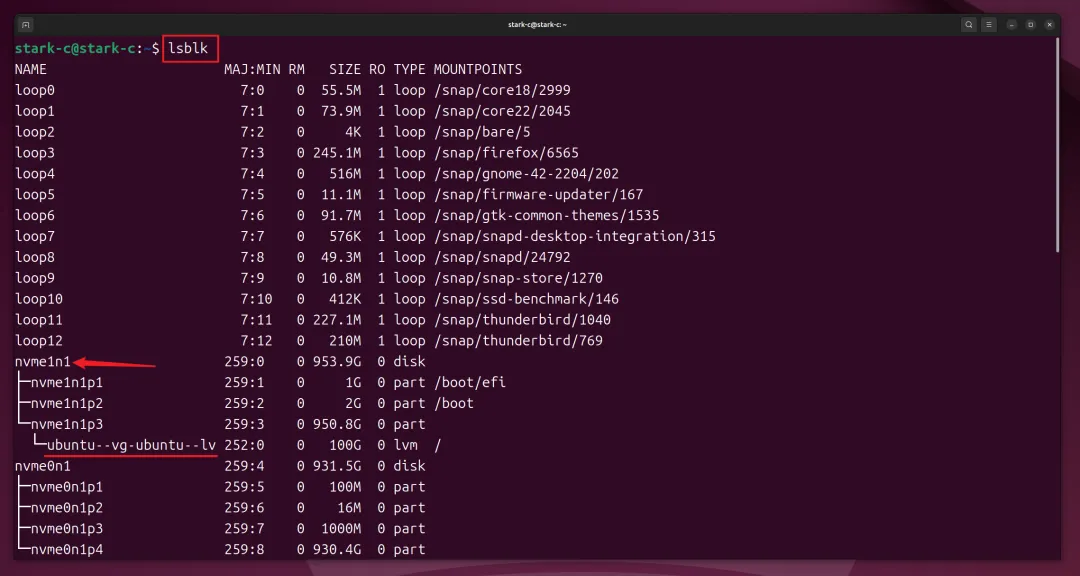

🔺开始之前我们先要确定这块硬盘零刻主机专属小龙虾硬盘的名称,输入命令“lsblk”列出主机内所有硬盘及其分区,通过ubuntu分区,可以确定我们需要测试的这块硬盘名称为“nvme1n1”,并且后面的容量也对得上。

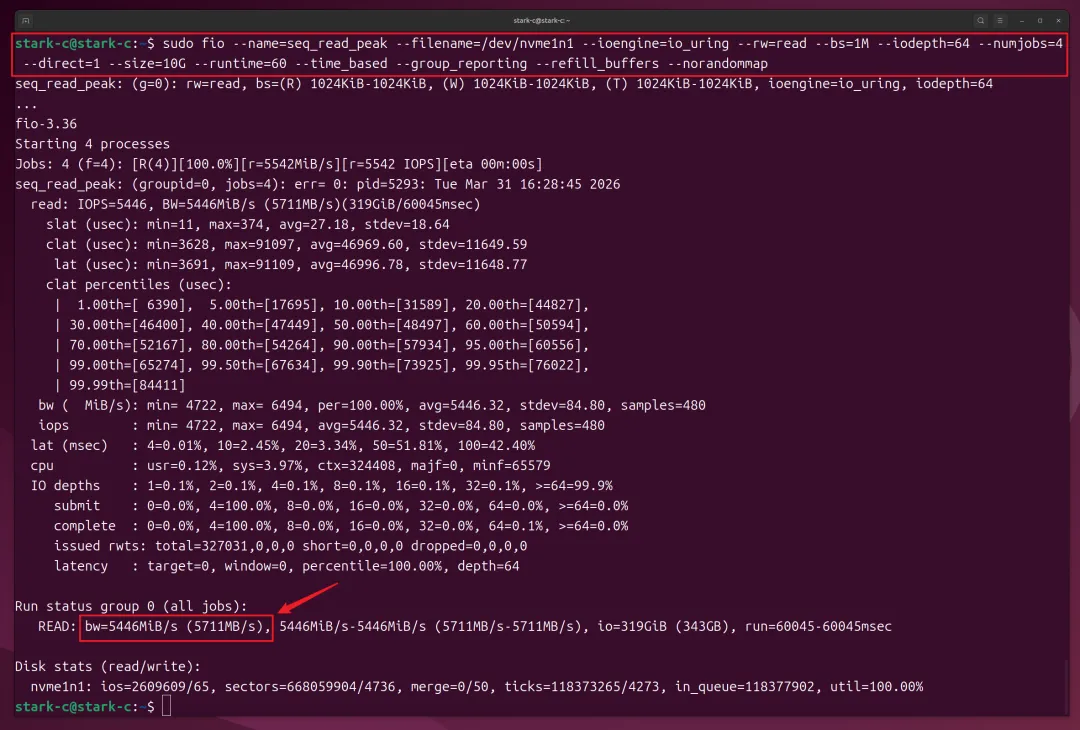

🔺接着同样在终端,使用我们安装好的FIO工具,来执行一个“顺序读取”吞吐峰值测试,测得的读取速度达到5711MB/s,竟然比官方给出的参考值5700MB/s还要高一丢丢,表现很是亮眼!

测试命令:sudo fio --name=seq_read_peak --filename=/dev/nvme1n1 --ioengine=io_uring --rw=read --bs=1M --iodepth=64 --numjobs=4 --direct=1 --size=10G --runtime=60 --time_based --group_reporting --refill_buffers --norandommap

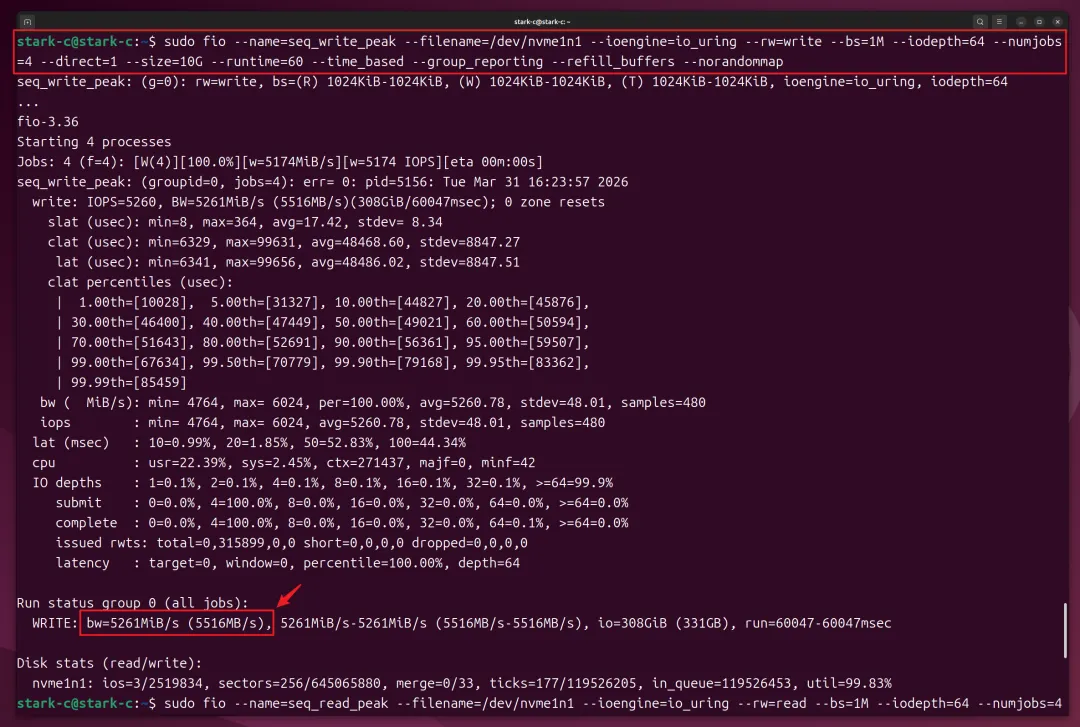

🔺同样的条件下,我在测一下它的“顺序写入”吞吐峰值,最后得出的结果为5516MB/s,表现依然非常亮眼!也就是说,抛开这根SSD的小龙虾属性不谈,但是硬盘本身的素质也非常的高!

测试命令:sudo fio --name=seq_write_peak --filename=/dev/nvme1n1 --ioengine=io_uring --rw=write --bs=1M --iodepth=64 --numjobs=4 --direct=1 --size=10G --runtime=60 --time_based --group_reporting --refill_buffers --norandommap

OpenClaw初始化配置

前面说过,因为我使用的这根M.2 SSD固态硬盘已经预装OpenClaw。也就是说,我们完全不用去某海鲜市场,找那些JS花上百,甚至上千元部署OpenClaw了,因为当我们拿着这根硬盘顺利进入系统时,就说明零刻这边已经将龙虾“送货上门”了!

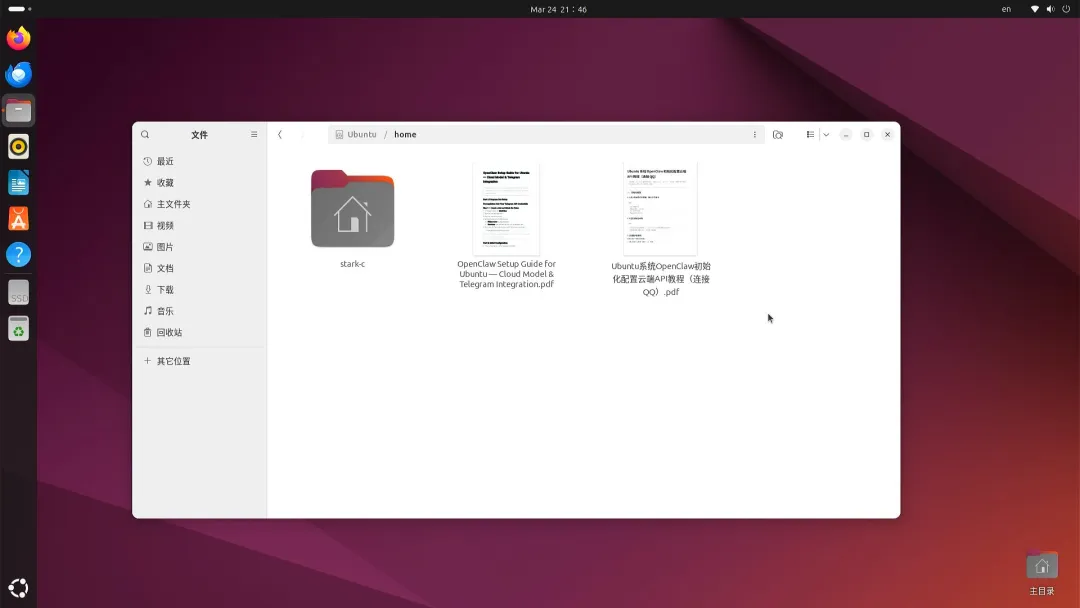

🔺不仅如此,零刻还在系统的文件管理器的主目录,也就是“/home”文件夹中,预装了OpenClaw的初始化配置教程,中英文PDF文件各一份。

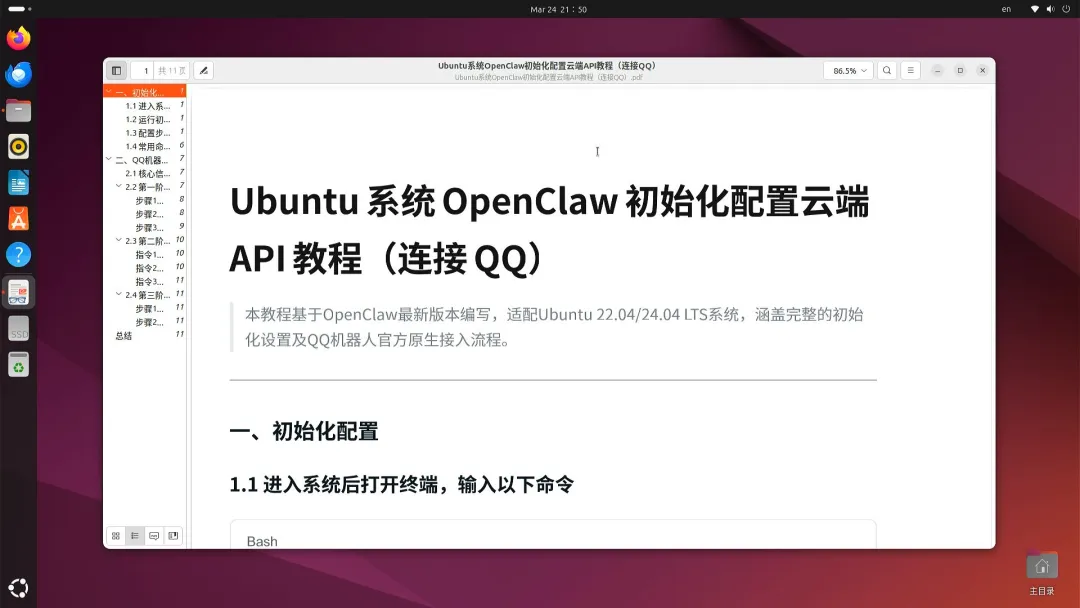

🔺打开就能使用,教程看上去还挺详细的。不过作为已经在“虾场”打摸滚爬数次的我来说,这个初始化配置对于我来说,貌似根本就用不上啊~

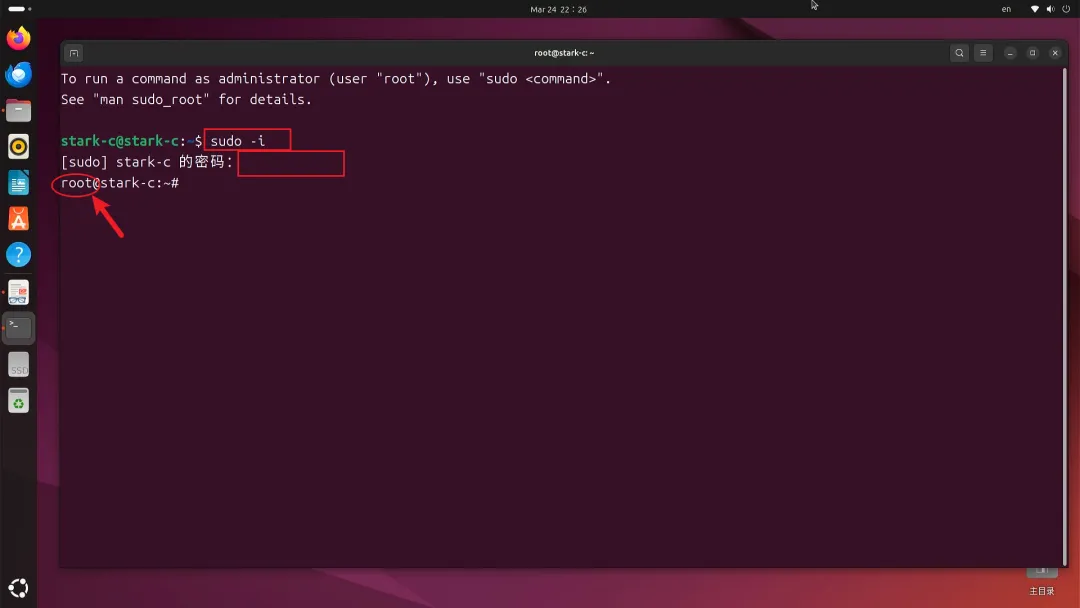

🔺接下来来展示下我自己这边的初始化配置。打开终端之后,先切换到root用户。输入命令“sudo -i”回车,然后提示输入密码,这里的密码同样是系统初始化设置的密码,输入密码的时候没有显示,输完密码之后直接回车,等到下一行以“root”开头,就说明成功进入root用户模式了。

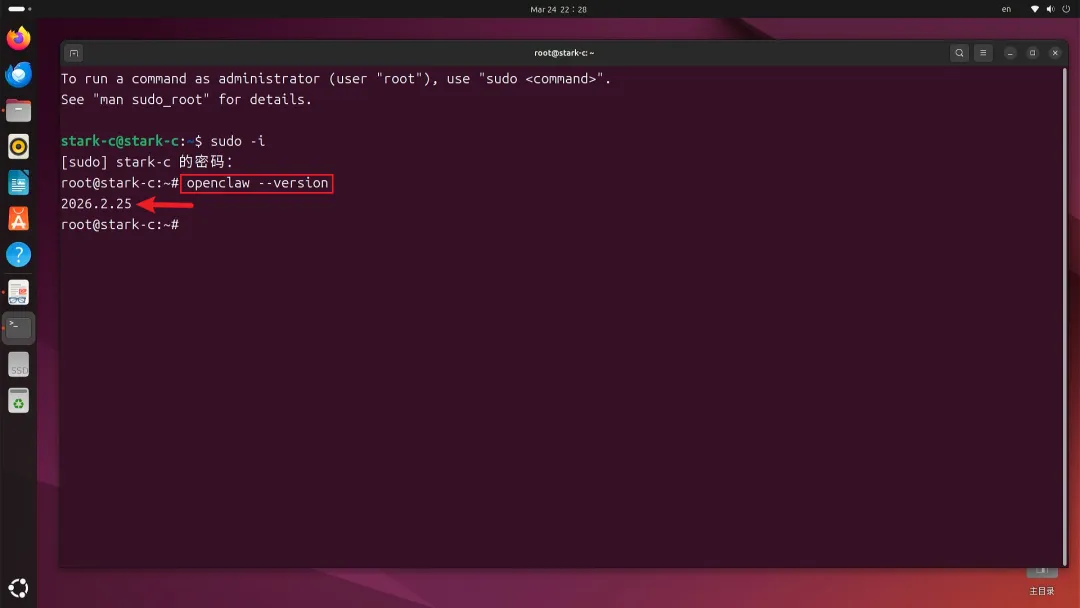

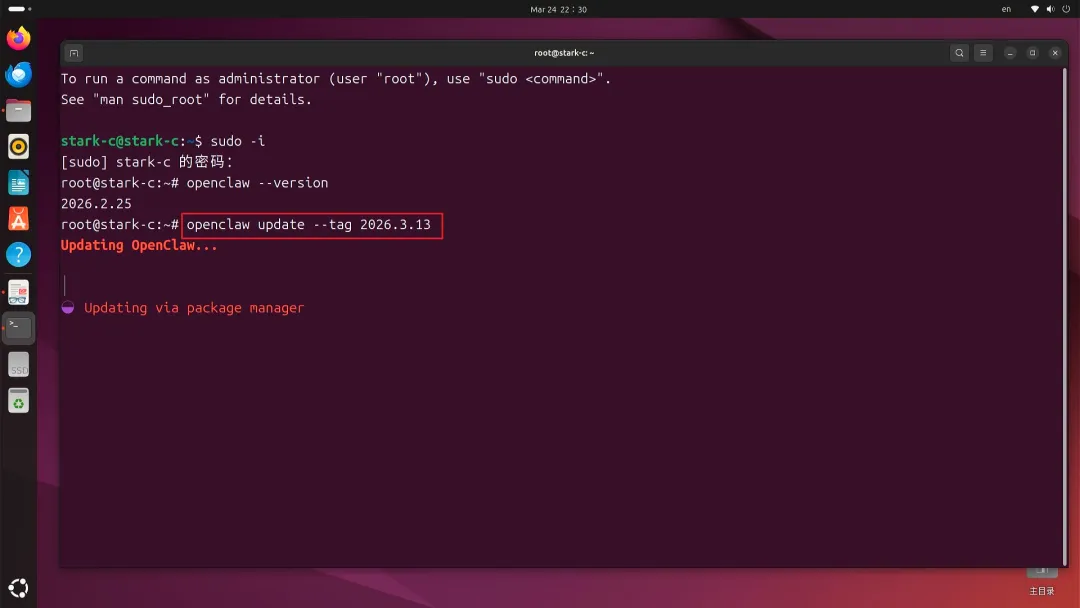

🔺这个时候先输入命令“openclaw --version”查看当前OpenClaw的版本,可以看到我手上这根SSD硬盘预装的OpenClaw版本号为“2026.2.25”,在当前OpenClaw疯狂迭代更新的时候,这个版本很明显有些“老旧”了,所以我们需要将它升级。

🔺以我当前的时间点来说,OpenClaw最新版本为“2026.3.23”,但是这个版本关注它的都知道,翻车严重,直接把Web UI都给干没了,并且好多插件也不支持,所以我就需要让它升级到指定的稳定最新版本,也就是上一个“2026.3.13”版本。

怎么做到呢?很简单,直接输入指令”openclaw updata --tag 2016.3.13“即可。

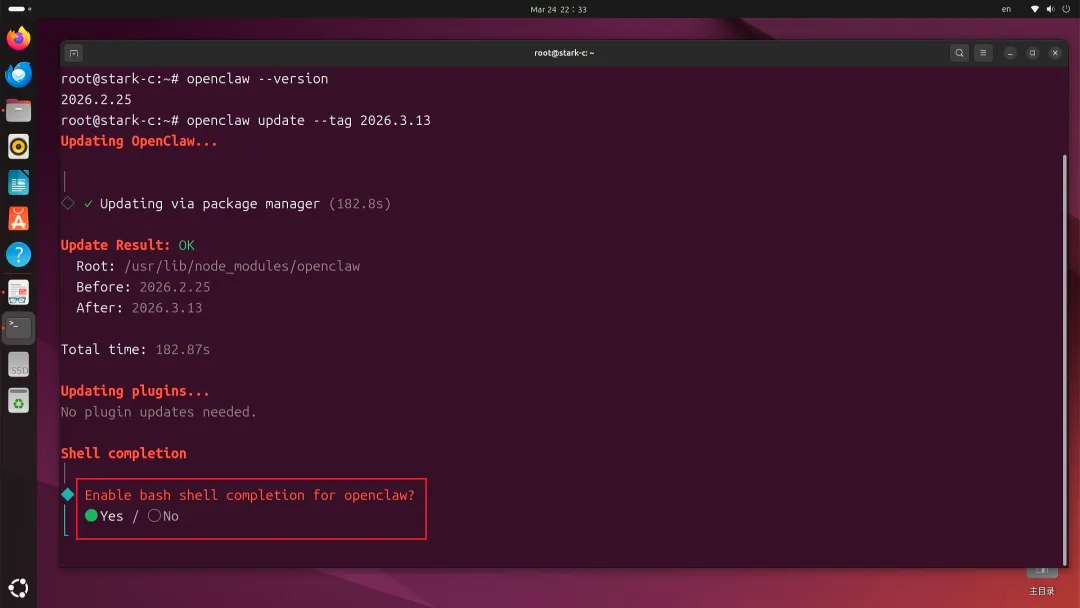

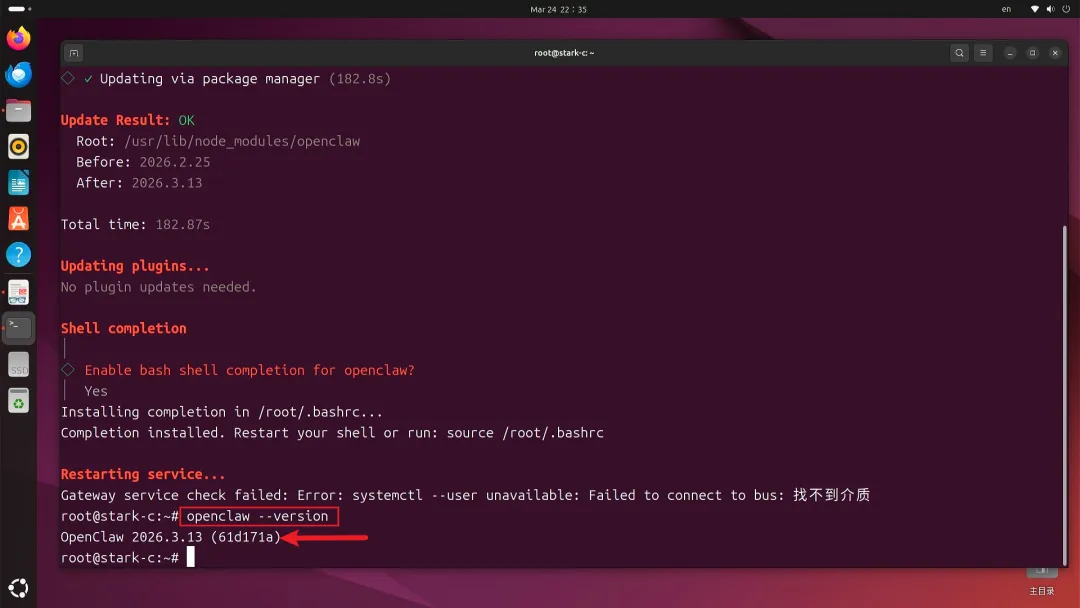

🔺然后OpenClaw就会自动升级到我们指定的这个版本。升级完成后会有一个启用bash shell的交互,直接选择“Yes”。

🔺等待升级完成后,再次输入版本号查看命令“openclaw --version”,可以看到显示的就是我们指定的“2026.3.13”版本。

然后细节来了!因为OpenClaw可执行的权限实在太大,个人建议接下来的初始化配置尽量别在当前的root用户模式下操作,需要退出root用户模式而进入普通用户模式,直接执行命令“exit”即可。(原谅我这里忘记截图了~)。

PS:普通用户模式还有另外一个好处,这里先卖个关子,后面再为大家揭晓~

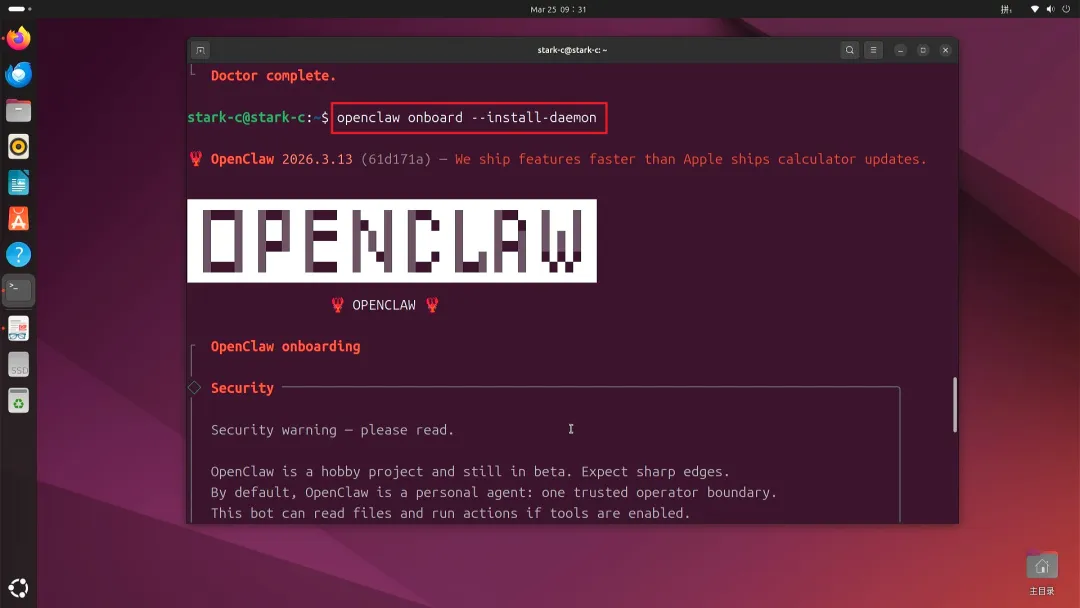

🔺退回普通用户模式之后,这里就可以执行OpenClaw的初始化配置了。输入命令“openclaw onboard --install-daemon”,就可以正式进入OpenClaw的交互式配置向导了。

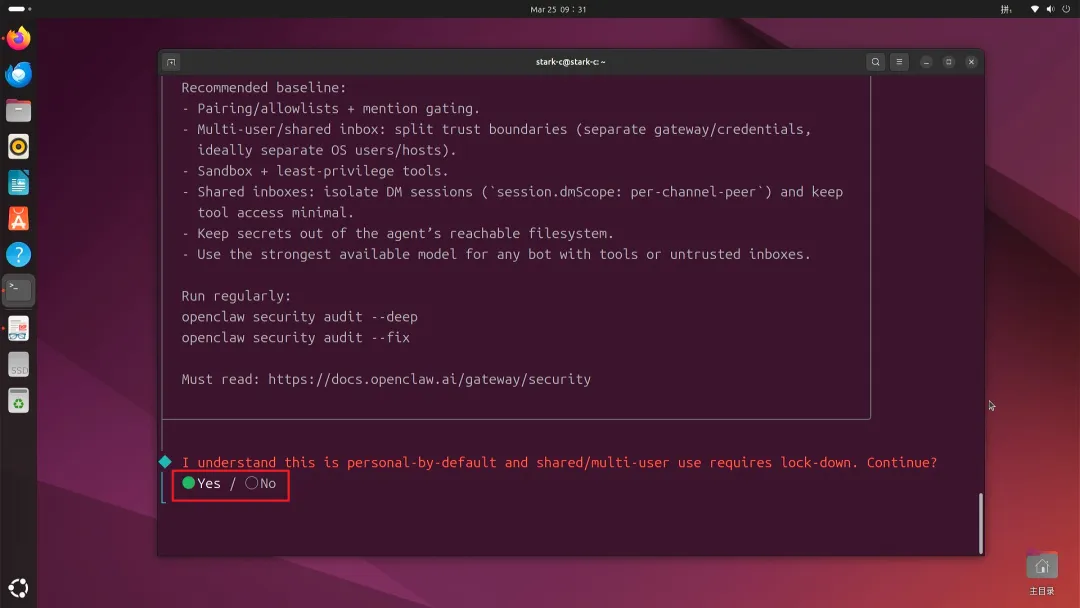

🔺这里需要确认是否个人使用,选择“Yes”。

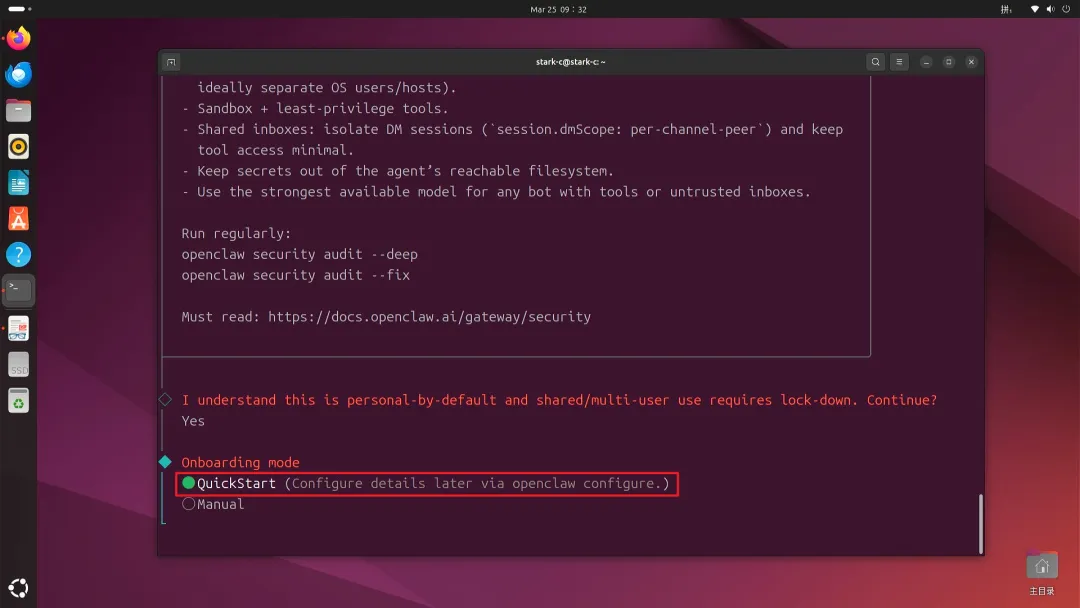

🔺然后是选择引导模式,直接选择“Quickstart(快速启动)”即可。

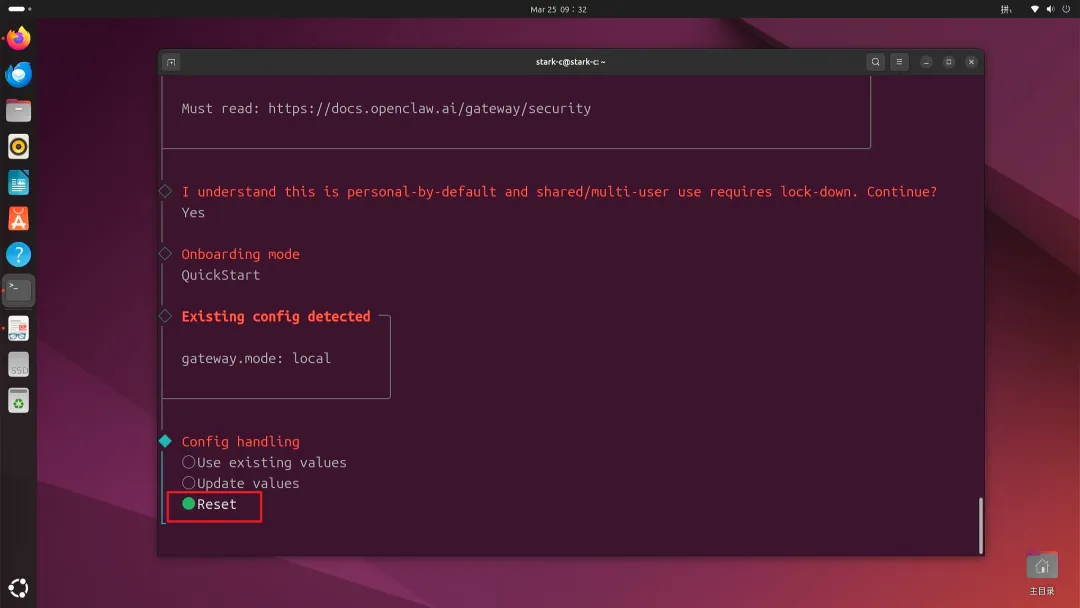

🔺因为是首次配置,配置处理这里选择“Reset(重置)”

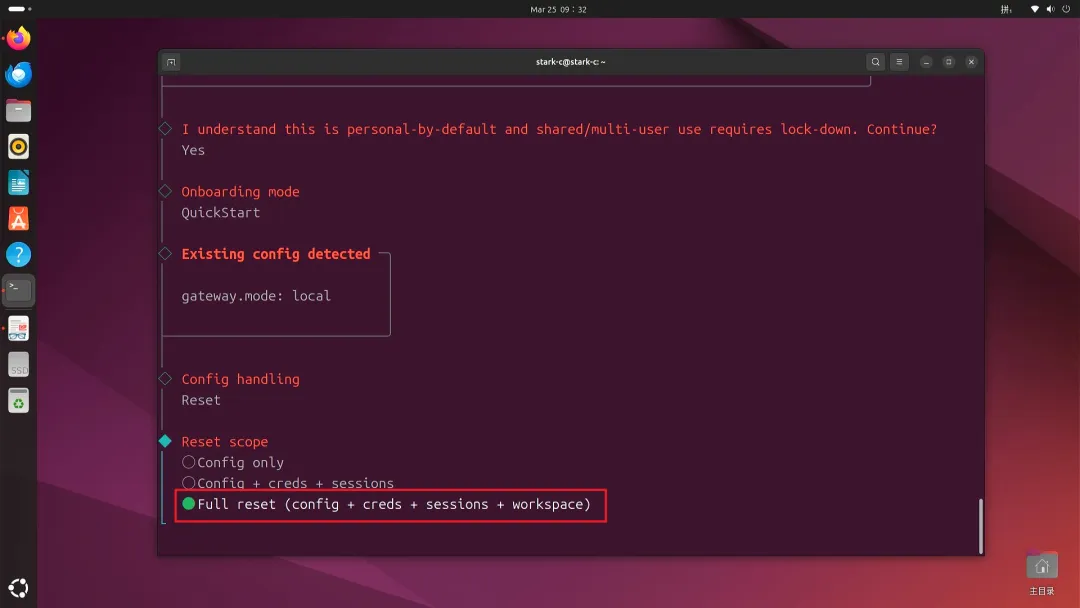

🔺询问重置那些配置,直接选择最后一个“Full reset(全部重置)”。

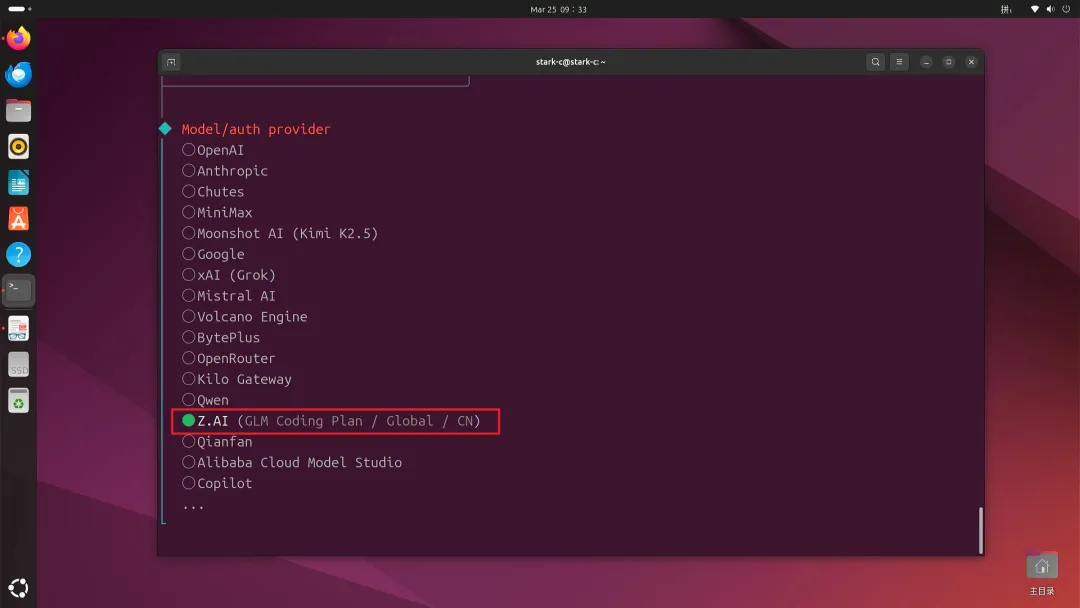

🔺然后就进入配置大模型的选项了,这里根据自己的实际情况来选择即可。我个人准备的智谱大模型,所以这里选择的“Z.AI”。

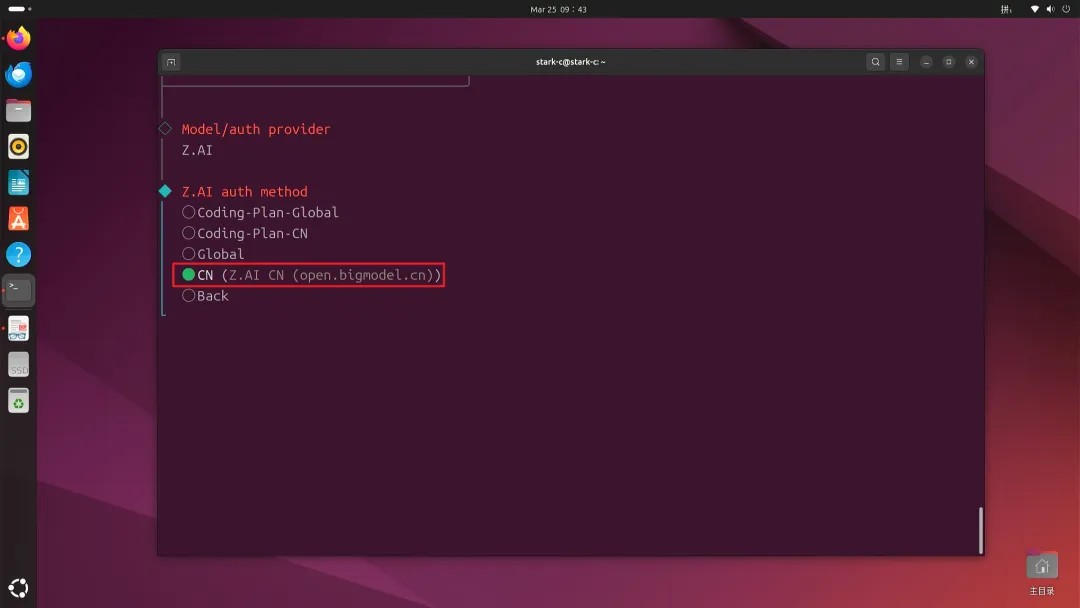

🔺身份验证这里选择CN(中国)。

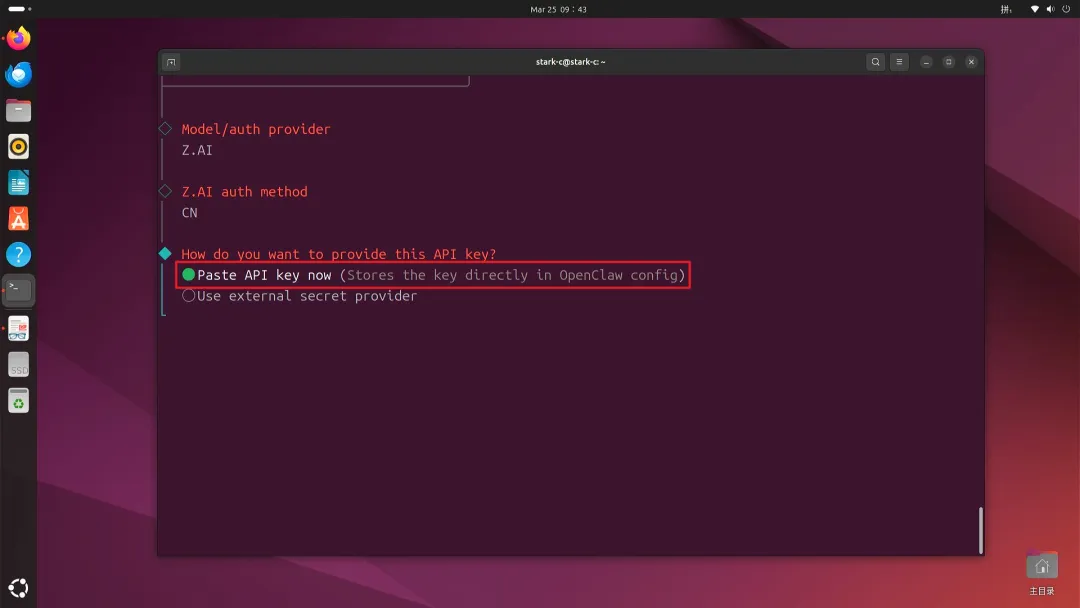

🔺这里提示如何使用大模型的API key,选择Paste(粘贴)即可。

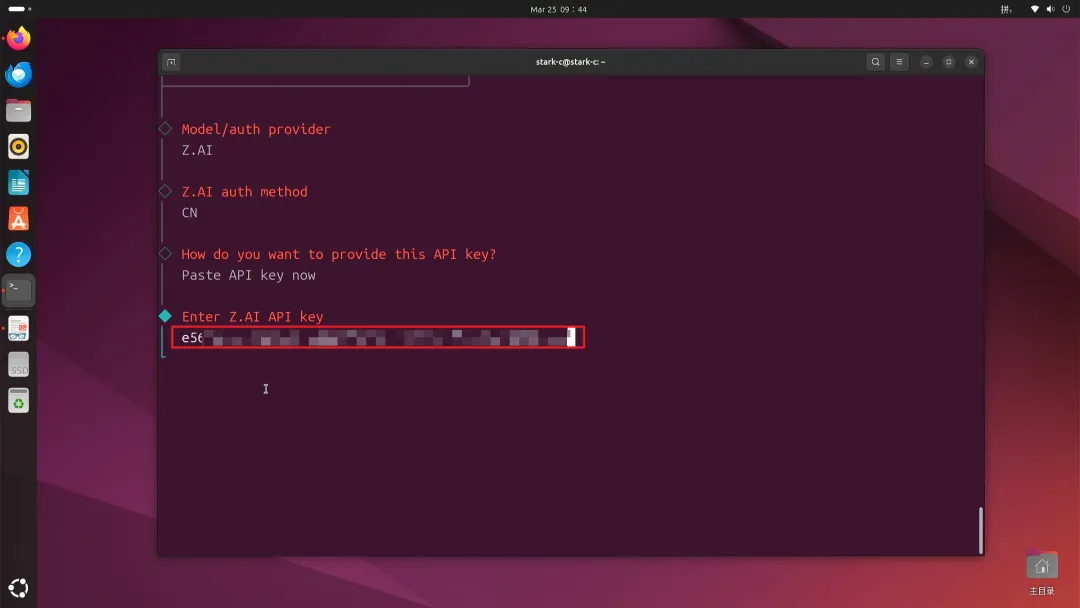

🔺然后将准备好的智谱大模型API Key粘贴过来即可。

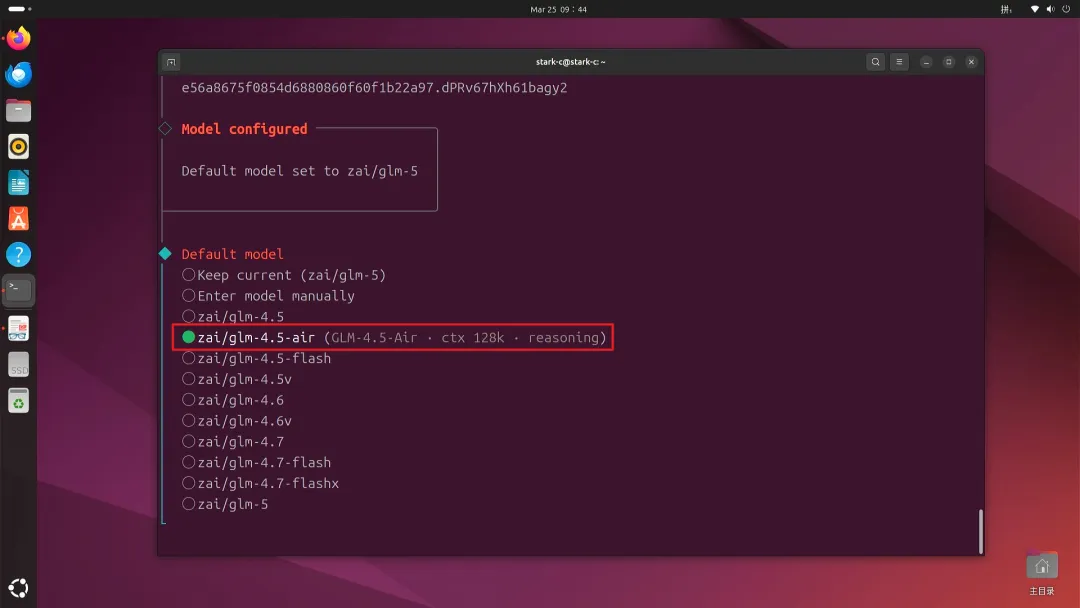

🔺接着是选择大模型的型号,我这里因为还有很多邀请送的资源包,所以选择的是GLM-4.5-Air,如果你是自己付费的,就选GLM-5,能力更强。

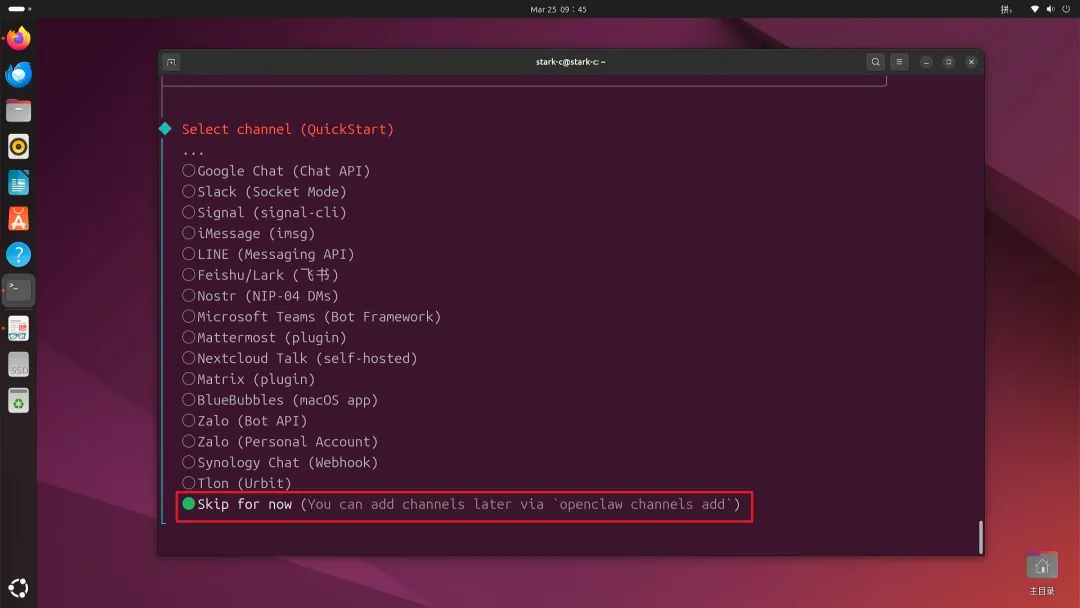

🔺之后就是选择通讯渠道(交互方式),如果是使用国内的飞书或者微信,这里就直接选择最后Skip for now(暂时跳过)就可以了,因为当前飞书和微信已经推出官方插件,添加会更加方便,使用方法后面我单独说。

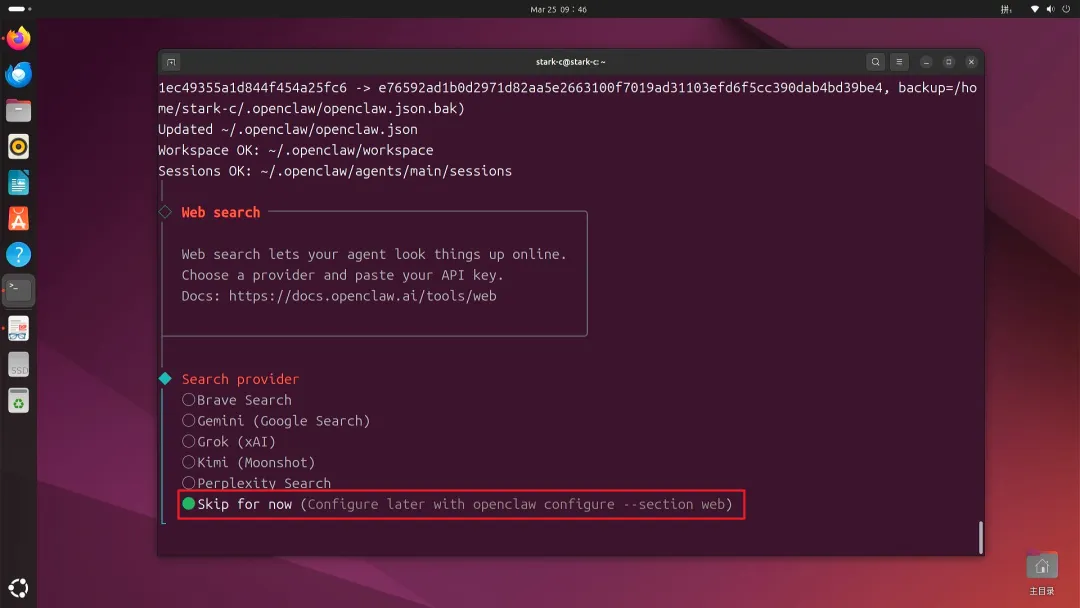

🔺然后是搜索服务商我们也Skip for now(暂时跳过),它这里的要么是国外的(魔法网络),要么需要付费,我们其实完全可以使用其它适合国内使用的免费方案,比如说Tavily,或者是自建搜索服务引擎SearXNG。

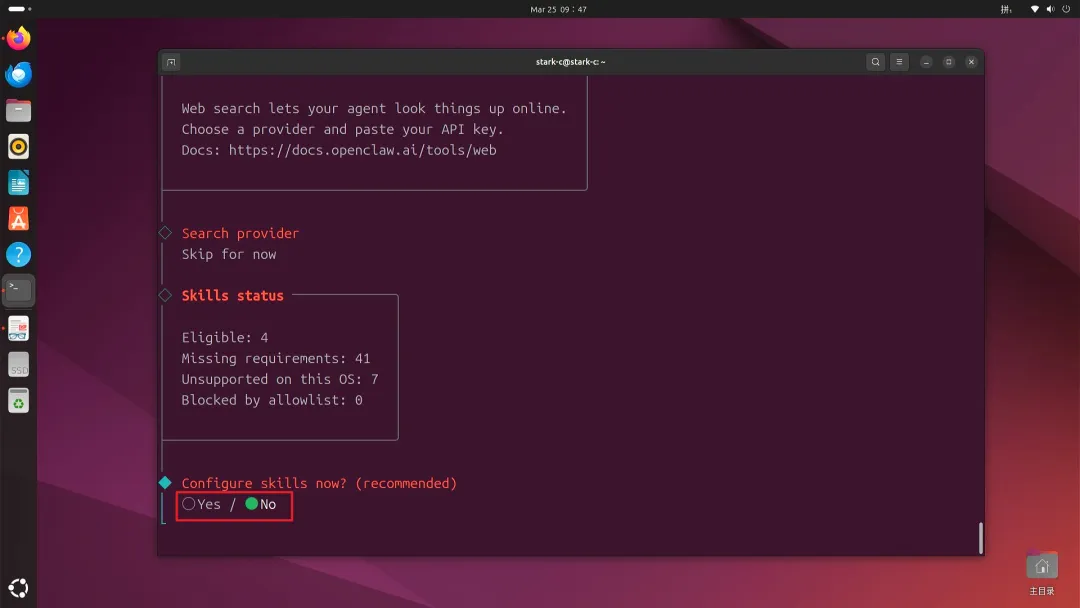

🔺然后是skills(技能)的安装,这里选择“No”,技能完全可以让龙虾自己装,不需要我们动手~

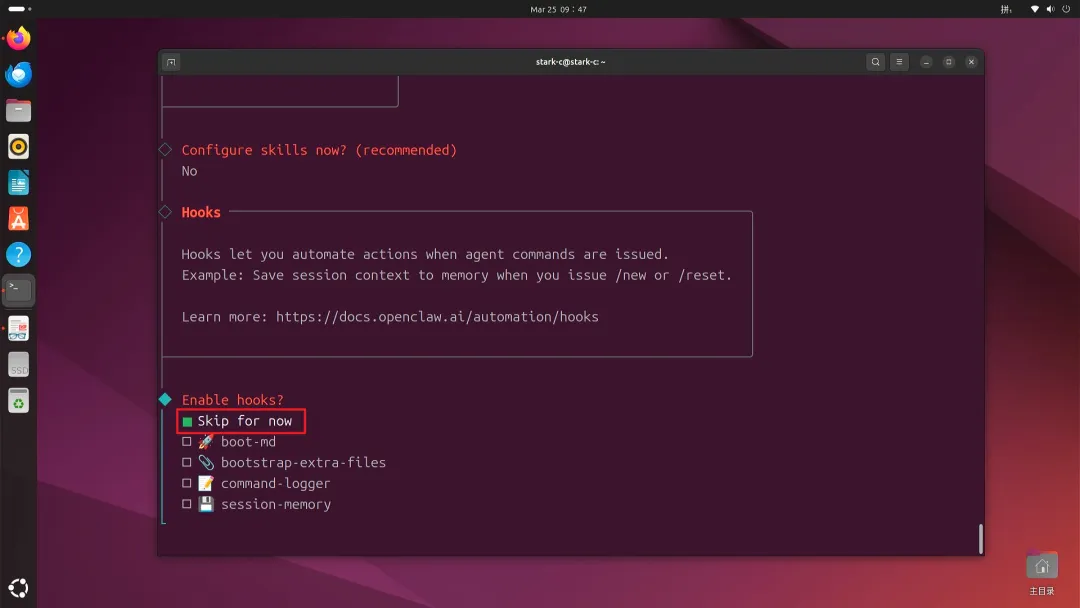

🔺hooks(钩子)这里建议选择“Skip for now”。

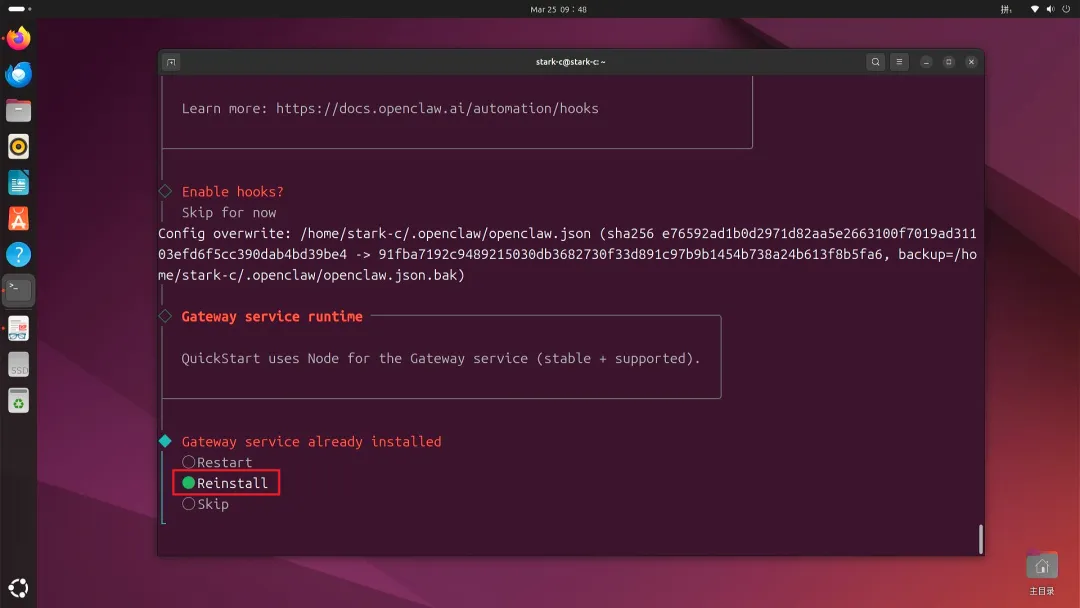

🔺这里网关服务的配置,选择“Reinstall(重新安装)”。

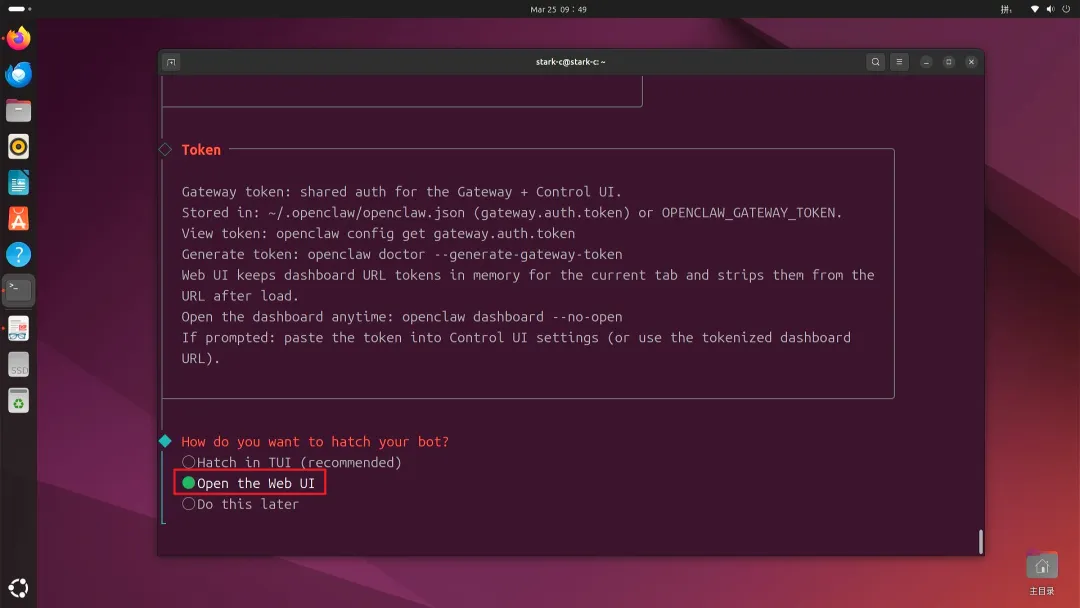

🔺最后是询问如何打开我们的小龙虾,建议选择“Open the Web UI(网页端)”。

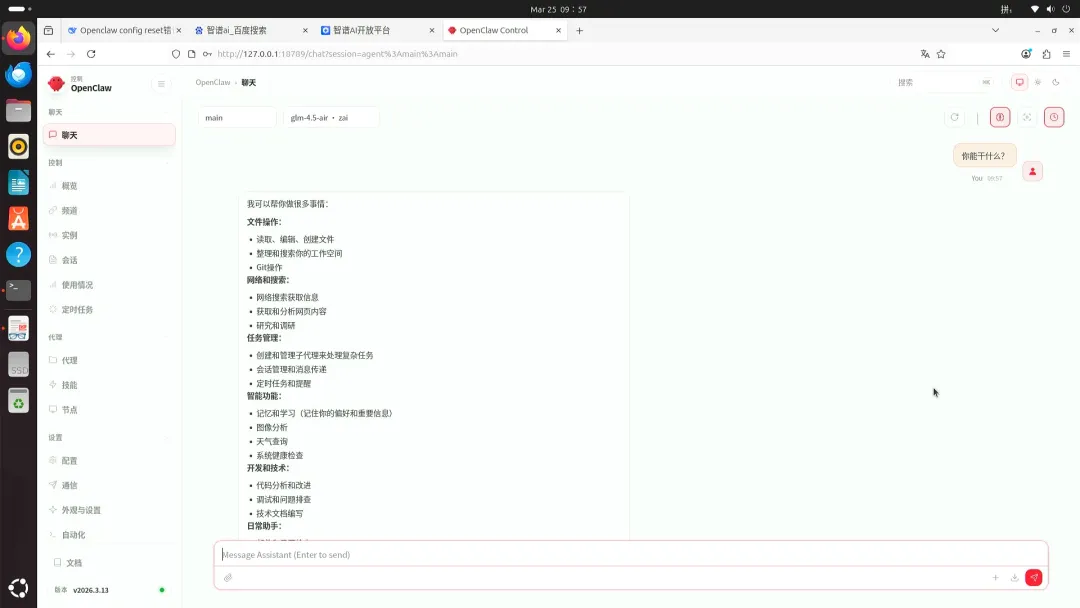

🔺然后它就会自动启动系统内置的火狐浏览器,打开OpenClaw的Web UI界面。如果没什么问题,我们这个时候已经可以正常和小龙虾对话了!

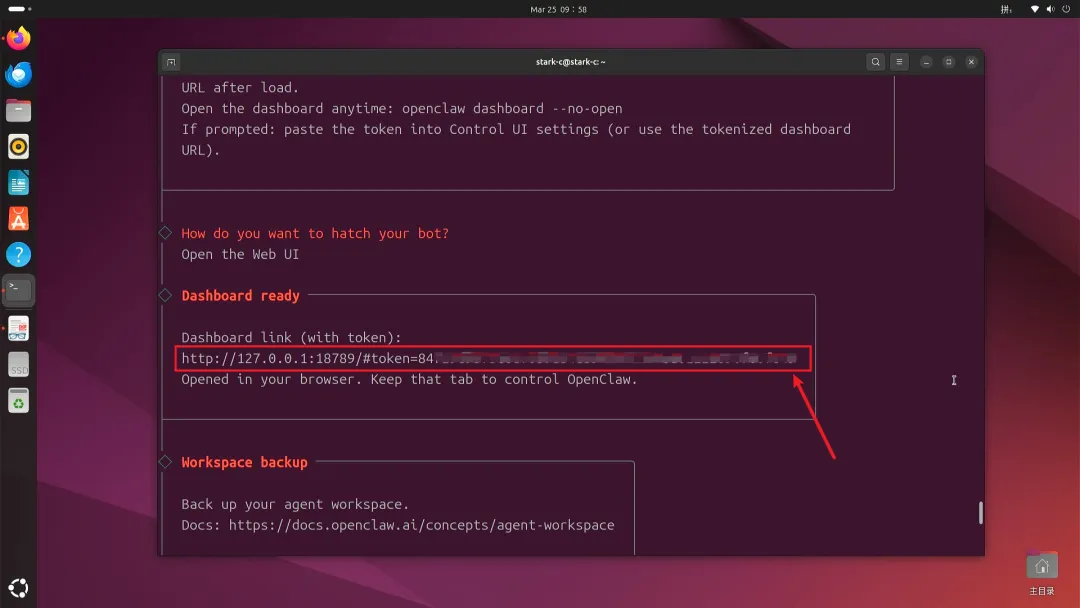

🔺那么我们下次怎么打开呢?其实在终端中的Dashboard ready下面显示的那个后面带token的链接就是,我们之后只要打开这个链接,就是OpenClaw的Web UI界面。

配置飞书和微信交互

目前飞书和微信都已经发布了自己的官方插件,只需要一个指令,就能一键对接到OpenClaw,并且不需要任何多余的来回设置与授权,非常方便!

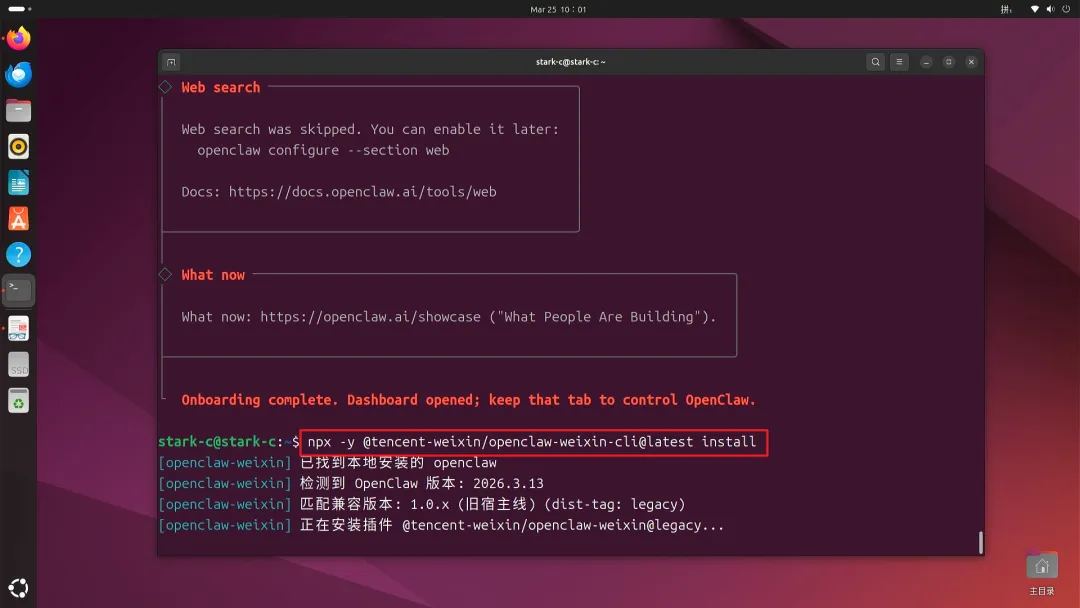

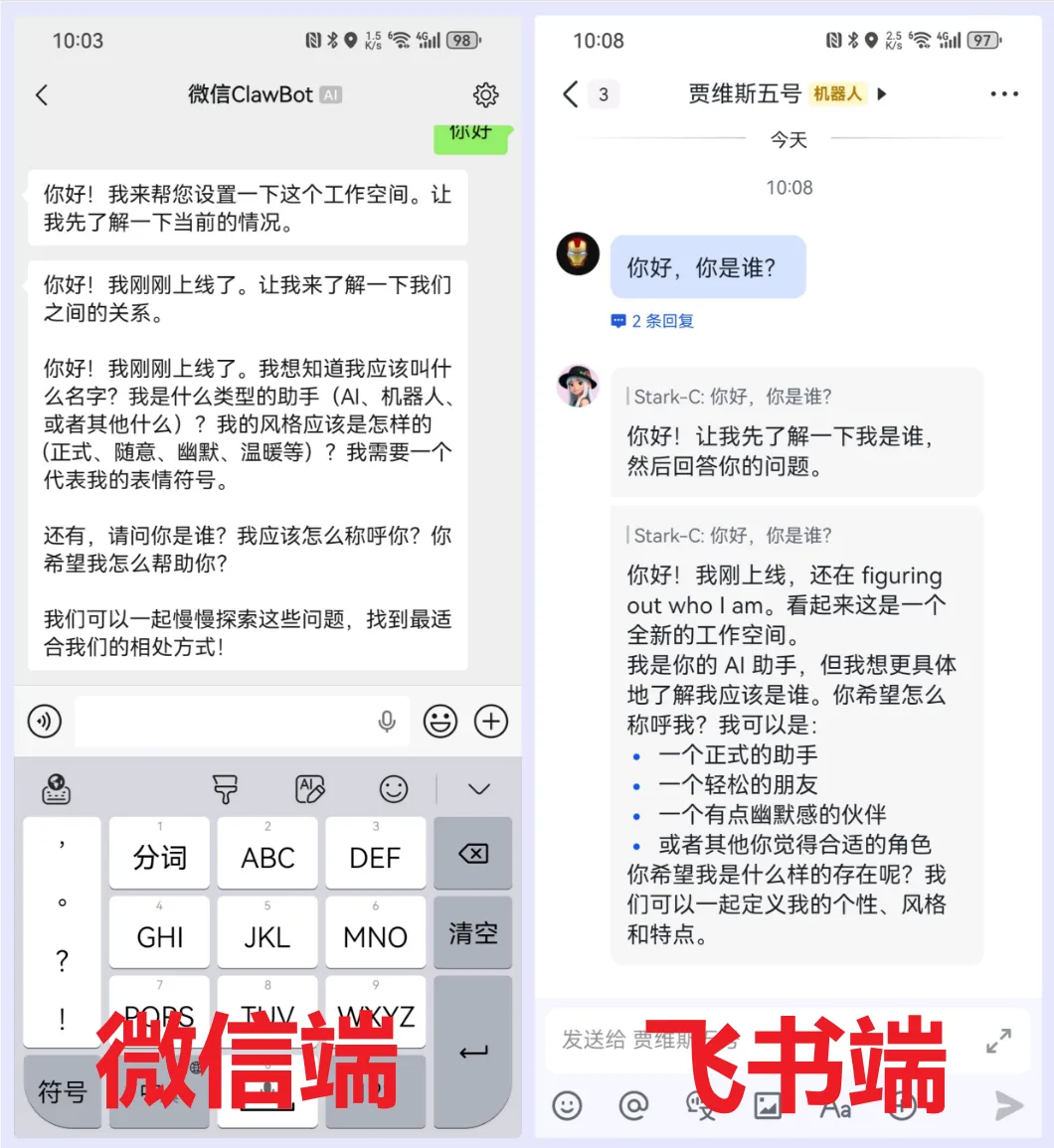

🔺先来说微信的,在我们初始化设置好OpenClaw之后,直接在终端输入指令“npx -y @tencent-weixin/openclaw-weixin-cli@latest install”,插件就会自动检查当前的环境状态,自动执行安装或更新操作。

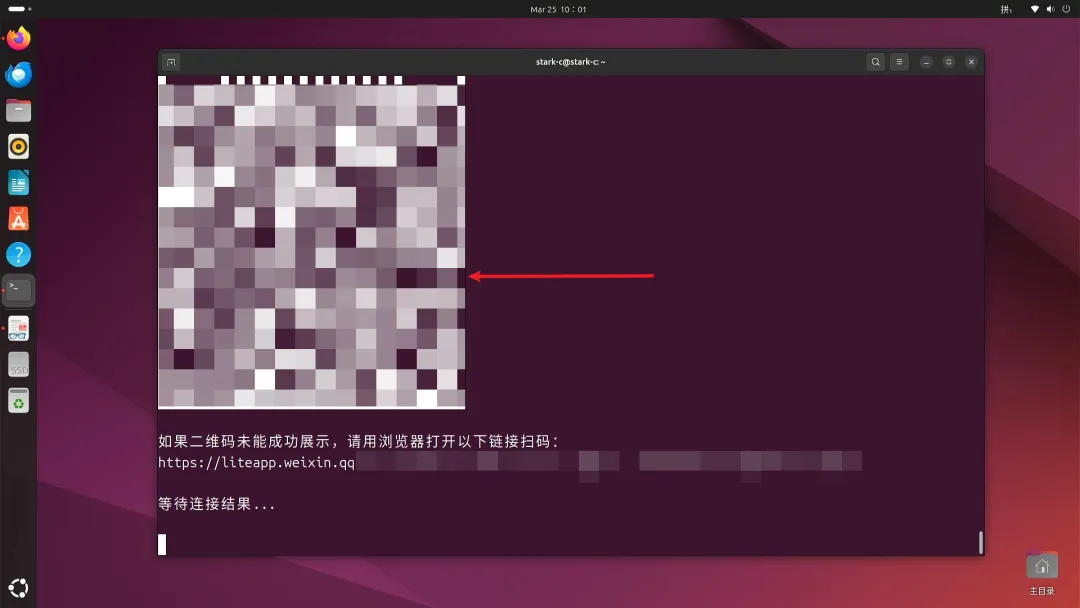

🔺安装完成后会给到一个二维码,我们直接使用自己的微信扫描这个二维码。

PS:如果碰到没有正常生成二维码,可以通过指令“openclaw channels login --channel openclaw-weixin”重新生成。

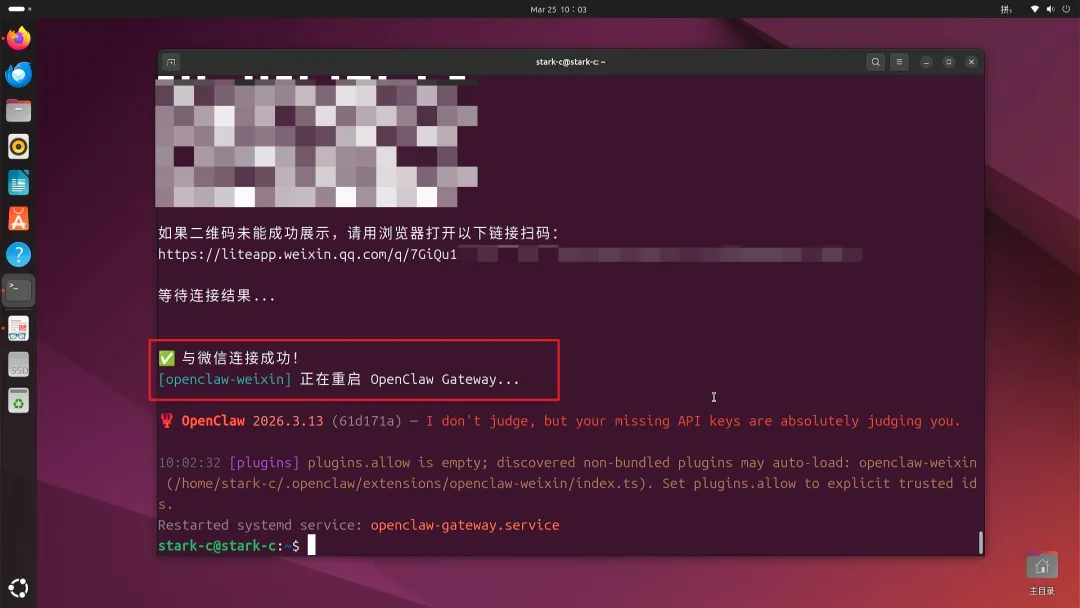

🔺扫描二维码之后再微信端确认之后,这里就会显示“与微信连接成功”的提示,并且还会自动重启网关。

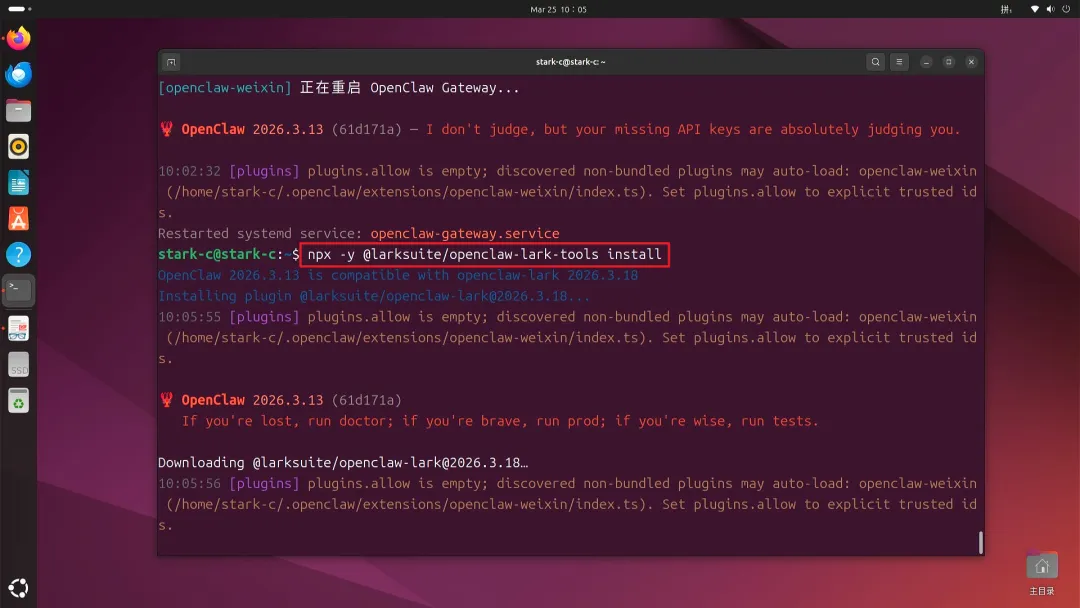

🔺飞书这边也是一样,同样在终端输入指令“npx -y @larksuite/openclaw-lark install”。

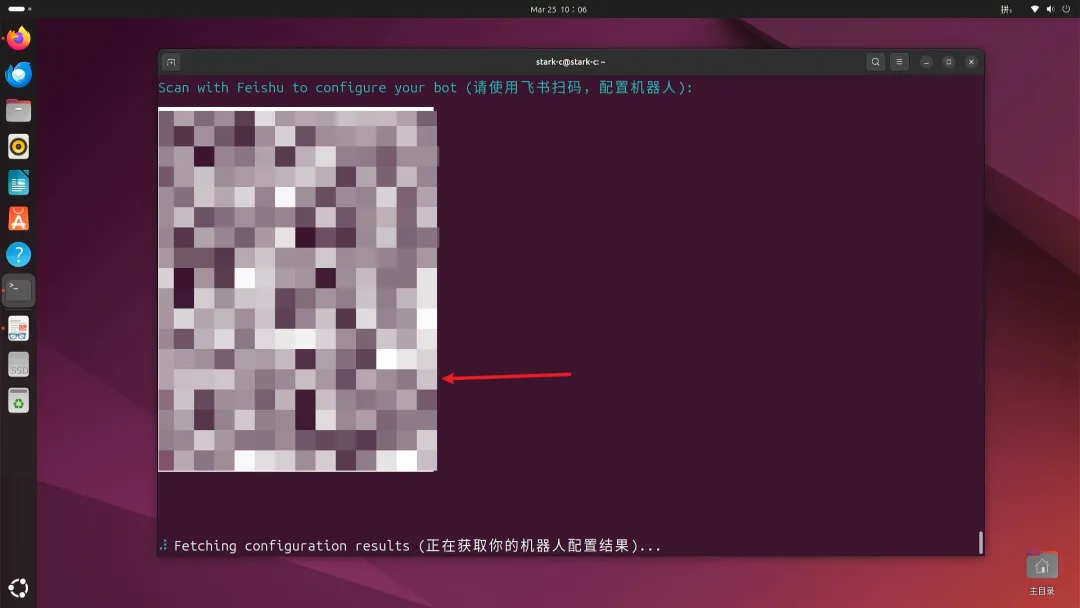

🔺之后也会出现一个二维码,我们直接使用手机飞书APP扫描这个二维码,就能一键创建飞书机器人了!

🔺不得不说官方出手就是猛,不管是微信端还是飞书端都能直接正常使用,只不过当前微信端的功能还比较有限,而飞书端就很强大了,不仅支持流式输出,而且还真的可以接入工作流,替我们回复消息,创建文档、多维表格,管理日程等。

配置Ollama 本地模型

玩小龙虾最让人无奈的就是部署成功了,但养不起(完全就是tokens粉碎机)。怎么解决这个问题呢?很简单,那就不花钱买商家的tokens,自己本地部署大模型服务,让OpenClaw接入就可以了。

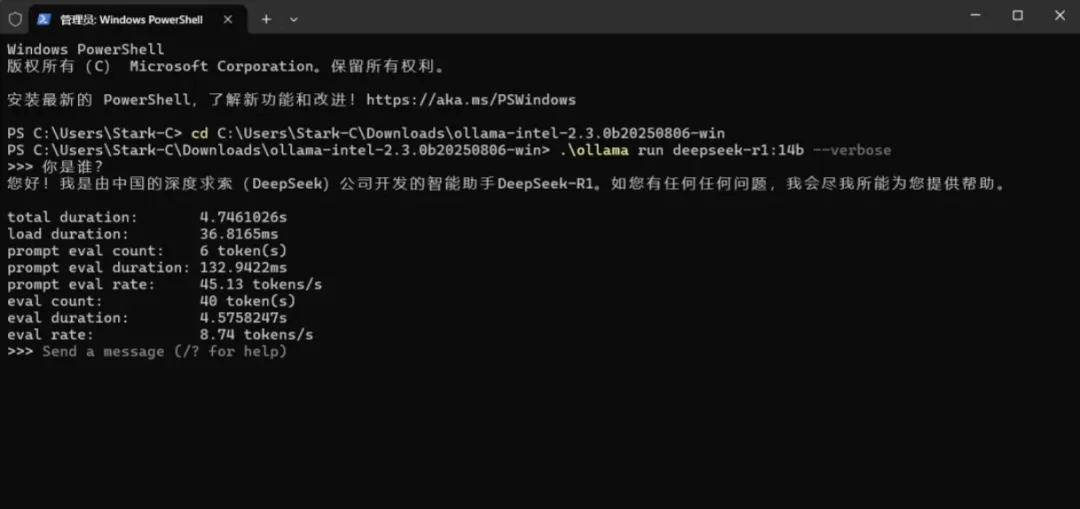

🔺之前看过我零刻GTi15 Ultra评测的小伙伴应该还有映像吧?零刻GTi15 Ultra得益于自身强大的Core Ultra 9 285H处理器,展现出强大的AI性能。我当时实机演示了在本地跑魔搭社区推出的Ollama 英特尔优化版Deepseek-14B 大模型,竟然跑到8.74tokens/s的成绩,这在没有独显加持的主机中,表现已经非常亮眼了!

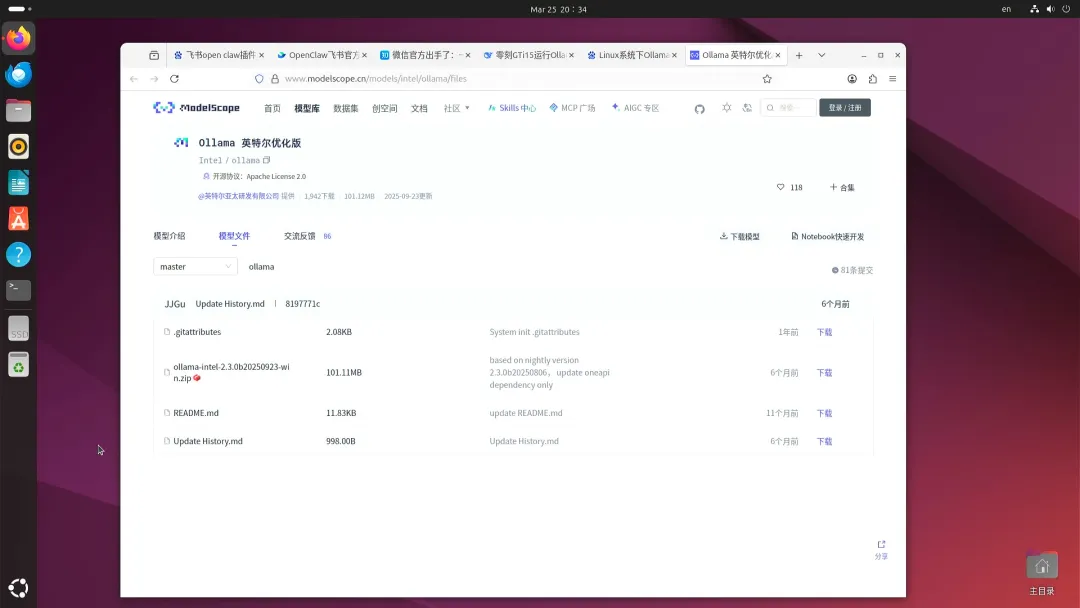

🔺我原版打算在当前的Ubuntu系统中也使用这个Ollama 英特尔优化版,但是貌似被开发者下架了~,有点遗憾,所以不得已还是选择直接跑Ollama原版了,只不过原版不会和优化版那样会调用GPU,就纯粹考验CPU性能了。

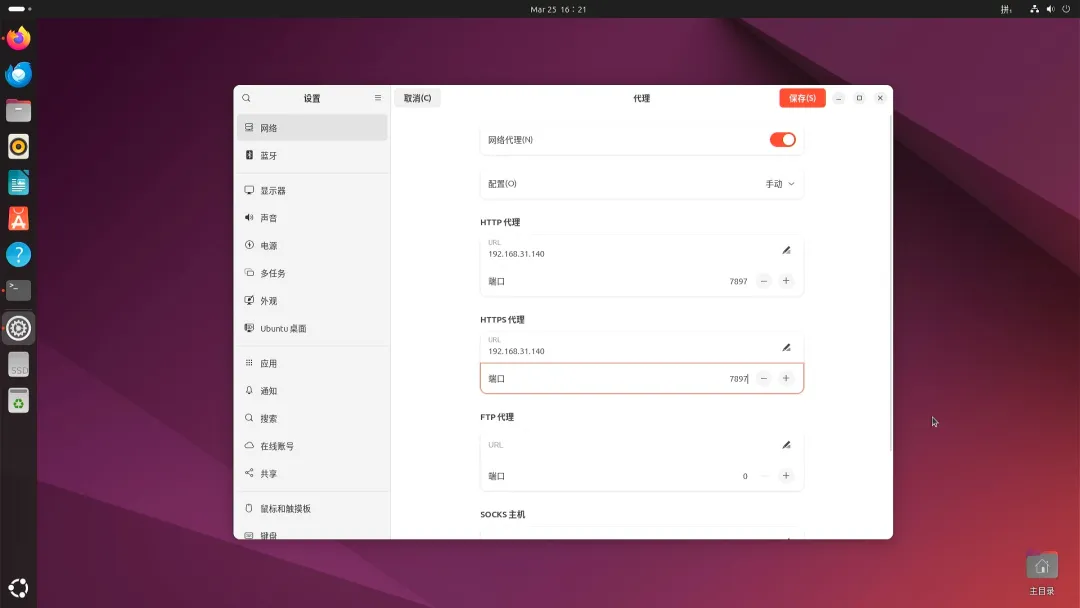

🔺另外需要说明的是,原版Ollama在安装的时候需要下载一下依赖文件,这些依赖文件可能对于国内网络环境不太友好,所以在这之前建议大家将自家网络接入互联网,我是通过Ubuntu系统内置的代理来使用的。

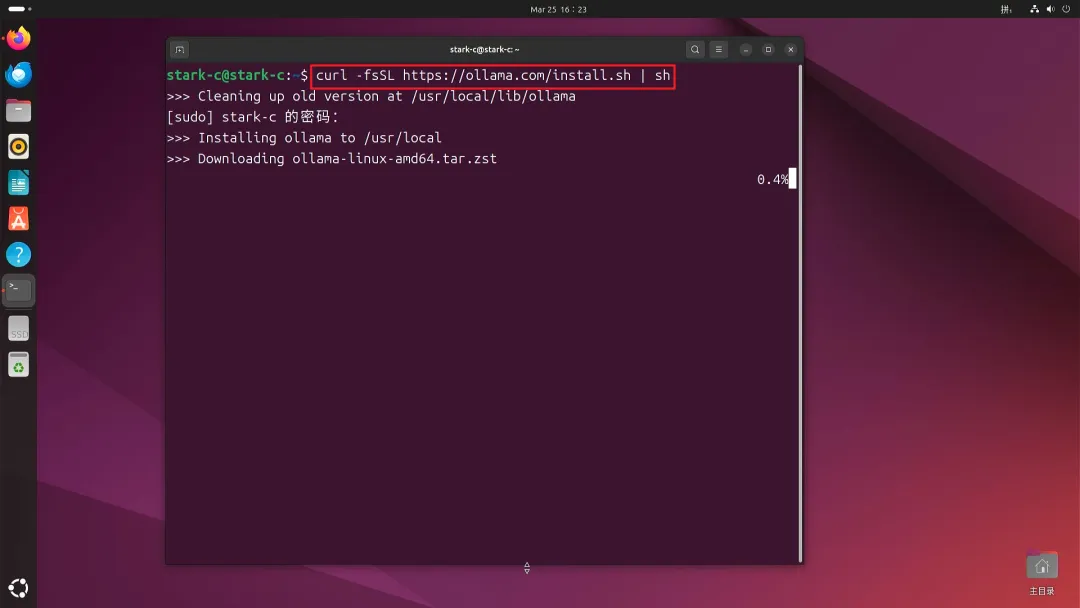

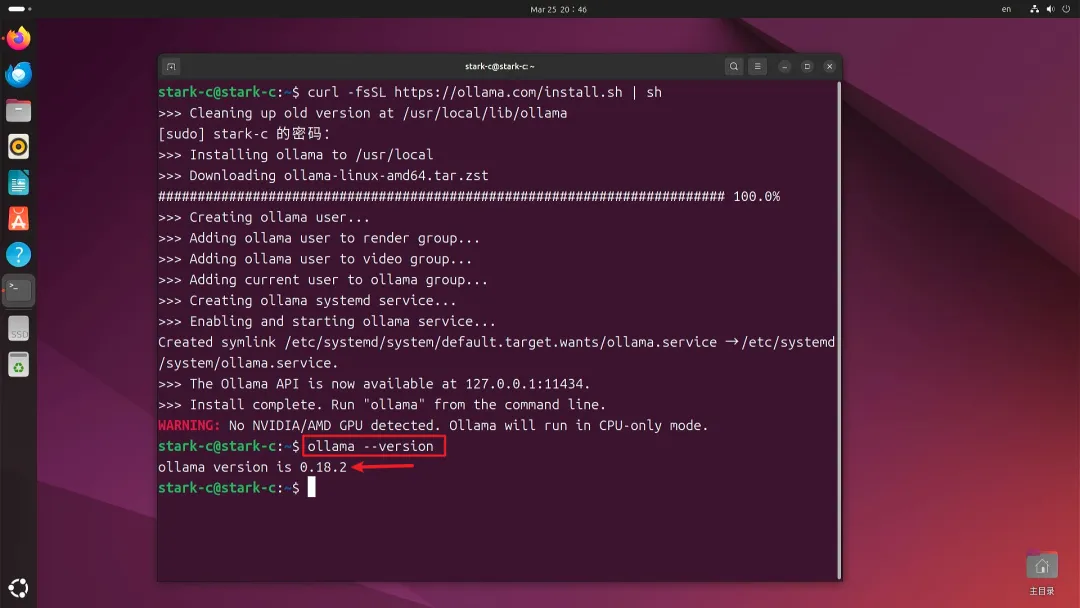

🔺记下来开始正式安装Ollama,同样在终端进行,输入部署指令“curl -fsSL https://ollama.com/install.sh | sh”,然后同样让我们输入密码,密码还是系统初始化设置的密码,之后Ollama就会自动安装和部署了。

🔺完成之后输入命令“ollama --version”查看版本,可以看到部署的是最新版0.18.2版本。

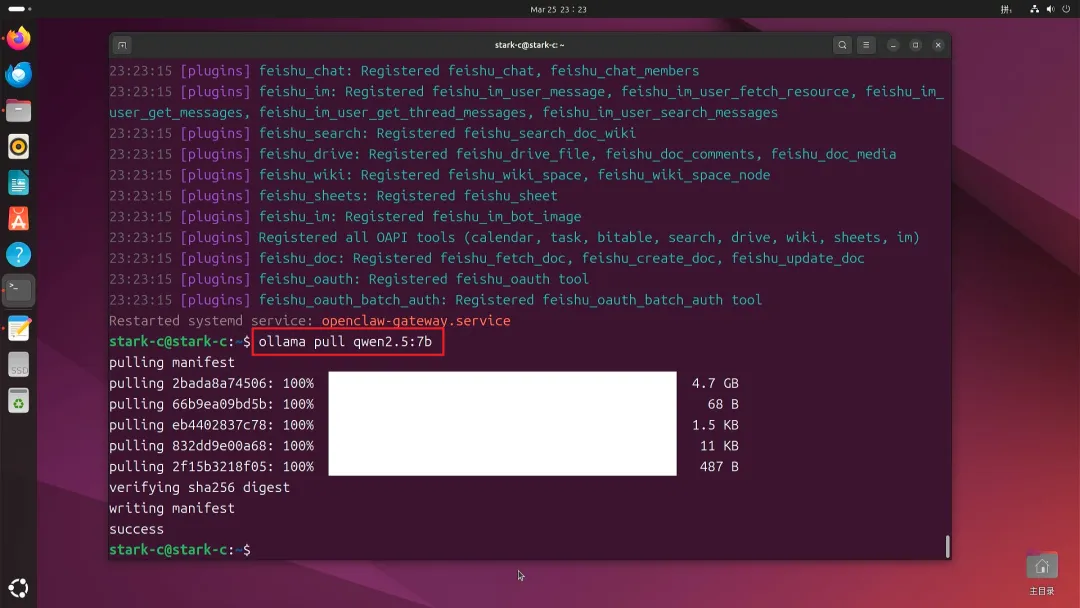

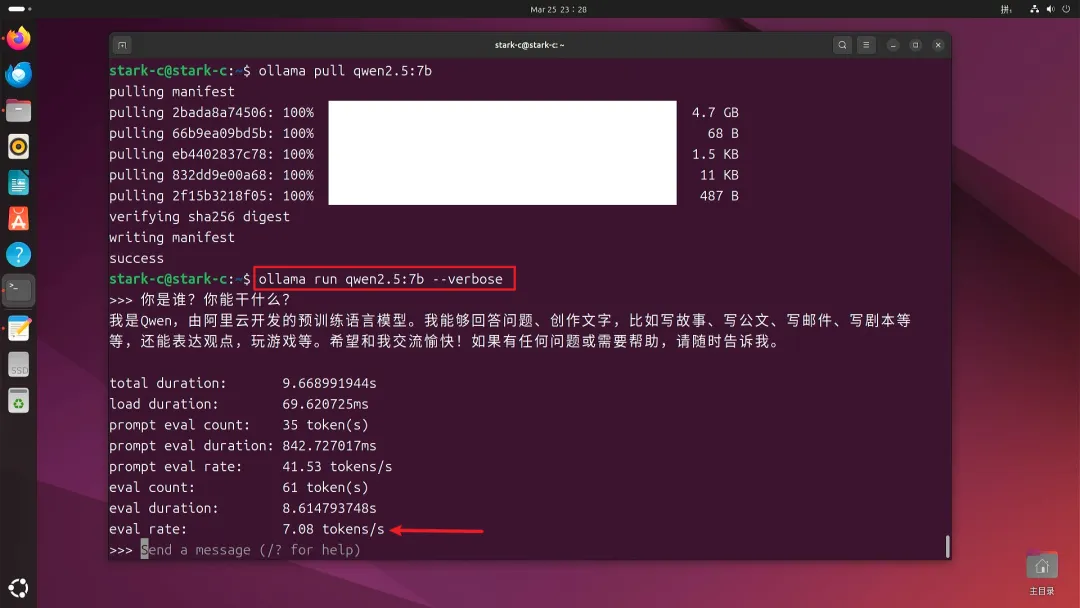

🔺然后开始拉取AI大模型,我实测了五款本地模型,最终选择了“qwen2.5:7b”模型,部署指令为“ollama pull qwen2.5:7b”。这个模型应该也算是通义千问旗下比较热门的一个大型指令微调模型,具有不错的知识覆盖、代码生成、数学推理等核心能力。还有就是它没有思考模式,并且在零刻GTi15 Ultra上跑起来的速度也还可以。

🔺“qwen2.5:7b”模型部署好之后,在没有其它任何优化的前提下,我这边实测它的输出速度为7.08tokens/s。确实谈不上优秀,也属于“打字机”范畴,但这可是本地不用联网,不费tokens的大模型,表现已经很不错了。

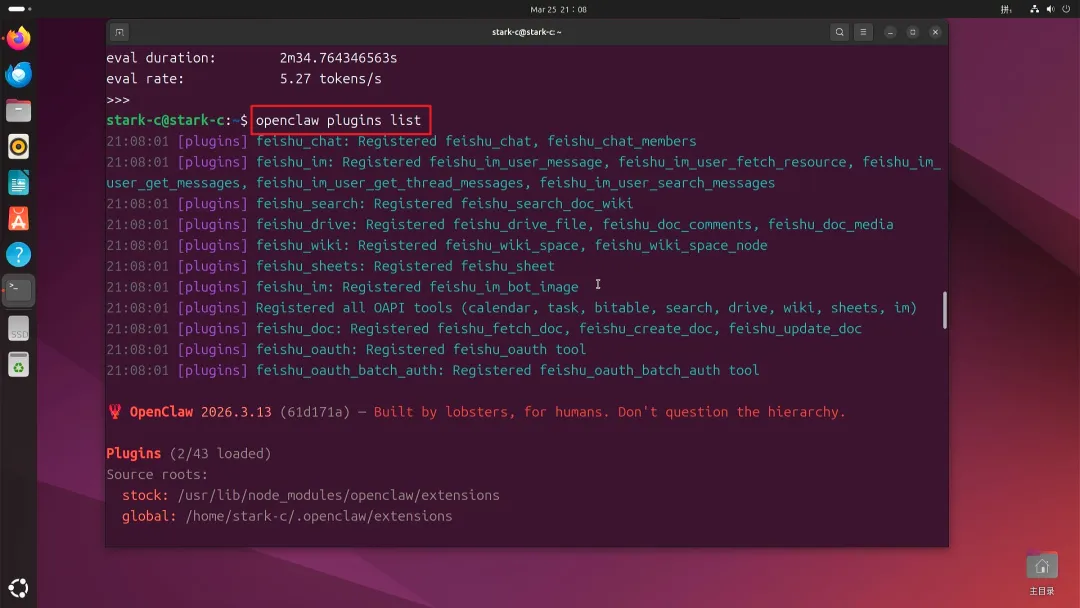

🔺本地大模型搞定之后接下里就该让小龙虾接入进来了。目前最新版的OpenClaw已经内置Ollama插件了,不仅可以直接添加,还支持向导式交互。同样在终端界面,输入本地插件查看指令“openclaw plugins list”。

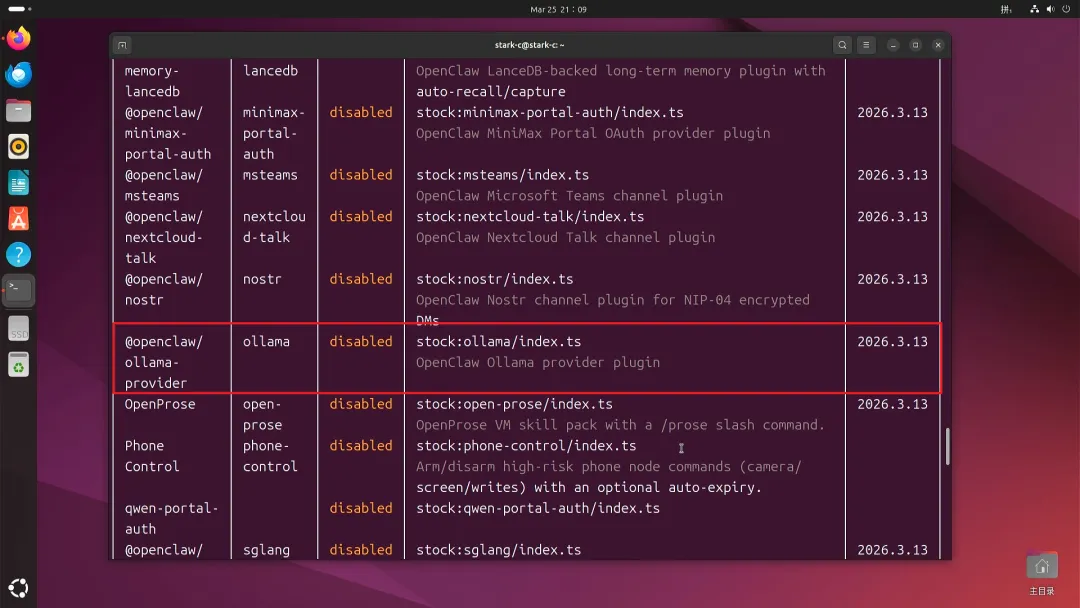

🔺然后在列表中就能看到ollama插件,不过它当前的状态显示的是“disabled(关闭)”,咱们需要手动开启它。

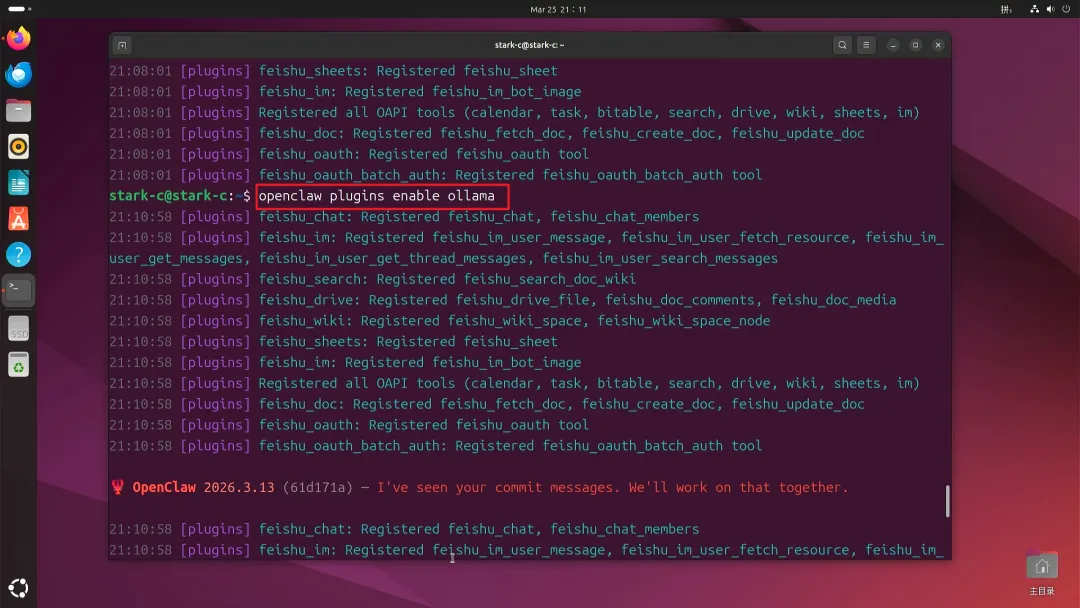

🔺输入ollama插件启用指令“openclaw plugins enable ollama”。

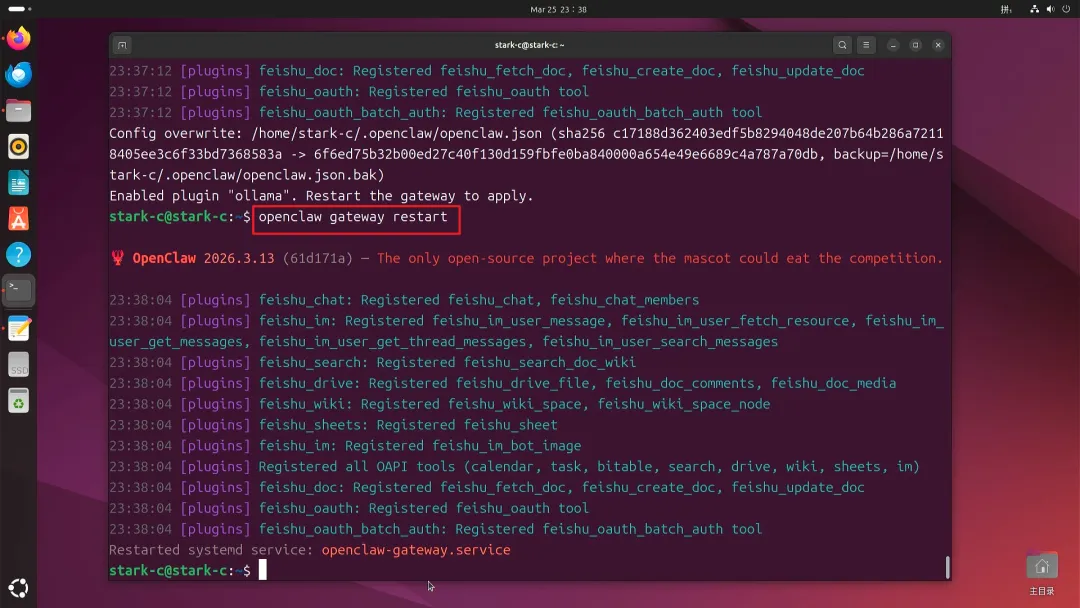

🔺等到系统提示让我们重启网关服务的时候,输入指令“openclaw gateway restart”即可。

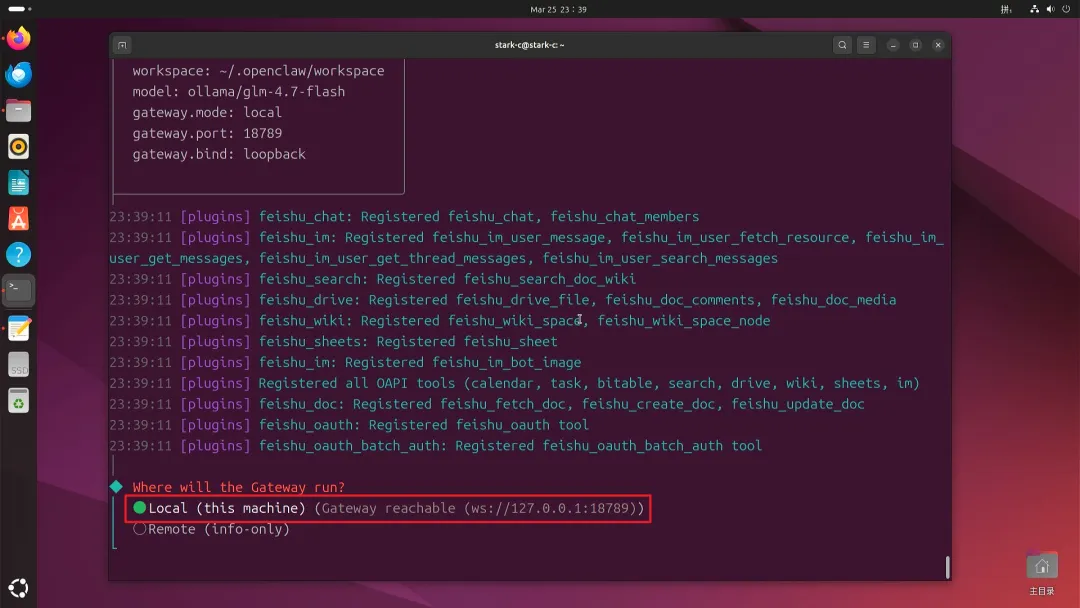

🔺重启网关之后开始运行配置向导,指令为“openclaw configure”。

🔺首先是部署模式,我们个人用户直接选择第一个“Local”。

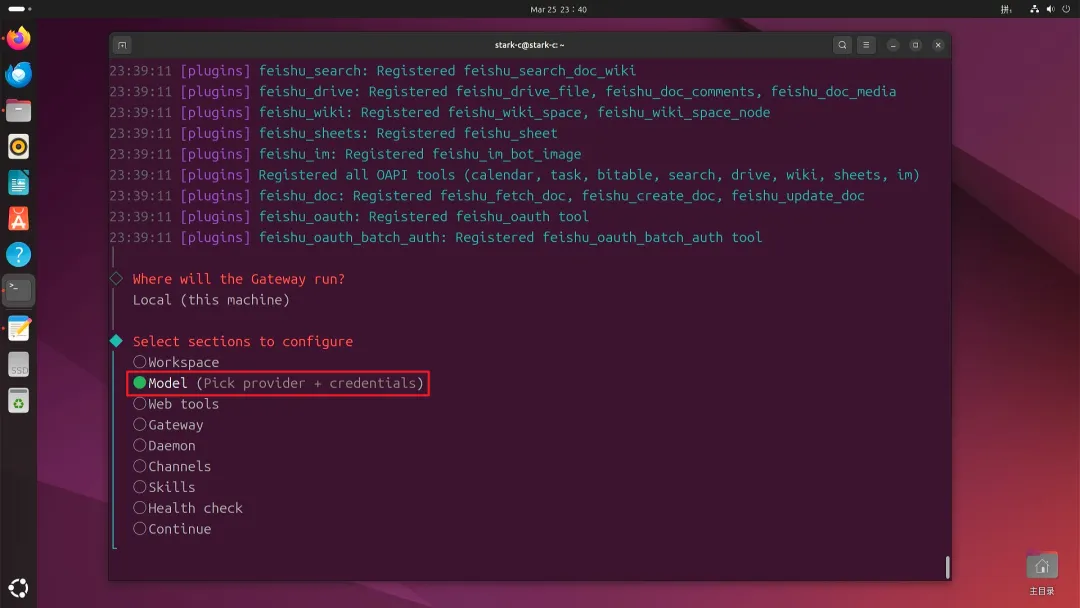

🔺接着在配置项这里选择模型设置”Model“。

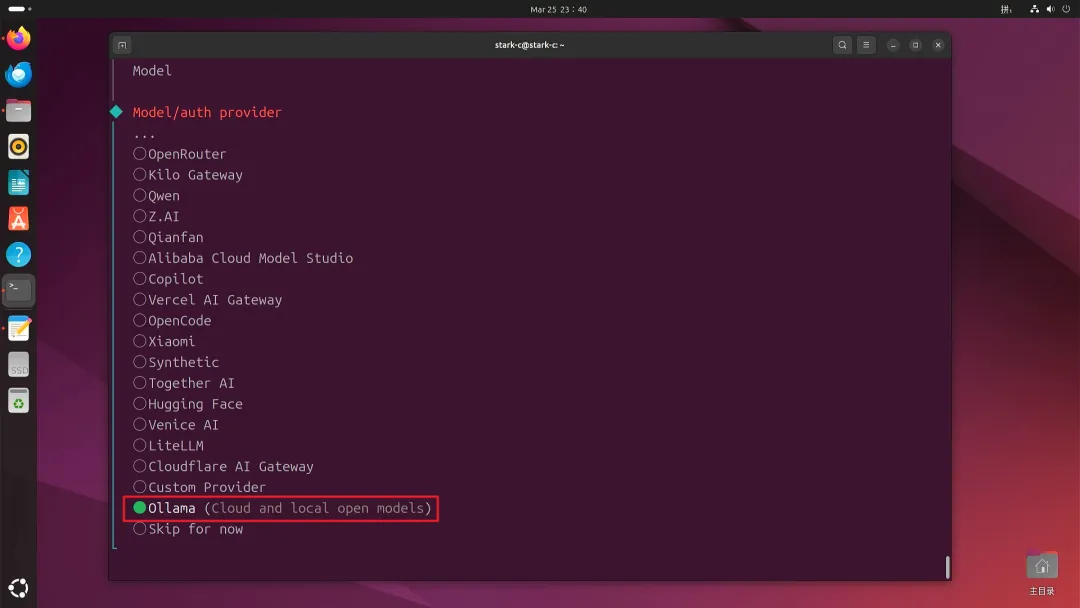

🔺在Model列表的下方位置选择“Ollama”。

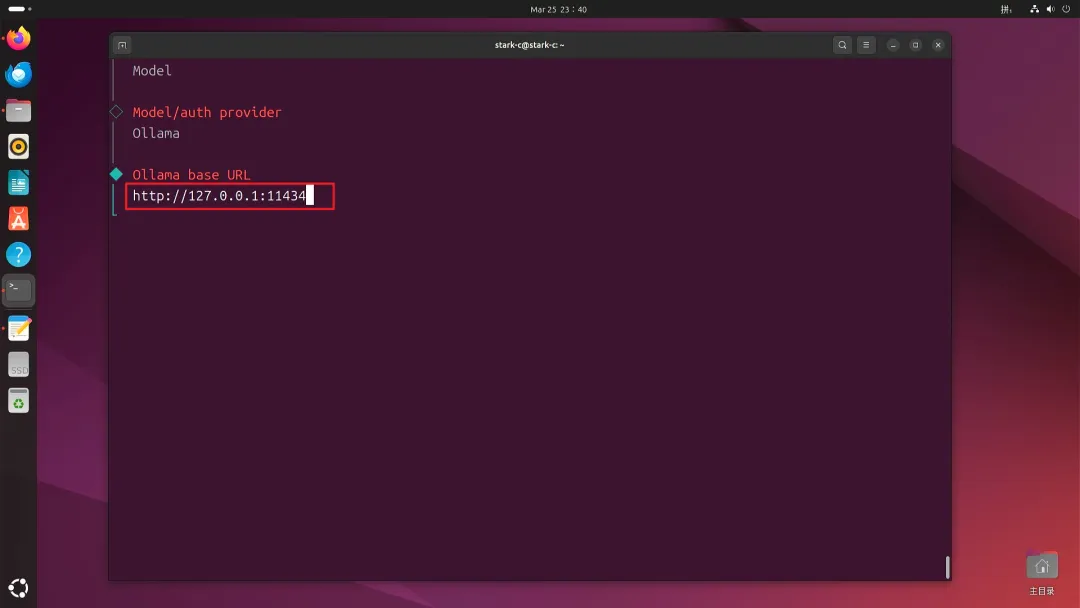

🔺一般来说我们是本机运行,Ollama 地址默认给到的就是“http://127.0.0.1:11434”,这个我们无需改动,直接回车。

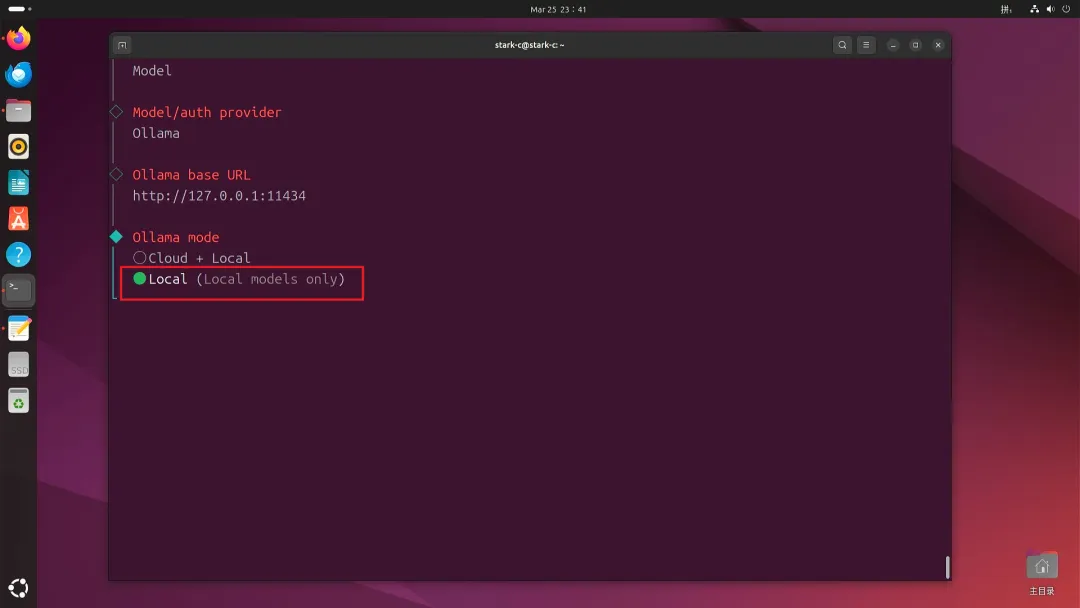

🔺模型的运行方式我们就选择纯本地运行“ Local”即可。

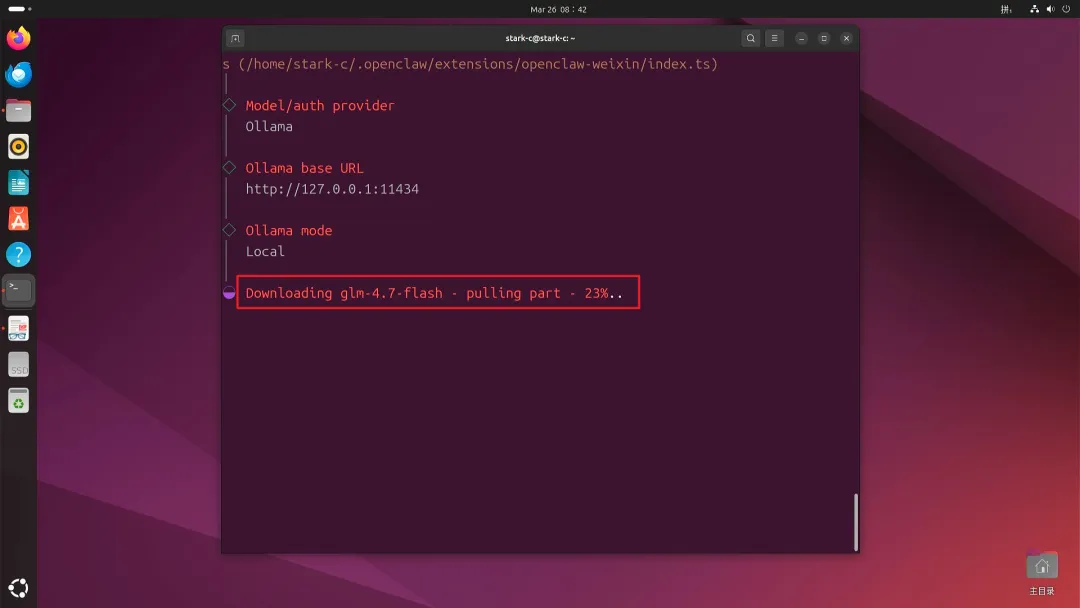

🔺这里应该是一个小bug,它会自动下载glm-4.7-flash模型,我们耐心等它下载完吧。

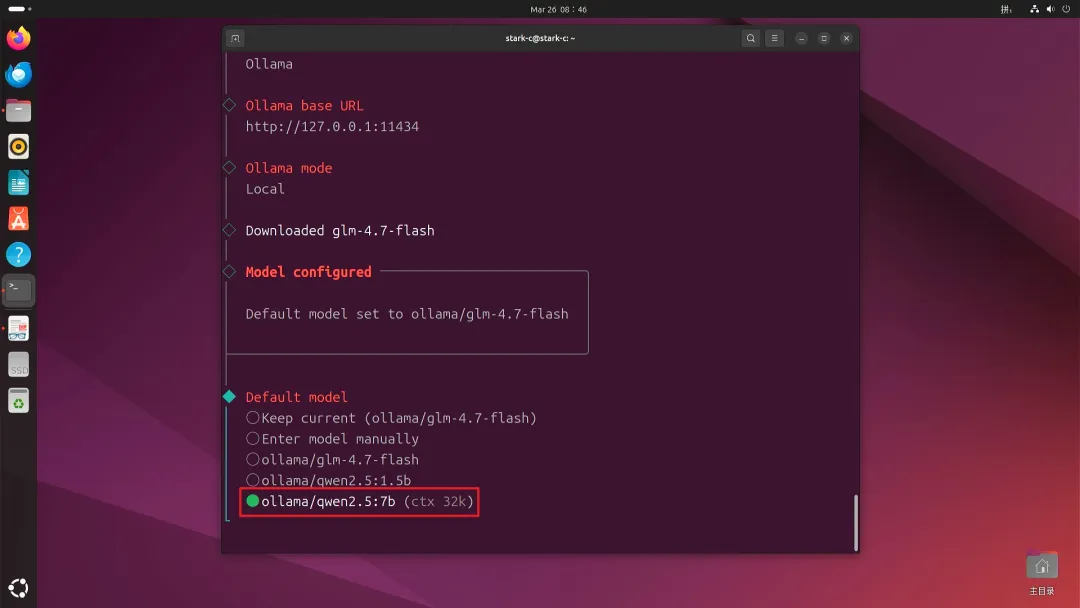

🔺下载完之后就是模型类型的选择了,选择我们部署在本地的“ollama/qwen2.5:7b”模型,使用空格键选中之后,直接回车确认选择。

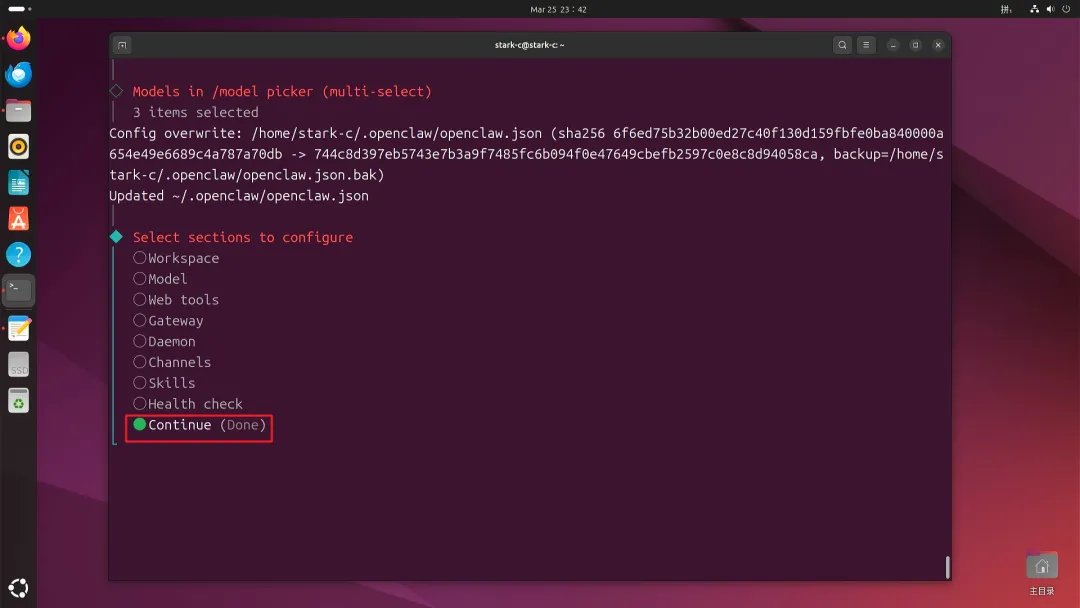

🔺之后再回到主配置页面,选择最后一个Continue(继续)完成模型的配置。

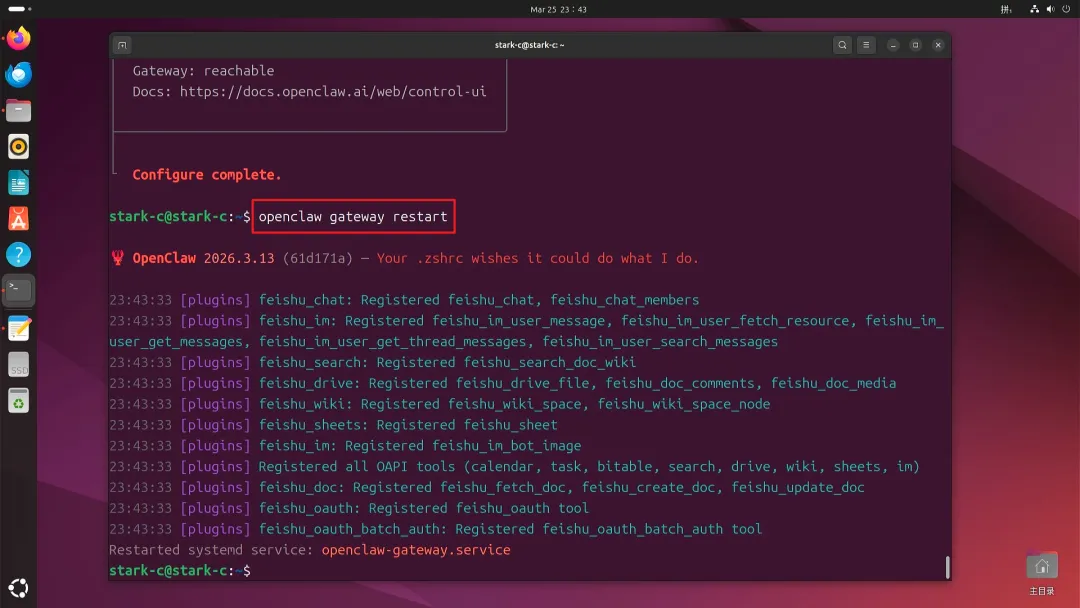

🔺最后记得再次重启网关服务,指令为“openclaw gateway restart”,重启之后小龙虾就能加载我们配置好的本地ollama模型了。

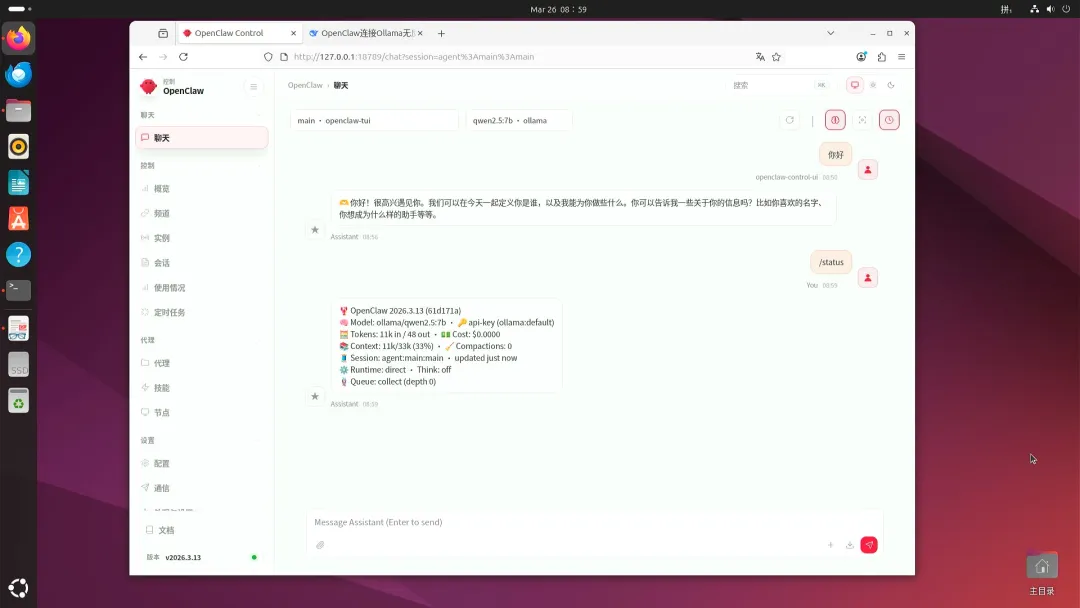

🔺咱们也可以在小龙虾的Web UI界面验证下,不管是和它对话,还是发出相关指令,都是没有问题的。

快速配置

OK,这里开始揭晓前面终端操作普通用户模式卖的关子了,那就是可以直接在文件管理器中执行“快速配置”操作。

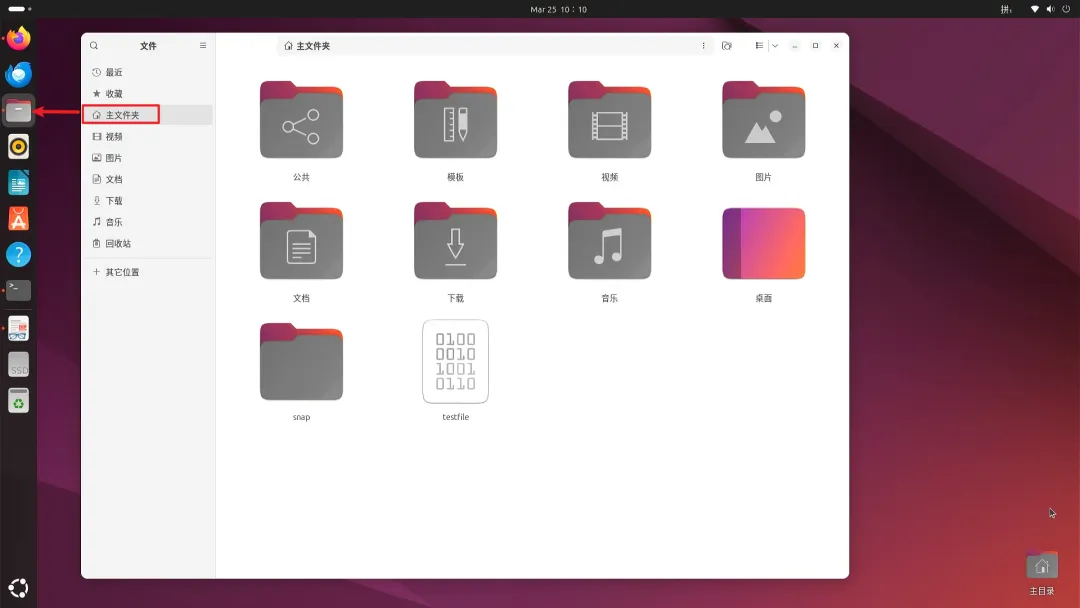

🔺直接打开文件管理器的“主文件夹”,貌似也没有啥呀!

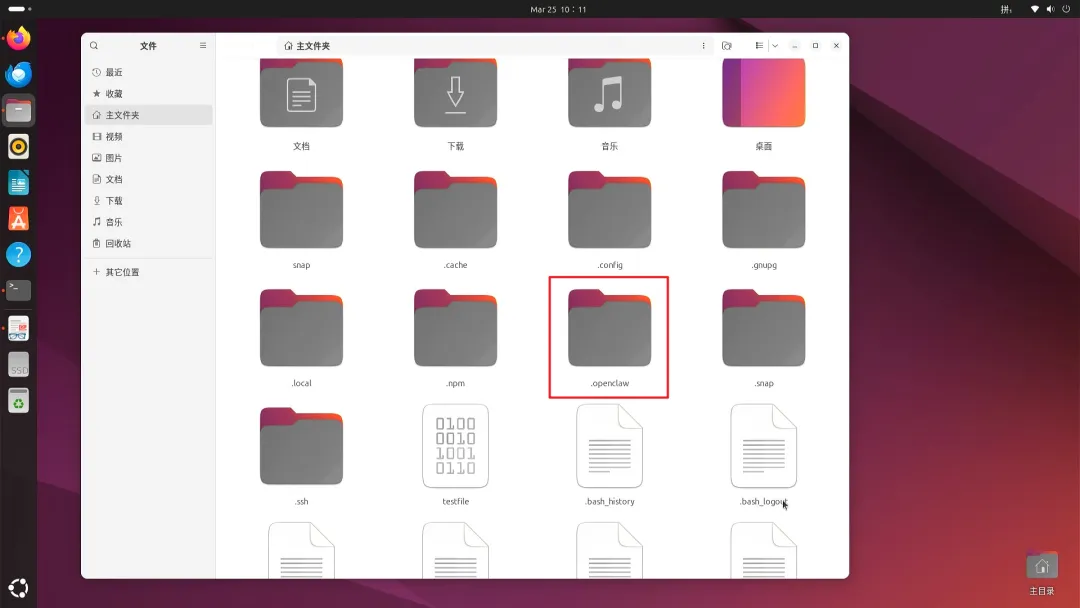

🔺但是当我们在当前页面执行“Ctrl + H”快捷操作之后,这里就能显示所有隐藏文件了,也包括小龙虾的总配置文件夹“.openclaw"。

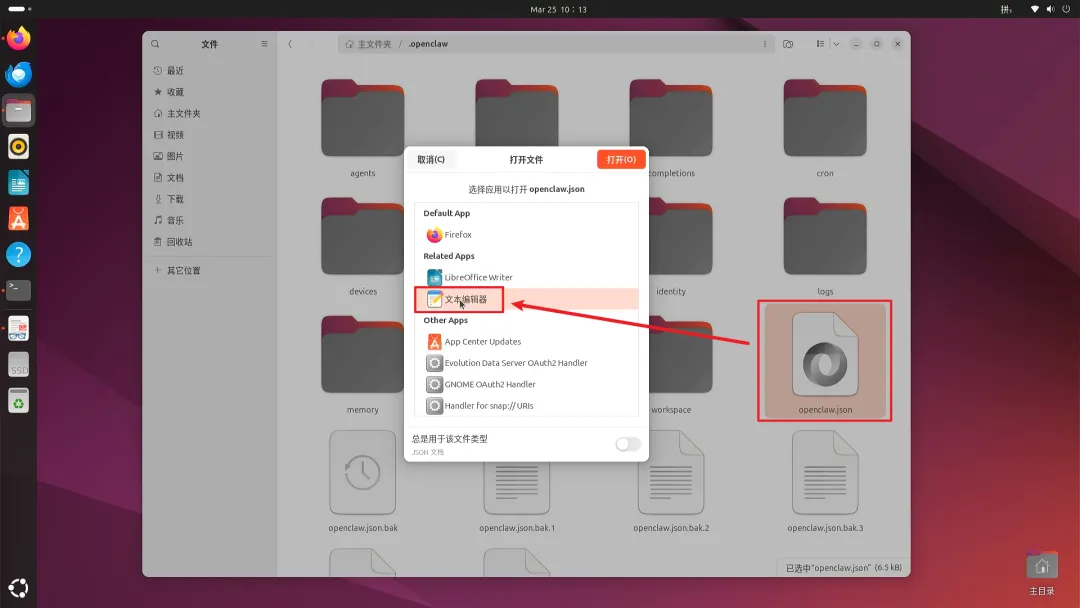

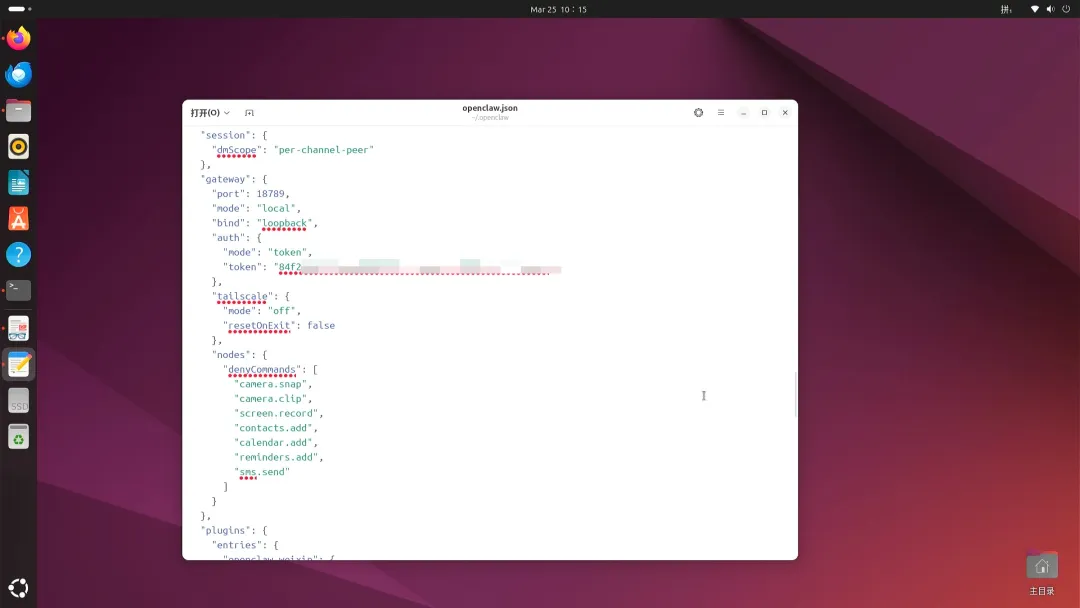

🔺在它的总配置文件夹中不仅有技能文件夹,还有它的工作文件夹,以及它的主配置文件“openclaw.json”,这个文件直接使用系统自带的“文本管理器”打开即可。

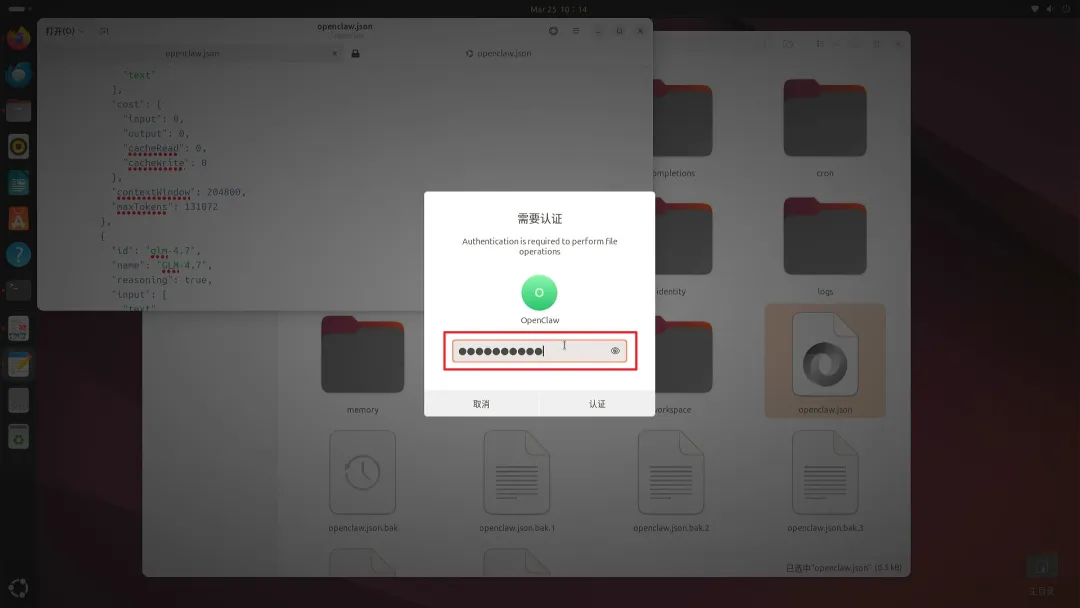

🔺打开的时候需要输入认证,密码还是系统初始化设置的密码。

🔺对于玩OpenClaw有段时间的小伙伴来说,这里应该就不用我多说了吧?在这里配置模型,局域网访问简直不要太方便了!在这里的每一次修改记得保存,然后让小龙虾自己重启一次网关才可以生效啊!

PS:为了不出错,每一次修改记得使用AI工具校对下,免得格式出错让小龙虾“噶”了~

最后

看到这里我相信各位的龙虾应该是跑起来了,后续的很多工作其实都可以让龙虾自己完成,比如添加技能,切换模型等。至于后续龙虾怎么养,就看各位的技术和本事了,毕竟“龙虾领进门,调教看个人”。

最后简单说说本文开头说的“龙虾两吃”方案(本地模型+云端模型)为什么是OpenClaw的完美形态:

本地模型能力有限,但是处理日常问答、知识库总结、管理文件/日历/邮件还是没问题的,而这些又是我们很多用户经常用到的高频任务。我们使用本地模型处理这些任务不仅保证了隐私信息的安全,而且可以无限使用,完全不用担心大模型的tokens问题; 云端模型能力强大,我们就把偶尔需要的复杂逻辑、深度推理、代码生成等高难度场景交给它,让它在最关键的时候发挥“最强大脑”的价值

也就是说,本地模型+云端模型混合方案,不仅避免了高频简单任务的隐私安全和tokens消耗,同时我们也没有在高难度场景里妥协,算是一种既安全稳定,又全能高效的 AI 智能体,所以这就是我个人理解的“OpenClaw 完美形态”。

好了,以上就是今天给大家分享的内容,我是爱分享的Stark-C,如果今天的内容对你有帮助请记得收藏,顺便点点关注,咱们下期再见!谢谢大家~

夜雨聆风

夜雨聆风