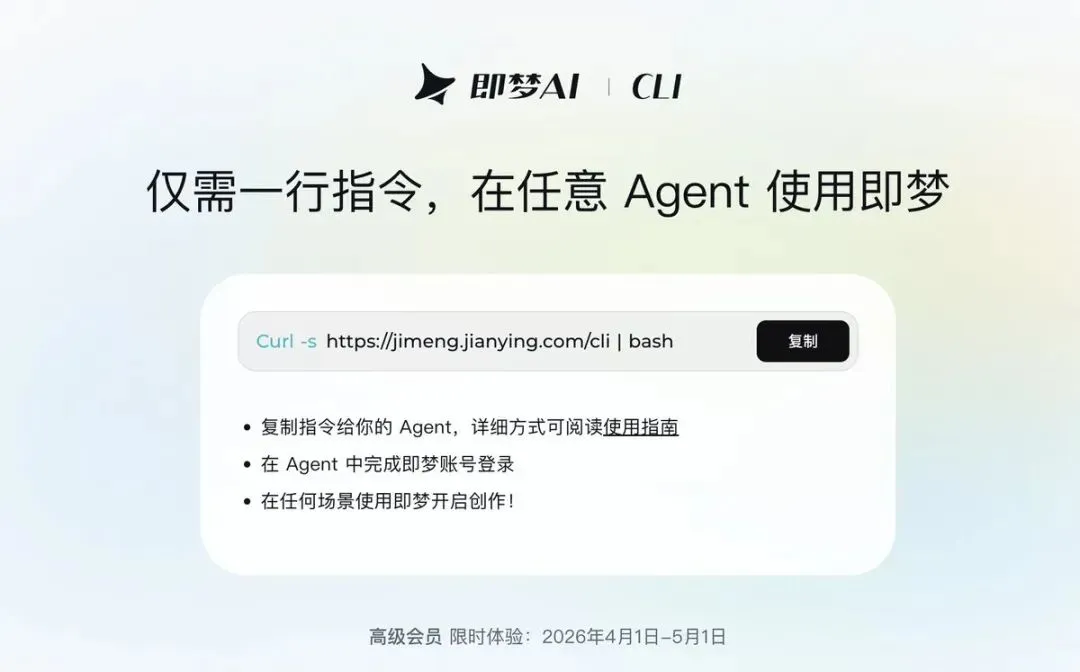

即梦官方把 CLI 全量开通了。你可以把它理解成一件事:字节把"生图生视频"从网页按钮,降维成了"命令"。而命令最适合被谁调用?不是人,是 Agent。

OpenClaw 现在能直接调用即梦的图片和视频生成能力,限时体验。

先说结论:这不是又多一个生图工具,是工作流接口

很多人把生图生视频当"创作灵感工具"。我更看重它的另一面:

- •你可以把即梦当成一个"可编排的模型服务"。

- •你可以把 OpenClaw 当成一个"会写脚本、会跑命令、会组织素材"的执行层。

两者一接上,最值钱的不是画面质量,而是可复用的产线。

即梦 CLI 到底给了什么能力?

根据 AIGCLINK 的整理,即梦 CLI 覆盖的核心能力包括:

- •text2image:文生图

- •image2image:图生图

- •image_upscale:图片超分

- •text2video:文生视频

- •image2video:图生视频

- •frames2video:首尾帧视频

- •multiframe2video:多帧连贯视频故事

- •multimodal2video:多模态旗舰视频生成(支持混合输入),并支持 seedance2.0、seedance2.0fast

同时还有登录、积分、任务列表与结果查询等管理命令。

这套能力的意义在于:你不需要把"生成"当成一次性动作。你可以把它变成一段可追踪的任务队列,有 ID,有结果查询,有可重跑。

最小闭环:装上 CLI,再让 OpenClaw 去调用

即梦安装入口在这里:jimeng.jianying.com/ai-tool/install。

把它接进 OpenClaw,你不需要一上来就搞复杂插件。先做"最小可用闭环":

- 你能在本机用 CLI 跑通一次生图或生视频

- 你能把"输入参数"和"输出文件路径"固定下来

- 你让 OpenClaw 负责三件事:

- •生成提示词与素材清单

- •调用 CLI 执行生成

- •归档结果到固定目录,并写一份

manifest.json

为什么要写 manifest?

因为你后面一定会遇到:

- •这条视频是用哪个模型生成的?

- •这版 prompt 改了什么?

- •哪次生成失败?失败原因是什么?

- •哪个镜头需要重跑?

没有 manifest,产线会退化成"靠记忆"。

一个更像样的工作流:把"生成"变成可迭代的工单

你可以把 OpenClaw 的任务拆成两段:

- •产研段:做方案与镜头脚本(文字可审)

- •生产段:跑生成与迭代(结果可追踪)

这一套跑通之后,你就会发现:

- •生成质量提升,不是因为你更会写 prompt。

- •是因为你终于有了"可重复试错"的结构。

3 个坑,建议你现在就设边界

1. 先把权限和账号隔离

如果 OpenClaw 是常驻 Agent,就不要用主账号做一切。单独的工作目录,单独的输出路径,最好连 token 或登录态都隔离。否则一旦它把生成结果写错目录,你会发现清理比生成更耗时间。

2. 先限定模型与模式,不要"全量开放"

即梦 CLI 支持很多模式,但你第一周只需要一个:

- •文生图 或 首尾帧视频

把它跑稳,再扩。否则你会把时间浪费在"选哪个模式"而不是"把一个模式用出复利"。

3. 把"限时体验"当成窗口期

限时体验这四个字,信息含量很高。它意味着:

- •现在适合做一套能交付的 Demo

- •现在适合把流程固化成模板

等门槛回升,你留下的是生产力,而不是一次性爽感

你可以立刻用它做什么?给你 4 个现实场景

- •自媒体封面工厂:一套固定风格的栏目封面,每天自动出 3 个备选

- •爆款镜头复刻:用 multiframe2video 做"连贯动作",一组素材反复迭代

- •商品展示视频:用 image2video 把主图变成短视频,并自动生成多个镜头节奏

- •知识类内容配图:先用 text2image 出结构图,再用 upscale 做清晰度保底

你会发现这类场景共同点只有一个:它们都不是"灵感",它们是"交付"。

信息来源:

- •AIGCLINK:即梦 CLI 全量开通,OpenClaw 可直接调用(含能力清单)

- •即梦安装入口

夜雨聆风

夜雨聆风