非常荣幸受大卡老师邀请,为“养虾社”撰写这篇文章。前面Partner分享的都是实操经验,这期我想换一个角度,聊聊我在使用“小龙虾”之后,对自动化的一些思考。

🖊 初次感受到自动化带来的便利

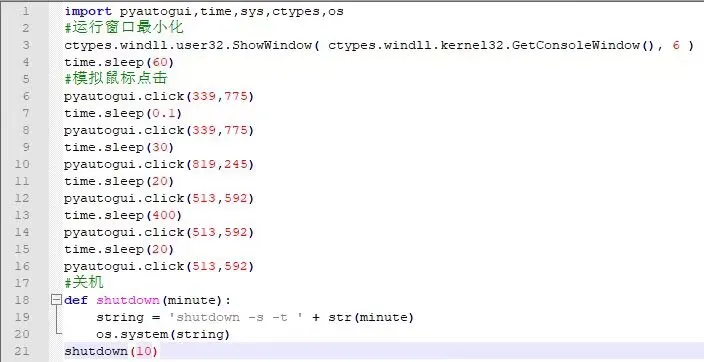

我第一次接触自动化,是在高一。那时我入坑了一款游戏《碧蓝航线》。想要拿到心仪的舰船,需要签到满一定天数。而住校的我没法每天签到,于是我用Python写了一个简易脚本,调用PyAutoGUI库,在BIOS里设置了每天定时开机,脚本执行完后自动关机。就这样,我在不带手机上学的情况下,稳稳地保持了签到,最终拿到了目标舰船。那是自动化第一次给我带来实实在在的便利。

高一时编写的《碧蓝航线》自动签到脚本

后来,我了解到了一个开源项目——AzurLaneAutoScript(ALAS)。它不仅能帮我签到,还能自动完成每日任务。它的核心逻辑很简单:预设规则+图像识别。检测到某个界面,就执行对应的点击操作;遇到异常(比如卡在“大世界”出不来了),就暂停等待人工介入。整个系统是确定性的——你给它什么样的输入,它就会给出什么样的输出,没有任何意外。

ALAS程序运行界面

这种确定性带来了一种安全感:你可以放心地把任务交给它,它不会自作主张,不会越界,不会在你不注意的时候搞出什么幺蛾子。即便出问题,原因也是可追溯、可复现的。

🦞 探索爆火“龙虾”,引起思考

再到最近,OpenClaw突然火了起来,大家给它贴上“数字员工”“效率神器”之类的标签。它能自动读取邮件并处理,有 HEARTBEAT 机制来执行定时任务,听起来确实很美好。我再一次怀着好奇,开始了对它的探索。

openclaw.ai官网

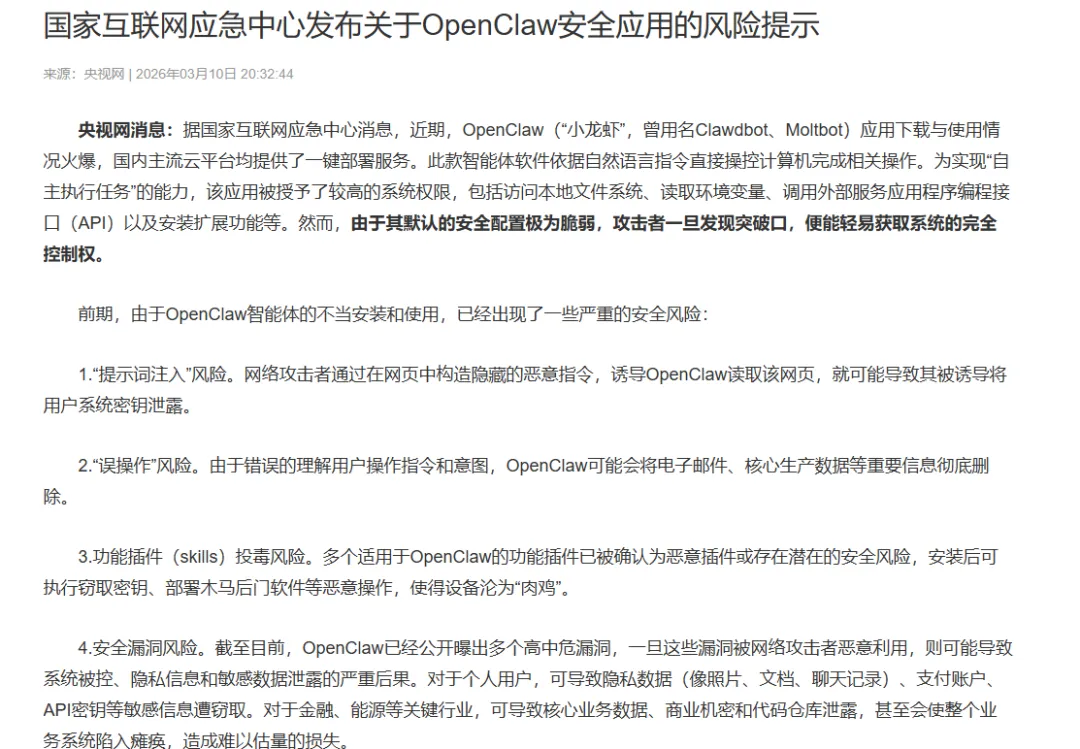

但当我真正用起来,现实却给我浇了一盆凉水。并不是说它不够强。它确实很强,集成了一大堆Skills,甚至能做普通用户不擅长或者根本就做不了的事。但问题恰恰在于:你不知道它什么时候会出错,也不知道它会出什么错。根据国家互联网应急中心今年3月发布的风险提示,OpenClaw已经出现了多起严重的安全事故:

有用户遭遇了“误操作”——OpenClaw错误理解了用户的指令意图,直接把电子邮件、核心生产数据等重要信息删除了,而且无法停止。还有“提示词注入”攻击——攻击者在网页里构造了隐藏的恶意指令,诱导OpenClaw读取后,系统密钥就被泄露了。

央视网 关于OpenClaw安全应用的风险提示

这些案例让我开始重新审视OpenClaw的设计逻辑。

软件工程里有个朴素却重要的原则:核心执行链路应该尽量建立在确定性系统上。

🔧 “龙虾”作为自动化工具的缺陷

什么是确定性系统?就像那个签到脚本,每一步都是明确、可预测的:开机→运行脚本→点击指定坐标→关机。不会多一步,也不会少一步。ALAS也是同理,它的每一步操作都是预设好的,虽然逻辑更复杂,但执行路径是确定的。

而目前的大模型,本质上是一个不确定性系统。你输入同样的指令,它每次给出的回答可能都不太一样。这种“不确定性”在聊天场景下是特色,但在“控制”场景下,就是隐患。OpenClaw目前的一个风险在于,它不是把大模型放在建议层,而是放在控制层甚至决策层。于是就会出现这样的情况:它可能误判当前任务状态,可能调错工具,可能因为上下文污染而执行错误的指令。

📚 要清醒认识自动化工具的边界

当然了,我写这篇文章,并不是想全盘否定OpenClaw。恰恰相反,正是因为OpenClaw足够优秀、被足够多人关注、被寄予厚望,这种“期待”与“现实”之间的落差才值得我们思考。当我们在拥抱大模型带来的“智能自动化”时,也要清醒地认识到它的边界。那些建立在确定性系统上的“朴素自动化”所带来的安全感,在如今这个被大模型包围的时代,反而显得弥足珍贵。

相关阅读:

夜雨聆风

夜雨聆风