今天就更第一篇硬核干货:Ollama安装全流程,真正的零基础保姆级教程,不用懂代码、不用独显、不用复杂设置,跟着一步一步做就能搞定,普通笔记本(哪怕是轻薄本)都能轻松上手,跟着步骤走,一次成功不踩坑。

先搞懂:Ollama到底是什么?(新手必看)

在开始安装前,先给小白们通俗解释下,避免懵圈:

Ollama就是本地AI的“启动器+管理器”,是搭建本地AI最核心的工具。

它的作用很简单:一键下载开源免费的AI模型,自动帮你配置好运行环境,让模型在你自己的电脑上运行,不用上传数据到云端,全程免费、离线可用。

适配你的电脑配置:

像我用的2024款ThinkPad X1(Ultra7+32G),跑起来毫无压力;就算是16G内存的普通轻薄本,也能完美运行,完全不用怕配置不够。

安装前准备

电脑系统:支持Windows 10/11、macOS、Linux(本文以最常用的Windows为例,Mac步骤几乎一致)

硬件要求:内存≥8G即可(推荐16G以上,32G流畅拉满),剩余硬盘空间≥10G

无需准备:不用独显、不用Python环境、不用技术基础,纯傻瓜操作

第一步:下载Ollama安装包

直接打开Ollama官网:https://ollama.com/

首页点击显眼的 Download 按钮,系统会自动识别你的电脑版本,下载对应安装包(Windows下载.exe文件,Mac下载.dmg文件)

下载速度很快,安装包体积约1.9G,网速快的话几分钟就能下完

避坑提醒:一定要去官网下载,别找第三方链接,避免捆绑垃圾软件!

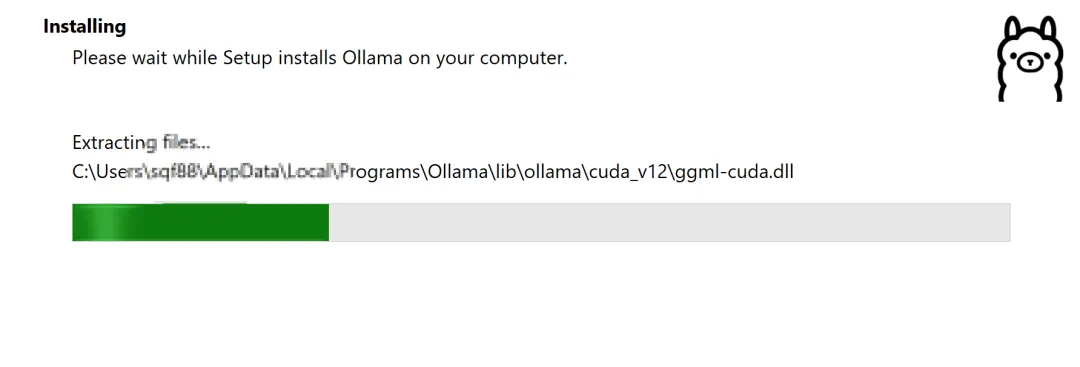

第二步:安装Ollama(一路下一步,无复杂设置)

找到下载好的安装包,双击打开安装程序

全程默认设置即可,不用修改安装路径,不用勾选额外选项,一路点击“下一步/Next”,最后点击“安装/Install”

等待1-5分钟,安装完成后,不需要重启电脑

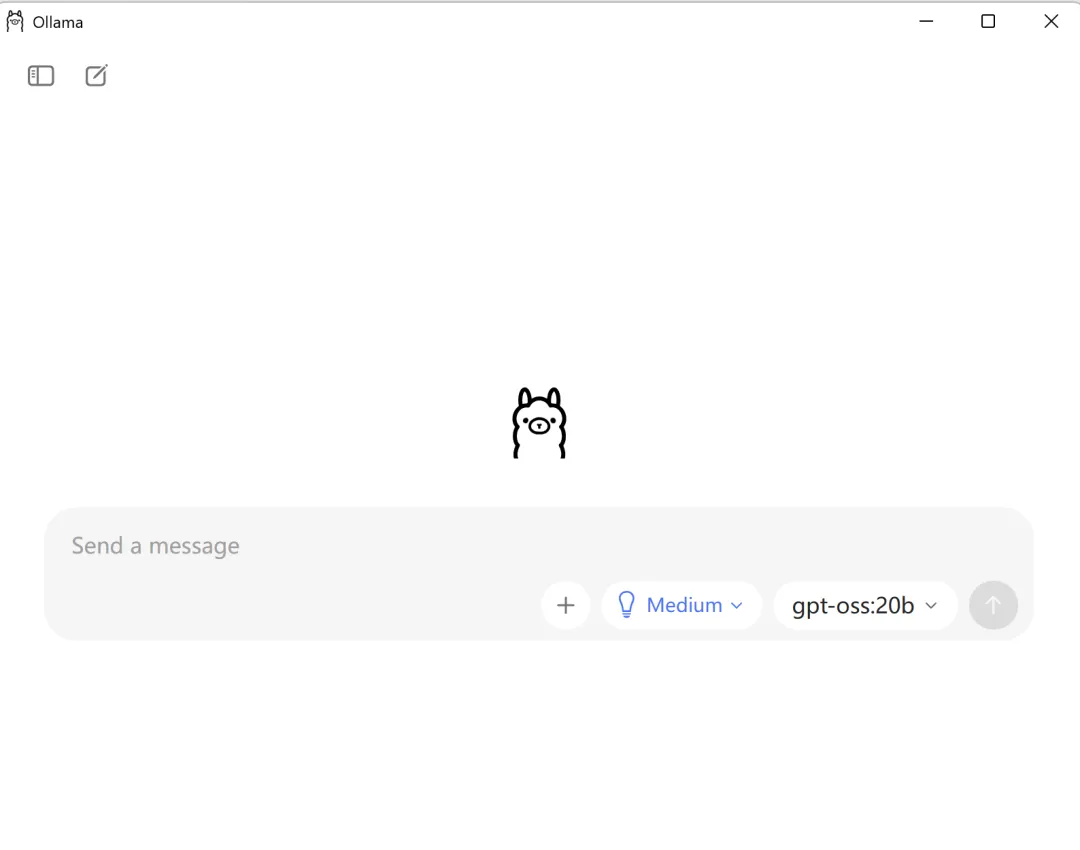

Ollama现在最新的版本很人性化,有图形化界面,安装成功后如下图,会展示一个图形化的客户端界面:

过去,Ollama 确实主要依赖命令行操作,需要用户输入指令来下载和运行模型,这对不熟悉技术的用户来说有一定门槛。但从 2025 年中后期开始,Ollama 正式发布了适用于 Windows 和 macOS 的官方桌面应用,带来了完整的图形用户界面(GUI),让操作变得像使用普通软件一样直观。

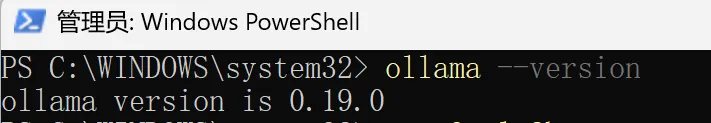

附:命令行验证安装是否成功

按下

Win+R键,输入cmd,打开命令提示符(CMD);或者直接搜索“PowerShell”打开在弹出的黑色窗口里,输入命令:

ollama --version

如果出现版本号(比如ollama version 0.19.0),就说明安装成功啦!

如果提示不是内部命令,关闭窗口重新打开再试一遍,基本不会出错。

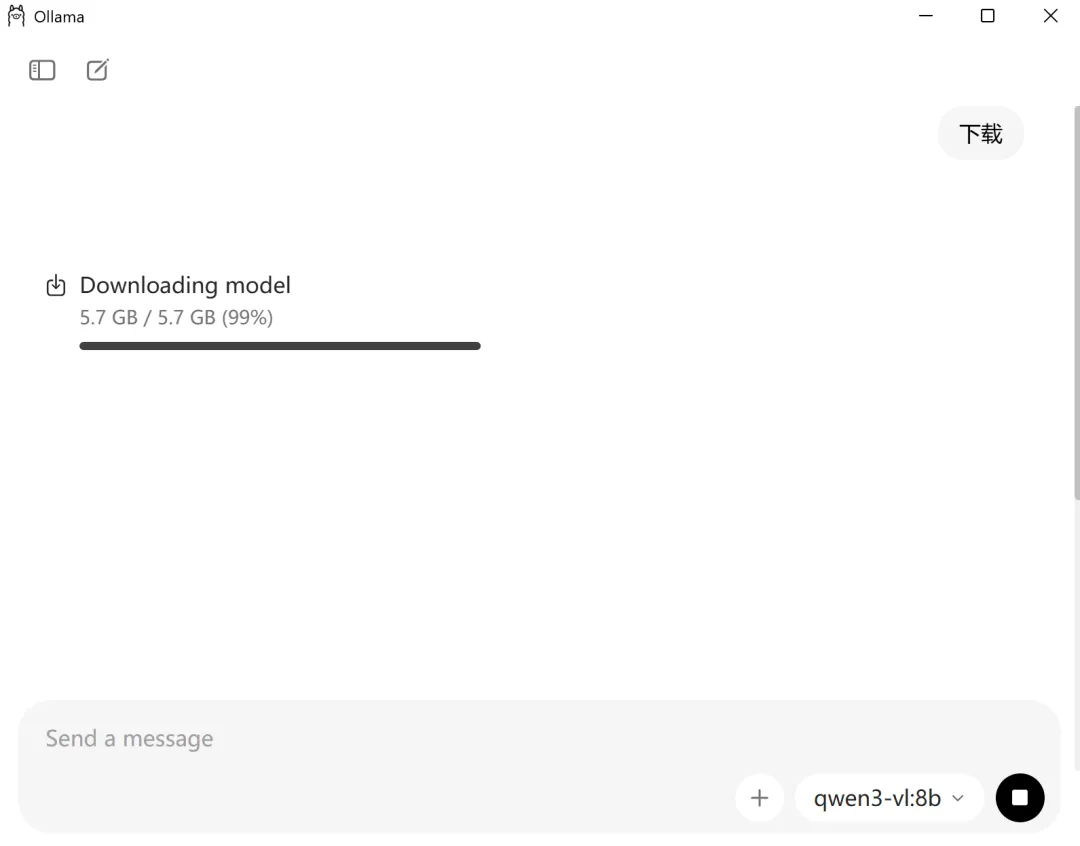

第四步:下载第一个免费AI模型(核心步骤)

Ollama安装好只是工具,我们需要下载AI模型才能使用,

小科普:*b代表模型参数大小,数值越大,模型体积越大,适用场景就越复杂,越全面。

针对我这台Ultra7+32G LPDDR5X 轻薄本,适合的模型按场景分好类, 全能首选:Qwen3 系列(阿里开源,国产之光)

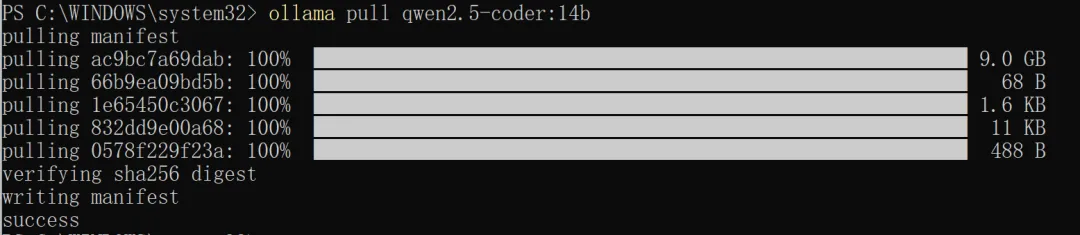

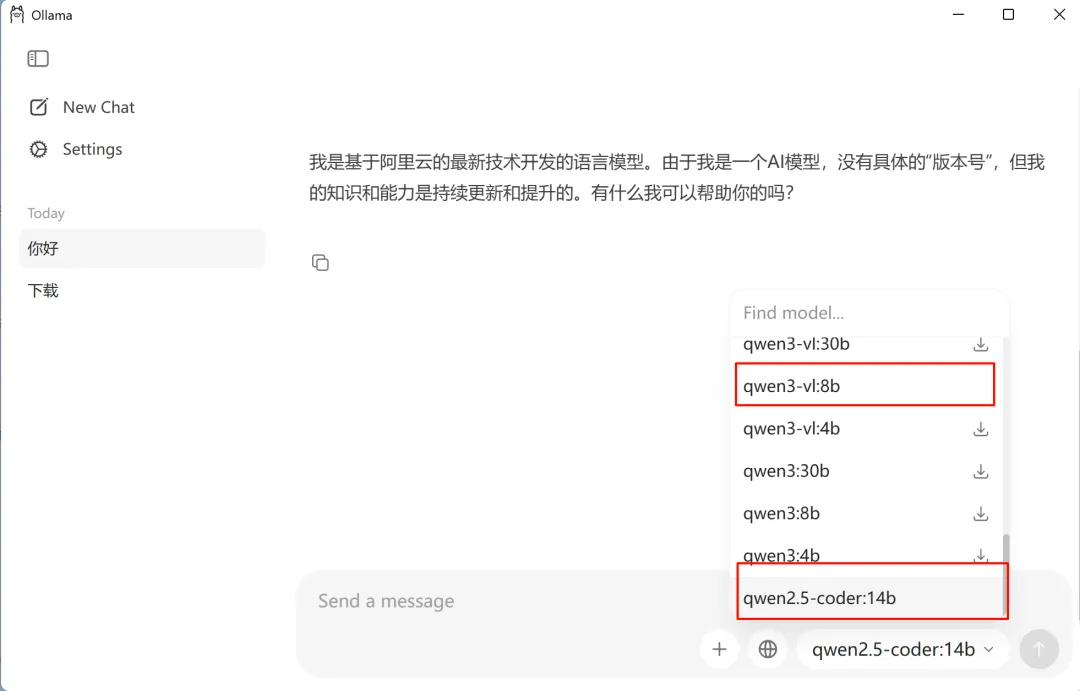

我下载了两个模型版本:qwen3-vl:8b(客户端界面下拉选项-可选择) 和 qwen2.5-coder:14b(没有在客户端界面下拉选项内,通过命令pull)

如果下拉模型中没有你想要的可以通过命令行的方式下载对应的模型版本

如下载qwen2.5-coder:14b,输入命令:ollama pull qwen2.5-coder:14b

下载并安装完成后,在ollama的客户端界面下拉框可以看到:

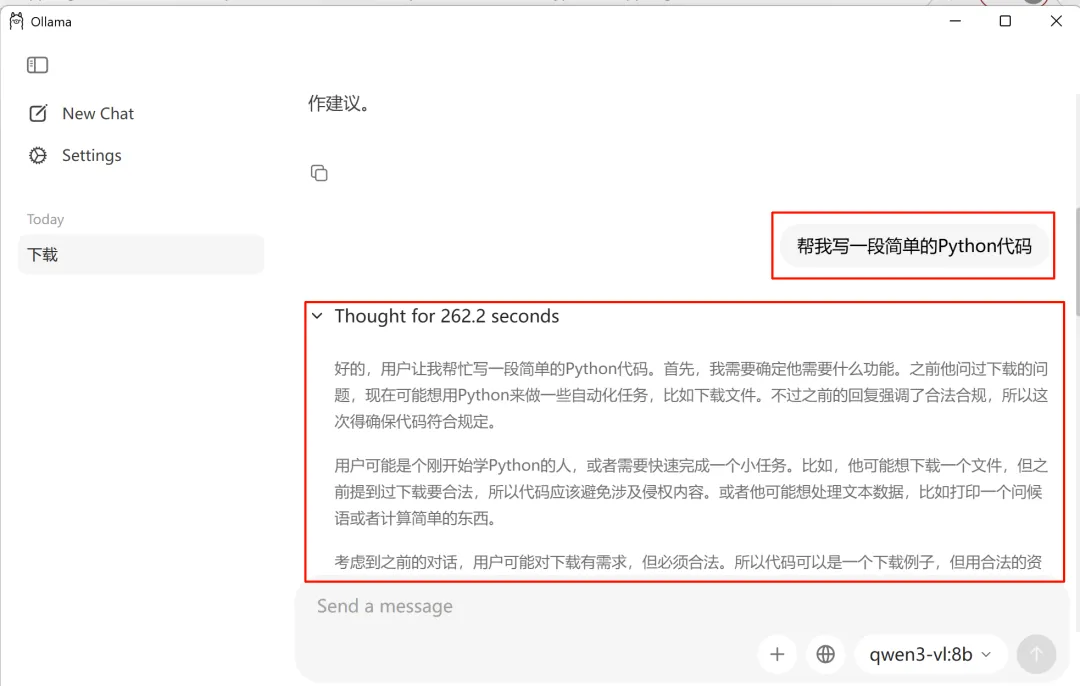

测试运行本地AI:接下来,就可以使用qwen3-vl:8b这个大模型,在对话框进行对话了。

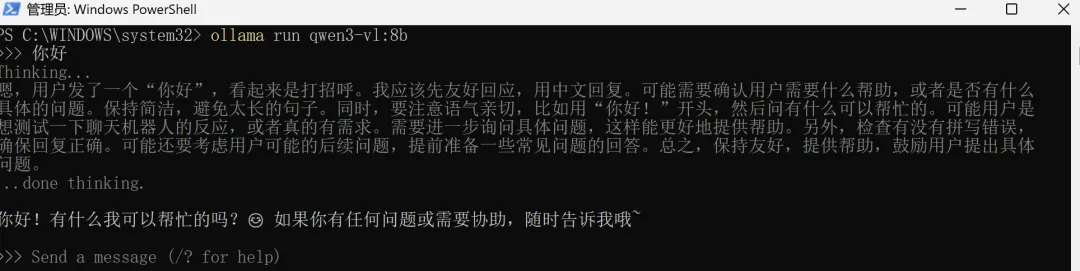

附:命令行方式测试安装的大模型能不能用

在CMD/PowerShell里输入命令:

ollama run qwen3-vl:8b

按下回车,等待1-2秒,窗口出现

>>>符号,就说明本地AI已经启动成功

直接输入你的问题,比如“帮我写一段简单的Python代码”“总结一段文字的核心内容”,AI就会本地生成回答,全程不联网、不花钱

本节最后讲一下Ollama 的设置项:

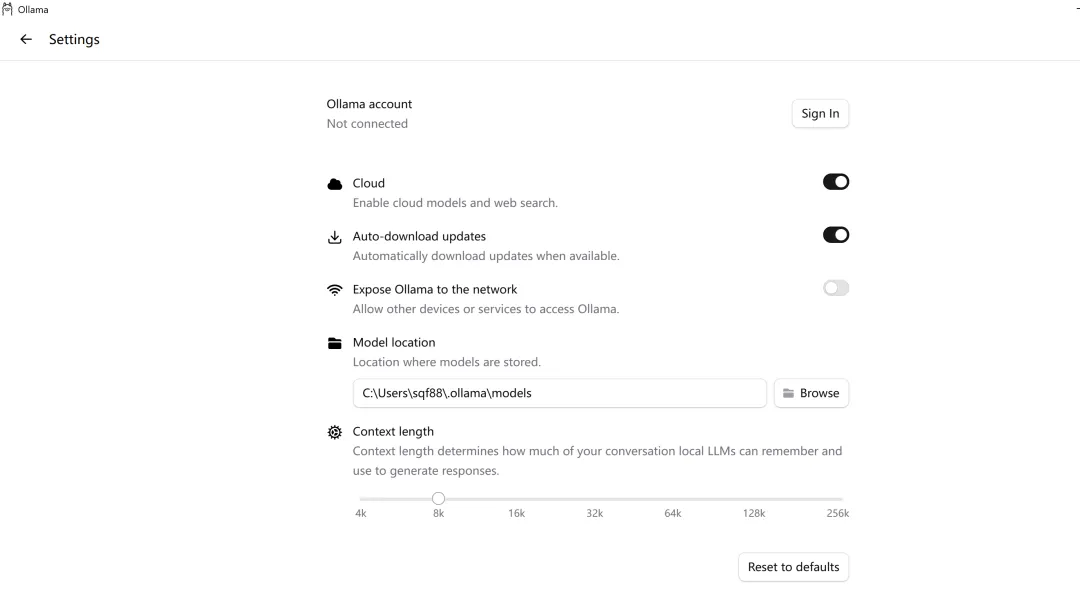

这张图片展示的是 Ollama 官方桌面客户端的“设置”(Settings)界面。

这个界面主要用于管理 Ollama 的运行环境、账号状态以及模型存储位置。以下是界面中各项内容的详细解读:

1. Ollama 账号

- 状态

:当前显示“Not connected”(未连接)。 - 功能

:右侧有一个“Sign In”(登录)按钮。这表明 Ollama 客户端现在支持账号系统,登录后可能用于同步设置、云端模型管理或访问某些高级功能。

2. 云功能

- 开关状态

:开启。 - 功能

:“Enable cloud models and web search”(启用云端模型和网络搜索)。 - 解读

:这意味着除了运行你本地下载的模型外,Ollama 还可以调用云端的资源。比如,当本地模型能力不足时,或者你需要联网搜索最新信息时,这个功能会提供支持。

3. 自动下载更新

- 开关状态

:开启。 - 功能

:“Automatically download updates when available”(有更新时自动下载)。 - 解读

:开启后,当 Ollama 软件本身或你下载的模型有新版本时,它会在后台自动更新,无需你手动操作。

4. 网络暴露

- 开关状态

:关闭。 - 功能

:“Expose Ollama to the network”(将 Ollama 暴露到网络中)。 - 解读

:这是一个重要的安全设置。 - 关闭(当前状态)

:只有你这台电脑能访问 Ollama。 - 开启

:局域网内的其他设备(比如你的另一台电脑、手机,或者运行在 Docker 里的应用)也可以通过 IP 地址访问并使用这台电脑上的 Ollama 服务。如果你只是自己用,保持关闭更安全。

5. 模型存储位置

- 路径

: C:\Users\sqf88\.ollama\models。 - 功能

:显示模型文件在硬盘上的具体存储位置,并提供“Browse”(浏览)按钮来更改。 - 解读

:大语言模型通常非常大(几个 GB 到几十个 GB)。如果你的 C 盘空间不足,强烈建议点击“Browse”把它改到 D 盘或 E 盘等其他空间较大的分区。

6. 上下文长度

- 滑块设置

:当前设定在 8k 左右。 - 功能

:“Context length determines how much of your conversation local LLMs can remember...”(上下文长度决定了本地大模型能记住多少对话内容)。 - 解读

: - 数值越大

:模型能“记住”的东西越多,适合处理长文档或长对话,但会占用更多的内存(RAM)和显存(VRAM),运行速度可能变慢。 - 数值越小

:节省资源,运行快,但模型容易“健忘”,忘了前面聊过什么。 - 数值含义

:这里的“k”代表 token 数量(大致可以理解为单词或汉字的数量)。8k 意味着模型大约能记住最近几千字的对话历史。 - 调节建议

:

总结

这是一个非常典型的现代软件设置页,Ollama 正在变得越来越易用。如果你只是普通用户,**“模型存储位置”**是最值得关注的,确保你的硬盘空间足够存放即将下载的模型。

==新手常见问题&解决办法==

下载模型速度慢:正常现象,耐心等待即可,也可以保持后台下载,不影响电脑使用

运行提示内存不足:换成更小的模型,如果你编程使用,可以输入

ollama pull qwen2.5-coder:4b即可命令输入没反应:检查命令是否输错,字母、符号都要全英文,别多打空格

写在最后

就这5步,你的电脑就拥有了一个免费、离线、私密的本地AI,不用充会员、不用担心数据泄露,不管是办公、写代码、做内容,还是理财分析,都能随便用。

这只是本地AI的第一步,下篇教程我会教大家安装Claude Code,对接Ollama本地模型,实现更专业的编程、办公效率提升,打造完整的本地AI工作站。

动手实操起来,有任何安装问题,评论区留言,我一一解答!

关注我,下期教你对接Claude Code,让本地AI更好用~

夜雨聆风

夜雨聆风