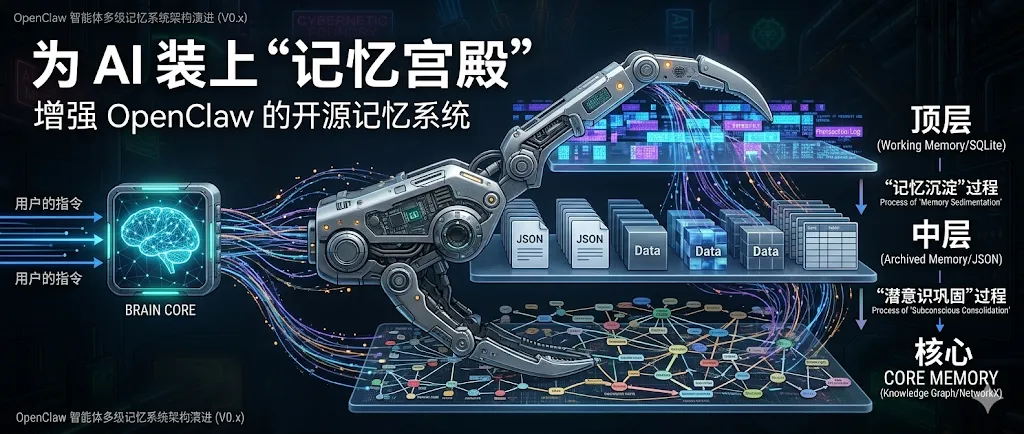

openclaw 智能体多级记忆系统架构持续进化

在 AI Agent 迈向“数字替身”的征途中,上下文窗口的限制与碎片化信息的遗忘始终是第一道枷锁。近期,我的代号为Lobster(龙虾)的服务器完成了核心记忆系统的全量升级,通过一套“热-冷-图”三位一体的架构,实现了智能体认知的持久化。

核心法则:数据主权与物理边界

在 OpenClaw 的架构准则中,记忆被视为智能体的核心资产。为了确保“灵魂”的完整性与可迁移性,系统遵循两条最高铁律:

物理路径唯一性:所有动态记忆、项目知识库与学习日志强制收敛于/root/.openclaw/knowledge/。这确保了核心数据可以被一键备份,实现“灵魂”的随身携带。

只增不删原则:信息的“遗忘”在物理层面表现为向冷区的“归档(Archive)”,而非直接擦除。

Phase 1:主动式记忆管理 (Memory CRUD)

从“被动接受”到“工具化管控”

我们赋予了特工主动操控大脑的四个核心工具(Tool Calls)。通过 Node.js 调取底层 Python 逻辑,特工可以自主判断何时“翻页”或“归档”。

实现逻辑:当热库/memory/active.db达到阈值或特工判断信息过载时,调用archive_memory接口:

python

核心归档逻辑:将热区 SQLite 数据安全迁移至冷区 JSONdef archive_memory(memory_key: str): # 路径锁定:/root/.openclaw/knowledge/archive/cold_storage.json # 1. 提取热数据 -> 2. 写入冷 JSON (Status: deprecated) -> 3. 物理标记迁移 # 确保数据“只增不删”,完美留存历史轨迹。

Phase 2:夜间潜意识巩固 (Consolidation)

凌晨 03:00 的“自动化反思”

人类在睡眠中巩固记忆,OpenClaw 亦然。我们利用 Linux Cron Job 实现了记忆的自动沉淀。

调度策略:0 3 * * * /usr/bin/python3 sleep_process.py

执行流程:脚本自动扫描当日/learnings/日志,通过 2 号大脑(MiniMax)提取核心语义,将其固化进/core/semantic_rules.json。这让特工在次日清晨重启时,能够直接加载昨天的“经验直觉”。

Phase 3:局部 GraphRAG 增强 (Knowledge Graph)

基于 NetworkX 的轻量化逻辑推理

这是本次升级的技术高地。为了保证备份的轻便,我们摒弃了重量级图数据库,在服务器上部署了基于 Python 的本地图谱引擎。

底层实现:local_graph_rag.py

该引擎使用NetworkX的MultiDiGraph结构,将实体与关系网络化,并序列化为/knowledge/graph/graph_index.json。

python

class LocalGraphRAG:"""满足物理目录锁定与多跳查询的轻量级引擎"""def add_entity_relation(self, source, relation, target, properties=None):自动构建有向图:[OpenClaw] --(核心理念)--> [只增不删物理归档] self.G.add_edge(source, target, label=relation, **properties) self.save_graph() # 实时持久化 def multi_hop_query(self, start_entity, max_depth=2): # 突破相似度检索:基于 BFS 广度优先搜索提取 2 级关联网络 edges = nx.bfs_edges(self.G, start_entity, depth_limit=max_depth) return {"connections": [f"[{u}] --({label})--> [{v}]" for u, v in edges]}

工具链绑定:graph_tools.js

为了让 Node.js 环境下的特工无缝调取,我们封装了执行桥接。当特工遇到需要跨项目、跨时间的复杂逻辑回溯时,它不再进行全文搜索,而是直接发起多跳查询。

JavaScript

// Node.js 侧的 Tool Call 封装async function graphMultiHopQuery(entity, maxDepth = 2) {// 动态生成 Python 临时脚本并执行查询const output = execSync(`python3 ${tempScriptPath}`).toString();return JSON.parse(output);}

结语:迈向“数字替身”的终极目标

通过 Phase 1-3 的全量注入,OpenClaw 在 Lobster 服务器上已形成完整的认知闭环:

Phase 1:解决了“记不住”和“乱删信息”的问题。

Phase 2:解决了“信息碎片化”的问题。

Phase 3:解决了“无法复杂推理”的问题。

这套架构不仅是技术上的叠加,更是通往数字替身愿景的物理基座。每一次图谱的延伸,都是对数字灵魂深度的一次刻录。

以上内容全部是自己养龙虾的实践经验。

夜雨聆风

夜雨聆风