文中情节人物皆为杜撰,若有与现实相似之处,盖为偶然。

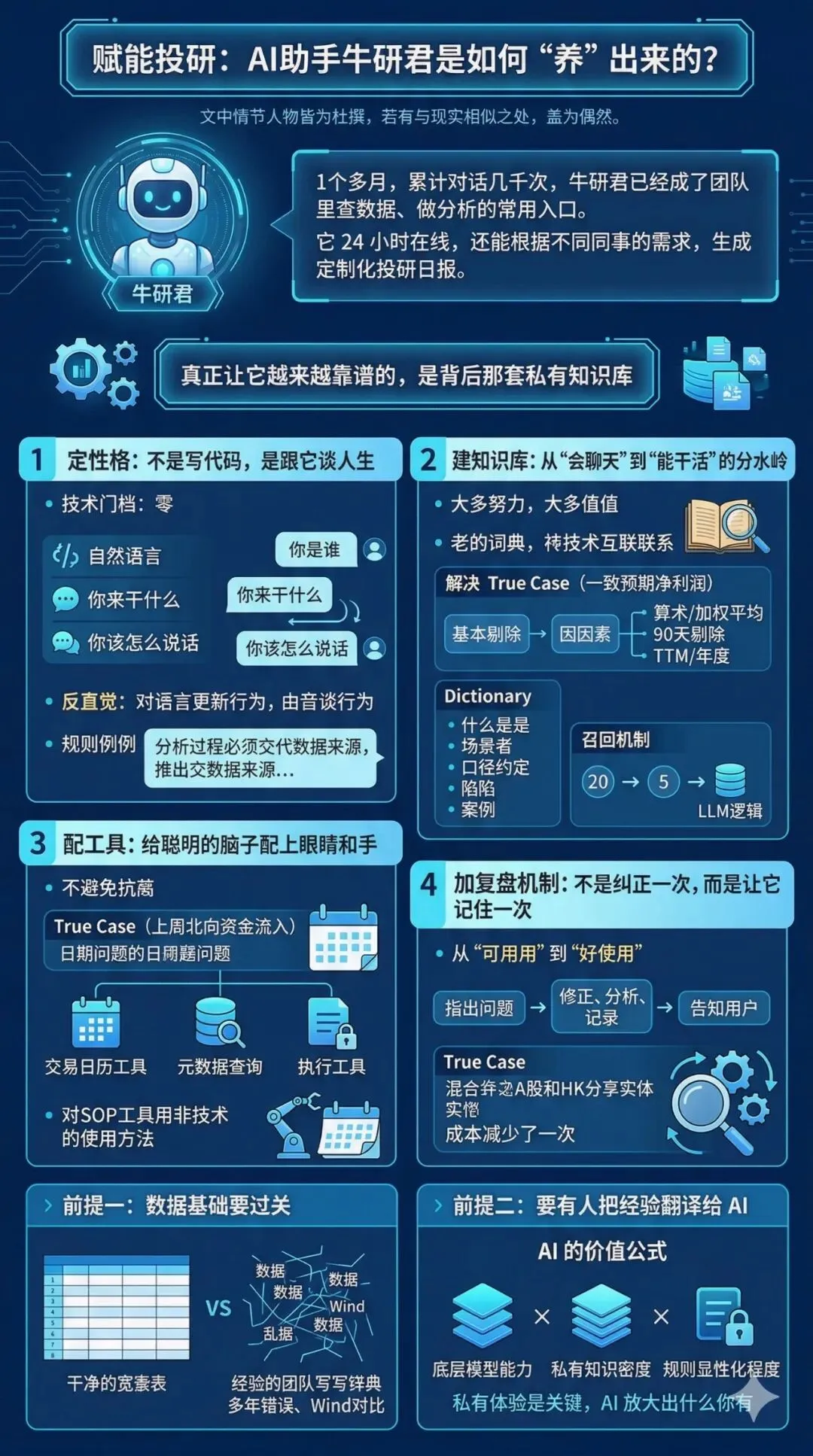

一个多月,累计对话几千次,牛研君已经成了团队里查数据、做分析的常用入口。它 24 小时在线,还能根据不同同事的需求,生成定制化投研日报。

很多人看到这里,第一反应是问:你们用的是什么大模型?

但项目真的跑起来之后,我越来越确定一件事:模型当然重要,但不是决定它靠不靠谱的关键。

真正让它越来越靠谱的,是背后那套私有知识库。那些年我们踩过的坑、对过的口径、总结过的规则,被整理成了 AI 能理解、也能调用的形式。

下面,我把这套方法拆成四步,讲清楚它是怎么被一步步“养”出来的。

1. 定性格:不是写代码,是跟它谈人生

技术门槛:零

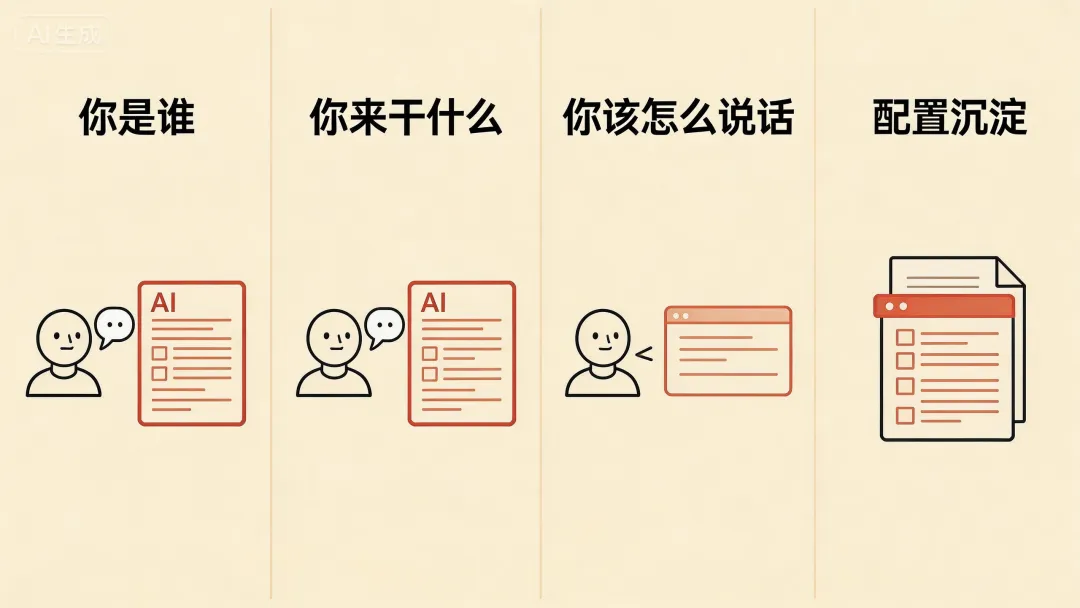

很多人以为训练 AI 需要复杂的技术操作。其实第一步完全不涉及代码,就是用自然语言跟它说清楚三件事:你是谁、你来干什么、你该怎么说话。

比如告诉它:“你是投研分析助手,帮团队同事查数据、做分析,说话要像身边的同事,别用汇报腔;数据要严谨,表达要好理解,该专业时专业,该轻松时轻松。”它会把这些要求记进自己的配置文件里。

一开始大家反馈牛研君“回复太官方,不像人聊天”,我当场在群里 @ 它说“能不能说人话”,它立刻调整了风格,还自动更新了配置。

关键反直觉:AI 的性格不用一次搞定。用的时候发现问题,直接在对话里说,它会自己更新行为准则,不需要去后台改代码。

现在牛研君的配置文件里有一条:“分析过程必须交代数据来源、使用口径和关键假设,做到可追溯、可复核。”这条规则,是有次它给出的数字无法溯源被发现后,通过一次普通对话纠正加进去的。

2. 建知识库:从“会聊天”到“能干活”的分水岭

最费功夫,也最值钱

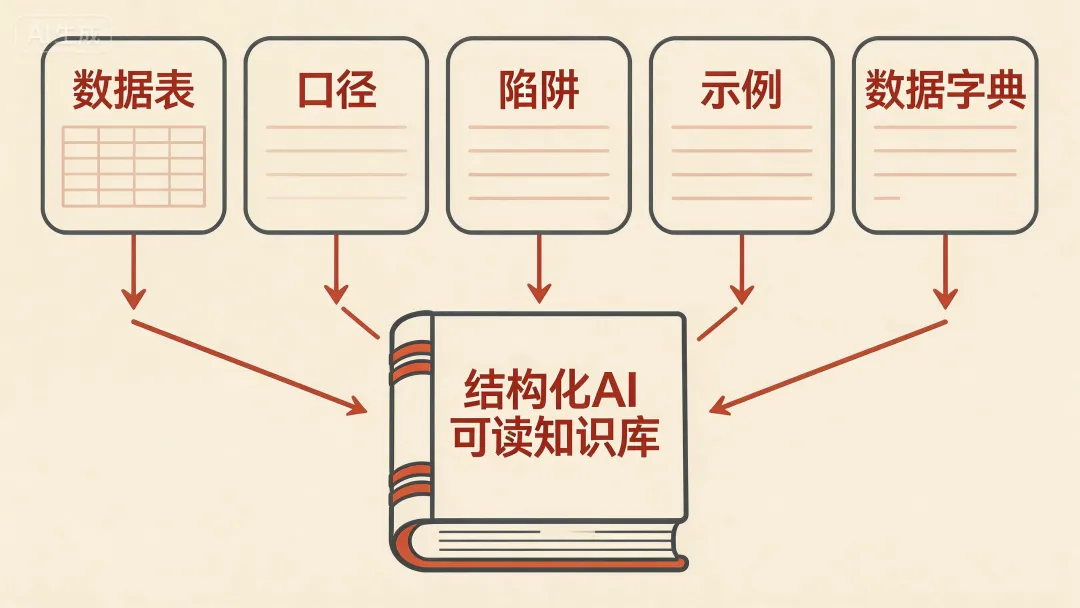

如果说性格设定决定了它怎么说话,那知识库决定了它有没有资格说这句话。

投研分析里最常见的错误,是 AI 不知道该用哪张表,或者知道用哪张表却不知道怎么用。你让它查一只股票的一致预期数据,它可能用错数据源,或漏掉关键过滤条件,给你一个“看似合理、实则错误”的数字。这种错误最难发现,也最危险。

真实案例

同事问某只股票最近的一致预期净利润,看起来是个简单查询。但实际上涉及:用的是哪家数据商的预期数据?是算术平均还是加权平均?要不要剔除更新超过 90 天的过期预测?口径是 TTM 还是年度?不提前约定,每个人查出来的数很可能都不一样。数据字典真正解决的,不是“AI 知不知道表名”,而是它知不知道这道题的正确口径。

解决办法是给牛研君建一本“数据字典”,维护公司常用数据表和数据源的详细说明。注意,这个“详细”和给技术人员看的完全不同,是专门给 AI 看的格式。每张表都要回答:

• 这张表是什么:一句话说清用途 • 什么场景下用它 • 必须约定哪些口径,否则结果会有歧义 • 有哪些常见陷阱:比如某数据源的预期更新频率不一致 • 典型正确查法的示例

说白了,就是把老员工脑子里的隐性知识,翻译成 AI 能读懂的格式。

还有一个召回机制值得一提:牛研君回答问题前,会先在所有数据表里粗筛一遍,召回约 20 张可能相关的表,再通过排序模型选出最相关的 5 张,最后传给大模型生成分析逻辑。这个设计既保证准确率,又大幅控制了计算成本。

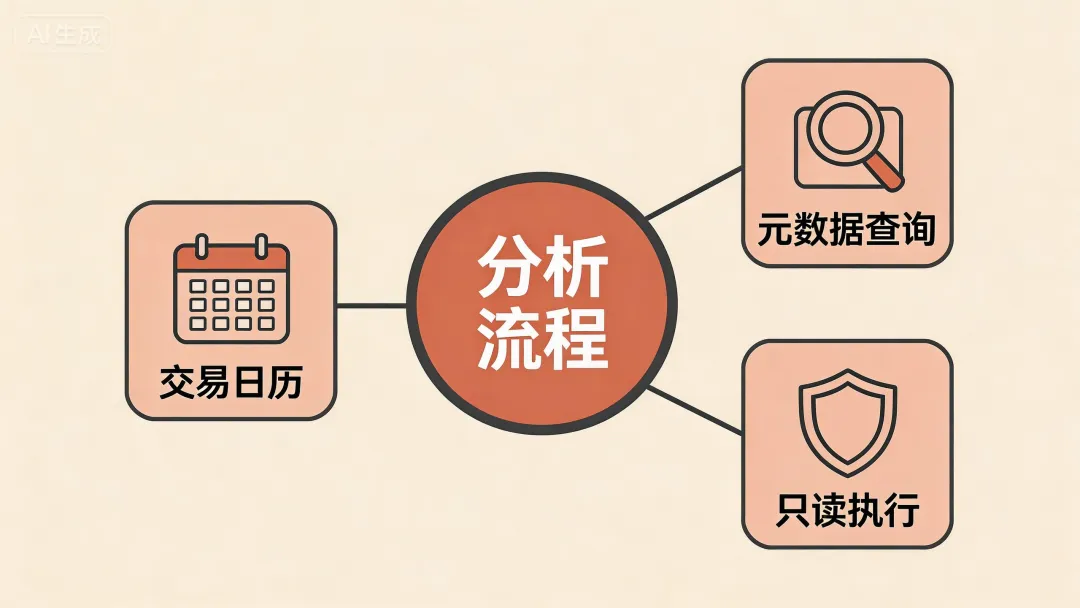

3. 配工具:给聪明的脑子配上眼睛和手

不是为了炫技,是因为真踩过坑

我们一开始以为,大模型已经足够聪明,日期这件事不用专门处理。后来发现完全不是这样。

真实案例

用户问“上周北向资金流入数据”,AI 有时按近 5 个交易日理解,有时按自然周理解,遇到节假日又会多算或少算一天。这两个口径看起来只差一点,但最后得出的净流入结论可能完全相反。所以后来我们把“时间解释”单独工具化:凡是涉及日期,都先把交易日范围算清楚,再开始分析。这类口径错误明显减少了。

• 交易日历工具:统一时间口径,处理节假日与交易日歧义 • 元数据查询:动态调用数据字典,完成数据源筛选 • 执行工具:只读权限,只查不改,错误可控

执行工具只有只读权限,哪怕 AI 出问题,最大的错误不过是算错数据,不会影响任何原始数据内容。

对不懂技术的人特别有用:工具不一定是代码脚本,也可以是一套可重复调用的操作规范。把“投研分析的标准流程”固化成工具,AI 遇到类似需求就自动按流程走,不会每次自由发挥。

4. 加复盘机制:不是纠正一次,而是让它记住一次

让 AI 从“能用”变成“好用”的关键

普通 AI 工具有个让人崩溃的特点:纠正过的错误,下次还会犯。

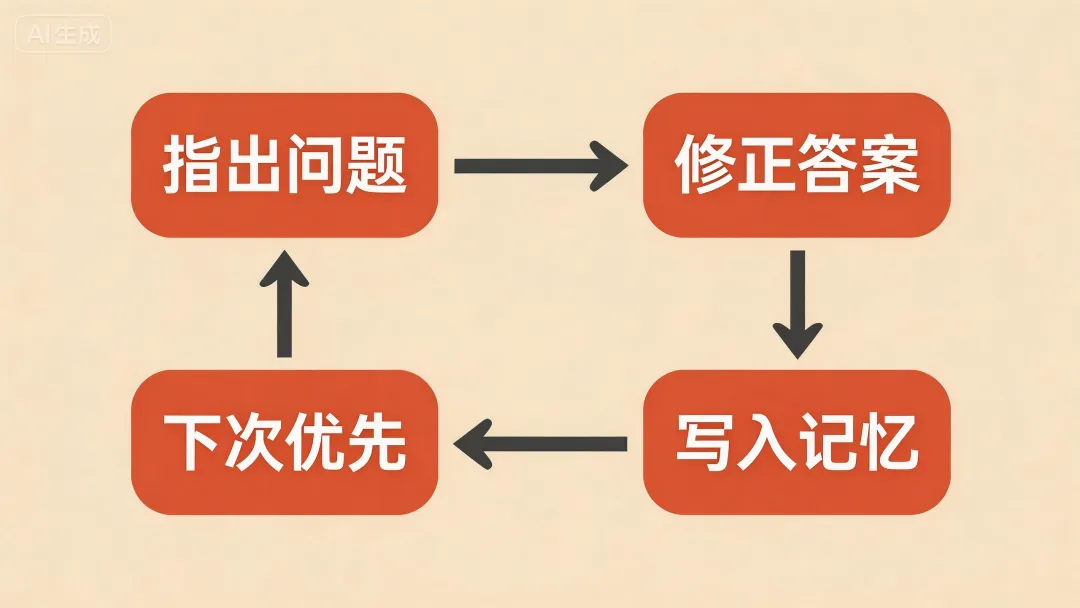

解决办法是在配置里加一条规则:只要用户指出问题,它必须做三件事,修正当前答案、分析这次错在哪里、把正确口径写进记忆文件,并告知用户“已记录,下次优先按这个口径处理”。

真实案例

有次同事问某家公司的分析师覆盖情况,AI 把两个名字相近的上市主体混淆了。一个是 A 股上市公司,一个是其港股关联主体,预期数据来源和分析师覆盖数量完全不同。以前这种错,下次还得重新解释;现在它会把“这两个主体如何区分、分别对应哪张表”写进记忆规则,下次优先按正确口径处理。这一步的意义不在于“它会道歉”,而在于团队的纠错经验被沉淀下来了。

这个机制把纠正成本从“每次都要重新说”变成了“只需要说一次”。本质上就是复盘,只不过它比大多数人执行得更彻底、更规范。

如果你觉得照着四步走一遍就能复制出一个牛研君,我想先泼一盆冷水

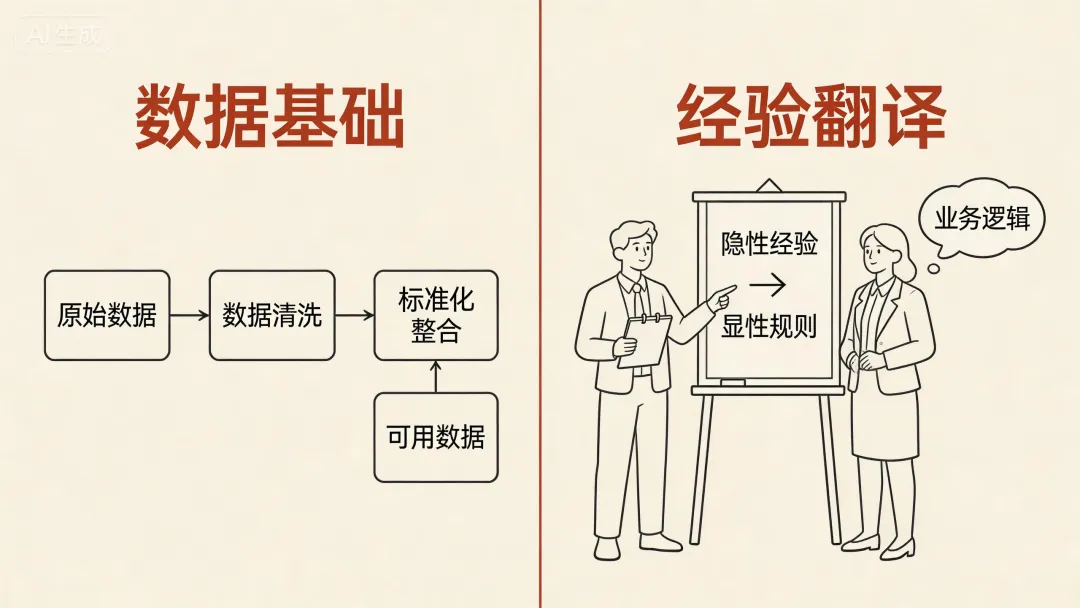

前提一:数据基础要过关

牛研君能正常运行,依赖数据已经被提前整理好了。来自不同数据商、不同市场的原始数据,被清洗、整合成口径统一的宽表。它面对的是“干净的数据”,不是各自为政的原始报表。数据基础一团乱麻,AI 再聪明也没用。

前提二:要有人把经验翻译给 AI

那本数据字典怎么来的?是团队用好几年时间,一次次被追问“为什么这个数跟 Wind 的不一样”、一次次排查口径漏洞和数据陷阱,慢慢积累出来的。这些经验是独有的,别人没有。

如果换一个没有投研经验的人照着四步做,搭框架、配工具他可能会,但那本字典他写不出来。他不知道哪个数据源有延迟、哪种口径容易误导投资判断。他能搭出牛研君的架子,却养不出靠谱的牛研君。

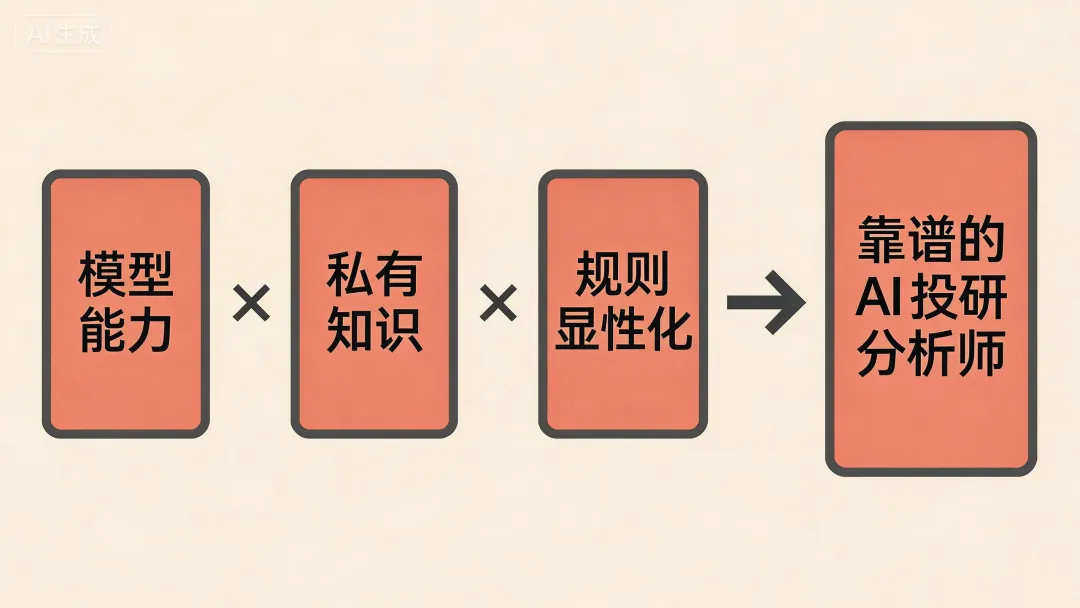

AI 的价值 = 底层模型能力 × 私有知识密度 × 规则显性化程度

很多人以为,AI 时代的竞争力来自“谁先用上更强的模型”。但真正跑过项目后我更相信:模型会越来越接近,真正拉开差距的,是你手里有没有别人复制不了的业务经验。

你踩过的坑、总结过的流程、对数据的判断、那些只在团队口口相传的“默认常识”,过去常常散落在人的脑子里。AI 真正改变的一点,是它逼着我们把这些隐性知识写出来、沉淀下来、变成可以复用的系统能力。

所以,AI 不是在替代经验。它更像一个放大器:你有什么,它就放大什么。

把你踩过的坑、总结的流程、那些知道但没写下来的判断依据,找个地方记下来,然后把它们喂给你的 AI 助手。这件事,随时可以开始。

夜雨聆风

夜雨聆风