3月份中国日均Token调用量突破140万亿,比两年前涨了1000倍。

各家云厂商集体涨价——腾讯混元模型涨了463%,阿里云、百度智能云同一天宣布涨价,连智谱Coding Plan都要靠脚本抢,还抢不到。

这次涨价潮到底是怎么回事?还会涨多久?普通人该怎么办?如何在其中赚到钱?

我们梳理了行业内最新的深度信息、社区讨论和创业者的第一手经验,用一场问答,把这件事彻底说透。

先看时间线,这波涨价有多密集?

2024年,行业还在打价格战——字节把Token定价打到0.0008元/千Token,比行业均价低99.3%;阿里云通义千问最高降价97%;百度文心直接免费。有头部厂商内部定下"三年内不考虑盈利"的目标。

到了2026年3月,风云突变:

- 3月13日,腾讯云混元模型价格上调,最高涨幅463%,输入价从0.0008元涨到0.004505元/千Token

- 3月18日,阿里云和百度智能云同一天宣布涨价,AI算力产品涨幅5%-34%,连新价格生效日期都默契地选在了4月18日

- 智谱两度涨价,GLM-5-Turbo API价格上调20%,Coding Plan取消首购优惠,套餐涨幅自30%起,还修改了限量规则。

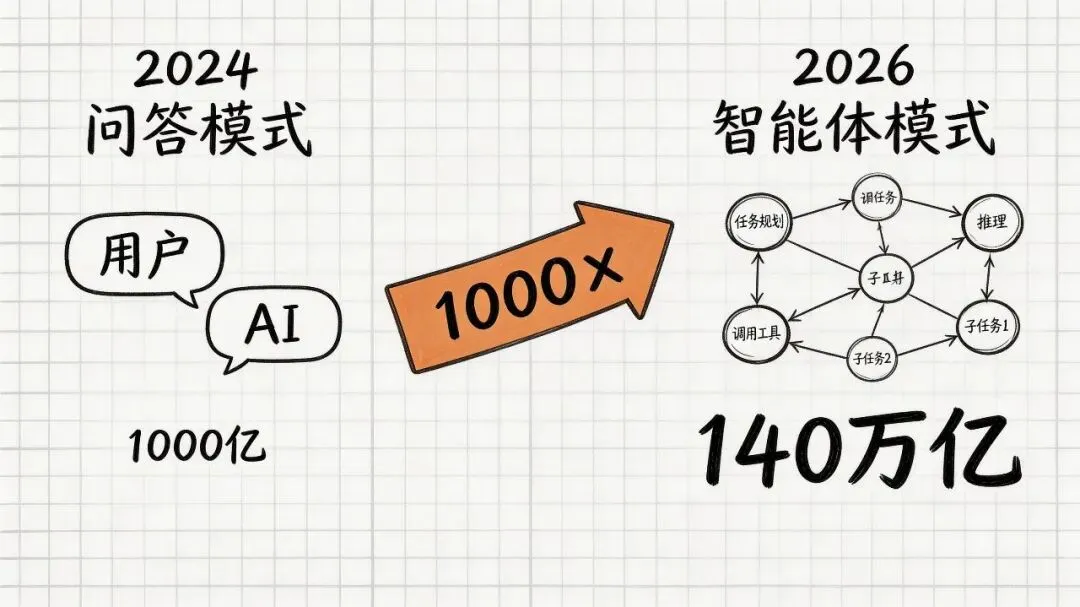

国家数据局局长刘烈宏日前披露:到今年3月,中国日均Token调用量已超140万亿,相比2024年初的1000亿增长了1000多倍。

Token调用量千倍增长对比

那到底什么变了?最核心变量只有一个:AI的使用模式从"一问一答"变成了"Agent智能体全天候自主执行复杂任务"。

以前大家用ChatGPT,问一个问题,拿个答案,消耗几千Token。现在OpenClaw(龙虾)直接替人干活——清理邮箱、管理日历、运行脚本、操控社交软件、编写代码并自行调试。它有心跳机制和定时任务,会自己主动唤醒、检查、推理、执行、休眠,然后循环往复。

黄仁勋在GTC大会上给了个数字:智能体执行复杂任务的Token消耗量是传统对话的10到1000倍。

有人用OpenClaw做爬虫测试,不到一天消耗近5000万Token,费用1700元。猎豹移动CEO傅盛的"龙虾"最高配置跑下来,一个月花费接近3万元。

"前两年算力需求方更多是企业,现在是个人算力'饥饿'。

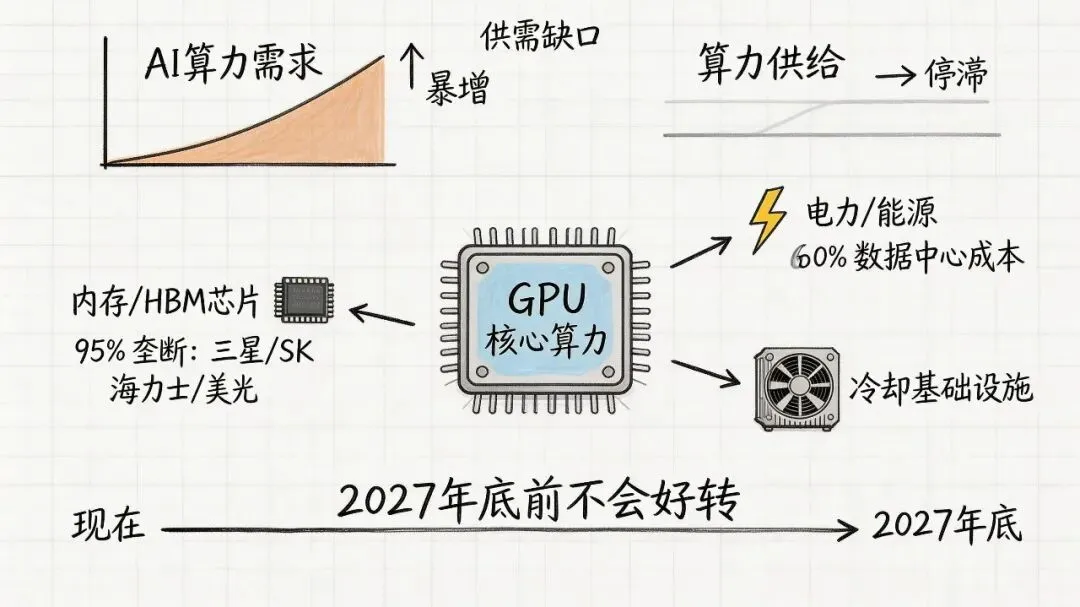

但硬件扩产不是一两个月能搞定的事。思科大中华区CTO侯胜利透露:产能跟上需求基本需要两年左右,"内存工厂的调整至少需要两年,2027年底之前不会好转。"

更有意思的观点来自派欧云计算创始人姚欣:今天限制AI和算力的瓶颈,并非最高端的芯片,而是那些普通的IT配套部件。

过去十年,内存、硬盘、交换机等传统IT基础设施一直跟着全球GDP增速温和增长。但AI爆发式增长打破了这一平衡——GPU出货量大增,配套部件在"拐点式"需求下供给被甩在身后。

"高端芯片产能是扩上去了,但其他产能没跟上。"姚欣说。

还有能源成本——数据中心电力成本占60%左右,石油、天然气价格在上涨,内存存在5年的上涨周期。

所以这轮涨价不是某一家厂商的决策,而是整条供应链的成本都在涨。HBM显存全球95%产能被三星、SK海力士、美光三家垄断,2026年Q1传统DRAM合约价格环比暴涨约90%-95%。

算力短缺将是未来3-5年的常态。

算力供应链瓶颈示意图

如果你最近试着买过Coding Plan,你大概率经历过这个场景:定好闹钟,蹲在电脑前,到点儿网站卡住,刷新瞬间——售罄。买不到对么?那就对了,因为你面对的是 自动抢购脚本程序。

V2EX上有程序员吐槽:"公司开脚本3个号能抢2个,昨天开脚本都没抢到,9点00分0秒,秒无。"

Coding Plan抢购场景

这本质上是一种限购+饥饿营销+健身卡的策略。

第一层猫腻:限量释放制造稀缺。 阿里云每天限量释放Pro套餐,"售完即止"。但"售完"的标准是什么?20个账号还是5个账号?没人知道。用户只能开脚本抢,闲鱼上甚至催生了代抢服务,30-50块一次。

第二层猫腻:用量乘数的文字游戏。 有用户发现,一些品牌的Coding Plan声称"几倍几倍用量",结果新模型还有3x乘数——你以为的翻倍,其实相对于涨价前的老套餐打了折,因为算法黑盒。

第三层猫腻:国际版价格陷阱。 某些品牌国际版年包打7折,走邀请再打9折,看起来和国内价格差不多。但高端模型并发限制只有2——太多人用,直接排队。

用户总拿这句话安慰自己:"你的时间才是最值钱的。"

模型厂商之前是健身卡逻辑,我赌你用不满。 有V2EX用户买了200元的阿里云Pro套餐,"站起来蹬+晚上挂着长时间任务+小龙虾,才用了40%多。"一个人根本用不完,于是催生了拼车——有人在V2EX上发帖找拼车伙伴,"人齐了,车已开。"

这个问题,行业里几位大佬给出了不同角度的回答。

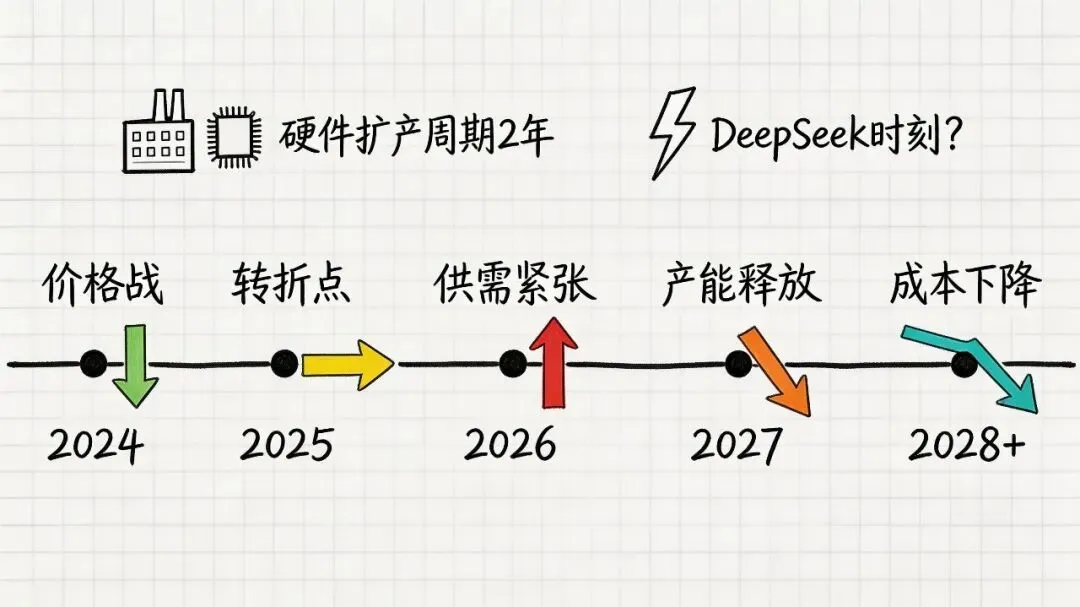

短期(1-2年):持续紧张。 侯胜利说得很直接——内存工厂调整至少两年,2027年底前不会好转。HBM显存被三家垄断的格局短期内无法打破。

中期(2-3年):取决于基模型能力提升。 田丰认为,每三个月迭代的新版本往往能解决此前未满足的刚需,释放新需求,反而可能继续推升算力价格。但推理效率的提升也在加速——英伟达Vera Rubin平台号称推理成本降90%。

长期(3-5年):一定会降。 田丰:"现在Token比实习生贵,三五年后一定会便宜。"他的逻辑是:制造业存在产能周期,扩产后新产能集中释放,价格随之降低,甚至出现产能过剩。中国正在推进新能源结构转型,也有望降低能源成本。

但除非再出现一次"DeepSeek时刻"——某个技术突破让推理成本骤降一个数量级——否则短期内缓解不了。

姚欣的比喻很形象:"AI已进入奇点时刻,未来一两年内十倍百倍高速增长。就像水波纹那样慢慢扩散,最终会趋于平稳。"

Token价格走势预测

说了这么多坏消息,来点实际的。

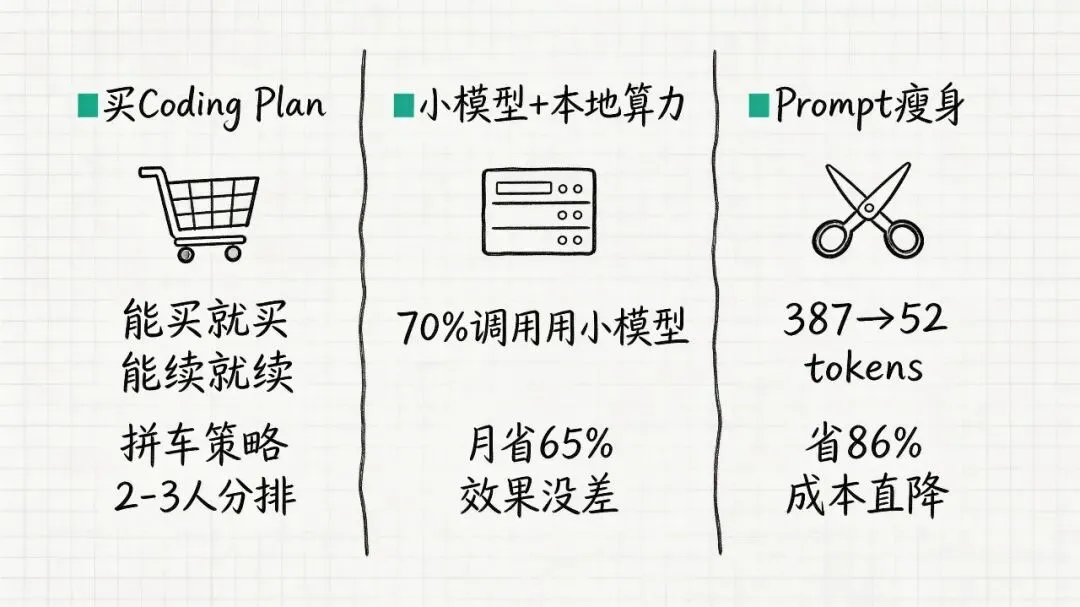

第一,能买Coding Plan就买,能续费就续费。 后面条件大概率会更苛刻。随着算力进一步紧张,号贩子的生意会越来越好。

第二,做好算力调度,配合小模型+本地算力做补充。 云端Token越贵,本地跑模型就越划算。

一个电商团队的实战经验值得参考:他们把70%的调用从GPT换成了更小的模型——简单分类、提取关键词、判断情感,便宜模型完全够用。月成本从2.3万降到0.8万,省了65%,效果几乎没区别,这就是用技术换成本优势。

第三,进行更深度的Prompt瘦身优化。 同样一个客服场景,优化前Prompt 387个Token,优化后52个Token,省了86%。大模型不需要你写周报,它要的是精准指令,不是背景介绍。

普通人应对策略全景图

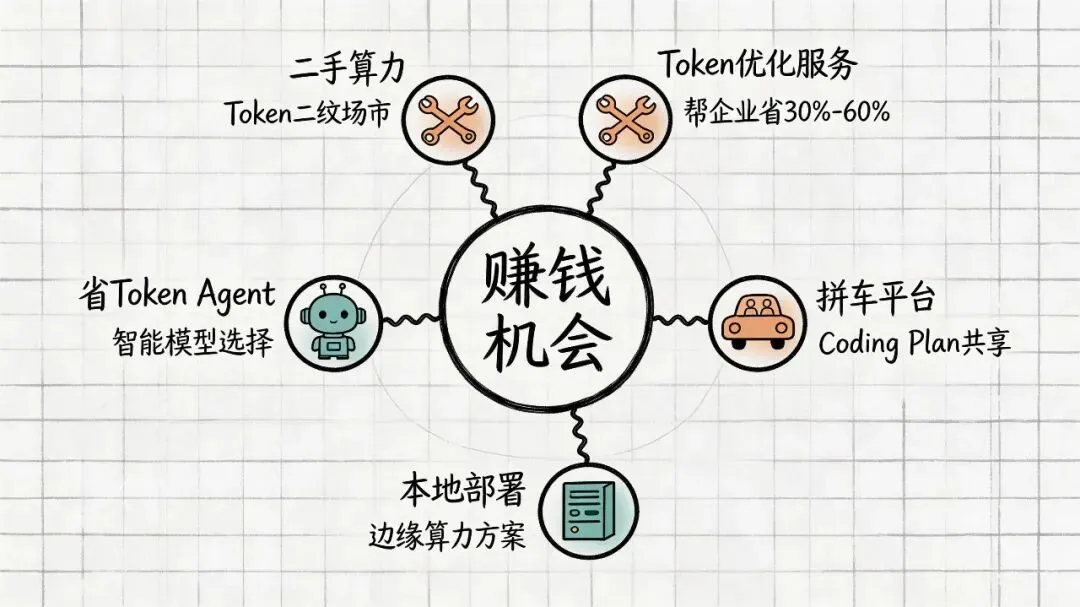

这是最重要的问题。涨价意味着价值转移——有人亏钱,就有人赚钱。

机会一:Token优化服务。 如果你能帮企业把Token成本降30%-60%,这就是一个真实的付费需求。上面那个电商团队的5个野路子(Prompt瘦身、缓存、模型分层、监控),每一个都可以产品化。Prompt审计、Token消耗监控仪表盘、智能缓存中间件——这些都是刚需。

机会二:Coding Plan代运营/拼车平台。 现在的Coding Plan抢购已经催生了闲鱼代抢(40-50块/次)和拼车群。如果把这件事平台化——统一抢购、智能分配用量、按需计费——这就是一门生意。关键是要解决信任问题(API Key共享的安全性)和合规问题。

机会三:本地部署和边缘算力。 随着Token越来越贵,本地部署的ROI在快速提升。如果你能帮中小企业搭建本地AI推理环境——哪怕是二手GPU服务器+开源模型——在当前价格下,半年内就能回本。

机会四:做"精打细算"的Agent。 黄仁勋在GTC上说的"Token工厂经济学",核心就是未来Agent的核心竞争力不仅仅是"能干什么",还有"干同样的事,谁更省Token"。如果你能开发一个在执行任务时自动选择最优模型的Agent——简单任务用nano,日常用mini,只有关键节点调用旗舰——这就是差异化竞争力。

机会五:二手算力市场。 就像云厂商有闲置算力一样,很多买了Coding Plan的用户用不满。如果你能做一个"Token二级市场"——让用量不足的人把额度转让给用量大的人——这在经济学上是帕累托改进。当然,这需要厂商开放API或者至少睁一只眼闭一只眼。

普通人赚钱机会全景图

最后,我们更深一步思考,把算力想象成钱或能源,想一想金融或能源行业现在是怎么玩儿的?这样思路就开阔了吧?Token经济是尚未被完全开采的金矿,是未来大有可为的蓝海行业。

夜雨聆风

夜雨聆风