谷歌的模型“Gemma”可以运行在手机上了!

是Gemma,记住了哈,千万别看错!

你可能会纳闷:不对啊,谷歌的大模型不是叫Gemini么?怎么又冒出一个Gemma?而且这俩名字长得也太像了吧?!

别慌,我这就给你盘清楚Gemma到底是个啥!

什么是Gemma?

谷歌的Gemma系列模型(注意,这是一个系列)是其最先进的“开放权重”模型家族。

简单来说,它就是谷歌旗舰模型Gemini的“轻量化、可本地运行”版本,专门为开发者和研究人员量身定制。

看重点!这里有两个核心关键词:开放、轻量化!

• 开放权重 vs 开源: 谷歌将其定义为“开放模型”而非传统意义上的“开源”。这意味着你可以免费获取模型权重,并在本地、云端甚至移动设备上部署;但谷歌并没有公开完整的训练数据集和原始训练代码。 • 轻量化: 不同于Gemini需要庞大的算力集群,Gemma的设计初衷就是为了能跑在个人电脑(比如MacBook)或单张消费级显卡(比如RTX 4090)上。

虽然我手里没有4090,但我有移动设备啊!

移动设备要求

目前移动端设备并不是都可以跑Gemma,主要考虑到运存和算力问题,官方给出的要求如下:

1. 核心硬件要求(RAM & 算力)

内存(运存RAM)是移动端运行大模型最大的瓶颈。

• Gemma1B/2B(轻量级): • RAM: 建议4GB以上可用内存。 • 适用设备: 入门级Android手机、iPhone 13及以上。 • Gemma 4B / 9B (主流性能级): • RAM: 建议8GB-12GB以上可用内存。经过4-bit量化后,Gemma 2 9B实际运行时约占用5GB-6GB内存。 • 处理器 (SoC): 建议搭载有独立NPU (AI神经网络芯片) 的芯片,如: • Android: 高通骁龙 8 Gen 2及以上,联发科天玑9200及以上,或者Google Tensor G3/G4。 • iOS: A16 Bionic及以上(iPhone 14 Pro及后续机型)。 • Gemma 27B / 31B (超大型): • RAM: 通常需要24GB以上内存。目前仅极少数顶配Android旗舰机支持,且主要运行在“极高压缩”模式下。

2. 软件环境与框架要求

• Android系统: • Android 14+: 通过AICore模块,系统会自动处理模型下发和底层硬件加速(目前主要支持Pixel 8/9系列和三星S24/S25系列)。 • MediaPipe LLM Inference API: 开发者最常用的跨平台框架,支持在Android和iOS上调用GPU/NPU。 • iOS系统: • iOS 17+: 必须使用Apple的Core ML或机器学习框架进行模型转换。 • Metal支持: 必须支持Metal加速以获得可用的推理速度。

我的测试设备:iPhone 14 Pro (256G)

操作步骤

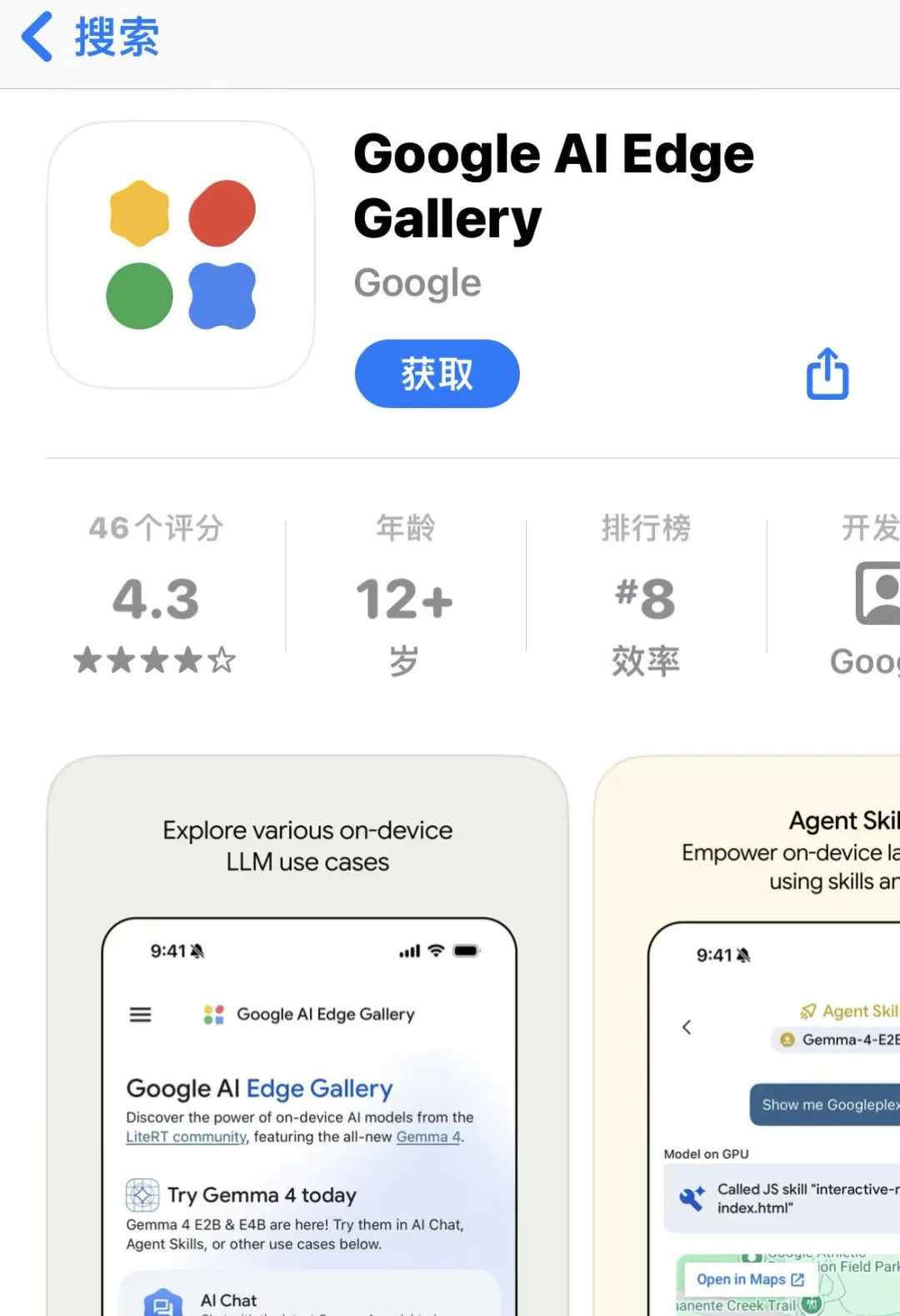

1、登录外区App Store账号

首先Gemma在谷歌的AI Edage里面,国内的App Store无法下载,所以需要登录外区。

我这里选择的是美区账号(没有账号的同学,搜一下如何注册外区账号,有困难可以后台联系)

2、搜索Google AI Edge Gallery

搜索栏直接搜索“Google AI Edge Gallery”,然后获取。如果搜索“Gemma”有可能出现错误索引信息。

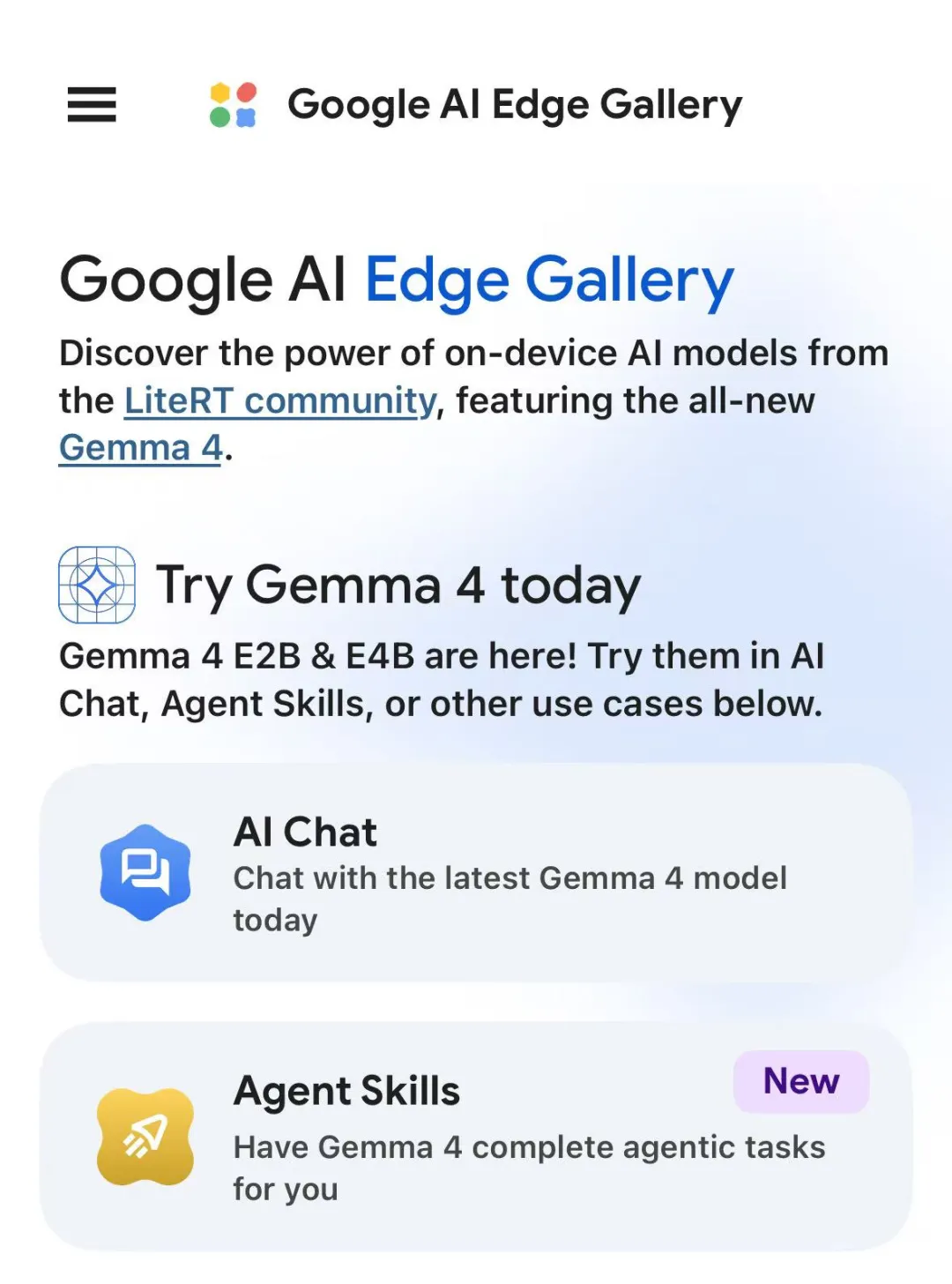

3、打开软件下载模型

Google AI Edge Gallery不需要登录谷歌账号开箱即用!

选择AI Chat或是Agent Skills,会提示下载模型(软件会适配符合你终端机器的模型版本)

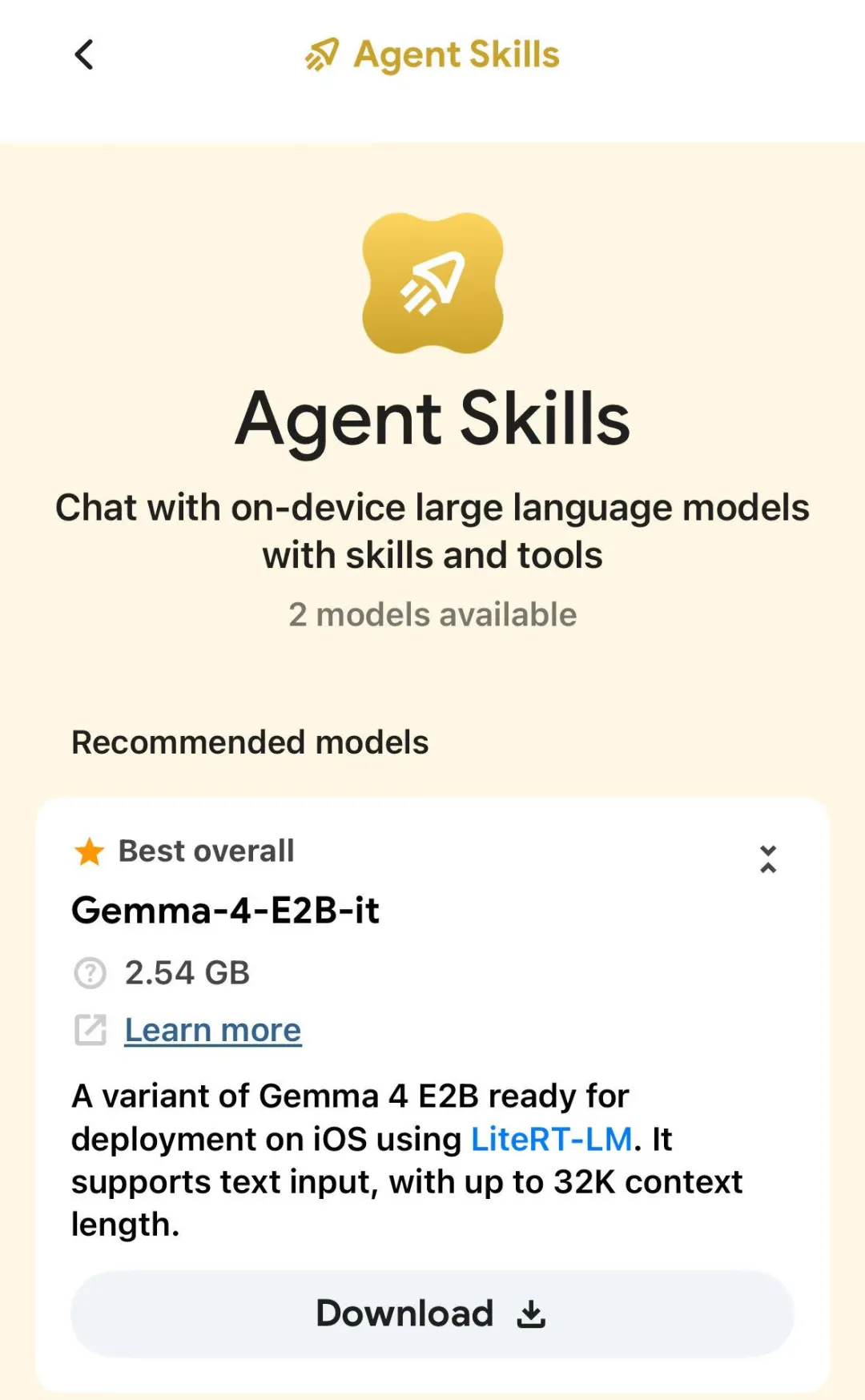

根据我的手机硬件情况,Google推荐E2B-it版本,最大上下文32K,也可以了,能用就可以!

点击Download下载模型。

4、开始对话

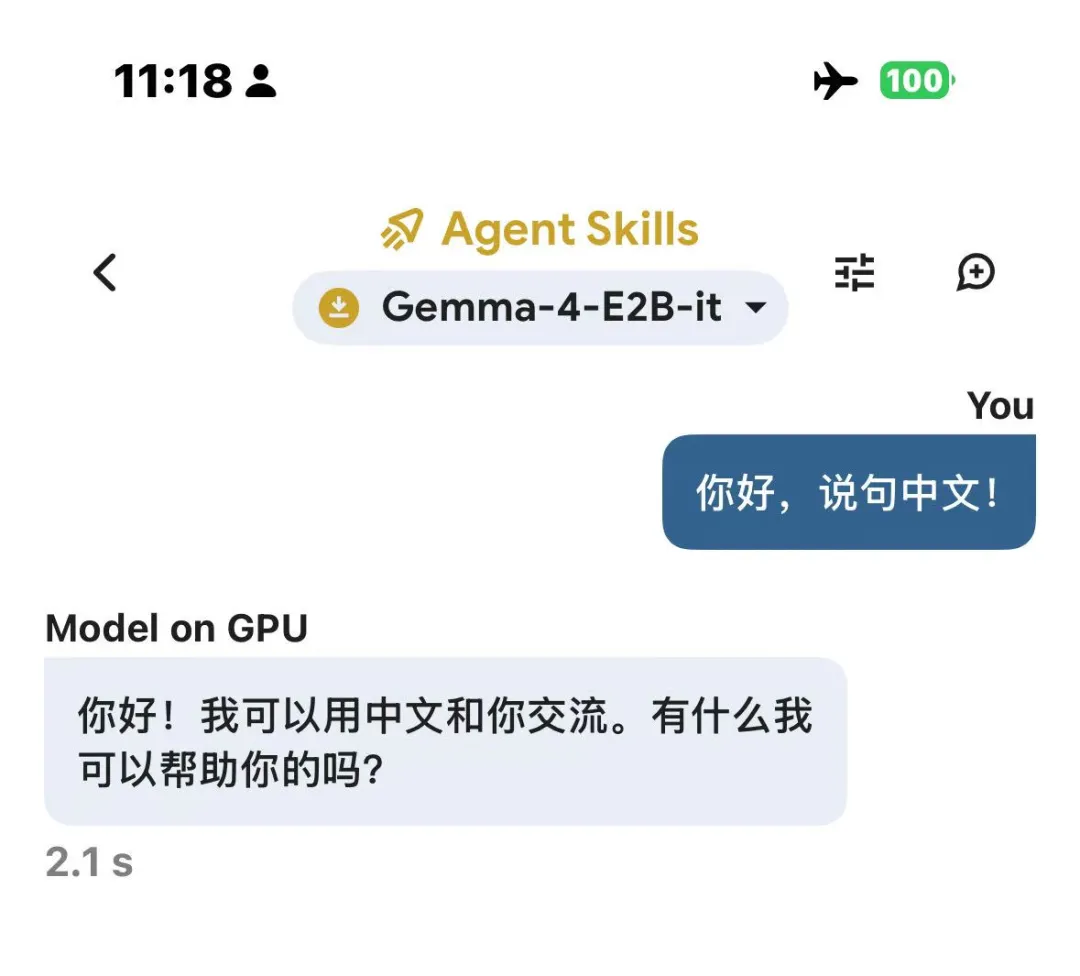

下载完成后,打开任意AI Chat或是Agent Skills就可以开始啦!说是离线嘛,我肯定是开启飞行测试的。

支持中文,速度还可以,运行基于GPU,2.1s的输出,还是不错的!

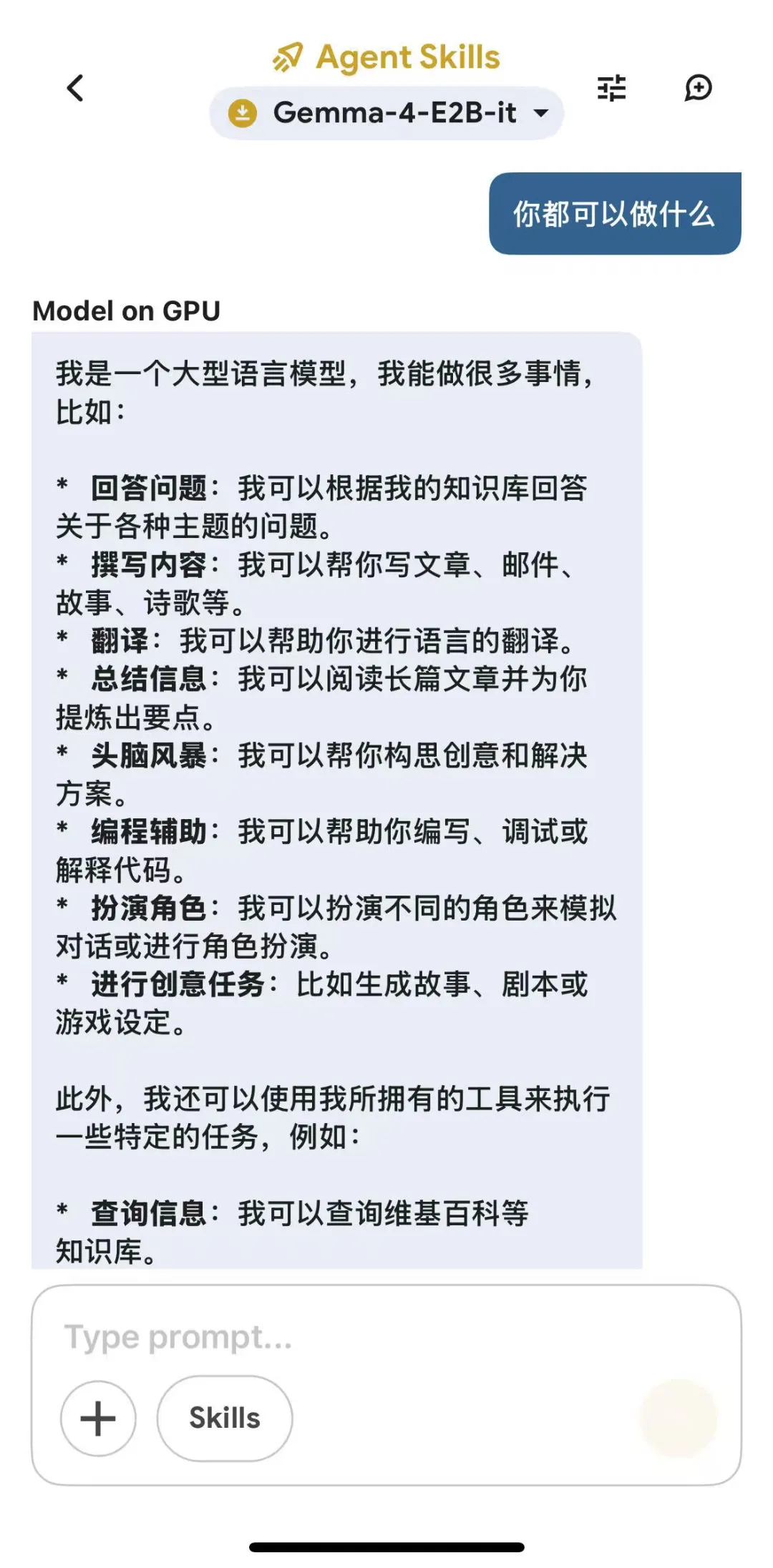

我又问了它可以做啥,看样子还挺能打的!

软件支持设置,包括调整算力芯片,上下文大小,模型信息,甚至还有温度。大家可以自己探索下!

移动端AI模型可以用来做啥?

很多人好奇,现在商业算力如此发达,为什么要搞个人算力!就算搞个人算力为啥要搞手机端的?

其实这可以聊很多!首先是隐私问题,商业算力平台(Open AI,Gemini,Claude,Kimi,Qwen等等)首先需要你交出你的数据,上传到他们的服务器,所以相当于是开放你的隐私。

很多企业对于数据是非常敏感的!本地算力最大的优势就是脱敏!

手机端跑AI模型其实未来可以实现以下场景

• 隐私信息的“私人秘书” • 场景: 帮你整理医疗报告、银行账单或私人日记。 • 优势: 这些极其敏感的数据完全不需要上传云端。Gemma可以在本地对照片中的发票进行 OCR识别,统计你的财务状况,或者总结你的体检指标,由于不联网,隐私泄露风险降为零。 • 弱网/无网环境的“随身百科” • 场景: 在飞机上、地下室、偏远山区出游时。 • 优势: 离线翻译、野外植物识别、紧急求救指南。Gemma 4可以完全离线运行,响应速度比云端更快(因为省去了网络传输的几百毫秒延迟)。 • App 之间的“万能胶水”(智能 Agent) • 场景: “帮我查一下上周我和张三在微信里聊到的那个餐厅,然后在地图里订个位。” • 优势: 传统的云端AI很难获得手机系统的深层权限。但通过Android的AICore,本地 Gemma可以直接在系统底层跨应用读取信息并执行指令,实现真正的“一句话操作手机”。

谷歌的初衷

谷歌推出Gemma并推进移动端部署,主要有三个核心商业逻辑:

• 降低“基建”成本: 云端运行Gemini极其昂贵(电费、芯片费)。如果能把50%的简单请求(如:总结短信、写个邮件草稿)转移到用户自己的手机上运行,谷歌每年能省下天文数字的运营成本。 • 构建Android壁垒: 通过将Gemma与Android系统(AICore)深度绑定,谷歌能让安卓手机拥有 iPhone暂时难以企及的本地AI体验,从而巩固硬件生态。 • 开发者生态抢位: 谷歌希望通过“开放权重”,让全球开发者习惯使用谷歌的架构,从而在AI时代定义新的软件开发标准。

写在最后

谷歌的设想其实很清晰,打造下一代AI智能端,把手机变成你的随身AI助手!

当然,如果只是为了复杂任务,手机跑模型确实不如云端强大;但如果你需要的是秒回、省流量、保隐私、且能操控手机的助手,Gemma就是目前的顶尖选择。对于开发者来说,它最大的魅力在于“免费的算力”——你可以利用用户手机的NPU来实现你的创意,而不必担心欠下巨额的API账单。

-END-

📌关注「引力谷」,获取更多的科技资讯和AI教程

夜雨聆风

夜雨聆风