近日,第33届IEEE虚拟现实与3D用户界面国际会议(IEEE VR 2026)在韩国大邱举办。软件学院师生参加会议,汇报了学院在虚拟现实、增强现实与3D交互技术领域的最新研究成果。

1.论文题目:Towards Event-guided Panoramic HDR Video Reconstruction for Indoor Immersive VR: A Novel Dataset and Approach(IEEE VR 2026)。山东大学为论文第一完成单位,山东大学软件学院博士研究生郭旭城为该篇文章的第一作者,山东大学软件学院教授沈益冉为通讯作者。

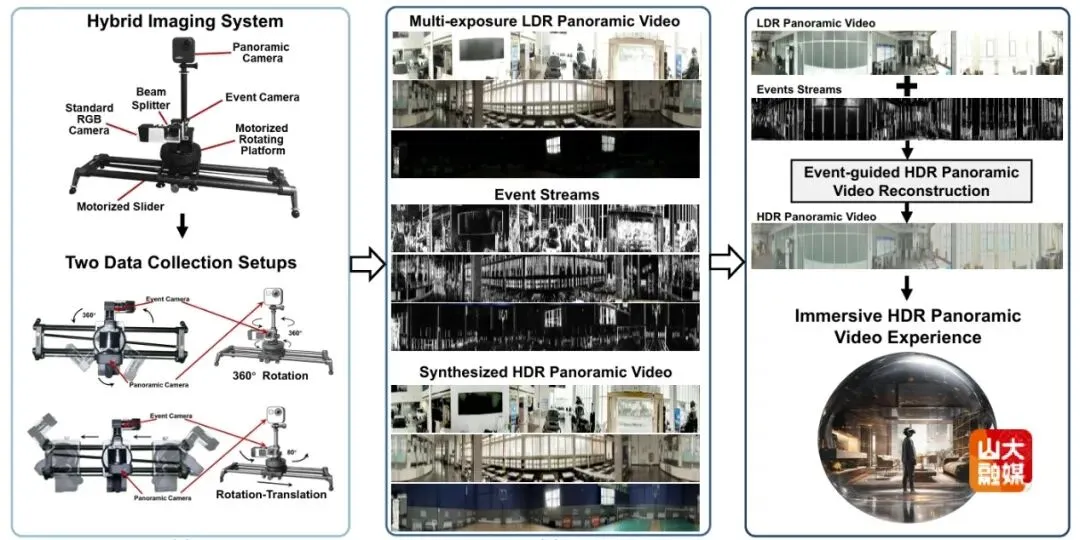

针对虚拟现实场景中全景视频动态范围不足、强光区域细节丢失以及运动模糊等问题,论文面向室内沉浸式VR应用,提出了一种事件相机引导的全景HDR视频重建新框架,构建了首个面向该任务的事件-全景HDR数据集Ev-Pano。该研究设计了由全景相机、事件相机、RGB相机、旋转平台与线性滑台组成的混合采集系统,提出了空间对齐、时间同步和HDR真值合成等预处理流程,实现了事件流与全景视频的高精度配准。基于此,论文进一步提出事件引导的全景HDR重建方法:通过切平面投影减弱球面畸变,将事件流重建为强度图,并结合颜色空间转换与加权融合策略,有效恢复 LDR 全景图像在过曝和欠曝区域中丢失的纹理与结构细节,最终生成高质量HDR全景视频。实验结果表明,该方法在客观指标和主观用户研究中均优于现有代表性方法,为事件视觉与全景成像融合,以及沉浸式VR/AR高质量内容生成提供了新的研究基础。

2.论文题目:IntentionAR: An Intention-Driven Camera–Projector System for AR Assembly Guidance(TVCG)。山东大学为论文第一完成单位,山东大学软件学院博士研究生曹昕为该篇文章的第一作者,山东大学计算机科学与技术学院教授钟凡、软件学院教授秦学英为通讯作者,香港科技大学(广州)教授梁海宁为合作导师。

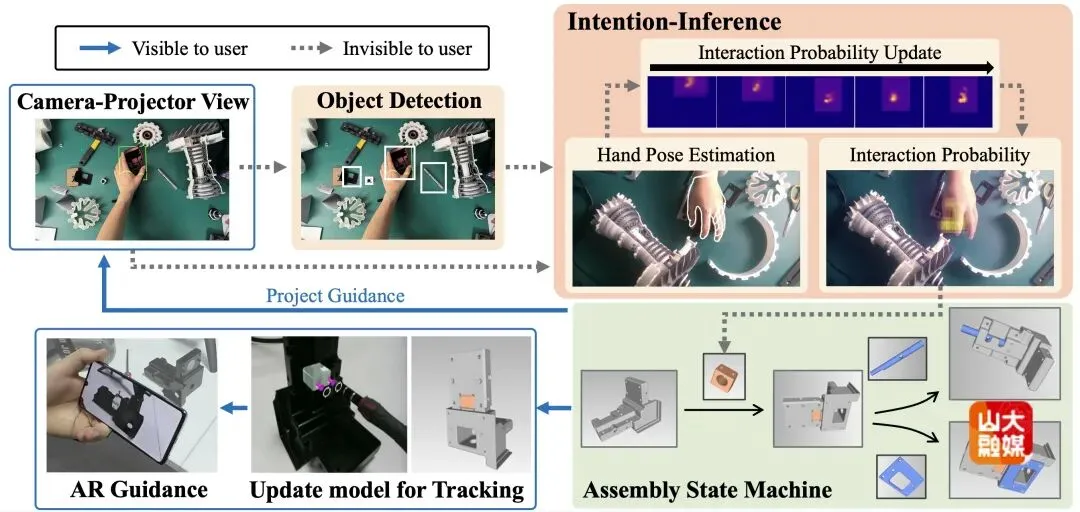

该研究面向增强现实装配引导这一智能人机交互领域的重要问题,提出了一种基于用户意图驱动的相机–投影仪系统IntentionAR。针对现有方法难以理解用户操作意图、交互过程滞后且难以适应非线性装配流程的问题,通过融合手部姿态估计与空间概率建模,实现对用户潜在交互目标的提前预测,并在操作发生前提供实时反馈。系统利用RGB相机获取手部运动信息,通过射线采样与体素概率分布推断用户意图,同时引入装配状态机对流程进行动态管理,实现对正确与错误操作的即时判定与引导。此外,系统结合投影显示与多终端AR动画,实现自然直观的装配指导体验。大量实验与用户研究表明,该系统在响应速度、交互准确性与用户体验方面均显著优于传统方法,为智能装配与人机协同提供了一种高效且实用的解决方案。

供稿单位 | 软件学院

作者 | 郭旭城 曹昕 沈益冉

摄影 | 郭旭城 曹昕 沈益冉

编辑 | 杜晶晶

责任编辑 | 盛楠 孙嘉蔚

夜雨聆风

夜雨聆风