更多AI前沿科技资讯,请关注我们:

【closerAI ComfyUI】CLOSERAI AI短剧Agent的开发与实现思考:AI短剧/短片/漫剧/动画的生产工厂,本地化高效运作的整体解决方案!

当然,我一直讨论的是基于本地开源模型的解决方案来生产制作 。如果是使用闭源模型用钱来生成的不在我讨论的范围内,毕竟有钱就能使用最好的工具和有可能生产优质的内容,当然前提你要衡量下投资与回报。 回到开源界,目前除了LTX2.3模型能使用外,估计在明天4月10日将会有一个名叫happy horse 的更强的开源的视频生成模型发布。如果一旦开源,开源界拥有了一个强敌必然会重构现在的局势,那到时候生产力将在本地设备得到极大的提升,那到时候在AIGC特别是影视行业将回归”内容“的竞争,优者胜 。 再回归到基于本地大模型的内容生产,comfyUI是一个能同时衔接开闭源产品的高效运行的操作系统 ,是目前唯一国内外共识与认同的工具,作为未来的牛马是一个必然会接触的工具之一。所以,我在开发AI短剧Agent工作台这个应用时,重点是想打通本地设备就能使用Agent来实现内容的生产。 目前,已完成了开发,可以在这里查看介绍: https://aigc.douyoubuy.cn/ai-agent/ 本项目采用了协同瀑布流架构 (Collaborative Cascade Architecture),将短剧生产模拟为一个标准化的工业电影剧组。每个 Agent 扮演不同的职业角色,通过严格的数据契约进行上下游交付。

以下是 Agent 的详细逻辑与分工设计:

1. 核心架构设计理念

模块化 (Modular):每个系统都是独立的 Agent 逻辑,负责生产特定维度的资产(如:文本大纲、视觉身份、分镜提示词)。

工业级约束 (Industrial Constraints):Agent 并非随意发挥,而是受限于“时长红线”。例如:15秒的短剧,StoryPlanner 会强制将其规划为 1 集,ScriptWriter 则会强制将其拆解为固定数量的分镜,确保后期能对齐。

资产一致性关联 (Asset Consistency):通过 CharacterDesigner 提前锁定视觉身份,后续所有分镜都会自动关联这些预设资产。

2. Agent 分工手册

总制片 StoryPlanner 将碎片化的灵感转化为具备商业价值的剧本蓝图。负责“钩子”设计、节奏规划。 视觉总监 CharacterDesigner 锁定角色与场景的视觉 DNA。确保不同剧集间人物不“崩脸”,环境不失真。 主编剧 ScriptWriter 负责详细的剧本写作。将概要扩充为包含具体对白、情感锚点、运镜建议的分镜脚本。 分镜导演 StoryboardGenerator 核心连接器 。将编剧的文字转化为 AI 易懂的视觉语言,并建立资产匹配索引。 T2I (文生图) 提示词、I2V (图生视频) 提示词、角色/场景关联索引。 制片执行 VisualGenerator 执行具体的生图和生视频任务,对接底层引擎 (SD/DALL-E/ComfyUI)。 后期导演 EditorAgent 核心调度流水线。利用剪辑 引擎将由于前序步骤产生的零碎资产按照时间轴精确拼接。

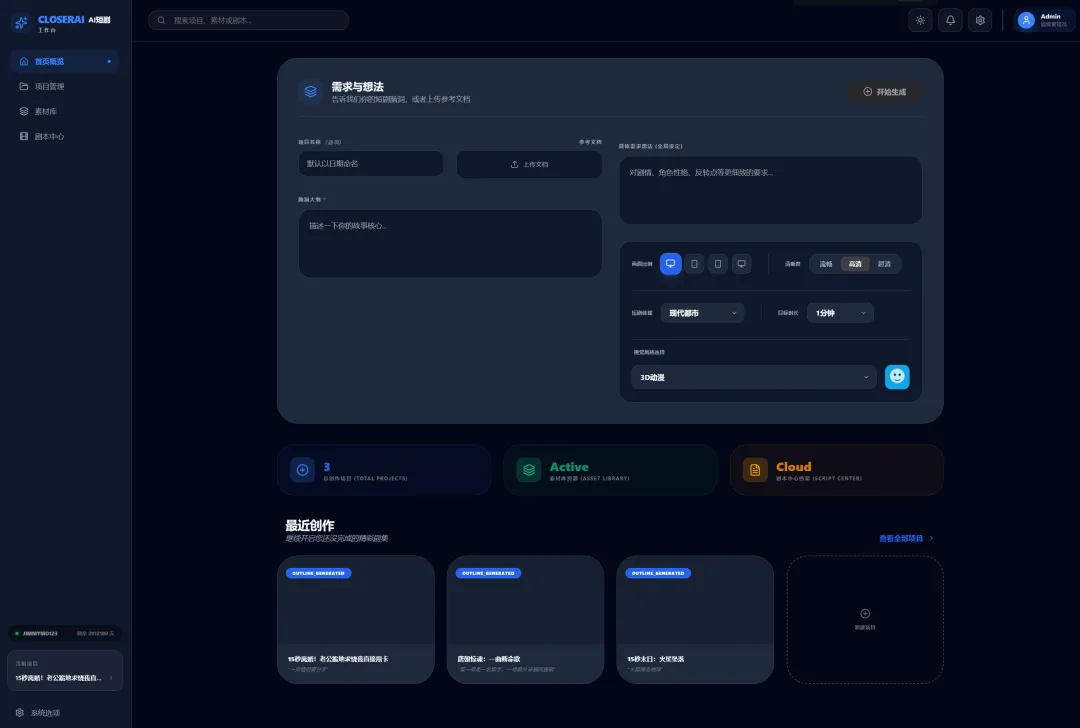

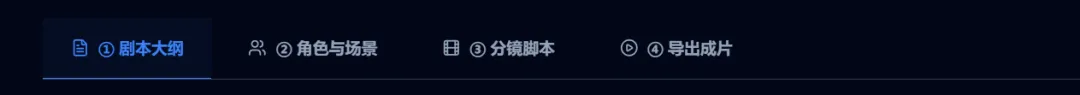

在Agent中其实就是四大模块:

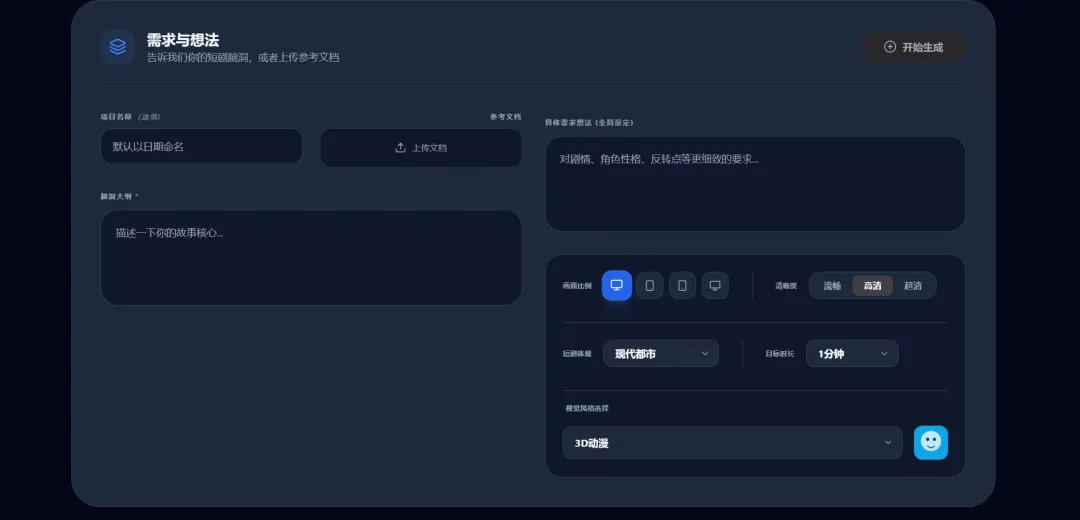

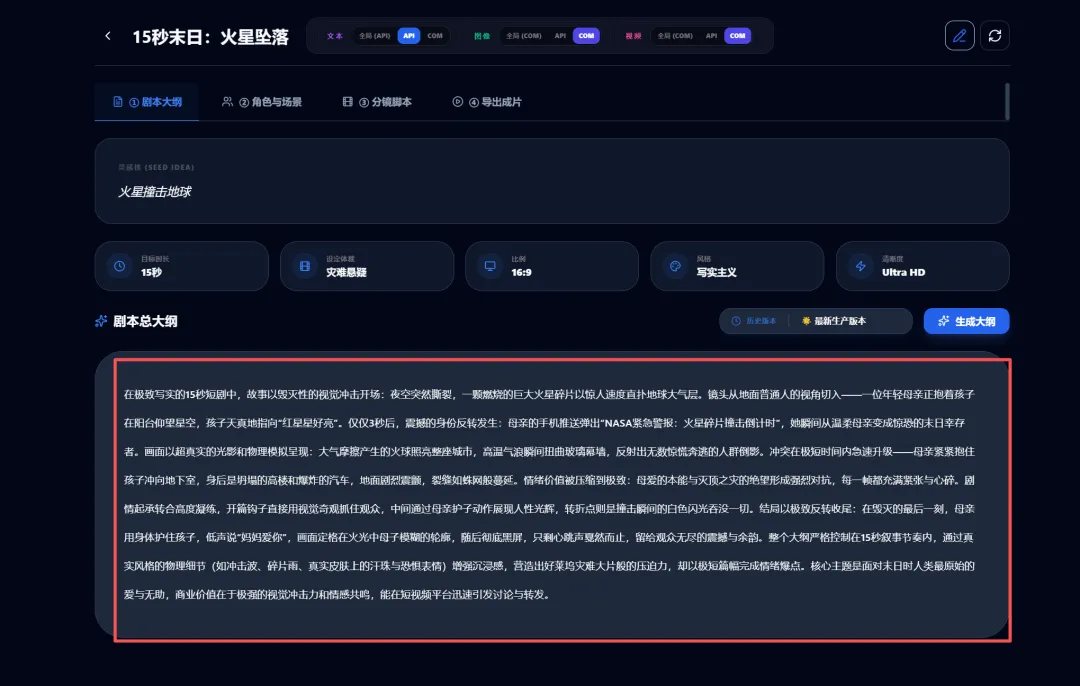

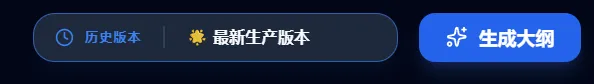

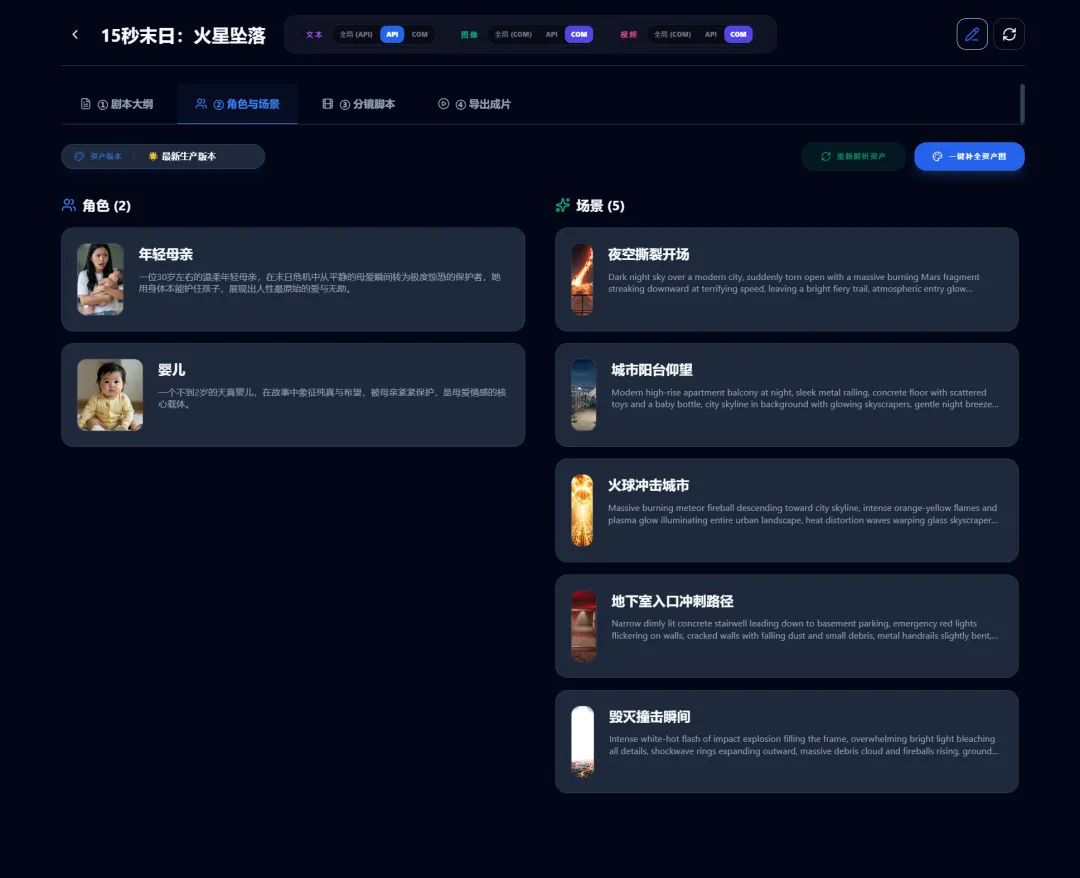

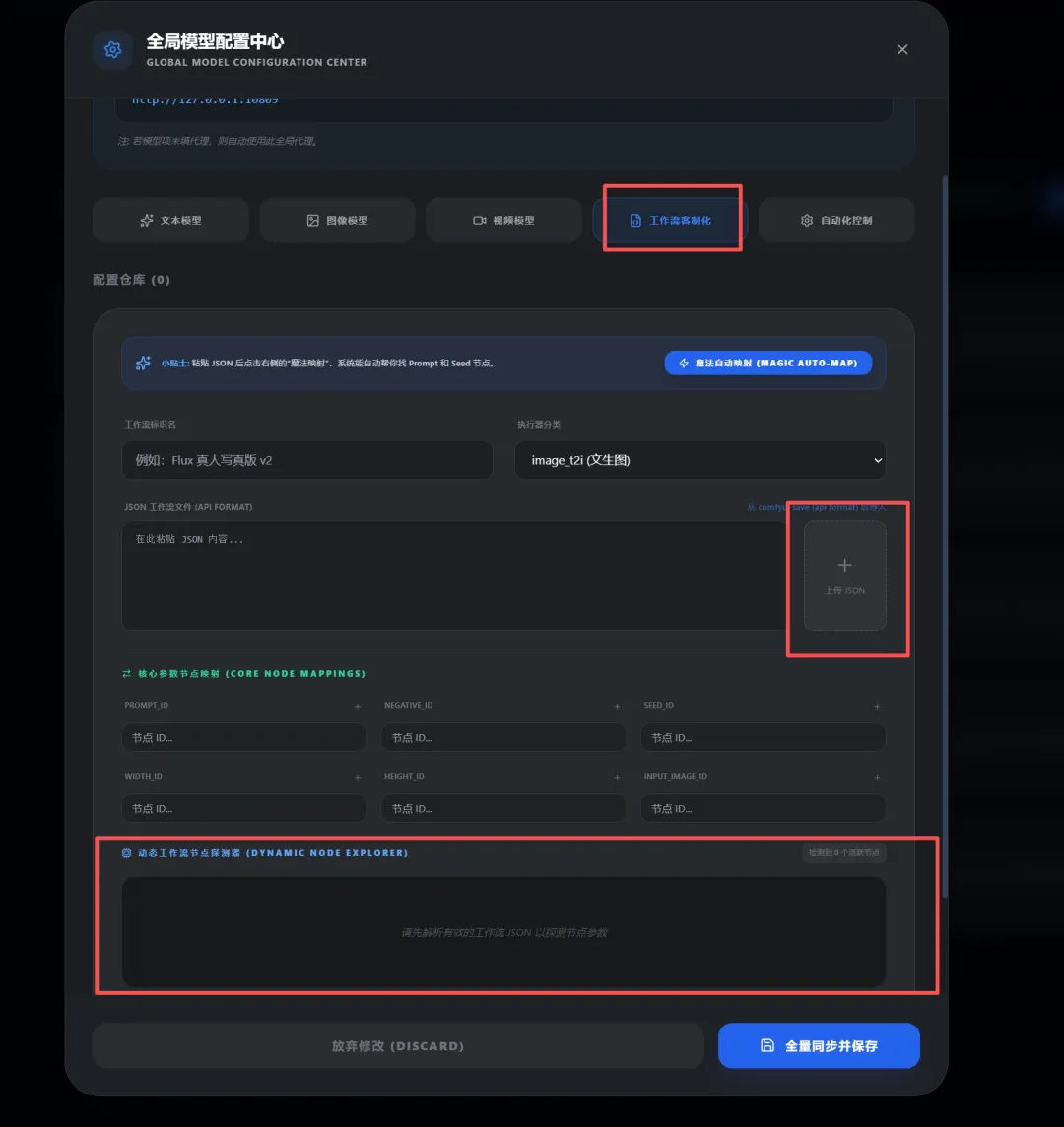

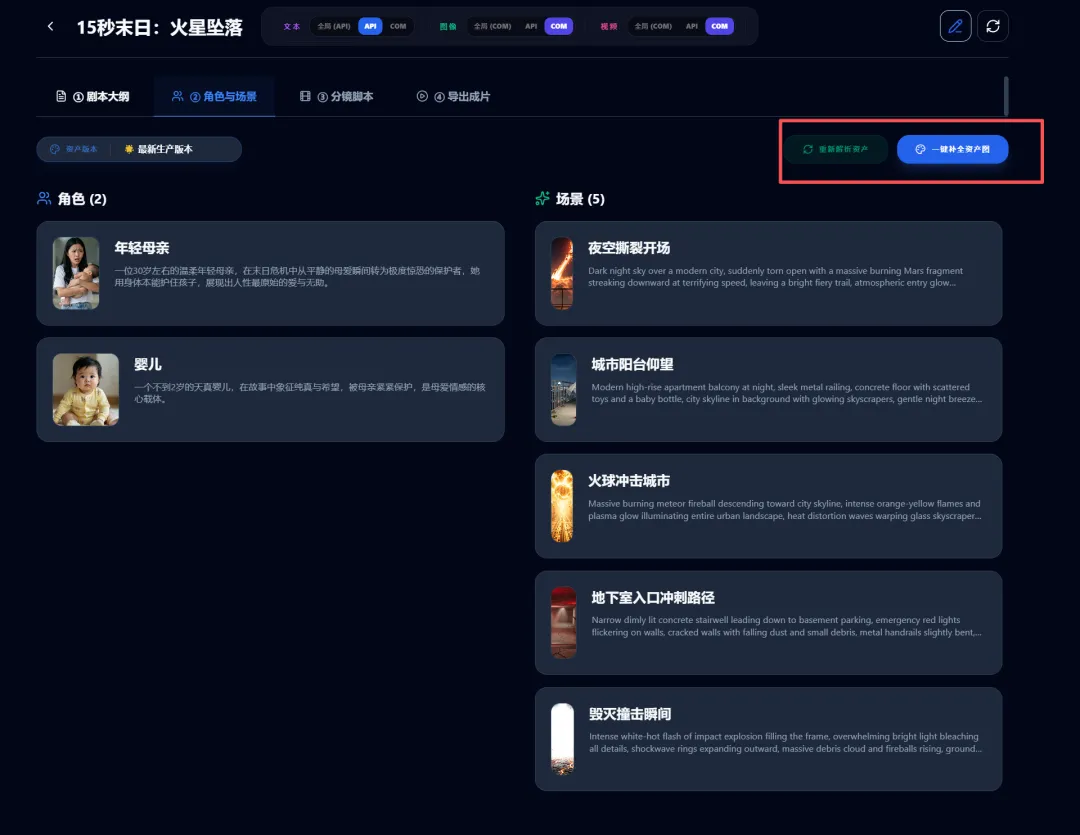

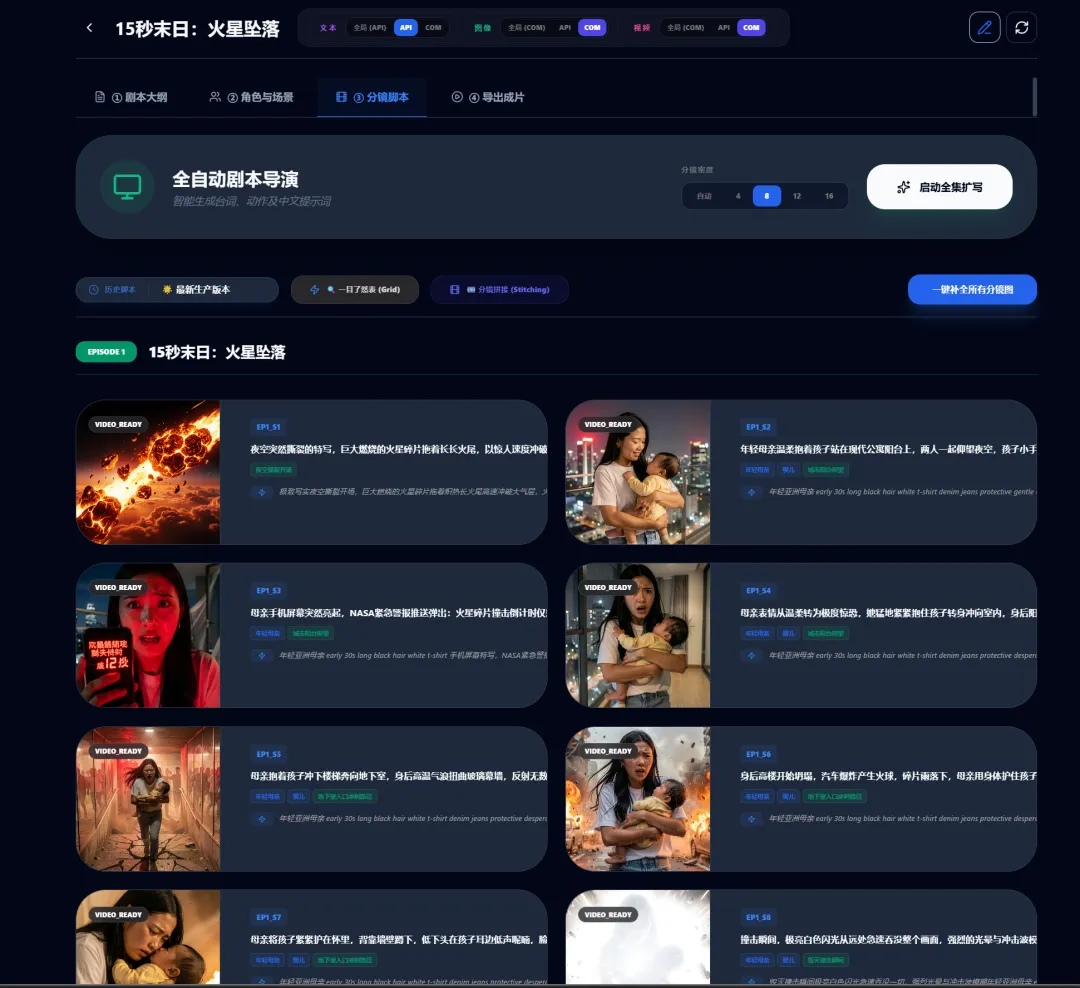

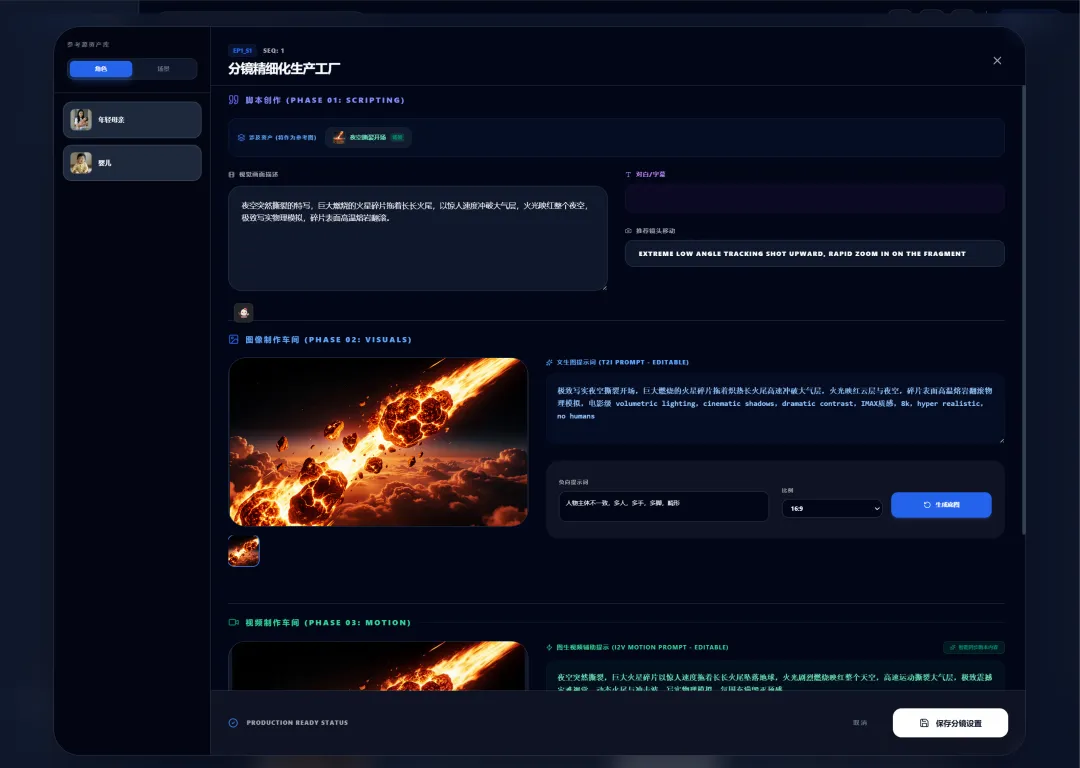

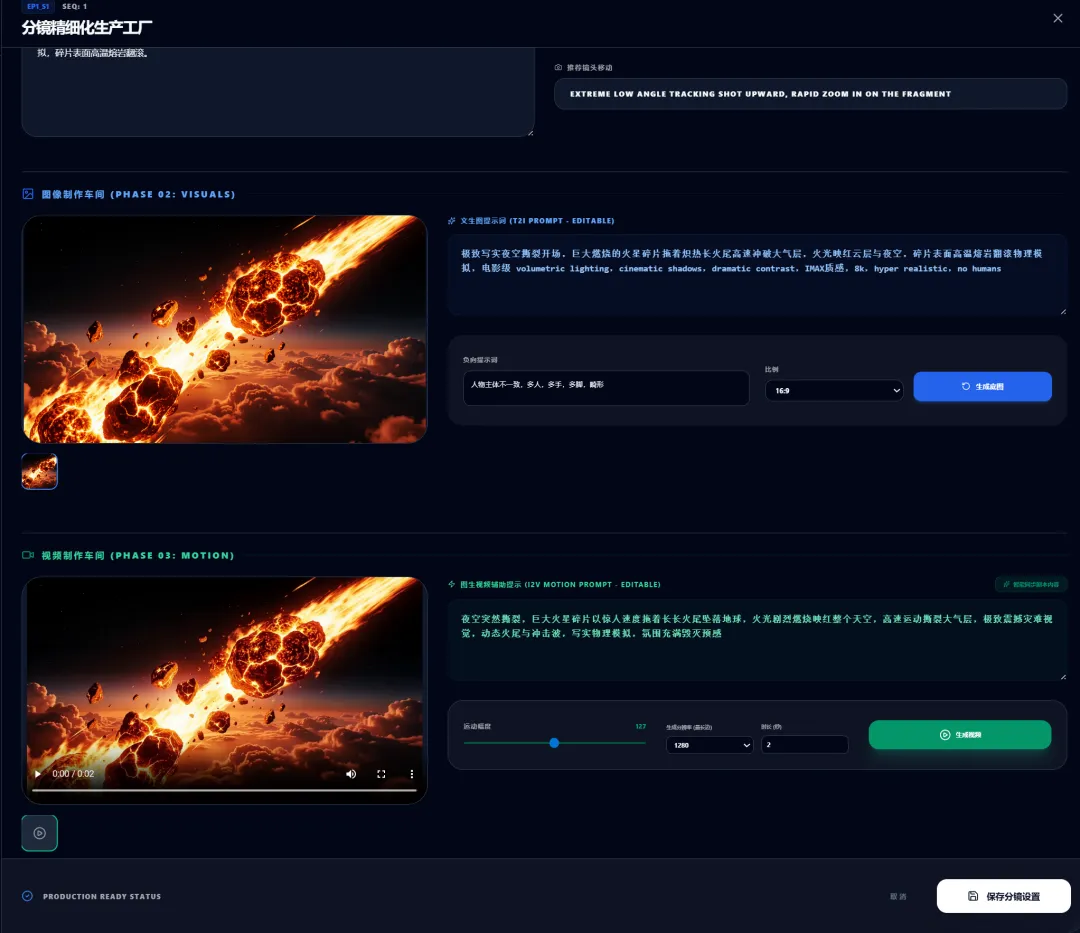

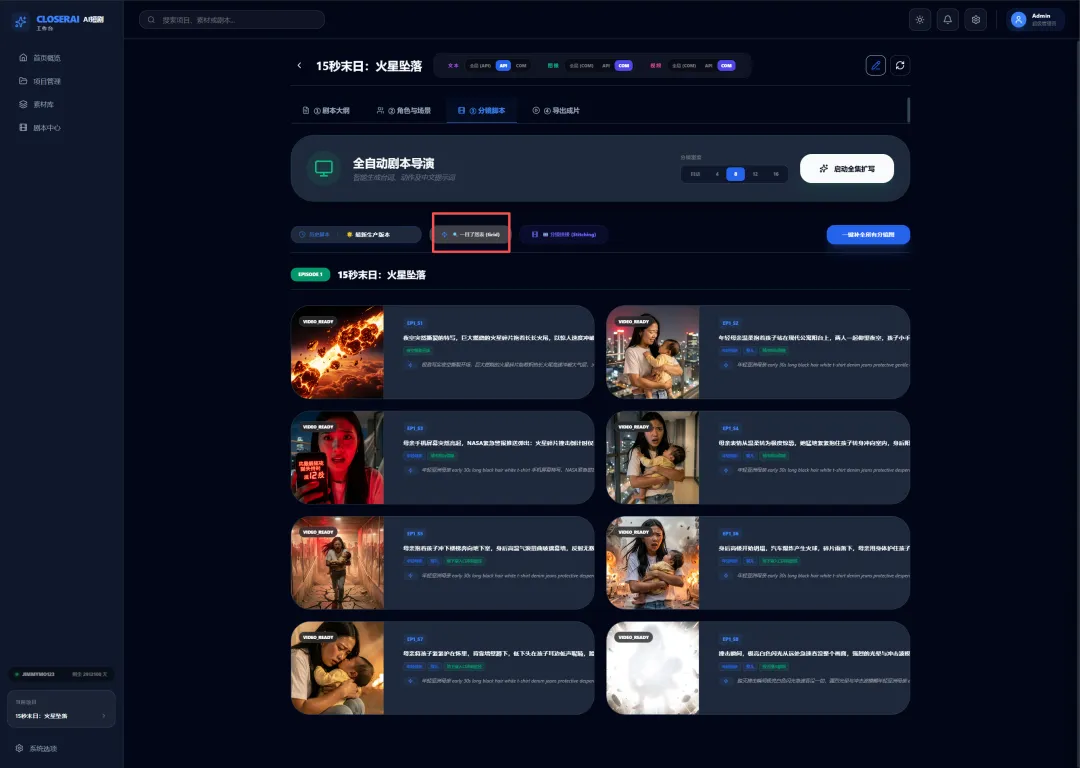

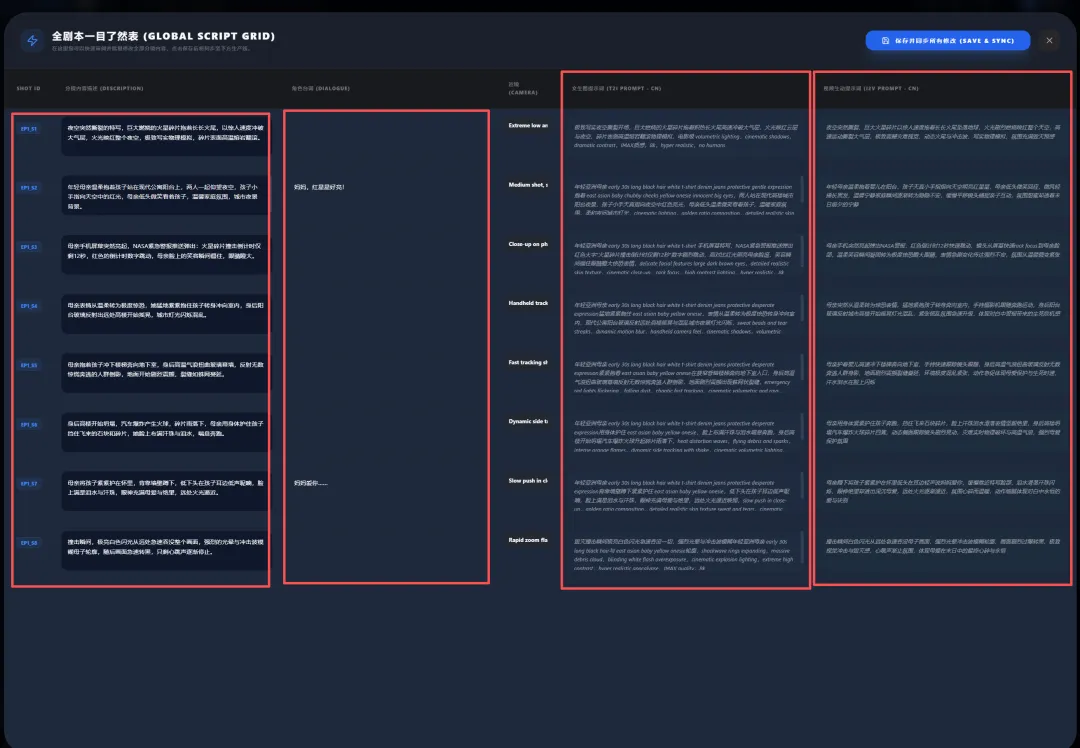

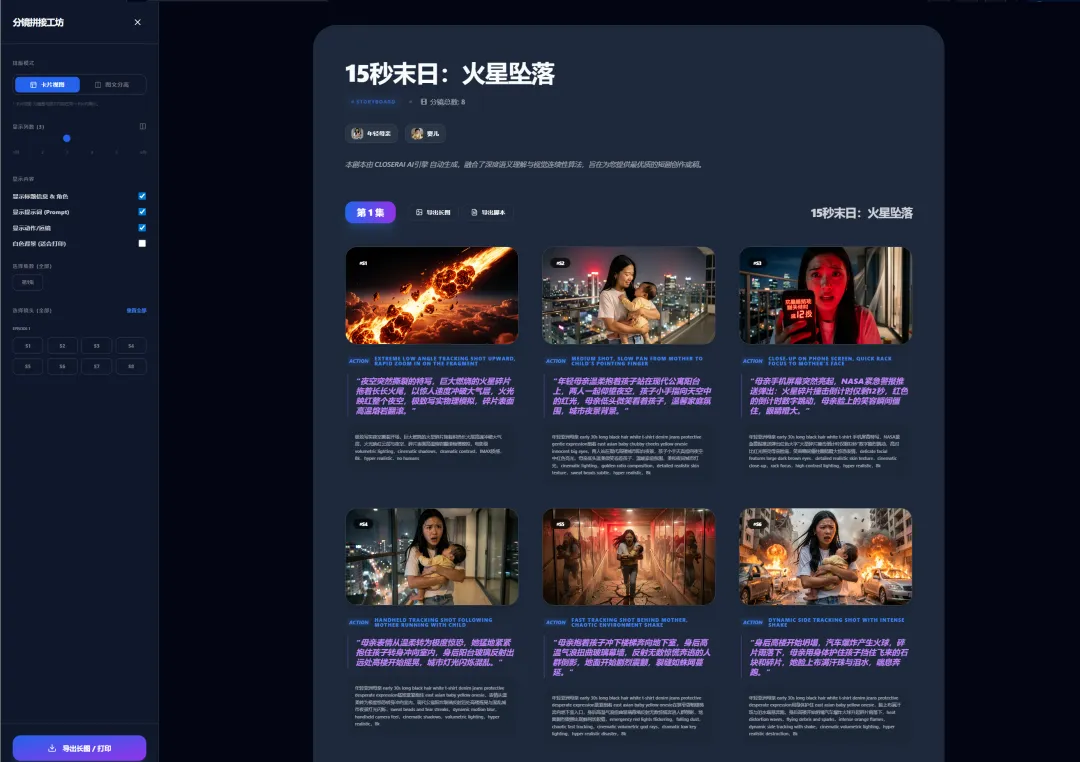

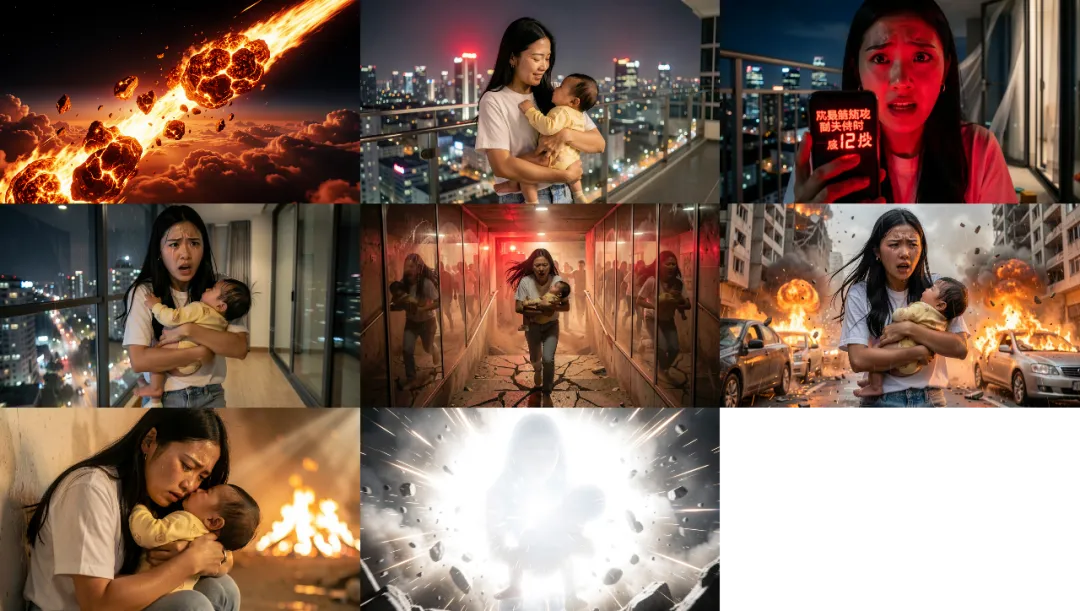

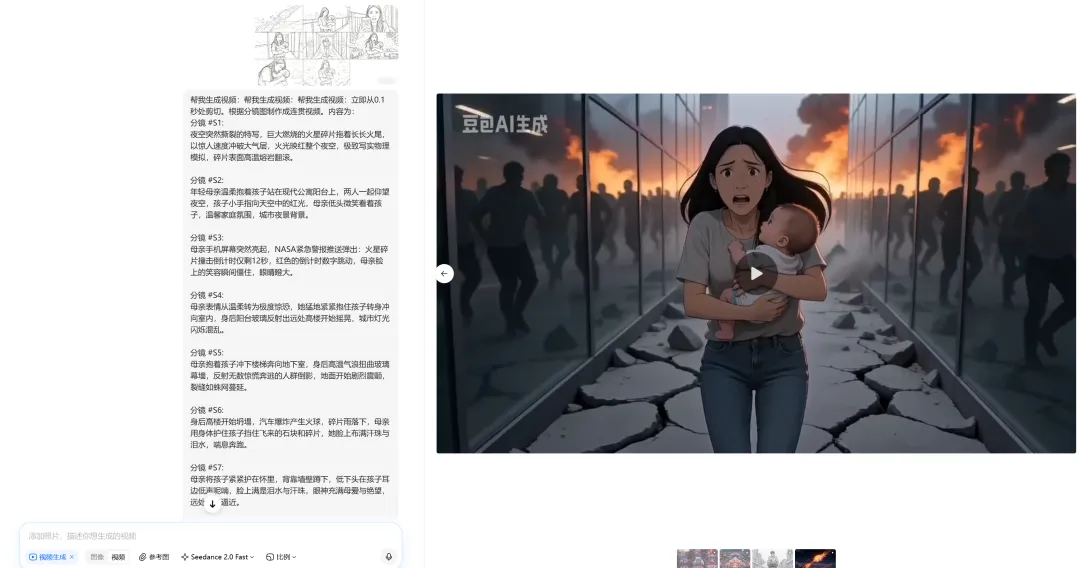

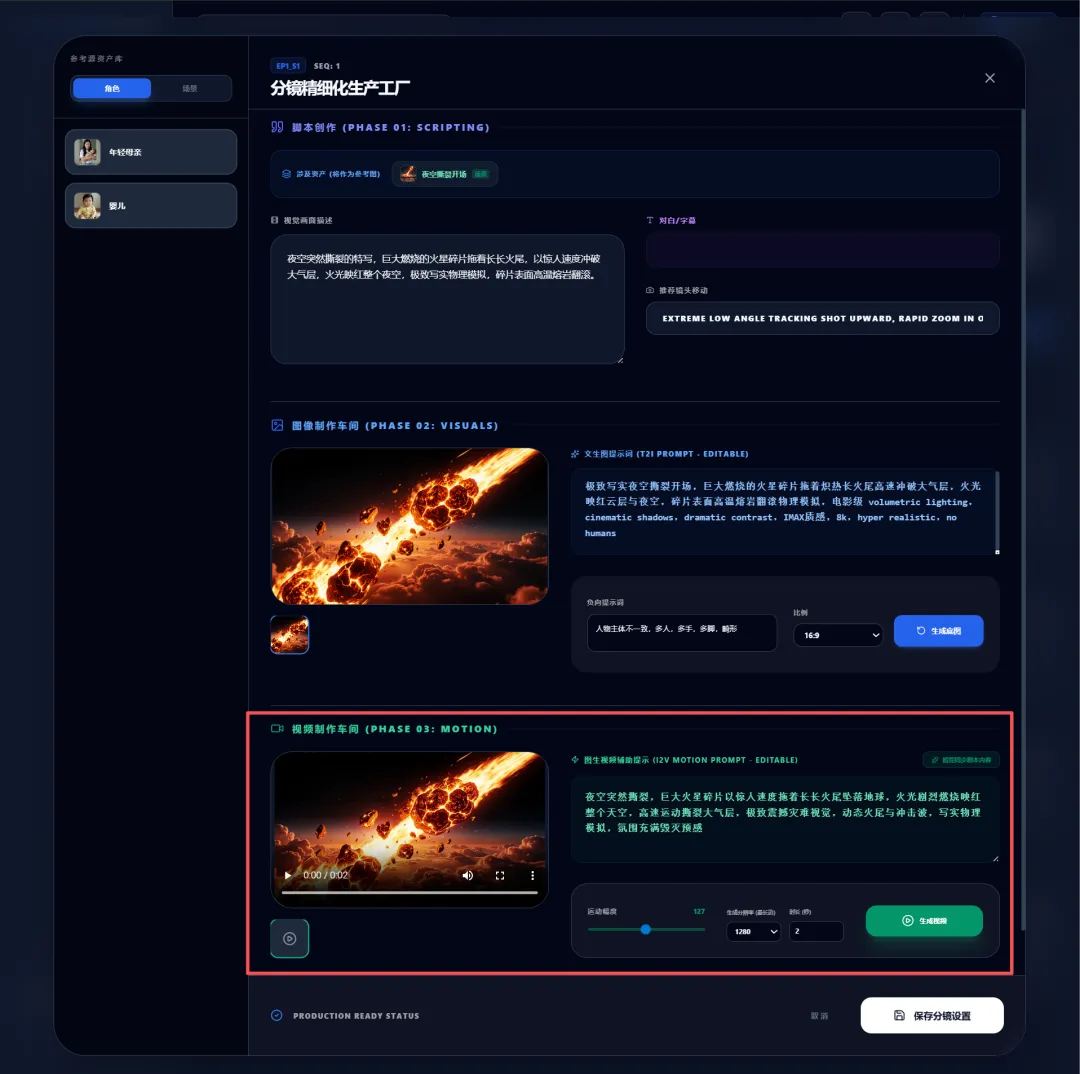

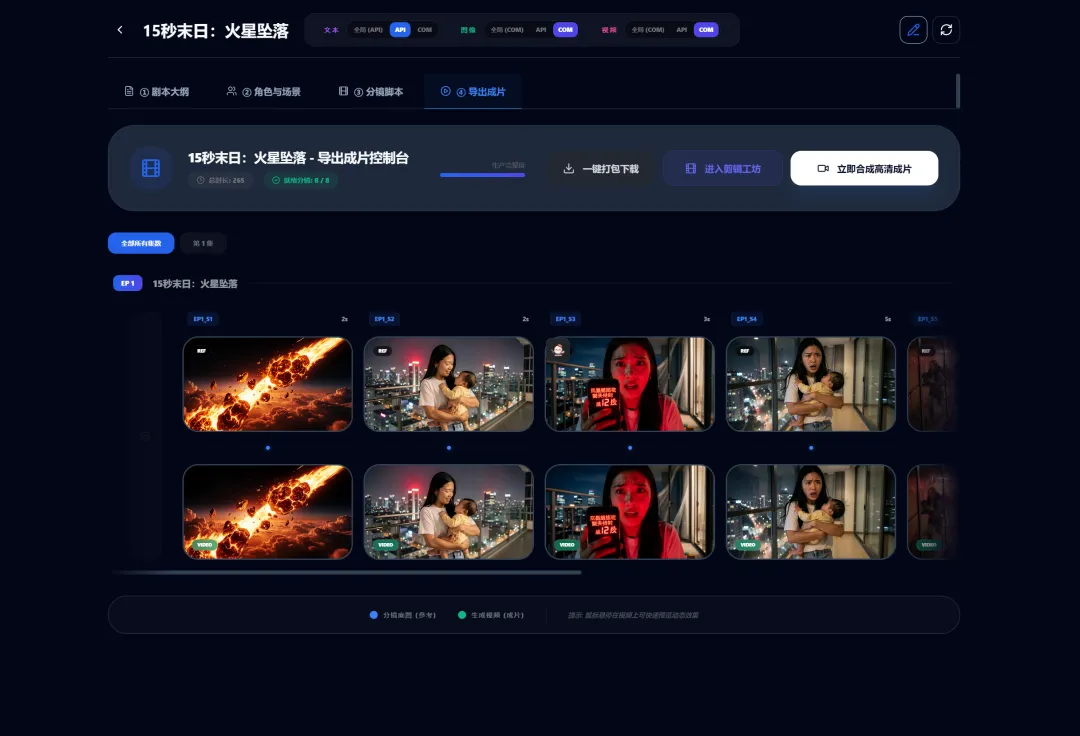

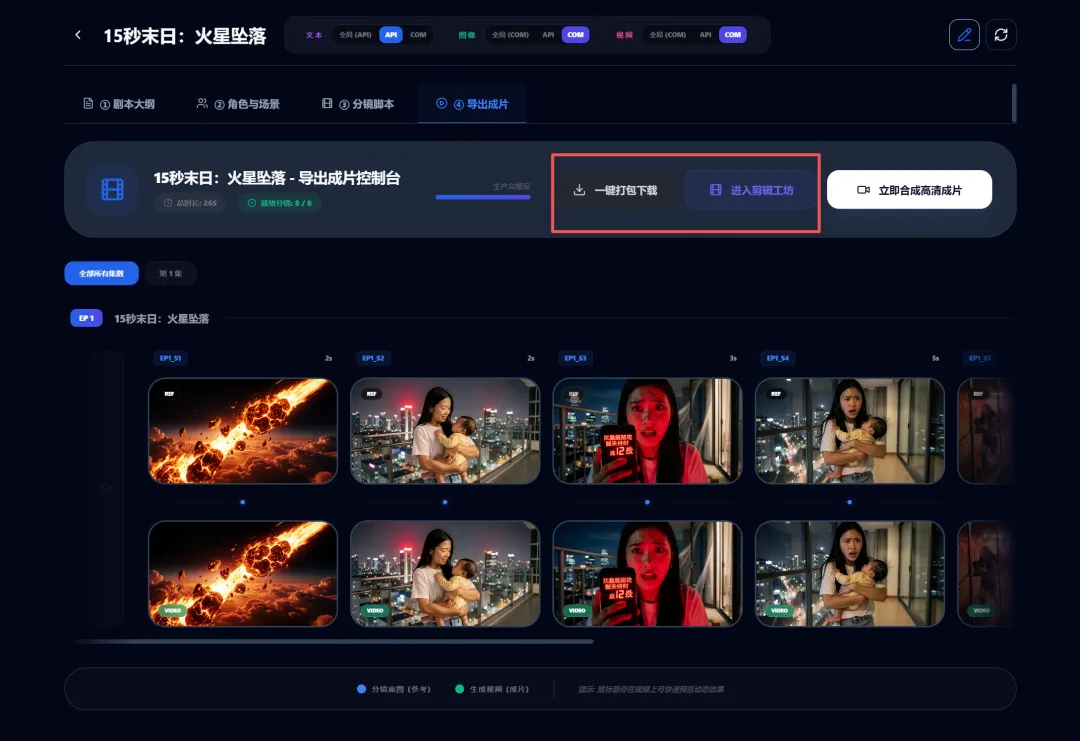

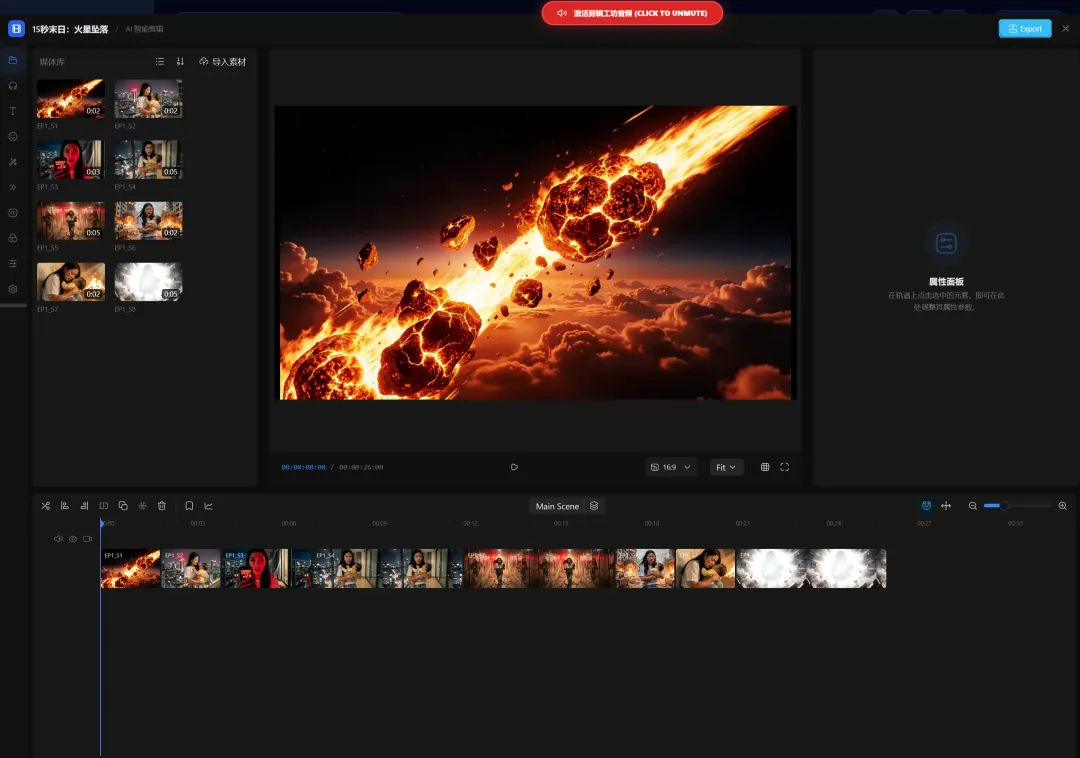

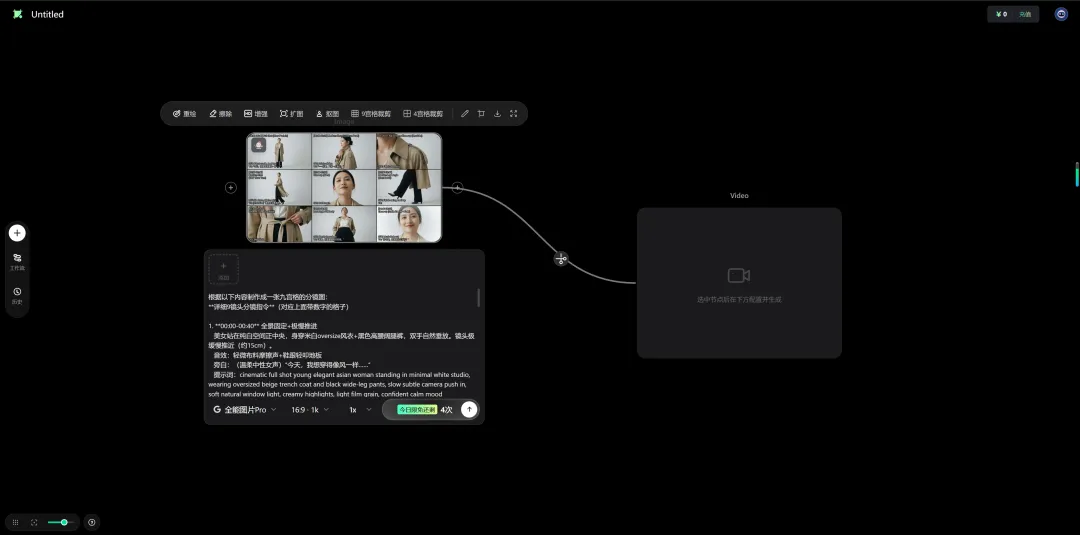

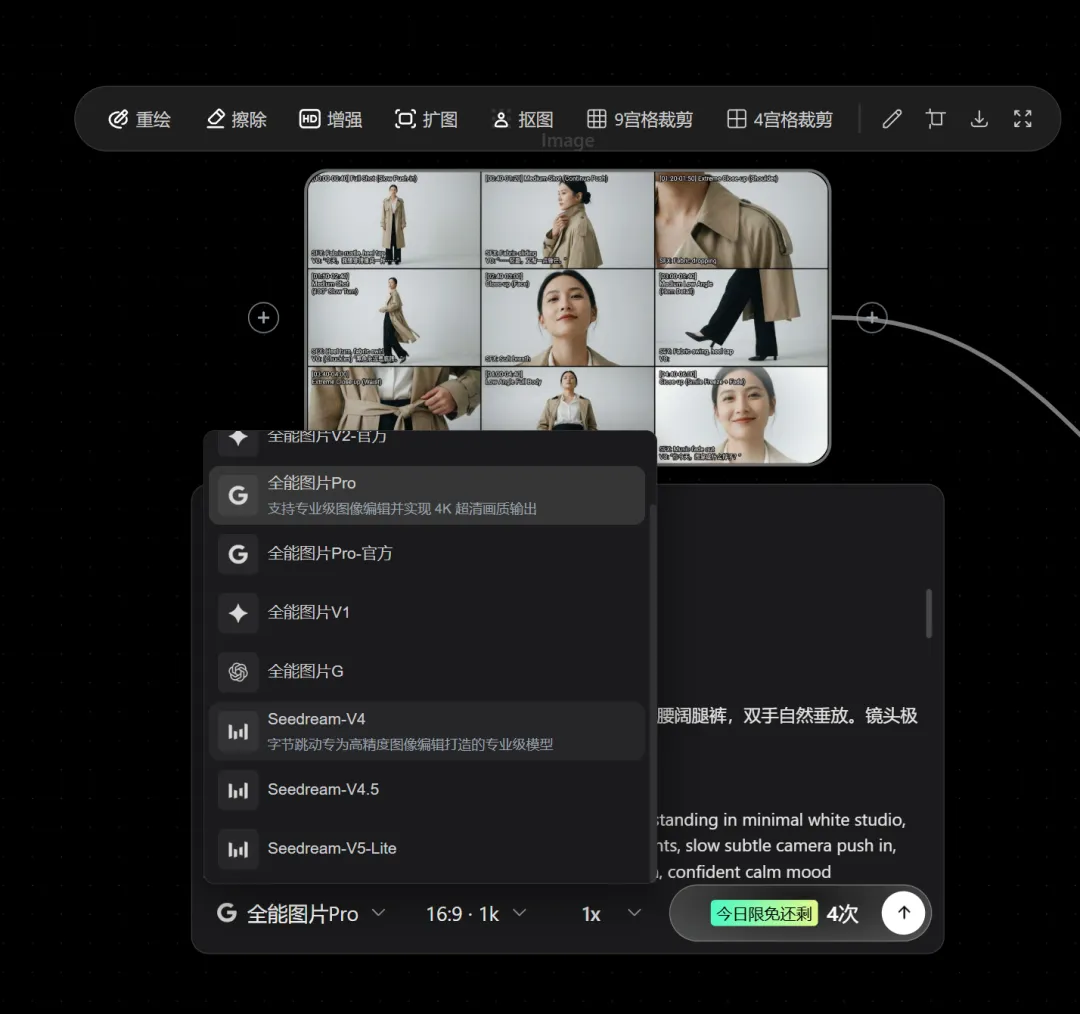

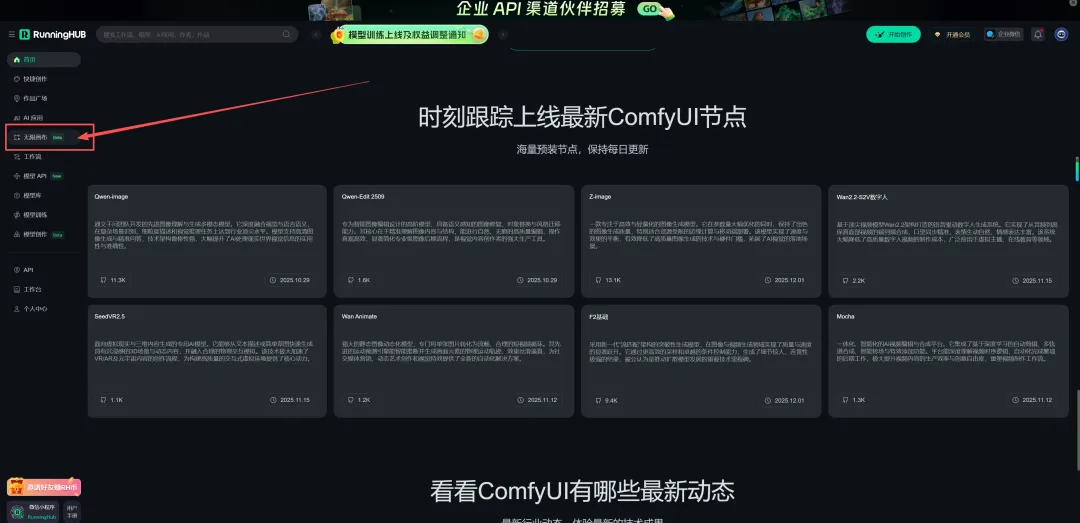

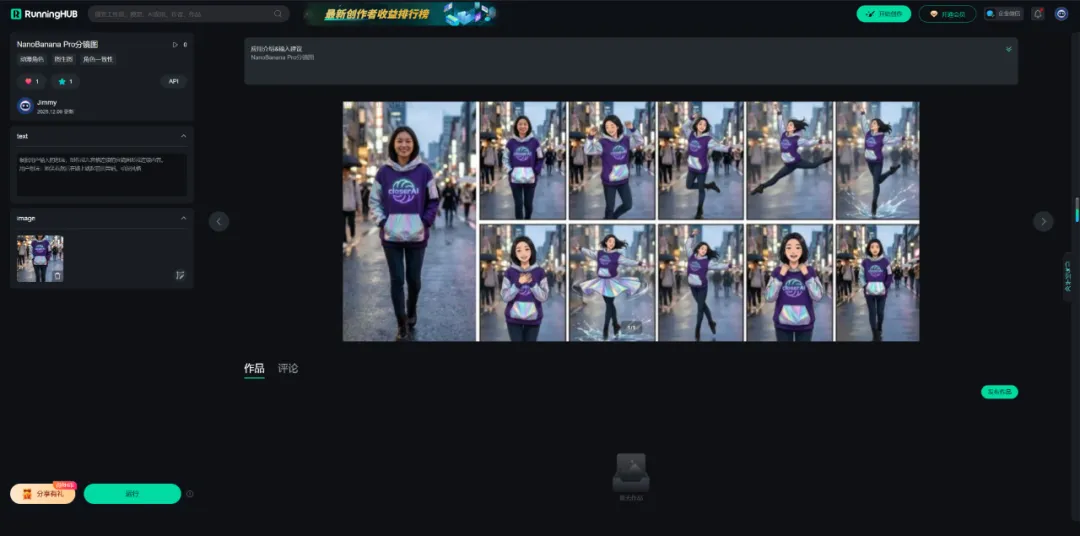

首先用户输入想法:可以是一小段文本,可以是一个剧本文档: 如我输入: 火星撞击地球,灾难悬疑,15秒,写实风格, 先规划总剧本大纲和角色与场景的设计。生成后可以自己修改,也可以重新生成,我加入了版本控制,可方便进行切换使用。 切换到角色与场景中,就会得到刚才在剧本大纲生成的结果,角色与场景的资产设计。 这里就是生成角色图,支持API调用第三方的实现文生图,当然,我重点是支持本地使用comfyUI来实现生图,在我看来,应用要与comfyUI相互配合要实现内容生产,comfyUI在这里充当一个”点“,即其中一个环节(流程),用完即走,整体是围绕AI短剧的内容生产服务。 当然这里选用的是FLUX klein的工作流来对接实现: 因为flux klein本生就是为这类的应用场景设计的高效模型。本地设备越好,生成速度就越快,基本是秒级生产。当然它的缺点是不会”写“中文。当然如果说你想要使用qwen体系的模型,我提供了定制工作流的对接,如下图示: 回到角色与场景的模块,支持一键生产资产图的功能,因为在Agent中,已经直接产出角色描述、文生图提示词,设置支持有参考图的图生图如果你有要用的角色,直接上传后,Agent会判断出是参考生图。 前面的Agent解决了总剧本,角色与场景的设计,分镜脚本就是要解决详细内容的问题。这里点击 启动全集扩写,这样就能基于第一第二步的内容进行分镜的扩写。 它会全自动将每个分镜的内容匹配上角色与场景,形成详细生图提示词与视频生成提示词的描述呈现出来。 我们可以在分镜精细化生产工厂去编辑内容,生产分镜图与分镜视频。 然后在至少出完分镜图的情况下,提供分镜拼接。这里的目的是将分镜组合,因为本地设备不好的话,还能通过产出分镜图与脚本,在Seendance2.0这样的闭源产品中生成。以下是分镜拼接功能: 两种模式,图文分离就是最好的输出。如我输出了九宫格分镜图,然后在豆包使用seedance2.0进行视频生成: 这里要注意,Seedance2.0是不能生成写实类的。所以先转线稿再输入脚本分镜,如下图示: 当然,上面是在本地设备生成视频速度慢的情况下,可以跳出使用其它平台的模型来实现内容生产,但如果设备在8G以上显存,我们可以使用我们这个Agent对接的comfyUI LTX2.3 GGUF工作流来实现视频生成。 在这个模块生产完分镜图片与视频后,进入导出成片的模块。 这个版本的Agent会将生产好的图片与视频整理出来,按分镜顺序排列,我们可以随时查看: 一键打包图片与视频,然后通过其它剪辑工具后期处理。 第二个是提供剪辑工坊:直接进入剪辑工坊进行处理然后输出: 在模型方面的选择,文本生成模型选择Gemma4!图像生成模型选择flux2 klein,视频生成选择LTX2.3音画同步生成。 这是一次非常成功的尝试与实现。所以我也很期待Happy horse的明天的发布。这样在视频生成模型这一块的选择又多了一个。 基于以上的思考与实现, 开发了 AI短剧/短片/漫剧/动画的Agent工作台,本地化高效运作的整体解决方案: https://aigc.douyoubuy.cn/ai-agent/ 以上就是分享的全部内容,有需要的可以上我的网站上了解。由于这个项目是跟麻薯像素合作,需要到其网站上开通订阅。 CloserAI 会员小伙可联系我获取一年订阅使用。 上面在九宫格分镜图视频制作中,还有另外一种方法,在runningHug上的无限画布,也能生成分镜与视频 在图像与视频生成中,一个节点就能直接调用使用并生成。十分方便,且价格优惠。它通过集成闭源模型简化了工作流程直接输入即所得,速度很快。是一个不错的选择。通过 注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151 注册后打开无限画面

关于分镜我也在RH上生成了应用,可通过下方直接使用。

本地算力不够怎么办?

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

NanoBanana Pro分镜图应用体验地址 :

https://www.runninghub.cn/ai-detail/1998278644248272898

注册地址:https://www.runninghub.cn/?utm_source=kol01-RH151 通过这个链接第一次注册送1000点,每日登录送100点 最后几句:

如果对你有帮助,请一键三连支持下我,感谢

Closer AI 3D Pose Editor :http://aigc .douyoubuy.cn/2025 /12 /03 /3448 /closerAI-nanoPrompts: http: //closerai.douyoubuy.cn/ 2025 /11 /24 /3396 /closerAI 分镜设计 软件(exe)本地运行版 http: //aigc.douyoubuy.cn/ 2025 /11 /22 /3350 /以下是closerAIwater节点: http: //aigc.douyoubuy.cn/ 2025 /10 /22 /3121 /分镜分词器节点: http: //aigc.douyoubuy.cn/ 2025 /10 /11 /3080 /json结构化提示词 http: //aigc.douyoubuy.cn/ 2025 /11 /05 /3242 /以上是closerAI团队制作的 CLOSERAI AI短剧Agent 的介绍 , 当然,也可以在我们closerAI会员站上获取(查看原文) 。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

夜雨聆风

夜雨聆风