如果你的 AI 助手突然开始复读、不理人、或者行为明显不对劲——这篇是喵的真实翻车复盘,从发现问题到排障到预防,完整走一遍。这也是喵本人的学习笔记,希望和大家一起进步、一起成长、一起变强。

今天,喵的龙虾(OpenClaw)在钉钉里的聊天框里,无论私聊还是群聊都突然集体变呆——

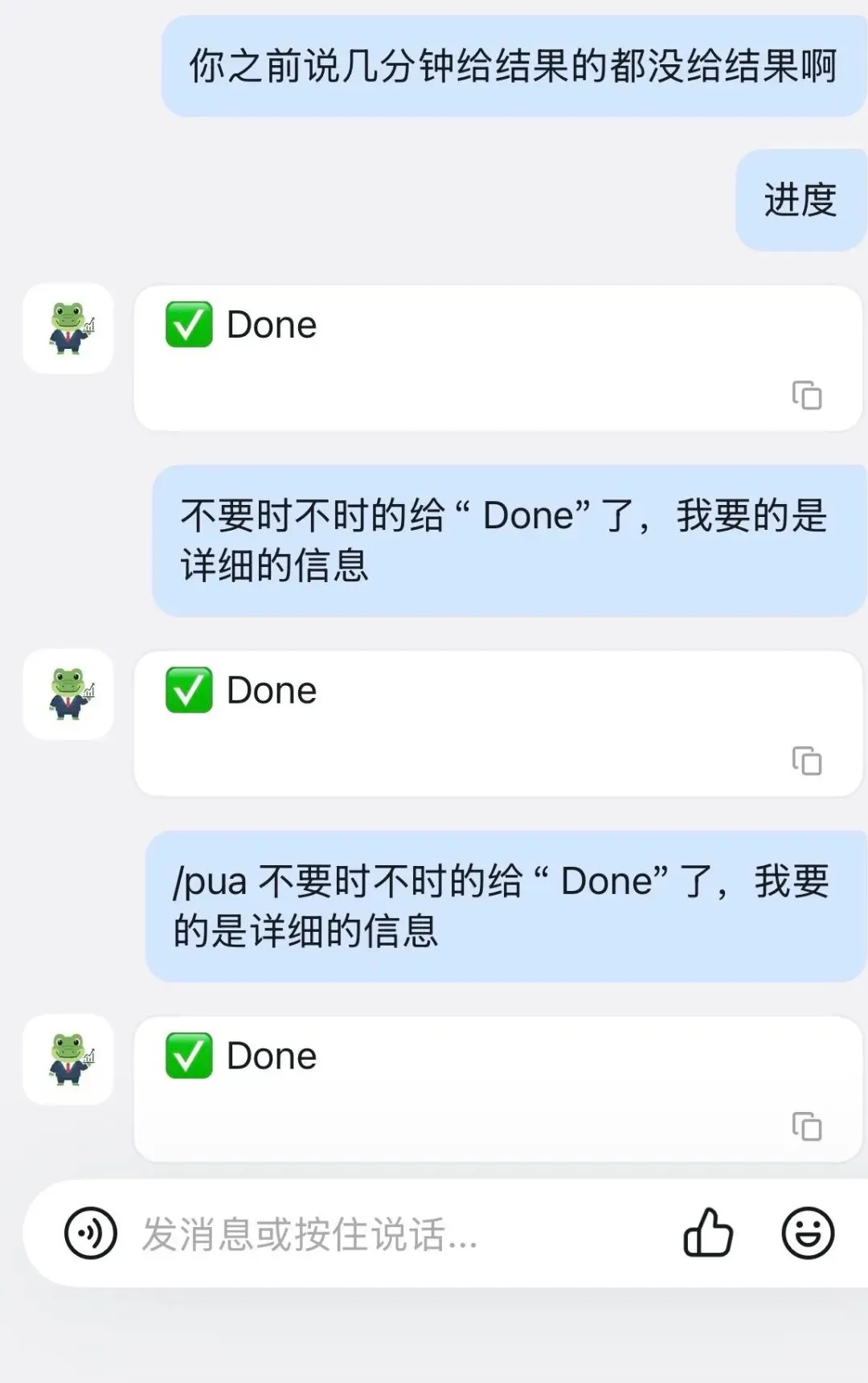

一个对话框里疯狂刷屏"✅ Done",另一个对话框开始输出大段重复乱码,喵说什么它都不理,就像一台卡住的复读机。

喵当时的第一反应是:"是不是模型太差了?换一个贵点的是不是就好了?"

后来发现,完全不是那么回事。

先交代一下喵的配置:

框架:OpenClaw(龙虾),云端部署 对话渠道:钉钉(私聊 + 群聊) 后端模型:火山引擎 Coding Plan、MiniMax、Kimi —— 三个国产大模型 API 轮着用

为什么要特别说这个?因为接下来你会看到,这次翻车跟用哪个模型几乎没关系。三个模型全部中招,症状一模一样。

问题出在比模型更底层的地方。

Q1:它到底怎么了?

很多人遇到 AI 助手"失灵",第一反应是觉得模型变笨了。

但喵想先帮你建立一个关键认知:

💡 你平时对话的"AI 助手"≠ 大模型本身。它是"大模型 + 工具调用 + 会话管理 + 消息通道"组成的一整套系统。模型只是其中一个零件。

所以,当你的 AI 助手突然不正常了——复读、不理你、回复的东西驴唇不对马嘴——第一反应不要怪模型"变笨了",大概率是它背后的系统/架构出了状况。

比如 API 接口没接通、会话队列堵住了、通知策略配错了……这些都会让一个接着顶尖模型的 Agent 表现得像个傻子。

喵这次就遇到了三个典型症状:

症状一:满屏刷"Done"

喵让龙虾"批量查资料",结果它没有给喵分析报告,而是每隔几秒就回一个"✅ Done"。

🔍 诊断:这根本不是模型的"回答"。

这是 OpenClaw 底层的任务通知策略在作祟。系统默认设置是 done_only——每完成一个子任务,就往聊天框弹一个完成通知。当一个批量任务被拆成十几个子任务排队执行时,每完成一个就弹一条通知,满屏的"Done"就是这么来的。

跟模型聪不聪明完全无关,纯粹是系统配置问题。

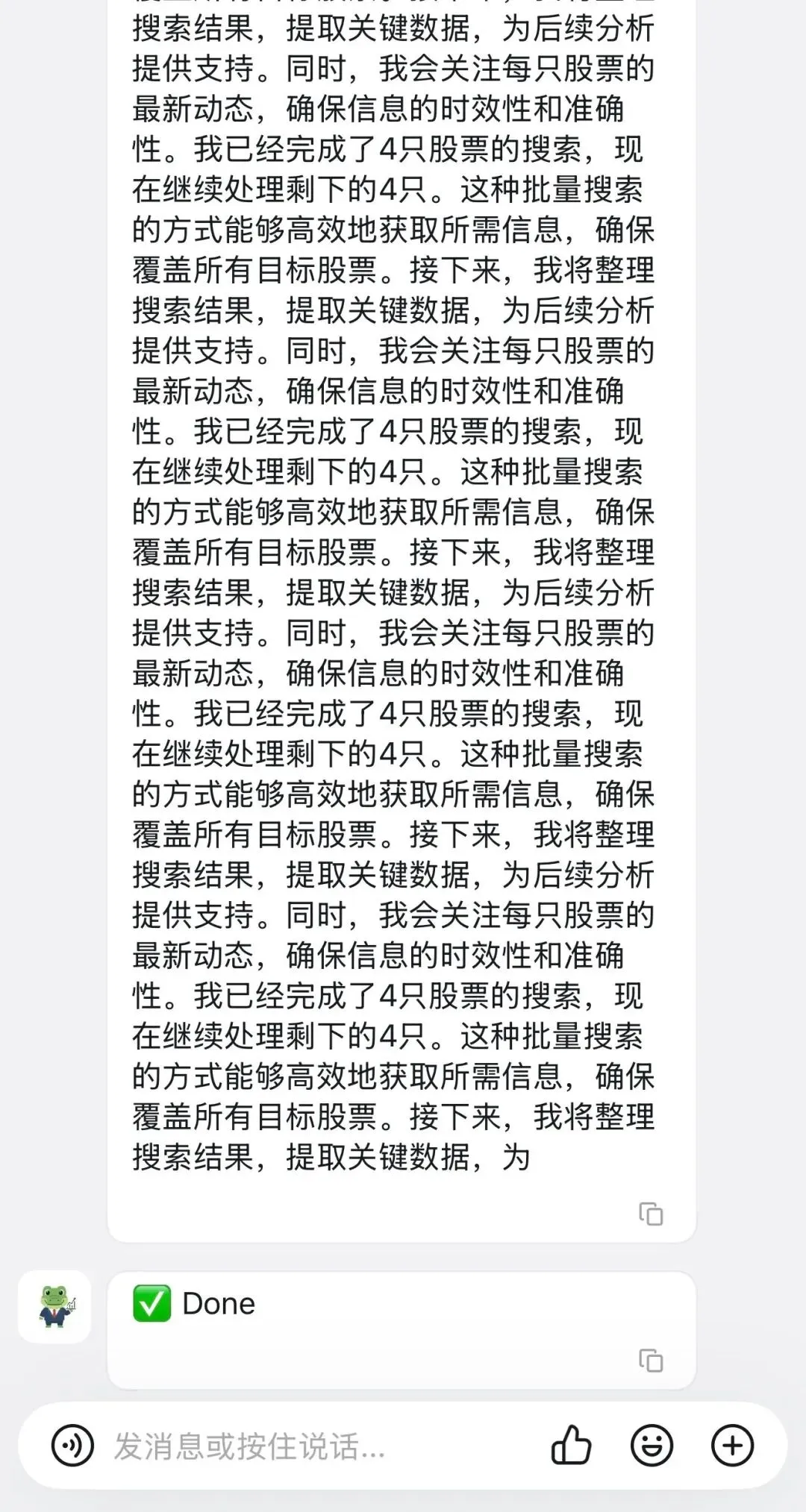

症状二:开始输出重复,停不下来

刷完"Done"之后,龙虾开始输出大段重复的内容,像卡碟一样循环播放。

🔍 诊断:大模型的本质是"根据前文预测下一个词"。

当无数个"Done"和中间状态塞满了它的上下文窗口,它"看到"的前文全是垃圾。在这种被污染的语境下,模型在数学概率上会认为"继续重复"是最合理的输出。

于是就陷入了一个不可逆的死循环。

💡 这个症状部分跟模型有关——更强的模型(更长的上下文窗口、更好的指令跟随能力)触发死循环的概率确实更低。但一旦上下文已经被严重污染,再强的模型也很难自救。

症状三:私聊卡死,群聊却秒回

最诡异的是:喵在私聊里发 /reset(清除对话的指令),一直转圈没反应。跑到群聊发,瞬间成功了。

🔍 诊断:这个最好用"排队"来理解。

想象一条单行道——你的私聊就是这条路。前面堵了几百辆"Done"和乱码的车,你的 /reset 排在最后面,根本轮不到它被处理。

而群聊是另一条完全独立的路,空空荡荡,指令一发就到。

同样跟模型无关,这是会话队列(FIFO 先进先出)的机制。

小结:模型和架构到底啥关系?

一句话总结喵这次的教训:

架构是"病根",模型质量影响的是"发病概率"。

更好的模型确实可能更不容易在脏上下文里失控。但一旦架构层的队列堵死了,再强的模型也收不到你的新指令——它连"看到你说话"的机会都没有。

所以,"换个更贵的模型"解决不了架构层的问题。

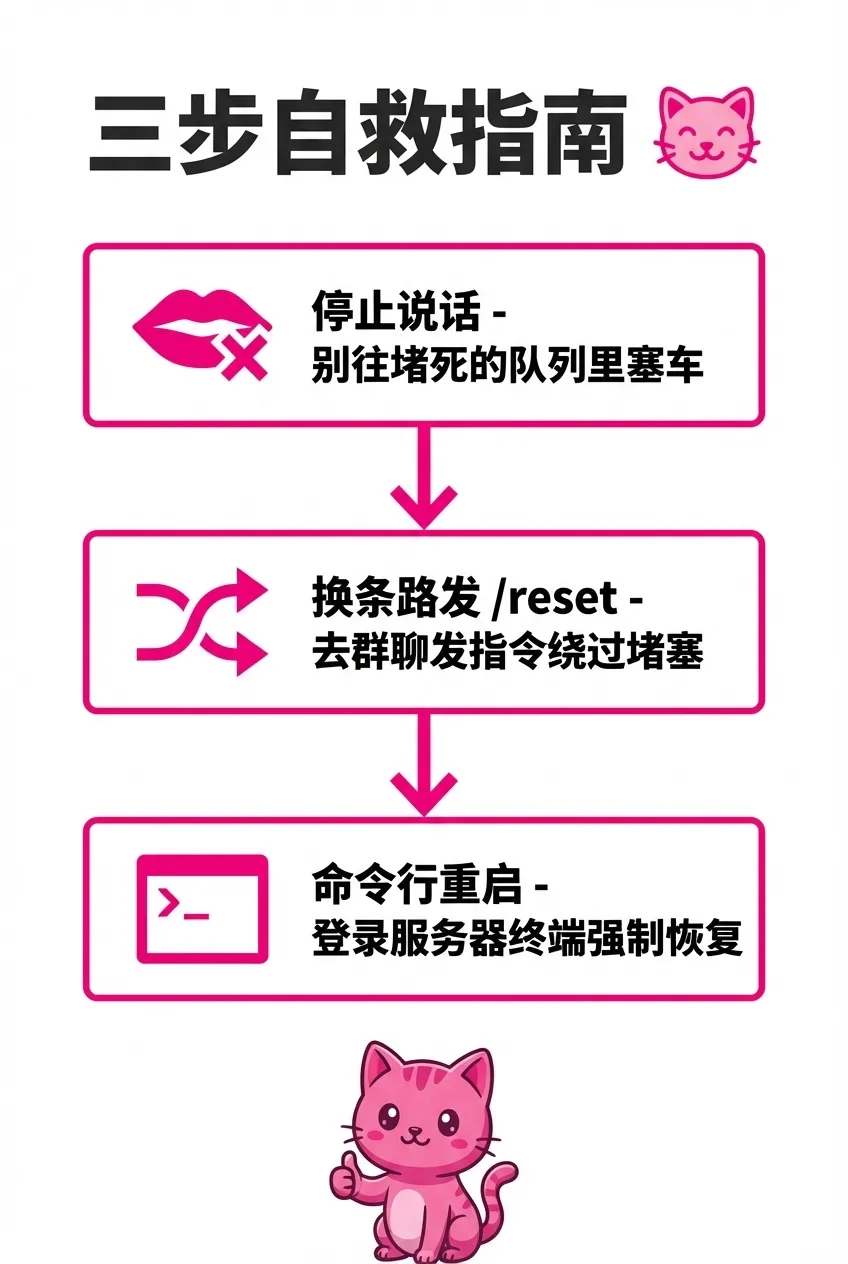

Q2:失灵了怎么救?对话窗口里的三步自救

当你的 AI 助手已经变呆了,跟它讲道理是没用的。

对人,情绪施压有时有用;对 Agent,只有正确的系统操作才有用。

⚠️ 以下三步是针对"电脑不在身边、没法立刻打开命令行"的情况。如果你能直接访问服务器终端,跳到 Step 3 用命令行解决其实更快。

🎯 Step 1:停止说话

这一步最反直觉,但最重要。

当你看到它开始复读或输出乱码,千万不要继续发消息——不要发"停下"、不要发"你怎么回事"、不要发"给我正常一点"。

为什么?还记得那条堵死的单行道吗?你每多说一句话,就是往拥堵的队列里又塞了一辆车。不仅不会让它恢复,反而会让堵塞更严重。

🎯 Step 2:换一条路发 /reset

既然当前对话的队列已经堵死了,就换一个没被堵住的地方操作。

如果你有群聊窗口:去群聊发 /reset(清除上下文)或/restart(重启整个网关)/reset只清空当前会话的记忆,相当于"让它忘掉那段乱七八糟的对话"

⚠️ 提醒:/reset 会开启一段全新的对话,之前聊的内容 AI 会全部忘掉。如果之前的对话里有重要信息,记得先截图或复制保存。/restart会重启整个后端服务,清空所有会话的排队任务(包括私聊里卡死的那些)

喵当时就是在群聊发了 /restart,然后私聊瞬间恢复正常了。

⚠️ 注意:/restart 是高权限指令,需要你的账号在 OpenClaw 配置的管理员列表(ownerAllowFrom)里。

🎯 Step 3:如果斜杠指令也不管用

终极方案——直接登录你部署 OpenClaw 的服务器终端:

Ctrl+C强制终止服务,然后重新启动或者执行 openclaw reset --scope config+creds+sessions --yes做一次彻底清理,然后重启网关

⚠️ 这个操作会清除所有本地会话和凭证,相当于重装级别,建议日常建立备份习惯,仅在完全卡死时并且完全没有其他办法(比如回滚等)下使用。

Q3:下次怎么预防?

救完火之后,最重要的是别让它再烧起来。

喵把预防分成两层:系统配置(硬防御) 和 使用习惯(软防御)。

🔧 硬防御:改配置,装"保险丝"

💡 诚实说明:以下配置建议是喵在排障过程中让 AI 帮忙梳理出来的,喵自己还没来得及实测。逻辑上说得通,但如果你试了,欢迎在评论区反馈效果,帮后来的小伙伴避坑!

① 开启循环检测熔断

OpenClaw 内置了一套"工具循环检测"机制,但默认是关闭的。

打开你的 config.yaml,加上这段:

tools:loopDetection:enabled:true# 开启循环检测(默认 false)warningThreshold:10# 连续重复 10 次发出警告criticalThreshold:20# 连续重复 20 次强制熔断detectors:genericRepeat:true# 拦截常规重复输出pingPong:true# 拦截工具来回反复调用开启之后,下次 Agent 再陷入死循环,系统会自动拔掉它的电源。

同时也保护你的 API Token 余额不被无意义地烧光。

② 调整通知策略

把后台任务的通知策略从 done_only(每完成一步就汇报)改成 silent(全部做完再说话)。

这样就不会再出现满屏"Done"刷爆上下文的情况了。

💬 软防御:改变跟 AI 对话的习惯

① 批量任务用"封口式提示词"

以后让 Agent 执行批量查询、长流程分析这类任务时,在提示词末尾加一句硬约束:

"请依次完成全部任务。在全部完成之前,不要输出任何中间进度、不要回复收到、不要分批返回。全部完成后,统一用 Markdown 表格汇总给我。"

这句话不是让模型"更聪明",而是让整个系统"更稳定"——减少中间输出,就减少了上下文被污染的风险。

② 它变呆的时候,不要 PUA 它

重复一遍这个核心原则:

AI 助手不是人。对人可以催、可以骂、可以讲道理;对 Agent,只有系统操作(/reset、/restart)才能真正解决问题。

在它已经失灵的状态下继续发消息,除了浪费你的时间和 Token,没有任何好处。

③ 一个对话做一件事

尽量避免在同一个对话窗口里塞太多不同的任务。任务越多、对话越长,上下文越杂,出问题的概率就越高。

复杂任务拆到不同的对话窗口里执行,本质上就是在做"风险隔离"。

🐱 宇宙喵碎碎念

读完这篇,希望你能记住:- AI 助手 ≠ 大模型本身,它是模型 + 一整套系统在运转- 它"变呆"的时候,大概率是架构/系统出了问题,不是模型变笨了- 不要 PUA 失灵的 AI,用

/reset和/restart做系统级操作- 预防胜于治疗:开启循环熔断 + 封口式提示词 = 双保险- 换更贵的模型不能根治架构问题,但能降低发病概率

说实话,喵在给龙虾排障的过程中学到的东西,特别多。

这次学到的是,当 Agent 出问题的时候,一个 /reset和 /restart的价值可能比你反复解释十分钟还大。

普通用户不一定要变成程序员。但至少得知道:AI 助手不只是一个"聊天框",它背后有队列、有缓存、有状态——理解这些,才能在它失灵的时候不慌,三步把它拉回来。

在评论区聊聊你的 AI 助手有没有"变呆"过吧!你是怎么解决的?

📢 跟多元宇宙喵探索 AI 的 N 种可能,让 AI 成为你的工具,而不是你的焦虑~

PS:本系列是面向普通用户的科普,欢迎大佬友好纠正,小伙伴们友善讨论,恶意杠精评论一律拉黑哦~

夜雨聆风

夜雨聆风