当 AI 开始明码标价,真正的变化其实刚刚开始

中午好,我是轻松懂AI君。

如果你刚把上午的事忙完,想用一篇文章快速接住今天 AI 圈最值得看的变化,这一篇我陪你顺一遍。今天的信息量不小,但真正值得留下来的,不是“又多了几个新模型”,而是几条很清晰的线索开始汇到一起了。

一条线索是,顶级 AI 能力正在被重新定价;一条线索是,语音、可视化、音乐这些能力开始真正变成普通用户点一下就能用的产品;还有一条更硬的线索,是云厂商、算力厂商和基础设施公司,已经在用真金白银把下一阶段的门槛抬高。

换句话说,今天这波更新,不只是热闹,它更像是在提醒我们:AI 这件事,正在从“能不能做出来”转向“谁能把它卖出去、接进去、跑起来”。

第一件最值得看:AI 能力已经开始被重新分层定价

今天最醒目的消息,还是 OpenAI 推出的每月 100 美元 Pro 档。表面看,这是一次订阅升级;但如果你把它放到最近几个月的节奏里看,这其实是在重新划线。

以前大家讨论 AI 产品收费,核心问题是“用户愿不愿意付费”。现在这个问题已经慢慢变成了另一个版本:什么样的人,愿意为了更高频、更稳定、更深度的 AI 使用权,去付出更高价格。

这次 100 美元 Pro 的重点,不只是额度提升到 Plus 的 5 倍,也不只是促销期内最高能到 10 倍。更关键的是,OpenAI 已经不再把所有用户都放在同一个台子上服务了。高强度开发者、重度工作流用户、偶尔用一用的普通用户,正在被明确分层。

这意味着什么?意味着未来一段时间,AI 产品的竞争可能不只是“谁最强”,而是“谁最懂怎么把最强能力拆成不同价格带,然后卖给不同人”。模型能力正在商品化,工作流价值正在溢价化。

第二件事更现实:语音交互终于开始像“人话”了

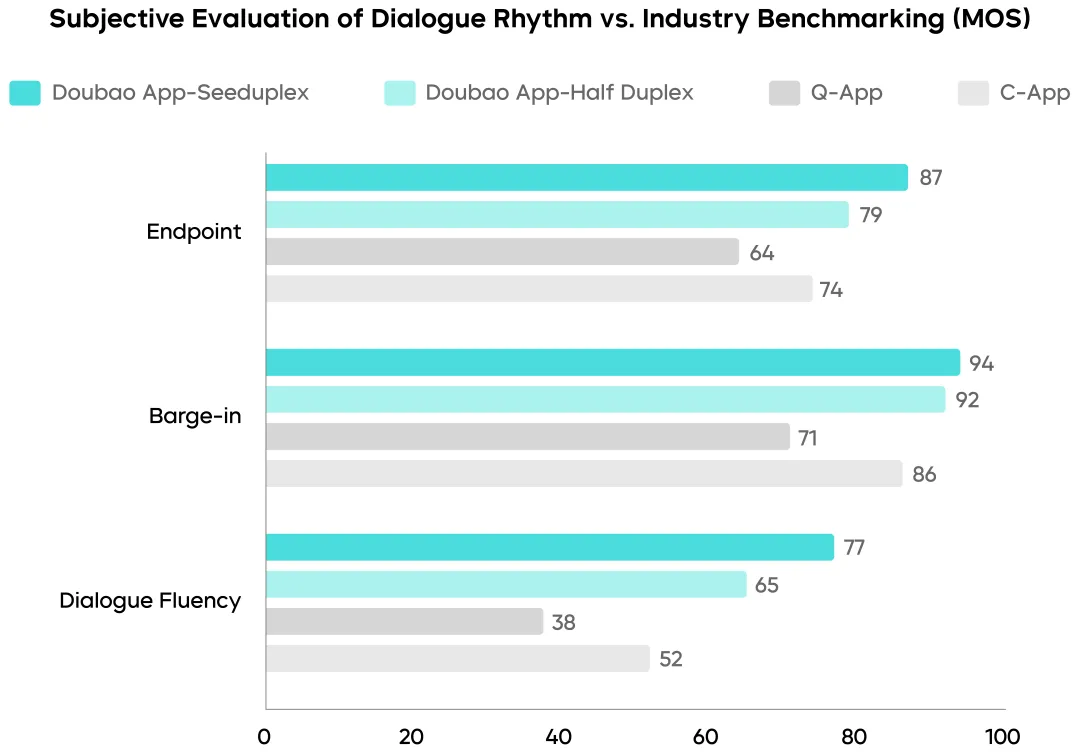

如果说价格分层讲的是商业化,那么 字节跳动 Seeduplex 讲的就是产品体验。它的重要性不在于又发了一个语音模型,而在于它把“边听边说”这件事,往真正自然的方向推了一大步。

过去很多语音助手最大的问题,不是听不懂,而是“不会等”“不会停”“不会看场合”。用户一句话没说完,它先抢答了;环境里有点杂音,它就误触发了。这类问题看起来小,但非常致命,因为它会直接毁掉人与机器对话时最基本的信任感。

Seeduplex 这次把误回复率、误打断率压下来,把判停延迟继续往下拉,本质上是在解决“对话节奏”这个更接近人的能力。这个点一旦做对,语音 AI 才有机会从“演示时很好玩”变成“我真愿意天天开着它”。

而且这次它不是停在实验室里,而是已经可以在 豆包 App 里直接体验。这个动作很重要,因为很多技术进展真正有价值,不在论文里,而在用户有没有机会形成习惯。

第三条线索已经越来越清楚:开发者工作台正在快速成熟

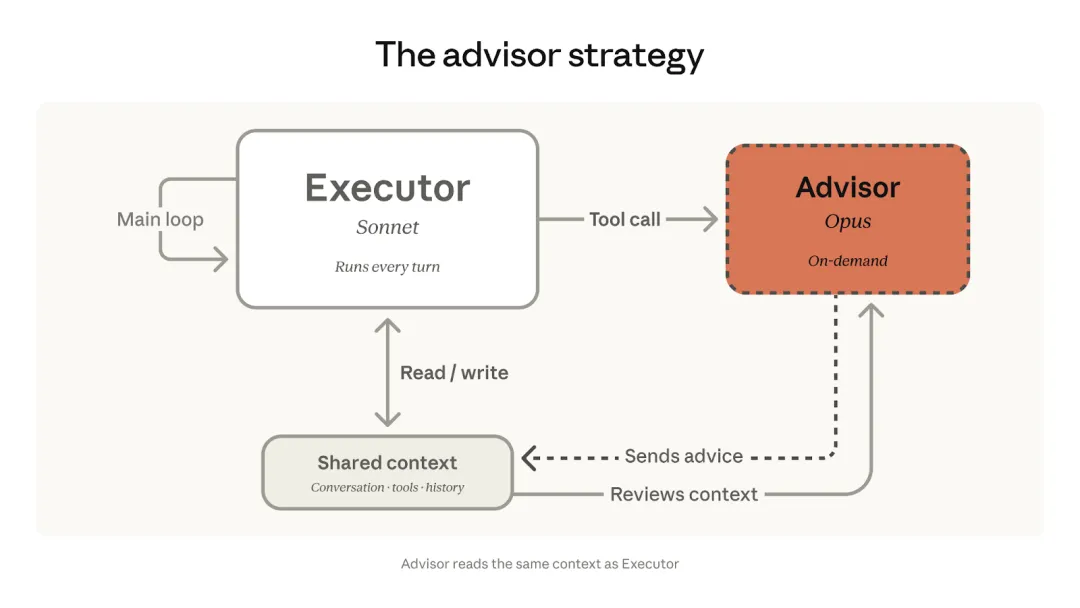

今天还有一组消息,我建议开发者一定要放在一起看:Claude API Advisor、Claude Code 的配置向导和监控工具、Codex 的 macOS 插件,以及额度重置这类运营动作。

单独看,每条都不算天崩地裂;但放在一起,你会发现一件很明显的事:AI 编程工具正在从“模型很强”升级为“工作台很完整”。

Advisor 的意思,是让更便宜的模型先跑,复杂决策再把最强模型叫出来。这不是单纯省钱,而是在告诉大家,未来主流 Agent 架构可能不是“一把梭最强模型”,而是分工、分层、分时调用。真正成熟的系统,靠的不是蛮力,而是调度。

而 Claude Code 新加的 Setup Wizard 和 Monitor Tool,又把另一个现实问题补上了:开发者不只需要一个会写代码的助手,还需要一个能搭环境、能盯后台、能少轮询、能真接入工程流的助手。工具是不是好用,常常不取决于它首屏 demo 多惊艳,而取决于它有没有把那些最烦、最耗时间的脏活一起做掉。

至于 Codex 这边,一边上桌面插件,一边继续调整额度,其实也在说明同一件事:AI 编程工具已经进入“既拼能力,也拼资源调度和产品运营”的阶段。好不好用,正在越来越取决于整套系统是不是顺手,而不是模型单点峰值有多高。

第四个变化离普通用户更近:AI 不只是回答你,它开始“演给你看”

今天 Google Gemini 连着两条更新,其实特别能说明下一阶段 C 端 AI 产品会往哪里走。

一条是可以直接生成交互式可视化和 3D 模型,另一条是把 Lyria 3 的完整歌曲生成能力放给免费用户。把这两件事放一起看,你会发现 Google 很清楚自己在做什么:它不是只想让 AI 会“说”,而是想让 AI 变成一个能生成可视对象、可试听内容、可操作结果的前端入口。

这背后是产品形态的变化。用户越来越不满足于“给我一段答案”,而是希望 AI 直接把东西做出来,最好还能让我拖一拖、转一转、点一点击试试。静态输出只是起点,交互式输出才更像下一阶段的默认体验。

更重要的是,当音乐生成这种能力都开始面向免费用户开放时,说明不少过去看起来很“高级”的生成能力,正在快速下探到大众层。很多产品的真正分水岭,以后未必是“有没有这个功能”,而是“谁把这个功能做得更顺手、更稳定、更愿意让人天天回来用”。

第五个值得盯住的方向:多模态知识库和开源模型继续往前拱

今天还有两类消息,不一定最热,但很容易在未来几个月里慢慢长出后劲。

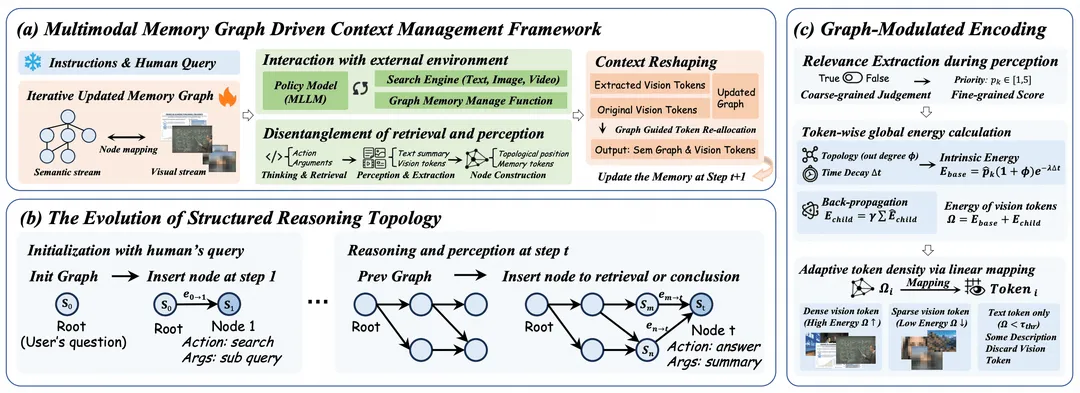

一类是 VimRAG 这样的多模态检索框架。它的价值不在于名字新不新,而在于它针对的是真问题。现实里的企业知识库,从来不只有文本,常常还混着截图、图表、视频片段、录屏材料。你如果还用一条线性上下文去强行拼这些内容,迟早会遇到检索混乱、状态丢失和推理绕圈的问题。

VimRAG 试图把这件事从“拼接资料”升级成“组织资料”,这背后其实是 RAG 从粗放时代往工程时代走的一步。以后真正有价值的知识库,不会只是“能搜到”,而是“能在复杂材料里稳定推理”。

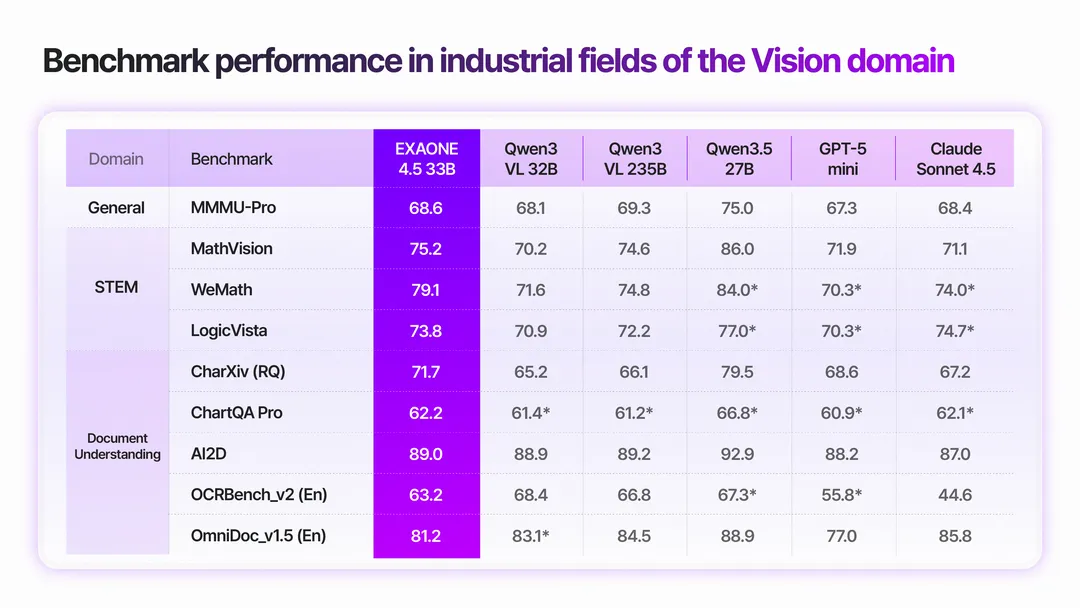

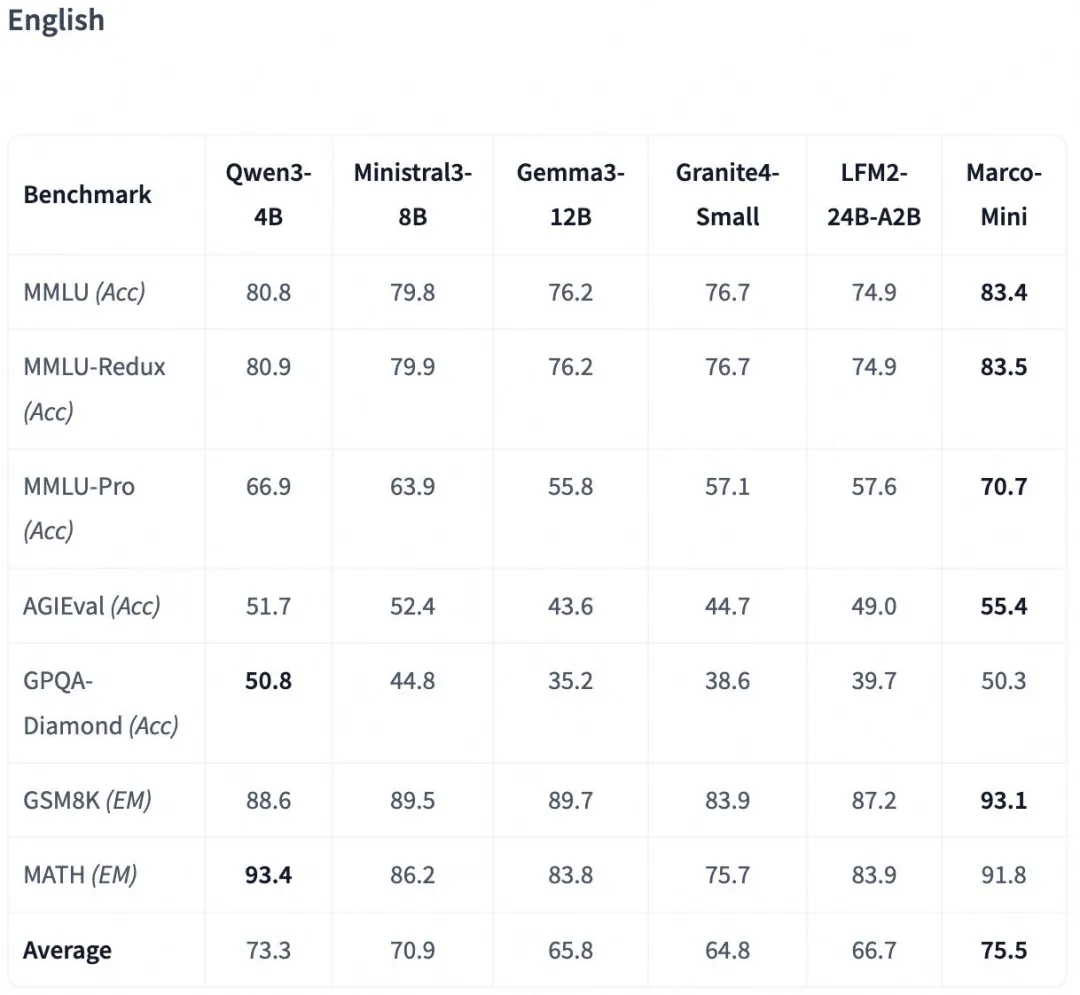

另一类是 EXAONE 4.5、Marco-MoE 这类开源模型。它们未必会在大众舆论里抢走最多注意力,但它们不断把视觉理解、多语言、稀疏推理这些能力往开源生态里推。等这些能力继续沉淀几轮,很多团队做垂类产品、做私有化、做区域化市场时,会比现在更从容。

最后一层别忽略:基础设施价格和资本动作,正在悄悄决定未来门槛

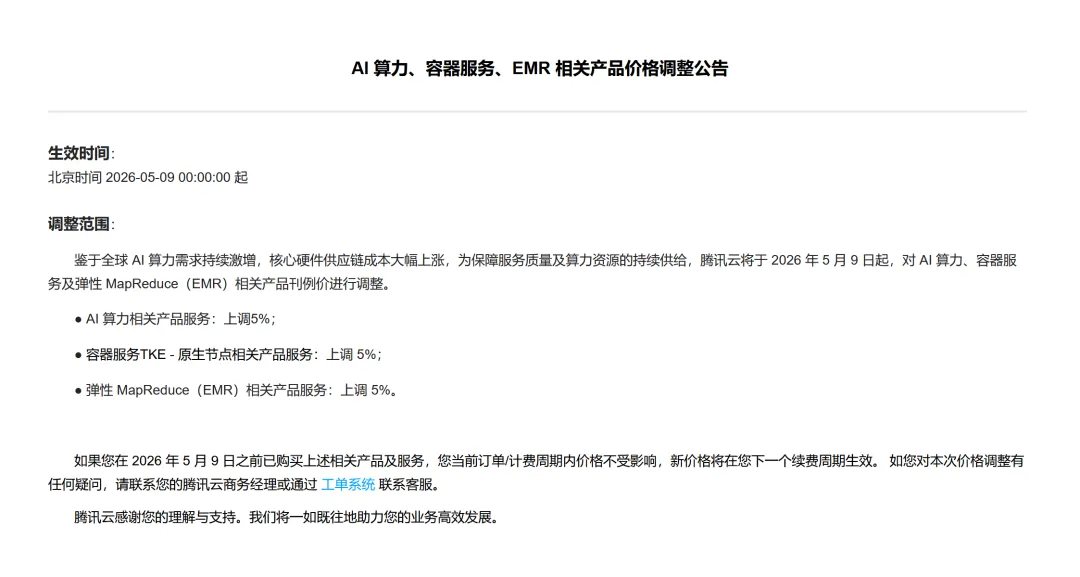

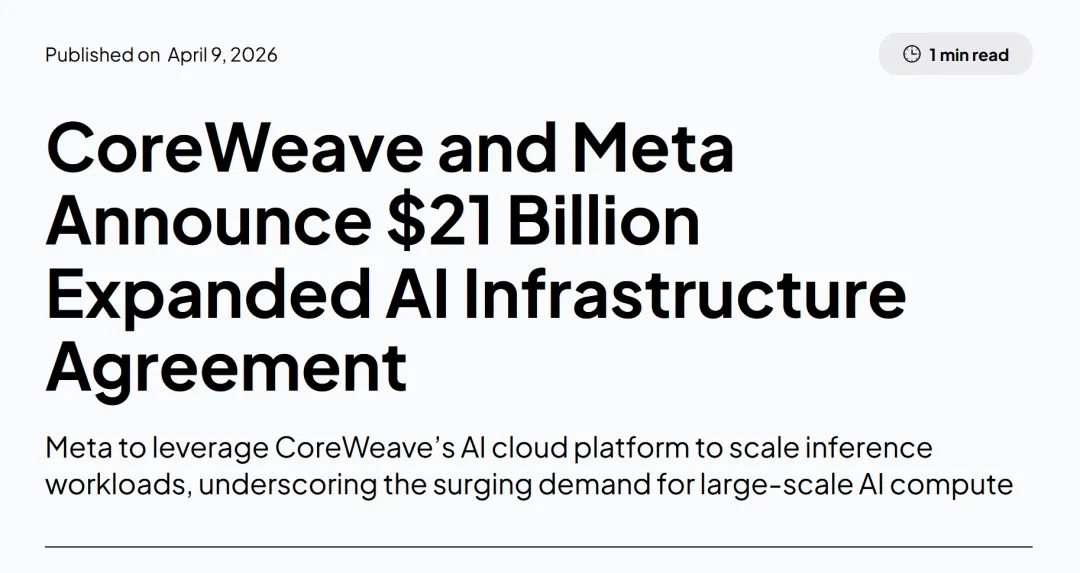

如果你只盯着模型和产品,很容易漏掉今天另一组更“硬”的信号:腾讯云 上调 AI 算力相关产品刊例价 5%,Intel 和 Google 继续推进 AI 云基础设施合作,Meta 又和 CoreWeave 签下 210 亿美元 的扩展协议。

这类消息通常没那么炸,但它们决定的是未来行业能不能持续扩张,以及谁有资格持续扩张。

当云厂商开始涨价,说明算力需求不是“很热”,而是真的紧;当大公司一边签多年合作、一边锁定下一代芯片的优先部署权,说明顶层玩家已经不再把基础设施视为后台支持,而是直接视为竞争力的一部分。

说得再直白一点,AI 的下一阶段,门槛可能不只是模型团队多强,也不只是产品做得多顺,而是谁能更稳定地拿到卡、拿到云、拿到更低的成本结构。表面上大家还在谈功能,底层其实已经在抢管道。

如果今天只想带走 3 个判断

今天看完这些更新,我反而更强烈地感觉到,AI 行业接下来最残酷的竞争,可能不发生在发布会那一刻,而发生在发布会之后的每一天。

谁能把能力持续供给出去,谁能把价格、资源、体验和场景拧成一股绳,谁才真正有资格说自己站在下一轮周期的起点上。对普通用户也是一样,未来最值钱的未必是抢先知道了哪个新功能上线,而是你能不能更早看清:哪些能力只是让人兴奋一下,哪些能力真的会重写你的工作和生活方式。

夜雨聆风

夜雨聆风