❝从空域到机械臂,从 ROS2 到字节码小脑——OpenClaw 生态正在覆盖机器人的每一个“关节”。

文末有飞书群入口,欢迎加入讨论!

最近,我们的开源项目合集中新增了四个极具代表性的机器人/AI 项目:

AerialClaw:让无人机像「会思考的助手」一样飞(LLM + 原子技能) AgenticROS:一句话指挥 ROS2 机器人(AI 平台无关的接入层) CaP-X:当机器人策略变成「写代码」(Code-as-Policy 研究框架) RoClaw:给 AI Agent 一块「小脑」(20cm 立方机器人 + 6 字节电机码)

下面,我们详细导读这四个项目,包含项目地址、核心亮点、技术细节、快速上手路径

一、AerialClaw:空域具身智能,LLM + 原子技能

项目地址:https://github.com/XDEI-Group/AerialClaw

本仓库导读:external-projects/AerialClaw/README.zh-xbotics.md

为什么值得关注

无人机竞赛、毕设和户外实验里,常见痛点是:任务一变就要改脚本,环境稍复杂就难以泛化。AerialClaw 探索的是另一条路:不预设完整航迹,只定义能力边界;大模型读传感器、实时规划、动态组合原子技能——更像一个“会思考的助手”。

核心亮点(详细)

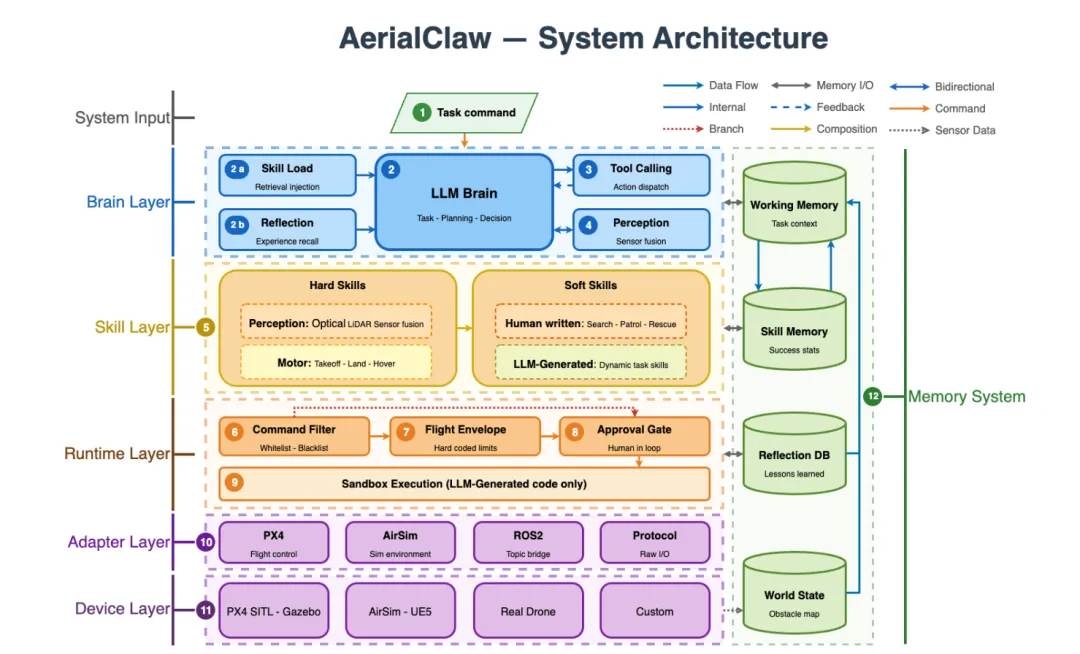

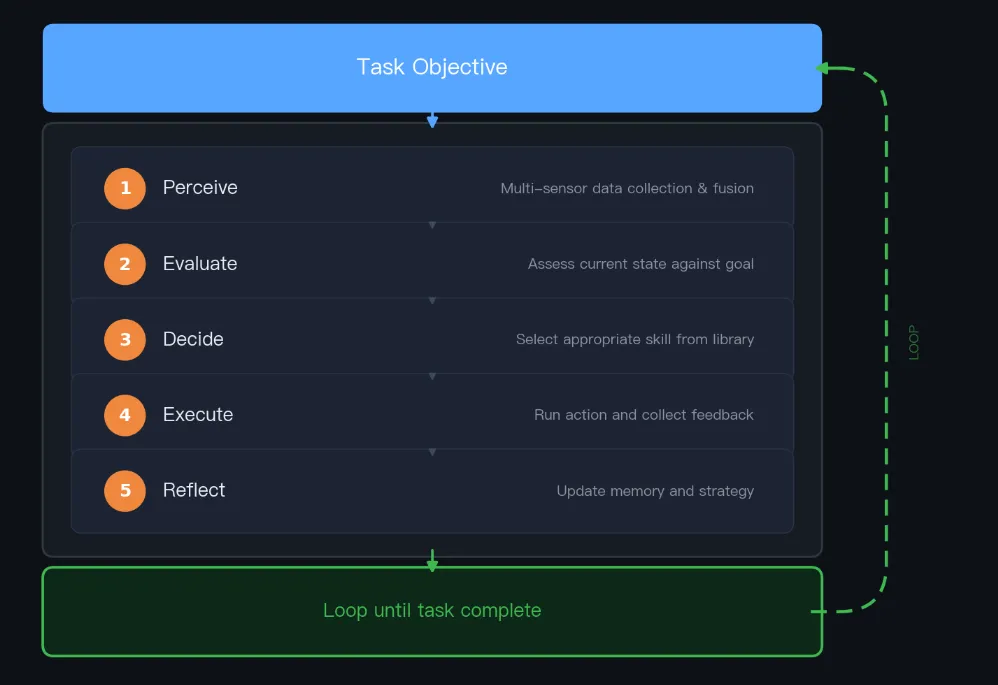

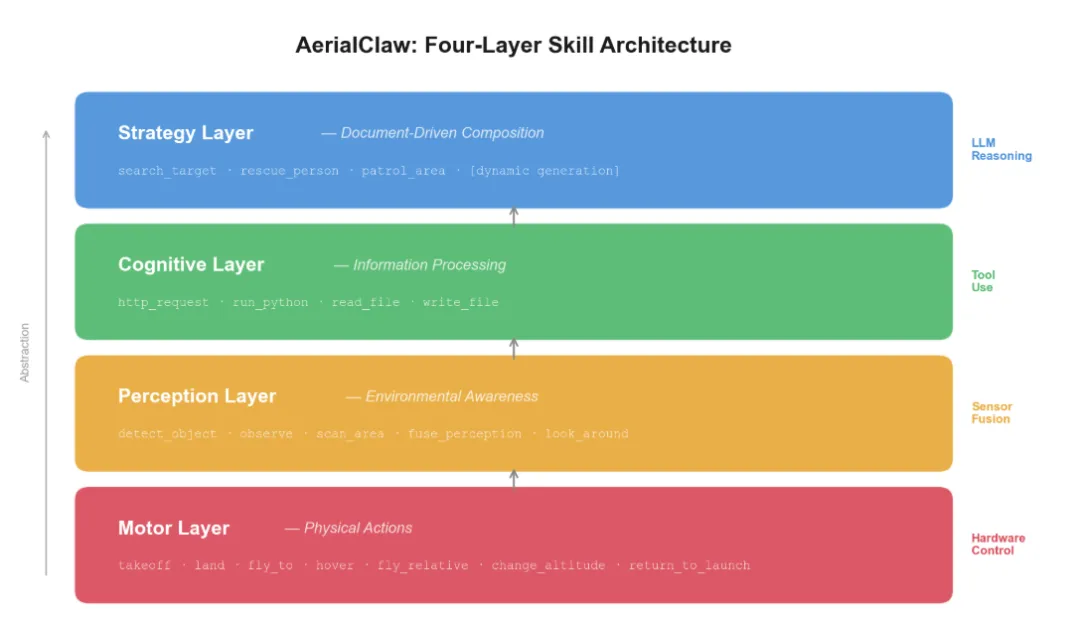

将起飞、悬停、导航、拍照、降落、状态查询等做成标准化“原子技能”。大模型在执行中根据语义化的传感器描述,实时规划调用哪些技能,而不是为每个任务手写全流程脚本。

每架无人机用多份 Markdown 文件维护认知状态:

SOUL.md:身份偏好、任务风格 BODY.md:机体参数、硬件边界 MEMORY.md:过往任务经验、成功/失败记录 SKILLS.md:技能统计、调用次数 WORLD_MAP.md:环境知识、语义地图

Agent 可以增量读写这些文件,实现个性化与经验积累。

硬技能:起降、定点飞行、感知、安全沙箱内 run_python、受控 http_request 等原子能力。 软技能:以 Markdown 策略文档存在(如区域搜索.md、巡逻.md、救援流程.md),LLM 读取后自主组合硬技能完成高层任务。系统还支持从反思中动态生成新软技能,把重复模式沉淀成文档。

后台持续融合传感器生成语义摘要;需要时再触发 VLM 做图像级分析(目标识别、场景理解)。模型可选云端 API(GPT-4V、Gemini)或本地部署(LLaVA、CogVLM),平衡延迟、精度与隐私。

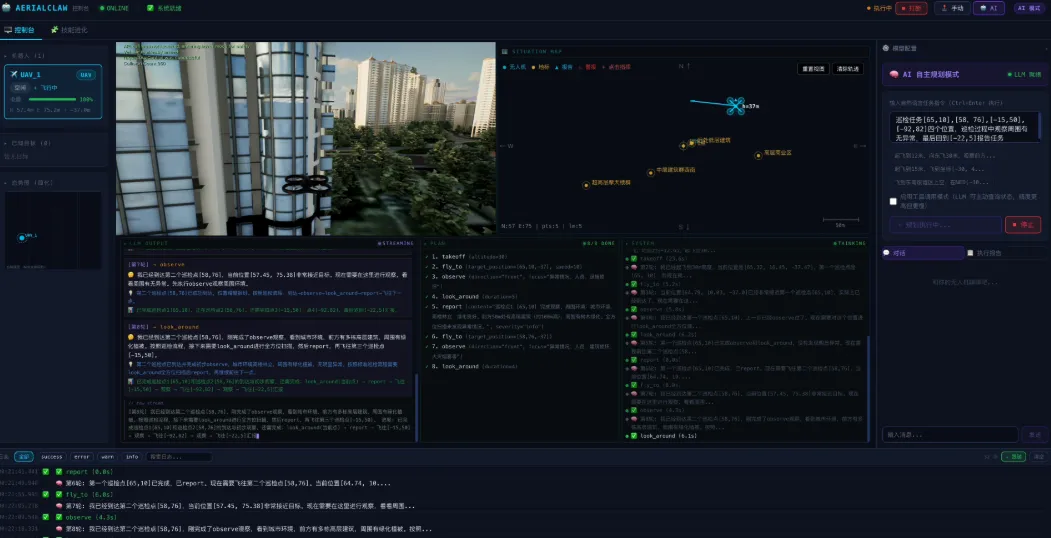

仿真栈:PX4 + Gazebo、OpenFly + AirSim(含城市场景、高楼间导航)。 Web 控制台:多视角图传、LiDAR 可视化、雷达图、手动/AI 模式一键切换。

真实部署时,人始终保留否决权。

地面 OpenClaw 强调“网关 + 工具/技能”,AerialClaw 在空域是“LLM + 原子技能 + 文档化状态”。同一套分层 Agent 思路,适合写进课程大作业的技术对比部分。

快速开始(摘要)

环境要求:Python ≥ 3.10,Node.js ≥ 18,CMake ≥ 3.22,Git。

步骤:

Bashgit clone https://github.com/XDEI-Group/AerialClawcd AerialClawpython -m venv venv && source venv/bin/activate<br>pip install -r requirements.txt# 参照 README_CN.md 的“快速开始”跑通一条仿真或控制台流程# 然后修改一条自然语言指令,观察 LLM 如何调用原子技能二、AgenticROS:与 AI 品牌解耦的 ROS2 接入层

项目地址:https://github.com/agenticros/agenticros

技能仓库:https://github.com/agenticros/agenticros-skills

本仓库导读:external-projects/agenticros/README.zh-xbotics.md

为什么值得关注

很多实验室已经用上 OpenClaw Gateway,习惯在 Telegram、网页聊天里下指令。下一步自然是:这些话怎样变成 cmd_vel、服务调用和多机命名空间?

AgenticROS 做的就是这件事——一套 AI 平台无关 的 ROS2 接入层:负责与机器人通信(rosbridge、Zenoh、本地 DDS、WebRTC 等),再用适配器把同一套能力暴露给 OpenClaw、Claude MCP、Gemini CLI 等不同入口。

核心亮点(详细)

已有 OpenClaw Gateway 的团队,只需将插件指向本仓库的 packages/agenticros 并按文档配置,就能把聊天句子落到 ROS2 接口上。插件还提供 HTTP 路由和遥控页面。

做课程演示时,可以同一台 TurtleBot3:一拨人用 OpenClaw 网页聊,一拨人用 Claude Code + MCP,还有人用 Gemini CLI——底层都是同一套 Core,便于对比“交互形态”而非重复造轮子。

packages/core:传输、配置 Schema(Zod)、共享类型——不依赖任何大模型厂商的 SDK。 packages/agenticros:OpenClaw 网关插件。 packages/agenticros-claude-code:MCP 服务器,终端或 IDE 里调 ROS2 工具。 packages/agenticros-gemini:函数调用直连同一套工具,无需 MCP。 ros2_ws/:消息定义、bringup(Gazebo/RViz/rosbridge)、discovery、follow_me 等。

多机或命名空间场景下,文档强调 robot.namespace 与话题对齐,减少“能连上但车不动”的经典踩坑。

docs/:架构、技能、机器人与 Zenoh、遥控说明。 scripts/:工作区初始化、网关插件注册、setup-openclaw-local.cjs(本地无 Token 开发)。 Gazebo + rosbridge 的启动表在 README.md 里按目标拆好了命令(如 rosbridge_gazebo.launch.py)。

典型数据流

Plain Text用户(消息 App)→ OpenClaw Gateway → AgenticROS 插件 → Core → ROS2 机器人快速开始

环境:Node.js ≥ 20,pnpm ≥ 9;ROS2(如 Jazzy);正在运行的 OpenClaw Gateway。

Bash git clone https://github.com/agenticros/agenticroscd agenticros pnpm installcd ros2_ws && colcon build # 构建 ROS2 包cd .. pnpm typecheck ./scripts/setup_gateway_plugin.sh # 注册插件到网关# 本地开发可运行:node scripts/setup-openclaw-local.cjs三、CaP-X:机械臂的 Code-as-Policy 研究框架

项目主页:https://capgym.github.io/

论文:https://arxiv.org/abs/2603.22435

项目地址:https://github.com/capgym/cap-x

本仓库导读:external-projects/cap-x/README.zh-xbotics.md

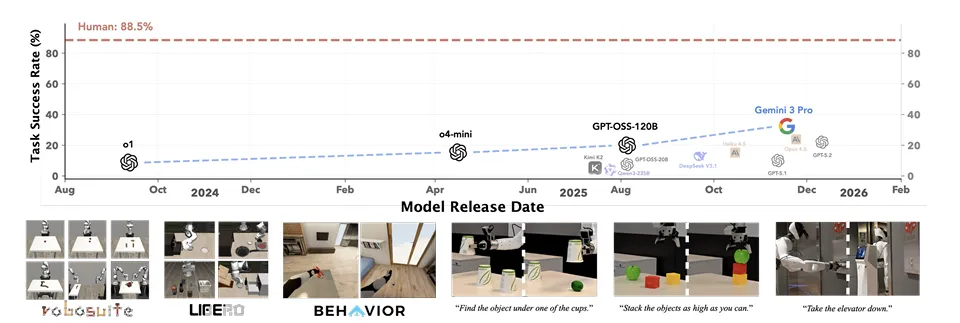

为什么值得关注

如果你在做机械臂操作、VLA / 代码生成策略或需要可发表基准,只会调 API 往往不够:你需要统一环境、分层评测、可对比的多轮交互。

CaP-X 把“写代码当策略”拆成 Gym 环境、基准、免训练智能体、RL 后训练四块,和 OpenClaw 路线在“可执行符号策略”上形成互补——一个是工程化 Agent 网关,一个是研究管线与论文配套。

核心亮点(详细)

组件 | 作用 |

CaP-Gym | Gymnasium 环境:智能体通过生成 Python 代码组合感知与控制原语;覆盖 Robosuite、LIBERO-PRO、BEHAVIOR 等任务族 |

CaP-Bench | 分层基准:单轮/多轮、不同抽象层级与视觉接地方式 |

CaP-Agent0 | 免训练多轮框架:视觉差分、技能库自动合成、并行集成推理等 |

CaP-RL | 用环境奖励对“写代码的智能体”做 GRPO 等后训练,并讨论 sim2real |

除仿真外,文档包含 Franka 真机 bringup(docs/real-franka.md)、RL 训练(docs/rl-training.md)、LIBERO / BEHAVIOR 任务专章,适合按“我要复现哪一张表”逐个点进去。

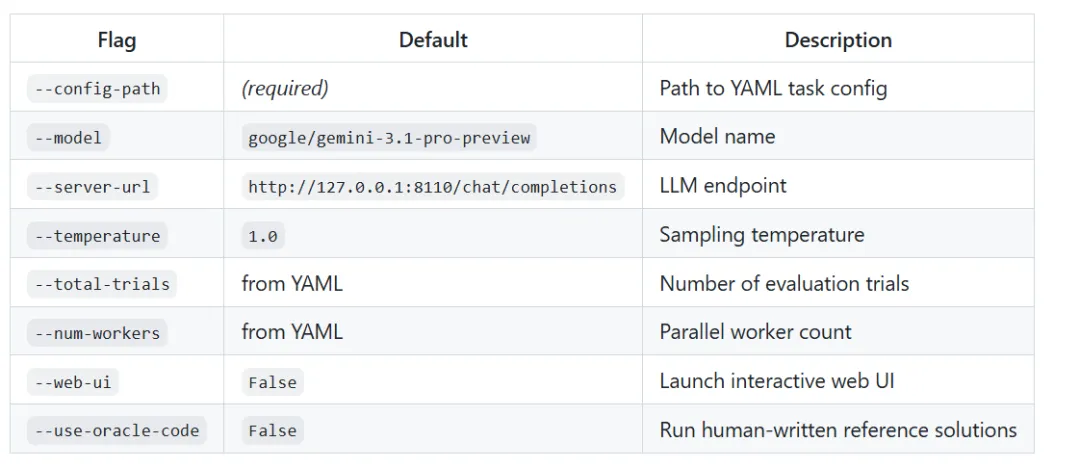

评测时常要 SAM、GraspNet、PyRoKi 等;项目支持 YAML 驱动自动拉起 perception servers,也可用 capx/serving/launch_servers.py 的 default / full / minimal 等 profile 预启动共享 GPU,对实验室多实验并行很友好。

通过本地 OpenAI 兼容代理(如 openrouter_server.py)接模型,配置集中在 docs/configuration.md,比零散脚本更易迁移到自己的密钥与内网推理。

capx/envs/launch.py 支持 --web-ui True,浏览器打开 http://localhost:8200 可看交互过程,适合做课堂演示或 Debug。

Robosuite 与 LIBERO 的 robosuite 版本会冲突,文档要求分虚拟环境安装(如主环境 Python 3.10,LIBERO 单独 .venv-libero)。这对新手是“防一周踩坑”的关键提示。

快速开始

前提:uv 管理依赖;Python 3.10;CUDA GPU;克隆时需 --recurse-submodules。

Bashgit clone --recurse-submodules https://github.com/capgym/cap-xcdcap-uv python install 3.10 && uv venv -p 3.10uv sync# 按 README 选择 robosuite OR libero OR behavior 之一安装# 配置 LLM 代理(如 .openrouterkey + openrouter_server.py)# 运行示例任务:python capx/envs/launch.py --config env_configs/robosuite/lift.yaml --web-ui True四、RoClaw:给 AI Agent 一块“小脑”

项目地址:https://github.com/EvolvingAgentsLabs/RoClaw

生态伙伴:evolving-memory(海马体)、skillos(前额叶)

本仓库导读:external-projects/RoClaw/README.zh-xbotics.md

为什么值得关注

大模型做机器人,常见瓶颈之一是:高层输出很漂亮,底层实时控制却拖不动——带宽、延迟、嵌入式解析成本都是真问题。

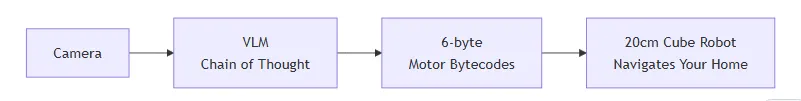

RoClaw 来自 Evolving Agents Labs 的三件套认知生态,定位是 “小脑 / 形体层”:约 20cm 立方、摄像头 + 步进电机,由 VLM 在闭环里输出极短电机字节码(例如 6 字节一帧),在 MCU 侧近乎零解析开销地完成运动。

核心亮点(详细)

Cortex(可与 OpenClaw 协同):输出任务级计划。 Cerebellum:根据当前图像做导航思维链,再编译为定长字节码。

学生可以清晰画出:谁在“想”、谁在“动”。

README 用同一条指令对比:

JSON 表示:约 58 字节 Bytecode 表示:6 字节

ESP32 上 memcpy 级消费 vs. 毫秒级 JSON 解析——这是很好的嵌入式+AI 课堂例子。

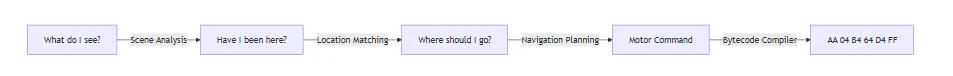

流水线包括:

Scene Analysis → Location Matching → Navigation Planning → Bytecode Compilation

并维护语义拓扑地图(节点为位置、边为可通行关系),把 Chain-of-Thought 落在可观测的室内导航上。

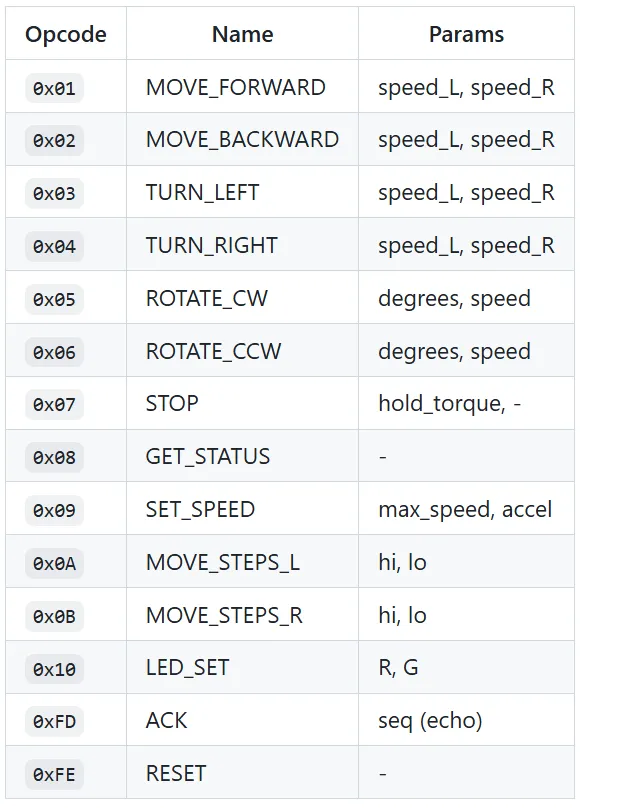

ISA v1.1:前进、转向、步进、LED、ACK、RESET 等 opcode。 V2:引入 8 字节帧(序号、ACK 标志等),且 decodeFrameAuto() 自动区分 V1/V2,兼顾兼容与可靠传输。

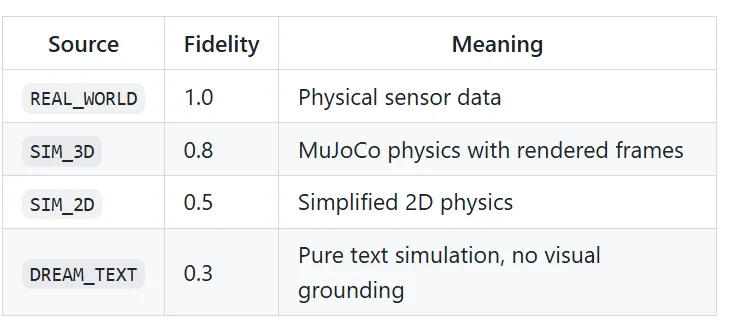

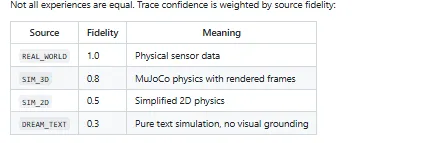

真实世界、3D 仿真、2D 仿真、纯文本 dream 等来源有不同 fidelity 权重。系统可先在低成本文本 dream 里试错,再在真实体验中抬高置信——和 RoClaw 的 trace、蒸馏管线(RoClaw-Distill)文档一起读,会看到完整数据闭环。

提供仿真环境(mjswan 等)和实体硬件桥接。若与 OpenClaw 联调,需对齐 HTTP/WebSocket 端口、鉴权与 skillos/memory 服务配置。

快速开始

建议顺序:

阅读 README.md 中的 mermaid 架构图与 ISA 表。 跑通仿真:cd simulation && python run_mjswan.py(具体命令见上游文档)。 若连接实体硬件,参考 roclaw_bridge.py 配置串口或网络桥接。 与 OpenClaw + evolving-memory 联调时,确保 memory 服务端口(如 8420)已启动,并在网关配置中指向正确地址。

小结与延伸

这四个项目覆盖了无人机、ROS2 地面车、机械臂和微型立方机器人,分别代表了:

空域具身智能(AerialClaw) AI 入口与 ROS 解耦(AgenticROS) 代码策略研究管线(CaP-X) 实时底层控制(RoClaw)

它们共同诠释了 OpenClaw 生态的核心思想:分层、可组合、文档即状态。

如果你对任何一个项目感兴趣,或者想把自己的机器人接入 OpenClaw 网关,欢迎加入我们的 飞书群!

加入飞书群

群名称:OpenClaw 机器人开源社区 加入方式:扫描下方二维码 或 点击链接 [请在此处放置飞书群邀请链接/二维码] 群内可讨论:项目使用问题、硬件适配、仿真搭建、论文复现、求职内推等。

如二维码/链接无法显示,请公众号后台回复“飞书群”获取最新入口。 |

相关链接汇总

AerialClaw:https://github.com/XDEI-Group/AerialClaw AgenticROS:https://github.com/agenticros/agenticros CaP-X:https://github.com/capgym/cap-x RoClaw:https://github.com/EvolvingAgentsLabs/RoClaw 合集总览:README.md(external-projects 表格)

-END-

往期回顾

OpenClaw + Robot 项目专栏 | 把 OpenClaw 装进机器人身体:四个新增项目的实战导读

Xbotics-robot-openclaw-awesome-work:把“OpenClaw × Robot”方向上出现的项目、教程、活动和实践资料,整理成一个统一入口

OpenClaw + Robot 项目专栏:当AI学会「动手」

仿真平台的新战场:OpenClaw × Simulation × RL,把“会做事”的能力自主训练出来

Vbot + OpenClaw:把“行动型 AI Agent”装进家庭机器狗的落地探索

Ask Me Anything|提问箱

❝对文章有疑惑,或想聊更深?欢迎把你的问题丢给我们:技术方案、实操踩坑、课程与资料、项目合作、职业发展,都可以问。

怎么问:在评论区留言,或私信公众号

我们会做什么:每周集中整理高质量问题并公开回复,重点问题邀请作者或嘉宾深度解答;典型问题会加入知识库并持续更新。

提问小提示:尽量说明「你的目标—当前做法—期望产出」,附上必要信息(硬件/软件版本、数据规模等),能更快获得有用答案。

一起把问题变成知识,推动社区进步 🚀

夜雨聆风

夜雨聆风