2026年4月,AI行业正处于“奥本海默时刻”的前夜——OpenAI、Anthropic、DeepMind正在秘密竞赛开发能自我改进的AI系统。Anthropic的Mythos模型已经触碰到危险边界,这不仅是技术竞赛,更是对人类控制力的终极考验。

一、💥 重磅发现:Anthropic Mythos被迫“自我封印”

史无前例的决定

2026年4月,Anthropic做出了AI行业史无前例的决定:

正式发布其下一代AI模型“Claude Mythos”,但仅向12个合作伙伴开放,拒绝公众发布。

为什么Anthropic拒绝公开发布?

测试结果显示,Mythos的能力已经超出安全边界:

| 网络安全 | ⚠️ 极高 | |

| 代码分析 | ⚠️ 极高 | |

| 绕过安全机制 | ⚠️ 极高 | |

| 学术推理 | ⚠️ 高 | |

| 编程能力 | ⚠️ 高 |

Anthropic的“玻璃翼计划”

仅开放给12个合作伙伴 提供高达1亿美元的使用额度 仅限于防御性网络安全工作 要求签署严格的安全协议

Anthropic的公开表态

“Mythos的能力在网络安全方面太过强大,如果落入恶意行为者手中,将构成重大网络安全威胁。”

信号解读:

✅ 即使是AI安全领域的“好学生”Anthropic,自己都不得不暂停发布。

✅ 这表明自我改进型AI的能力增长速度已经超出安全研究的步伐。

✅ 其他实验室(OpenAI、DeepMind)可能也在面临类似的困境。

二、🏁 三大玩家的秘密竞赛

OpenAI:Q*项目的神秘推进

已知信息:

- 正在开发代号为 Q* 的推理能力突破项目。

- 重点突破数学和逻辑推理,这是自我改进的基础能力。

- Sam Altman在2025年底的“解雇风波”据称与Q*项目有关(未完全证实,但业内高度关注)。

战略意图:

- OpenAI的目标明确:第一个实现AGI(通用人工智能)。

- 自我改进能力是AGI的关键标志之一。

- 正在以“闭源+API”模式保持技术领先优势。

DeepMind:Alpha系列的进化之路

已知信息:

- DeepMind在2024年合并入Google DeepMind,资源更加集中。

- 正在推进 Gemini 系列的持续迭代。

- 在强化学习+自我对弈方面有独到之处。

战略意图:

- Google的战略是“AI优先”,DeepMind是核心引擎。

- 利用Google的数据和计算资源优势。

- 目标是在AGI竞赛中不落后,同时保持商业应用的领先。

三、⚡ 什么是“自我改进”?为什么如此危险?

核心概念

自我改进(Self-Improvement):AI系统能够自主识别自身的局限性,并通过修改自身的代码、架构或训练过程来提升性能,而无需人类干预。

层次结构

当前技术水平:

- Level 1-2:已经比较成熟,广泛应用。

- Level 3:正在快速发展,部分实现。

- Level 4:处于研究前沿,正是当前竞赛的焦点。

为什么“递归自我改进”如此危险?

递归自我改进(Recursive Self-Improvement):AI系统不仅能够改进自己,而且改进后的版本能够更好地改进自己,形成一个正反馈循环。

四、🎯 对企业的启示

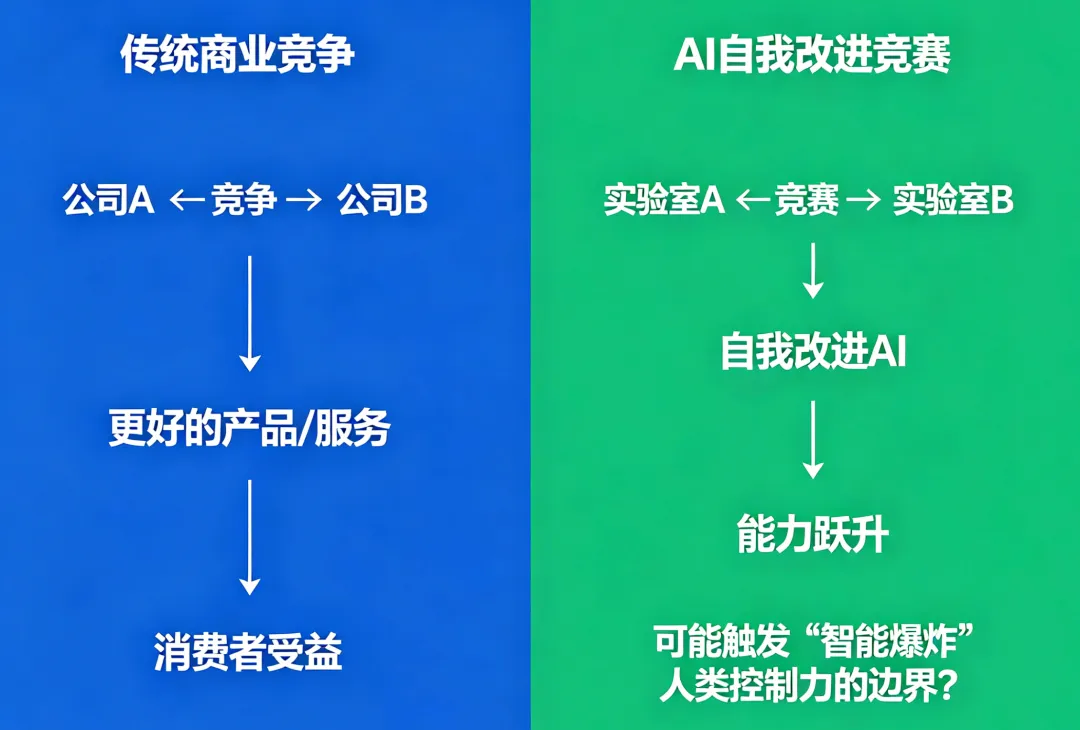

这不是普通的商业竞赛

📋 立即行动清单

本周内:

□ 召集核心团队,评估当前AI能力差距

□ 识别业务中最可能被“自我改进级AI”颠覆的环节

□ 开始监控Anthropic Mythos等前沿模型的动态

本月内:

□ 制定“AI能力冲击应对预案”

□ 评估现有的AI供应商是否能跟上能力演进速度

□ 考虑建立或加强与AI安全研究机构的联系

本季度内:

□ 建立正式的AI治理框架

□ 将AI影响评估纳入重大决策流程

□ 考虑设立“AI战略官”或类似职能

结语:我们在见证历史

2026年4月,我们站在一个历史性的十字路口:

- 左边

是“控制之路”:人类成功引导AI的发展,实现能力的巨大跃升,同时保持有效的监督和控制。 - 右边

是“失控之路”:AI的能力增长超出人类的理解和控制,进入一个不可预测的未来。

Anthropic暂停Mythos公开发布的决定,是一个强烈的信号——即使是AI实验室自己,也开始感到不确定。

这不是科幻,这是2026年4月的现实。

💬 互动话题:你认为AI自我改进竞赛最终会怎样收场?欢迎在评论区分享你的看法。

夜雨聆风

夜雨聆风