很多人聊 ChatGPT、Claude Code 和人工智能平台时,还是习惯先看模型能力:谁更聪明、谁写代码更快、谁上下文更长。但过去 72 小时真正值得注意的,不是又一轮“能力排行榜”,而是平台竞争已经明显切到更硬的一层:运维层、治理层和生产交付层。

为什么这么说?因为这几天发生的几条新闻,已经不是“发布一个新功能”那么简单,而是在回答同一个问题:当 AI 真要进入企业的真实工作流,平台要如何承担事故、管理权限、协调代理、控制成本,并让系统长期跑下去。

最新动态:过去72小时,至少有四个关键事实

第一条事实来自 OpenAI。4 月 10 日,OpenAI 发布《Axios developer tool compromise》说明,披露攻击者通过受感染的第三方开发者工具,获取了少量企业客户的连接器凭证与聊天数据。单看这是一则安全通报,但把它放在整个行业里看,它的意义远不止“出了一次事故”。这说明 AI 平台已经深度嵌入企业的连接器、文档与协作链路,一旦外围工具出问题,平台就必须像真正的生产基础设施那样响应、披露与善后。

第二条事实来自 Claude Code。4 月 10 日,Anthropic 发布《Seeing like an agent: how we design tools in Claude Code》,复盘 Claude Code 的工具设计逻辑。文中提到,团队从最初的 TodoWrite 逐步转向更适合多代理协作的 Task tool,也强调工具不应只是越多越好,而要符合代理本身的能力结构。换句话说,AI 编程平台的竞争,已经不是“给模型塞多少按钮”,而是“能不能给代理一套真正高效、低噪声、可协作的操作环境”。

第三条事实同样发生在 4 月 10 日。Anthropic 又发布《How and when to use subagents in Claude Code》,系统解释 subagent 在研究、并行任务、验证和流水线式工作中的作用。它把 subagent 讲得很直白:主会话负责主线,子代理在独立上下文里处理支线,只把结果带回来。这个设计非常关键,因为它正好对应企业实际使用 AI 编程工具时最痛的点:任务越来越复杂,主上下文越来越重,成本和噪音都在上升。subagent 的本质不是“更炫的功能”,而是一种更接近团队协作和工程分工的执行方式。

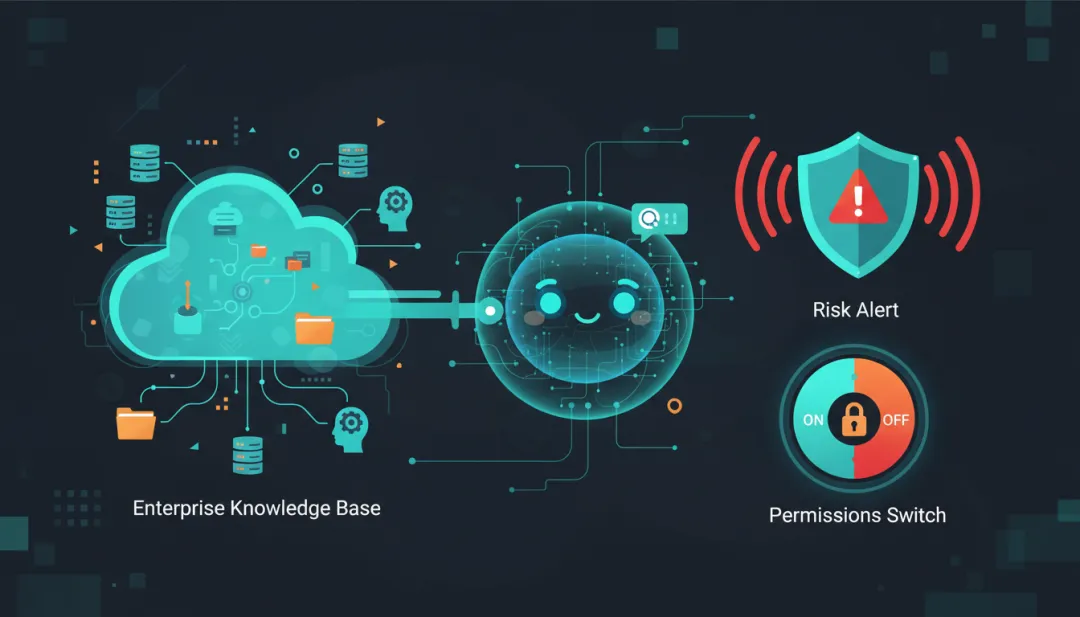

第四条事实也不该被忽略。Anthropic 在 4 月 10 日发布《Making Claude Cowork ready for enterprise》,为企业用户加入了基于角色的权限控制、组级预算、使用分析、OpenTelemetry 事件、连接器动作限制等能力。4 月 8 日,Anthropic 还发布《Claude Managed Agents: get to production 10x faster》,强调沙箱执行、长会话、权限治理、执行追踪和多代理协调。这两条信息放在一起看,指向的是同一个现实:代理不是“演示版助手”了,而是正在被包装成企业可部署、可审计、可预算、可持续运行的生产系统。

为什么这几条消息能拼成一张图?

因为它们共同说明,AI 平台真正的门槛正在后移。

过去,大家比的是前台体验:回答像不像人、代码补全快不快、生成效果强不强。现在,这些当然还重要,但已经不足以决定企业采购和长期留存。企业越来越关心的是另一组问题:

- • 出了事故以后,平台能不能快速披露与隔离风险;

- • 一个代理调用了什么工具、改了什么文件、用了哪些连接器,能不能追踪;

- • 多个代理同时工作时,能不能合理拆分上下文与权限;

- • 团队预算能不能控,谁能写、谁只能读,能不能做角色限制;

- • 从试点到规模部署,中间是否还要自己补一整套基础设施。

这就是为什么 OpenAI 的安全披露和 Anthropic 的产品更新,虽然表面上分属不同主题,却在商业层面上讲的是同一件事:谁能把 AI 从“聪明工具”做成“可运营系统”,谁才更有机会赢下下一阶段。

ChatGPT 与 Claude Code,分别暴露了什么信号?

对 OpenAI 来说,4 月 10 日这次安全披露是一次压力测试。它会提醒企业客户,接入 ChatGPT 类产品时不能只盯住模型本身,还要审视周边工具、连接器与第三方链路的安全性。未来用户对 ChatGPT 的要求,不会只停留在“是否好用”,而会延伸到“是否能承受组织级风险”。

对 Anthropic 来说,这几篇连续文章释放出的信号更加完整:Claude Code 想把“代理如何工作”讲清楚,把 subagent 这种执行范式做成标准能力,再把 Cowork 和 Managed Agents 补上企业治理与托管部署层。换句话说,Anthropic 正试图从编程助手、企业协作代理,到托管代理基础设施,铺出一条连续产品线。

这也是为什么今天再讨论 ChatGPT 和 Claude Code,不能只用“谁写代码更强”来概括。真正的竞争,已经进入一个更像云服务、更像企业软件、也更像基础设施的阶段。

这对普通团队意味着什么?

如果你是开发团队、内容团队或者产品团队负责人,接下来判断 AI 平台时,建议把问题从“哪个模型更厉害”改成三层:

第一层,前台能力。模型能不能完成你最核心的写作、研究、编码或代理任务。

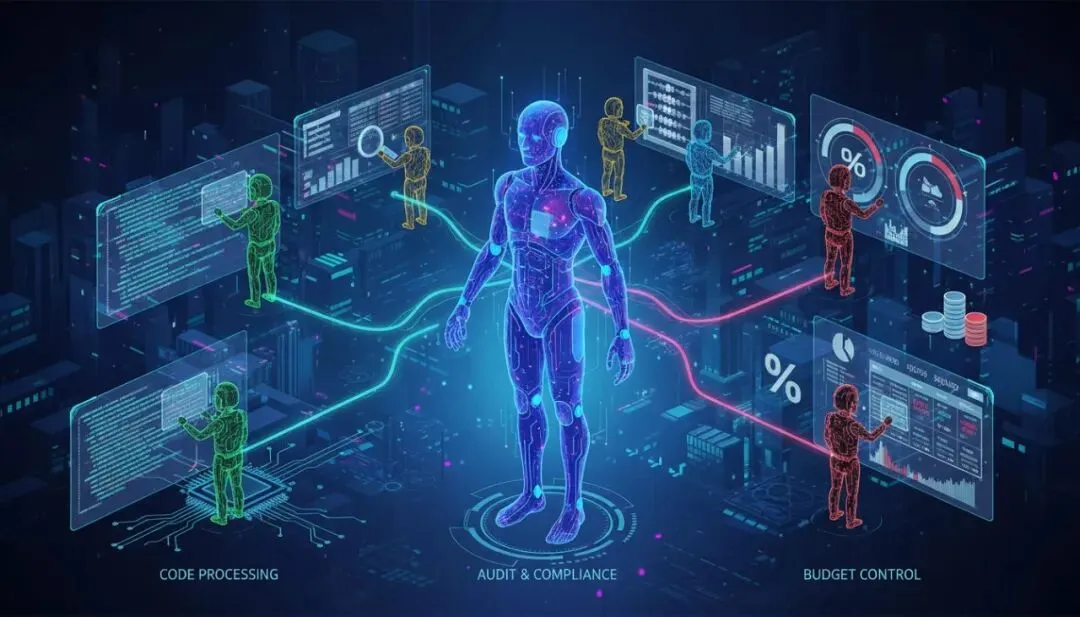

第二层,执行结构。它是否支持 subagent、任务分发、长会话、上下文隔离、失败恢复这些真正决定效率的能力。

第三层,运维治理。它能不能给出权限控制、预算限制、审计事件、日志与可观测性,以及事故后的明确响应机制。

如果只看第一层,你选到的很可能只是一个“短期好用”的 AI 工具;如果三层一起看,你才是在选一套能长期进入组织流程的 AI 系统。

最后一句

过去 72 小时最重要的信号不是 AI 又变聪明了一点,而是 ChatGPT、Claude Code 以及更广义的人工智能平台,都在被迫回答更难的问题:出了事怎么办,多个代理怎么协作,企业怎么管,系统怎么长期跑。

这意味着下一轮竞争,不再只是模型层的能力赛跑,而是运维层、治理层和生产层的综合较量。谁能把这些“看不见但最关键”的部分做好,谁才真正更接近企业级胜出。

夜雨聆风

夜雨聆风