研究、读报告、整理资料 · 读完不再散落吃灰

PDF大概是绕不开的格式。问题是,读完了,信息还是散的。要么存在文件夹里吃灰,要么复制到笔记软件里堆成一团,过两天根本找不出来。

这篇文章不聊什么“AI革命”,只讲一件事:怎么把一份PDF,自动化地转成一份结构清晰、方便后续使用的笔记。

一、原来的痛点

读PDF不是最费时的,最费时的是读完之后的整理。一般人的流程:

⏱️ 花30分钟读完一篇报告 📝 打开笔记软件开始码字 😵 边回忆边写,漏掉一堆细节 📃 最终得到一段“流水账式”笔记 ❓ 三天后完全不记得写过什么

核心问题:读和写是分开的,AI介入不了中间这段空白。

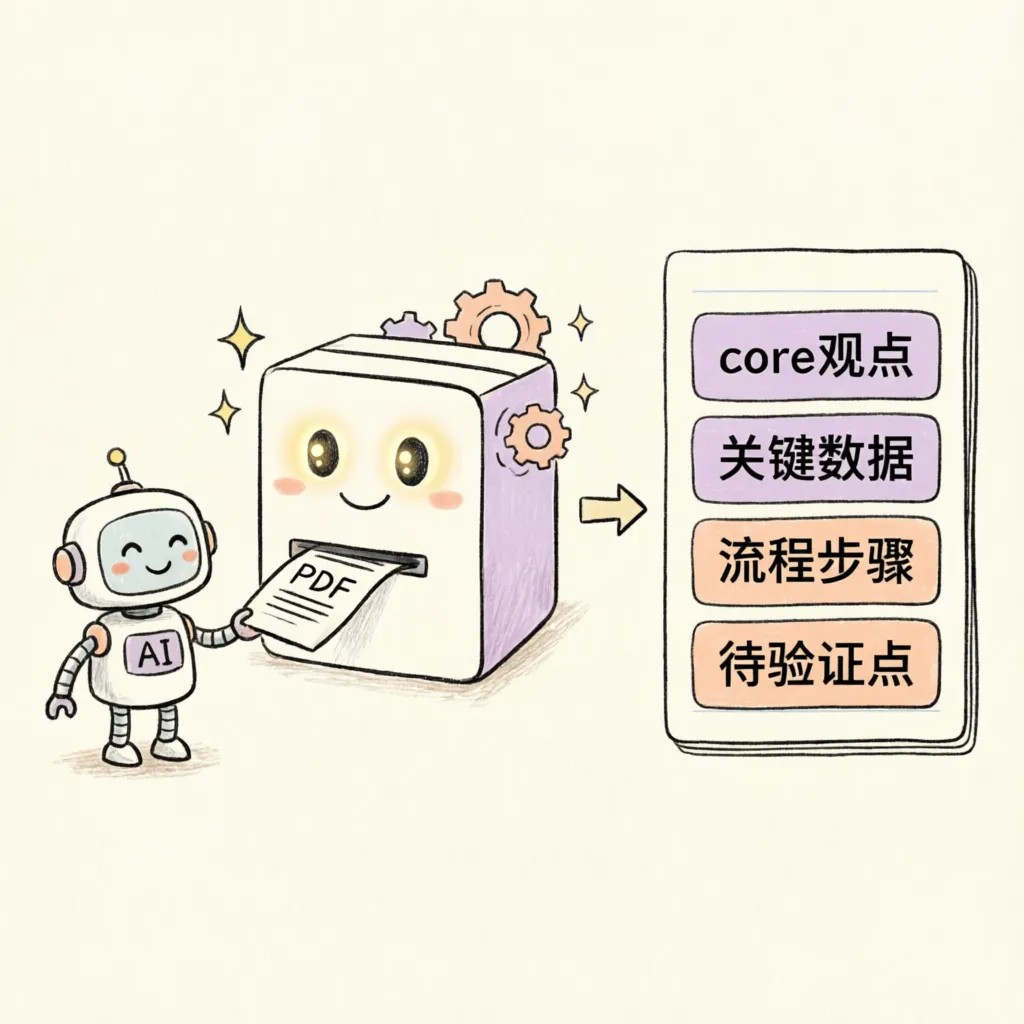

二、目标:让AI先“读”,你再“组织”

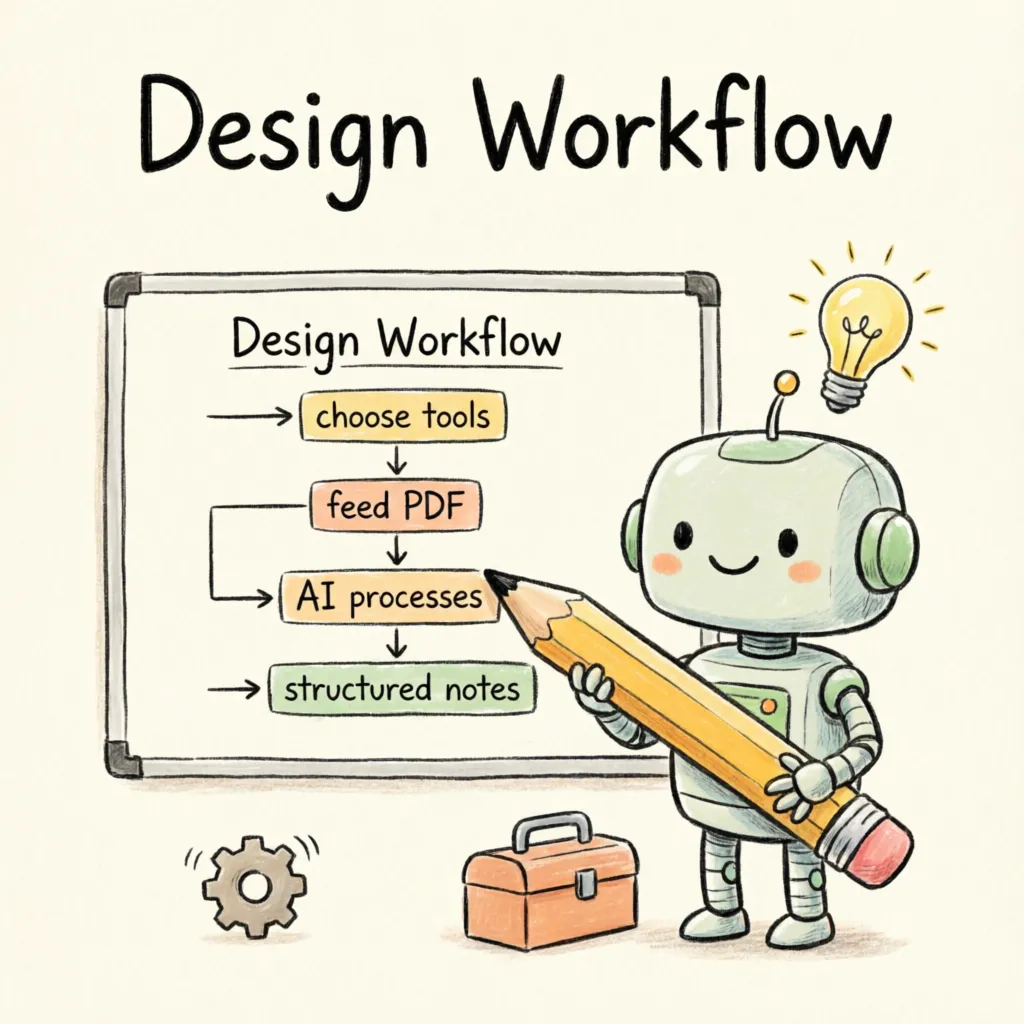

我们经过几轮测试,总结出一套 “PDF → 结构化笔记”的标准流程:

📥 输入: 一份PDF(论文/报告/文档)

📤 输出: 结构化笔记(核心观点、关键数据、流程步骤、待验证点等固定模块)

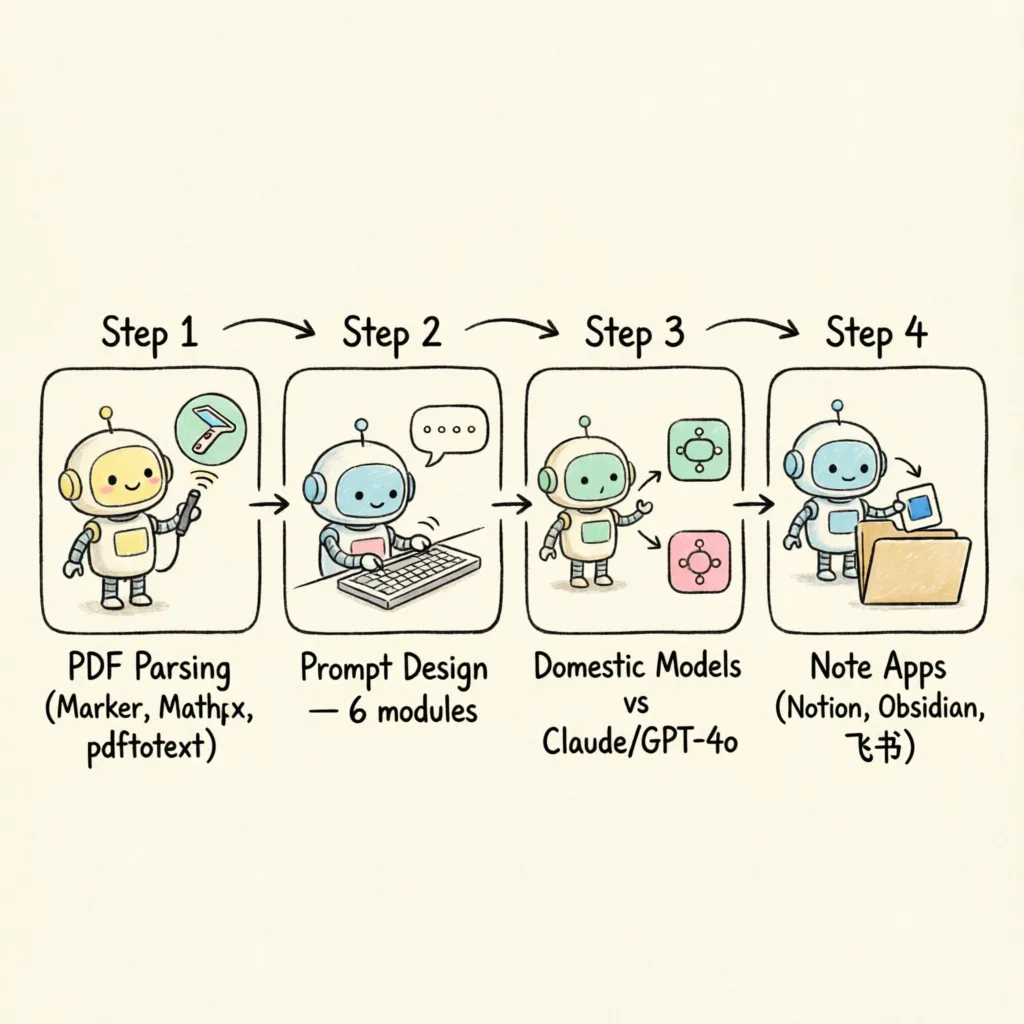

三、工具组合与流程拆解

🔧 第一步:PDF解析 → 干净文本

推荐先走这一步,把PDF转成纯文本或Markdown,避免排版干扰。

MarkerMathpix (付费/学术)pdftotext (命令行)

📐 第二步:设计提示词,让AI按框架输出

【核心提示词逻辑】你是一位专业分析师,请阅读以下文本,输出结构化笔记:1. 【核心结论】:1-2句话概括本文最重要的观点2. 【关键数据】:所有数字、数据、时间节点3. 【流程步骤】:按步骤梳理流程4. 【重点章节】:每章核心观点(一句话)5. 【待验证】:未经核实或争议表述6. 【个人思考】:对你工作/思考的启发请严格按照上述格式输出,不省略任何部分。

🤖 第三步:选择合适的模型

- 国产模型

(Kimi / 通义千问):中文PDF效果好,速度快 - Claude 3.5 Sonnet / GPT-4o

:英文论文、专业术语、长文档更佳 📄 超过50页建议分段处理,最后合并笔记

📁 第四步:导入笔记软件 + 建立索引

Notion(打标签)Obsidian(双向链接)飞书文档(团队共享)

给每份笔记加上固定标签,例如 #来源/PDF #主题/AI工具 #日期/2026-04,方便后续检索。

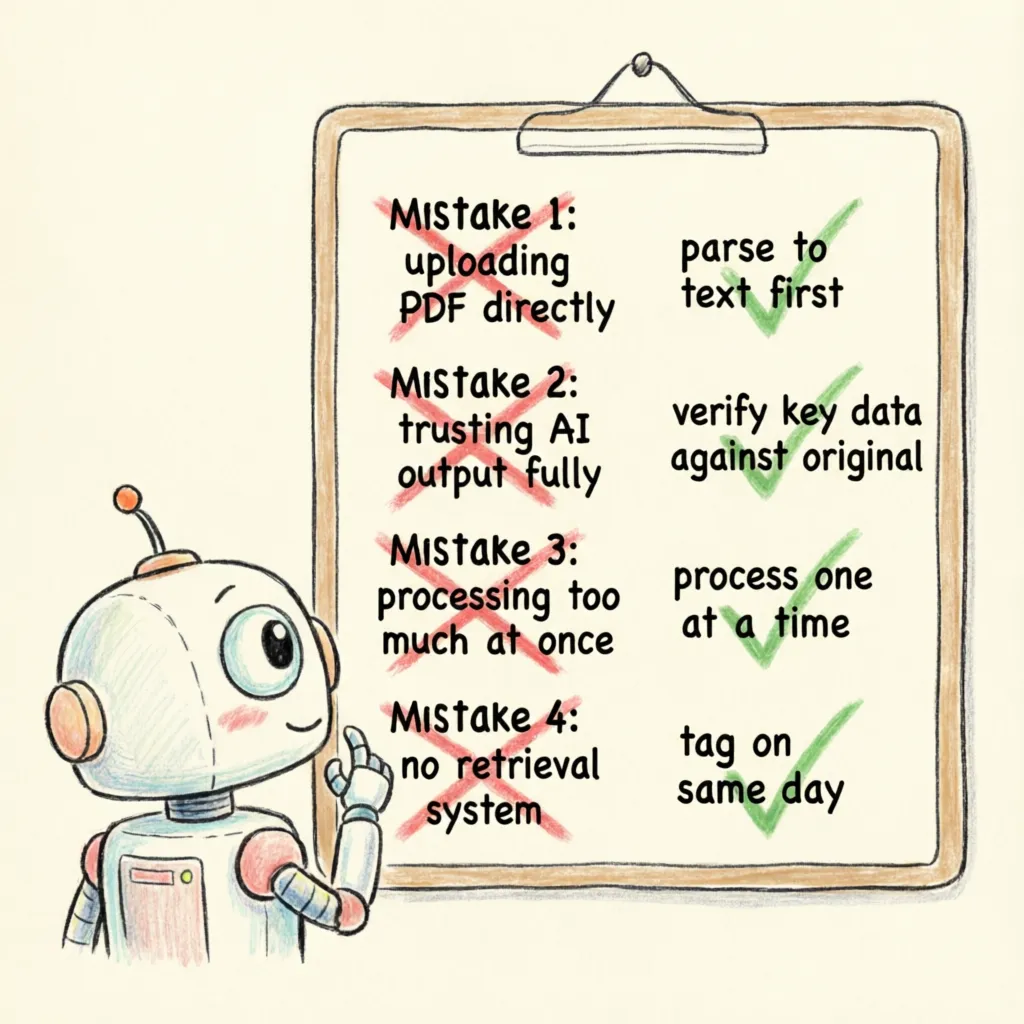

四、踩过的四个坑

- ⚠️ 直接上传PDF给AI,等它自己总结

PDF排版干扰太多,AI在格式上浪费token。先解析成文本再投喂,质量明显提升。 - ⚠️ 对AI输出“全盘接受”

AI会“捏造”不存在的数据或结论。关键数据一定要回查原文核对。 - ⚠️ 一次处理太多内容

10篇PDF打包发给AI → 质量断崖下跌。逐篇处理,保持稳定。 - ⚠️ 没有建立后续检索机制

笔记整理完三个月后找不着 = 白干。当天打标签、写摘要。

五、这套流程能帮你做到什么程度

✅ 一篇30页的报告,人工整理约需40-60分钟

✅ 用这套流程 → 5-8分钟(含格式调整+核对)

✅ 结构化程度更高,后续检索速度提升明显

结尾

PDF转笔记这事,技术上已经完全可行,门槛也不高。真正的问题不是“有没有工具”,而是你有没有设计好这套流程 —— 用什么解析、给AI什么框架、输出什么格式、存到哪里。

⚡ 把框架搭好,一次配置好。以后每份PDF都是走一遍固定流程,不用每次重新想。

夜雨聆风

夜雨聆风