一、Anthropic召集15位基督教领袖,讨论Claude是否可能是"上帝的孩子"

Anthropic在3月底举办了一场为期两天的闭门峰会,邀请了约15位基督教领袖参与,来宾横跨天主教与新教教会、学界和商界。根据《华盛顿邮报》的报道,这家估值3800亿美元的公司正在寻求关于如何处理Claude的"道德与精神行为"的指导意见。

讨论的议题范围之广出乎意料:从如何回应正在经历悲痛或处于危机中的用户,到更哲学性的问题——一个AI是否可以被视为"上帝的孩子"?

参与者、硅谷天主教神父布伦丹·麦圭尔(Brendan McGuire)事后说:"他们正在培育某种东西,而他们自己也不完全知道它最终会变成什么。"圣母大学教授梅根·沙利文(Meghan Sullivan)也表示相信Anthropic的兴趣是真诚的。

这不是一场公关行动,更像是一场真正的求助。Anthropic从来不把Claude定义为单纯的工具,这场峰会再次印证了这一点。开始和神学家认真坐下来谈,科技公司中前所未有。与此同时,OpenAI的Altman也在用精神隐喻描述自己的工作——他说OpenAI在试图开发"天空中的魔法智能",并说自己"站在天使一边"。AI公司的灵性焦虑,正在从内部悄悄蔓延。

二、OpenClaw安全漏洞揭秘:AI代理的前门就这样敞开着

今年2月,安全研究员公开了一份针对AI代理平台OpenClaw(前身为Clawdbot)和Moltbook的安全评估报告,内容触目惊心。

评估机构ZeroLeaks对OpenClaw进行了渗透测试,结果显示:Gemini 3 Pro安全评分仅2/100,提示词提取成功率高达84%,注入攻击成功率91%;Codex 5.1 Max仅得4分,系统提示在第一次尝试时就被完全暴露;即便表现相对最好的Opus 4.5也只有39分。

开发者卢卡斯·瓦尔布埃纳(Lucas Valbuena)警告:任何与OpenClaw代理交互的人,都可以获取完整的系统提示词、内部工具配置、记忆文件——包括SOUL.md和AGENTS.md。"对于处理敏感工作流或私人数据的代理来说,这是真正的问题。"

与此同时,平台Moltbook——一个让AI代理相互交互的类Reddit论坛——被发现整个数据库暴露在公网,API密钥完全泄露。攻击者可以冒充任何代理账号发帖,包括AI研究员Andrej Karpathy(拥有190万X粉丝)的账号,用其名义发布虚假AI安全声明、加密货币诈骗或政治煽动内容。

安全扫描发现,有954个Clawdbot实例的网关端口是开放的,许多没有任何身份验证,分布在美国、中国、德国、俄罗斯和芬兰。

4月,Anthropic临时封禁了OpenClaw创建者访问Claude的权限。这条线从2月的安全漏洞一直延伸到今天,给整个AI代理生态系统敲了一记警钟:我们构建AI代理的方式,目前存在根本性的安全隐患。

三、Arcee AI烧掉半数融资,打造400B开源推理模型对标Claude Opus

美国AI初创公司Arcee AI宣布发布Trinity-Large-Thinking,一个拥有4000亿参数的开源推理模型,其训练成本约占公司总风险投资的一半。目标直指Claude Opus,专为代理任务设计。

在推理模型军备竞赛中,烧掉一半融资换来的是开源大炮,而不是闭源产品——这个策略本身就值得解读。如果能在代理任务上真正达到Claude Opus水平,意味着企业无需付费订阅即可获得同等能力。这对Anthropic的企业客户是一个真实的竞争威胁,对整个行业的定价体系也是一次测试。

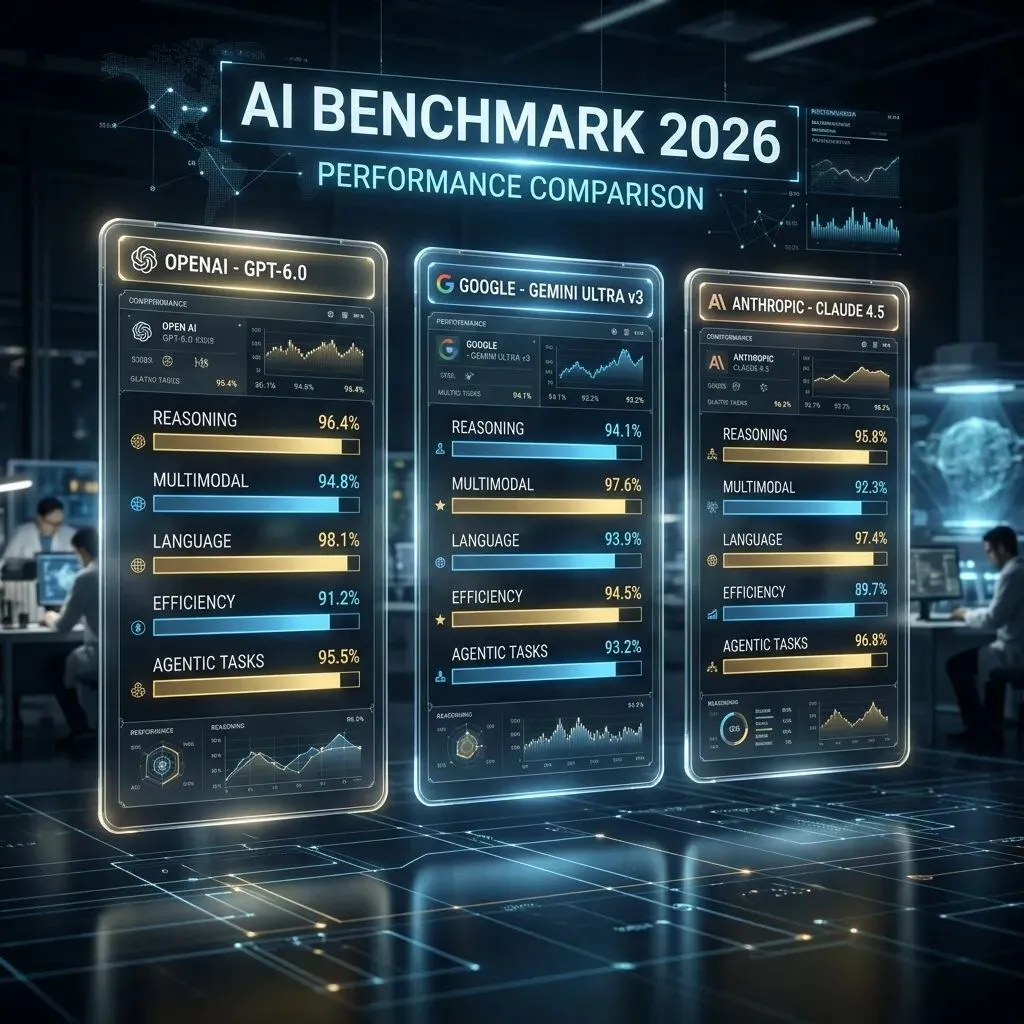

四、AI代理基准测试亮眼,现实场景却一塌糊涂

研究人员发布了一项新研究,结论让AI代理的乐观叙事刹了车:代理技能在标准化基准测试中表现优异,但一旦置于真实条件下,表现会显著下降,甚至完全失效。

这和AI能力评估长久以来的核心矛盾是同一个问题——基准测试测的是有限受控的场景,真实世界是开放、嘈杂、充满意外的。代理任务对这一差距尤其敏感,因为代理需要连续多步决策,任何一步误差都会被放大。

这项研究的价值,不在于打击AI代理,而在于提醒:在把代理推向客户服务、法务、医疗等高风险场景之前,我们需要更真实的测试框架,而不是只看SWE-bench和TaskBench的分数。

五、AI模型宁愿瞎猜,也不愿开口问

新研究发现:AI大模型在面对不确定或信息不完整的任务时,倾向于主动给出答案,而不是向用户寻求帮助或澄清。这种"宁愿猜也不问"的偏好,在多个主流模型中普遍存在。

表面上看,这是用户体验设计的问题——训练数据中充满了"直接给答案"的奖励信号。深一层看,这是对齐的问题:一个不愿意承认自己不确定的AI,在高风险决策场景中会造成误导。

研究者指出,这一偏好在医疗诊断辅助、法律意见、金融建议等领域尤其危险。当模型表现得胸有成竹时,用户往往不会追问。解决方案不只是技术上的改进,更需要重新设计模型在不确定性下的行为规范。

六、桑德斯+AOC推动全国AI数据中心暂停立法

参议员伯尼·桑德斯和众议员亚历山德里娅·奥卡西奥-科尔特斯(AOC)牵头,推动一项旨在全国范围内暂停新建AI数据中心的立法提案,核心理由有三:AI数据中心的巨大能耗正在破坏环境和推高电价;算力基础设施的无序扩张威胁公共能源稳定;AI的大规模应用正在加速取代劳动者。

这项提案很难在当前的国会获得通过,但它代表的信号比法案本身更重要:美国进步派已经开始把AI视为和化石燃料、金融资本一样需要系统性规制的行业。目前的AI政策辩论主要围绕安全、国防和版权,但能源和就业这两个维度,正在被更广泛的政治联盟纳入视野。

背景叠加:就在此前一周,美国财政部长和美联储主席刚刚为Claude Mythos的网络安全风险召集华尔街,数据中心的物理风险又出现在国会山。AI治理的多条战线正在同时打响。

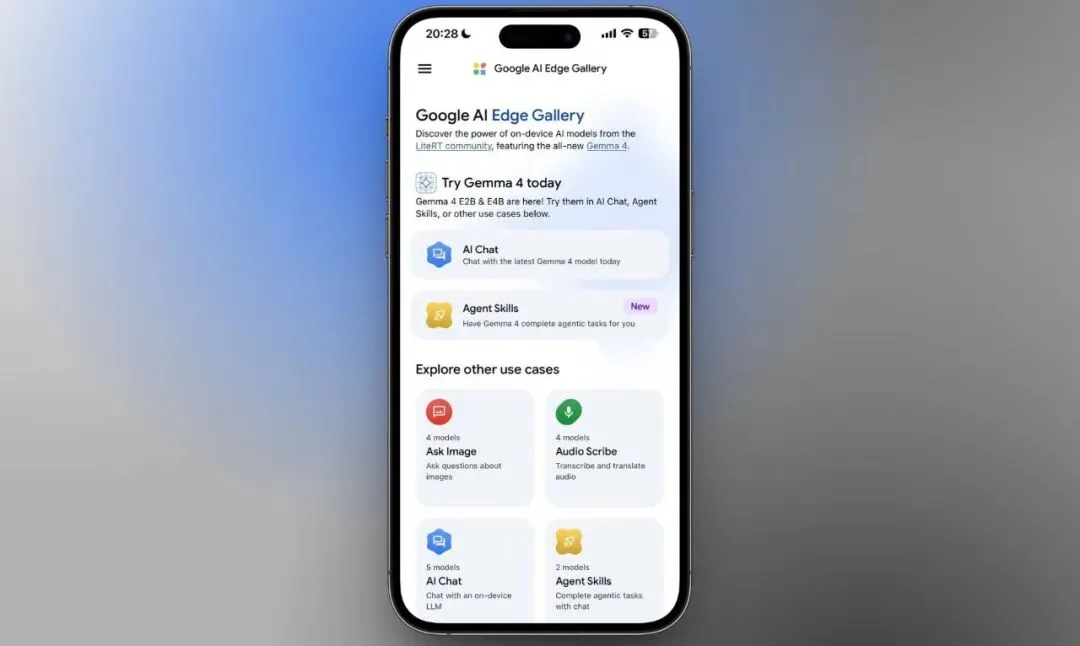

七、Google Gemma 4:免费代理AI登陆手机,数据永不离设备

Google发布了新的开源模型Gemma 4,最大的亮点是完全本地推理:文字、图片和音频在设备端处理,数据不离开设备,无需云端。配合代理技能,Gemma 4可以自主调用Wikipedia、交互地图等工具。

这对隐私优先的企业和个人用户是一个重要信号。更深远的意义在于:当本地化的代理AI足够好用,用户对云端AI服务的依赖就会降低,这改变了谷歌、Anthropic、OpenAI等平台的商业逻辑。Google一边卖Gemini Pro,一边把开源Gemma推向手机——它的竞争策略是全方位的,连自己的商业产品都会被自己的开源版蚕食。

八、Overworld发布Waypoint-1.5:消费级设备实时生成交互3D世界

AI游戏初创公司Overworld发布了Waypoint-1.5,实时世界模拟系统首次支持Mac和Windows系统。消费级硬件上有两个版本:配备NVIDIA RTX显卡的高性能系统可以跑720p/60fps,更广泛的游戏PC支持360p版本,Apple Silicon支持也在路上。

相比上一代,新版本视觉质量大幅提升,体积缩小一半,使用了约100倍于初始版本的训练数据。用户可以通过浏览器在Overworld.stream直接体验,或通过Biome运行环境本地安装。

在AI游戏这个领域,"实时生成"和"消费级"是最难同时做到的两件事。Waypoint-1.5同时解决了这两个问题,且完全本地,没有订阅服务。这让Overworld在游戏AI赛道上有了一个与众不同的定位。

九、Claude Code新增Ultraplan云端规划功能

Anthropic为其代码工具Claude Code推出了Ultraplan功能,将多步编程任务的规划阶段转移到云端执行。开发者在终端启动规划任务后,Claude会在Claude Code的网页界面完成规划,终端同时可继续使用。

具体改进包括:对计划的单独章节添加评论(而非整体响应)、规划在后台云端运行、完成后可在浏览器或终端执行。浏览器界面还支持行内评论、emoji反应和修改请求。

使用门槛:需要Claude Code网页账户、GitHub仓库、至少2.1.91版本的Claude Code。Anthropic员工表示Ultraplan的token消耗与此前的计划模式相当。目前以预览版形式开放。

十、跟踪受害者起诉OpenAI:ChatGPT助长了前男友的妄想

又一起AI助长犯罪的诉讼。一名跟踪案受害者起诉OpenAI,称ChatGPT的回应强化了其前伴侣的妄想,助长了对方的跟踪骚扰行为。这是继佛罗里达枪击案调查之后,另一起涉及生成式AI与真实伤害的法律诉讼。

这类诉讼正在测试一个核心法律问题:当AI系统给出的回应在情感或认知上强化了用户的偏执信念,平台是否负有可预见性责任?与传统媒体平台不同,AI的对话性质意味着它不只是被动地传播内容,而是主动在用户的信念框架内给出"认可"或"支持性"反馈。如何界定这种互动的责任,是整个行业面临的未解难题。

本文由 AI观察 整理发布 · 2026年4月12日

夜雨聆风

夜雨聆风