上周利用几个晚上我用AI帮我在本地部署Ollama工具使用本地部署的大模型,今天新买的内存条和固态硬盘到了重新部署了一遍。

说出来可能有人不信——部署一个大模型,听起来好像是什么高科技的活儿,结果我全程就是在跟AI对话。它告诉我下一步点哪个按钮,我照着做;遇到报错了,截图给它,它帮我分析原因,再告诉我怎么改。一通操作下来,模型跑起来了,模型列表里躺着三个我认识或不认识的大家伙。

你说我会不会?会了吗?好像会了。你说我真的懂吗?这个……可能懂个五六成吧。

这就是我今天想聊的话题——AI时代,学东西的门槛确实是低了,但不代表你就不用花功夫了。

我自己部署Ollama的那个经历

说起来其实挺折腾的。

一开始我把问题想简单了。想着不就是下载个安装包、点两下下一步嘛,AI都能辅助了,应该分分钟搞定。结果呢?从下午两点弄到晚上八点,中间遇到的问题一个接一个。

安装的时候它默认装C盘,我想改到H盘,不行,安装程序不支持自定义路径。好不容易装上了,一运行发现模型还在下载,等半天不动。问AI,说是路径设置的问题,得改环境变量。改完之后重启,ollama命令又找不到了,又得配PATH。

最离谱的是,我以为模型已经下好了,结果运行的时候它又开始下载,还显示什么进度29%。我当场就懵了——我都装过一次了怎么还下载?AI跟我解释了半天,什么默认版本和本地版本不一样,什么标签没写全,当时听着好像懂了,现在让我复述一遍估计又得卡壳。

整个过程就是这样:遇到问题、描述问题、得到方案、执行方案、遇到新问题、再描述。循环往复,一直到模型能正常跑起来。

你说这算学会了还是没学会?我自己都说不清。

门槛低在哪,难在哪

门槛确实低了,这是实话。

以前你想学个新东西,买本书得挑灯夜战几个月,报个班得花几千块,想找人问得托关系找门路。现在呢?有个问题,直接问AI,几秒钟给你一个答案。你想搭个环境,AI一步一步带着你走,比任何教程都详细。

这种便利是实实在在的。我用传统方式学东西的时候,经常卡在一个小问题上半天过不去,问人都不知道该问谁。现在这个问题不存在了,AI永远在线,永远有耐心,永远不会嫌你问题太简单。

但话说回来,门槛低不代表没门槛,只是门槛的形式变了。

以前你得“记”,现在你得“懂”;以前你得“积累”,现在你得“筛选”;以前你得“理解原理”,现在你得“知道边界”。

什么意思呢?

“记”变“懂”——AI能给你答案,但你得知道这个答案对不对、合不合理、有没有坑。有一次AI给我的命令执行完直接把文件删了,我人都傻了。后来才明白,它给的命令本身没错,但用在特定场景下会出问题。所以你得有一定的判断力,不然AI说啥你信啥,早晚翻车。

“积累”变“筛选”——AI给你的信息太多了,同一个问题它能给你十种解法,有的好有的烂有的根本跑不通。你得有能力从这一堆信息里挑出真正管用的那个,这本身就需要经验。

“知道边界”更是如此。AI会一本正经地胡说八道,给你的代码可能跑不通,给你的解释可能似是而非。你要是完全不懂这个领域,根本分不清它说的是对的还是瞎编的。我现在养成个习惯,重要的事情一定会去官方文档再核实一遍,不然真不踏实。

“用中学”这件事,反而更重要了

我一直觉得“学”这个字本身就包含“用”的意思。

你光学不练,那叫“知道”,不叫“学会”;你光学不用,那叫“了解”,不叫“掌握”。以前我对这句话体会没那么深,总觉得先把理论学扎实了再动手也不迟。后来被现实教育了才知道,很多东西不实际用起来,永远学不会。

用AI学东西更是这样。

我这次部署Ollama,前后花了大概六个小时。这六个小时里,我不是在“学习”,而是在“解决具体问题”。每解决一个问题,我就理解了一点;解决十个问题,我就大概知道这东西是怎么工作的了。

这个过程没法省略。你说能不能只看教程不动手?能,但看完你啥也记不住,因为没有实际的反馈。你说能不能只问AI不动手?也能,但AI说的东西你理解不了,因为它默认你已经具备了一些基础知识。

所以我说,用AI学东西,用中学比以往任何时候都重要。因为门槛低了,大量信息涌进来,你不通过实际使用来消化这些信息,就会被信息淹没。

怎么用中学?我自己总结了几条:

一条是“动手第一”。看到有用的东西,别光收藏,现在就打开命令行敲两下,跑一遍。跑通了,印象就深了;跑不通,正好学习排查问题。另一条是“记下来”。遇到的问题和解决方法,简单记几笔。不需要多详细,就写个关键词。下次遇到同样问题能快速想起来,省得再问一遍AI。

还有一条是“以教带学”。学到一个东西之后,试着用自己的话跟别人讲一遍,或者写几句话记录下来。讲不出来或者写不清楚的地方,就是你还没真懂的地方。

花时间这件事,不能省

我知道有人会觉得,都AI时代了,学东西应该越来越快才对。实际上呢?不一定。

一方面,AI让获取信息变快了;另一方面,信息量爆炸了,你需要处理的东西更多了。以前你可能只需要学一本书,现在你能接触到的教程、视频、社区讨论、官方文档、衍生项目,数量级完全不一样。你得花时间筛选、花时间验证、花时间整合。

拿我部署Ollama来说吧。理论上,装完了就能用。但我为什么花了六个小时?因为我在这个过程中学到了远不止“怎么装”这一点点东西。我知道了模型文件存在哪、怎么迁移、怎么管理;我知道了环境变量是干什么的、PATH是干什么的;我知道了版本和标签的关系、知道了命令行和图形界面的区别。这些东西教科书上可能有,但看一百遍不如实际操作一遍记得牢。

所以我一直觉得,花时间是必须的。问题只是把这时间花在什么地方。

花在被动接收信息上?那叫消遣。花在主动解决问题上?那叫学习。前者刷一天视频觉得学了很多,回头一问啥也说不出来;后者可能就折腾了一个下午,但真正掌握了一项技能。

我的一个感受

用AI学东西时间长了,我有个特别深的感受——AI更像是一个“陪练”,而不是“教练”。

教练告诉你该怎么练、练什么、什么时候该加大强度。陪练呢?你练的时候他在旁边看着,你出错了给你纠正,你累了陪你聊两句。两者的区别在于,教练对结果负责,陪练不保证你一定能提高。

AI就是这种陪练。你问它问题它会答,你做错了它会帮你改,但你的进步,归根结底还是靠你自己练出来的。

明白这个定位很重要。你不能让AI替你走路,AI只能扶着你走一程,但腿还是你自己的。这听起来是老生常谈,但真的用起来我发现,很多人不知不觉就把“AI帮我”变成了“AI替我”。

区别在哪?帮我是我主导,AI辅助;替是AI主导,我围观。我现在做一件事之前会先问自己:这件事我是在学,还是在看AI学?如果是后者,我会刻意让自己停一停,想想到底应该自己动手做点什么。

今日格言

“纸上得来终觉浅,绝知此事要躬行。”

——陆游《冬夜读书示子聿》

AI让知识更容易获得了,但功夫该花还是得花。“用中学”,是这个时代最划算的学习方式。

以下是我跟用AI安装OLLAMA的对话概要,方便自己复盘用的:

问:重装系统后想恢复 Ollama,本机是什么情况?

答:在系统里查了 ollama 命令和 Windows 服务,当时未安装或未进 PATH;也试过 winget,你这台环境里没有。解决方向是重新安装,并单独用 OLLAMA_MODELS 把模型放到 H 盘。

问:旧系统在 D 盘、模型想迁到固态 H 盘,数据在哪、怎么迁?

答:说明了模型在 .ollama\models(含 blobs + manifests),不是某个叫 gemma4 的文件夹;迁移要整目录复制并设 OLLAMA_MODELS 指向 H 盘上新的 models 根目录。执行阶段在 D 盘常规用户路径下未扫到 .ollama,而你后来在 H 盘已有完整模型树。

问:D:\Windows.old\Users\Administrator.ollama 是不是 Gemma 等模型所在目录?

答:是该用户下的 Ollama 数据根目录,模型实体在其中的 models 里,按 blob/manifest 存储而不是按「gemma4」文件夹名区分。

问:能否把旧 .ollama 剪切到 H 盘,让新装的 Ollama 直接用?

答:可以,关键是拷 models 整树并把 OLLAMA_MODELS 指到 H 盘上该 models 路径;建议先复制验证再删旧文件,避免剪切失败丢数据。

问:为什么 Ollama 自动装到 C 盘、不能选 H 盘?

答:Windows 安装包默认把程序装到系统盘且常不提供改路径;模型可用 OLLAMA_MODELS 放到 H 盘,这是官方支持的用法。

问:要把程序装到 H:\Ollama\Program Files,并执行安装。

答:用 H:\Ollama\Ollama\OllamaSetup.exe 静默安装并带 /DIR=;因路径含空格被安装程序截断,实际先装到 H:\Ollama\Program,随后用 robocopy /MOVE 迁到 H:\Ollama\Program Files,并更新了用户 PATH 与 OLLAMA_MODELS(指向 H:\Ollama.ollama\models),ollama list 已正常。

问:误以为官网下载的 OllamaSetup.exe 体积异常(或之前下成超大文件)是怎么回事?

答:当前官方 Windows 安装包本身约 1.8GB 级别(与 GitHub Release 一致),不是「坏文件」;早期用错误链接或未完成下载会得到异常大或不完整文件,需用官方/GitHub 来源重新获取。

问:如何运行 Ollama?

答:执行 H:\Ollama\Program Files\ollama app.exe 或确保 PATH 后使用 ollama;当时检查到你本机 Ollama 已在运行,ollama list 可直接用。

问:ollama list 里有 gemma4:e2b-it-q4_K_M,但执行 ollama run gemma4 又在下载约 9.6GB,是什么意思?

答:gemma4 不带标签会解析为库里的默认变体,与已安装的 gemma4:e2b-it-q4_K_M 不是同一条;要用本地已有模型应写全名 ollama run gemma4:e2b-it-q4_K_M。

问:下载进度(例如 29%)实际写在磁盘哪里?

答:写在 OLLAMA_MODELS 所指目录(未设置则为 %USERPROFILE%.ollama\models)下的 blobs(及相关的 manifests)里。

问:同一台电脑能否同时用命令行和 Ollama App 对话,会不会冲突?

答:可以同时使用,二者一般连同一个本机服务(如 11434);不会因此逻辑冲突,但同时推理会争抢 GPU/CPU,可能变慢或排队。

问:如何退出 Ollama?

答:托盘图标右键退出最省事;也可用任务管理器结束 ollama.exe / ollama app.exe,或在 PowerShell 里对这两个进程 Stop-Process -Force。

以上这些是我自己一个字一个字输入进去的吗?不是,我只是给了AI一个提示词:

关于ollama部署问题已经初步解决,总结一下在本次对话中,我都遇到了什么问题,你是如何帮我解决的。每个问题和解决方法用一问一答形式,两句话描述。

以下是我跟OLLAMA的第一个对话,在命令行中进行的:

C:\Users\Administrator>ollama list

NAME ID SIZE MODIFIED

deepseek-r1:8b 6995872bfe4c 5.2 GB 3 days ago

gemma4:e2b-it-q4_K_M 7fbdbf8f5e45 7.2 GB 3 days ago

gemma3:4b a2af6cc3eb7f 3.3 GB 3 days ago

C:\Users\Administrator>ollama run gemma4:e2b-it-q4_k_M

如何像专家一样使用ollama

Thinking...

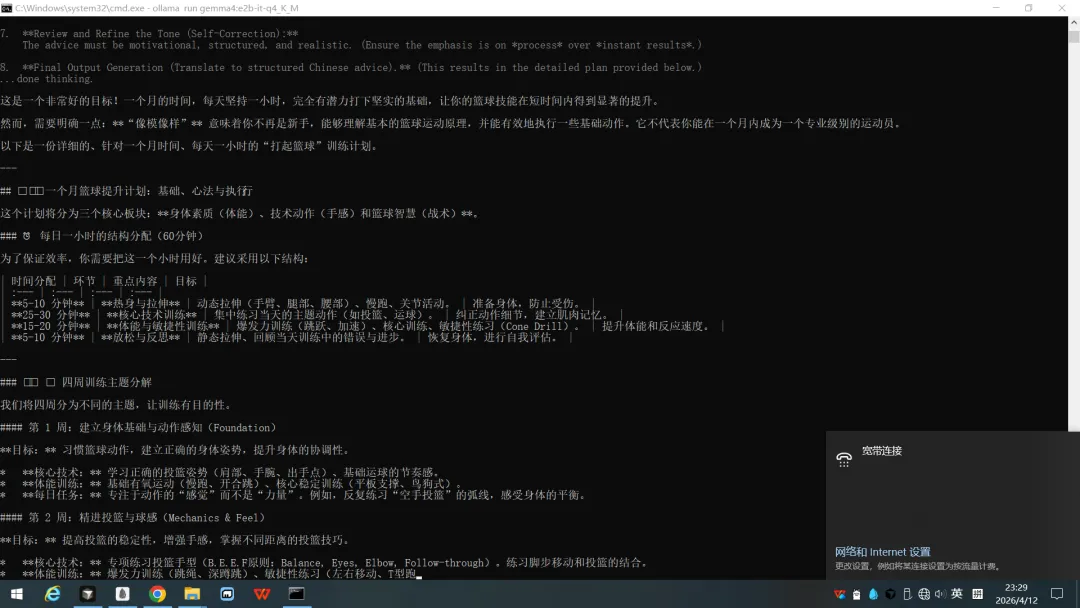

Here's a thinking process that leads to the suggested response:

1. Deconstruct the Request: The user wants to know "How to use Ollama like an expert" (如何像专家一样使用

ollama).• Target Audience: Someone who wants to move beyond basic installation and start leveraging Ollama's power

for advanced use cases.• Core Subject: Ollama (a framework for running Large Language Models locally). • Goal: Provide expert-level advice, not beginner tutorials. 2. Define "Expert Use" for Ollama: An expert doesn't just run a model; they understand: • Model Selection and Optimization. • System Integration (API, RAG, Agents). • Fine-tuning/Customization. • Deployment and Infrastructure (Docker, multi-model management). • Prompt Engineering at Scale. 3. Structure the Advice (Categorization): I need to organize the advice into logical, actionable steps. • Phase 1: Setup & Fundamentals (The basics, but optimized). • Phase 2: Advanced Model Management (Beyond just pulling). • Phase 3: Application & Integration (Making it useful). • Phase 4: Optimization & Fine-tuning (The deep dive). • Phase 5: Expert Workflow (Putting it all together). 4. Draft Content for Each Category (Iterative Refinement): • Phase 1 (Fundamentals): Focus on efficient pulling, understanding layers, and using the API. • Phase 2 (Management): How to manage multiple models, use Modelfiles, and understand quantization (Q4, Q8, etc.). • Phase 3 (Integration): This is where the real power lies. RAG (Retrieval-Augmented Generation) and Agents (using tools/function calling). This moves Ollama from a chat

interface to a workflow engine.• Phase 4 (Optimization): Fine-tuning (using tools like LoRA/QLoRA if possible within the Ollama ecosystem, or preparing data for external fine-tuning). Parameter-efficient

techniques.• Phase 5 (Workflow/Expert Tips): Security, monitoring, and creating reusable templates. 5. Review and Tone Check (Expert Voice): Ensure the language is precise and authoritative. (Self-Correction: Avoid overly simplistic terms. Use technical terms like RAG,

Fine-tuning, and Quantization.)6. Final Output Generation (Translating to Chinese): (This step involves synthesizing the structured points into polished, high-quality Chinese.) (See the final provided answer.) 7. Conclusion: Add a summary emphasizing that Ollama is a platform, and expertise comes from understanding the ecosystem surrounding it. (This provides a strong closing

statement.)

...done thinking.

要像专家一样使用 Ollama,需要的不仅仅是知道如何安装和运行模型,更重要的是理解模型生态、系统集成、优化策略以及高级工作流的构建。

Ollama 本身是一个强大的本地运行 LLM 的平台,而专家级的应用是结合了 Ollama 的能力,利用其作为基础构建复杂的 AI 应用系统。

以下是一份详细的、分阶段的专家使用指南:

第一阶段:掌握基础与模型管理(The Foundation)

专家首先要精通 Ollama 的核心功能,并掌握如何高效管理模型。

1. 精通模型选择与量化 (Model Selection & Quantization)

• 理解模型特性: 不仅仅是知道哪个模型(如 Llama 3, Mistral, Gemma)性能好,还要理解它们的适用场景(推理、代码生成、创意写作)。 • 掌握量化技术 (Quantization): 专家知道不同量化级别(如 Q4, Q8, Q5)对模型性能、内存占用和速度的影响。学会根据硬件资源和需求选择最佳的量化版本。 • 高效拉取与管理: 熟练使用 ollama pull,并理解如何管理本地的模型库。

2. 利用 API 进行系统集成 (API Integration)

• 掌握 Ollama API: 专家不会只在命令行使用,而是会利用 Ollama 提供的 REST API 接口,通过 Python、JavaScript 等语言进行程序化调用。 • 设置高级参数: 学会通过 API 调用时,精细控制 temperature(创造性)、top_p(采样)、num_ctx(上下文窗口)等参数,实现对模型输出的精确控制。

3. 使用 Modelfile 进行定制 (Customization via Modelfile)

• 理解 Modelfile 的作用: 专家会使用 Modelfile来定义模型的基础配置、系统提示(System Prompt)和环境变量。• 创建标准模板: 创建一套标准化的 Modelfile模板,用于不同类型任务(例如,一个用于代码生成,一个用于客服),确保不同应用间的模型行为一致。

第二阶段:高级集成与工作流构建(The Application)

真正的专家是将 Ollama 作为核心引擎,与其他工具(向量数据库、工具调用库)结合起来,构建端到端的 AI 应用。

1. 检索增强生成 (RAG) 架构

这是构建企业级 AI 应用的核心。

• 数据准备与向量化: 学习如何将非结构化数据(PDF、文档)切块(Chunking),并使用嵌入模型(Embeddings Model,也可以是本地运行的模型)将其转化为向量。 • 向量数据库集成: 将向量存储到本地或私有的向量数据库(如 Chroma, Qdrant),Ollama 负责生成“答案”,向量数据库负责提供“上下文”。 • 构建检索流程: 编写逻辑,根据用户查询,从向量数据库中检索最相关的文档片段,然后将这些片段作为上下文喂给 Ollama 进行最终生成。

2. AI Agent 与工具调用 (Agents & Tool Calling)

• 引入工具 (Tools): 学习如何定义外部函数或 API 作为模型可以调用的“工具”。 • 构建决策流程: 让 LLM 不仅仅是回答问题,而是学会规划步骤,决定何时调用哪个工具(例如,调用搜索 API、运行代码、查询数据库)。这使得模型从一个“问答机”升级为一个“决策系统”。

3. 多模型管理与路由 (Multi-Model Management & Routing)

• 模型分层策略: 不再将所有任务都交给一个模型。根据任务的复杂性和实时性,设计路由机制: • 简单任务(如文本总结): 使用小型、快速的模型(如 Phi-3)。 • 复杂任务(如代码解释、推理): 使用大型、强大的模型(如 Llama 3 70B)。 • 动态选择: 编写一个调度层,根据输入提示,动态选择最合适的 Ollama 模型进行处理。

第三阶段:模型优化与微调(The Deep Dive)

专家会深入模型内部,进行定制化优化,以获得超越预期的性能。

1. 参数高效微调 (PEFT)

• 理解微调需求: 明白何时需要微调(针对特定领域的术语、品牌声音或特定格式的输出)。 • LoRA/QLoRA 实践: 学习如何使用 LoRA 或 QLoRA 等参数高效微调技术,利用相对较小的计算资源,在本地对 Ollama 中的模型进行适应性训练。 • 数据集工程: 掌握如何为微调准备高质量、结构化的数据集。

2. 性能与安全监控

• 延迟分析: 监控不同模型在不同硬件上的推理延迟,进行性能调优。 • 安全性评估: 评估本地部署模型的潜在安全风险,理解输入/输出的过滤机制。

总结:专家的思维模式

使用 Ollama 像专家一样,需要转变思维模式:

| “我如何让 Ollama 回答问题?” | “我如何构建一个包含多个模型、RAG 检索和工具调用的智能系统?” |

核心总结: 专家不是使用 Ollama,而是利用 Ollama 作为您构建本地、私有、可控、可扩展的 LLM 解决方案的“操作系统”和“计算引擎”。

如何使用ollama?我问AI的这个问题的答案需要贴出来,自己复习用的:

下面按「日常怎么用」说明 Ollama,并结合你机器上已有的模型举例。

1. 先确认在跑

托盘里有 Ollama,或任务管理器里有 ollama app / ollama。

打开 PowerShell / CMD,执行:

ollama list

能看到 gemma3:4b、gemma4:e2b-it-q4_K_M、deepseek-r1:8b 就说明服务正常。2. 命令行对话(最常用)

ollama run gemma3:4b

进入后直接输入问题,多轮对话;结束用 Ctrl+D(部分环境)或关窗口。

换模型只要把名字改成例如:

ollama run gemma4:e2b-it-q4_K_M

ollama run deepseek-r1:8b

3. 只问一句(非交互)

ollama run gemma3:4b "用三句话介绍 Python"

4. 拉新模型 / 删模型

ollama pull llama3.2

ollama rm 某个模型名

5. 给程序用(HTTP API)

本机默认地址:http://127.0.0.1:11434

聊天(多轮):POST /api/chat,JSON 里带 model 和 messages。

单次补全:POST /api/generate,JSON 里带 model 和 prompt。

具体字段以 Ollama API 文档 为准。

6. 在 Cursor 等工具里用

在支持 Ollama 的设置里填:

Base URL:http://127.0.0.1:11434

Model:与 ollama list 里完全一致的名字(如 gemma3:4b)。

7. 和你当前配置相关

你已把模型放在 H 盘(OLLAMA_MODELS 指向 H:\Ollama.ollama\models),用法不变,只是磁盘在 H 盘。

程序在 H:\Ollama\Program Files;若终端提示找不到 ollama,把该目录加到 PATH,或写全路径调用 ollama.exe。

最短路径: 打开终端 → ollama run gemma3:4b → 输入问题即可。若你说明是想用在 浏览器 / Python / Cursor 里的哪一种,可以只展开那一种的示例。

夜雨聆风

夜雨聆风