🎋 你好,这里是小竹团队。

2026 年 2 月,Nous Research 发布了一个开源项目——上线后迅速获得大量关注。

它不依附 IDE,不是聊天机器人套壳,更不是一个"问答工具"。

它的官方定位只有一句话——「一个随时间增长的 Agent」。

叫 Hermes Agent。

这个名字来自希腊神话中的赫尔墨斯——众神的信使,掌管通信、旅行和边界跨越。而 Hermes Agent 做的事,恰好也是跨越边界:在你的 Telegram、Discord、Slack 等平台之间自由穿梭,同时还能记住你是谁、你做过什么。

但最让我感兴趣的,不是它的多平台能力,而是它背后的一个设计理念——

💭 AI Agent 真正的价值,不是单次回答多精彩,而是每一次使用都让下一次更好。

这篇文章想聊三件事:Hermes Agent 到底是什么 🔍;它的「闭环学习」架构是怎么做到越用越聪明的 🧠;以及,它对 AI Agent 行业意味着什么 🚀

一、Hermes Agent 是什么?

🤔 先说结论

Hermes Agent 是 Nous Research 开源的、基于 Python 的自主 AI Agent 运行时。 它有四个核心标签:

🧠 闭环学习:自动创建技能、技能在使用中改进、跨会话记忆 🌍 随处运行:CLI、Telegram、Discord、Slack、WhatsApp、Signal……一个网关进程搞定多平台 🔧 模型无关:可以用自家 Hermes 模型,也可以接 Claude、GPT、OpenRouter 200+ 模型,甚至本地 Ollama 🛡️ 6 种执行后端:本地、Docker、SSH、Daytona、Singularity、Modal——一行配置切换

用一句话概括:它介于 Claude Code 式的终端 Agent 和 OpenClaw 式的跨平台消息 Agent 之间——既能在终端干活,也能在 Telegram 里陪聊,而且越用越懂你。

📦 安装有多简单?

# 一行安装

curl -fsSL https://raw.githubusercontent.com/NousResearch/hermes-agent/main/scripts/install.sh | bash

# 交互式配置

hermes setup

# 开始对话

hermes

60 秒装完,2 分钟内开始第一次对话。从 OpenClaw 迁移?首次运行 hermes setup 时会自动检测 ~/.openclaw 并提示是否导入;之后也可以用 hermes claw migrate 手动迁移。

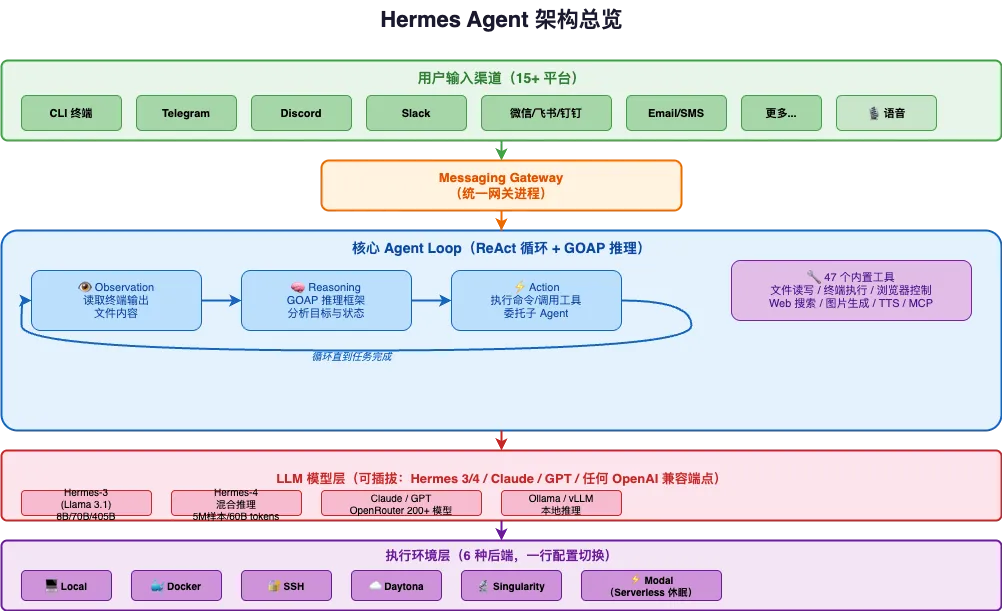

🏗️ 整体架构长什么样?

从上到下,可以拆成几个模块来看:

第一层,用户输入渠道。 CLI、Telegram、Discord、Slack、WhatsApp、Signal……多平台统一接入。

第二层,Messaging Gateway。 一个网关进程搞定所有平台的消息路由、用户授权、会话管理。

第三层,核心 Agent Loop。 经典的 ReAct 循环(观察 → 推理 → 行动 → 循环)。40+ 个内置工具,支持并行执行,还有 MCP 协议扩展。

第四层,LLM 模型层。 可插拔设计——Hermes 3/4、Claude、GPT、任何 OpenAI 兼容端点,甚至本地 Ollama / vLLM。一行命令切换模型:hermes model。

第五层,执行环境层。 六种后端实现同一个 BaseEnvironment 接口:本地、Docker(只读文件系统 + 命名空间隔离)、SSH 远程、Daytona 云开发、Singularity HPC 集群、Modal Serverless(空闲休眠,按需唤醒,成本几乎为零)。

设计原则很明确:Agent 代码不变,变的只是执行表面。

二、越用越聪明:闭环学习的秘密

🔑 核心创新:不只是 Agent,是「会学习」的 Agent

市面上大多数 Agent 的记忆,是"能搜到以前的对话"。这当然有用,但它有一个根本问题——搜索只返回碎片,不返回能力。

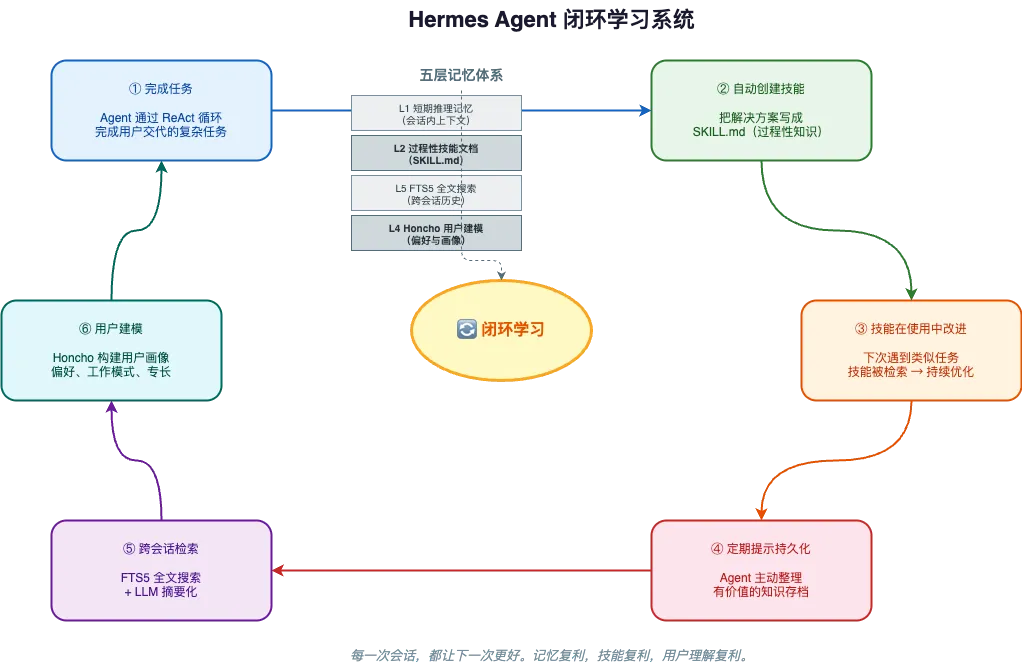

Hermes Agent 不一样。它实现了一个闭环学习系统,让 Agent 在使用中不断积累两种东西:

过程性知识(技能):不只是"当时说了什么",而是"当时怎么做的" 用户理解(画像):不只是"你的名字是什么",而是"你偏好什么、工作模式是什么"

这套系统由多个子系统协同组成:

技能文档(SKILL.md):Agent 在完成复杂任务后自动创建 Markdown 文件,记录解决步骤 技能检索:技能文档可被按需加载和复用,遇到类似任务时自动匹配已有技能 跨会话搜索(FTS5):SQLite 全文搜索引擎记录所有历史交互,支持"上周二我做了什么"这类查询 用户建模(Honcho):来自 Plastic Labs 的用户建模库,异步推理用户偏好、工作模式和领域专长 定期自省:Agent 会定期主动整理有价值的知识,防止重要经验随会话消失

这个闭环的核心流程是:

① 完成任务

Agent 通过 ReAct 循环完成用户交代的复杂任务——调试微服务、优化部署流水线、分析数据集。

② 自动创建技能

任务完成后,Agent 会自主判断:这件事值得记下来吗? 如果值得,它会自动生成一个 SKILL.md 文件——用 Markdown 记录完整的解决步骤。

注意,这不是聊天记录的搬运,而是结构化的过程性知识。就像一个有经验的工程师在写"踩坑笔记",而不是流水账。

③ 技能在使用中改进

下次遇到类似任务,Agent 会检索到相关技能,把它作为"脚手架"。而且技能不是静态的——Agent 在使用过程中会持续优化它。用得越多,技能越精准。

④ 定期提示持久化

Agent 不是被动等任务,而是会主动整理知识。它会定期"提醒自己":最近有什么有价值的经验值得归档?这种"自省"机制确保了重要知识不会随会话结束而消失。

⑤ 跨会话检索

FTS5(SQLite 全文搜索引擎)记录了所有历史交互。当你问"上周二我做了什么"——Agent 能跨会话检索并总结。

⑥ 用户建模

最后,也是最有意思的一层——Honcho 用户建模(来自 Plastic Labs)。它不只在记录"你做了什么",更在推理"你是谁":你的偏好、工作模式、领域专长。每次对话都让这个模型更精准。

这些子系统形成闭环:完成任务 → 创建技能 → 技能改进 → 持久化知识 → 跨会话检索 → 更好地理解用户 → 更好地完成下一次任务。

每一次会话,都让下一次更好。记忆复利,技能复利,用户理解复利。

三、底层支撑:模型训练和标准化

📚 Hermes 模型家族

Hermes Agent 的底层模型是 Nous Research 自研的 Hermes 系列,但它不绑定自家模型——你可以用任何 OpenAI 兼容的端点。

Hermes 3(2024 年 8 月):

基于 Llama 3.1 微调,三个规模:8B / 70B / 405B。关键数据:

训练数据:~3.9 亿 token,合成数据为主,涵盖通用指令、角色扮演、数学、代码、工具调用等多个类别 训练方式:先监督微调(SFT),再直接偏好优化(DPO) 函数调用:前身 Hermes 2 Pro 就达到 90% 精度(同期通用模型只有 60-70%),Hermes 3 进一步提升 支持能力:函数调用(JSON Schema + <tools>XML 标签)、结构化输出、RAG 引用标注(<cite>标签)、多轮对话上下文窗口:128K token

Hermes 4(2025 年 8 月):

一次巨大飞跃,训练规模大幅扩大:

混合推理:模型可以在标准回复和深度思考之间切换,思考过程使用专用推理标签包裹 DataForge:图结构的合成数据生成系统,每个节点做一次结构转换(比如维基百科文章 → 问答对),由 LLM 评委评分过滤 训练规模:相比 Hermes 3 的百万级样本,Hermes 4 大幅扩展了训练数据量和多样性 Hermes 4.3(36B):一个特别版本,基于字节跳动的 Seed 36B 微调(不是 Llama 骨干),在推理效率上有显著改进,有效缓解了"模型想太久"的问题

🎯 结构化推理

Hermes 的工具调用模板支持结构化推理——在调用工具之前,先规划目标和行动步骤:

<scratch_pad>

Goal: 分析这份 CSV 数据,找出异常值

Actions:

- result = read_file(path="data.csv")

- summary = analyze_data(data=result)

- anomalies = detect_outliers(data=result, threshold=3.0)

Reflection: 需要先读取文件,再分析数据,最后检测异常。工具完备,参数明确。

</scratch_pad>

先在 <scratch_pad> 里规划目标和行动,再执行。不是"边想边做",而是"先想清楚再动手"。

🔌 agentskills.io:技能的"POSIX 标准"

Hermes Agent 的技能遵循 agentskills.io 开放标准。一个技能就是一个目录,核心是 SKILL.md:

---

name: deploy-to-production

description: 安全部署当前分支到生产环境,支持回滚

license: Apache-2.0

---

## 步骤

1. 运行测试套件,确认全部通过

2. 从当前分支创建标记版本

3. 使用项目部署脚本执行部署

4. 验证健康检查端点

5. 健康检查失败则自动回滚

为什么这件事重要?因为越来越多的工具在采用同一个标准——Claude Code、Cursor、GitHub Copilot、Gemini CLI 等主流开发工具都在兼容 agentskills.io。

为 Hermes Agent 写的技能,在 Claude Code 里也能用。为 Cursor 写的技能,Hermes Agent 也能跑。

在 Agent 生态里,这种跨框架兼容性非常罕见。

四、跟其他 Agent 比,它强在哪?

📊 横向对比

Hermes Agent 的优势:灵活性最高。6 种运行后端、丰富的记忆子系统、广泛的平台覆盖、可移植技能。

它的代价:配置复杂度——Python 运行时、独立的模型服务(Ollama/vLLM)、配置文件、依赖管理。对开发者友好,对非技术用户有门槛。

一个有意思的发现:有基准测试表明,同一个底层模型,不同的 Agent 脚手架在 SWE-bench 上可以有显著差异。架构比模型更重要。 这也验证了 Hermes Agent 在 Agent Loop + 记忆系统上投入的合理性。

五、它给行业带来了什么启示?

💡 启示一:Agent 的竞争维度变了

之前,Agent 竞争的是"谁的回答更聪明"。现在,竞争维度变成了**"谁记得更多、学得更快"**。

Hermes Agent 的闭环学习,把 Agent 从"一次性工具"变成了"长期伙伴"。你的每次使用,都在投资它的能力——技能在积累,对你的理解在加深。

💡 启示二:技能标准化可能改变生态

agentskills.io 已有多款工具兼容,意味着技能不再被框架锁定。这是一个类似 POSIX 的时刻——一旦标准建立,生态就会加速。

但这也有风险:标准是刻意的极简设计(只要 name 和 description),这让它容易采纳,但也可能在演化时遇到瓶颈——当各家需要标准不支持的功能(认证、版本管理、依赖声明)时,是扩展还是分裂?

💡 启示三:合成数据的规模很重要

从 Hermes 3 到 Hermes 4,训练数据的规模和多样性都有了显著增长。DataForge 的合成数据管道 + LLM 评委的质量过滤,验证了一个假设:大规模合成数据 + 任务级验证器,可能比小规模精心整理的数据更有效。

但这也有争议——合成数据可能放大种子数据中的偏见。合成数据是否真的比精心整理的数据好?基准测试给出了一些正面信号,但由于基础模型也变了(Llama → Seed),对比并不完全干净。

💡 启示四:用户建模是下一个蓝海

大多数 Agent 记忆系统关注的是"Agent 做了什么"(任务历史、工具调用、输出结果)。Honcho 关注的是**"用户是谁"**——偏好、工作模式、领域专长。

这是否能在 100 次会话后产生有意义的行为差异?还是只是积累了一个越来越过时的用户档案?这是一个有趣的开放问题。

🌟 写在最后

Hermes Agent 不是完美的——Python 运行时的门槛、配置的复杂度、技能是否会无限膨胀——这些都是真实的问题。

但它做了一件很少有人做的事:把"学习"当成 Agent 的一等公民来设计。

不是搜索历史,而是积累能力。不是记住对话,而是理解用户。不是一次性工具,而是越用越强的伙伴。

Agent 的终局,可能不是"谁更聪明",而是"谁更记得住、学得会"。

如果 Hermes Agent 的方向是对的,那么 AI Agent 的竞争,才刚刚开始。

🎋 顺便介绍一下小竹

小竹 是一款本地优先、会记忆、能主动的私人 AI 助手。

我们做小竹的初衷很简单:AI 助手不应该只是一个"问答机器",而应该是一个真正懂你、记住你、能主动帮你想事情的长期伙伴。

所以小竹有几个我们很在意的特点:

🧠 记忆飞轮:自动从对话中提取你的偏好、习惯和重要信息,越用越懂你

⚡ 主动引擎:不只是被动应答,而是基于记忆和模式识别主动提醒、主动关怀

🔒 本地优先:语音识别/合成、意图理解、记忆存储全部在本地运行,你的数据首先是你自己的

🧩 技能自进化:系统遇到能力缺口会自动创建新技能,越用越强

Hermes Agent 的"闭环学习"理念,和小竹的"记忆飞轮 + 技能自进化"有着异曲同工之妙。 不同的是,小竹用 Rust 实现,走的是本地优先路线——不需要 Python 运行时,不需要独立的模型服务,一个二进制搞定一切。

如果你对 AI Agent、本地助手、或者小竹本身感兴趣——

👇 欢迎来群里坐坐,一起聊。

💬 交流群

QQ 群:755265051

复制群号搜索即可加入 🙌

🌐 官网

https://xiaozhu-tec.cloud

欢迎访问,了解更多 🎋

本文提及的 Hermes Agent、Nous Research、Hermes 3/4 模型、agentskills.io 标准等内容均基于公开资料和官方文档整理。架构图和对比表以实际版本为准。

参考来源:

Hermes Agent 官方文档:hermes-agent.nousresearch.com/docs Hermes Agent GitHub:github.com/NousResearch/hermes-agent Hermes 3 Technical Report(arXiv:2408.11857) Hermes 4 Technical Report(arXiv:2508.18255) Hermes Function Calling:github.com/NousResearch/Hermes-Function-Calling agentskills.io 技能标准:agentskills.io CrabTalk 行业调查:crabtalk.ai/blog/hermes-agent-survey

夜雨聆风

夜雨聆风