我对着终端里修改了第 7 版的 agent 配置文件发呆。

prompt 写了 2000 多字,工具链配了 8 个,记忆模块也上了。按理说它应该很强。但实际用起来——怎么说呢,就像一个能力很强但完全不理解你工作习惯的新同事。你每次都要重新解释一遍"我平时喜欢这样处理"。

然后我看到了 Hermes-Agent 的 GitHub 页面。

6.9 万 Star。Python 语言。介绍语只有一句:

“The agent that grows with you.”

不是 “the most powerful”。不是 “the smartest”。

是 “grows with you”——和你一起成长。

这句话让我想了很久。因为过去半年,几乎所有 Agent 项目都在卷同一件事:更强、更快、更多工具。但 Hermes 反其道而行之,它赌的是另一条路——Agent 的终局不是能力,而是关系。

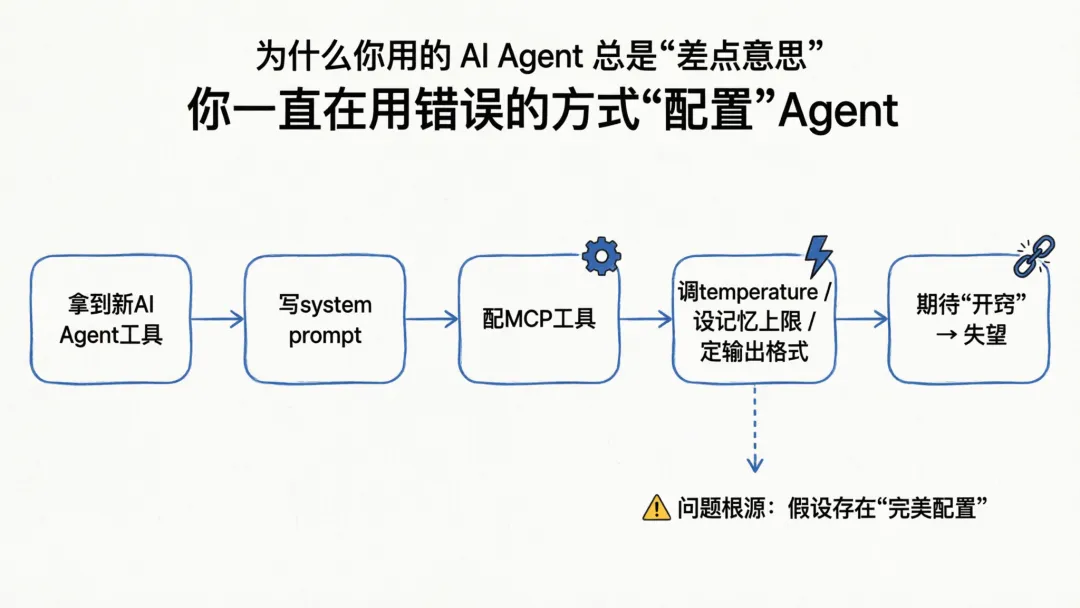

你一直在用错误的方式"配置"Agent

先说一个你可能没意识到的问题。

你拿到一个新的 AI Agent 工具后,做的第一件事是什么?

我猜是这些:写 system prompt、配 MCP 工具、调 temperature、设置记忆上限、定义输出格式。

这套流程本身,就是问题所在。

因为它假设了一件根本不存在的事——存在一个"完美配置",只要你参数调得够准、prompt 写得够细,Agent 就会突然开窍,变成你的专属智能助手。

但现实是:你今天的需求和三个月后不一样。你的工作流在变,你的偏好也在变。一个"一次性配好"的 Agent,注定会在某个时间点变得不合身。

就像你买了一件剪裁完美的西装。刚穿上很帅。然后你胖了十斤。

不是西装不好。是它不会跟着你长。

Hermes 的整个架构就是冲着这个痛点来的。它不做"最强配置",它做"最能适应变化的配置"。具体怎么做?三个层面。

第一层:渐进式复杂度

大多数 Agent 框架一上来就给你一堆能力:代码执行、文件读写、网络搜索、多步推理。听起来很爽。但新手根本不知道从哪里开始。

Hermes 的逻辑是反过来的——**先让你跑起来,再让你变强。**

它有一个明确的"成长路径":

•阶段一: 基础对话 + 简单工具调用。你能用它完成日常问答和单步任务。

•阶段二: 当你开始需要多步操作时,它会自动建议你启用工作流编排。

•阶段三: 当你有了固定的任务模式,它会帮你把这些模式沉淀成可复用的 skill。

这不是功能列表。这是学习曲线。

大多数框架把复杂度一次性倒给你,然后祝你玩得开心。Hermes 把复杂度藏在后面,等你撞墙了再递梯子。

这两者的区别,决定了你是"用起来"还是"配到放弃"。

第二层:记忆不是存储,是理解

说到记忆,几乎所有 Agent 项目都在比谁存得多、谁检索快。

但真正的问题不是"记不记得住",而是"理不理解"。

你告诉 Agent “我喜欢用 pytest 写测试”,它记下来了。下次你让它写测试,它用了 pytest。看起来不错。

但它不知道你为什么喜欢 pytest——是因为你们团队规范要求?还是因为你被 unittest 坑过?还是因为你就是觉得它语法简洁?

不知道"为什么"的记忆,只是数据。不是理解。

Hermes 在记忆层做了一个很微妙的设计:它不只存"你做了什么",它尝试推断"你偏好什么"以及"为什么有这个偏好"。

这意味着什么?意味着当你换了一个项目、换了一个技术栈,它不会机械地套用旧模式,而是会根据你的底层偏好做适配。

你以前用 pytest,现在项目用 Jest。它不会问"你要不要用 pytest",它会说"这个项目的测试框架是 Jest,按你的风格我这样写测试——"

这种"懂你"的感觉,才是 Agent 从工具变成伙伴的关键。

第三层:失败是数据,不是 bug

这是 Hermes 最让我意外的一点。

大多数 Agent 框架把失败当成异常处理——报个错、回滚、重试。完事。

Hermes 把失败当成训练信号。

当你纠正它"不是这样做,应该那样做"的时候,它不只是执行你的指令。它会把这次纠正记录下来,分析"我为什么会犯错",然后更新自己的行为模式。

换句话说:你每次骂它,都在训练它。

这不是什么黑科技。这是一个设计选择——你愿不愿意把"犯错"当成成长的机会,而不是系统的缺陷。

大多数框架选择了后者,因为它们想要"稳定"。Hermes 选择了前者,因为它想要"进化"。

为什么大多数 Agent 框架做不好这件事

说到这里,你可能会问:这听起来不难啊,为什么别人不做?

因为这件事和"快速迭代"是冲突的。

做一个"渐进式复杂度"的 Agent,意味着你要花大量时间设计新手路径、埋点、判断用户什么时候该升级。这些事情不会出现在 release note 里,也不会让 Hacker News 给你点赞。

做一个"理解型记忆"的 Agent,意味着你要处理模糊的偏好推断、处理冲突的用户信号、处理"我昨天说 A 今天说 B 你该听哪个"的哲学问题。

做一个"失败即训练"的 Agent,意味着你要接受产品永远不完美——它一直在变,一直在调整,永远没有一个"最终版本"。

这三件事,对投资人不好讲,对 PR 不好写,对工程师不好做。

但它们对用户极其重要。

因为用户不在乎你的架构多优雅。用户只在乎一件事:**这个玩意儿能不能让我少操点心。**

Hermes 能长到 6.9 万 Star,不是因为它技术最先进。是因为它第一个认真回答了这个问题。

你现在可以做什么

如果你也在用 Agent,但总觉得"差点意思",我建议你做三件事。

第一件事:换一个角度评估你的 Agent。

不要问"它能做什么"。问"它懂我多少"。

具体做法:让它处理一个你经常做的任务。然后观察——它是机械地执行,还是会根据你的历史偏好做调整?如果它每次都需要你从头教起,那问题不在你,在工具。

第二件事:试试"渐进式"的 Agent 框架。

Hermes 是目前这个方向上最成熟的选择。GitHub 搜 NousResearch/hermes-agent,Star 6.9 万,Python 写的,文档齐全。

但重点不是用哪个工具。重点是改变你的使用方式——不要一上来就配齐所有功能。从最简单的场景开始,让它跟着你的需求一起长。

第三件事:把你的"纠正"当成训练,而不是抱怨。

下次 Agent 做错事,不要只是关掉重来。花 30 秒告诉它"应该这样做"。大多数框架不会利用这个信号,但 Hermes 会。

而且就算你用的不是 Hermes,这个习惯也会让你成为一个更好的 Agent 使用者——因为你在教它,而不是在忍受它。

最后一句话

Agent 不是工具。

工具是锤子。你用它钉钉子,它不会因为你用了 100 次就变得更懂你的力度和角度。

但 Agent 应该是伙伴。伙伴的特点是——你们一起经历过一些事,然后它开始知道你在什么情况下会做什么决定。

Hermes 的 6.9 万 Star 说明了一件事:越来越多人意识到了这一点。

问题不再是"AI 够不够强"。

问题是:你的 AI,愿不愿意和你一起长。

夜雨聆风

夜雨聆风