点击上方蓝字“新闻与写作” ▶ 右上角“…” ▶ 设为星标★ 好内容 不迷路!

阅读准备

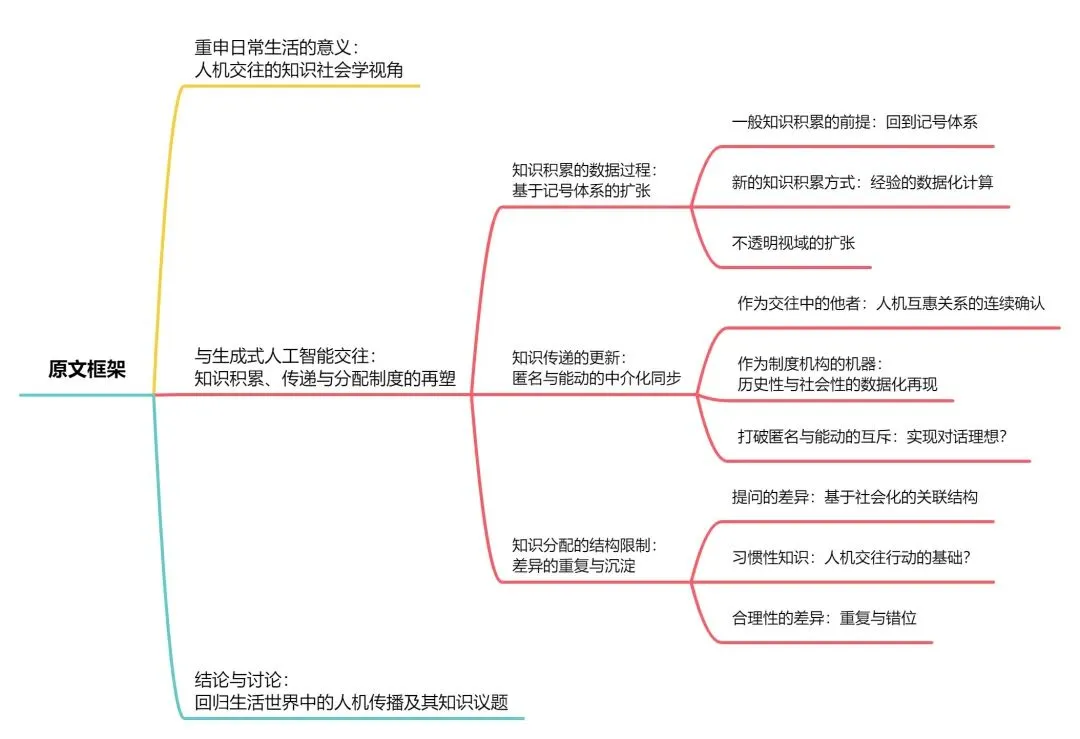

生成式人工智能正在改变知识生产与传播的方式。现象学知识社会学的视野将知识置于以日常生活为导向的交往过程中,有助于观察生成式人工智能给日常生活知识制度带来的变化。

本期推荐的论文发现:在知识积累方面,生成式人工智能通过对海量的文字、图像、代码等多种符号的收集和处理,构建了以日常生活知识为核心的数据知识库,其内容更容易被看作“理所当然”,却无法探究其来源和逻辑;在知识传递方面,机器虽仍像学校、媒体这样的制度机构一样,与个人传播意图相分离,但能通过与用户持续、动态的对话,建立起一种互惠的交流关系;在知识分配方面,提问情境仍受限于既存分配结构,但工具使用技能的重要性被削弱,对回答的判断能力要求却在提升。这种人机交往样态正在持续影响后续的知识积累、传递、分配。

省流版干货提炼

●生成式人工智能的介入正在进一步促使日常生活知识制度发生转变。在现象学知识社会学的视角下,本文依据人机传播的特点,试图将日常生活知识制度分为知识积累、传递与分配三个相互依赖的构成,探究在生成式人工智能的介入下,原有的日常生活知识制度如何延续、更新。

● 生成式人工智能改变了主体间经验沉积、融合后进入共同知识库的过程,也偏离了以用户行为为导向的数据收集。生成式人工智能以对记号体系的经验性计算为基础,实现了对人类一般知识的数据化积累,却也导致了日常生活不透明领域的扩张。

● 生成式人工智能既是庞大数据知识库,又切实参与着社会交往,正延续并更新着既有的知识传递形式。其能够与用户多次确认彼此间的互惠关系,也使其成为一个具有长期意义取向的制度机构。随着匿名性和能动性的互斥关系被打破,客观解释图式灵活地达成一致成为可能。

● 知识传递方式的更新看似使其知识分配全然依赖于用户主动地获取,但实际上仍受制于关联结构的社会差异,包括习惯性知识与合理性标准的差异。其中习惯性知识重要性似乎在减轻;合理性标准的差异则凸显,甚至存在交往中的错位。

更多内容看这里

重申日常生活的意义:

人机交往的知识社会学视角

在现象学知识社会学的理论视域下,知识生产和传播都嵌入于主体间交往行动中的活动。这种交往行动以日常生活世界为基本背景。知识不仅是传播的内容,还是在主体间的交往过程中形成的意义。

日常生活知识制度至少包括两个循环交融的社会过程。其一是知识形成过程。主观意识体验被转化为典型的外在过程或物体,抑或特定的符号系统,从而实现客观化。如果这种知识与他人相关,便可在主体间交往中沉淀下来进入社会知识库,并被例行传递到下一代,从而实现知识的积累。其二是知识传递的过程。经由与重要他人、次级社会化机构和非重要他人的互动和交往,社会知识库中的知识成为个人主观知识库的组成部分。

此外,在日常生活惯例中,社会知识库与个人主观知识库之间存在某种结构性关系。这便是知识分配问题。这种分配关系在过去显然是由社会角色和劳动分工决定的。知识的积累、传递与分配构成了日常生活知识制度的基本层面,其中存在着被人们视作理所当然的日常惯例,定义了何为知识与如何传播的问题语境。

然而,当下的数据化已经带来了新的社会知识制度:知识的沉淀通过数据化收集产生,而不是主体间互动;基于数据的算法介入到人们获得知识的过程之中;这种知识分配的社会角色基础同样由平台算法所定义的分类与范畴决定,由此引发“信息茧房”“过滤气泡”等忧虑。

生成式人工智能则代表了这种传播自动化进程的全新一步。其实现的主要目标已从信息分发的自动化变为信息生成的自动化,在人与信息、人与人相遇过程发生变化之前,首先导致了信息本身、人类交流对象本身的变化。新的自动化目标嵌入到旧的目标之中:一些平台仍在既有算法基础上尝试在多个环节应用生成式人工智能。由此,现实的中介化建构过程中,社会知识的客观化不再仅仅是对用户行为的数据化,社会知识的主观化也不再仅仅意味着对人们的社会行动的制约。

与生成式人工智能交往:

知识积累、传递与分配制度的再塑

知识积累的数据过程:

基于记号体系的扩张

一般知识积累的前提:回到记号体系

客观化,是主观经验的一种外化过程,使得个人内在意识体验可以被他人理解。用户在数字媒介传递的个人体验,首先以人类交流常用的记号表达出现,其次这些记号内容被进一步数据化与客观化。对当下以大语言模型为核心的人工智能而言,这些数据不仅被用来识别和分类用户及其行动,还被反过来用以识别人类知识积累的重要基础——记号体系。

每一种自然语言都是在主体间交往中建立的、经过历史存储和社会传递的记号体系,因此人们总是能够对相同的词汇和语句做出相似的解释。但在具体的交往情境中,我们往往不仅需要理解语词在字典上的客观含义,还需要理解它们在情境中的主观与偶然出现的含义。这种含义可能和说话者的身份、语气、交往行动的时机等情境要素相关。

与此相比,形式逻辑记号体系的主导规范要求彻底脱离主观经验。纯粹形式逻辑建立在“非真即假”的二值基础上,只关乎思维之形式而非内容,并与经验无关。然而,在科学系统的实际运作中,形式逻辑仅是其程序核心而非全部。在这一语境下,两种不同的记号体系尽管存在本质差异,却都在不同程度上服务于现实的交往目的与情境。

对于生成式人工智能而言,记号体系不仅构成知识,还维系着社会知识库的传递:自然语言是人类每一个现实建构的主要手段,也是传递在历史和社会上已经建构起来的现实的主要媒介;形式逻辑则定义了一个理想事物和完美关系构成的世界,超越了特定历史与社会的限制。对记号体系的数据化识别,是其积累人类社会知识的基础,也为其参与人类社会知识的积累与传递提供前提。

新的知识积累方式:经验的数据化计算

在知识积累的方式上,不同记号体系并不兼容。许多这样互相不兼容的解释图式存储在人类的日常生活知识库中:它不是逻辑上一致的系统,而是沉淀下来的、受到情境限制的诸多解释的总和。这种不兼容并未对人类理解他人与世界提出根本上的难题,然而,这却是生成式人工智能试图从不同记号体系中积累知识时所面临的基本挑战。

一些研究者将大语言模型推理能力的发展过程对应到人类的思考过程,将其描述为从直觉型、自主运行的快思考到耗费力气、需要注意力的慢思考,并与不同的推理工具相对应。在大语言模型中,形式逻辑所揭示出的世界被视作生活世界的派生,科学推理机制则被视作日常推理的某种变形。

基于此,生成式人工智能在记号体系的基础上,生产了一种新的数据化且经验性的共呈关系:通过数据计算构建“标记(token)”与其表示对象的经验联系。从主观经验到记号、从记号到数据标记,这种对客观化的再客观化,似乎让自然语言记号体系在使用上进一步脱离了人类主体间的具体交流情境。从记号体系中产生的经验性的数据标记拥有与自然语言更为近似的能力,形式逻辑仅仅作为日常生活的派生世界中所使用的符号。也就是说,人们在什么时候需要形式逻辑构成的知识,事实上依赖于机器如何理解自然语言所定义的交往情境。

这种新的共呈关系是对记号体系中内含经验的数据化计算,其后果则是形成了一种关于记号体系的记号体系,其中存储着人们使用原有记号体系积累的知识。这种知识经过了双重的客观化过程,却仍以经验的方式试图召唤自然语言共呈的直观体验,甚至试图以此为基础,召唤形式逻辑共呈的真值。不兼容的记号体系,得以以自然语言为基础,经由经验计算,共同存储于数据知识库中,等待交往情境的召唤。

不透明视域的扩张

在发现问题前,我们总是“理所当然”地使用我们拥有的知识。但是关于日常生活的社会知识库总是或多或少地不透明。生成式人工智能的数据知识库又在多大程度上对我们来说是透明的呢?

在数据知识库中,正存储着来自社会知识库传递且经由经验计算而沉淀下来的或多或少被检验过的经验,但其总量远超作为有限生命的我们所能在生活体验中亲身检验的知识。学习者很容易将其中的知识看作是理所当然的、无须解释的,只有在出现问题时,我们才会进一步探究答案为何如此。在此情形下,在日常生活领域,机器所提供的理所当然的事物正在增加,这些事物背后不熟悉、不确定的领域也正在逐渐增长。

与此同时,对数据的经验性计算造成的后果之一,便是将形式逻辑的解释图式放置于具体交往情境的语境之中。于是,该意义领域中的透明事物也同样被不透明的视域包围。也就是说,“黑箱”并不是新技术的专属,而是我们日常生活领域的延续与扩展。

因此,尽管双重客观化与不透明领域的增长使我们通常摆脱了“有问题”情境的出现,但如果想要在日常生活实践中试图阐明这一数据知识库所提供知识的可靠根据,人们不会去评估这些计算处理方式是否可靠,也难以追溯记号中原本存储的知识是否可靠,而是更依赖于另一个过程:人机交往。其中,机器的数据知识库既与社会知识库一般丰富,又像他者一样与我们互动。

知识传递的更新:

匿名与能动的中介化同步

作为交往中的他者:人机互惠关系的连续确认

“社交线索”越多,拟人化便越能够实现。在面对面交往中的他者可能展现出的社交线索往往最为丰富。这也造成了人们对社交在场感的理解。在这样的视角下,机器越像人,就越能减少人们使用机器所需的认知工作,从而产生积极的效果。

这种拟人化的效果之所以成立,正是由于在交往行动中,无论是通过记号还是面对面,我们都必须面对一种关于他者的假设。在中介化交往中,这种体验演变为一种“双重中介性”。我们需要通过书信、电话、推文寻找那些来自他者的征象(第一重中介),而后验证他者的假设是否真的存在(第二重中介)。确认他者似乎变得更加困难,我们只能在获得的回答中寻找来自他者的征象,以验证他者的存在。例如在我们提出问题后,搜索引擎提供了一系列不同的链接排布供我选择,我发现这并不是人类交流的特征,于是否定了电脑界面的背后是一个他者在与我交流。但如果机器回答道“让我来告诉你怎么做……”,我便可能假设是他者在进行回答。

当然,仅仅回应不足以达成“征象的丰满性”。当向机器提问时,我行动的目标,也就是目的动机往往是希望得到某种答案,如果用户认为机器的回答就是自己想要的答案,那么用户的问题就确实构成了机器回答的原因动机。这种动机关联的交往,曾经被视作仅仅在人类交往之中发生,所以是确认他者的一个重要“征象”。更重要的是,交往行动中的双方在其中构成了一种基本的互惠关系。机器提供的答案或多或少满足了提问者的期待,因而能够被提问者积累到自己的主观知识库中。

然而,在中介化交往中,这种互惠关系的构成需要在一连串相遇中展开,因而也意味着一系列的假设。对于搜索引擎、在线课程等过往的数字化知识传递形式来说,要跨越“双重中介性”显得尤其困难。因此,对人机之间互惠关系连续确认的能力,是生成式人工智能知识传递之形式更新的重要特征之一。

作为制度机构的机器:

历史性与社会性的数据化再现

中介化交往的另一特点是,假设性他者作为传播源具有不同程度的匿名性。我们越是靠近共同世界,面对的他者便愈加匿名化,我们也越是倾向于以类型化的解释图式理解他人和他们的行动。

我们从机器与制造者之间的关系中解释所有生成式人工智能生产的内容,无疑通常是徒劳的。换言之,这种制造品拥有极高的匿名性。如果我们在向生成式人工智能索要旅行计划,并收到了符合我提问目的的结果,那么我可以将此解释为机器提供了一份旅行计划,也可能将其解释为制造者希望通过机器为我提供一份旅行计划。然而,生成式人工智能的数据知识库所能提供的解决方案远超任何个人,制造者是否真的希望机器为我提供这份计划,就显得不足为道。即使制造者不愿其制造品提供某一方面内容,这种控制也未必能够达成——人工智能“价值对齐”面临的困难也在于此。

在此背景下,凡登豪尔建议进一步将机器人定位为一种制度机构,因此具有长期的行为模式和意义取向。但是这种制度机构显然与学校、电视台等与传播对象动机关联保持相对不变的传统机构有所不同。在生成式人工智能的知识传递中,一方面,动机关联仅仅在最底层的方面不会改变,或许机器只会假定他们的用户需要在交流中被回应;另一方面,其意义取向的长期性并不表现在由历史与社会沉淀而成的固定动机关联中,而是奠定在其对社会知识库的数据化积累之上,是记号体系中内含历史性与社会性的再现。

打破匿名与能动的互斥:实现对话理想?

根据对你每一个当下状态的认识,机器对“你”的理解不断增加,最终可能与“你”对自己的理解达成一致。我们也可以在人机陪伴或亲密关系中发现对这种体验的追求。从撒播到对话的失败本质上不源于身体是否在场,而是源于互惠关系能否在一次、再一次地相遇中连续达成。如身体在场一般的征象丰满性难以达成,并不意味着“我们关系”中的理解一致性不可能实现。

一方面,记号体系的数据化计算,使机器积累了诸多社会知识库中共享的解释图式,充满着可被用户视作理所当然的知识,表达一种在历史与社会中长期沉淀的意义取向。这是其作为制度机构之匿名性的体现。另一方面,通过提问与回答的连续进行,机器能够构建基本的互惠关系,机器与用户之间始终是可彼此询问的,机器变得好像有信念、愿望和意图去了解我们,由此双方能在每一次交流中增加对对方使用记号之主观意义的理解,从而达成解释图式的一致性。可以说,生成式人工智能与人类交流的理想状态,意味着人机共享的解释图式既具有客观化的属性,又可以连续不断变动,从而一次、再一次地实现解释图式的一致性。

彼得斯认为,对话之交流理想的一部分失败原因,便在于匿名机构提供内容与受众完美匹配的不可能。但生成式人工智能似乎打破了这种匿名性与能动性的互斥关系,用户总是能获得自己期待的答案,从而内化到自己的主观知识库中。这种知识可以具有不同程度的匿名性,既可近乎私人,又可以是广泛共识。

然而,彼得斯对于对话还有另一层忧虑:即使我们对对话的交流理想投射了对公正与真实的道德期盼,希望它可以限制不假思索的权力滥用,却仍然并不能逃避这一后果。这说明,以对话为形式的知识传递仍然嵌入在社会知识库与主观知识库的结构性关系中。

知识分配的结构限制:

差异的重复与沉淀

提问的差异:基于社会化的关联结构

生成式人工智能拥有着人类使用记号体系积累下来的诸多典型问题及其解决方案,又总是可以依据问题提供与其解释图式一致的回答。所以无论用户提出什么主题的问题、可以接受什么样的解释,它都可以提供与之具有紧密关联性的答案。

从数据知识库进行知识分配意味着用户作为知识传递的受众不再处于被动地位。一方面,理想上,如果得到答案的时间足够短,我们可以提出近乎无限多与我具有或多或少关联性的问题,使我们的主观关联结构得到无限扩张;另一方面,面对一个有问题的情境,我们也能够更容易地通过关联性的匹配,获得想要的解释,使既有的关联结构得到进一步强化。

但沉淀在我们主观知识库的主观关联结构是很大程度上社会化了的,结构性的知识分配决定了被传递的社会知识与谁关联、如何关联。因此,我们实际只会询问与日常生活的实用情境有关的问题。生成式人工智能更新了的知识传递形式,貌似使知识分配依赖于一个主动的知识获得过程,能够极大程度地拓展自身的主观关联结构,却仍以既存的结构性分化为基础,且受到生命时间的限制。这种分化通过在互惠关系之中的提问差异,进一步沉淀于用户的主观知识库中。

习惯性知识:人机交往行动的基础?

在被传递的社会知识中,习惯性知识是影响机器具体使用的基础因素。其把人类交往过程中对媒介工具的使用视作日常生活惯例的组成部分,并广泛接受这些工具作为某些行动过程的解决方案。

一方面,这种“习惯性知识”涉及“技能”。随着惯例重复地使用,问题解决逐渐能够自动地、标准化地进行。然而,需要使用数字技术的情境对于一些人来说,始终是存在问题的:例如技术的可访问性,或是在技术接受上受到社会影响等。

另一方面,使用生成式人工智能还需要一种更为具体的习惯性知识——“处方知识”,这种知识与技能有所重叠,但拥有更具体的获得和使用情境,包括“提示词”学习、特定的个性化智能体训练等,既可以在与机器的持续交往中获得,又可以在他人经验的客观化结果中习得。

技能与处方知识不仅是我们在人机互动中获得其他一般知识的行动基础,还是我们获得角色专属知识的行动基础。由此,习惯性知识的分配也导致了其他社会知识分配的差异。如果要尝试弥合这种分配不公,习惯性知识的传递与培养至少显得更具可行性。但问题在于,当机器的交流能力不断增强,其所涉及的习惯性知识逐渐无限接近于本就惯例化的日常生活交往,而无需特殊的处方知识甚至技能之时,这种减轻差异的路径是否还能行得通?

合理性的差异:重复与错位

如果机器的回答没有满足用户的真实性要求,但用户却愿意让对话继续进行,那它的回答可能是满足了正确性要求、真诚性要求等其他合理性评判标准。因此,合理性标准也是关联结构的一个重要层面。也就是说,人机交往间合理性标准的典型相似性,也是互惠关系得以达成的条件之一。

我们为什么接受这种标准而不接受另一种,同样也与社会知识的结构性分配相关。现代科学所使用的合理性标准是一种真实性标准,或是要求行动者将自己的感知和意见与世界中客观存在的事物统一,或是要求行动者让客观世界中存在的事物与自身的愿望和意图吻合。秉持此种有效性要求的人群,在人机交往中也以此标准要求机器的表达。棘手的是,数据知识库将形式逻辑的知识建立在了由自然语言构成的经验性的世界之上,机器提供的内容是否符合真实性标准,取决于用户是否用能力和意愿去评判其表达是否与客观世界相统一、是否能够实现自己在客观世界中的目的。

一方面,用户采用真实性标准的能力与意愿同样取决于既有的社会知识分配,尤其是社会角色的差异。另一方面,以这种关联结构为主导的交往情境,总是能够使人们获得实现更高可信度与权威性的知识。因此,相比习惯性知识的差异,合理性标准的分化更依赖于交往情境与社会角色,导致在人机交往中知识分配的差异,乃至知识所属现实领域的错位。

在知识积累、传递与分配三个层面,生成式人工智能的介入都整体上再塑了人们的日常生活制度,延续并拓展了现实的交往建构过程。这些探讨将人工智能的知识议题置于生活世界的交往行动中,与人机传播领域的经验研究与相关理论深刻呼应。事实上,日常生活知识制度在多大程度上被生成式人工智能改变,仍取决于这种人机互动在多大程度与范围上已经与人们日常生活的交往行动相互交织。在这持续的相互依存的交往行动中,生成式人工智能参与所导致的变化仍在再度型构的过程之中。

作者介绍

金之玥:中国社会科学院大学新闻传播学院博士生、奥地利维也纳大学社会学系访问博士生;杜智涛:中国社会科学院大学新闻传播学院媒介与社会发展研究中心主任、教授、博士生导师

本文为原论文节选版,内容有删改和编辑,原载于《新闻与写作》2026年第2期,注释从略。

学术引用及文献参考请以纸质版为准,未经授权,严禁转载。

投稿请登录https://xwxz.cbpt.cnki.net/

订阅纸质刊物请致电010-85201321

商务与广告合作请致电010-65595210

夜雨聆风

夜雨聆风