01 OpenClaw 的本质

小龙虾的本质,是为用户构建一个完全属于自己、在本地设备上运行的高级人工智能系统。 可悲的,在各种厂商的圈地一样的宣传下,99%的中国大陆区域的人,根本不知道真正AI是什么?和OpenClaw到底能做什么?

02 云厂商为什么推动套壳产品?

| 维度 | 云端 OpenClaw (SaaS) | 私有化部署 OpenClaw (AI Native) |

| 数据安全性 | 数据流向公网,存在隐私泄露风险 | 数据物理隔离,核心资产本机 |

| 响应速度 | 受限于网络带宽与公云调度,存在波动 | 内网毫秒级响应,生产流转无缝衔接 |

| 定制化程度 | 通用模板,难以深入行业垂直逻辑 | 深度适配,可针对特定行业知识库微调 |

| 成本控制 | 按量计费,高频使用下成本不可控 | 一次性投入,边际成本随使用量增加而递减 |

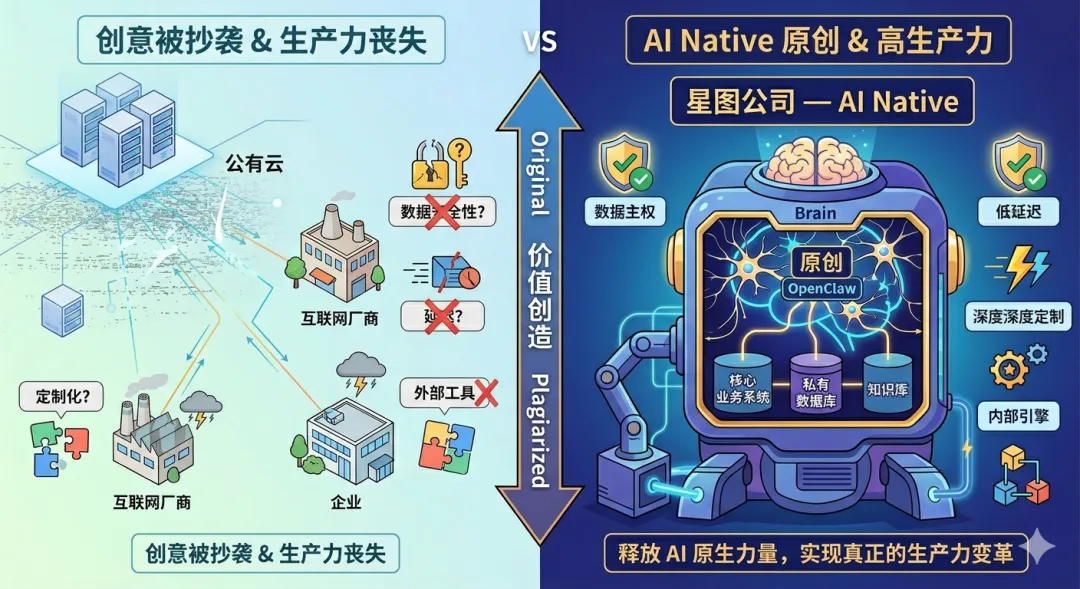

03 星图AI为甚么主张反套壳,回归本质

总结一句话: 云厂商推套壳是为了让你依赖它;星图倡导 AI Native 私有化是为了让你变强大。

04 OpenClaw的核心能力

1. 异构模型:顶级模型各司其职

原生部署允许你同时运行并管理多个顶级大模型(LLMs),实现“术业有专攻”:

智力型龙虾: 接入顶级通用大模型(如 Llama 3 或星图定制模型),负责复杂的逻辑推理、文案创作和战略规划。

计算型龙虾: 接入专门针对代码优化的模型,处理高难度的编程、自动化脚本编写及漏洞检测。

轻量化龙虾: 部署在本地边缘设备上,使用 7B 或更小的模型,负责低延迟、高频次的指令转发和实时监控。

2. 龙虾统帅制:层级化管理与指挥

这正是原生 OpenClaw 的精髓——“一只龙虾指挥一群龙虾”:

总控龙虾(Commander): 负责理解用户的高级意图,将其拆解为多个子任务。

执行龙虾(Workers): 接受总控龙虾的调度。例如,总控龙虾命令“代码龙虾”写出控制算法,命令“分析龙虾”检查算法效率,最后汇总结果。这种分布式治理架构,彻底解决了单一模型处理复杂业务时“顾此失彼”的问题。

2、原生 OpenClaw 的正确用法:全场景生产力释放

如果你仅仅把 OpenClaw 当作聊天工具,那是对 AI Native 力量的极大浪费。以下是原生私有化部署的正确“打开方式”:

1. 极客式编程:全自动代码闭环

深度集成 IDE: 原生龙虾直接读取你的本地工程目录,理解整个项目架构。

自主迭代: 你只需提出需求,它会自动写代码、跑单元测试、根据报错信息自主 Debug,直到代码完美运行。因为它在本地,它可以安全地访问你的编译环境。

场景:构建电商独立站

2. 金融与股票:私有数据实时洞察

全量接入: 接入你私有的研报库、实时行情接口和历史交易数据。

策略演习: 利用 10万+ Skill 中的金融分析组件,原生龙虾可以 7×24 小时不间断监控全球市场波动,并在本地进行回测,所有的核心交易策略和敏感数据绝不上云。

场景:量化交易

3. 工业与机器人控制:物理世界的指挥官

低延迟控制链: 原生 OpenClaw 通过本地协议(如 ROS、MQTT)直接与机器人硬件连接。

自然语言交互: 你可以对它说:“把那个红色零件拿到 2 号位”,总控龙虾会计算路径,指挥负责视觉识别和机械臂控制的子龙虾精准完成任务。由于是内网连接,响应延迟达到了工业级标准。

场景:机器人控制

4. 商业机密情报站:10万+ Skill 的组合拳

多源融合: 调动 Skill 抓取行业动态,配合本地的竞品数据库。

深度推演: 龙虾统帅会指挥“情报龙虾”进行 SWOT 分析,指挥“创意龙虾”生成应对策略。所有的推演过程都在企业防火墙内完成,确保商业机密万无一失。

场景: 竟对分析,公司调研

夜雨聆风

夜雨聆风