最近使用比较多的文生图模型,和文生视频模型,以及看短视频的时候,发现一个问题,对于图片中带有中文描述的产物,或者视频里面带有中文的,比如手机,电脑里面的文字。中文的文字字体会发虚,而且很多的中文字是错误的,写得很挤,挤在一起,看起来一眼就是假的。不管是nano banana还是sd 2.0好像都有这种问题。

比如下面的图片,这里的"图"字就看着很别扭:

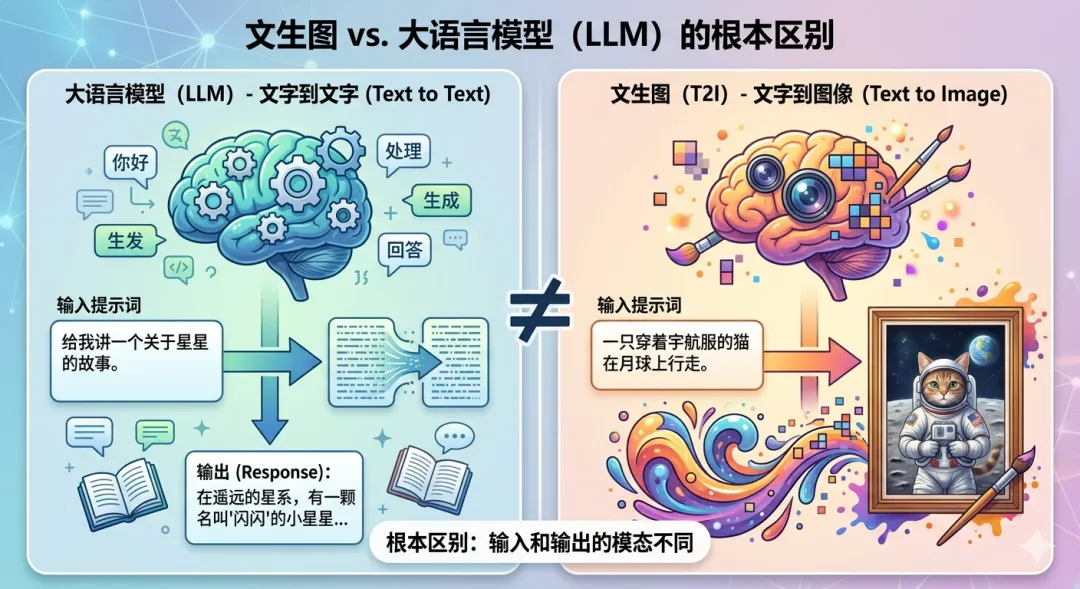

于是,我就问了下AI,记录一下答案:

一、它在“临摹纹理”,而非“理解语言”

比喻:不懂中文的外国画家在复刻残卷

目前的文生图模型(如 Stable Diffusion)底层是扩散模型。它的逻辑是:从一片噪声中,通过去噪逐渐“抠”出图像。简单说,就是一点一点画出来的,但是不理解文字,可能它知道怎么画字,但是不知道字的意思,也不知道怎么写字。

非逻辑性建模: AI 并不把文字当成符号,而是当成一种“视觉纹理(Texture)”。

只求“神似”: 在 AI 眼里,汉字和一朵云、一簇草没区别。它知道某块区域应该出现一些“方块状的墨迹”,但它不知道这是“银行”还是“行李”。因为它不识字,所以它根本不在乎字与字之间是否需要留白,最终导致笔画粘连,像被雨淋透的春联。

二、“组合式”与“整体式”的错位:中英文难度天差地别

比喻:拼积木 vs 搭榫卯

为什么英文就画得好?这涉及到了核心的编码逻辑。

英文是“线性组合”: 只有 26 个字母,结构极其简单且规范。即便 AI 把 a 画得像个圆圈,你根据前后的单词语境也能瞬间“脑补”成功。这叫高容错率。

中文是“整体式编码”: 汉字是复杂的二维结构,几千个常用字,每个字都是一套严丝合缝的“精密榫卯”。差一撇一捺就完全不可读。AI 这种“走一步看一步”的生成方式,只要一处榫卯没对齐,视觉上瞬间崩塌。

三、“局部优化”导致“全局崩坏”

比喻:走一步看一步的“盲人摸象”

扩散模型不是一笔一画写字的,它是在每一步去噪中优化局部像素的一致性。

缺乏全局约束: AI 在画左边偏旁时觉得挺好,画右边时逻辑断了,于是强行缝合。

结果: 导致你看到的文字局部看起来对,整体全是错。这种“局部合理、全局混乱”的矛盾感,正是中文“一眼假”的元凶。

英文更“标准”: 训练集里的英文大多是标准的 Logo、UI 或海报字体,间距规范,且被明确标注。AI 学习起来像是在看课本。

中文太“多变”: 训练集里的中文涵盖了黑体、宋体、手写草书甚至是变体的艺术字,排版还有横有竖。对于 AI 来说,它学到的是一堆不断变化的、不可捉摸的纹理,很难形成稳定的视觉记忆。

比喻:南辕北辙的“翻译官”

文生图的第一步是文本编码(CLIP/T5)。

理解断层: 英文的 Token 粒度通常很合理(单词或子词);而中文在切分时,有时候按字,有时候乱切。

视觉对齐失败: “文本理解层”和“图像生成层”之间存在严重错位。当指令传到画笔上时,已经变成了模糊的形状暗示,而非精确的字符指令。

目前,纯扩散模型(Pure Diffusion)已经快触及天花板了。要解决中文“鬼画符”,商业工具通常采用以下“外挂”:

显式建模: 给 AI 植入“字形库”(Glyph-aware)。

两阶段生成: 先画图,再单独用排版引擎“渲染”文字。

文字控制层: 类似 ControlNet,强行给 AI 规定字长在哪里、长什么样。

夜雨聆风

夜雨聆风