《AI换脸技术中人格权的侵害与应对——以网络平台的义务与责任为中心》

AI换脸技术正在侵犯你的人格权?网络平台的责任与出路

一场技术狂欢

背后的法律与伦理拷问

你是否曾在抖音、B站上看到过“杨幂换脸朱茵”的视频?是否曾被“雷军AI配音”的恶搞内容逗笑?这些看似有趣的AI换脸内容,背后却隐藏着对个人肖像权、隐私权、名誉权的严重侵害。

随着人工智能技术的飞速发展,AI换脸(Deepfake)技术已从实验室走向大众视野。2025年全国两会上,雷军、李东生等代表委员纷纷呼吁加快AI换脸拟声领域的立法治理。在这一技术滥用愈演愈烈的背景下,网络平台作为内容传播的核心载体,究竟应承担怎样的义务与责任?

本课题组通过对381份普通网民问卷、62份网络平台提供商问卷的调研,结合国内外典型案例与法律法规分析,系统梳理了AI换脸技术中人格权侵害的现状、问题与应对策略。

一、AI换脸技术:

从娱乐工具到侵权利器

技术原理简述

AI换脸技术基于深度学习,尤其是生成对抗网络(GANs),通过编码-解码框架实现人脸特征的提取与替换。自2017年“deepfakes”事件以来,技术门槛不断降低,普通用户也可轻松实现“一键换脸”。

应用广泛,风险并存

AI换脸技术在影视制作、社交媒体、广告营销、虚拟主播、医疗教育等领域展现了巨大的商业与社会价值。例如,电影《我和我的祖国》中演员的“年轻化”处理,快手“可灵”模型的创作效率提升等。

然而,技术的便利也带来了滥用的风险。从美国女明星的色情视频换脸,到国内高中生盗用同学照片拼接裸照,再到李玟、张国荣等已故明星被“数字复活”,AI换脸已成为人格权侵害的重灾区。

二、人格权侵害的五大类型

课题组归纳出AI换脸技术中常见的五种人格权侵害类型:

1. 侵害肖像权

典型案例包括“杨幂换脸朱茵”事件、美国斯嘉丽·约翰逊换脸色情视频等。未经授权使用他人面部特征,即构成对肖像权的侵犯。

2. 侵害隐私权

如李玟去世后被“复活”并传播,侵犯其近亲属的情感与隐私权益。

3. 侵害名誉权

网红“@小野”被AI换脸至不雅视频,评论区造黄谣;车模叶凯薇面孔被拼接淫秽视频,名誉严重受损。

4. 侵害声音权

雷军AI配音恶搞视频、古天乐林峯“被代言”赌博游戏,均属声音权的典型侵权。

5. 侵害个人信息权

如抖音网红吴某的原创视频被换脸软件商业化使用;深圳市民被AI换脸合成不雅照敲诈勒索。

三、网络平台面临的五大现实困境

尽管法律上已有人格权保护的基本原则,但在AI换脸技术面前,网络平台的治理能力显得力不从心。

1. 操作门槛低,监管难度大

55.91%的受访者使用过AI换脸技术,82.94%了解操作流程。技术普及化使得侵权内容爆发式增长,平台难以实时精准识别。

2. 告知义务履行不合规

多数平台在用户授权环节存在“默认勾选”“一揽子授权”等问题,肖像权使用条款藏匿于冗长隐私协议中,用户难以真正知情。

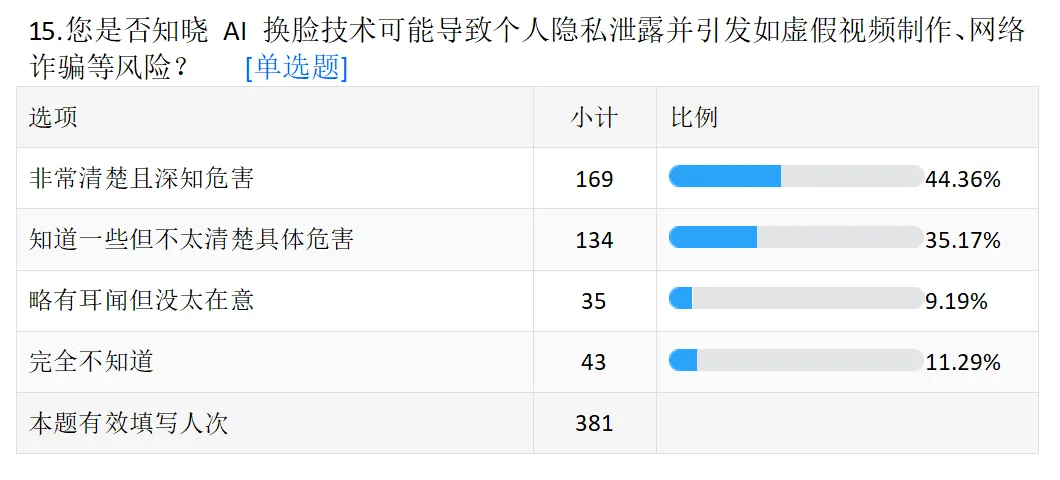

3. 公众风险认知不足,平台传播责任缺失

多数用户将AI换脸视为娱乐工具,对隐私泄露、名誉损害等风险缺乏警惕。平台的警示信息流于形式,审查机制缺失,侵权内容易被算法推荐放大。

4. 侵权处理效率低,制度缺位

多数平台采用“先传播后处理”的被动模式,投诉入口隐蔽,证据留存机制不健全,跨平台数据流动加剧追溯难度。

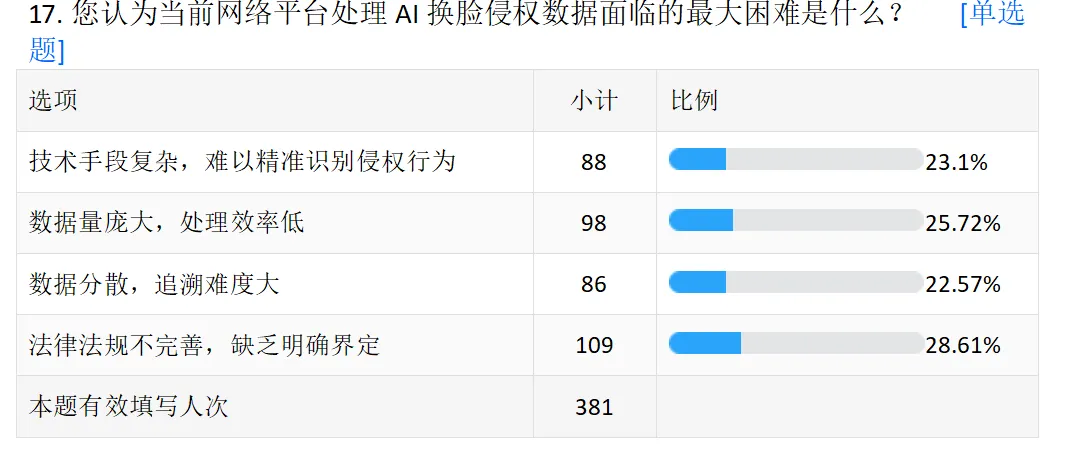

5. 责任主体界定不明

现行法律对平台在AI换脸内容管理中的义务边界规定模糊,平台常以“技术中立”为由推卸责任,导致受害者维权成本高、周期长。

四、国外经验:立法与技术并重

美国:立法与技术双管齐下

(1)国防高级研究计划局(DARPA)启动“媒体取证”项目,开发识别Deepfake的技术工具。

(2)加州、弗吉尼亚州等立法禁止非自愿换脸色情内容。

(3)Twitter、YouTube等平台要求上传者标注合成内容。

欧盟:GDPR与DSA构建强监管框架

(1) GDPR赋予个人对其肖像、声音等数据的控制权。

(2) 数字服务法案(DSA)要求平台对用户生成内容承担严格审核责任。

韩国:快速立法与平台责任强化

(1) 2020年女明星换脸色情案推动《信息通信网法》修正案,违法者可判5年有期徒刑。

(2)Naver等平台因审核不力被批评,后加强技术检测能力。

日本:平台审核义务提升

(1) 虚假医疗广告换脸案中,YouTube因未能防止内容再次上传受到批评。

(2)法律要求平台建立快速举报响应机制。

五、对策与建议:构建全链条保护体系

1. 明确平台的审查与检测义务

(1) 事前预防:用户上传换脸内容前需完成人脸识别身份核验,并强制提示需取得授权。

(2)事中识别:建立“AI换脸内容特别标注制度”,要求添加水印或标签。

(3)事后处置:设立人格权侵权快速响应通道,对公众人物内容1小时内下架,并同步存证。

2. 完善“知情—同意”规则

(1)单独同意:生物识别信息需逐项勾选,禁止默认授权。

(2)多重告知:采用弹窗、二次确认、动态验证等方式强化用户风险感知。

3. 强化平台传播责任

(1)在功能入口、生成页面嵌入普法教育,如侵权案例情景剧、法律课堂等。

(2)通过沉浸式设计提升用户法律意识。

4. 提升监管技术与数据管理能力

(1) 数据—算法监管体系:建立多模态数据融合系统、动态对抗性算法、分层审核机制。

(2)数据安全防护:对生物特征数据进行不可逆加密,建立异常访问熔断机制。

5. 完善法律保障体系

(1)明确侵权认定标准:制定深度伪造内容的技术识别标准,建立主观恶意与损害后果的关联评估。

(2)构建司法救济机制:

(3)推行“举证责任倒置”,由平台自证无过错。

(4)建立人格权侵害禁令制度,允许紧急下架。

(5)增设惩罚性赔偿,设定3-5倍实际损失赔偿标准。

(6)探索“数字人格权保护令”等新型救济形式。

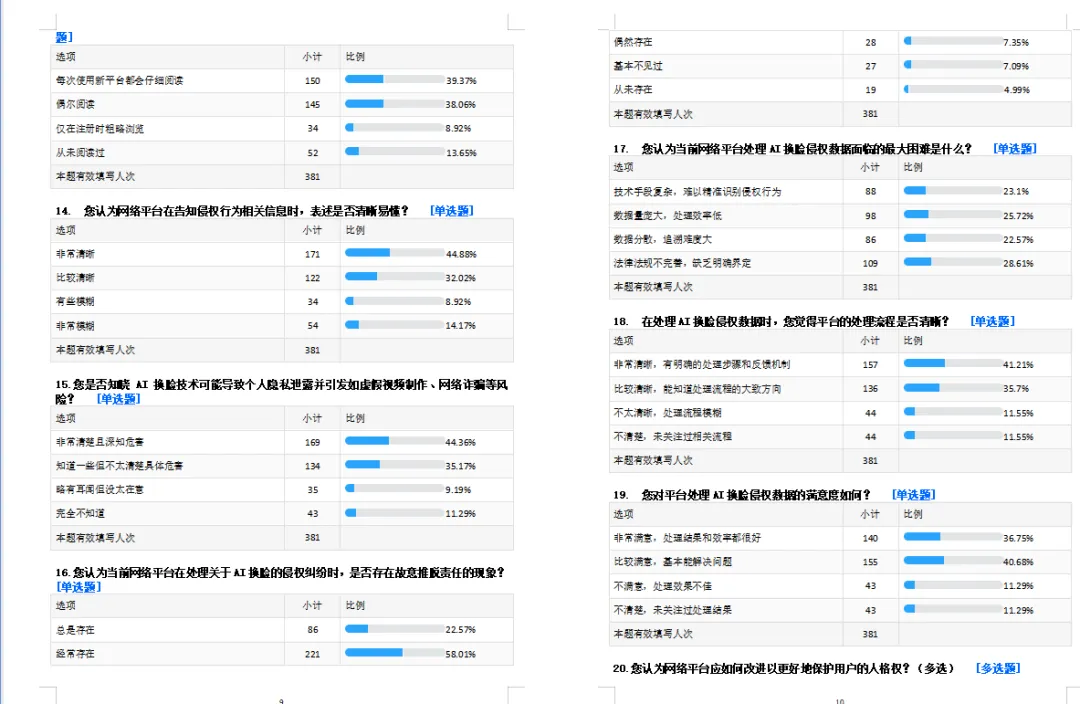

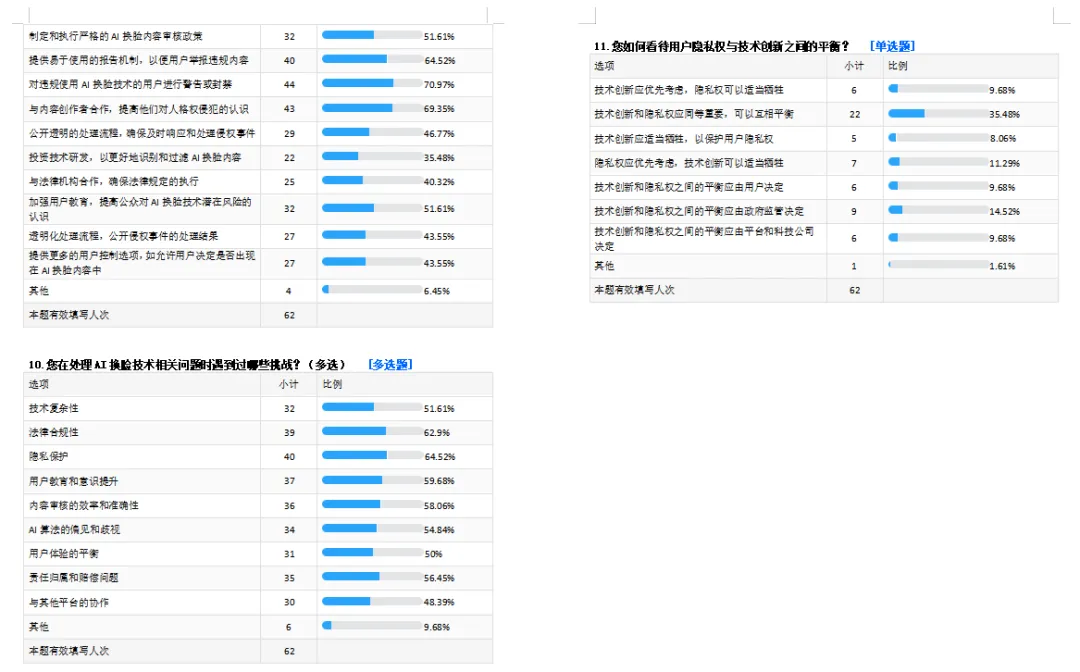

各项调查

表1 AI换脸技术使用调查

表2 AI换脸技术使用熟练程度调查

表3 民众对网络平台告知行为的认定

表4 平台开展用户教育活动调查

表5 民众风险认知程度调查

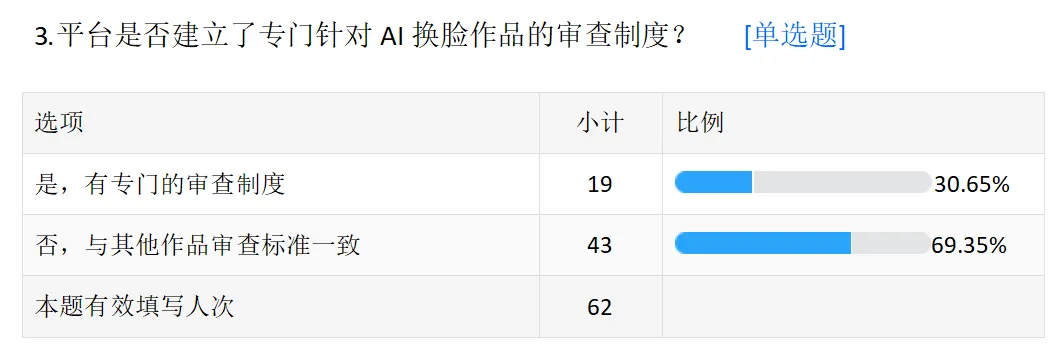

表6 平台对AI换脸作品审查制度调查

表6 民众对平台侵权处理的意见调查

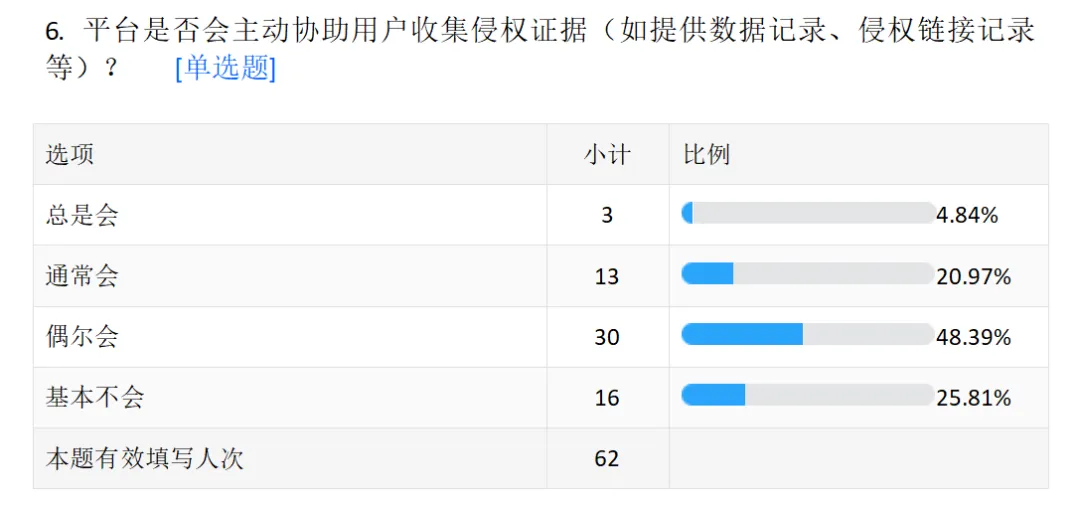

表7 平台收集侵权证据情况调查

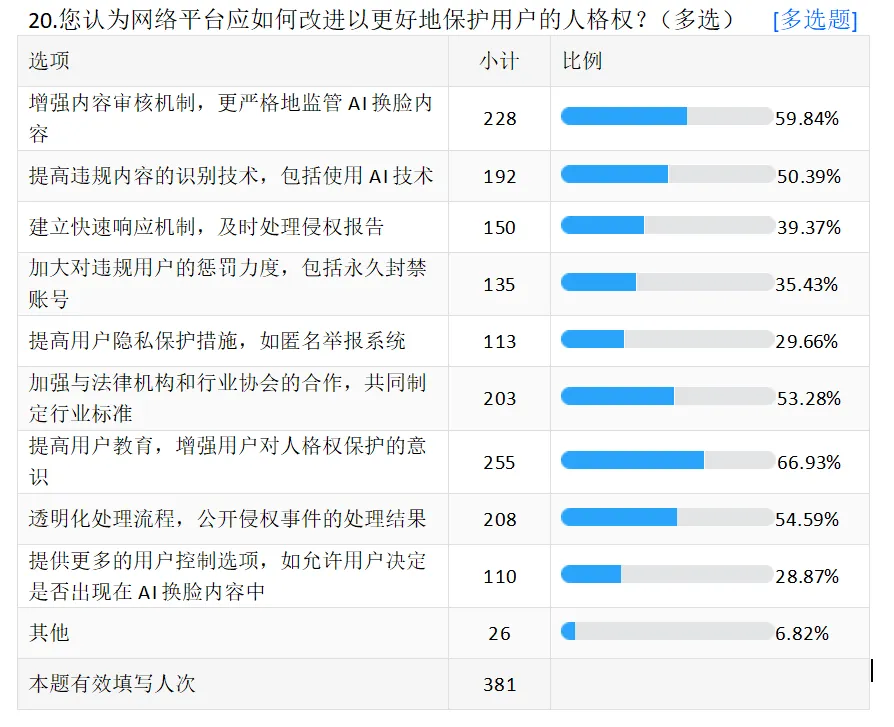

表8 网络平台如何改进保护人格权方法的调查

六、结论与展望

本课题组通过问卷调查、文献分析与案例研究,得出以下主要结论:

1.超过70%的网民对AI换脸技术有所了解,但仅30%知晓相关法律保护措施。

2.多数平台意识到技术风险,但约50%在监管技术上存在困难。

3. 80%的平台提供商呼吁更明确的法律法规。

未来,网络平台应从“被动响应”转向“主动治理”,构建“预防—识别—追责”的全链条保护体系。同时,立法机关应加快出台AI专项法律,明确平台责任边界,推动技术与法治的良性互动。

AI换脸技术并非洪水猛兽,但若无有效的法律与伦理约束,它将成为人格权侵害的“隐形杀手”。网络平台作为数字世界的“守门人”,必须承担起应有的社会责任。只有在法治框架下,技术才能真正服务于人,而非伤害于人。

夜雨聆风

夜雨聆风