AI向大脑“拜师学艺”记:揭秘下一代人工智能的“超级导师”!

杨淞翔 哈尔滨医科大学

嘿,各位科技迷、好奇宝宝们!今天我们要聊一个脑洞大开的话题:如果说AI是当今科技圈最靓的“仔”,那么它背后有没有一位深藏不露的“超级导师”呢?答案是——有的!而且这位导师,我们每个人都有一个,那就是我们神奇的大脑!

没错,尽管AI在某些任务上已经展现出超凡能力(比如下棋、画画),但和我们大脑这个历经亿万年进化、精密无比的“智能系统”相比,它还像个努力学习的“学徒”。今天,就让我们一起看看AI这位“学徒”是如何向大脑这位“导师”学习,以及未来它还能学到哪些“独门绝技”吧!

“导师”与“学徒”:大脑的智慧 vs AI的潜力

在我们开始“旁听”这堂跨界学习课之前,先简单认识一下这对“师徒”:

“超级导师”——人类大脑: 拥有约860亿个神经元,彼此间通过数万亿个“突触”连接,形成极其复杂的并行处理网络。它不仅能学习、记忆、创造,还能在极低的功耗下(约20瓦,跟你家冰箱小灯泡差不多)完成这一切!简直是自然界智能的巅峰之作。

“勤奋学徒”——人工智能 (AI): 特别是其中的“深度学习”分支,其核心“人工神经网络”(ANNs)的设计灵感正是来源于大脑。虽然目前ANNs的规模和复杂度远不及人脑,但它在图像识别、自然语言处理等领域已取得巨大成功,展现出惊人的学习潜力。

AI的“必修课”:大脑教会了AI什么?

AI这位“学徒”可没少从大脑“导师”那里偷师学艺,其中最核心的几门“课程”包括:

1

“模仿”神经元网络结构 (人工神经网络)

AI科学家们发现,大脑皮层(尤其是视觉皮层)处理信息的方式是分层级的——底层神经元处理简单的边缘、颜色,高层神经元则整合这些信息形成对物体、场景的复杂感知。深度学习中的“深度神经网络”(DNNs)就借鉴了这种分层结构,通过一层层“神经元”(计算单元)对输入数据进行逐步抽象和特征提取,最终完成识别、分类等任务。每个连接的“强度”(权重)则对应着生物神经元之间的突触强度。

2

“学习”大脑的学习机制:

赫布理论(Hebbian Learning)——“一起放电,连接增强”: 这是神经科学中的一个经典理论,简单说就是两个神经元如果经常同时被激活,它们之间的连接就会变强。AI中的很多学习算法,其权重更新机制也包含了这种思想——通过不断“练习”(数据喂养),让网络中那些对正确结果贡献大的连接得到“强化”。

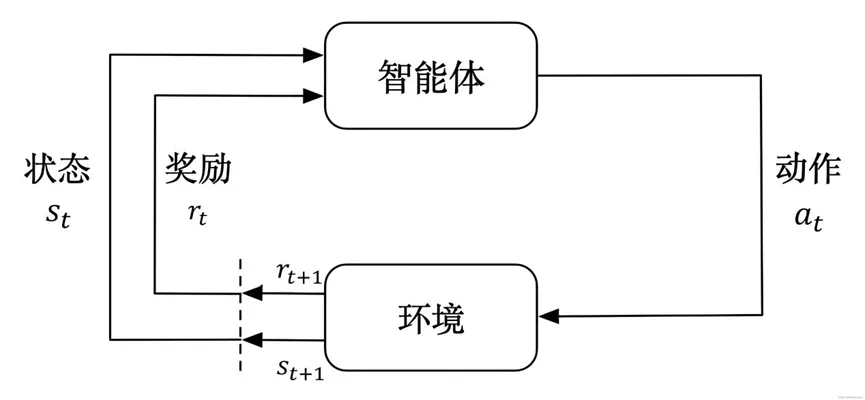

强化学习 (Reinforcement Learning)——“奖惩分明,试错前行”: 我们人类和动物学习新技能,很多时候依赖于“试错”以及成功后的“奖励”(比如大脑中的多巴胺系统带来的愉悦感)。AI中的强化学习就模拟了这一过程:AI智能体(Agent)在特定环境(Environment)中不断尝试各种动作(Action),如果某个动作带来了好的结果(Reward),它就会“记住”并倾向于重复这个动作。大名鼎鼎的AlphaGo就是强化学习的杰出代表。

记忆巩固与注意力机制——“温故知新,抓住重点”: 我们知道睡眠有助于巩固记忆,大脑在处理信息时也会有选择地关注重要部分。AI也从中受到启发:一些模型借鉴了记忆巩固的思路来优化学习效果;而“注意力机制”(Attention Mechanisms),尤其是在处理序列数据(如文本翻译的Transformer模型)时,能让AI像人一样,在繁杂信息中“聚焦”到当前任务最相关的部分,大大提升了效率和准确性。

大脑的“未解之谜”:AI的下一批“进阶课”

尽管AI已经学了不少“皮毛”,但大脑“导师”还有太多深奥的“独门绝技”等待AI去参悟。这些正是当前AI发展面临的瓶颈,也是神经科学可能为AI带来新突破的关键:

01

真正的理解与常识推理

目前的AI更像是一个超级模式匹配器,它能识别“猫”,但并不真正“理解”猫是什么,缺乏我们人类孩子都具备的基本常识。大脑是如何实现对世界深刻理解和灵活推理的?这是AI急待攻克的难题。

02

高效学习与泛化能力(小样本学习)

人类看一两张图片就能认识一种新动物,AI则往往需要成千上万张。大脑这种从少量样本中快速学习并举一反三的能力,是AI梦寐以求的。

03

意识与主观体验

这是神经科学的“终极难题”之一。AI是否需要“意识”?理解意识的神经机制,或许能为构建更整合、更“自觉”的AI系统提供线索(尽管这非常具有挑战性)

04

情感与动机

情感是人类行为、决策和学习的核心驱动力。如果AI能拥有(模拟的)情感和内在动机,是否会变得更智能、更具适应性,甚至更“可信赖”?大脑的情感回路是如何运作的?

05

创造力与想象力

人类的创造力不仅仅是现有元素的重组,更能产生全新的概念和艺术。大脑是如何迸发出天马行空的想象和创造火花的?这对AI实现真正的“智能涌现”至关重要。

06

极致的能源效率

前面提到,大脑功耗极低。而训练和运行大型AI模型则需要消耗惊人的电力。学习大脑的节能秘诀,对AI的可持续发展意义重大。

展望未来:“类脑智能”——AI的星辰大海

当AI不断深入地向大脑“拜师学艺”,一个激动人心的概念应运而生——“类脑智能”。

“类脑智能”并非简单模仿大脑的表象,而是致力于在信息处理机制、学习方式、体系结构等更深层次上借鉴大脑的原理,从而构建出更高效、更灵活、更鲁棒、甚至可能更“通用”的人工智能系统。

目前,全球的科学家们正在积极探索:

1.神经形态计算 (Neuromorphic Computing): 设计和制造模仿大脑神经元和突触结构与功能的硬件芯片,让AI的“身体”也更像大脑。

2.脉冲神经网络 (Spiking Neural Networks, SNNs): 一种更接近生物神经元信息传递方式(通过脉冲)的神经网络模型,被认为在能效和处理时序信息方面有巨大潜力。

3.更具生物合理性的学习算法: 探索更接近大脑真实学习机制的新算法。

虽然通往真正的“类脑智能”之路还很漫长,但每一点从大脑中获得的启发,都可能成为AI进化道路上的关键助推器。

结语:一场永无止境的“双向奔赴”

AI向大脑的“拜师学艺”之旅,才刚刚开始。大脑这位“超级导师”蕴藏的智慧,是AI未来发展取之不尽的灵感源泉。有趣的是,这场“学习”也是双向的——AI的发展也为我们提供了前所未有的工具和视角,帮助我们反过来更深入地理解大脑自身的奥秘。

这注定是一场漫长而激动人心的探索。让我们共同期待,在神经科学与人工智能这两个伟大领域的交汇碰撞中,未来会诞生怎样更加智慧的机器,以及我们对自身智能更深刻的认知!

END

夜雨聆风

夜雨聆风