我对目前AI发展的思考总结从春节到现在还不到两个月,整个AI的应用技术发展明显加快了,从小龙虾OpenClaw到Harness Engineering、Claude Code的火热(主要是它的源码泄漏),然后是Andrej Karpathy提出的LLM wiki设计思想,接着是刚刚发布没多久的Hermes框架。其实再把时间提前一点到春节前的MiniMax和智谱的上市,距今目前股价已经各自上涨了7倍和5倍。目前无论是市场还是IT工业界都是一片欣欣向荣,但这背后的逻辑与未来是什么?1,目前大模型的两个天然缺陷

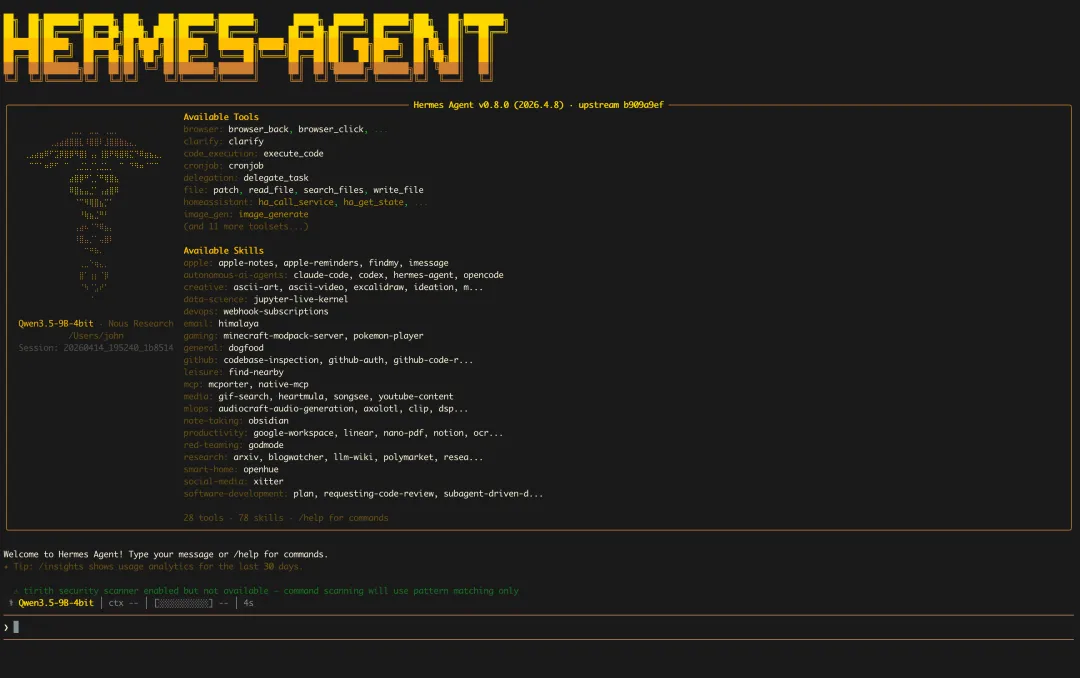

过去的2025一整年,从DeepSeek-R1发布开始,所有的中美大模型厂商都在相互努力竞分赶超,目的是提升大模型的输出质量,特别是在加入思维链之后,让大模型能能回答更多更复杂的问题,并且越来越往小参数高质量输出的方向上发展,包括蒸馏技术、更好的数据集和更好的训练算法,这个赛道的竞争目前仍在持续,后面我会讲到我对大模型发展的预测。截止到目前,大模型给我们的只有一个聊天框,但我们要的AI可不是一个聊天框而已,而是真正能应用到真实世界的各种应用需求,能够替代我们自动化接管各种任务的AI,所以就有了Agent的概念,一个利用大模型能力来自动处理任务的智能体。目前我见到的真正商业化成功的Agent,也只有Anthropic的Claude Code,但那也只是一个还没有从对话框的初级阶段里跳出来的Agent。这一切都因为,大模型(LLM)有两个天然缺陷:无法调用外部工具和没有记忆。我们目前使用的无论是小龙虾OpenClaw,还是新发布的Hermes,或是去年就火热的MCP和今年又流行的CLI和SKILL,本质上都是在用工程思路解决大模型的这两个天然缺陷。即通过整合大模型的智能化,突破有限的上下文限制增强记忆 + 自动调度外部工具。在可预见的2026整年,整个IT工业界都将围绕这两个问题提出各种解决方案和落地产品。用一句话总结,截止到今年底,整个AI展现出来的实际能力= 模型能力×(它能调用的工具+它拿到的上下文)。在目前大模型的能力下,为了提升上面括号中的内容,IT工业界已经有了共识,就是Harness Engineering(驾驭工程、约束工程)。2,Harness 本质上是一套强约束、结构化、可闭环、可追溯的 LLM 上下文交付机制

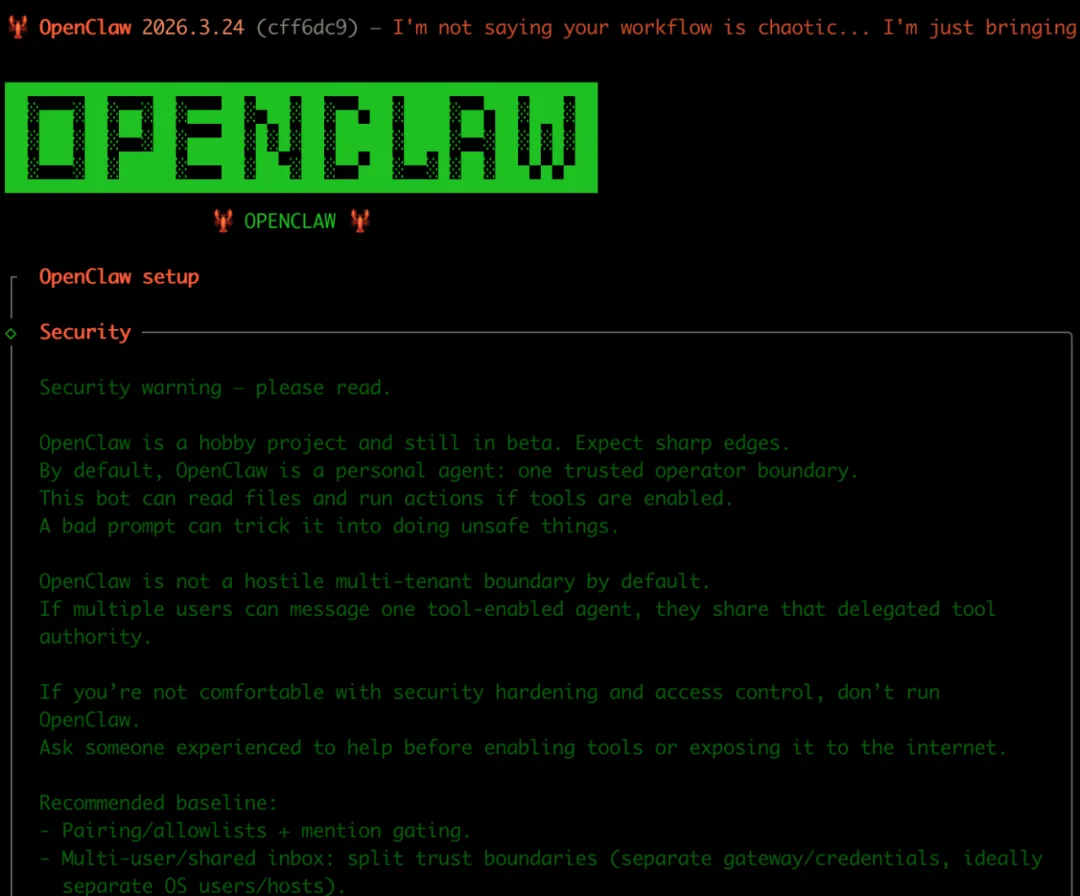

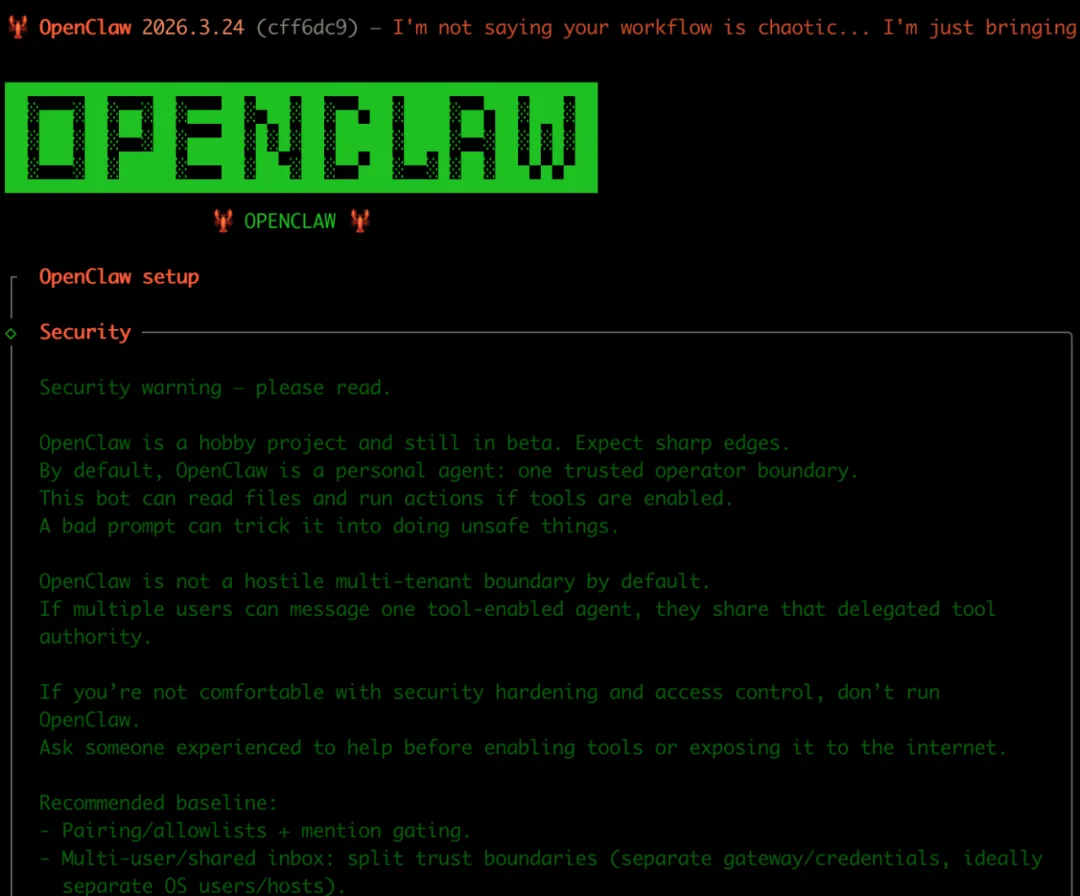

Harness Engineering 不是一个具体框架,而是一个设计模式,它要解决的就是大模型的上下文记忆的问题,同时它还重点关注整个任务流的可控,以达到企业级应用的标准。这也是从去年Agent开发开始到现在,业界共识出的解决方案的概念综合。不同于最原始的Prompt Engineering(提示词工程),也不同于升级一点的Context Engineering(上下文工程),Harness Engineering(驾驭工程、约束工程)是一套控制论模式,通过反馈回路让大模型(LLM)从“会说话”变成“可控执行系统”,让模型在复杂环境中不失控地干活,告诉其这个任务执行需要不干什么、检查什么、控制什么、格式是什么、外部工具在哪里等等。通过Harness Engineering的名称来源,harness单词的本意(给(马等)套轭具; 控制),我们也能体会,它是用工程的方法来控制大模型这匹不羁的马。优秀的模型在糟糕的Harness中会出现幻觉、循环、泄露信息或失败;而普通的模型在优秀的Harness中能保持边界、从错误恢复、产出可审计的结果,这才是企业应用所应该有的标准。总结到这里,我们可以说年后爆火的OpenClaw其实就是Harness Engineering控制论模式的具体的产品实现。3,OpenClaw是未来AI操作系统的雏形

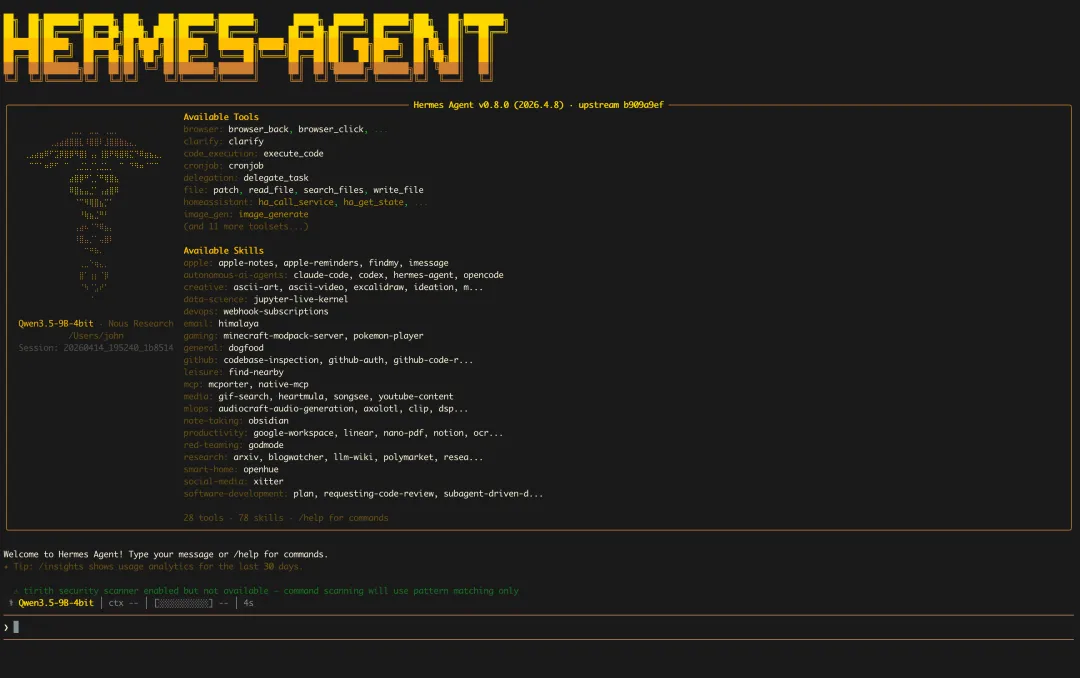

OpenClaw小龙虲的爆火不是没有原因的,它给我们展示了一种未来。OpenClaw不仅仅是Harness Engineering控制论模式的具体的产品实现,它更像是一个未来AI操作系统的雏形。不同于传统的计算机操作系统(如Windows、Linux)以硬件资源调度为核心,未来的AI操作系统,核心是调度大模型能力、外部工具和上下文资源,让AI能自主、高效地完成复杂任务,而OpenClaw正是展现了这种可能性,尽管还有太多不完善,太偏理工男化了,但我喜欢。OpenClaw不再将用户局限于被动的“问答”交互,而是构建了一个以任务执行为核心的“接管”模式。它用大模型作为“中央处理器”,通过Harness机制来管理上下文内存、调度外部工具(文件系统、浏览器、API等),并强制执行任务闭环。它能够理解屏幕语义、自主规划路径、调用工具并执行点击、输入等操作,实现了从“认知”到“行为”的闭环。这使得AI Agent不再是一个聊天框里的玩具,而是一个能自主规划、执行、反馈、纠错的执行单元。正因如此,OpenClaw被很多开发者视为“AI OS”的第一个实验品:这种能够调度底层资源、管理任务进程、并以标准化方式响应用户需求的架构,正是操作系统的本质特征。对比刚刚发布的Hermes,两者虽同为解决大模型缺陷的产品,但定位差异显著。Hermes更专注于轻量级、可嵌入的Harness模式,试图让普通模型也能通过严格的上下文约束来完成高价值任务,比如代码审查、自动化报表生成等。无论是OpenClaw还是Hermes,它们都在证明同一件事:大模型的能力边界,正被Harness Engineering从“能说什么”扩展为“能做什么”。从行业发展来看,OpenClaw的雏形属性,预示着AI正从“单点工具”向“系统级能力”跨越。未来,当OpenClaw这类平台完善了工具生态、优化了调度效率,它或将成为多数企业部署AI应用的核心载体——企业无需再单独开发Agent,只需在OpenClaw上配置工具、设定约束规则,就能快速实现特定场景的AI自动化,这也是AI工业化落地的关键一步。4,Token经济

现在再回来看支撑着大模型背后的商业模式,Token经济已经兴起。我们都需要为调用云端大模型服务而支付Token的消耗费用,Token 或将成为智能世界的 “通用货币”,像电力、流量一样成为未来的生产资料。每一次API调用、每一轮Agent对话、每一个工具调用指令,都对应着Token的计费与结算。这种模式会彻底改变了软件定价方式:从“买许可证”变成了“按计算量付费”,让大模型厂商获得了持续的收入流。目前已经上市的MiniMax与智谱的主要营收就来自于大模型的调用服务,而Token的定价逻辑,主要与模型参数规模、调用并发量、响应速度以及上下文长度挂钩。参数越大、响应越快、上下文越长,Token消耗成本越高,对应的服务价值也越高。随着Agent类产品如OpenClaw等的普及,Token的消耗量会以指数级增长——一个复杂的Agent任务可能一次执行就用掉上万Token,而企业级用户调用大模型处理复杂的数据分析、代码生成任务,需要更高的并发和更长的上下文支持,其Token消耗费用将远高于个人用户的日常聊天调用。未来,Token的定价、缓存、压缩和优化将成为新的技术战场。Token经济的兴起,还会带动整个AI产业链的分工协作。第三方开发者可以基于大模型的Token服务,开发各类垂直场景的应用,通过赚取Token差价或服务费实现盈利。此外,Token的流通还催生了“Token节约”的工程需求,比如通过优化上下文与效率的价比,减少无效Token消耗,或也将成为企业降低AI应用成本的关键。我们可以预见:谁能用更少的Token完成同样的任务,谁就能在AI时代的商业竞争中胜出。 同时,大模型的私有化部署也会是对数据安全要求极高的企业或部门的首要需求,这也将是2026年下半年最值得关注的变数。5,未来的大模型和Agent

前面已经提到大模型的两个缺陷,其实大模型目前还有第三个大缺陷就是无法实时学习新知识。目前大模型一旦训练完成,它的知识就停留在训练数据的最后更新时间,所以它不知道今天产生的新知识、行业的新动态,这也限制了大模型在实时性要求高的场景(如实时客服、金融行情分析)中的应用。未来的大模型会向着解决这三个缺陷去进化,一旦解决其中任何一个缺陷,它就能替代当前绝大多数的Agent——解决记忆缺陷,就能实现长期任务的持续推进;解决工具调用缺陷,就能自主完成复杂的跨工具任务;解决实时学习缺陷,就能快速适配行业变化,无需频繁重新训练。另一点,大模型和Agent都会向着垂直领域发展,这是由企业应用的个性化需求决定的。通用大模型虽然能处理各类基础任务,但在垂直行业(如医疗、金融、制造)中,往往缺乏行业专用知识和场景适配能力,而垂直领域的大模型和Agent,能够结合行业数据、业务流程进行定制化训练和开发,更能满足企业的实际需求。例如,医疗领域的大模型会专注于医学知识的学习和医疗数据的分析,Agent则能实现病历整理、辅助诊断等专业化任务;金融领域的大模型会聚焦于行情预测、风险评估,Agent则能自动完成交易复盘、报表生成等工作。从两者的关系来看,未来大模型和Agent会呈现“共生进化”的态势。大模型是Agent的核心能力支撑,Agent则是大模型落地的重要载体——大模型的能力提升,会让Agent的自动化水平更高;而Agent在实际场景中的应用反馈,又会为大模型的优化提供数据支撑,形成“模型升级→Agent能力提升→场景反馈→模型再优化”的闭环。往后一年大模型的竞争,将从“谁参数更大、谁排名更高”转向“谁在特定约束下更可靠、更经济、更懂行”。 2027年,我们或许会看到第一个完全解决了“实时学习”缺陷的垂直模型出现,它将像当年的DeepSeek-R1一样,再次改写行业规则。btw,我觉得大模型的终极进化方案是:未来的大模型是一个活的会即时学习的大模型,类似于人的神经网络那样的实时系统,基本就是一个模拟的人类大脑了,它能主动接入互联网,并能调用网络工具,不过有点恐怖。。。