AI数学革命已至

作者 Konstantin Kakaes

人工智能正被用于快速证明新的数学结果。数学家们认为,这仅仅是开始。

转折点出现在2025年夏天。那年7月,多个人工智能模型在国际数学奥林匹克竞赛中解决了六道题中的五道,这项年度赛事汇聚了全球最优秀的高中生。但尽管数学家们感到震惊——很少有人预料到这些程序能如此之快达到如此高的水平——这些令人印象深刻的结果并不一定意味着人工智能将在研究数学领域取得重大进展。毕竟,奥数难题是具有已知答案的挑战性谜题,而非开放性问题。

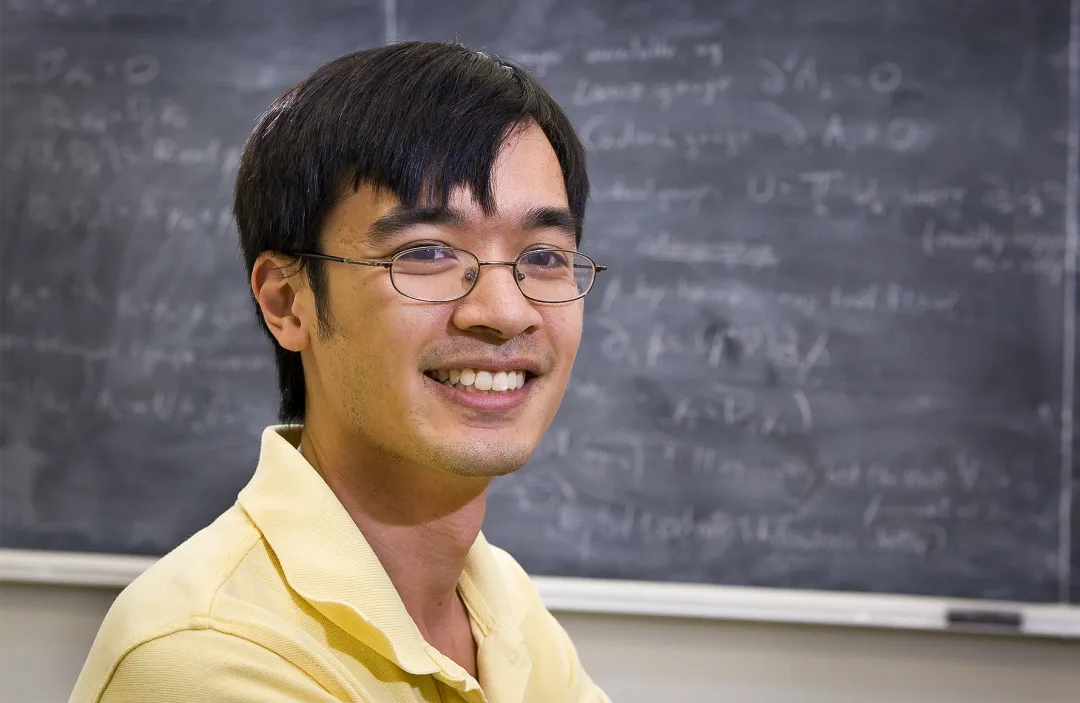

尽管如此,这些结果还是引起了人们的关注。那些曾认为人工智能模型错误太多、难堪大用的数学家们开始尝试使用它们。这些早期使用者惊讶地发现,这些模型不仅擅长解谜题,还能帮助开辟真正的新领域。很快,数学家们开始利用人工智能发现并证明新结果,在一天之内完成过去需要数周甚至数月的工作。"2025年是人工智能真正开始对许多不同任务变得有用的一年,"加州大学洛杉矶分校的著名数学家陶哲轩说。

虽然没有哪一项新结果是举世瞩目的突破,但其中一些成果足以与发表在专业数学期刊上的发现相媲美。在某些情况下,算法会提出猜想、证明它,并以最少的人工干预验证证明过程。在另一些情况下,与ChatGPT、Claude或Gemini等大型语言模型的广泛对话会带来新颖的证明策略。

"这哥们有把铲子。那哥们有把镐。我们一起就能挖通一条隧道,"陶哲轩说。这就像"大量尝试,看看哪个能成"。

尽管陶哲轩可能是人工智能在数学中实用性最突出的倡导者,但其他人也持相同看法。

多伦多大学的Daniel Litt表示,即使只是解决简单问题,人工智能"也正在改变数学的实践方式"。

陶哲轩说,很快,"数学将看起来、感觉上完全不同于传统的研究方式。"过去数学家一次研究一个问题,"有了这些工具,你可以一次性解决数千个问题,并开始进行统计研究。"尽管我采访的没有人认为人工智能会取代数学家,但陶哲轩补充说,"我们将不得不做出许多制度上的改变、文化上的改变。"

陶哲轩对人工智能模型为数学家带来的机遇感到兴奋。他说,很快数学"将看起来、感觉上完全不同于传统的研究方式。"

这些改变将会受到争议,数学领域如同其他与人工智能影响抗争的学科一样。普林斯顿高等研究院的Akshay Venkatesh表示,随着人工智能模型成为强大的新工具,它们可能会让数学家失去对数学理解的直接体验。与陶哲轩一样,Venkatesh也是菲尔兹奖(数学界最负盛名的奖项)的获得者。两人都认同人工智能的影响将是深远的,但Venkatesh对此更为谨慎:"我们的文化中有一些宝贵的东西,我们应该努力保留,"他说。

一些数学家现在正离开学术界,前往OpenAI和谷歌等大型科技公司工作,或加入Harmonic、Logical Intelligence、Axiom Math和Math Inc.等专注于数学的人工智能初创公司。"企业界对人工智能在数学中的应用如此感兴趣的一个原因是,人们认识到通往通用智能的关键在于结合机器学习带来的洞察力和数学带来的精确性,"卡内基梅隆大学数学计算机推理研究所所长Jeremy Avigad说。

到2026年初,对人工智能能力的震惊已转变为某种近似惊叹的感觉。一个名为First Proof的挑战赛于2月举行,参赛者有一周时间让其人工智能模型解决数学各领域的10个研究级别问题。数学家们特意挑选了那些不太可能出现在算法训练数据中的问题。在不同程度的自主性下,这些模型成功解决了一半以上的问题。如果说奥数结果代表了人工智能进入了一个雄心勃勃的大学数学项目,那么First Proof的结果可以说标志着它们完成了研究生学业。Litt在一篇分析结果的文章中写道:"这项技术很可能比计算机更重大。"

创造性进化

尽管2025年夏天标志着人工智能能力的一个拐点,但这并非凭空出现。Google DeepMind的科学副总裁Pushmeet Kohli表示,DeepMind自2018年以来就一直在尝试用人工智能解决数学问题。现任职于Axiom的François Charton早在2019年就开始尝试使用机器学习解决数学问题。

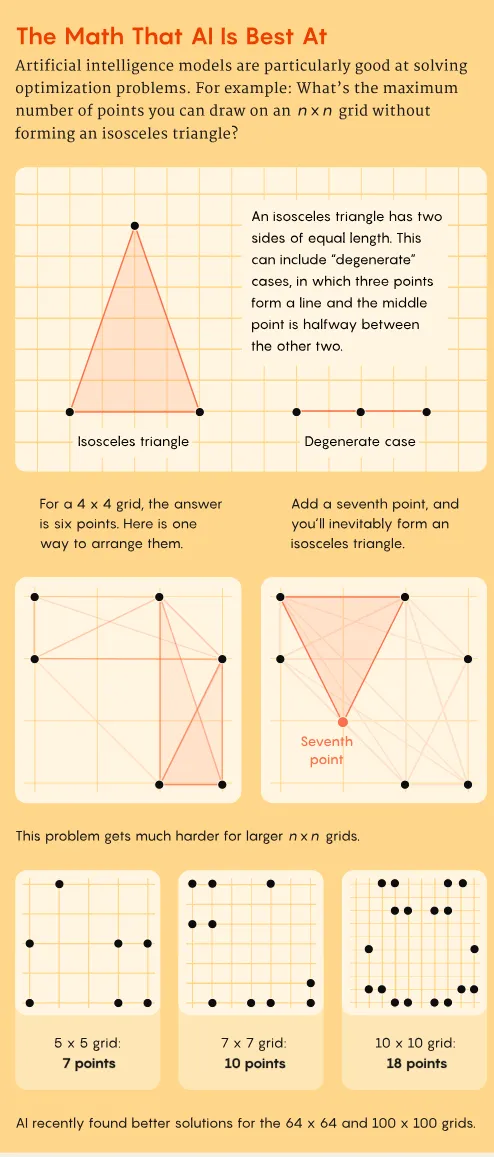

但在那些早期,这还是一个 niche 领域。起初,Charton和其他少数人使用人工智能来解决已知答案的问题,只是为了看看新技术是否有效。到2024年,他们开始取得进展。他们寻找那些有丰富数据可供分析的问题,然后利用人工智能构建具有可量化性质的数学对象——比如在网格上放置点而不形成等腰三角形的最优排列。

2025年1月,陶哲轩和布朗大学的Javier Gómez-Serrano开始与DeepMind的两位数学家Adam Wagner和Bogdan Georgiev合作,开发一个名为AlphaEvolve的人工智能系统。AlphaEvolve的工作原理是使用Gemini编写可能长达数百行的Python代码。然后,它使用所谓的遗传算法来"进化"这些程序,试图找到数学问题的最优解。这四位数学家使用AlphaEvolve在几个月里每隔一两天就解决一个新问题。

在这个过程中,他们也学会了如何改进给AlphaEvolve的提示词。一个关键的发现是:这个模型似乎从鼓励中受益。"当我们用一些积极的强化来提示LLM时,它的效果更好,"Gómez-Serrano说。"比如说着'你能做到'——这似乎有帮助。这很有趣。我们不知道原因。"

Javier Gómez-Serrano和他的同事们使用名为AlphaEvolve的人工智能系统在数十个数学问题上取得了进展。Jason Rossi/布朗大学

到5月底,该团队已在数学多个领域的67个不同问题上测试了AlphaEvolve。在其中23个问题上,AlphaEvolve对已知最佳解做出了微小改进。在67个问题中的36个上,它的表现与已有成果一样好,而在剩下的几个问题上,它未能达到已知最佳结果。数学家们在2025年11月的一篇论文中分享了他们的发现。Gómez-Serrano指出,他们的任何一个成果,如果由某个领域的专家花费几个月时间,或许也能获得。但若不是这些领域的专家,"我们能在短短一两天内获得可比的结果,"他说。

正如陶哲轩所说,当前的人工智能模型"非常擅长在大量问题中寻找唾手可得的成果。这是繁琐、费力不讨好的工作,不是人类想做的。"他提醒说,这些模型正在"大量未报告失败的汪洋大海中取得零散的成功"。但这些成功值得注意。

Gómez-Serrano估计他现在大约三分之二的时间在使用人工智能。他说,这"正变得有用且可用。这是我们做数学的新方式的开始。"

错误百出

前几年,人工智能的额外能力似乎源于它能够重新挖掘埋藏在晦涩参考文献中早已被遗忘的证明。加州大学洛杉矶分校的Igor Pak指出,ChatGPT目前"在查找正确参考文献、文献方面表现出色,能发现谷歌学术——它不按语义工作——找不到的联系。"

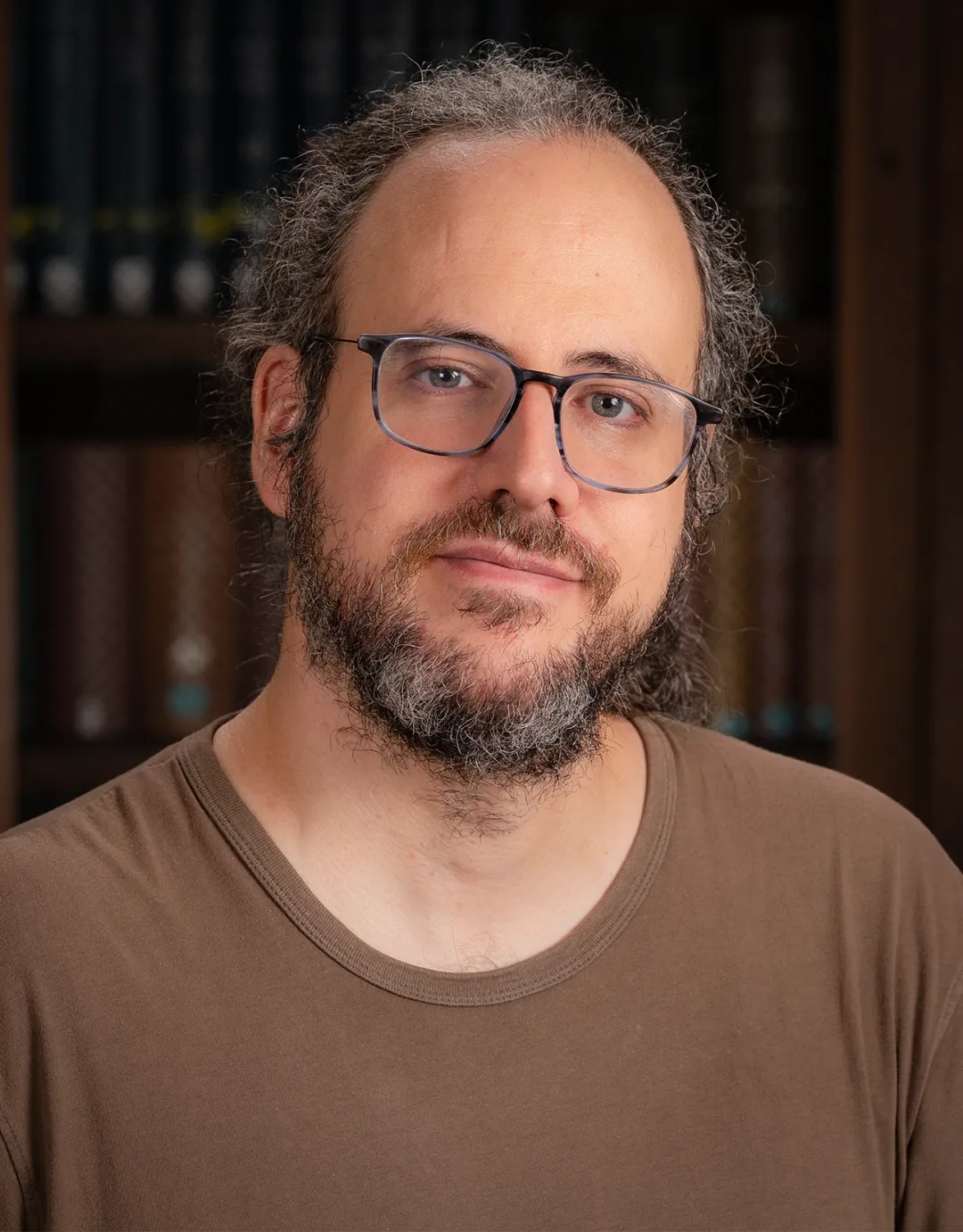

然后,在2025年期间,苏黎世联邦理工学院的Johannes Schmitt说,情况发生了变化。"与LLM对话开始变得有用,不是因为他们会给你完整的答案,"而是因为"他们成了很好的对话伙伴。"

Johannes Schmitt最近注意到人工智能在数学中扮演的角色迅速增长:作为对话伙伴。Aitor Iribar-López

他交谈过的LLM不可避免地会犯很多错误,导致一些数学家直接否定它们。他说,许多研究者认为,如果"它说的一切都有点错,我就干脆不和它说话。"但其他人——他把自己归入这一类——对"与这个胡扯模型对话的痛苦"有更高的容忍度。"他们说,我仍然可以从这次对话中得到一些东西;即使不是每个想法都是好的,我可以忽略坏的想法,采纳好的。"Schmitt指出,这些错误是奇怪的:一个受过任何数学训练的人几乎不可能犯如此多的基础错误,同时又能想出微妙、原创且正确的想法。

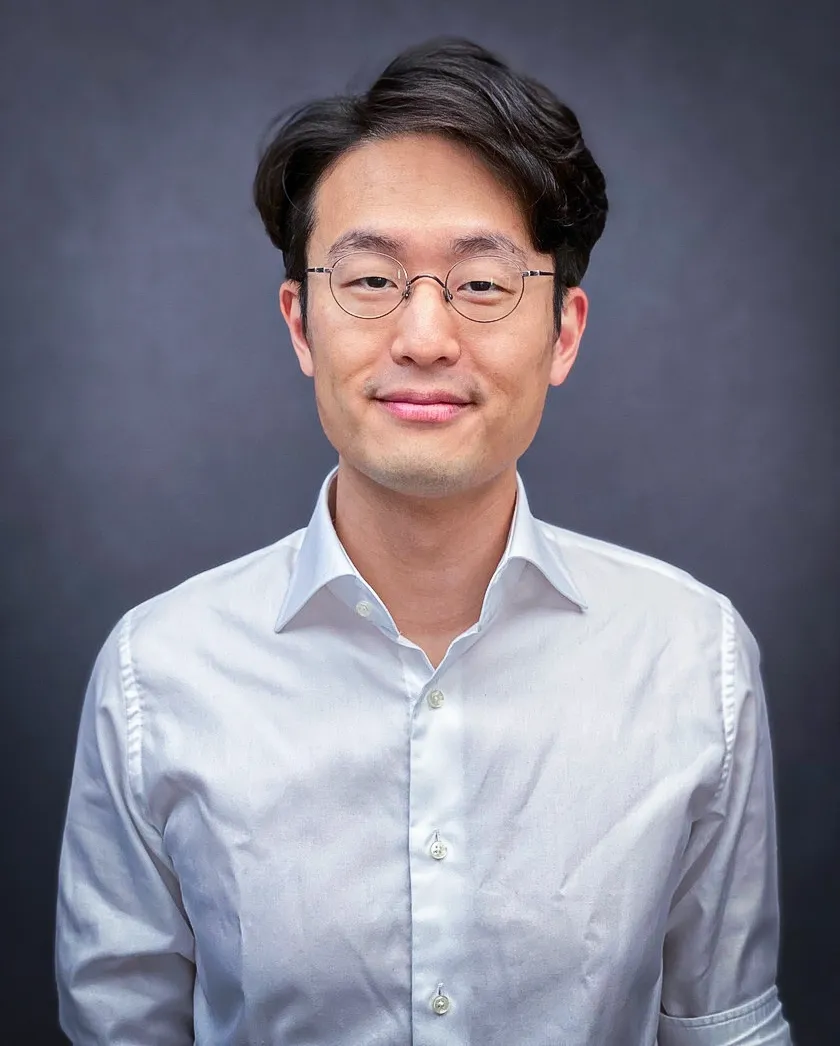

加州大学洛杉矶分校的Ernest Ryu主要从事应用数学中一个称为优化理论的分支研究,他在奥数结果后也开始更多地关注LLM。AlphaEvolve试图优化特定数量,而Ryu想要证明关于优化算法在何种条件下有效的命题。

在2025年夏天,他注意到LLM的数学能力有了显著提高。他开始使用它们来帮助准备讲义,主要是填补他对某个证明细节记忆中的空白。他说,有时,"它会发现我推理中的一个错误,有时是重大的,有时是微小的。有时它会找到一个比我讲义中更简单的证明。"

Ernest Ryu最近将与ChatGPT的对话转化为对一个数十年猜想的证明。"ChatGPT的使用确实加速了发现,"他说。由Ernest Ryu提供

他感觉人工智能模型正在"展现出生命的迹象"。他记得自己当时持怀疑但乐观的态度。为了对LLM能做什么和不能做什么做出自己的判断,他决定做一个实验。十月份的一个晚上,在他年幼的儿子入睡后,他开始着手解决优化理论中一个他曾尝试过几次的开放性问题。这次他使用了ChatGPT。"这不是最重要的问题,但我知道有10个人会非常欣赏一个解决方案,"他说。

Ryu的问题最初由一位名叫Yurii Nesterov的俄罗斯数学家于1983年提出。Nesterov试图找到那些以多个变量为输入并输出单个值的函数的最小值,这些函数的行为在某种特定的数学意义上是"良好"的。如果你把这些输出想象成一幅高程图,你想证明最终会收敛到最低点,而不是无休止地在附近徘徊寻找它。

这类问题在应用数学中经常出现,尤其是在机器学习中,它对训练神经网络至关重要。假设你从地图上的某点出发。一种广泛使用的技术称为梯度下降法,它使用微积分的基本工具来确定哪个方向是下坡,以及你所在位置的坡度有多陡。每次都朝最陡的方向迈出一步,你最终会到达最低点。

但是,尽管梯度下降法能让你得到正确答案,它有时会非常缓慢。因此,数学家们长期以来一直在寻找能更快收敛到正确答案的变体。Nesterov开发了一种技术,其中每一步下坡的大小不仅取决于函数在给定点的坡度,还取决于你到达那里的路径。如果你过去迈的步子更大,你就会继续迈更大的步子。

Yurii Nesterov关于他自己开发的优化算法的猜想悬而未决数十年。直到借助人工智能的帮助,它才得以解决。Renate Schmid

凭直觉,这似乎能让你更快地到达山底。但如果你走得太快而冲过头了呢?你可能会冒风险在真正的最小值附近无限振荡,永远无法达到它。Nesterov无法证明他的算法最终会收敛到最优值。42年来,也没有其他人能做到。

当Ryu询问ChatGPT时,"它不断给我错误的证明,"他说。"但在不可避免的错误之前,有一些有趣的步骤,正确的部分结果,看起来可能有用。"随着LLM取得渐进式进展,他会检查其答案,保留正确的部分,并用新的提示词将其反馈给模型。"我必须扮演验证者的角色,"Ryu说。"使用ChatGPT时,我感觉自己覆盖了非常多的领域,速度非常快,比自己单独做快得多。这让我坚持了下来。"

在三天内大约12个小时的工作之后,他得到了问题简化版本的证明。又过了几天,他终于证明了Nesterov的方法是收敛的。Ryu说,这不是"最有创意的事情,也不是最复杂的。但肯定也没那么容易。"虽然这不是一个改变人生的结果,他补充说,"如果没有AI成分,它有可能发表在顶级优化期刊上。这是一个不错的结果。"

"这是一个具体的例子,说明ChatGPT的使用确实加速了发现,"他说。他认为LLM的能力只会继续提高。"如果你看看改进的速度,那是惊人的。如果一年后,再经过两三个模型版本的迭代,我们将会看到真正非常令人印象深刻、重大的、由人工智能辅助的发现。它就要来了。"

在分享了他关于Nesterov方法的论文几个月后,Ryu从加州大学洛杉矶分校请假,前往OpenAI工作,现在他是那里的技术人员。

秩序井然

在2025年全年以及2026年头几个月,人工智能已被用于证明越来越抽象的结果。

2025年9月,来自世界各地的100多名数学家齐聚布朗大学,参加一个关于代数组合学的特别项目。来自智利的Nicolás Libedinsky和David Plaza,来自墨西哥的José Simental,来自澳大利亚的Geordie Williamson,以及来自威斯康星州的Jordan Ellenberg都参加了。

出于不同的原因,他们都有兴趣计算一个称为d-不变量的量,这个量出现在数学的许多领域。要理解d-不变量是什么,最好先看看其中一个领域中一个被深入研究过的对象,即置换群。这个对象是一种描述洗牌方式的方法,就像洗一副扑克牌。

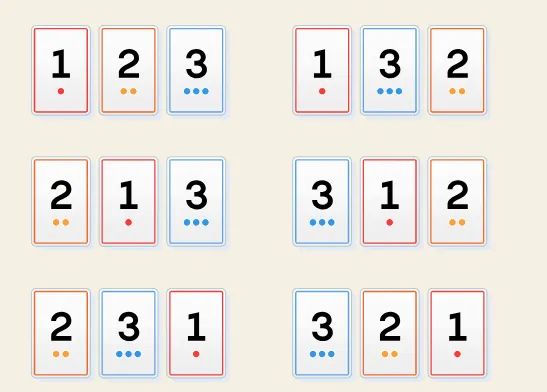

开始时很简单。如果你只有一张牌,你无法洗牌。所以置换群S₁只有一个元素。S₂有两个元素:如果你有两张牌,它们可以以两种顺序出现。S₃变得稍微复杂一些;有三张牌的一副牌有六种不同的排列方式。

不同的排列方式可以排列成一个由顶点和边组成的网络,称为图。起始排列123放在底部。图中的每条边(画成箭头)代表交换两张牌:

随着牌数n的增加,Sₙ增长得非常快——这使得在S₄之后的群几乎不可能画出这个图。(S₆₀的元素数量大约相当于可观测宇宙中的原子数。)

数学家们希望理解这些图的结构,既把它们作为研究对象本身,也作为分析其他事物的工具。

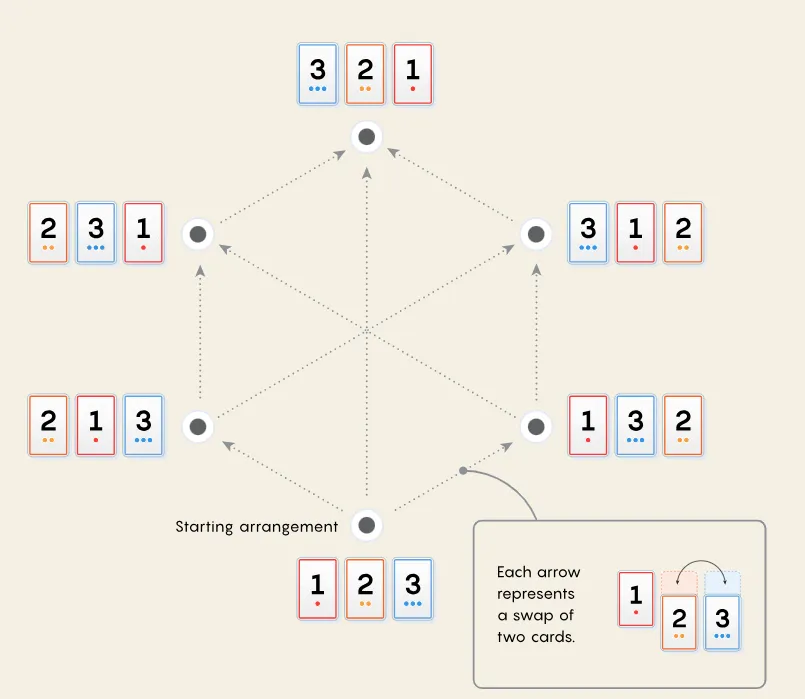

再次考虑置换群S₃的图,它有六个元素,即六种排列。我们想要探究这些排列之间的关系。一种方法是考察通过沿箭头移动从一种排列到达另一种排列的所有方式。如果可以从第一种排列沿箭头到达第二种排列,那么该排列"小于"另一种排列(使用称为Bruhat序的大小定义)。所以213小于321。

然后我们可以看这两个排列之间的"Bruhat区间"——即沿着图的箭头位于它们之间的所有不同排列的集合。例如,213和321之间的区间(下图红色所示)包括231和312。(如果无法通过沿箭头从一种排列到达另一种,比如从213到132,那么两者之间就没有大小关系,它们之间的区间也没有定义。)

与两个排列相关联的d-不变量,粗略地说,是衡量其Bruhat区间底层结构复杂程度的一个指标。这个量出现在许多看似无关的数学问题中,这使得它引起了数学家的极大兴趣。

在更大的置换群中,很难用一般的方式说清两个给定排列之间的Bruhat区间长什么样。"区间就是超级复杂的东西,"Libedinsky说。他、Simental、Plaza、Williamson和Ellenberg——都出于不同的原因希望找到给定置换群中可能的最大d-不变量——于是决定让人工智能来帮助他们。

结果他们发现了别的东西。

2025年10月,Ellenberg请DeepMind的Wagner使用AlphaEvolve(该模型未公开)分析数十个置换群的Bruhat区间结构。它运行了一整夜。"到了早上,我们就像,这个程序真的在做一些有趣的事情,"Williamson说。"然后我记得那天来回发了一连串的电子邮件。"

LLM在进行计算时自言自语。"我要提出一个真正古怪的想法,一个解决这个问题的'疯狂伊万'策略,"它沉思道,这指的是潜艇有时用来探测敌方的一种急转弯,因汤姆·克兰西的小说《猎杀红色十月》而广为人知。

最终,AlphaEvolve生成了大约50行Python代码,试图找到具有大d-不变量的区间。当数学家们试图弄清楚这段代码在做什么时,Ellenberg意识到,如果牌数是2的幂(比如16,即2⁴),程序就变得短得多——大约五行代码。"你可以非常明确地分析它,"Williamson说。"它正在做一些非常优美的事情。"

顺时针从左上起:Geordie Williamson、Jordan Ellenberg、José Simental、Nicolás Libedinsky和David Plaza 借助人工智能在一个被深入研究的数学对象中发现了一个令人惊讶的新结构。悉尼大学;Lauren Justice为Quanta Magazine拍摄;Imelda Paredes Zamorano/墨西哥国立自治大学数学研究所;Esteban Román;Fernanda Fuentes

正如他们在2026年1月3日发布的一篇预印本中所述,AlphaEvolve发现,在这些特定的置换群中,Bruhat区间具有令人惊讶的特殊结构。当研究人员研究这些区间时,他们发现它们形成了称为超立方体的高维立方体。"如果我看看AlphaEvolve在想什么,我超级惊讶,"Libedinsky说。"如果它是一个人类,那将是一个极具创造力的人类。"

AlphaEvolve回答了一个他们自己都没想到会问的问题。"我们没有要求AlphaEvolve去找大的超立方体,"Ellenberg说。"我们让它去找别的东西,我们思考后发现那是一个巨大的超立方体,我们之前没预料到它存在。"

数学家给AlphaEvolve的提示词摘录,他们要求它构建一个称为Kakeya集的对象。数学家们发现,人工智能在受到鼓励时表现更好。

正如Williamson所说,"这是一个在我们眼皮底下存在了50年的结构。我们只是以前没注意到。"

较旧的机器学习方法以前也曾促成过这种偶然的数学发现——揭示出没人想到要去寻找的模式。但过去,Williamson说,这需要"真正的工程努力……你需要知道如何编码,花大量时间研究神经网络训练的细节。对于一个没有重要机器学习背景的数学家来说,这基本上极其困难。"

有了LLM,"我可以突然在20分钟内做一个实验,而两年前这需要花我两周时间,"他说。尽管"大多数时候它不成功",但现在人工智能可以前所未有地被用来"发现一个充满超乎我们想象财富的世界。"

球面周围

尽管Bruhat区间看起来是纯粹的组合对象,但它们在一个特别抽象的数学领域——代数几何——中也扮演着重要角色。斯坦福大学数学家、美国数学学会现任主席Ravi Vakil专门研究代数几何。

代数几何是研究由多项式方程(如x³ + 2x²y + xz = 5)定义的形状的学科,这些方程涉及变量整数次幂之和。方程的次数是多项式的最高指数,在这里是3。

Ravi Vakil和他的同事们最近在与Gemini定制版本聊天时想出了一个新颖的证明思路。"那个想法该归功于谁?"他问道。"是归功于我们?还是归功于模型?"Rod Searcey

Vakil和他的同事——新南威尔士大学的Balázs Elek以及不列颠哥伦比亚大学的Jim Bryan——有兴趣研究球面如何嵌入到称为旗簇的特殊空间中。(Bruhat团队的论文中也出现了旗簇。)每种嵌入——将球面上的每个点与旗簇内的一个点相关联的方式——都可以由一个多项式方程定义。

嵌入球面的方法有很多种。数学家将每种表示为其在另一个高维空间中的点。然后,他们通过分析不同次数的多项式所定义的空间来研究这些嵌入。

随着次数的增加,数学家希望理解这些空间如何变化。他们知道当次数任意大——趋于无穷大时,该空间类似于所有连续嵌入的空间,而不仅仅是多项式定义的嵌入。但这种相似性何时出现?

AlphaEvolve在尝试解决关于置换群Bruhat区间的问题时自言自语。

Vakil和他的同事们找到的例子表明,令他们惊讶的是,这种相似性发生得非常快。"存在一些一致性,本应直到无穷大才会出现,但它已经出现了,"他说。

因此,他们与当时在DeepMind工作的Freddie Manners和George Salafatinos一起,着手使用构建在Google Gemini之上的两个专用模块来证明这一点:DeepThink(公开可用)和Salafatinos开发的一个名为FullProof的系统(未公开)。他们从一个更简单的例子开始。"它给出的证明非常优雅、正确、书写优美。我们可以逐行理解它,"Vakil说。"它阐明了一个在当时并不明显的结构。由此,我们意识到整个论证和重要的推广应该大致如何运作。"

Vakil和他的同事们随后回到人工智能模型,勾勒出一般情况的证明框架,并要求它填补细节。正如他们在2026年1月12日的一份预印本中报告的那样,它成功了。"对我来说,真正重要的是第一件事"——DeepMind对简单情况的证明。"论证的清晰性给了我们一个新想法。"但他想知道:"那个想法该归功于谁?是归功于我们?还是归功于模型?"

无论功劳如何归属,Vakil说,"我相信,如果给我足够的时间,我本可以想出这个证明。"

但他犹豫了一下。"我这么认为。我不确定。我不知道。也许我会用一种笨拙的方式来做。很可能,这篇论文没有这个帮助就不会存在。"

最后:"我们需要反复来回。人工智能模型将通过让我们做以前没有时间做的事情,来帮助我们做数学。"

这或许是一个典型例子,说明了今天的人工智能如何发挥作用。一组专家数学家,在一家大型科技公司的帮助下,比他们本来可能的速度更快地弄清楚了某件事——并且他们确信这是正确的,因为他们可以逐行验证。

你需要知道的一切

在探讨人工智能对数学研究的影响时,我们不应只看成功案例。Litt提醒说,"有很多人工智能生成的无意义内容污染了公共资源。"圣母大学的Joel David Hamkins说他"对这片淹没我们期刊系统的垃圾海洋感到绝望。"

数学家们正将希望寄托在形式化证明上,作为驾驭这片垃圾海洋的方式。他们将证明转换成计算机能理解的语言,然后使用计算机程序来验证证明中的所有逻辑是否成立。"没有验证的人工智能太不可靠,无法在任何严肃应用中使用,"陶哲轩说。

"这项技术很可能比计算机更重大,"Daniel Litt在最近一篇分析人工智能对数学潜在影响的文章中写道。Marta Iwanek

目前,以这种方式形式化数学证明是一个耗时、复杂的过程,本身需要大量的数学知识,并且有点像一门手艺。因此,数学家们越来越多地转向"自动形式化",即人工智能模型将数学陈述翻译成形式化的逻辑陈述,然后证明它们。"这是第一次,"陶哲轩说,"感觉我们可以通过人工智能形式化相当大一部分数学。"

许多数学家看到的另一个因人工智能数学能力日益增强而产生的主要挑战是,它将如何影响学生的学习方式。即使是最热忱的人工智能支持者也对此感到担忧。弗吉尼亚大学教授、最近请假成为Axiom"创始数学家"的Ken Ono告诉我,他"看到了一幅关于人工智能如何帮助数学研究的乐观图景,但我对人工智能在未来各级工作和培训中的作用深感担忧。"

陶哲轩说:"我们布置的许多问题,人工智能都能瞬间解决。这可能会阻碍许多学生锻炼他们的脑力。"

Hamkins对此表示同意。"我以前会布置相当多的作业。我不能再这样做了,"他说;学生上交的相当一部分作业是由人工智能写的。"我不想读它。我不想当人工智能警察。"尽管家庭作业在教学上非常有价值,但现在"一切都必须是课堂小测验和课堂作业。这对整个学术职业来说是个问题。"

正如另一位在顶尖研究型大学工作的数学家告诉我的那样,"存在着一个严重的风险:在加速严肃数学研究者进步的同时,人工智能阻碍了我们培养更多的数学研究者。"

即使经历了过去一年的快速变化,在我报道这篇文章时采访的数学家中,没有人担心数学这门学科会过时。陶哲轩给出了一个类比,数学家试图攀登"一个有着许多高山和许多山麓丘陵的大山脉"。人类一次只能攀登一步,但他们可以规划通往像珠穆朗玛峰这样山顶的路线。与此同时,陶哲轩说,当前的人工智能就像跳跃机器人。它们有时可以"通过跑酷的方式登上人类无法攀登的6英尺高的墙顶"。但它们无法进行长期的战略规划。陶哲轩设想,这6英尺可能会变成10英尺或100英尺,但"这些小跳跃机器人离数学的珠穆朗玛峰还差得远。"

Pak认为,某些"珠穆朗玛峰"——比如数论中一个关于像π + e这样的和能否写成分数的主要问题——将在几个世纪内仍未解决。"我真的很怀疑人工智能能在那里取得任何进展,"他说。"这不是人工智能能够做的事情。但我相当乐观,如果人类幸存下来,最终我们会弄明白的。"

当然,这在很大程度上取决于人工智能算法的能力在未来几年将如何变化和改进。即使是最敏锐、最仔细的观察者也无法确切地说出模型将如何发展。很少有人看到停滞的迹象。"事情发展得非常快。我没有看到任何放缓的迹象,"Litt说。2026年的头几个月已经见证了来自谷歌和OpenAI等大公司、Axiom等小公司,以及学术界甚至业余爱好者的源源不断的新成果。

"我的期望是,20年后我们肯定会看到人工智能工具产生的数学在许多可衡量的方面优于每一位人类数学家,"Litt说。"如果这没有发生,我会感到震惊。"

但正如Venkatesh告诉我的那样,"归根结底,表述任何一块数学都有无限多种方式。"他说,我们做出的选择受人类价值观的支配,并且受到数学不仅是科学也是艺术这一事实的影响。

科学与艺术之间的这种平衡,在很大程度上赋予了数学美——这是Venkatesh希望保留的"我们文化中的宝贵东西"之一。如果人工智能推动数学远离其艺术传统,这门学科将会受损,即使每个月证明的定理更多。毕竟,没有诗人会认真地谈论对十四行诗进行统计回归以找到最优的诗。

对人工智能最好的期望是,它将帮助数学家发现并证明那些否则将永远成谜的东西。大多数数学家同意,这正是计算机过去80年所做的工作。但当下正在发生的变革规模让许多人感到不安。

世界上最大的年度数学会议每年一月初举行。2026年,在华盛顿特区,关于被人工智能淘汰的紧张笑话随处可见,即使所有人都公开坚持人工智能将成为人类数学家的帮手。Williamson——他已经与人工智能合作多年并对此感到非常兴奋——被选中向整个会议发表一系列关于人工智能与数学的著名演讲。他告诉听众,以无知和恐惧来回应人工智能的发展是错误的。

但他表示,他理解恐惧从何而来。他将数学视为一门"人们毕生——奉献一生——的技艺。未来它的价值有可能被大大削弱。"

夜雨聆风

夜雨聆风