OpenClaw 2026.04.14 更新

这次先别盯新功能,先看那些最容易悄悄出错的地方。

这次更新如果只看标题,确实不算热闹。可真往里看会发现,OpenClaw 这回主要在收拾那些最容易拖垮日常体验、却又常常不显山不露水的小问题。

更新摘要

这次 OpenClaw 的更新,不是加一两个新功能,而是一轮偏底层的质量修整版。

从官方主更新帖和配套 release 来看,重点放在模型提供方兼容、GPT-5 系列的显式回合处理、频道侧问题修复,以及核心代码重构带来的整体性能改善;

具体改动里还能看到对 gpt-5.4-pro 的前向兼容支持、Telegram 论坛话题名称写入上下文,以及本地 Ollama 超时、Codex 自定义模型目录等一批问题修复。

整体看,这次更新的方向很清楚:不是把表面功能铺得更大,而是把模型兼容、上下文细节和底层稳定性再拧紧一轮。

对日常使用来说,这类版本不一定最吸睛,但往往最影响“能不能稳定跑、会不会悄悄掉配置”这种真实体验。

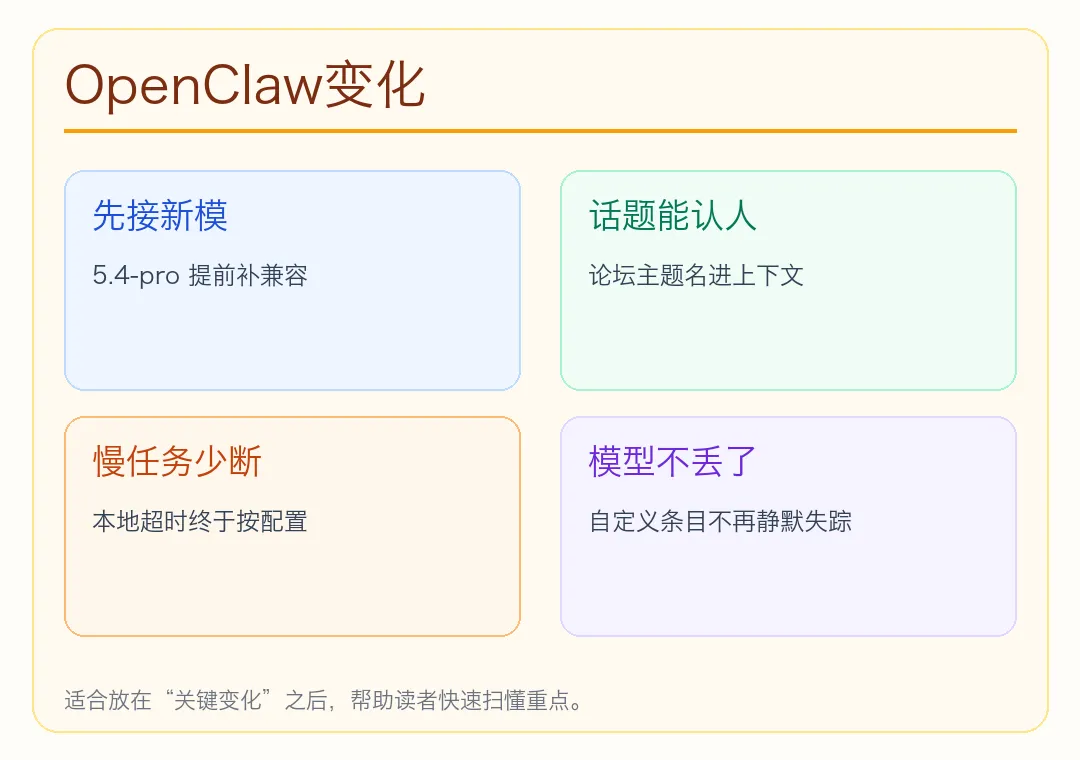

关键变化

这次最关键的变化,先看 OpenClaw 提前补上了 gpt-5.4-pro 的兼容支持。

从官方主更新帖和 release 来看,这次不仅把 Codex 侧的价格、限制和列表可见性一并补齐,还特意强调是在上游目录还没完全跟上的情况下先做前向兼容。

说白了,就是别等模型目录慢半拍,OpenClaw 先把能接的地方接上。第二个变化,是 Telegram 论坛话题终于更像“人能看懂的上下文”了。

release 提到,系统现在会从 Telegram 论坛的服务消息里学习真实话题名,再把这些名称写进 agent 上下文、提示元数据和插件钩子元数据里。

这个改动看着小,但它直接影响代理在多话题群组里到底知不知道自己在处理哪一个主题。第三个变化,是 本地 Ollama 的慢任务不再更容易被默认超时误伤。

配套说明写得很具体,这次把你配置的嵌入式运行超时继续往底层流式超时设置里传了下去。换句话说,如果你本来就把本地模型设成“允许慢一点跑”,现在不会再被系统另一层默认超时偷偷截断。

第四个变化,是 Codex 自定义模型“静默失踪”的问题被修了。

release 提到,之前 provider catalog 输出里少了 apiKey,会导致验证器直接拒收条目,最后把 models.json 里的自定义模型悄悄丢掉。

现在把这个字段补回去,本质上是在修那种最烦的错误类型, 不是直接报错,而是你以为配好了,结果系统默默没认。

如果把这些改动放在一起看,这版更新真正动的,是模型兼容、上下文可读性和底层超时这三块最容易影响日常稳定性的地方。

这张图对应的是这一节引用的官方说明,方便和正文里的具体变化对照着看。

这一节的重点已经整理成图,先看图再读正文会更轻松。

为什么重要

这次 OpenClaw 更新最值得关注的,不是又多了几个表面功能,而是那些最容易让系统悄悄出问题的地方,被集中修了一轮。

像 gpt-5.4-pro 的前向兼容、Telegram 论坛话题名写入上下文、本地 Ollama 的超时继承,还有 Codex 自定义模型静默丢失,这些改动看着分散,实际都指向同一件事:减少“你以为它会正常工作,结果某个细节先掉链子”。

对实际工作流来说,这会带来很直接的变化。模型目录跟不上时,OpenClaw 不用再干等上游;

多话题群组里,代理拿到的不再只是冷冰冰的话题编号;本地慢模型也不会轻易被默认超时提前掐掉。

说白了,这些都是日常跑任务时最烦、但又最难第一时间定位的问题。另一层价值在于维护和排障。

尤其是 Codex 自定义模型那类“系统没报错,但配置其实没生效”的问题,一旦修掉,团队接手和排查都会轻松很多。

换句话说,这次更新真正推进的,不是新鲜感,而是让 OpenClaw 更少出现那种隐蔽但很折磨人的小故障。

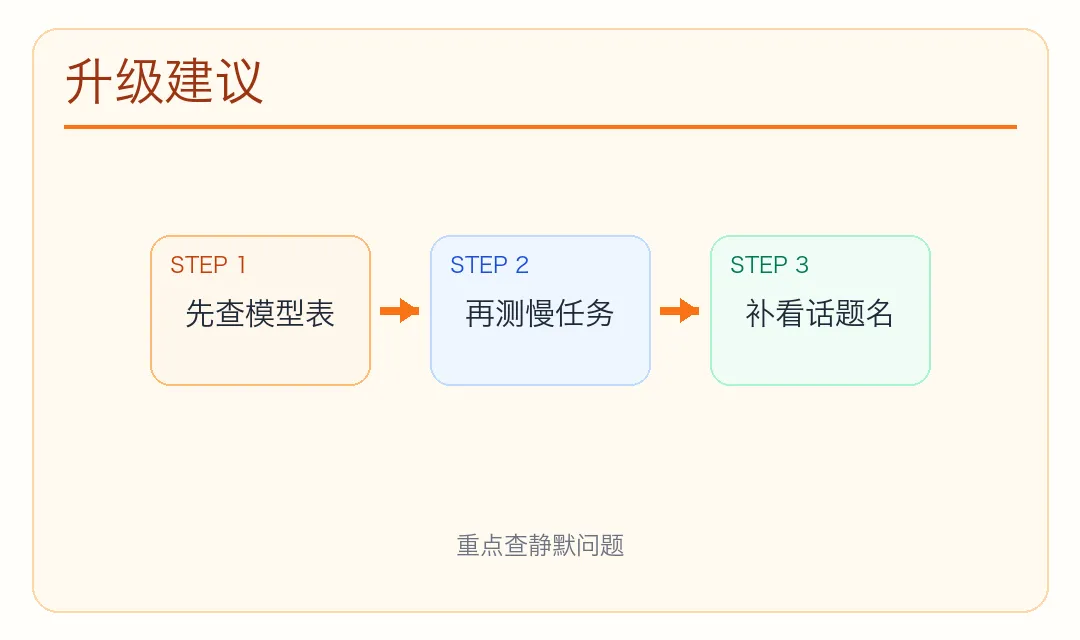

升级建议

如果准备升级到 OpenClaw 这版,第一步建议先查 模型目录和自定义模型配置。

官方 release 已经明确修了 gpt-5.4-pro 的前向兼容和 Codex 自定义模型被静默丢掉的问题,所以升级后最好先看一眼模型列表、状态页和 models.json,确认你原来配的条目都还在。

第二步,如果你本地在跑 Ollama,记得专门补一轮慢任务测试。

因为这次修的是超时设置往底层流式请求传递的问题,更稳妥的做法是拿一条本来就跑得慢的任务试一下,确认它现在真按你配置的超时执行,而不是被默认值截断。

第三步,Telegram 论坛群用户最好顺手检查话题上下文。既然系统现在会学习真实话题名并写进上下文和元数据,那就值得实际跑一遍多话题流程,看看代理是否已经能更准确地区分不同讨论线程。

这一节适合用步骤图来看,比连续几段正文更容易扫懂。

结论

如果只用一句话收尾,这次 OpenClaw 更新真正做的,是把那些最容易悄悄出问题的细节补牢了。

从官方主更新帖到配套 release,能看到前向兼容、上下文可读性、本地超时和自定义模型配置这些地方都被逐个修正,方向非常一致,就是让系统少一点隐性故障。

对普通使用者来说,最实在的一句建议就是:这版先别看花活,先看你的模型配置和慢任务是不是终于稳定了。

参考来源

以下链接是正文实际引用到的官方说明与配套文档。

官方更新说明

Release openclaw 2026.4.14 — openclaw/openclaw

这版先别看花活,先看你的模型配置和慢任务是不是终于稳定了。

夜雨聆风

夜雨聆风