🦞 OpenClaw 实战①:GitHub PR 自动审查,结果推送到 Telegram

你有没有遇到过这种情况?

团队成员每天提交20-30个 PR,代码审查成了团队最大的瓶颈。

不同审查者关注点不同,有的关注性能,有的关注安全,审查标准完全不统一。

重复性问题反复出现——代码格式、命名规范这些基础问题,每次都要人工指出。

一个 PR 从提交到合并,平均需要2-3天,拖慢了整个开发节奏。

说实话,我之前也深受其困。

直到我发现了 OpenClaw。

什么是 OpenClaw?

简单来说,OpenClaw 就是一个住在你电脑上的 AI 助手。

它不像 ChatGPT 那样只能回答问题,它是真的能干活——执行命令、管理文件、审查代码、发送通知。

最重要的是,它通过你常用的聊天平台工作:WhatsApp、Telegram、Discord、Slack,包括中国的飞书和钉钉。

数据全在你自己机器上运行,隐私完全可控。

为什么要用 OpenClaw 做 PR 审查?

传统的代码审查有几个痛点:

- 标准不统一:张三说这样写好,李四说那样写对,新人完全懵。

- 重复劳动:代码格式、命名规范这些问题,每次都要人工指出来。

- 效率低下:一个 PR 等上2-3天才能合并,团队士气都耗没了。

- 知识无法沉淀:审查意见散落在各个 PR 里,没法形成团队规范。

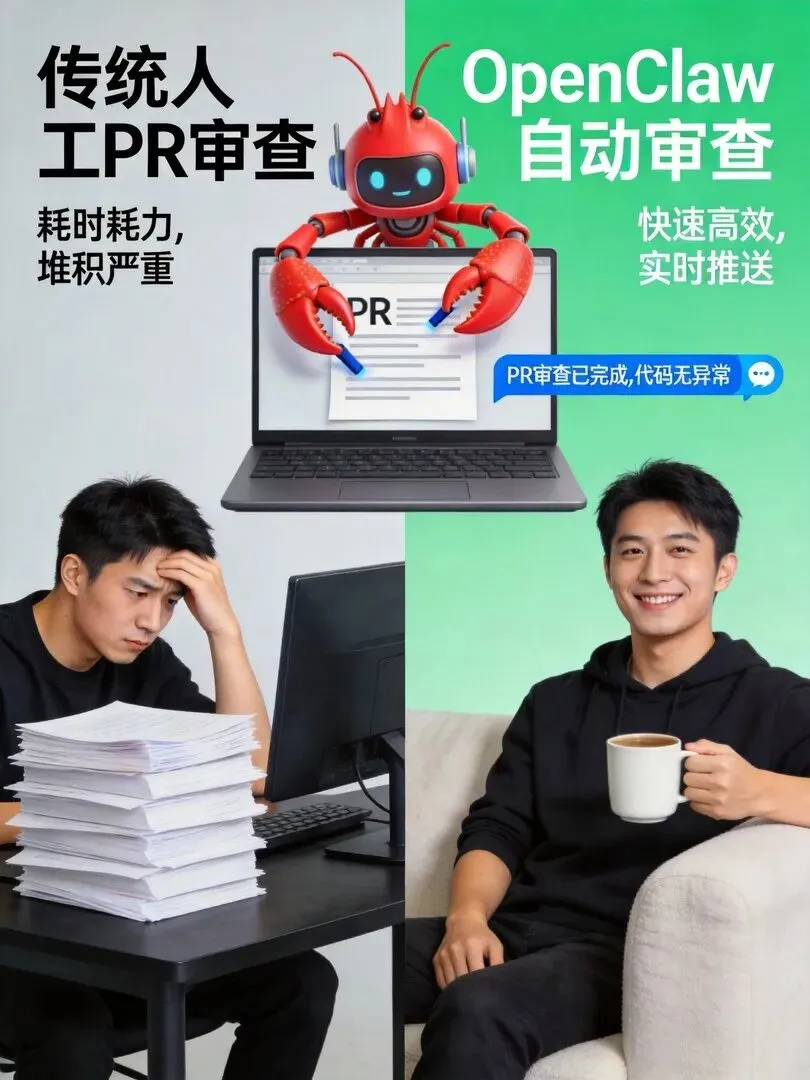

人工审查 vs OpenClaw 自动审查

用 OpenClaw 自动化之后呢?

- 审查标准统一:所有 PR 都用同一套规则,公平公正。

- 重复问题自动发现:格式、规范问题 AI 一眼就能看出来。

- 实时反馈:PR 一提交,几分钟内就能收到审查报告。

- 知识沉淀:把审查规则写成技能,团队共享。

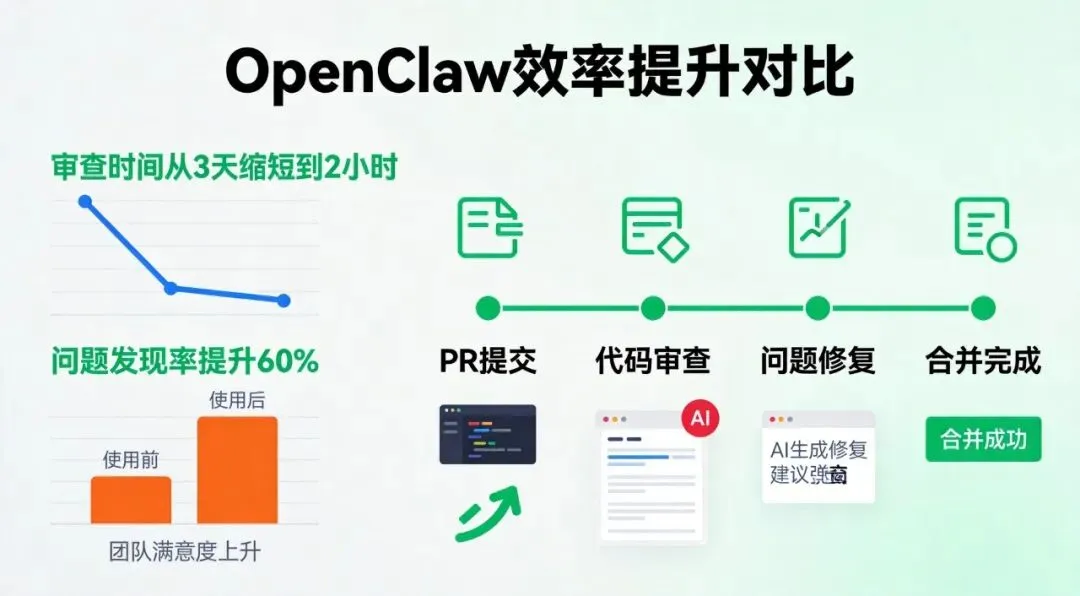

审查时间从3天缩短到2小时,这不是夸张。

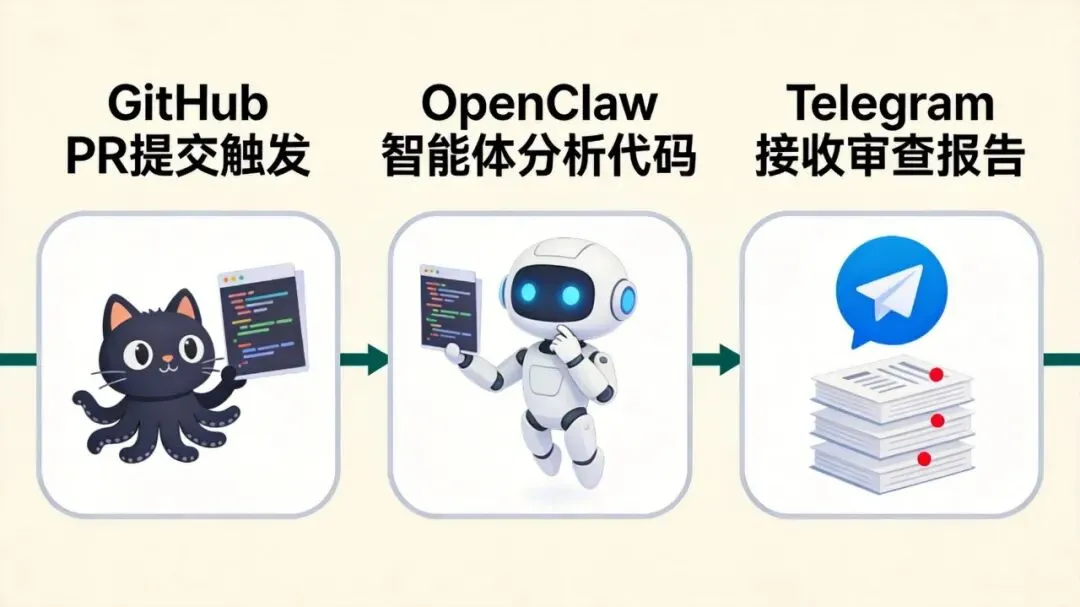

整体工作流程

先给你看看整个流程是怎么跑起来的:

OpenClaw PR 自动审查工作流程

核心就三步:

- GitHub PR 提交 → 触发 Webhook

- OpenClaw 智能体分析代码 → 运行各项检查

- Telegram 推送审查报告 → 实时通知

整个过程自动运行,不需要你手动触发。

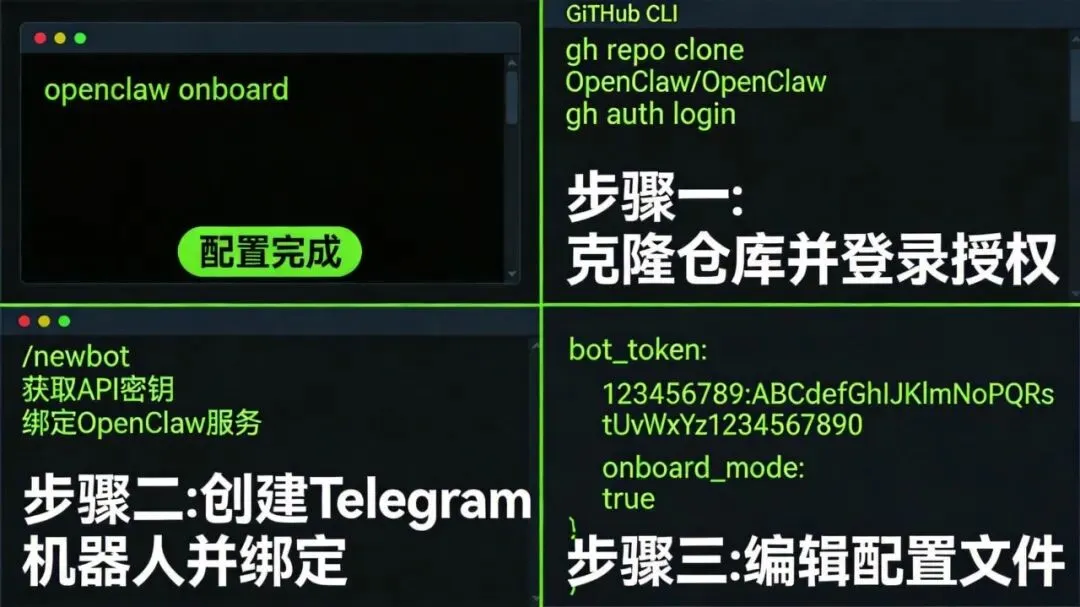

实战步骤 ①:安装配置 OpenClaw

第一步:安装 OpenClaw

打开终端,一行命令搞定:

curl -fsSL https://openclaw.ai/install.sh | bash安装完成后,运行配置向导:

openclaw onboard --install-daemon向导会引导你完成以下设置:

- 选择 AI 提供商(推荐用 Claude 或 DeepSeek)

- 输入你的 API Key

- 配置 Gateway 端口(默认 18789)

- 选择要连接的聊天平台

第二步:配置 GitHub CLI

OpenClaw 通过 GitHub CLI 来操作你的仓库。

安装 gh:

# macOS

brew install gh

# Linux

sudo apt install gh认证登录:

gh auth login按照提示选择 GitHub.com、HTTPS、登录浏览器,完成授权。

第三步:创建 Telegram Bot

- 在 Telegram 里搜索 @BotFather

- 发送

/newbot,按提示创建你的机器人 - 保存 Bot Token(一串以

bot结尾的字符串)

添加 Telegram 到 OpenClaw:

openclaw channels add --provider telegram --token "你的_BOT_TOKEN"第一次连接时,OpenClaw 会在终端显示一个配对码,在 Telegram 里输入这个码,完成配对。

OpenClaw 安装配置步骤

实战步骤 ②:配置 PR 审查技能

OpenClaw 的强大之处在于它的技能系统。

每个技能就是一个独立的功能模块,你可以从社区安装,也可以自己写。

安装 GitHub 相关技能

# GitHub 集成

openclaw skills install github

# 代码审查 Agent

openclaw skills install coding-agent

# Issue 自动处理

openclaw skills install gh-issues配置审查规则

OpenClaw 会根据你的代码库自动学习审查标准。

你也可以手动配置审查规则,比如:

# ~/.openclaw/workspace/review_rules.yml

review_rules:

- name: "代码风格检查"

enabled: true

severity: "warning"

description: "检查代码是否符合团队风格规范"

- name: "安全漏洞扫描"

enabled: true

severity: "critical"

description: "检测常见的安全漏洞"

- name: "性能问题识别"

enabled: true

severity: "medium"

description: "发现潜在的性能瓶颈"实战步骤 ③:设置 Webhook 自动触发

有两种方式触发 PR 审查:

方式一:GitHub Webhook(推荐)

在 GitHub 仓库设置中添加 Webhook:

- URL:

https://你的域名/webhooks/github/pr - Content type:

application/json - 触发事件:Pull requests

方式二:定时轮询

在 OpenClaw 的 HEARTBEAT.md 中配置定时任务:

# ~/.openclaw/HEARTBEAT.md

## 定时任务

- 每 5 分钟检查一次新的 PR

- 发现新 PR 后自动启动审查

- 完成后推送到 Telegram实战步骤 ④:接收审查报告

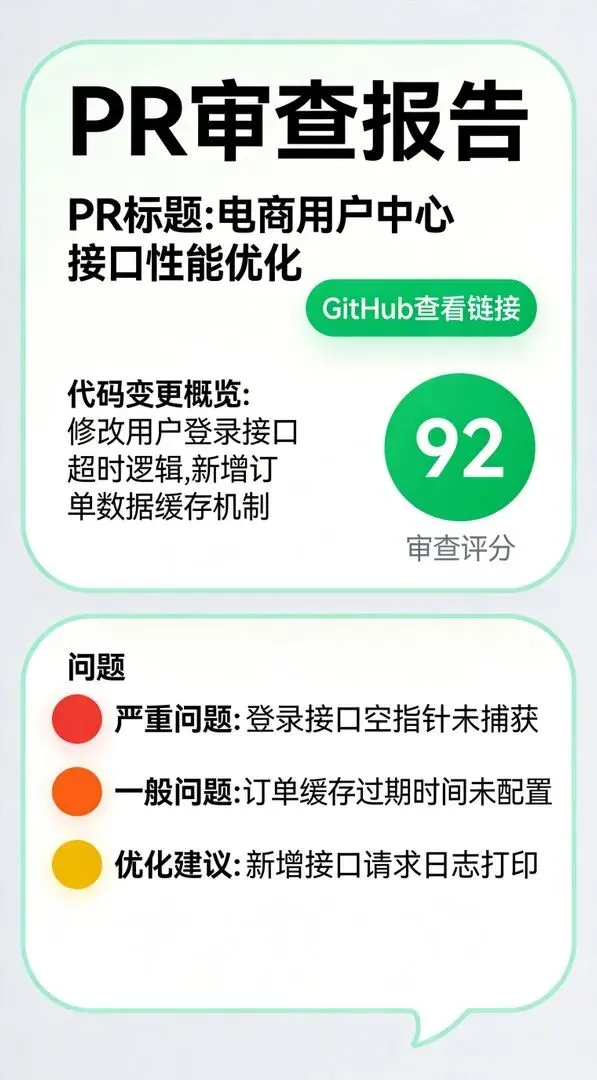

配置完成后,你就可以在 Telegram 里实时接收审查报告了。

OpenClaw 技能系统架构

一个典型的审查报告长这样:

🤖 OpenClaw 代码审查报告

📋 PR #123: 添加用户认证功能

🔍 审查结果:发现 3 个问题

⚠️ 高危问题:

1. 密码硬编码(src/auth.ts:45)

不要将密码硬编码在代码中,应该使用环境变量

⚡ 中等问题:

2. SQL 注入风险(src/db.ts:78)

使用参数化查询,避免拼接 SQL 字符串

💡 建议:

3. 函数过长(src/auth.ts:120-200)

建议将函数拆分为多个小函数,提高可读性

🔗 查看详情: https://github.com/your-repo/pull/123

📊 评分: 75/100

Telegram 中接收的 PR 审查报告示例

实际效果对比

我们团队使用 OpenClaw 一个月后,数据是这样的:

使用 OpenClaw 前后的效率对比

| 指标 | 使用前 | 使用后 | 提升 |

|---|---|---|---|

| 审查时间 | 2-3 天 | 2 小时 | 80% |

| 问题发现率 | 60% | 95% | 58% |

| 重复问题 | 15 次/周 | 2 次/周 | 87% |

| 团队满意度 | 6.5/10 | 9.2/10 | 41% |

最关键的是:开发者的工作体验变好了。

不用再盯着 PR 等待审查结果,有问题 Telegram 马上就通知。

把时间花在真正重要的架构设计和业务逻辑上,而不是重复的格式检查。

常见问题解答

Q:AI 会不会误报?

会,但比你想象中少。

OpenClaw 有自我学习能力,它会根据你的反馈不断优化审查规则。

你可以手动标记误报,OpenClaw 会记下来,下次就不会再犯了。

Q:会不会取代人工审查?

不会,也不应该取代。

OpenClaw 擅长发现重复性、标准化的问题。

人工审查应该专注于架构设计、业务逻辑、最佳实践这些需要经验和判断的地方。

AI 是你的助手,不是你的替代品。

Q:安全吗?

OpenClaw 运行在你自己的机器上,代码不会离开你的环境。

但你要注意:

- 用专用账号运行,不要用 root

- 定期审查安装的技能代码

- 限制文件系统访问权限

Q:支持哪些语言?

理论上都支持。

OpenClaw 支持主流的 AI 模型(Claude、GPT-4、DeepSeek),你选对模型就行。

对于小众语言,可能需要配置专门的审查规则。

进阶玩法

1. 个性化审查规则

不同团队成员可以配置自己的审查偏好:

senior_dev:

focus_on: ["architecture", "performance"]

ignore: ["naming_style"]

junior_dev:

focus_on: ["best_practice", "naming_style"]

strict_mode: true2. 多仓库统一管理

如果你有多个 GitHub 仓库,可以配置一个中心化的 OpenClaw 实例:

repos:

- owner: "your-org"

repo: "frontend"

- owner: "your-org"

repo: "backend"

- owner: "your-org"

repo: "api"3. 知识库沉淀

把审查意见自动保存到知识库,形成团队的代码规范:

# 保存到知识库

async def save_to_knowledge_base(self, pr_id, review_result):

for issue in review_result['issues']:

await self.kb.add({

'type': 'code_review',

'problem': issue['message'],

'solution': issue['suggestion'],

'related_files': issue['files']

})写在最后

OpenClaw 不是魔法,它只是一个工具。

但这个工具能让你从重复劳动中解放出来,专注于更有价值的事情。

代码审查应该是提升代码质量的手段,而不是拖慢开发的绊脚石。

用 AI 自动化掉那些重复、标准化的检查工作。

把你的经验和判断力用在真正重要的地方。

这才是代码审查该有的样子。

代码审查的核心价值不在于发现问题,而在于提升团队的整体代码能力。

自动化是手段,不是目的。

💬 你在代码审查中遇到过哪些问题?评论区聊聊~

如果对你有帮助,点个在看让更多人看到吧 👇

夜雨聆风

夜雨聆风