AI 的"超级引擎"正在加速,但踩油门的人越来越少了

2025 年的某个凌晨,我盯着屏幕上的一行数据愣住了。

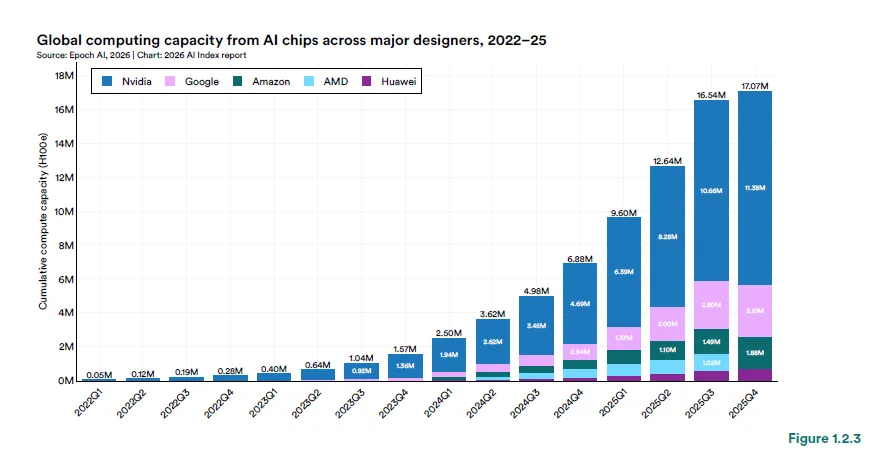

全球 AI 算力在过去三年里每年增长 3.3 倍,达到了 1710 万个 H100 等效芯片的规模。这个数字是什么概念?相当于全世界每秒钟都在建造一座超大型数据中心。

但另一组数据让我更震撼:流入美国的 AI 研究人员和开发者,自 2017 年以来下降了 89%,仅 2025 年一年就下降了 80%。

一边是疯狂加速的引擎,一边是越来越少踩油门的人。

这很奇怪,对吧?

全球 AI 算力增长图(2022-2025 年),显示 computing capacity 从约 2 H100E 飙升至近 18 H100E 的指数级增长曲线

一、行业的"独角戏"

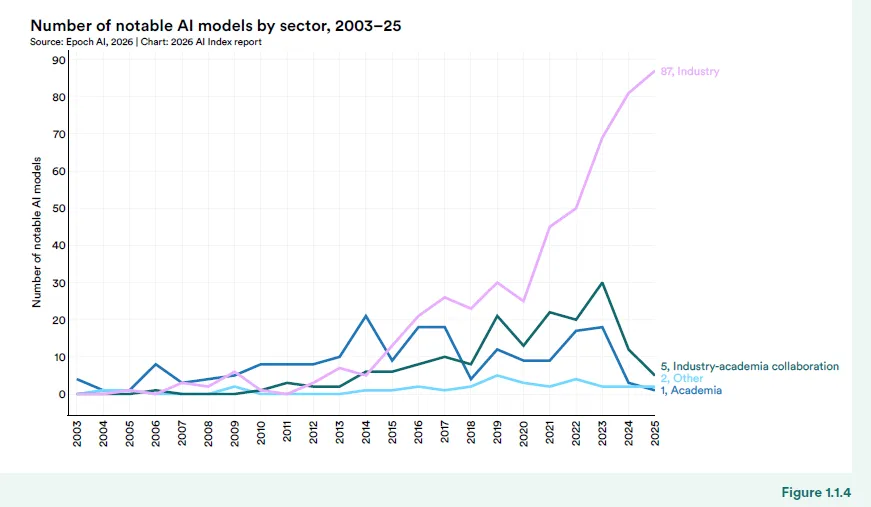

先说一个基本事实:2025 年,超过 90% 的显著 AI 模型来自行业。

这个数字比 2024 年还要高。学术机构和政府实验室正在慢慢退出这场竞赛,不是因为他们不想参与,而是因为参与的门槛已经高到无法想象。

训练一个前沿模型需要多少钱?没人愿意公开说,但业内普遍估计是数亿美元。这需要什么样的算力集群?数千张 H100 同时运转数月。需要什么样的数据?几乎整个互联网的公开文本。

学术机构玩不起了。

行业 vs 学术界 AI 模型占比图(2003-2025 年),显示行业份额从约 40% 增长至 91.6%,学术界萎缩至仅 1%

但这带来一个更深层的问题:当 AI 的发展方向几乎完全由商业利益决定时,我们会失去什么?

我记得 2023 年的时候,还有很多大学实验室在探索各种"奇怪"的方向——有些模型效率很低,但可解释性极强;有些研究不追求性能,而是专注于理解神经网络到底在"想"什么。

现在这些声音越来越少了。

行业主导意味着效率优先、性能优先、商业化优先。这没错,商业公司本来就该这样。但科学的进步有时候需要一些"不实用"的探索,需要一些允许失败的空间。

二、中美 AI 竞赛的另一面

说到 AI,就绕不开中美竞争。

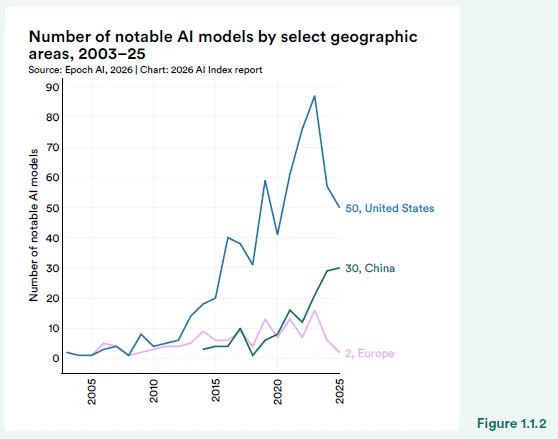

报告里有一组很有意思的数据:在前沿模型数量上,美国以 50 个对 30 个领先中国。但在论文数量、引用次数和专利授权方面,中国全面领先。

中美模型数量对比柱状图:美国 50 个,中国 30 个,韩国 5 个,加拿大/法国/英国各 1 个

这说明什么?

美国在"塔尖"上依然占优,但中国在"塔基"上已经非常雄厚。

我有个在斯坦福读博的朋友,去年跟我聊天时说了一句让我印象深刻的话:"以前是我们教中国学生怎么做研究,现在是他们教我们怎么高效做实验。"

中国的科研体系有一种独特的优势:一旦确定方向,就能集中资源快速推进。这在 AI 这种需要大规模工程能力的领域特别有效。

但美国也有自己的护城河。

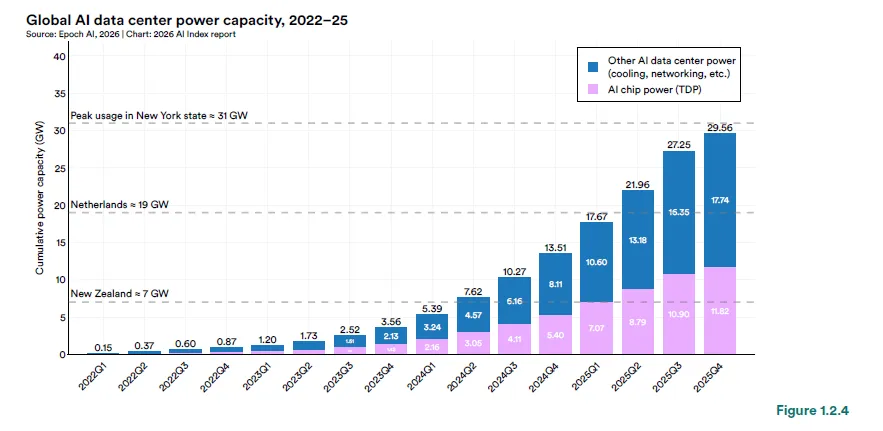

报告提到一个关键数据:美国拥有 5427 个数据中心,是其他国家的 10 倍以上。这不是钱的问题,这是时间的问题——建数据中心需要土地、电力、审批,这些都需要时间积累。

全球 AI 数据中心电力容量增长图,显示从 2022 年 Q1 的 2.52 GW 增长至 2025 年 Q4 的 29.56 GW

还有一个更隐蔽的优势:最强大的 AI 模型,几乎都来自美国。而且这些模型的透明度最低,评分只有 2-16 分(满分 100 分)。

不透明本身就是一种壁垒。你连对手在用什么都不知道,怎么竞争?

三、供应链上的"定时炸弹"

如果说中美竞争是明线,那供应链风险就是暗线。

报告里有一句话,我读的时候后背发凉:

"几乎所有 AI 芯片都由台积电一家制造。"

不是"大部分",是"几乎全部"。

想象一下,整个 AI 行业的大厦,建立在一家公司的生产能力之上。如果台积电出问题,全球的 AI 发展都会停摆。

这不仅仅是地缘政治的风险。地震、疫情、电力短缺,任何意外都可能引发连锁反应。

更有趣的是,美国虽然拥有最多的数据中心,但在芯片制造上却依赖台湾。这种"算力在美国,制造在台湾"的格局,本身就是一种脆弱性。

报告没有明说,但我能感觉到作者们的担忧:AI 的发展速度已经超过了供应链的韧性建设速度。

我们造引擎的速度,比修路的速度快太多了。

四、人才流动的"逆向潮"

回到文章开头那组数据:美国 AI 人才流入下降 89%。

这不仅仅是数字。每个数字背后都是一个人,一个家庭,一个职业选择。

我认识几位原本计划去美国读 AI 博士的学生,去年都改变了主意。有的去了欧洲,有的留在国内,还有的直接进了行业。

原因很复杂。签证政策只是表象,更深层的是"机会成本"的计算。

当中国的 AI 产业已经能提供有竞争力的薪资和研究条件时,出国的吸引力自然下降。更何况,美国的生活成本和安全问题也是现实考量。

但人才流动的影响是长期的。

科学进步很大程度上依赖于思想的碰撞和人员的交流。当这种流动减少,整个领域的创新活力都会受到影响。

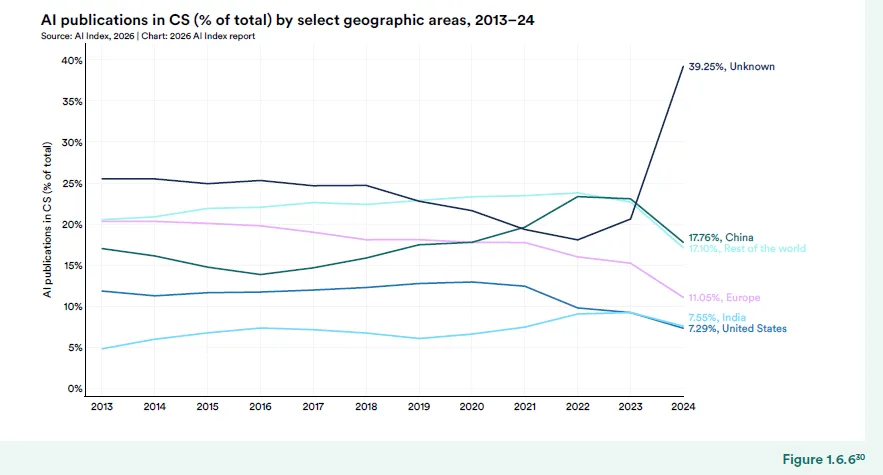

各国 AI 论文发表占比趋势图(2013-2024 年),显示中国 17.76%、欧洲 11.05%、印度 7.55%、美国 7.29%

报告里还有一个容易被忽略的细节:各国 AI 领域的性别差距依然严重,"没有任何国家接近平等"。

这意味着,AI 行业不仅在流失地理多样性,也在流失认知多样性。当一群背景相似的人决定技术的未来时,盲点会越来越多。

五、透明度的悖论

最后说一个让我很纠结的问题:透明度。

报告说,几乎所有前沿模型开发者都报告能力基准,但负责任的 AI 基准报告参差不齐。大多数领先模型的透明度评分极低,只有 2-16 分。

这很好理解。商业公司花数亿美元训练的模型,怎么可能把细节都公开?

但问题是,不透明会带来信任问题。

当一个模型被广泛应用于医疗、金融、司法等关键领域时,我们真的不需要知道它是如何工作的吗?

这里有一个深刻的悖论:

越强大的模型,越不透明;越不透明的模型,越需要被信任。

行业有自己的逻辑。商业机密、竞争优势、安全风险,这些都是真实的考量。但科学的传统是开放和共享,当这个传统被打破,整个领域的公信力会受到影响。

我想起报告里的另一组数据:记录的 AI 事故从 2024 年的 233 起上升到 362 起。

这不是在指责谁,而是在说一个事实:当技术越来越强大,而我们对它的理解越来越有限时,意外是必然的。

六、我们在见证什么?

写到这里,我想回到最初的问题:AI 研发资源持续增长,但前沿模型越来越集中于少数组织,这意味着什么?

我认为我们在见证一个历史性的转变:

AI 正在从"科学探索"转变为"工业基础设施"。

这不是好坏的问题,而是现实。就像电力、互联网一样,AI 正在成为社会的基础设施。而基础设施的特点就是:高投入、高集中、高门槛。

这个转变有好处。工业化意味着标准化、规模化、可靠性提升。我们会看到更好的产品、更稳定的服务、更快的迭代。

但也有代价。多样性会减少,探索的空间会压缩,"失败的权利"会被剥夺。

我有时候会想,如果 AI 的发展完全由商业逻辑主导,我们会错过什么?

会不会有某个"不实用"的方向,其实是通向更高级智能的钥匙?会不会有某个被放弃的研究,本可以解决我们现在头疼的对齐问题?

没人知道答案。

但有一点是确定的:当引擎越来越强大,而踩油门的人越来越少时,方向的选择就变得更加重要。

我们需要在效率和多样性之间找到平衡,在商业利益和科学探索之间保留空间,在技术进步和社会责任之间建立对话。

这不是某一家公司或某一个国家的责任,而是整个行业、整个社会的责任。

最后说两句

写这篇文章的时候,我一直在想:作为读者,你看完这些信息,应该做什么?

我的建议是:保持好奇,保持质疑。

AI 不是魔法,它是由人创造的技术。既然是人创造的,就可以被人理解、被人影响、被人改变。

不要因为技术强大就放弃思考,不要因为行业集中就停止关注。

这个世界需要更多踩油门的人,也需要更多看地图的人。

而你,可以成为其中任何一个。

本文基于斯坦福 AI Index 2026 报告第 1 章(研究与开发)撰写。数据来源:Epoch AI、OpenAlex、斯坦福 AI Index。

夜雨聆风

夜雨聆风