无需联网、隐私安全、永久免费,带你玩转本地大模型。

最近很多朋友问我:有没有既安全又免费的AI工具?网上那些在线服务要么收费,要么担心数据泄露。其实,只要你的电脑有一块还不错的显卡(或者足够的内存),完全可以把AI“请回家”——本地部署,隐私无忧,而且永久免费。

今天,我就把自己一直在用的五款本地AI工具打包分享给大家。一个BAT启动器,五个入口,覆盖聊天、翻译、创意写作等日常需求。全部基于llama.cpp或Ollama后端,模型自己选,数据自己存,完全掌控。

•隐私安全:所有对话、翻译、文档都在你自己的电脑上处理,不会上传到任何云端。

•永久免费:没有API计费,没有会员订阅,只要你愿意,可以用一辈子。

•离线可用:没网也能用,出差、旅行、办公室内网环境,照常工作。

•模型自由:支持 DeepSeek、Qwen、Llama、Gemma 等上千种开源模型,随便换。

•极速响应:没有网络延迟,生成速度只取决于你的硬件。

🧰五大工具,一键启动

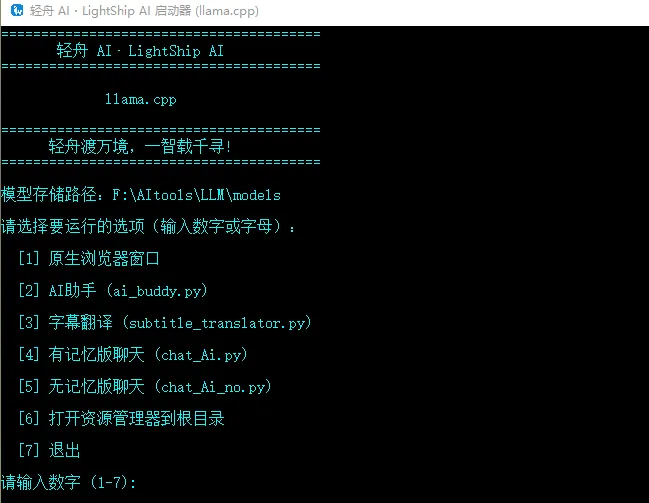

我写了一个 BAT启动器(批处理文件),放在 F:\AItools\LLM 目录下。双击运行,会出现一个简洁的菜单:

下面逐一介绍每个工具的用途和亮点。

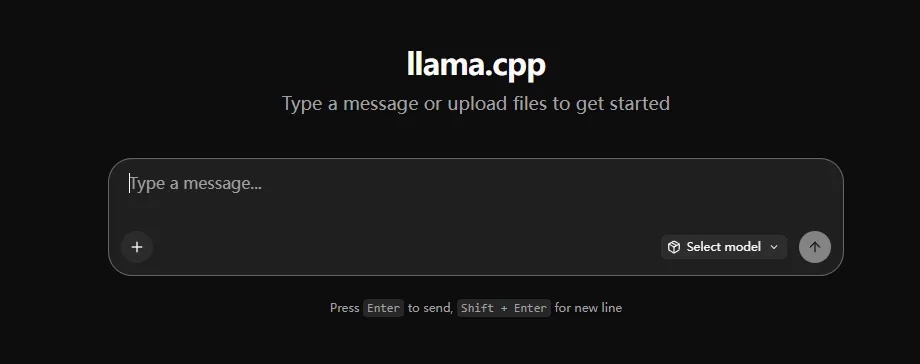

1️⃣原生浏览器 – 在线AI的“导航台”

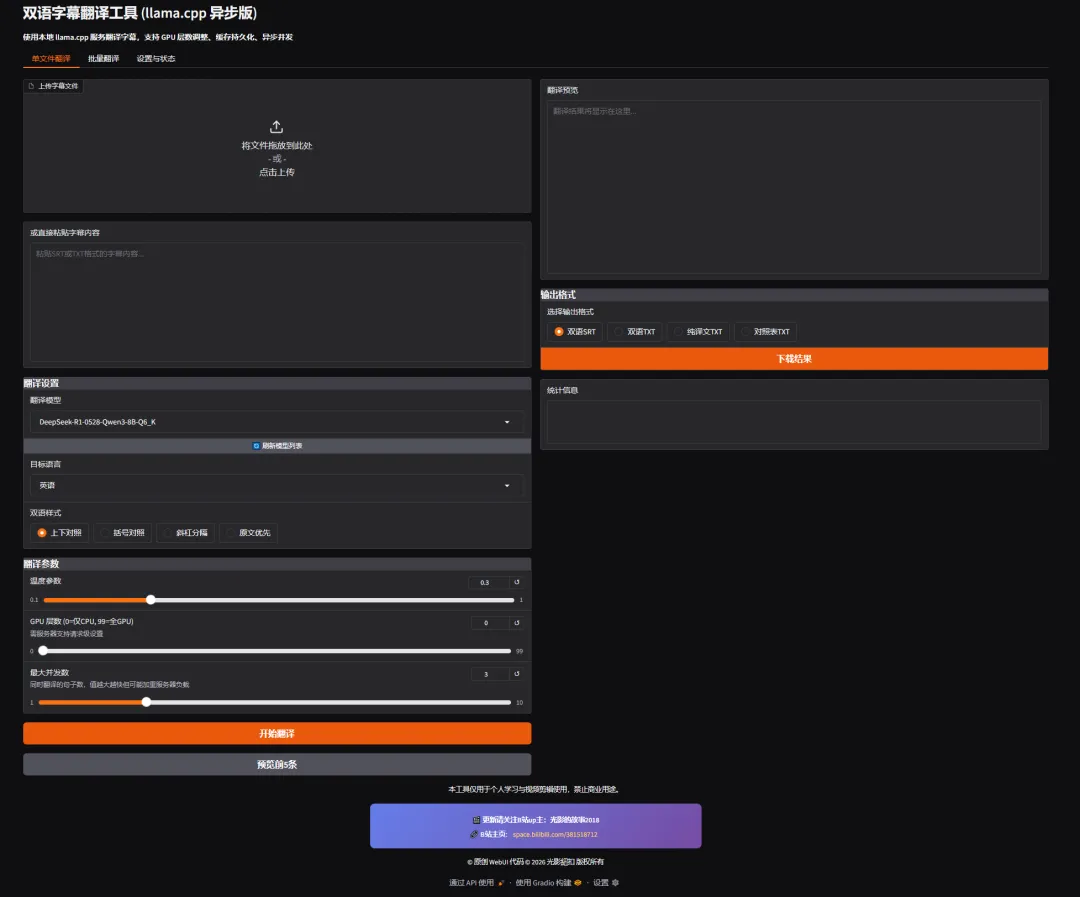

2️⃣双语字幕翻译工具 – 视频创作者的救星

做视频的朋友都知道,给外文视频配双语字幕有多麻烦。这个工具专门解决痛点:

•支持 SRT / TXT 字幕:直接上传字幕文件,或者粘贴内容。

•调用本地 llama.cpp 翻译:完全离线,不用担心字幕内容泄露。

•智能长文本分段:遇到几百字的台词自动拆分,不会撑爆模型上下文。

•四种双语样式:上下对照、括号对照、斜杠分隔、原文优先。

•批量处理:一次翻译整个文件夹的字幕文件。

•输出多种格式:双语SRT、纯译文TXT、对照表等。

适合场景:自媒体翻译、外语学习、企业培训视频本地化。

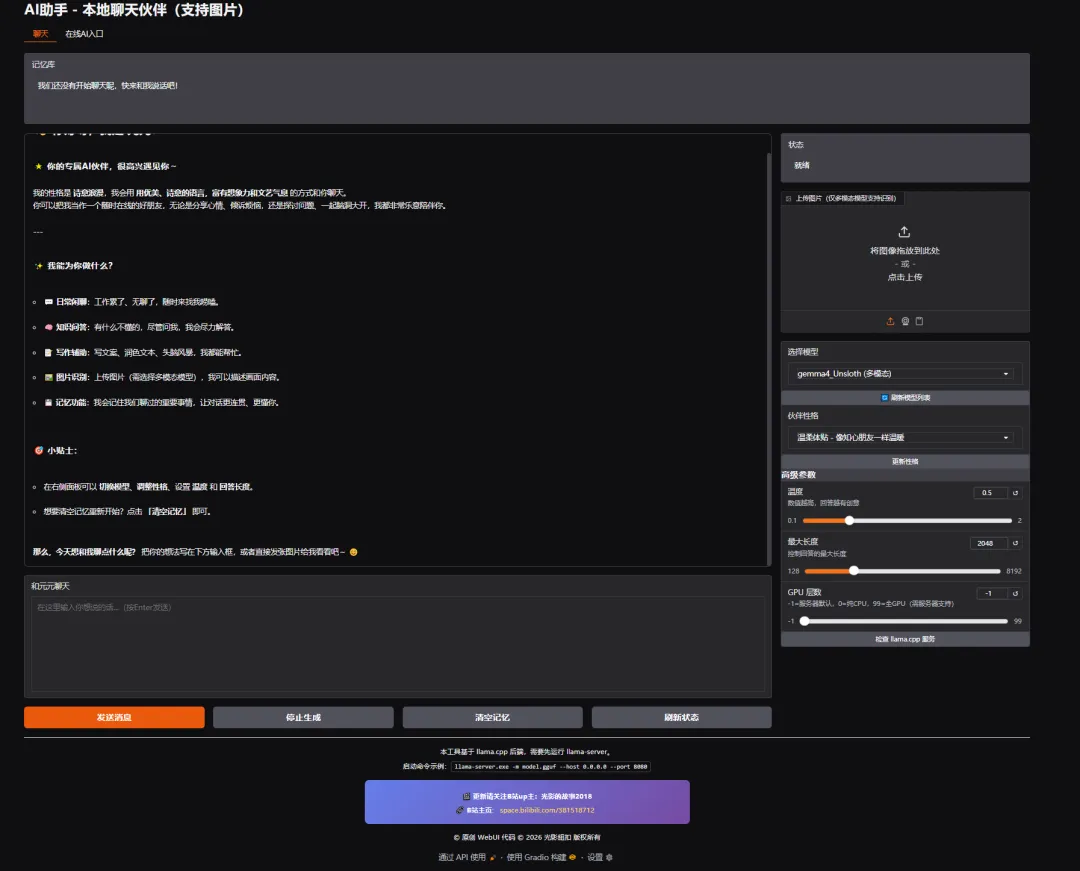

3️⃣ AI Buddy – 带思考过程的智能伙伴

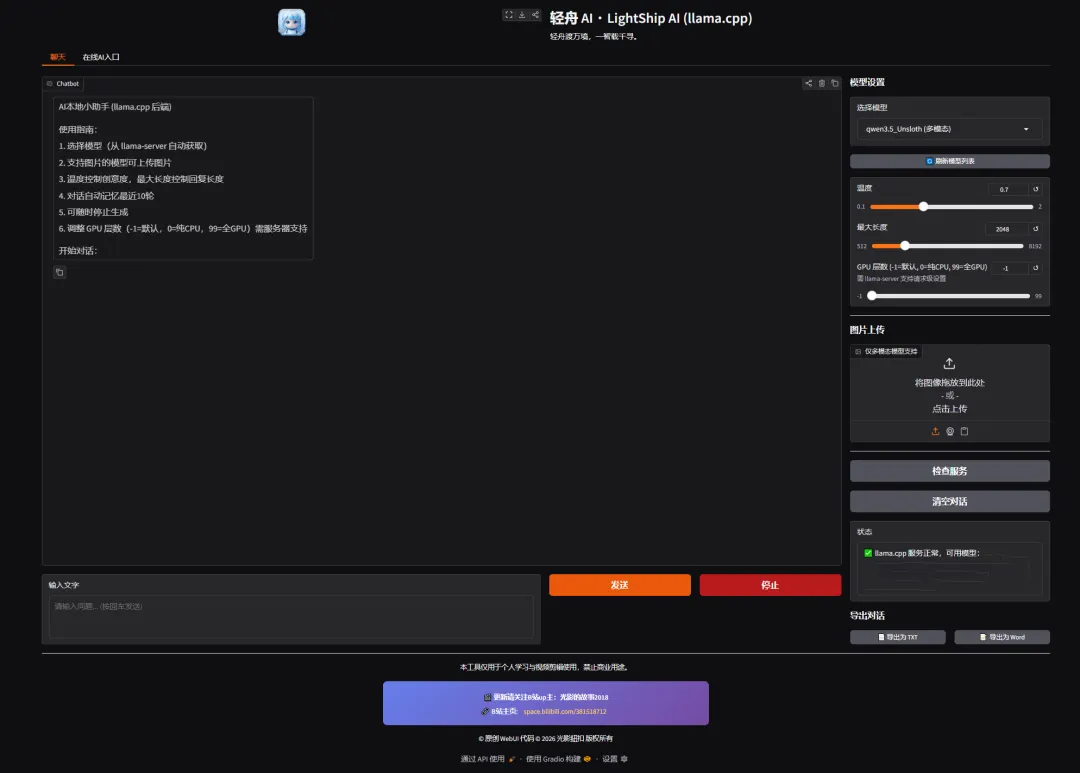

这是最常用的聊天工具。它基于 llama.cpp或Ollama后端,支持多模态(图片识别),并且会显示AI的思考过程。

核心功能:

•流式对话:逐字显示回答,像真人聊天。

•思考过程可视化:AI 会先用标签写下推理步骤,然后给出最终答案。你可以点击展开查看它是如何“想”的。

•长期记忆:所有对话自动保存到 memory/chat_memory.json,下次启动还能接着聊。

•性格切换:内置12种人格(温柔体贴、傲娇可爱、热血中二……),还可以自定义。

•图片识别:选择支持多模态的模型(如 Qwen2.5-VL、LLaVA),上传图片,AI 能看懂图中内容。

适合场景:日常闲聊、头脑风暴、学习辅助、情绪陪伴。

4️⃣有记忆聊天 – 真正“认识你”的AI

这个版本专注于长期对话记忆,没有复杂的思考过程显示,界面更简洁,但记忆容量更大。

•自动记住最近10轮对话,即使关掉程序,下次打开还能接着上次的话题聊。

•支持模型切换:可以随时换模型,记忆不会丢失。

•轻量级:适合长时间、多轮次的深度对话,比如写小说时和AI一起构思情节。

适合场景:角色扮演、创作协作、心理咨询式聊天。

5️⃣无记忆聊天 – 用完即走,不留痕迹

如果你只是临时问个问题,不希望留下任何记录,就用这个。

•不保存任何对话历史,关闭窗口后一切清零。

•极简界面,只有输入框和回复区。

•速度最快,因为没有记忆加载和保存的开销。

适合场景:查资料、算数学题、临时翻译一句话、测试不同模型的回答风格。

🛠️技术栈 & 环境要求

所有工具均基于以下开源项目:

后端 | 说明 |

llama.cpp | 高效运行 GGUF 格式模型,支持 CPU / GPU 混合推理 |

Ollama | 可选后端,用于 ai_buddy.py(原版) |

Gradio 6.x | 统一 WebUI 框架,所有工具都是独立的 Gradio 应用 |

硬件要求(最低):

•CPU:4核以上(建议 8核)

•内存:16GB(推荐 32GB)

•显卡:可选,有 NVIDIA GPU 可大幅提速

•硬盘:至少 20GB 用于存放模型文件

软件要求:

•Windows 10 / 11

•Python 3.10+ 环境(已打包在python_embeded 文件夹中,无需额外安装)

📦如何获取和安装?

通过百度网盘分享的文件:本地AI部署

链接:https://pan.baidu.com/s/1OTsi50VMkwVc_znh5uMpLQ?pwd=6688

安装步骤:

1.下载压缩包,解压到 F:\AItools\LLM(或其他任意英文路径)。

2.双击 启动AI.bat,根据提示选择要运行的工具。

4.浏览器会自动打开对应的 Gradio 界面(默认端口 7861~7866,冲突时自动切换)。

⚠️注意:本工具包不包含任何模型文件,需要您自行从 Hugging Face 或国内镜像下载 GGUF 格式模型。推荐使用 deepseek-r1-8b-q5、qwen3.5-7b 等。 |

🧪实际使用演示

场景一:深夜学习英文论文

打开 双语字幕翻译工具,上传一个 TED 演讲的 SRT 字幕,选择qwen3.5-7b 模型,目标语言“中文”,5分钟后得到双语字幕。导入剪映,直接出片。

场景二:和AI讨论人生规划

打开 有记忆聊天,设定性格为“理性冷静”,连续聊三天,AI 记住了你昨天提到的职业困惑,今天的回答更有针对性。

场景三:测试不同模型的创造力

同时打开 无记忆聊天 和 AI Buddy,问同一个问题:“给我讲一个关于月亮的恐怖故事”。对比DeepSeek-R1 和 Qwen 的回答风格,选出最喜欢的。

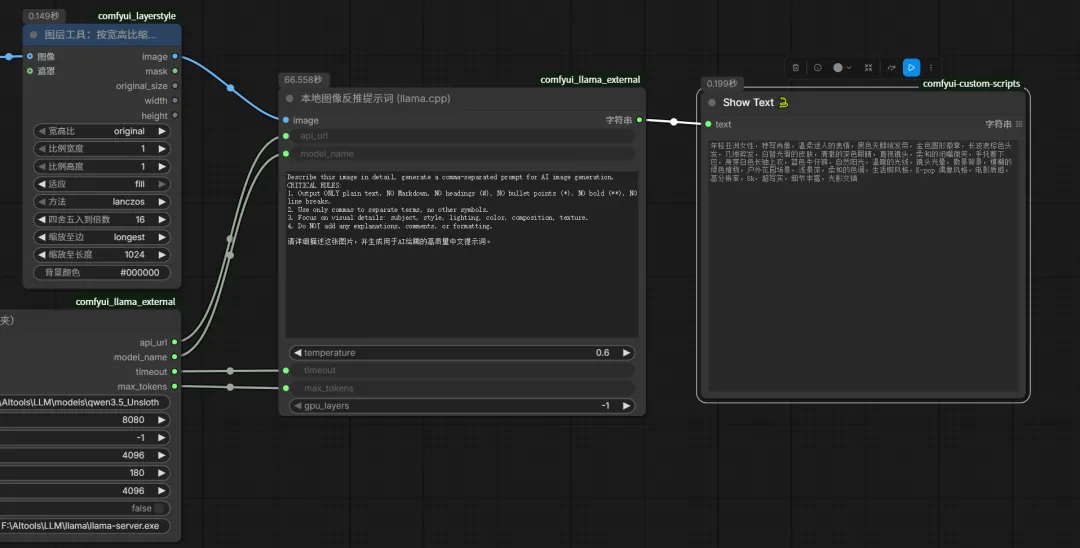

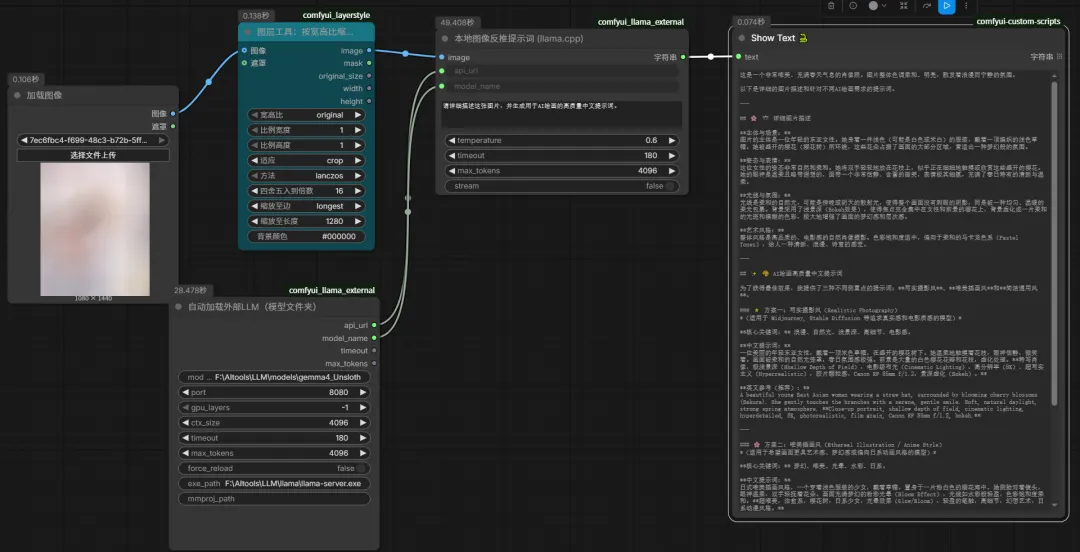

彩蛋功能:接入ComfyUI,让提示词工程起飞

如果你玩 Stable Diffusion / ComfyUI,一定遇到过这样的痛点:写提示词写到词穷,或者想让画面内容更贴合剧本,却不知道怎么用英文精确描述。

现在,本地大模型可以直接为 ComfyUI 服务!

omfyUI 插件:一键生成/优化提示词

我做了一个 ComfyUI 插件节点,功能包括:

节点名称 | 功能 |

LLM Prompt Enhancer | 输入简单中文描述,AI自动扩写成高质量英文提示词(支持 SDXL / SD3 / Flux 风格) |

LLM Negative Prompt Gen | 根据画面内容,自动生成反向提示词,去除畸形手、多余肢体等 |

LLM Prompt Translate | 中英文提示词互译,保留专业术语(如 “8K, masterpiece, cinematic lighting”) |

Batch Prompt Engineering | 批量处理提示词列表,一键风格化改写(赛博朋克、水墨风、黏土动画等) |

工作流示例:

•在 ComfyUI 中输入中文:“一个穿着机甲的女孩站在雨中,背景是未来城市,霓虹灯反射在水洼里”

•调用本地 qwen3.5-7b 模型,通过 OpenClaw 发送请求。

•返回英文提示词:"A cyberpunk girl in mecha suit standing in the rain, futuristic city background, neon lights reflecting in puddles, 8K, cinematic, intricate details, volumetric lighting"

•直接送入采样器生成图片。

完全离线,不用花钱买 GPT 的API,而且可以反复调试模型参数(温度、top_p),找到最适合你画风的提示词风格。

⚙️如何使用?

在 ComfyUI 中安装插件:将comfyui_llm_prompt_engineer 文件夹放入 custom_nodes 目录。

•配置插件中的 API 地址(默认 http://127.0.0.1:8080/v1/chat/completions),选择本地模型。

•拖拽节点,连接你的提示词输入框,即可享受 AI 辅助提示词工程。

💡小技巧:把常用画风(比如 “analog film grain, 35mm, f/1.8”)写进系统提示词,每次扩写都会自动附加,省去重复输入的麻烦。 |

整体架构回顾

现在,这套工具已经不仅仅是“聊天+翻译”了,而是一个完整的本地AI中枢:

用户交互层:

•AI Buddy(带思考过程聊天)

•有记忆聊天(长期对话)

•无记忆聊天(临时问答)

•双语字幕翻译

能力扩展层:

•OpenClaw(API 代理)

•ComfyUI 插件(提示词工程)

•原生浏览器(在线AI入口)

后端引擎:

•llama.cpp (llama-server)

•Ollama(可选)

模型层:

•DeepSeek-R1(推理)

•Qwen3.5(多模态/翻译)

•LLaVA(图片识别)

•任何 GGUF 格式模型

所有组件都可以独立运行,也可以互相调用。比如:

•在 ComfyUI 里用 AI Buddy 的思考过程来生成提示词。

•把双语字幕翻译的结果直接喂给 AI Buddy,让它帮你润色。

•用无记忆聊天快速测试不同模型的翻译质量。

最后:ComfyUI插件的确是我最得意的“隐藏功能”之一。这样一来,本地AI不仅能聊,还能画,真正打通了语言模型和图像生成之间的壁垒。

夜雨聆风

夜雨聆风