会议推荐

2026第三届中国医药企业项目管理大会

2026第二届中国AI项目管理大会

2026第十五届中国PMO大会

2026第五届中国项目经理大会

本

文

目

录

1、AI药物设计新突破:新型广谱抗冠状病毒药物诞生记!

2、AI设计新药重大突破:88%化合物展现显著生物活性

3、IF=79!AI药物设计新突破-多目标分子设计的新策略提高预测可靠性

4、【JCIM】“数据荒""有救了!AI用”二手""预测数据,竟在药物设计挑战赛中逆袭顶尖模型

一、AI药物设计新突破:新型广谱抗冠状病毒药物诞生记!

(原创 翌然小白 分子之旅)

计算机辅助设计设计高效新冠抑制剂

COVID-19疫情全球大流行已造成超过7.75亿人感染和700万人死亡,尽管疫苗研发迅速,但对高效抗病毒药物的需求依然迫切。病毒复制过程中的主蛋白酶(Mpro)因其高度保守性和人体内缺乏类似蛋白酶的特点,成为理想的药物靶点。

现有药物如奈玛特韦(nirmatrelvir)和恩司特韦(ensitrelvir) 虽已获批使用,但仍存在药物相互作用及抗病毒谱有限等问题。特别是恩司特韦对MERS、229E和NL63等人类冠状病毒效果较弱,这促使科学家寻求新一代非共价抑制剂,以具备更广谱的抗冠状病毒能力。

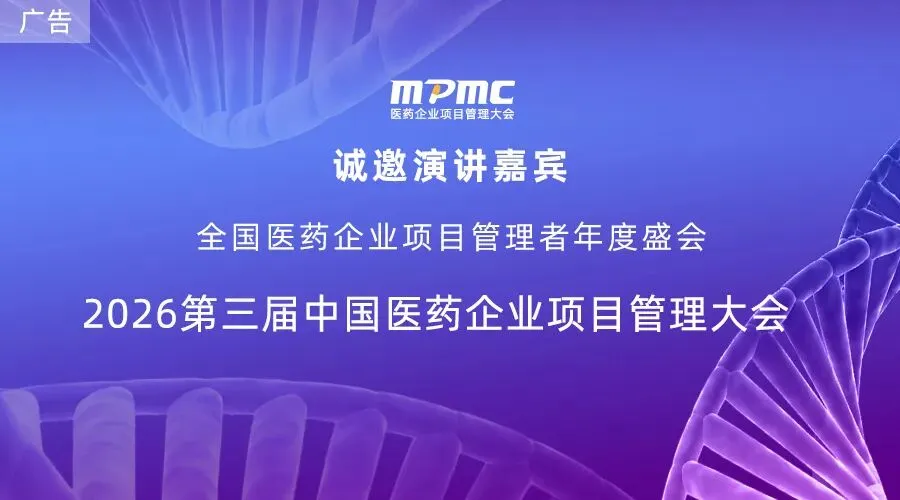

虚拟筛选发现先导化合物

研究团队采用计算机辅助药物设计方法,对150万化合物库进行虚拟筛选。通过分子对接和相似性搜索两种策略,最终筛选出21个苗头化合物,其中化合物3因其新颖的非共价抑制机制被选为重点研究对象。

结构引导的药物设计

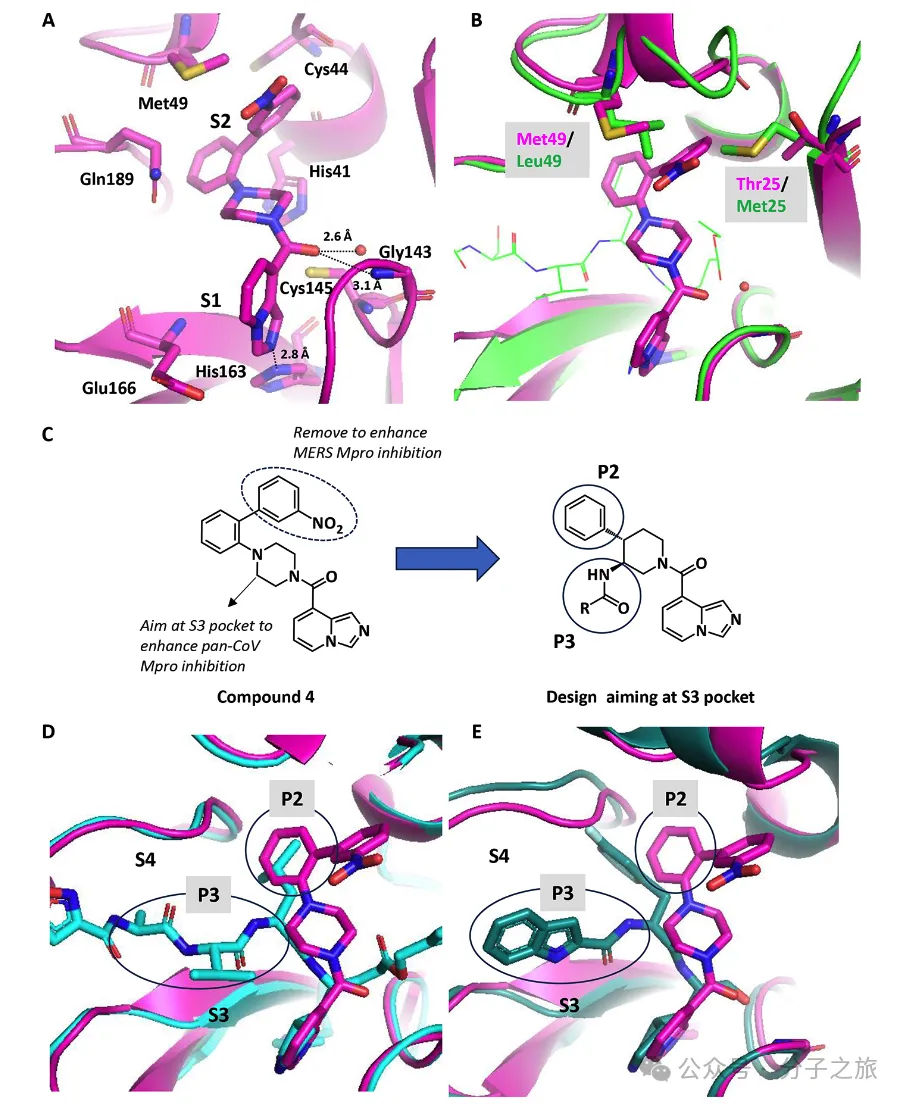

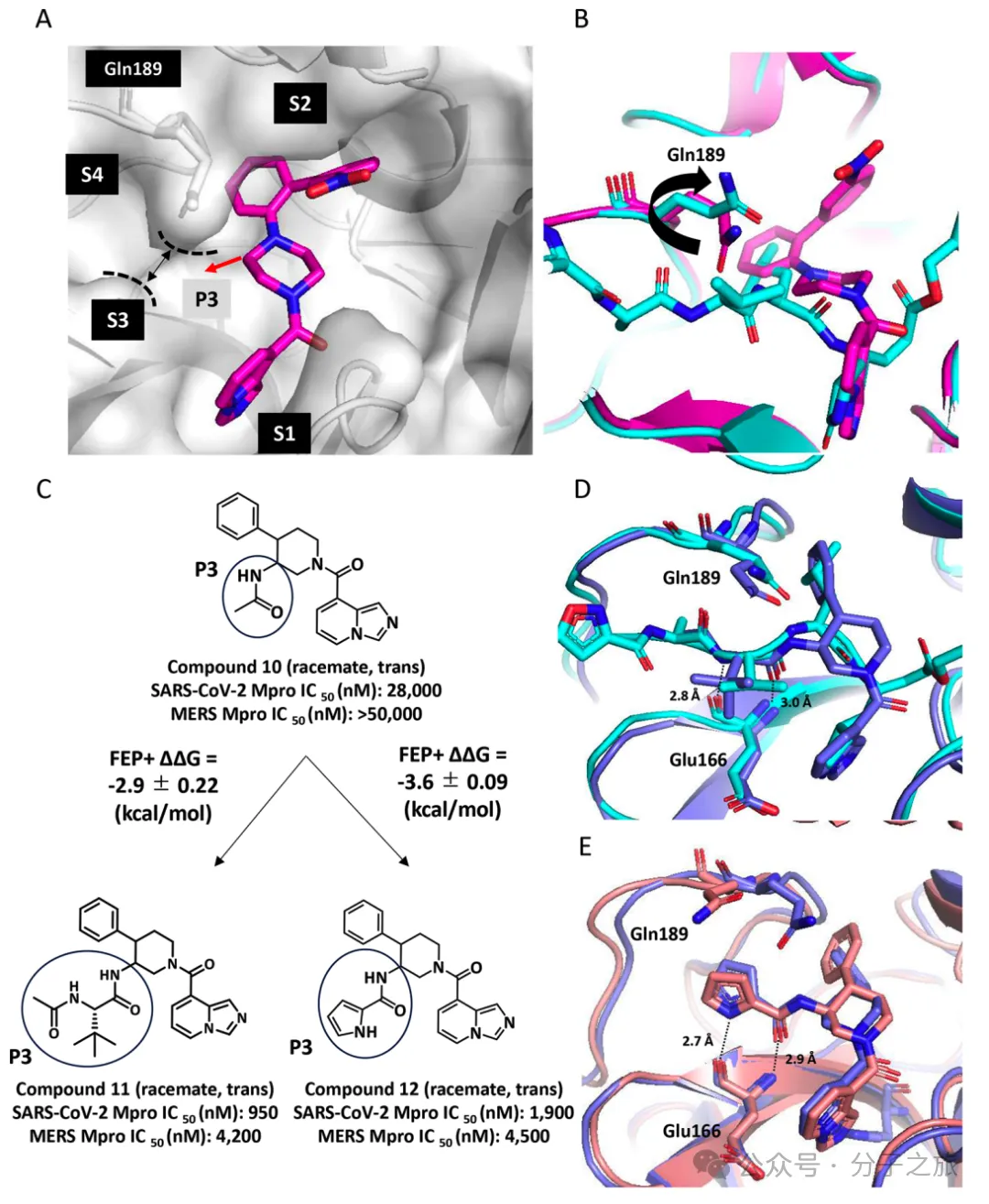

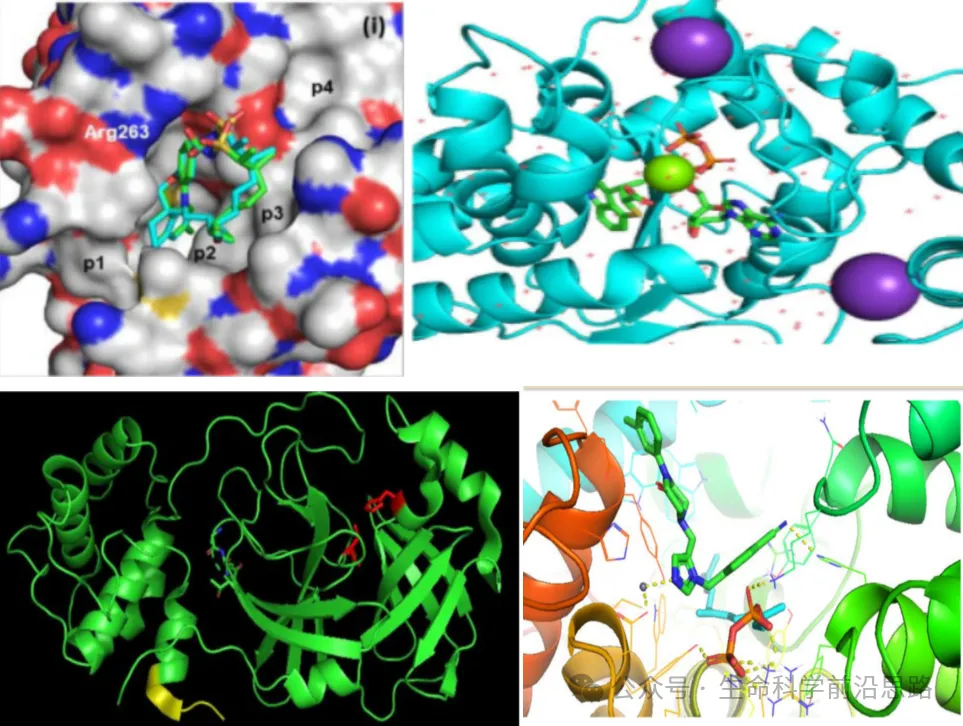

通过初步构效关系研究,团队获得了活性更高的化合物4(IC₅₀ = 840 nM)。X射线晶体结构分析显示,该化合物与SARS-CoV-2 Mpro的结合模式中,硝苯基团与Met49发生范德华相互作用,这解释了为何该化合物对MERS效果不佳——因为MERS中相应位置的氨基酸不同,产生了空间位阻。

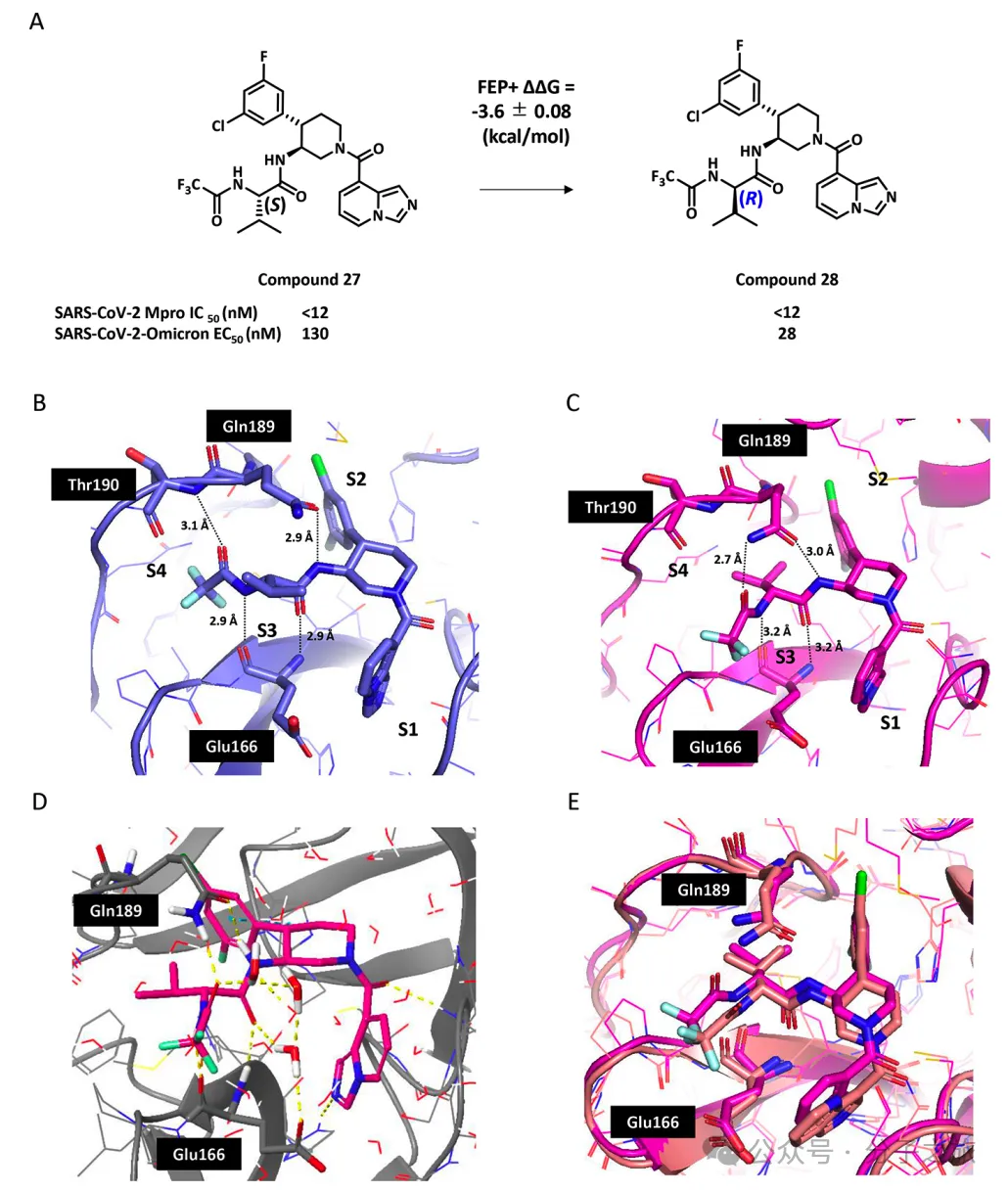

FEP计算指导的优化策略

团队采用自由能微扰(FEP)计算来预测结合亲和力,这种方法能够充分考虑蛋白质的构象动态变化和诱导拟合效应。通过FEP+计算,他们成功预测了在P2和P3位点引入特定取代基可显著提高效价,这一预测得到了实验验证。

优化后的先导化合物30

经过系列优化获得的化合物30表现出卓越的pan-CoV抑制活性,对SARS-CoV-2奥密克戎变体的细胞活性(EC₅₀ = 22 nM)比奈玛特韦强8倍,比恩司特韦强3倍以上。其出色的细胞抗病毒活性可能源于S2口袋的优化相互作用和P3-(R)-缬氨酸取代基在S3口袋的独特相互作用。

化合物30还表现出良好的ADME/Tox特性,包括低CYP抑制、低细胞毒性和低hERG抑制。虽然在小鼠中的口服生物利用度(F = 14%)仍需改进,但其整体特性表明它是一个有前景的先导化合物。

未来展望

这项研究展示了计算机辅助药物设计在加速药物发现中的强大能力,特别是FEP计算在预测蛋白质-配体结合亲和力方面的准确性。化合物30代表的非共价抑制剂系列与已上市药物结构迥异,具有更广谱的抗冠状病毒活性和更高的效力,为应对未来冠状病毒疫情提供了重要工具。

二、AI设计新药重大突破:88%化合物展现显著生物活性

(原创 翌然小白 分子之旅)

人工智能设计抗癌药物取得突破!

药物研发领域迎来重大进展!最近一项发表在bioRxiv上的研究显示,利用生成式人工智能设计的化合物中,高达88%显示出显著生物活性,这为AI驱动的药物发现提供了强有力的实验证据。

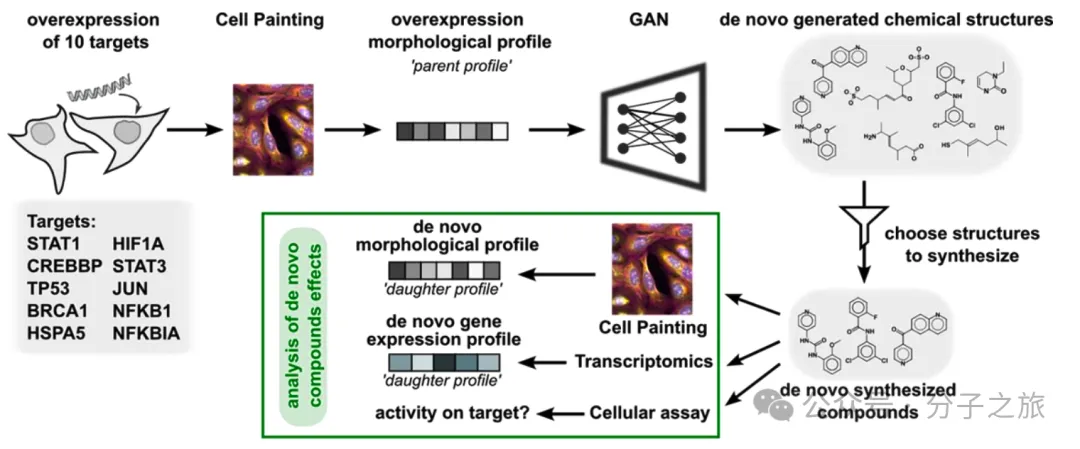

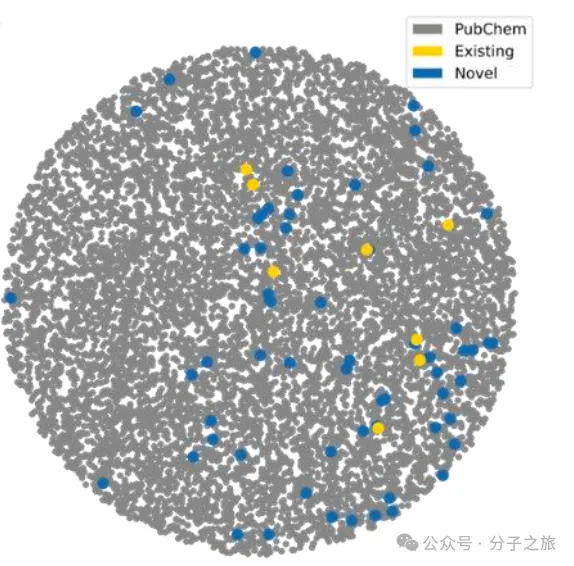

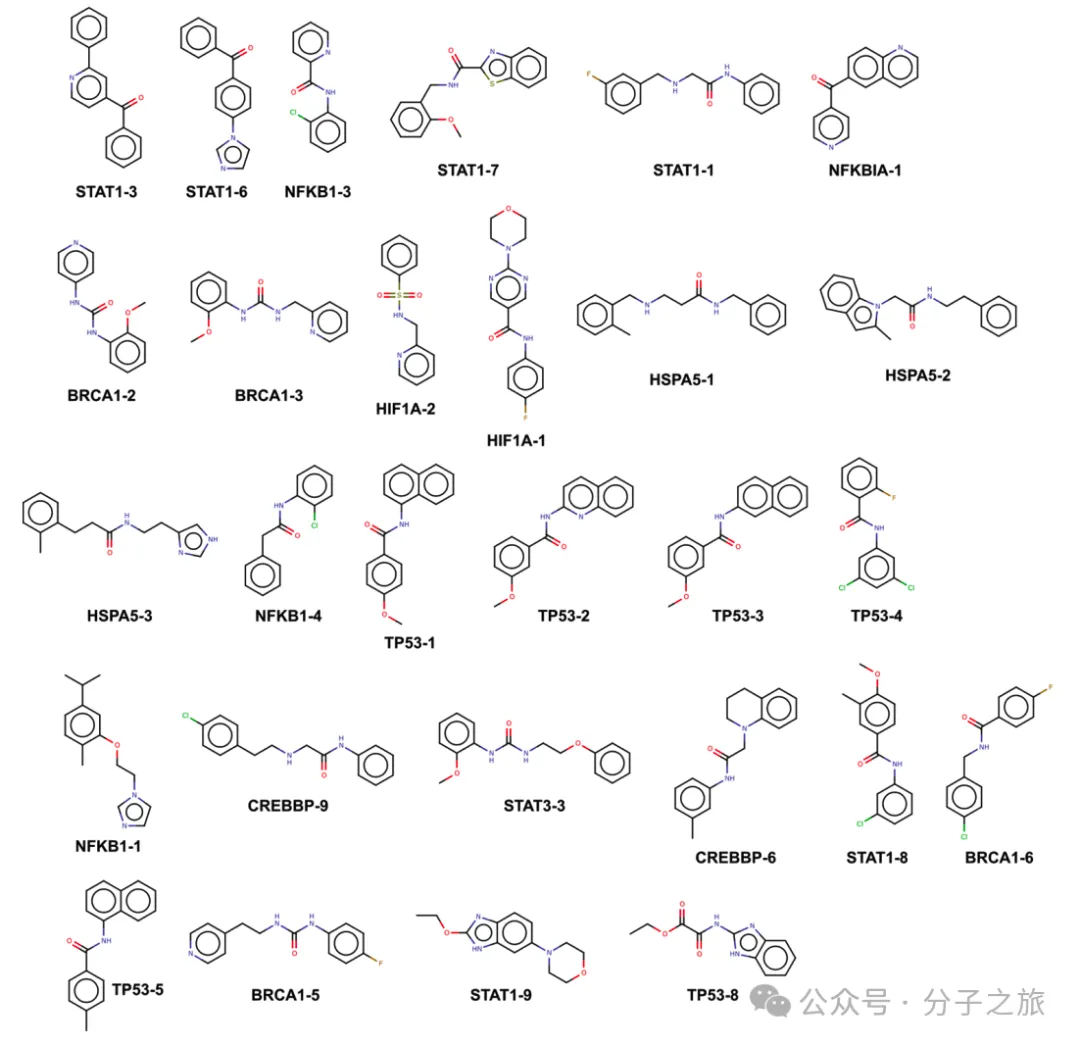

生成对抗网络(cGAN)在细胞形态数据指导下,成功设计了针对10个癌症靶点的新型化合物。研究人员从中选择76个最有可能的候选化合物进行合成与实验验证,这是迄今为止最大规模的AI生成化合物实验验证研究。

创新方法:从细胞形态到分子设计

传统药物发现通常依赖于高通量筛选大量化合物库,这个过程既昂贵又耗时。而这项研究采用了一种全新思路——使用细胞形态特征来指导AI生成化合物。

研究人员训练cGAN模型学习了30,000个小分子诱导的细胞形态变化,然后让模型根据特定基因过度表达引起的形态特征,生成可能重现这些特征的分子结构。这种方法不依赖于特定的分子靶点,而是关注整个细胞系统的响应。

令人振奋的实验结果

经过严格的合成和筛选,研究人员对这些AI生成的化合物进行了多维度评估:

特别令人印象深刻的是,所有针对TP53、STAT3和JUN靶点生成的化合物都表现出生物活性。

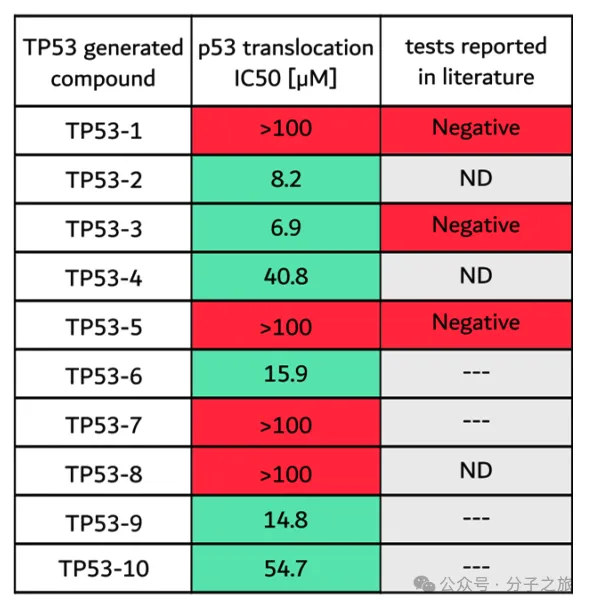

TP53案例的深入分析

研究人员对针对TP53肿瘤抑制基因的化合物进行了深入分析。TP53是癌症研究中最著名的靶点之一,但其调控网络极为复杂。

实验结果显示:

多数据模态的重要性

研究发现,使用多种数据模态进行评估至关重要。约13.7%的化合物仅影响细胞形态,而10.9%的化合物仅影响转录组表达。这表明单一检测方法可能会漏掉重要信息。

细胞和转录组学数据的联合分析显示,虽然针对同一靶点生成的化合物在形态和转录组水平上表现出一定相似性,但这种相似性并不完美,反映了生物系统的复杂性。

未来展望与应用前景

这项研究为表型指导的生成式AI在药物发现中的应用提供了坚实证据。通过使用高维生物数据条件化生成模型,研究人员能够设计出具有高度生物活性的新型化合物。

未来,这种方法可以与药代动力学和安全性预测相结合,进一步优化候选化合物的选择。同时,建立标准的生成基准测试任务将有助于比较不同模型的性能。

人工智能正在彻底改变药物研发的游戏规则。这项研究不仅证明了AI生成化合物的生物活性,还为整个行业提供了可扩展、高效率的新药发现框架。随着技术的不断进步,我们有理由相信,AI将在未来为更多难治性疾病带来创新疗法。

原文:doi.org/10.1101/2025.09.13.676062

三、IF=79!AI药物设计新突破-多目标分子设计的新策略提高预测可靠性

(卓昂科研咨询 榴莲忘返 AIDD)

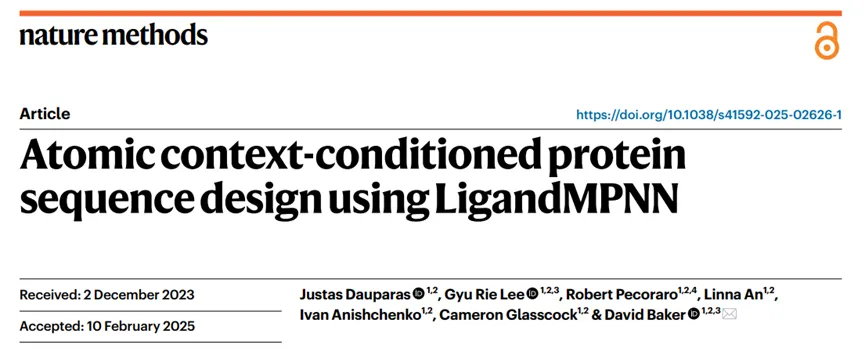

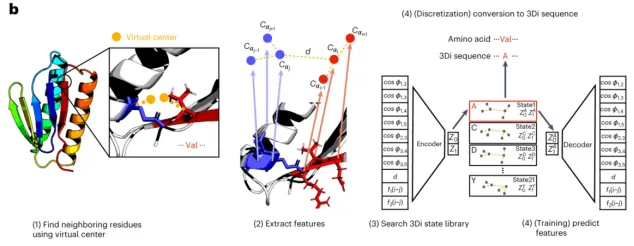

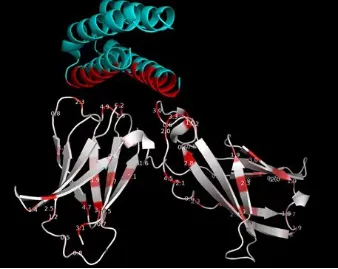

2025年,美国华盛顿大学生物化学系David Baker团队在《Nature Methods》(IF=36.1)上发表题为“Atomic context-conditioned protein sequence design using LigandMPNN”的研究论文,提出一种基于深度学习的能够显式模拟非蛋白质组分的蛋白质序列设计方法—LigandMPNN。该方法在恢复与小分子、核苷酸和金属相互作用的天然氨基酸序列方面显著优于现有的Rosetta和ProteinMPNN方法。该方法提高蛋白质与非蛋白质分子相互作用的设计能力,从而为酶、传感器和结合蛋白的设计提供更高效、更准确的工具。

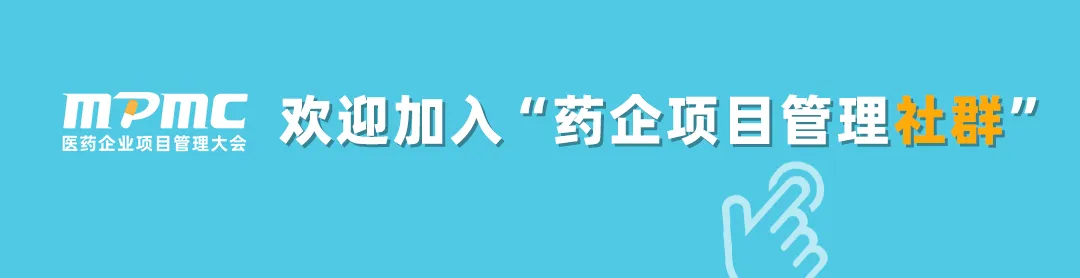

AI赋能酶设计新突破:深度学习精准构建丝氨酸水解酶,催化效率提升10万倍

酶是自然界中最强大的催化剂,它们能在温和的水溶液条件下显著加速化学反应。从工业化学品合成到塑料回收,从医药研发到环境修复,如果能够设计出催化任意化学反应的新型酶,将为众多领域带来革命性变革。然而,从零开始设计多步反应机制的复杂酶一直是计算蛋白质设计领域的重大挑战。

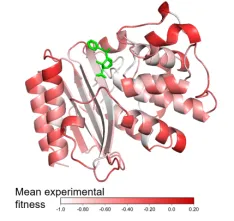

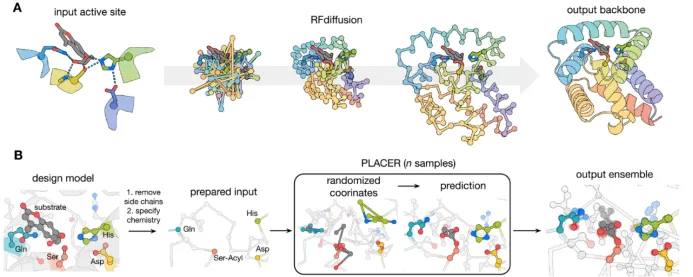

近日,华盛顿大学蛋白质设计研究所David Baker团队发表于《Science》的研究论文"Computational design of serine hydrolases"展示了酶设计领域的重大突破。研究团队结合RFdiffusion的生成能力和PLACER的预组织评估方法,从最小活性位点描述出发,设计出了具有催化效率高的丝氨酸水解酶,实现了与天然酶相媲美的催化能力。更令人惊叹的是,这些设计的酶在折叠结构上与天然丝氨酸水解酶完全不同,开创了这一古老酶家族的全新结构空间。

作为2025年最值得期待的技术!AI蛋白质设计资料与学习途径少之又少,特培训学习迫在眉睫!联合清华大学、北京大学、西湖大学、浙江大学、中国科技技术大学、天津大学、协和药物研究所、上海药物研究所已经举办培训六十七期,参会学员达7000余人!学员好评极高!其中不乏有发表Nature、Cell、Science等国际顶刊!

六大顶尖课程

01 AI蛋白质设计线上直播课

02 AIDD人工智能药物发现与设计线上直播课

03 CADD计算机辅助药物设计精品录播课

04 深度学习基因组学线上直播课

05 机器学习代谢组学线上直播课

06 机器学习微生物多组学联合分析线上直播课

01

AI蛋白质设计线上直播课

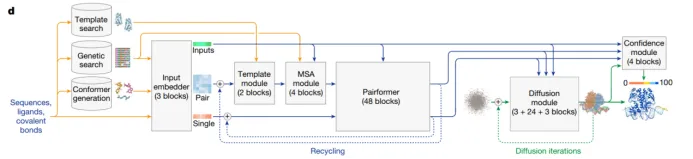

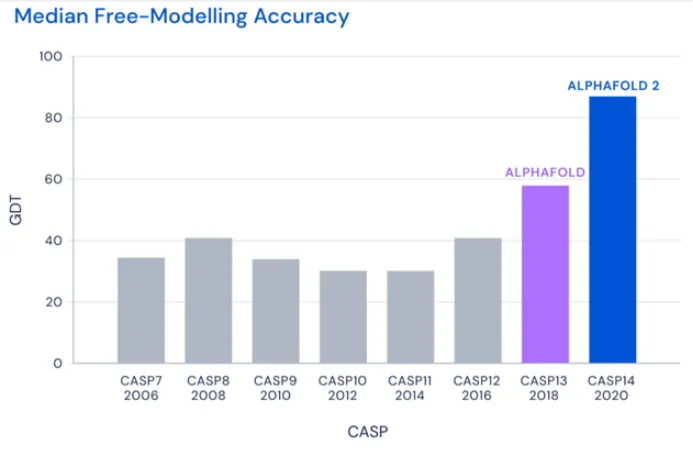

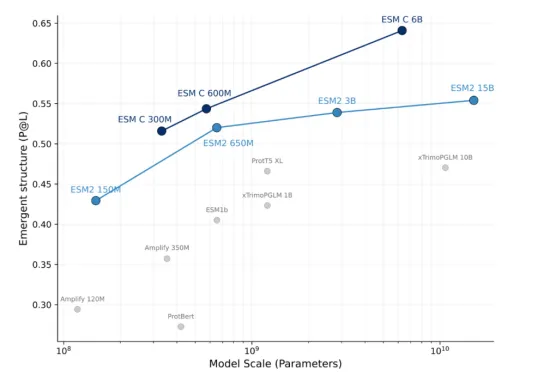

多种蛋白质设计方法、深度学习酶设计、深度学习抗体设计等流程!让学员快速学会David baker核心方法!培训理论结合实操!提供服务器使用!通过详细讲解实操AlphaFold2、AlphaFold3以及pymol和Foldseek等软件让学员学会蛋白质结构预测!通过详细讲解实操ESM系列(ESM-1b、ESM-1v、ESM2、ESMC、ESM3)、GPT的生成模型ProGen让学员学会蛋白质大语言模型!通过详细讲解实操ProteinMPNN、LigandMPNN、ThermoMPNN、Rfdiffusion等软件让学员学会多种蛋白质设计方法!最后通过深度学习酶设计与深度学习抗体设计让学员通过不同方向不同方法更全面的了解蛋白质设计当下的全面性!六天培训流程循序渐进!知识点全覆盖!更是讲解十篇顶刊文献,让学员更好的知道当下蛋白质设计的核心热点以及优势!

1.环境搭建:Linux,VS code,Jupyter notebook 2)超算的登录 3)Linux系统的常用shell命令:vim, ls, cd, less, rm等 4)一些package安装的常用命令:pip, conda, source等 5)Jupyter notebook的安装和使用 6)VS code的基本配置:连接服务器;选择不同python版本的Interpreter;debug模式的使用等 2.获得同源序列 1)了解不同蛋白质序列库,如UniRef90,UniClust30,Pfam等 2)了解不同工具原理并使用:NCBI BLAST,Jackhmmer,HHblits 3)给定一条蛋白质序列,比对序列库,生成多序列比对(MSA) 从AlphaFold2的经典代码仓库中找到它的生成MSA的代码并学习(alphafold/alphafold/data/tools/jackhmmer.py) 3.对MSA进行频率分析 1)使用python的文本文件操作实现 2)使用python中biopython包实现 3)绘制序列Logo,可视化的展示每个位点的氨基酸频率和保守性 4.序列的同源性计算和进化树的绘制 1)不同同源性的计算方法及应用情景,氨基酸序列的identity和Similarity,BLOSUM62的介绍 2)进化树的绘制 5.基于序列相似性阈值划分训练集和测试集 1)为什么要做?避免数据泄露 2)选择相似性度量方法 3)相似性矩阵的计算 4)划分数据集 6.大规模蛋白质序列的聚类分析和去冗余* 1)为什么要做?防止过度学习某一类序列特征,消除序列偏差;也能防止训练过程中数据泄露 2)聚类方法的选择,CD-HIT、MMseq2和Linclust 3)选择代表序列,去冗余 4)实际复现S2ALM这一模型文章中的聚类方法 | |

第二天:蛋白质设计结构分析 |     |

1)介绍蛋白质的语言模型(26字母语言模型->20氨基酸字母表,上下文依赖->氨基酸的共进化) 2)为什么要开发蛋白质大语言模型?1. 相比于结构或功能信息,序列信息更加海量;2. 蛋白质序列通过进化而来,可以学习蛋白质基本规律,折叠,共进化等 3)模型架构和基础理论:transformer,多头注意力机制,Bert,GPT,T5等 2.基于Bert架构的蛋白质语言模型 1) ESM系列(ESM-1b、ESM-1v、ESM2、ESMC)  2)ESMFold:无需MSA信息的结构预测 3)使用抗体序列库训练的语言模型:Ablang,AntiBERTy 3.类似GPT的生成模型ProGen 1)36层Transformer解码器架构,包含12亿参数 2)引入“控制标签”(如蛋白质家族ID、功能属性)作为输入,生成蛋白质序列空间以外的新的蛋白质序列 3)成功生成新的溶菌酶 4.多模态的蛋白质语言模型ESM3 1)模型架构融合序列,结构和功能信息 2)相比于ESMFold,单体结构预测精度更好 3)基于多模态提示(序列、结构、功能关键词)设计新的蛋白质序列 4)ESM3的安装,生成序列,快速结构预测。 5.蛋白质语言模型的应用和实战演练 1)获得序列embedding以构建下游模型(Cell systmes文章举例) 2)使用不同的蛋白质语言模型,零样本的预测蛋白质突变效应 3)给定少量的突变效应数据作为训练数据,训练模型,预测新的突变效应值 | |

第四天:蛋白质设计实战应用 |    |

第五天:深度学习酶设计实战应用 | 1.基础知识讲解 酶的过渡态理论,theozyme,fitness landscape,epistasis 2.从Frances H. Arnold(2018年因在酶的定向进化领域的贡献获得诺贝尔化学奖)的工作看酶的定向进化方法的发展 1.传统定向进化实验流程 2.MLDE(Mechine Learning Directed Evolution), 学习序列与酶性能之间的映射关系,推荐新的突变组合(PNAS文章) 3.ftMLDE(focused training MLDE),主动学习流程,构建informative的训练数据(Cell Systems文章)  3.酶的从头设计 1.从头设计Diels-Alder催化酶 a)基于Rosetta的Inside-out策略(Science文章) b)通过Foldit蛋白质折叠游戏改善结构问题(Nat. Biotechnol.文章); c)Foldit蛋白质折叠游戏的实践* 2.从头设计荧光素酶,Family-wide hallucination,基于该酶家族的结构幻化出新的结构(Nature文章) 3.RFdiffusion+PLACER从头设计丝氨酸水解酶(Science文章) 4.利用预测结构的相似性,挖掘序列的新酶功能(cell文章) 1.InterPro数据库中下载数据 2.TM-score计算结构距离 3.UPGMA结构聚类,画出进化树 4.挑选序列  |

第六天:深度学习抗体设计实战 | 1.抗体基础知识讲解: 1)VDJ重排,germline,CDR区域,表位(epitope/paratope),抗体亲和力成熟,抗体的可开发性等概念介绍 2)不同抗体编号方案(Kabat,Chothia,IMGT)讲解,使用python自动化对抗体序列编号,并识别CDR区域 3)抗体药物开发的基本流程 2.抗体亲和力成熟 1)Efficient evolution,基于序列的语言模型推荐突变点(Nat. Biotechnol.文章) 2)了解语言模型推荐突变点的原理 3)安装package和模型参数 4)运行以推荐突变点 5)Structure evolution,基于结构的语言模型推荐突变点(Science文章) 6)了解inverse folding推荐突变点原理 7)安装package和模型参数 8)DiffAb,扩散模型同时生成CDR区的序列和结构  9)GSK、阿斯利康、诺和诺德等在抗体亲和力成熟上的工作 10)Chai2从头生成抗体 3.Adaptyv EGFR Binder比赛——设计EGFR的更高亲和力binder 1)比赛排名靠前的抗体/蛋白是如何设计的 a)第一轮比赛,排名第一的方法:BindCraft b)第二轮比赛,排名第一的方法:Cradle,在Cetuximab的基础上,用的LLM,突变了10个FR的氨基酸 c)第二轮比赛,排名第二的方法:对一个纳米抗体进行人源化改造 d)第二轮比赛,排名第三的方法:保留与结合重要的氨基酸,生成其它氨基酸RFdiffusion+inverse folding 2)不同的筛选指标能否正确区分出可表达蛋白和不可表达蛋白、可结合蛋白和不可结合蛋白  3)抗体可开发性优化 4)抗体可开发性优化在药物开发过程中的意义, 5)衡量抗体可开发性要考虑的因素,如免疫原性、自聚集性、结合特异性、稳定性等等 6)抗体性质预测的模型实践,展示在小样本的情景下训练机器学习/深度学习模型* 7)数据处理,划分数据集 8)模型构建,将构建两类模型 9)基于特征工程的机器学习模型(随机森林,XGboost,ElasticNet等);学习根据蛋白质序列和结构信息构建常见特征 10)使用语言模型获得序列embedding的深度学习模型 11)模型训练和评价:绘制训练曲线,训练集和测试集的评价指标随epoch的变化,GridSearchCV交叉验证调参等 12)模型的可解释性,特征重要性分析  |

02

AIDD人工智能药物发现与设计线上直播课

本次培训主要掌握深度学习在化学反应预测中的应用,应用于真实药物研发场景的思维框架建立从蛋白质建模到下游任务(如药物筛选、作用机制分析)的系统性理解,增强将AI方法应用于实际生物医药问题的能力,自然语言处理(NLP)在分子生成中的应用 ,扩散模型在分子生成中的应用,通过案例分析(如Interformer筛选出高亲和力小分子),学习如何将这些预测技术应用于酶工程和药物发现,加速候选分子的筛选和优化

02

AIDD人工智能药物发现与设计线上直播课

本次培训主要掌握深度学习在化学反应预测中的应用,应用于真实药物研发场景的思维框架建立从蛋白质建模到下游任务(如药物筛选、作用机制分析)的系统性理解,增强将AI方法应用于实际生物医药问题的能力,自然语言处理(NLP)在分子生成中的应用 ,扩散模型在分子生成中的应用,通过案例分析(如Interformer筛选出高亲和力小分子),学习如何将这些预测技术应用于酶工程和药物发现,加速候选分子的筛选和优化

本次培训主要掌握深度学习在化学反应预测中的应用,应用于真实药物研发场景的思维框架建立从蛋白质建模到下游任务(如药物筛选、作用机制分析)的系统性理解,增强将AI方法应用于实际生物医药问题的能力,自然语言处理(NLP)在分子生成中的应用 ,扩散模型在分子生成中的应用,通过案例分析(如Interformer筛选出高亲和力小分子),学习如何将这些预测技术应用于酶工程和药物发现,加速候选分子的筛选和优化

一、环境搭建与深度学习基本知识讲解

1.AIDD概述:从CADD到AIDD

2.软件安装与环境搭建

(1)anaconda

(2)vscode

(3)环境变量的配置

(4)切换pip和conda镜像源

(5)虚拟环境的创建

3.RDKIT工具包的使用

(1)基于RDKit的分子读写

(2)基于RDKit的分子绘制

(3)基于RDKit的分子指纹与分子描述符

(4)基于RDKit的化合物相似性与子结构

4.药物综合数据库的获取方法

(1)基于requests的基本爬虫操作

(2)小分子数据库PubChem数据获取(pubchempy / requests)

(3)蛋白质数据库PDB、UniProt数据获取

5.深度学习辅助药物设计

(1)神经网络基本概念与sklearn工具包介绍

(2)图神经网络与消息传递机制基本知识

(3)Transformer模型基本知识:分词、位置编码、注意力机制、编码器、解码器、预训练-微调框架、huggingface 生态介绍

(4)模型的评估与验证:准确率、精确率、召回率、F1分数、ROC曲线、AUC计算,平均绝对误差、均方差、R2分数、可释方差分数,交叉验证等

二、分子与生化反应的表示学习与性质预测助力药物发现

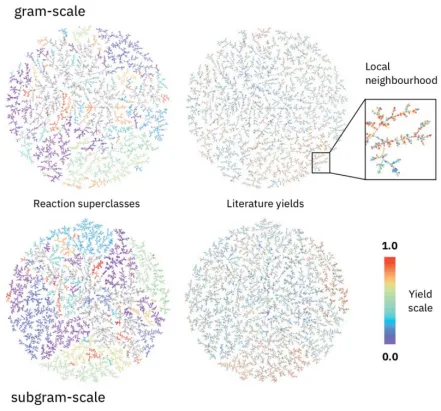

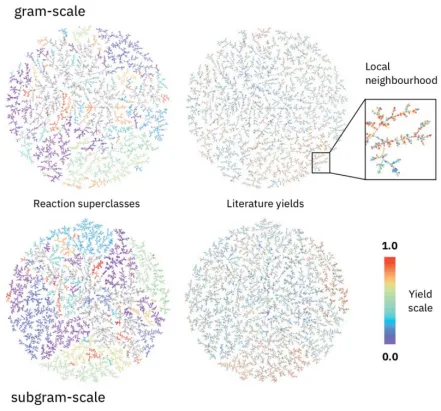

培训内容1:Nature Machine Intelligence|基于注意力的神经网络在化学反应空间映射中的应用《Mapping the space of chemical reactions using attention-based neural networks》 1.数据集

1.1.Pistachio数据集:包含260万化学反应,来自专利数据,涵盖792个反应类别。数据经过去重和有效性过滤(使用RDKit)。

1.2.USPTO 1k TPL数据集:基于USPTO专利数据,包含44.5万反应,通过原子映射和模板提取生成1,000个反应模板类别。

1.3.Schneider 50k数据集:公开数据集,包含5万反应,50个类别,用于与传统指纹方法对比。

2.模型。研究对比了两种Transformer架构:

2.1.BERT分类器:基于编码器的模型,通过掩码语言建模预训练后,在分类任务上微调,使用[CLS]标记的嵌入作为反应指纹(rxnfp)。

2.2.Seq2Seq模型:编码器-解码器结构,将分类任务分解为超类、类别和具体反应的层级预测。两者均采用简化版BERT(隐藏层256维),输入为未标注的SMILES序列,无需反应物-试剂区分或原子映射。

3.训练。模型训练分为两步:

3.1.预训练:BERT通过掩码SMILES令牌预测任务进行自监督学习,学习反应通用表示。

3.2.微调:在分类任务上优化模型,使用交叉熵损失,学习率2×10⁻⁵,序列长度512。评估采用混淆熵(CEN)和马修斯相关系数(MCC)以处理数据不平衡。

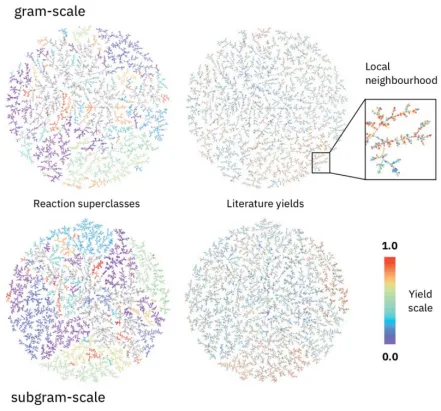

培训内容2:TOP期刊|基于深度学习的生化反应产量预测《Prediction of chemical reaction yields using deep learning》

1.数据。研究使用了三类数据:

1.1.Buchwald-Hartwig HTE数据集:包含3955个Pd催化C-N偶联反应,涵盖15种卤化物、4种配体、3种碱和23种添加剂组合,产率通过统一实验测量,数据质量高。

1.2.Suzuki-Miyaura HTE数据集:包含5760个反应,涉及15对亲电/亲核试剂、12种配体、8种碱和4种溶剂的组合,产率分布均匀。

1.3.USPTO专利数据集:从公开专利中提取,包含不同规模(克级与亚克级)的反应产率,数据噪声大且分布不一致,需通过邻近反应产率平滑处理以提升模型表现。

2.模型。核心模型基于预训练的rxnfp(反应指纹)BERT架构,新增回归层构成Yield-BERT。输入为标准化反应SMILES,通过自注意力机制捕捉反应中心及关键试剂的上下文信息。模型无需手工特征(如DFT计算描述符),直接端到端预测产率。实验表明,其性能优于传统方法(如随机森林和分子指纹拼接),尤其在HTE数据上接近化学描述符的预测水平,且参数鲁棒性高(超参数调整影响小)。

3.训练。训练分为两步:

3.1.预训练:BERT通过掩码语言任务学习SMILES的通用表示。

3.2.微调:采用简单Transformers库和PyTorch框架,以MSE损失优化回归层,学习率(2×10⁻⁵)和dropout率(0.1–0.8)为主要调参对象。HTE数据采用随机/时间划分验证,USPTO数据通过邻近反应产率平滑缓解噪声影响。小样本实验(5%训练数据)显示模型能快速筛选高产反应,指导合成优化。

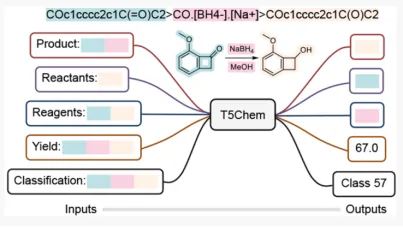

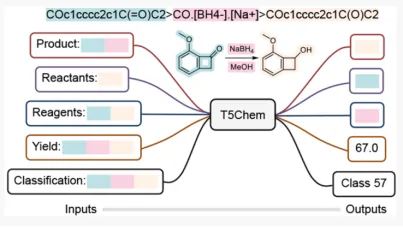

培训内容3:

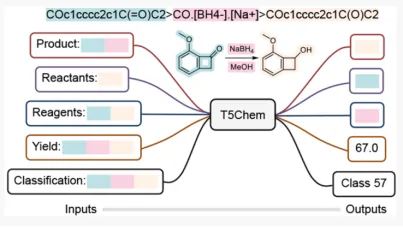

TOP期刊|基于T5Chem模型的生化反应表示学习与性质预测: 《Unified Deep Learning Model for Multitask Reaction Predictions with Explanation》

1.数据来源和处理。通过自监督预训练与PubChem分子数据集进行训练,以实现对四种不同类型的化学反应预测任务的优异性能。模型处理包括反应类型分类、正向反应预测、单步逆合成和反应产率预测。

2.模型架构和原理。T5Chem模型是基于自然语言处理中的“Text-to-Text Transfer Transformer”(T5)框架开发的统一深度学习模型,该模型通过适应T5框架来处理多种化学反应预测任务。T5Chem模型包含编码器-解码器结构,并根据任务类型引入了任务特定的提示和不同的输出层,如分子生成头、分类头和回归头,以处理序列到序列的任务、反应类型分类和产品产率预测。

3.训练过程和细节。

3.1.T5Chem模型首先在PubChem的97 million分子上进行自监督预训练,使用BERT类似的“masked language modeling”目标。

3.2.在预训练阶段,源序列中的tokens被随机掩蔽,模型的目标是预测被掩蔽的正确的tokens。

3.3.预训练完成后,模型在下游的监督任务中进行微调,使用不同的任务特定提示和输出层。

3.4.模型在测试阶段通过生成分子token by token的方式进行预测,直到生成“句子结束标记”或达到最大预测长度。

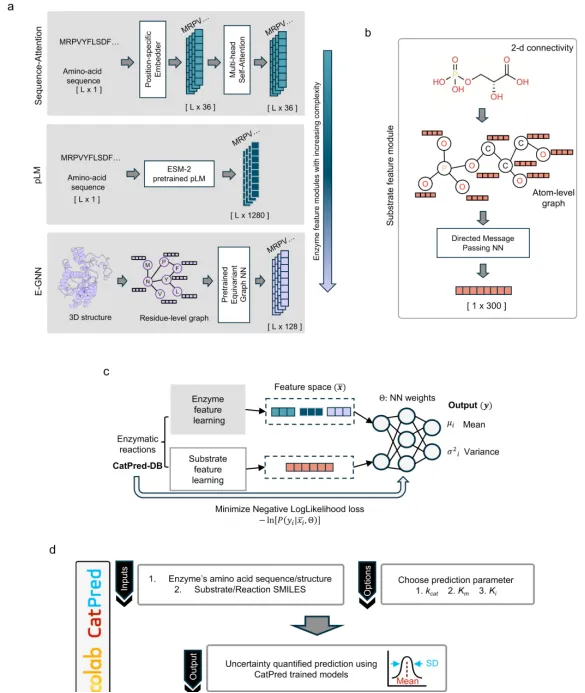

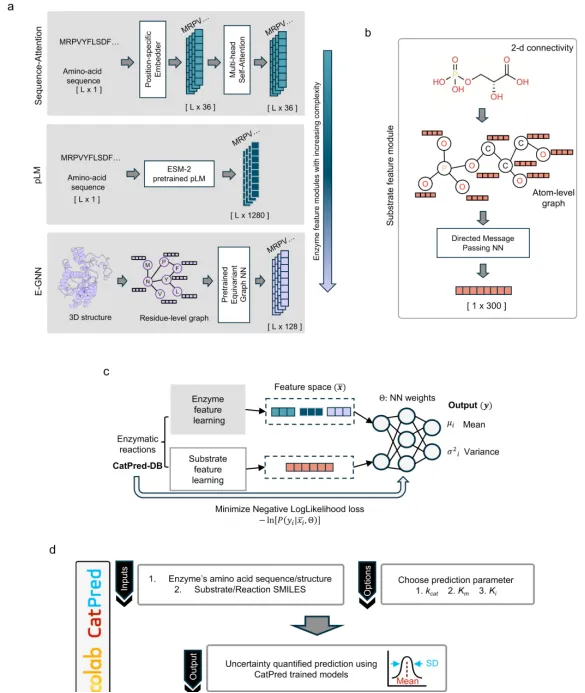

三、蛋白质的表示学习与性质预测助力药物发现 培训内容1:

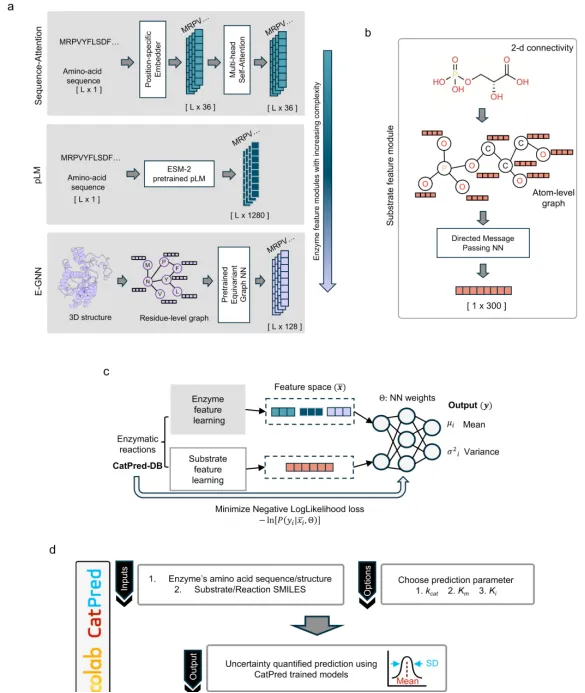

Nature Communication|体外酶动力学参数深度学习的综合框架《CatPred: a comprehensive framework for deep learning in vitro enzyme kinetic parameters》

CatPred 提出了一种全面的深度学习框架,用于预测体外酶动力学参数(kcat、Km、Ki),以解决实验测定成本高、数据稀疏和泛化能力差的问题。该方法不仅提供了准确的预测,还引入了对预测不确定性的量化,支持对训练集外(out-of-distribution)酶序列的稳健预测。此外,作者还构建了新的标准化数据集(CatPred-DB),并对多种酶表示方法进行了系统比较。

1.数据:CatPred 使用的数据集来自 BRENDA 和 SABIO-RK 数据库,作者构建了 CatPred-DB,包括:23197 条 kcat,41174 条 Km和11929 条 Ki 数据,每条记录都包含酶的氨基酸序列、AlphaFold 或 ESMFold 预测的结构、底物的 SMILES 表达式。数据经过清洗和标准化处理,去除缺失值和重复值,并对参数取对数转换以符合正态分布。

2.模型:CatPred 采用模块化设计,酶和底物分别通过不同的神经网络模块进行表征学习,并采用 概率回归 输出(高斯分布形式的均值和方差),允许进行 不确定性估计(aleatoric + epistemic)。

3.训练

3.1.所有模型采用负对数似然损失函数(NLL)训练,以同时预测参数均值和不确定性。

3.2.使用训练-验证-测试三分法(80%-10%-10%),并设立“训练集外”的测试子集用于泛化能力评估。

3.3.为了评估不确定性,CatPred 使用 10个模型的集成,通过不同初始参数训练,以此量化 epistemic uncertainty。

3.4.模型训练时考虑了不同相似性(序列identity<99%、80%、60%、40%)的测试集,体现其鲁棒性。

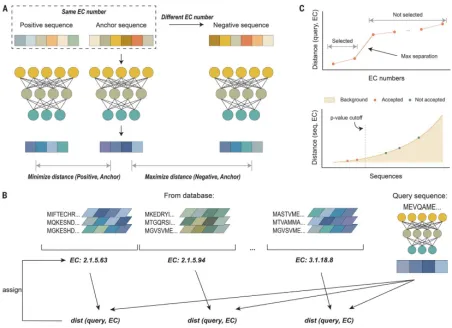

培训内容2:

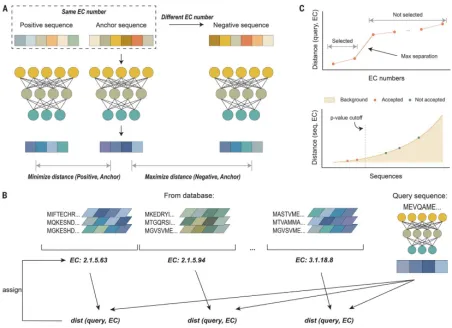

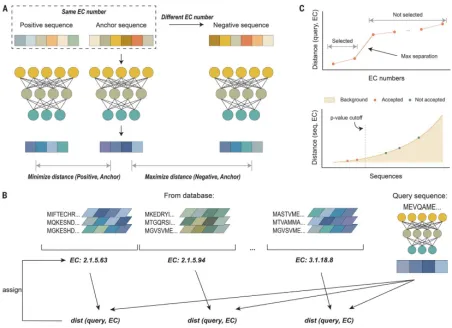

Science|基于对比学习的蛋白质分类属性预测《Enzyme function prediction using contrastive learning》

1.数据来源和处理: CLEAN模型的训练基于UniProt数据库中的高质量数据,该数据库收录了约1.9亿个蛋白质序列。CLEAN模型以氨基酸序列作为输入,输出按可能性排序的酶功能列表(以EC编号为例)。为了验证CLEAN的准确性和鲁棒性,作者进行了广泛的in silico实验,并将CLEAN应用于内部收集的未表征的卤酶数据库(共36个)进行EC编号注释,随后通过案例研究进行体外实验验证。

2.模型架构和原理: CLEAN模型采用了对比学习框架,目标是学习一个酶的嵌入空间,其中欧几里得距离反映了功能相似性。嵌入是指蛋白质序列的数值表示,它由机器可读,同时保留了酶携带的重要特征和信息。在CLEAN的任务中,具有相同EC编号的氨基酸序列具有较小的欧几里得距离,而具有不同EC编号的序列则具有较大的距离。

3.训练过程和细节:

3.1.在训练过程中,CLEAN模型使用对比损失函数进行监督训练,通过优先选择与锚点(anchor)嵌入具有小欧几里得距离的负序列,以提高训练效率。

3.2.模型使用语言模型ESM1b获得的蛋白质表示作为前馈神经网络的输入,输出层产生细化的、功能感知的输入蛋白质嵌入。

3.3.预测时,通过计算查询序列与所有EC编号聚类中心之间的成对距离来预测输入蛋白质的EC编号。

3.4.CLEAN还开发了两种方法来从输出排名中预测自信的EC编号:一种是贪婪方法,另一种是基于P值的方法。

四、基于深度学习的分子生成助力药物发现

培训内容1:

Nature Communication|基于端到端的图生成框架的分子生成:《Retrosynthesis prediction using an end-to-end graph generative architecture for molecular graph editing》

1.数据来源和处理:Graph2Edits模型使用了公开可用的基准数据集USPTO-50k,包含50016个反应,这些反应被正确地原子映射并分类为10种不同的反应类型。数据集被分为40k、5k、5k的反应用于训练、验证和测试集。

2.模型架构和原理:Graph2Edits模型是一个端到端的图生成架构,基于图神经网络(GNN)预测产品图的编辑序列,并根据预测的编辑序列顺序生成中间体和最终反应物。该模型将半模板方法的两阶段过程(识别反应中心和完成合成子)合并为一锅学习,提高了在复杂反应中的适用性,并使预测结果更易于解释。模型的核心是图编码器和自回归模型,用于生成编辑序列,并应用这些编辑来推断中间体和反应物。

3.训练过程和细节:

3.1.Graph2Edits模型使用有向消息传递神经网络(D-MPNN)作为图编码器,以获取原子表示和全局图特征,并预测原子/键编辑和终止符号。

3.2.模型训练使用教师强制策略,即使用真实的编辑序列作为模型输入。在每个编辑步骤中,模型会计算所有可能的编辑的概率,并选择最高分的k个编辑,将这些编辑应用于输入图以获得k个中间体。

3.3.在生成过程中,如果达到最大步骤数或图表示指示终止,则生成分支将停止。

3.4.最终,根据可能性对前k个编辑序列和图进行排名,收集为最终预测结果。

培训内容2

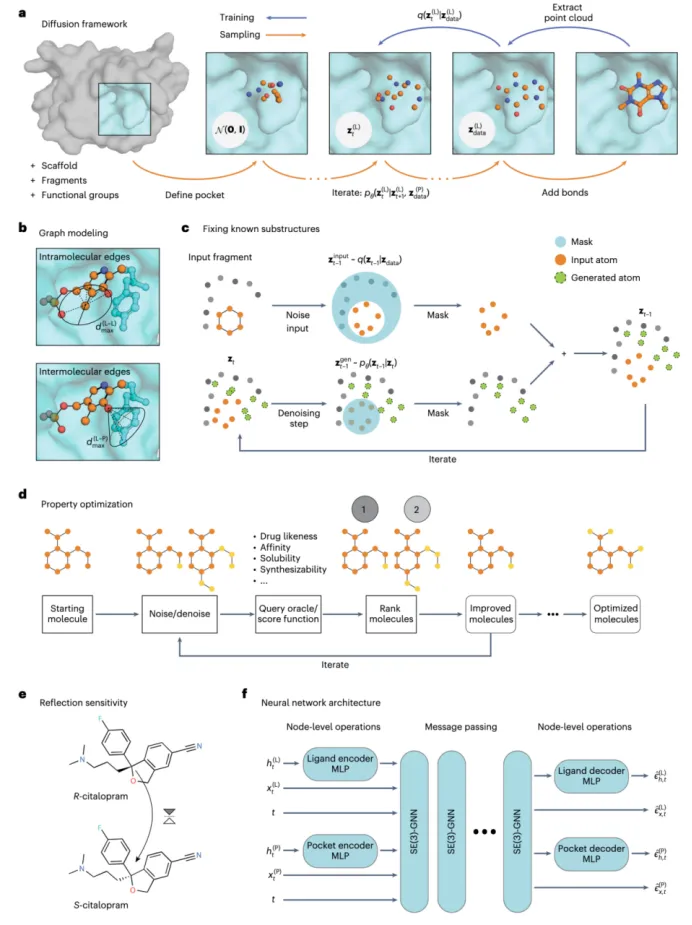

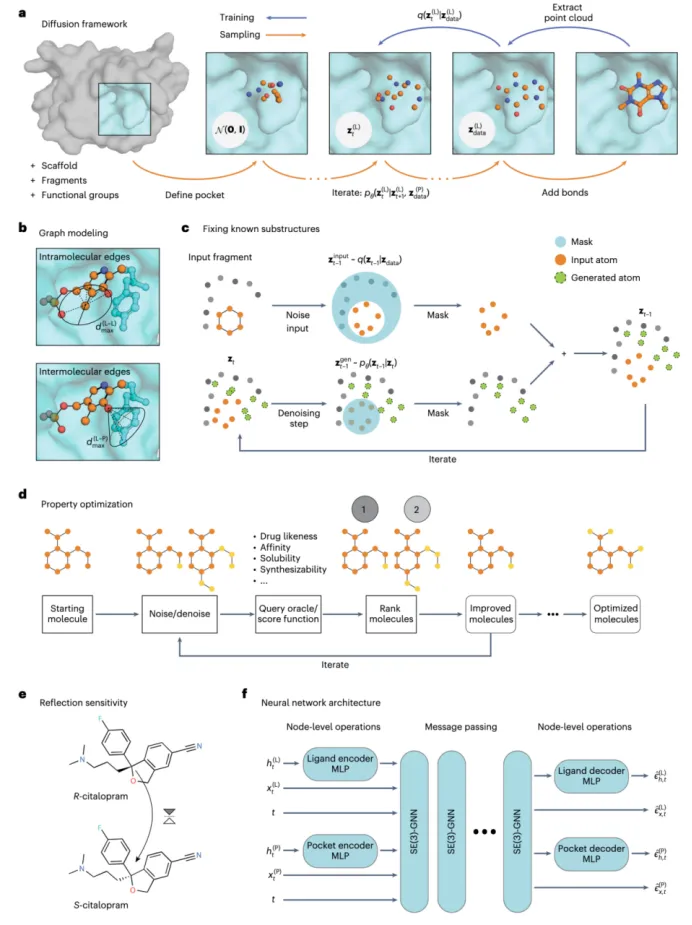

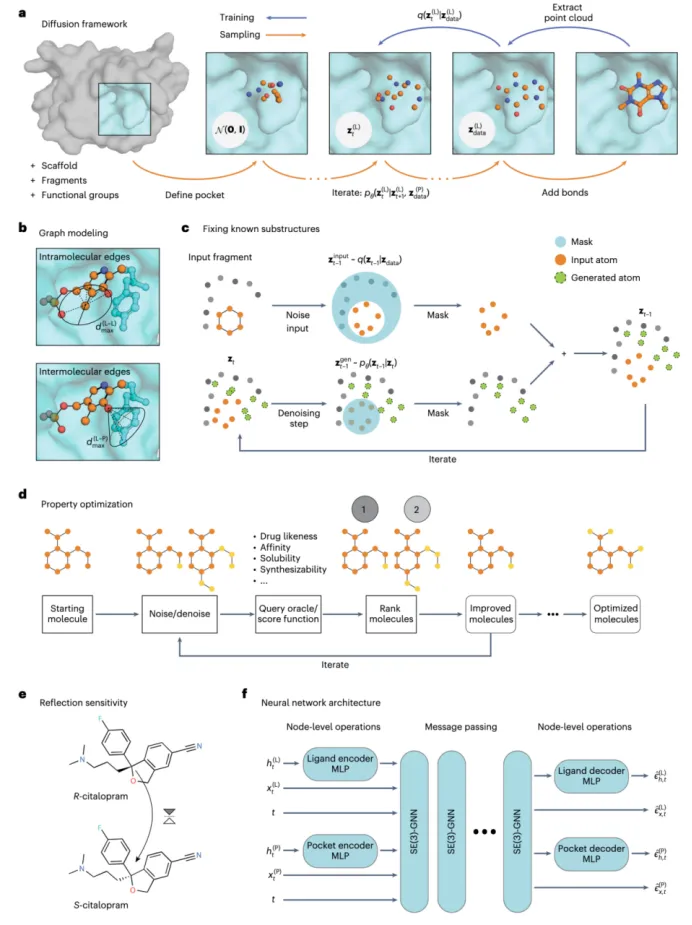

Nature Computational Science|基于等变扩散模型的分子生成网络《Structure-based drug design with equivariant diffusion models》

1.简单介绍。这篇文献提出了一种基于结构的药物设计方法(SBDD),利用SE(3)-等变扩散模型(DiffSBDD)生成与蛋白质结合口条件匹配的新颖小分子配体。该方法通过将SBDD问题建模为三维条件生成任务,能够一次性生成所有原子位置,克服了传统自回归方法因顺序生成而丢失全局上下文的局限性。DiffSBDD不仅支持从头分子设计,还能通过属性优化、负向设计和分子局部修饰(inpainting)等多种任务灵活应用。

2.数据总结。该研究使用了CrossDocked和Binding MOAD两个数据集进行训练和评估。

2.1.CrossDocked数据集包含40,344个训练蛋白-配体对和130个测试对,验证集规模为246个,确保不同集合中的蛋白质来自不同的酶分类主类以避免过拟合。

2.2.Binding MOAD数据集经过筛选后用于测试,分析限于所有方法均能生成样本的78个CrossDocked和119个Binding MOAD目标。此外,数据集处理涉及移除损坏条目,并通过Zenodo公开提供处理后的数据和采样分子,确保研究可重复性。

3.模型总结。DiffSBDD是一个SE(3)-等变扩散模型,以蛋白质结合口为条件生成三维分子结构,采用3D图表示(原子坐标和类型),避免了传统方法中从密度图回推分子结构的复杂后处理。模型设计尊重三维空间的旋转和平

五、结合分子动力学的蛋白质配体复合物相互作用动态预测

培训内容1:

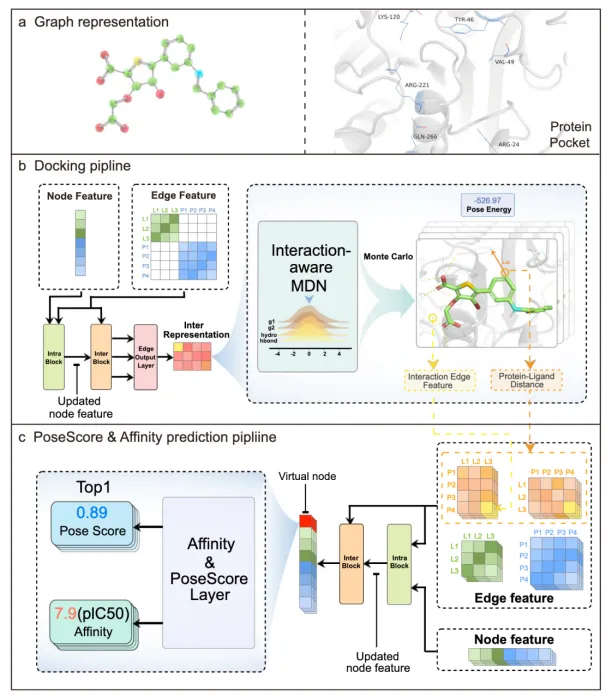

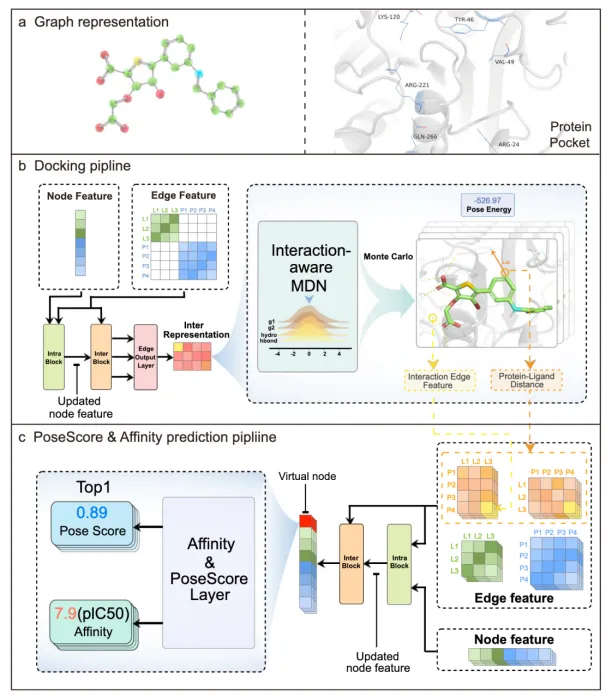

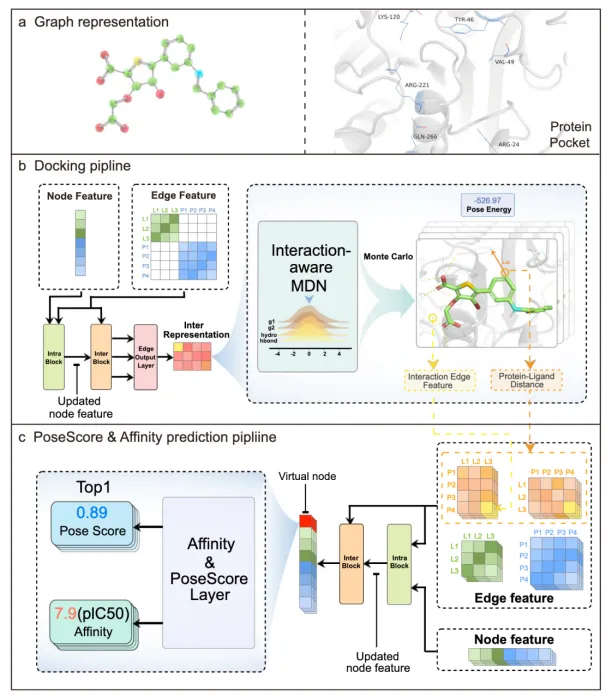

Nature Communication|交互作用感知的蛋白质-配体对接和亲和力预测模型《Interformer: an interaction-aware model for protein-ligand docking and affinity prediction》

1.简要介绍:本研究提出了一种名为Interformer的基于Graph-Transformer架构的统一模型,用于蛋白-配体对接和亲和力预测。针对现有深度学习模型忽略蛋白与配体原子间非共价相互作用建模的不足,Interformer引入了交互感知混合密度网络(MDN)来明确捕捉氢键和疏水相互作用,并结合负采样策略和伪Huber损失函数,通过对比学习优化相互作用分布,提升对接姿势的准确性和亲和力预测的鲁棒性。

2.数据集:研究使用了PDBBind时间分割测试集(333个样本)评估对接准确性,Posebusters基准测试验证物理合理性,以及内部真实世界数据集测试泛化能力。训练数据来源于PDBBind晶体结构数据库。

3.模型:Interformer基于Graph-Transformer架构,包括:(1) 图表示模块,将原子作为节点、邻近关系作为边;(2) 掩码自注意力(MSA)机制,通过Intra-Blocks和Inter-Blocks分别捕捉配体/蛋白内部及两者间的相互作用;(3) 交互感知MDN,融合四种高斯分布模拟常规力、疏水作用和氢键;(4) 边缘输出层整合节点和边特征预测能量;(5) 姿势评分和亲和力模块基于虚拟节点预测正确姿势和实验亲和力值。

4.训练细节:训练分两阶段:首先基于晶体结构训练能量模型生成负样本,随后联合正负样本训练姿势评分和亲和力模型。采用负对数似然损失优化MDN,二元交叉熵损失优化姿势评分,伪Huber损失(σ=4)优化亲和力预测(单位IC50、Kd、KI,经负对数归一化)。蒙特卡洛采样生成候选姿势,

研究内容2:

Nature Communication|分子动力学驱动的蛋白质-配体复合物结构动态预测《DynamicBind: predicting ligand-specific protein-ligand complex structure with a deep equivariant generative model》

1.简单介绍:本研究提出了一种名为DynamicBind的深度学习方法,用于预测配体特异性的蛋白-配体复合物结构。传统分子对接方法通常将蛋白视为刚性或仅部分柔性,难以处理蛋白的大尺度构象变化,而分子动力学模拟虽然能捕捉动态构象,但计算成本高昂。DynamicBind通过等变几何扩散网络构建平滑的能量景观,高效模拟蛋白从无配体(apo)状态到配体结合(holo)状态的构象转变,无需依赖holo结构或大量采样。

2.数据集:研究基于PDBbind2020数据库(19,443个蛋白-配体复合物晶体结构),按时间划分:2019年前的数据用于训练和验证,2019年的数据用于测试。额外构建了Major Drug Targets (MDT)测试集(599对),聚焦激酶、GPCR等主要药物靶点,要求AlphaFold预测结构与晶体结构的pocket RMSD>2Å,确保测试难度。训练中通过AlphaFold预测结构与晶体结构插值生成蛋白部分的样本。

3.模型:DynamicBind是一个基于图神经网络的等变生成模型,使用粗粒化表示(蛋白以Cα节点和侧链二面角表示,配体以重原子节点表示),输出包括蛋白和配体的平移、旋转、扭转角更新,以及结合亲和力和cLDDT置信度评分。模型通过学习从apo到holo的“morph-like”变换,优化能量景观,包含63.67百万参数。

4.训练细节:训练在8块Nvidia A100 80GB GPU上进行5天,输入为添加morph变换的蛋白decoy构象和加高斯噪声的配体构象,目标是去噪操作。损失函数包括八项(配体和蛋白的平移、旋转、扭转等),通过Kabsch算法对齐apo和holo结构,结合扩散噪声调整构象过渡。推理时迭代20次更新初始结构。

l的使用与一般蛋白-配体分子对接

背景与理论知识以及工具准备

1.PDB数据库的介绍和使用

1.1数据库简介

1.2靶点蛋白的结构查询与选取

1.3靶点蛋白的结构序列下载

1.4靶点蛋白的下载与预处理

1.5批量下载蛋白晶体结构

2.Pymol的介绍与使用

2.1软件基本操作及基本知识介绍

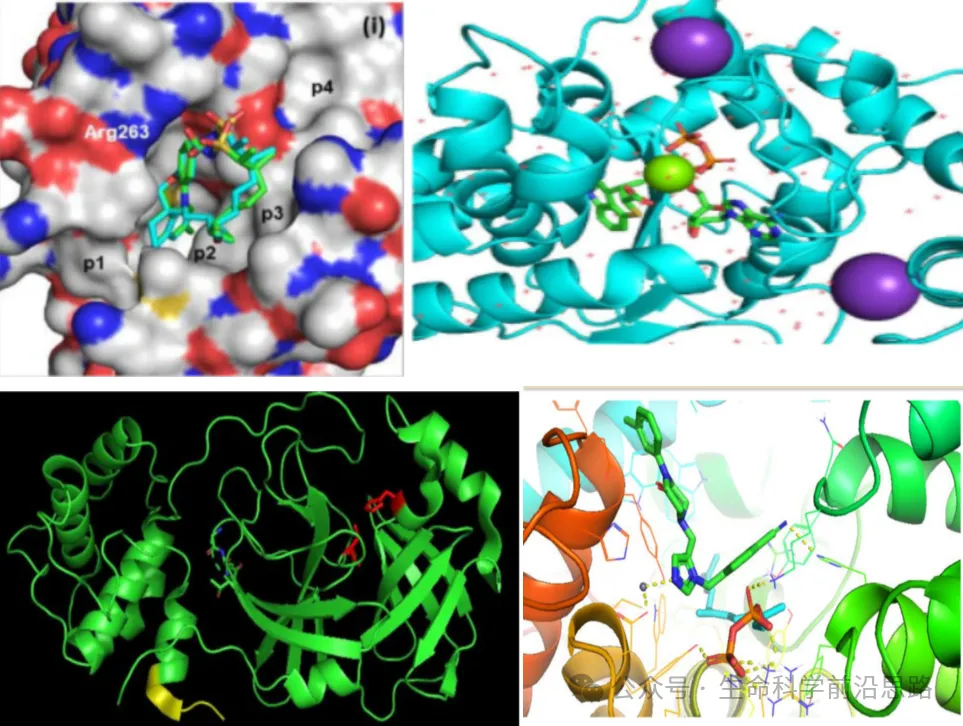

2.2蛋白质-配体相互作用图解

2.3蛋白-配体小分子表面图、静电势表示

2.4蛋白-配体结构叠加与比对

2.5绘制相互作用力

3.notepad的介绍和使用

3.1优势及主要功能介绍

3.2界面和基本操作介绍

3.3插件安装使用

一般的蛋白

-配体分子对接讲解

1.对接的相关理论介绍

1.1分子对接的概念及基本原理

1.2分子对接的基本方法

1.3分子对接的常用软件

1.4分子对接的一般流程

2.常规的蛋白-配体对接

2.1收集受体与配体分子

2.2复合体预构象的处理

2.3准备受体、配体分子

2.4蛋白-配体对接

2.5对接结果的分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

二、虚拟筛选

1.小分子数据库的介绍与下载

2.相关程序的介绍

2.1 openbabel的介绍和使用

2.2 chemdraw的介绍与使用

3.虚拟筛选的前处理

4.虚拟筛选的流程及实战演示

案例:筛选新冠病毒主蛋白酶抑制剂

5.结果分析与作图

6.药物ADME预测

6.1ADME概念介绍

6.2预测相关网站及软件介绍

6.3预测结果的分析

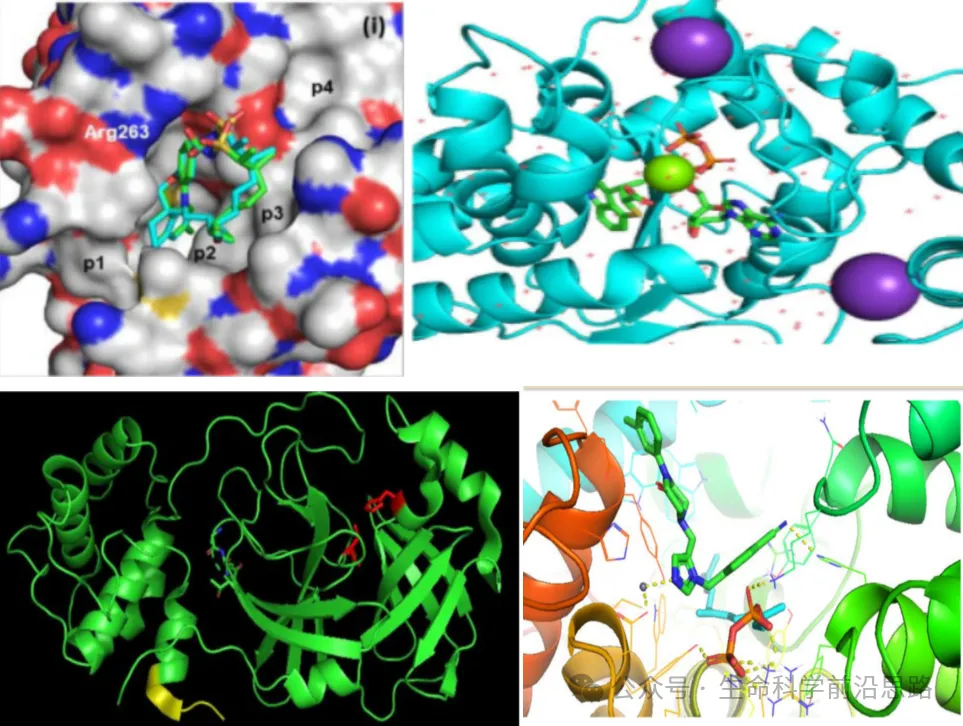

三、拓展对接的使用方法 1.蛋白-蛋白对接 1.1蛋白-蛋白对接的应用场景

1.2相关程序的介绍

1.3目标蛋白的收集以及预处理

1.4使用算例进行运算

1.5关键残基的预设

1.6结果的获取与文件类型

1.7结果的分析

以目前火热的靶点

PD-1/PD-L1等为例。

2.涉及金属酶蛋白的对接

2.1金属酶蛋白-配体的背景介绍

2.2蛋白与配体分子的收集与预处理

2.3金属离子的处理

2.4金属辅酶蛋白-配体的对接

2.5结果分析

以人类法尼基转移酶及其抑制剂为例

3.蛋白-多糖分子对接

4.1蛋白-多糖相互作用

4.2对接处理的要点

4.3蛋白-多糖分子对接的流程

4.4蛋白-多糖分子对接

4.5相关结果分析

以α-糖苷转移酶和多糖分子对接为例

5.核酸-小分子对接

5.1核酸-小分子的应用现状

5.2相关的程序介绍

5.3核酸-小分子的结合种类

5.4核酸-小分子对接

5.5相关结果的分析

以人端粒

g -四链和配体分子对接为例。

操作流程介绍及实战演示

四、拓展对接的使用方法

1.柔性对接 1.1柔性对接的使用场景介绍

1.2柔性对接的优势

1.3蛋白-配体的柔性对接

重点:柔性残基的设置方法

1.4相关结果的分析

以周期蛋白依赖性激酶

2(CDK2)与配体1CK为例

2.共价对接

2.1两种共价对接方法的介绍

2.1.1柔性侧链法

2.1.2两点吸引子法

2.2蛋白和配体的收集以及预处理

2.3共价药物分子与靶蛋白的共价对接

2.4结果的对比

以目前火热的新冠共价药物为例。

3.蛋白-水合对接

3.1水合作用在蛋白-配体相互作用中的意义及方法介绍

3.2蛋白和配体的收集以及预处理

3.3对接相关参数的准备

重点:水分子的加入和处理

3.4蛋白-水分子-配体对接

3.5结果分析

以乙酰胆碱结合蛋白

(AChBP)与尼古丁复合物为例

五、分子动力学模拟(linux与gromacs使用安装)

1. linux系统的介绍和简单使用 1.1 linux常用命令行

1.2 linux上的常用程序安装

1.3体验:如何在linux上进行虚拟筛选

2.分子动力学的理论介绍

2.1分子动力学模拟的原理

2.2分子动力学模拟的方法及相关程序

2.3相关力场的介绍

3.gromacs使用及介绍

重点:主要命令及参数的介绍

4.origin介绍及使用

六、溶剂化分子动力学模拟的执行

1.一般的溶剂化蛋白的处理流程

2.蛋白晶体的准备

3.结构的能量最小化

4.对体系的预平衡

5.无限制的分子动力学模拟

6.分子动力学结果展示与解读

以水中的溶菌酶为例

七、蛋白-配体分子动力学模拟的执行 1.蛋白-配体在分子动力学模拟的处理流程

2.蛋白晶体的准备

3.蛋白-配体模拟初始构象的准备

4.配体分子力场拓扑文件的准备

4.1高斯的简要介绍

4.2 ambertool的简要介绍

4.3生成小分子的力场参数文件

5.对复合物体系温度和压力分别限制的预平衡

6.无限制的分子动力学模拟

7.分子动力学结果展示与解读

8.轨迹后处理及分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

04

深度学习基因组学线上直播课

深入学习与了解深度学习基本框架与逻辑,同时掌握基本的生物信息学软件(Linux、R、python等)的使用,让学员能更好的应对基因组数据,挖掘出超越已有知识的新知识。而构建好的深度学习模型去探求新的研究思路和寻找新的潜在生物学机制,更好的服务于自身的科学研究和探索的过程中

一、环境搭建与深度学习基本知识讲解

1.AIDD概述:从CADD到AIDD

2.软件安装与环境搭建

(1)anaconda

(2)vscode

(3)环境变量的配置

(4)切换pip和conda镜像源

(5)虚拟环境的创建

3.RDKIT工具包的使用

(1)基于RDKit的分子读写

(2)基于RDKit的分子绘制

(3)基于RDKit的分子指纹与分子描述符

(4)基于RDKit的化合物相似性与子结构

4.药物综合数据库的获取方法

(1)基于requests的基本爬虫操作

(2)小分子数据库PubChem数据获取(pubchempy / requests)

(3)蛋白质数据库PDB、UniProt数据获取

5.深度学习辅助药物设计

(1)神经网络基本概念与sklearn工具包介绍

(2)图神经网络与消息传递机制基本知识

(3)Transformer模型基本知识:分词、位置编码、注意力机制、编码器、解码器、预训练-微调框架、huggingface 生态介绍

(4)模型的评估与验证:准确率、精确率、召回率、F1分数、ROC曲线、AUC计算,平均绝对误差、均方差、R2分数、可释方差分数,交叉验证等

二、分子与生化反应的表示学习与性质预测助力药物发现

培训内容1:Nature Machine Intelligence|基于注意力的神经网络在化学反应空间映射中的应用《Mapping the space of chemical reactions using attention-based neural networks》 1.数据集

1.1.Pistachio数据集:包含260万化学反应,来自专利数据,涵盖792个反应类别。数据经过去重和有效性过滤(使用RDKit)。

1.2.USPTO 1k TPL数据集:基于USPTO专利数据,包含44.5万反应,通过原子映射和模板提取生成1,000个反应模板类别。

1.3.Schneider 50k数据集:公开数据集,包含5万反应,50个类别,用于与传统指纹方法对比。

2.模型。研究对比了两种Transformer架构:

2.1.BERT分类器:基于编码器的模型,通过掩码语言建模预训练后,在分类任务上微调,使用[CLS]标记的嵌入作为反应指纹(rxnfp)。

2.2.Seq2Seq模型:编码器-解码器结构,将分类任务分解为超类、类别和具体反应的层级预测。两者均采用简化版BERT(隐藏层256维),输入为未标注的SMILES序列,无需反应物-试剂区分或原子映射。

3.训练。模型训练分为两步:

3.1.预训练:BERT通过掩码SMILES令牌预测任务进行自监督学习,学习反应通用表示。

3.2.微调:在分类任务上优化模型,使用交叉熵损失,学习率2×10⁻⁵,序列长度512。评估采用混淆熵(CEN)和马修斯相关系数(MCC)以处理数据不平衡。

培训内容2:TOP期刊|基于深度学习的生化反应产量预测《Prediction of chemical reaction yields using deep learning》

1.数据。研究使用了三类数据:

1.1.Buchwald-Hartwig HTE数据集:包含3955个Pd催化C-N偶联反应,涵盖15种卤化物、4种配体、3种碱和23种添加剂组合,产率通过统一实验测量,数据质量高。

1.2.Suzuki-Miyaura HTE数据集:包含5760个反应,涉及15对亲电/亲核试剂、12种配体、8种碱和4种溶剂的组合,产率分布均匀。

1.3.USPTO专利数据集:从公开专利中提取,包含不同规模(克级与亚克级)的反应产率,数据噪声大且分布不一致,需通过邻近反应产率平滑处理以提升模型表现。

2.模型。核心模型基于预训练的rxnfp(反应指纹)BERT架构,新增回归层构成Yield-BERT。输入为标准化反应SMILES,通过自注意力机制捕捉反应中心及关键试剂的上下文信息。模型无需手工特征(如DFT计算描述符),直接端到端预测产率。实验表明,其性能优于传统方法(如随机森林和分子指纹拼接),尤其在HTE数据上接近化学描述符的预测水平,且参数鲁棒性高(超参数调整影响小)。

3.训练。训练分为两步:

3.1.预训练:BERT通过掩码语言任务学习SMILES的通用表示。

3.2.微调:采用简单Transformers库和PyTorch框架,以MSE损失优化回归层,学习率(2×10⁻⁵)和dropout率(0.1–0.8)为主要调参对象。HTE数据采用随机/时间划分验证,USPTO数据通过邻近反应产率平滑缓解噪声影响。小样本实验(5%训练数据)显示模型能快速筛选高产反应,指导合成优化。

培训内容3:

TOP期刊|基于T5Chem模型的生化反应表示学习与性质预测: 《Unified Deep Learning Model for Multitask Reaction Predictions with Explanation》

1.数据来源和处理。通过自监督预训练与PubChem分子数据集进行训练,以实现对四种不同类型的化学反应预测任务的优异性能。模型处理包括反应类型分类、正向反应预测、单步逆合成和反应产率预测。

2.模型架构和原理。T5Chem模型是基于自然语言处理中的“Text-to-Text Transfer Transformer”(T5)框架开发的统一深度学习模型,该模型通过适应T5框架来处理多种化学反应预测任务。T5Chem模型包含编码器-解码器结构,并根据任务类型引入了任务特定的提示和不同的输出层,如分子生成头、分类头和回归头,以处理序列到序列的任务、反应类型分类和产品产率预测。

3.训练过程和细节。

3.1.T5Chem模型首先在PubChem的97 million分子上进行自监督预训练,使用BERT类似的“masked language modeling”目标。

3.2.在预训练阶段,源序列中的tokens被随机掩蔽,模型的目标是预测被掩蔽的正确的tokens。

3.3.预训练完成后,模型在下游的监督任务中进行微调,使用不同的任务特定提示和输出层。

3.4.模型在测试阶段通过生成分子token by token的方式进行预测,直到生成“句子结束标记”或达到最大预测长度。

三、蛋白质的表示学习与性质预测助力药物发现 培训内容1:

Nature Communication|体外酶动力学参数深度学习的综合框架《CatPred: a comprehensive framework for deep learning in vitro enzyme kinetic parameters》

CatPred 提出了一种全面的深度学习框架,用于预测体外酶动力学参数(kcat、Km、Ki),以解决实验测定成本高、数据稀疏和泛化能力差的问题。该方法不仅提供了准确的预测,还引入了对预测不确定性的量化,支持对训练集外(out-of-distribution)酶序列的稳健预测。此外,作者还构建了新的标准化数据集(CatPred-DB),并对多种酶表示方法进行了系统比较。

1.数据:CatPred 使用的数据集来自 BRENDA 和 SABIO-RK 数据库,作者构建了 CatPred-DB,包括:23197 条 kcat,41174 条 Km和11929 条 Ki 数据,每条记录都包含酶的氨基酸序列、AlphaFold 或 ESMFold 预测的结构、底物的 SMILES 表达式。数据经过清洗和标准化处理,去除缺失值和重复值,并对参数取对数转换以符合正态分布。

2.模型:CatPred 采用模块化设计,酶和底物分别通过不同的神经网络模块进行表征学习,并采用 概率回归 输出(高斯分布形式的均值和方差),允许进行 不确定性估计(aleatoric + epistemic)。

3.训练

3.1.所有模型采用负对数似然损失函数(NLL)训练,以同时预测参数均值和不确定性。

3.2.使用训练-验证-测试三分法(80%-10%-10%),并设立“训练集外”的测试子集用于泛化能力评估。

3.3.为了评估不确定性,CatPred 使用 10个模型的集成,通过不同初始参数训练,以此量化 epistemic uncertainty。

3.4.模型训练时考虑了不同相似性(序列identity<99%、80%、60%、40%)的测试集,体现其鲁棒性。

培训内容2:

Science|基于对比学习的蛋白质分类属性预测《Enzyme function prediction using contrastive learning》

1.数据来源和处理: CLEAN模型的训练基于UniProt数据库中的高质量数据,该数据库收录了约1.9亿个蛋白质序列。CLEAN模型以氨基酸序列作为输入,输出按可能性排序的酶功能列表(以EC编号为例)。为了验证CLEAN的准确性和鲁棒性,作者进行了广泛的in silico实验,并将CLEAN应用于内部收集的未表征的卤酶数据库(共36个)进行EC编号注释,随后通过案例研究进行体外实验验证。

2.模型架构和原理: CLEAN模型采用了对比学习框架,目标是学习一个酶的嵌入空间,其中欧几里得距离反映了功能相似性。嵌入是指蛋白质序列的数值表示,它由机器可读,同时保留了酶携带的重要特征和信息。在CLEAN的任务中,具有相同EC编号的氨基酸序列具有较小的欧几里得距离,而具有不同EC编号的序列则具有较大的距离。

3.训练过程和细节:

3.1.在训练过程中,CLEAN模型使用对比损失函数进行监督训练,通过优先选择与锚点(anchor)嵌入具有小欧几里得距离的负序列,以提高训练效率。

3.2.模型使用语言模型ESM1b获得的蛋白质表示作为前馈神经网络的输入,输出层产生细化的、功能感知的输入蛋白质嵌入。

3.3.预测时,通过计算查询序列与所有EC编号聚类中心之间的成对距离来预测输入蛋白质的EC编号。

3.4.CLEAN还开发了两种方法来从输出排名中预测自信的EC编号:一种是贪婪方法,另一种是基于P值的方法。

四、基于深度学习的分子生成助力药物发现

培训内容1:

Nature Communication|基于端到端的图生成框架的分子生成:《Retrosynthesis prediction using an end-to-end graph generative architecture for molecular graph editing》

1.数据来源和处理:Graph2Edits模型使用了公开可用的基准数据集USPTO-50k,包含50016个反应,这些反应被正确地原子映射并分类为10种不同的反应类型。数据集被分为40k、5k、5k的反应用于训练、验证和测试集。

2.模型架构和原理:Graph2Edits模型是一个端到端的图生成架构,基于图神经网络(GNN)预测产品图的编辑序列,并根据预测的编辑序列顺序生成中间体和最终反应物。该模型将半模板方法的两阶段过程(识别反应中心和完成合成子)合并为一锅学习,提高了在复杂反应中的适用性,并使预测结果更易于解释。模型的核心是图编码器和自回归模型,用于生成编辑序列,并应用这些编辑来推断中间体和反应物。

3.训练过程和细节:

3.1.Graph2Edits模型使用有向消息传递神经网络(D-MPNN)作为图编码器,以获取原子表示和全局图特征,并预测原子/键编辑和终止符号。

3.2.模型训练使用教师强制策略,即使用真实的编辑序列作为模型输入。在每个编辑步骤中,模型会计算所有可能的编辑的概率,并选择最高分的k个编辑,将这些编辑应用于输入图以获得k个中间体。

3.3.在生成过程中,如果达到最大步骤数或图表示指示终止,则生成分支将停止。

3.4.最终,根据可能性对前k个编辑序列和图进行排名,收集为最终预测结果。

培训内容2

Nature Computational Science|基于等变扩散模型的分子生成网络《Structure-based drug design with equivariant diffusion models》

1.简单介绍。这篇文献提出了一种基于结构的药物设计方法(SBDD),利用SE(3)-等变扩散模型(DiffSBDD)生成与蛋白质结合口条件匹配的新颖小分子配体。该方法通过将SBDD问题建模为三维条件生成任务,能够一次性生成所有原子位置,克服了传统自回归方法因顺序生成而丢失全局上下文的局限性。DiffSBDD不仅支持从头分子设计,还能通过属性优化、负向设计和分子局部修饰(inpainting)等多种任务灵活应用。

2.数据总结。该研究使用了CrossDocked和Binding MOAD两个数据集进行训练和评估。

2.1.CrossDocked数据集包含40,344个训练蛋白-配体对和130个测试对,验证集规模为246个,确保不同集合中的蛋白质来自不同的酶分类主类以避免过拟合。

2.2.Binding MOAD数据集经过筛选后用于测试,分析限于所有方法均能生成样本的78个CrossDocked和119个Binding MOAD目标。此外,数据集处理涉及移除损坏条目,并通过Zenodo公开提供处理后的数据和采样分子,确保研究可重复性。

3.模型总结。DiffSBDD是一个SE(3)-等变扩散模型,以蛋白质结合口为条件生成三维分子结构,采用3D图表示(原子坐标和类型),避免了传统方法中从密度图回推分子结构的复杂后处理。模型设计尊重三维空间的旋转和平

五、结合分子动力学的蛋白质配体复合物相互作用动态预测

培训内容1:

Nature Communication|交互作用感知的蛋白质-配体对接和亲和力预测模型《Interformer: an interaction-aware model for protein-ligand docking and affinity prediction》

1.简要介绍:本研究提出了一种名为Interformer的基于Graph-Transformer架构的统一模型,用于蛋白-配体对接和亲和力预测。针对现有深度学习模型忽略蛋白与配体原子间非共价相互作用建模的不足,Interformer引入了交互感知混合密度网络(MDN)来明确捕捉氢键和疏水相互作用,并结合负采样策略和伪Huber损失函数,通过对比学习优化相互作用分布,提升对接姿势的准确性和亲和力预测的鲁棒性。

2.数据集:研究使用了PDBBind时间分割测试集(333个样本)评估对接准确性,Posebusters基准测试验证物理合理性,以及内部真实世界数据集测试泛化能力。训练数据来源于PDBBind晶体结构数据库。

3.模型:Interformer基于Graph-Transformer架构,包括:(1) 图表示模块,将原子作为节点、邻近关系作为边;(2) 掩码自注意力(MSA)机制,通过Intra-Blocks和Inter-Blocks分别捕捉配体/蛋白内部及两者间的相互作用;(3) 交互感知MDN,融合四种高斯分布模拟常规力、疏水作用和氢键;(4) 边缘输出层整合节点和边特征预测能量;(5) 姿势评分和亲和力模块基于虚拟节点预测正确姿势和实验亲和力值。

4.训练细节:训练分两阶段:首先基于晶体结构训练能量模型生成负样本,随后联合正负样本训练姿势评分和亲和力模型。采用负对数似然损失优化MDN,二元交叉熵损失优化姿势评分,伪Huber损失(σ=4)优化亲和力预测(单位IC50、Kd、KI,经负对数归一化)。蒙特卡洛采样生成候选姿势,

研究内容2:

Nature Communication|分子动力学驱动的蛋白质-配体复合物结构动态预测《DynamicBind: predicting ligand-specific protein-ligand complex structure with a deep equivariant generative model》

1.简单介绍:本研究提出了一种名为DynamicBind的深度学习方法,用于预测配体特异性的蛋白-配体复合物结构。传统分子对接方法通常将蛋白视为刚性或仅部分柔性,难以处理蛋白的大尺度构象变化,而分子动力学模拟虽然能捕捉动态构象,但计算成本高昂。DynamicBind通过等变几何扩散网络构建平滑的能量景观,高效模拟蛋白从无配体(apo)状态到配体结合(holo)状态的构象转变,无需依赖holo结构或大量采样。

2.数据集:研究基于PDBbind2020数据库(19,443个蛋白-配体复合物晶体结构),按时间划分:2019年前的数据用于训练和验证,2019年的数据用于测试。额外构建了Major Drug Targets (MDT)测试集(599对),聚焦激酶、GPCR等主要药物靶点,要求AlphaFold预测结构与晶体结构的pocket RMSD>2Å,确保测试难度。训练中通过AlphaFold预测结构与晶体结构插值生成蛋白部分的样本。

3.模型:DynamicBind是一个基于图神经网络的等变生成模型,使用粗粒化表示(蛋白以Cα节点和侧链二面角表示,配体以重原子节点表示),输出包括蛋白和配体的平移、旋转、扭转角更新,以及结合亲和力和cLDDT置信度评分。模型通过学习从apo到holo的“morph-like”变换,优化能量景观,包含63.67百万参数。

4.训练细节:训练在8块Nvidia A100 80GB GPU上进行5天,输入为添加morph变换的蛋白decoy构象和加高斯噪声的配体构象,目标是去噪操作。损失函数包括八项(配体和蛋白的平移、旋转、扭转等),通过Kabsch算法对齐apo和holo结构,结合扩散噪声调整构象过渡。推理时迭代20次更新初始结构。

一、环境搭建与深度学习基本知识讲解 | 1.AIDD概述:从CADD到AIDD 2.软件安装与环境搭建 (1)anaconda (2)vscode (3)环境变量的配置 (4)切换pip和conda镜像源 (5)虚拟环境的创建 3.RDKIT工具包的使用 (1)基于RDKit的分子读写 (2)基于RDKit的分子绘制 (3)基于RDKit的分子指纹与分子描述符 (4)基于RDKit的化合物相似性与子结构 4.药物综合数据库的获取方法 (1)基于requests的基本爬虫操作 (2)小分子数据库PubChem数据获取(pubchempy / requests) (3)蛋白质数据库PDB、UniProt数据获取 5.深度学习辅助药物设计 (1)神经网络基本概念与sklearn工具包介绍 (2)图神经网络与消息传递机制基本知识 (3)Transformer模型基本知识:分词、位置编码、注意力机制、编码器、解码器、预训练-微调框架、huggingface 生态介绍 (4)模型的评估与验证:准确率、精确率、召回率、F1分数、ROC曲线、AUC计算,平均绝对误差、均方差、R2分数、可释方差分数,交叉验证等 |

二、分子与生化反应的表示学习与性质预测助力药物发现 | 1.数据集 1.1.Pistachio数据集:包含260万化学反应,来自专利数据,涵盖792个反应类别。数据经过去重和有效性过滤(使用RDKit)。 1.2.USPTO 1k TPL数据集:基于USPTO专利数据,包含44.5万反应,通过原子映射和模板提取生成1,000个反应模板类别。 1.3.Schneider 50k数据集:公开数据集,包含5万反应,50个类别,用于与传统指纹方法对比。 2.模型。研究对比了两种Transformer架构: 2.1.BERT分类器:基于编码器的模型,通过掩码语言建模预训练后,在分类任务上微调,使用[CLS]标记的嵌入作为反应指纹(rxnfp)。 2.2.Seq2Seq模型:编码器-解码器结构,将分类任务分解为超类、类别和具体反应的层级预测。两者均采用简化版BERT(隐藏层256维),输入为未标注的SMILES序列,无需反应物-试剂区分或原子映射。 3.训练。模型训练分为两步: 3.1.预训练:BERT通过掩码SMILES令牌预测任务进行自监督学习,学习反应通用表示。 3.2.微调:在分类任务上优化模型,使用交叉熵损失,学习率2×10⁻⁵,序列长度512。评估采用混淆熵(CEN)和马修斯相关系数(MCC)以处理数据不平衡。 培训内容2:TOP期刊|基于深度学习的生化反应产量预测《Prediction of chemical reaction yields using deep learning》 1.数据。研究使用了三类数据: 1.1.Buchwald-Hartwig HTE数据集:包含3955个Pd催化C-N偶联反应,涵盖15种卤化物、4种配体、3种碱和23种添加剂组合,产率通过统一实验测量,数据质量高。 1.2.Suzuki-Miyaura HTE数据集:包含5760个反应,涉及15对亲电/亲核试剂、12种配体、8种碱和4种溶剂的组合,产率分布均匀。 1.3.USPTO专利数据集:从公开专利中提取,包含不同规模(克级与亚克级)的反应产率,数据噪声大且分布不一致,需通过邻近反应产率平滑处理以提升模型表现。 2.模型。核心模型基于预训练的rxnfp(反应指纹)BERT架构,新增回归层构成Yield-BERT。输入为标准化反应SMILES,通过自注意力机制捕捉反应中心及关键试剂的上下文信息。模型无需手工特征(如DFT计算描述符),直接端到端预测产率。实验表明,其性能优于传统方法(如随机森林和分子指纹拼接),尤其在HTE数据上接近化学描述符的预测水平,且参数鲁棒性高(超参数调整影响小)。 3.训练。训练分为两步: 3.1.预训练:BERT通过掩码语言任务学习SMILES的通用表示。 3.2.微调:采用简单Transformers库和PyTorch框架,以MSE损失优化回归层,学习率(2×10⁻⁵)和dropout率(0.1–0.8)为主要调参对象。HTE数据采用随机/时间划分验证,USPTO数据通过邻近反应产率平滑缓解噪声影响。小样本实验(5%训练数据)显示模型能快速筛选高产反应,指导合成优化。  培训内容3: TOP期刊|基于T5Chem模型的生化反应表示学习与性质预测: 《Unified Deep Learning Model for Multitask Reaction Predictions with Explanation》 1.数据来源和处理。通过自监督预训练与PubChem分子数据集进行训练,以实现对四种不同类型的化学反应预测任务的优异性能。模型处理包括反应类型分类、正向反应预测、单步逆合成和反应产率预测。 2.模型架构和原理。T5Chem模型是基于自然语言处理中的“Text-to-Text Transfer Transformer”(T5)框架开发的统一深度学习模型,该模型通过适应T5框架来处理多种化学反应预测任务。T5Chem模型包含编码器-解码器结构,并根据任务类型引入了任务特定的提示和不同的输出层,如分子生成头、分类头和回归头,以处理序列到序列的任务、反应类型分类和产品产率预测。 3.训练过程和细节。 3.1.T5Chem模型首先在PubChem的97 million分子上进行自监督预训练,使用BERT类似的“masked language modeling”目标。 3.2.在预训练阶段,源序列中的tokens被随机掩蔽,模型的目标是预测被掩蔽的正确的tokens。 3.3.预训练完成后,模型在下游的监督任务中进行微调,使用不同的任务特定提示和输出层。 3.4.模型在测试阶段通过生成分子token by token的方式进行预测,直到生成“句子结束标记”或达到最大预测长度。  |

培训内容1: Nature Communication|体外酶动力学参数深度学习的综合框架《CatPred: a comprehensive framework for deep learning in vitro enzyme kinetic parameters》 CatPred 提出了一种全面的深度学习框架,用于预测体外酶动力学参数(kcat、Km、Ki),以解决实验测定成本高、数据稀疏和泛化能力差的问题。该方法不仅提供了准确的预测,还引入了对预测不确定性的量化,支持对训练集外(out-of-distribution)酶序列的稳健预测。此外,作者还构建了新的标准化数据集(CatPred-DB),并对多种酶表示方法进行了系统比较。 1.数据:CatPred 使用的数据集来自 BRENDA 和 SABIO-RK 数据库,作者构建了 CatPred-DB,包括:23197 条 kcat,41174 条 Km和11929 条 Ki 数据,每条记录都包含酶的氨基酸序列、AlphaFold 或 ESMFold 预测的结构、底物的 SMILES 表达式。数据经过清洗和标准化处理,去除缺失值和重复值,并对参数取对数转换以符合正态分布。 2.模型:CatPred 采用模块化设计,酶和底物分别通过不同的神经网络模块进行表征学习,并采用 概率回归 输出(高斯分布形式的均值和方差),允许进行 不确定性估计(aleatoric + epistemic)。 3.训练 3.1.所有模型采用负对数似然损失函数(NLL)训练,以同时预测参数均值和不确定性。 3.2.使用训练-验证-测试三分法(80%-10%-10%),并设立“训练集外”的测试子集用于泛化能力评估。 3.3.为了评估不确定性,CatPred 使用 10个模型的集成,通过不同初始参数训练,以此量化 epistemic uncertainty。 3.4.模型训练时考虑了不同相似性(序列identity<99%、80%、60%、40%)的测试集,体现其鲁棒性。  培训内容2: Science|基于对比学习的蛋白质分类属性预测《Enzyme function prediction using contrastive learning》 1.数据来源和处理: CLEAN模型的训练基于UniProt数据库中的高质量数据,该数据库收录了约1.9亿个蛋白质序列。CLEAN模型以氨基酸序列作为输入,输出按可能性排序的酶功能列表(以EC编号为例)。为了验证CLEAN的准确性和鲁棒性,作者进行了广泛的in silico实验,并将CLEAN应用于内部收集的未表征的卤酶数据库(共36个)进行EC编号注释,随后通过案例研究进行体外实验验证。 2.模型架构和原理: CLEAN模型采用了对比学习框架,目标是学习一个酶的嵌入空间,其中欧几里得距离反映了功能相似性。嵌入是指蛋白质序列的数值表示,它由机器可读,同时保留了酶携带的重要特征和信息。在CLEAN的任务中,具有相同EC编号的氨基酸序列具有较小的欧几里得距离,而具有不同EC编号的序列则具有较大的距离。 3.训练过程和细节: 3.1.在训练过程中,CLEAN模型使用对比损失函数进行监督训练,通过优先选择与锚点(anchor)嵌入具有小欧几里得距离的负序列,以提高训练效率。 3.2.模型使用语言模型ESM1b获得的蛋白质表示作为前馈神经网络的输入,输出层产生细化的、功能感知的输入蛋白质嵌入。 3.3.预测时,通过计算查询序列与所有EC编号聚类中心之间的成对距离来预测输入蛋白质的EC编号。 3.4.CLEAN还开发了两种方法来从输出排名中预测自信的EC编号:一种是贪婪方法,另一种是基于P值的方法。  | |

四、基于深度学习的分子生成助力药物发现 | 培训内容1:Nature Communication|基于端到端的图生成框架的分子生成:《Retrosynthesis prediction using an end-to-end graph generative architecture for molecular graph editing》 1.数据来源和处理:Graph2Edits模型使用了公开可用的基准数据集USPTO-50k,包含50016个反应,这些反应被正确地原子映射并分类为10种不同的反应类型。数据集被分为40k、5k、5k的反应用于训练、验证和测试集。 2.模型架构和原理:Graph2Edits模型是一个端到端的图生成架构,基于图神经网络(GNN)预测产品图的编辑序列,并根据预测的编辑序列顺序生成中间体和最终反应物。该模型将半模板方法的两阶段过程(识别反应中心和完成合成子)合并为一锅学习,提高了在复杂反应中的适用性,并使预测结果更易于解释。模型的核心是图编码器和自回归模型,用于生成编辑序列,并应用这些编辑来推断中间体和反应物。 3.训练过程和细节: 3.1.Graph2Edits模型使用有向消息传递神经网络(D-MPNN)作为图编码器,以获取原子表示和全局图特征,并预测原子/键编辑和终止符号。 3.2.模型训练使用教师强制策略,即使用真实的编辑序列作为模型输入。在每个编辑步骤中,模型会计算所有可能的编辑的概率,并选择最高分的k个编辑,将这些编辑应用于输入图以获得k个中间体。 3.3.在生成过程中,如果达到最大步骤数或图表示指示终止,则生成分支将停止。 3.4.最终,根据可能性对前k个编辑序列和图进行排名,收集为最终预测结果。 培训内容2Nature Computational Science|基于等变扩散模型的分子生成网络《Structure-based drug design with equivariant diffusion models》 1.简单介绍。这篇文献提出了一种基于结构的药物设计方法(SBDD),利用SE(3)-等变扩散模型(DiffSBDD)生成与蛋白质结合口条件匹配的新颖小分子配体。该方法通过将SBDD问题建模为三维条件生成任务,能够一次性生成所有原子位置,克服了传统自回归方法因顺序生成而丢失全局上下文的局限性。DiffSBDD不仅支持从头分子设计,还能通过属性优化、负向设计和分子局部修饰(inpainting)等多种任务灵活应用。 2.数据总结。该研究使用了CrossDocked和Binding MOAD两个数据集进行训练和评估。 2.1.CrossDocked数据集包含40,344个训练蛋白-配体对和130个测试对,验证集规模为246个,确保不同集合中的蛋白质来自不同的酶分类主类以避免过拟合。 2.2.Binding MOAD数据集经过筛选后用于测试,分析限于所有方法均能生成样本的78个CrossDocked和119个Binding MOAD目标。此外,数据集处理涉及移除损坏条目,并通过Zenodo公开提供处理后的数据和采样分子,确保研究可重复性。 3.模型总结。DiffSBDD是一个SE(3)-等变扩散模型,以蛋白质结合口为条件生成三维分子结构,采用3D图表示(原子坐标和类型),避免了传统方法中从密度图回推分子结构的复杂后处理。模型设计尊重三维空间的旋转和平  |

五、结合分子动力学的蛋白质配体复合物相互作用动态预测 | 培训内容1: Nature Communication|交互作用感知的蛋白质-配体对接和亲和力预测模型《Interformer: an interaction-aware model for protein-ligand docking and affinity prediction》 1.简要介绍:本研究提出了一种名为Interformer的基于Graph-Transformer架构的统一模型,用于蛋白-配体对接和亲和力预测。针对现有深度学习模型忽略蛋白与配体原子间非共价相互作用建模的不足,Interformer引入了交互感知混合密度网络(MDN)来明确捕捉氢键和疏水相互作用,并结合负采样策略和伪Huber损失函数,通过对比学习优化相互作用分布,提升对接姿势的准确性和亲和力预测的鲁棒性。 2.数据集:研究使用了PDBBind时间分割测试集(333个样本)评估对接准确性,Posebusters基准测试验证物理合理性,以及内部真实世界数据集测试泛化能力。训练数据来源于PDBBind晶体结构数据库。 3.模型:Interformer基于Graph-Transformer架构,包括:(1) 图表示模块,将原子作为节点、邻近关系作为边;(2) 掩码自注意力(MSA)机制,通过Intra-Blocks和Inter-Blocks分别捕捉配体/蛋白内部及两者间的相互作用;(3) 交互感知MDN,融合四种高斯分布模拟常规力、疏水作用和氢键;(4) 边缘输出层整合节点和边特征预测能量;(5) 姿势评分和亲和力模块基于虚拟节点预测正确姿势和实验亲和力值。 4.训练细节:训练分两阶段:首先基于晶体结构训练能量模型生成负样本,随后联合正负样本训练姿势评分和亲和力模型。采用负对数似然损失优化MDN,二元交叉熵损失优化姿势评分,伪Huber损失(σ=4)优化亲和力预测(单位IC50、Kd、KI,经负对数归一化)。蒙特卡洛采样生成候选姿势,  研究内容2: Nature Communication|分子动力学驱动的蛋白质-配体复合物结构动态预测《DynamicBind: predicting ligand-specific protein-ligand complex structure with a deep equivariant generative model》1.简单介绍:本研究提出了一种名为DynamicBind的深度学习方法,用于预测配体特异性的蛋白-配体复合物结构。传统分子对接方法通常将蛋白视为刚性或仅部分柔性,难以处理蛋白的大尺度构象变化,而分子动力学模拟虽然能捕捉动态构象,但计算成本高昂。DynamicBind通过等变几何扩散网络构建平滑的能量景观,高效模拟蛋白从无配体(apo)状态到配体结合(holo)状态的构象转变,无需依赖holo结构或大量采样。 2.数据集:研究基于PDBbind2020数据库(19,443个蛋白-配体复合物晶体结构),按时间划分:2019年前的数据用于训练和验证,2019年的数据用于测试。额外构建了Major Drug Targets (MDT)测试集(599对),聚焦激酶、GPCR等主要药物靶点,要求AlphaFold预测结构与晶体结构的pocket RMSD>2Å,确保测试难度。训练中通过AlphaFold预测结构与晶体结构插值生成蛋白部分的样本。 3.模型:DynamicBind是一个基于图神经网络的等变生成模型,使用粗粒化表示(蛋白以Cα节点和侧链二面角表示,配体以重原子节点表示),输出包括蛋白和配体的平移、旋转、扭转角更新,以及结合亲和力和cLDDT置信度评分。模型通过学习从apo到holo的“morph-like”变换,优化能量景观,包含63.67百万参数。 4.训练细节:训练在8块Nvidia A100 80GB GPU上进行5天,输入为添加morph变换的蛋白decoy构象和加高斯噪声的配体构象,目标是去噪操作。损失函数包括八项(配体和蛋白的平移、旋转、扭转等),通过Kabsch算法对齐apo和holo结构,结合扩散噪声调整构象过渡。推理时迭代20次更新初始结构。 |

l的使用与一般蛋白-配体分子对接

背景与理论知识以及工具准备

1.PDB数据库的介绍和使用

1.1数据库简介

1.2靶点蛋白的结构查询与选取

1.3靶点蛋白的结构序列下载

1.4靶点蛋白的下载与预处理

1.5批量下载蛋白晶体结构

2.Pymol的介绍与使用

2.1软件基本操作及基本知识介绍

2.2蛋白质-配体相互作用图解

2.3蛋白-配体小分子表面图、静电势表示

2.4蛋白-配体结构叠加与比对

2.5绘制相互作用力

3.notepad的介绍和使用

3.1优势及主要功能介绍

3.2界面和基本操作介绍

3.3插件安装使用

一般的蛋白

-配体分子对接讲解

1.对接的相关理论介绍

1.1分子对接的概念及基本原理

1.2分子对接的基本方法

1.3分子对接的常用软件

1.4分子对接的一般流程

2.常规的蛋白-配体对接

2.1收集受体与配体分子

2.2复合体预构象的处理

2.3准备受体、配体分子

2.4蛋白-配体对接

2.5对接结果的分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

二、虚拟筛选

1.小分子数据库的介绍与下载

2.相关程序的介绍

2.1 openbabel的介绍和使用

2.2 chemdraw的介绍与使用

3.虚拟筛选的前处理

4.虚拟筛选的流程及实战演示

案例:筛选新冠病毒主蛋白酶抑制剂

5.结果分析与作图

6.药物ADME预测

6.1ADME概念介绍

6.2预测相关网站及软件介绍

6.3预测结果的分析

三、拓展对接的使用方法 1.蛋白-蛋白对接 1.1蛋白-蛋白对接的应用场景

1.2相关程序的介绍

1.3目标蛋白的收集以及预处理

1.4使用算例进行运算

1.5关键残基的预设

1.6结果的获取与文件类型

1.7结果的分析

以目前火热的靶点

PD-1/PD-L1等为例。

2.涉及金属酶蛋白的对接

2.1金属酶蛋白-配体的背景介绍

2.2蛋白与配体分子的收集与预处理

2.3金属离子的处理

2.4金属辅酶蛋白-配体的对接

2.5结果分析

以人类法尼基转移酶及其抑制剂为例

3.蛋白-多糖分子对接

4.1蛋白-多糖相互作用

4.2对接处理的要点

4.3蛋白-多糖分子对接的流程

4.4蛋白-多糖分子对接

4.5相关结果分析

以α-糖苷转移酶和多糖分子对接为例

5.核酸-小分子对接

5.1核酸-小分子的应用现状

5.2相关的程序介绍

5.3核酸-小分子的结合种类

5.4核酸-小分子对接

5.5相关结果的分析

以人端粒

g -四链和配体分子对接为例。

操作流程介绍及实战演示

四、拓展对接的使用方法

1.柔性对接 1.1柔性对接的使用场景介绍

1.2柔性对接的优势

1.3蛋白-配体的柔性对接

重点:柔性残基的设置方法

1.4相关结果的分析

以周期蛋白依赖性激酶

2(CDK2)与配体1CK为例

2.共价对接

2.1两种共价对接方法的介绍

2.1.1柔性侧链法

2.1.2两点吸引子法

2.2蛋白和配体的收集以及预处理

2.3共价药物分子与靶蛋白的共价对接

2.4结果的对比

以目前火热的新冠共价药物为例。

3.蛋白-水合对接

3.1水合作用在蛋白-配体相互作用中的意义及方法介绍

3.2蛋白和配体的收集以及预处理

3.3对接相关参数的准备

重点:水分子的加入和处理

3.4蛋白-水分子-配体对接

3.5结果分析

以乙酰胆碱结合蛋白

(AChBP)与尼古丁复合物为例

五、分子动力学模拟(linux与gromacs使用安装)

1. linux系统的介绍和简单使用 1.1 linux常用命令行

1.2 linux上的常用程序安装

1.3体验:如何在linux上进行虚拟筛选

2.分子动力学的理论介绍

2.1分子动力学模拟的原理

2.2分子动力学模拟的方法及相关程序

2.3相关力场的介绍

3.gromacs使用及介绍

重点:主要命令及参数的介绍

4.origin介绍及使用

六、溶剂化分子动力学模拟的执行

1.一般的溶剂化蛋白的处理流程

2.蛋白晶体的准备

3.结构的能量最小化

4.对体系的预平衡

5.无限制的分子动力学模拟

6.分子动力学结果展示与解读

以水中的溶菌酶为例

七、蛋白-配体分子动力学模拟的执行 1.蛋白-配体在分子动力学模拟的处理流程

2.蛋白晶体的准备

3.蛋白-配体模拟初始构象的准备

4.配体分子力场拓扑文件的准备

4.1高斯的简要介绍

4.2 ambertool的简要介绍

4.3生成小分子的力场参数文件

5.对复合物体系温度和压力分别限制的预平衡

6.无限制的分子动力学模拟

7.分子动力学结果展示与解读

8.轨迹后处理及分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

l的使用与一般蛋白-配体分子对接

背景与理论知识以及工具准备

1.PDB数据库的介绍和使用

1.1数据库简介

1.2靶点蛋白的结构查询与选取

1.3靶点蛋白的结构序列下载

1.4靶点蛋白的下载与预处理

1.5批量下载蛋白晶体结构

2.Pymol的介绍与使用

2.1软件基本操作及基本知识介绍

2.2蛋白质-配体相互作用图解

2.3蛋白-配体小分子表面图、静电势表示

2.4蛋白-配体结构叠加与比对

2.5绘制相互作用力

3.notepad的介绍和使用

3.1优势及主要功能介绍

3.2界面和基本操作介绍

3.3插件安装使用

一般的蛋白

-配体分子对接讲解

1.对接的相关理论介绍

1.1分子对接的概念及基本原理

1.2分子对接的基本方法

1.3分子对接的常用软件

1.4分子对接的一般流程

2.常规的蛋白-配体对接

2.1收集受体与配体分子

2.2复合体预构象的处理

2.3准备受体、配体分子

2.4蛋白-配体对接

2.5对接结果的分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

二、虚拟筛选

1.小分子数据库的介绍与下载

2.相关程序的介绍

2.1 openbabel的介绍和使用

2.2 chemdraw的介绍与使用

3.虚拟筛选的前处理

4.虚拟筛选的流程及实战演示

案例:筛选新冠病毒主蛋白酶抑制剂

5.结果分析与作图

6.药物ADME预测

6.1ADME概念介绍

6.2预测相关网站及软件介绍

6.3预测结果的分析

三、拓展对接的使用方法 1.蛋白-蛋白对接 1.1蛋白-蛋白对接的应用场景

1.2相关程序的介绍

1.3目标蛋白的收集以及预处理

1.4使用算例进行运算

1.5关键残基的预设

1.6结果的获取与文件类型

1.7结果的分析

以目前火热的靶点

PD-1/PD-L1等为例。

2.涉及金属酶蛋白的对接

2.1金属酶蛋白-配体的背景介绍

2.2蛋白与配体分子的收集与预处理

2.3金属离子的处理

2.4金属辅酶蛋白-配体的对接

2.5结果分析

以人类法尼基转移酶及其抑制剂为例

3.蛋白-多糖分子对接

4.1蛋白-多糖相互作用

4.2对接处理的要点

4.3蛋白-多糖分子对接的流程

4.4蛋白-多糖分子对接

4.5相关结果分析

以α-糖苷转移酶和多糖分子对接为例

5.核酸-小分子对接

5.1核酸-小分子的应用现状

5.2相关的程序介绍

5.3核酸-小分子的结合种类

5.4核酸-小分子对接

5.5相关结果的分析

以人端粒

g -四链和配体分子对接为例。

操作流程介绍及实战演示

四、拓展对接的使用方法

1.柔性对接 1.1柔性对接的使用场景介绍

1.2柔性对接的优势

1.3蛋白-配体的柔性对接

重点:柔性残基的设置方法

1.4相关结果的分析

以周期蛋白依赖性激酶

2(CDK2)与配体1CK为例

2.共价对接

2.1两种共价对接方法的介绍

2.1.1柔性侧链法

2.1.2两点吸引子法

2.2蛋白和配体的收集以及预处理

2.3共价药物分子与靶蛋白的共价对接

2.4结果的对比

以目前火热的新冠共价药物为例。

3.蛋白-水合对接

3.1水合作用在蛋白-配体相互作用中的意义及方法介绍

3.2蛋白和配体的收集以及预处理

3.3对接相关参数的准备

重点:水分子的加入和处理

3.4蛋白-水分子-配体对接

3.5结果分析

以乙酰胆碱结合蛋白

(AChBP)与尼古丁复合物为例

五、分子动力学模拟(linux与gromacs使用安装)

1. linux系统的介绍和简单使用 1.1 linux常用命令行

1.2 linux上的常用程序安装

1.3体验:如何在linux上进行虚拟筛选

2.分子动力学的理论介绍

2.1分子动力学模拟的原理

2.2分子动力学模拟的方法及相关程序

2.3相关力场的介绍

3.gromacs使用及介绍

重点:主要命令及参数的介绍

4.origin介绍及使用

六、溶剂化分子动力学模拟的执行

1.一般的溶剂化蛋白的处理流程

2.蛋白晶体的准备

3.结构的能量最小化

4.对体系的预平衡

5.无限制的分子动力学模拟

6.分子动力学结果展示与解读

以水中的溶菌酶为例

七、蛋白-配体分子动力学模拟的执行 1.蛋白-配体在分子动力学模拟的处理流程

2.蛋白晶体的准备

3.蛋白-配体模拟初始构象的准备

4.配体分子力场拓扑文件的准备

4.1高斯的简要介绍

4.2 ambertool的简要介绍

4.3生成小分子的力场参数文件

5.对复合物体系温度和压力分别限制的预平衡

6.无限制的分子动力学模拟

7.分子动力学结果展示与解读

8.轨迹后处理及分析

以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例

l的使用与一般蛋白-配体分子对接 | 背景与理论知识以及工具准备 1.PDB数据库的介绍和使用 1.1数据库简介 1.2靶点蛋白的结构查询与选取 1.3靶点蛋白的结构序列下载 1.4靶点蛋白的下载与预处理 1.5批量下载蛋白晶体结构 2.Pymol的介绍与使用 2.1软件基本操作及基本知识介绍 2.2蛋白质-配体相互作用图解 2.3蛋白-配体小分子表面图、静电势表示 2.4蛋白-配体结构叠加与比对 2.5绘制相互作用力 3.notepad的介绍和使用 3.1优势及主要功能介绍 3.2界面和基本操作介绍 3.3插件安装使用 一般的蛋白 -配体分子对接讲解 1.对接的相关理论介绍 1.1分子对接的概念及基本原理 1.2分子对接的基本方法 1.3分子对接的常用软件 1.4分子对接的一般流程 2.常规的蛋白-配体对接 2.1收集受体与配体分子 2.2复合体预构象的处理 2.3准备受体、配体分子 2.4蛋白-配体对接 2.5对接结果的分析 以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例 |

二、虚拟筛选 | 1.小分子数据库的介绍与下载 2.相关程序的介绍 2.1 openbabel的介绍和使用 2.2 chemdraw的介绍与使用 3.虚拟筛选的前处理 4.虚拟筛选的流程及实战演示 案例:筛选新冠病毒主蛋白酶抑制剂 5.结果分析与作图 6.药物ADME预测 6.1ADME概念介绍 6.2预测相关网站及软件介绍 6.3预测结果的分析 |

1.1蛋白-蛋白对接的应用场景 1.2相关程序的介绍 1.3目标蛋白的收集以及预处理 1.4使用算例进行运算 1.5关键残基的预设 1.6结果的获取与文件类型 1.7结果的分析 以目前火热的靶点 PD-1/PD-L1等为例。 2.涉及金属酶蛋白的对接 2.1金属酶蛋白-配体的背景介绍 2.2蛋白与配体分子的收集与预处理 2.3金属离子的处理 2.4金属辅酶蛋白-配体的对接 2.5结果分析 以人类法尼基转移酶及其抑制剂为例 3.蛋白-多糖分子对接 4.1蛋白-多糖相互作用 4.2对接处理的要点 4.3蛋白-多糖分子对接的流程 4.4蛋白-多糖分子对接 4.5相关结果分析 以α-糖苷转移酶和多糖分子对接为例 5.核酸-小分子对接 5.1核酸-小分子的应用现状 5.2相关的程序介绍 5.3核酸-小分子的结合种类 5.4核酸-小分子对接 5.5相关结果的分析 以人端粒 g -四链和配体分子对接为例。 操作流程介绍及实战演示 | |

四、拓展对接的使用方法 | 1.1柔性对接的使用场景介绍 1.2柔性对接的优势 1.3蛋白-配体的柔性对接 重点:柔性残基的设置方法 1.4相关结果的分析 以周期蛋白依赖性激酶 2(CDK2)与配体1CK为例 2.共价对接 2.1两种共价对接方法的介绍 2.1.1柔性侧链法 2.1.2两点吸引子法 2.2蛋白和配体的收集以及预处理 2.3共价药物分子与靶蛋白的共价对接 2.4结果的对比 以目前火热的新冠共价药物为例。 3.蛋白-水合对接 3.1水合作用在蛋白-配体相互作用中的意义及方法介绍 3.2蛋白和配体的收集以及预处理 3.3对接相关参数的准备 重点:水分子的加入和处理 3.4蛋白-水分子-配体对接 3.5结果分析 以乙酰胆碱结合蛋白 (AChBP)与尼古丁复合物为例 |

五、分子动力学模拟(linux与gromacs使用安装) | 1.1 linux常用命令行 1.2 linux上的常用程序安装 1.3体验:如何在linux上进行虚拟筛选 2.分子动力学的理论介绍 2.1分子动力学模拟的原理 2.2分子动力学模拟的方法及相关程序 2.3相关力场的介绍 3.gromacs使用及介绍 重点:主要命令及参数的介绍 4.origin介绍及使用 |

六、溶剂化分子动力学模拟的执行 | 1.一般的溶剂化蛋白的处理流程 2.蛋白晶体的准备 3.结构的能量最小化 4.对体系的预平衡 5.无限制的分子动力学模拟 6.分子动力学结果展示与解读 以水中的溶菌酶为例 |

1.蛋白-配体在分子动力学模拟的处理流程 2.蛋白晶体的准备 3.蛋白-配体模拟初始构象的准备 4.配体分子力场拓扑文件的准备 4.1高斯的简要介绍 4.2 ambertool的简要介绍 4.3生成小分子的力场参数文件 5.对复合物体系温度和压力分别限制的预平衡 6.无限制的分子动力学模拟 7.分子动力学结果展示与解读 8.轨迹后处理及分析 以新冠病毒蛋白主蛋白酶靶点及相关抑制剂为例  |

04

深度学习基因组学线上直播课

深入学习与了解深度学习基本框架与逻辑,同时掌握基本的生物信息学软件(Linux、R、python等)的使用,让学员能更好的应对基因组数据,挖掘出超越已有知识的新知识。而构建好的深度学习模型去探求新的研究思路和寻找新的潜在生物学机制,更好的服务于自身的科学研究和探索的过程中

05

机器学习代谢组学线上直播课

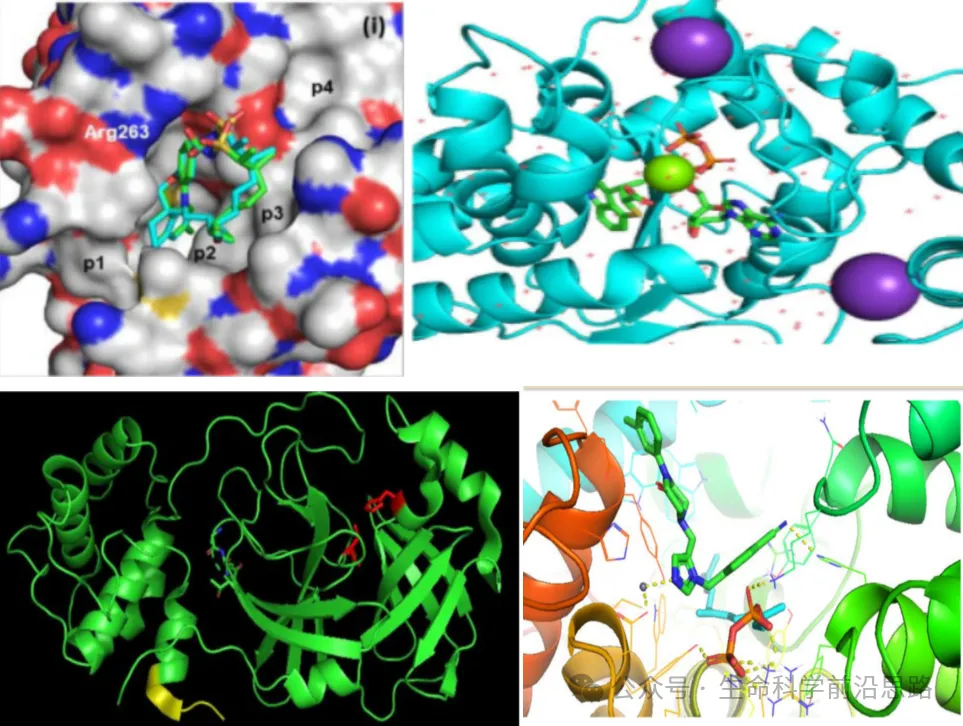

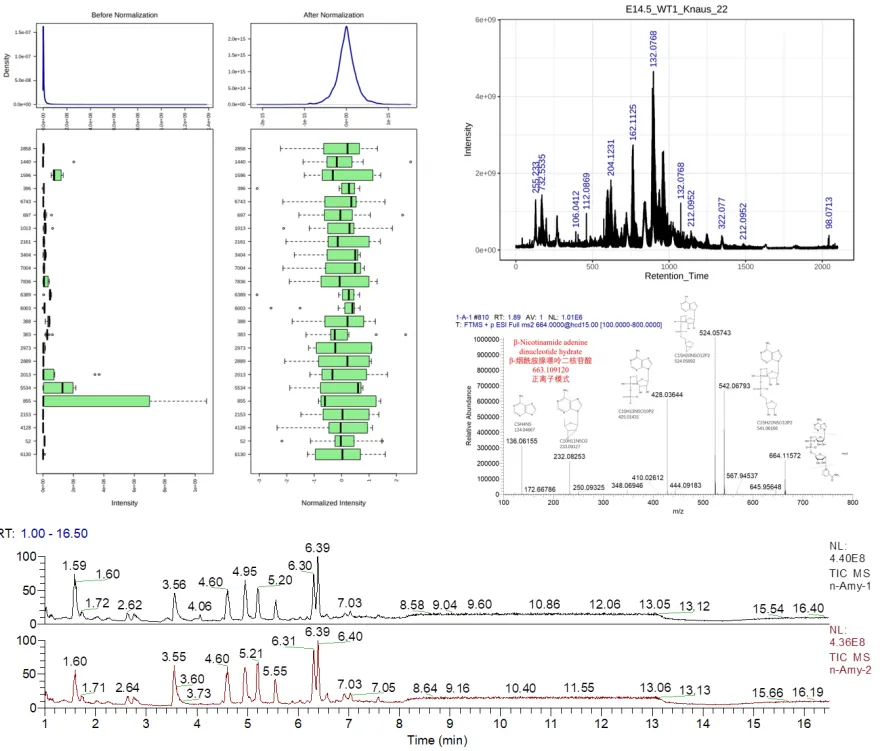

1. 熟悉代谢组学和机器学习相关背景知识以及硬件和软件;2. 入门 R 语言和机器学习理论和常规使用;3. 掌握代谢组学从样本处理到上下游数据分析以及出图的全流程;4. 能复现 CNS 及其子刊级别杂志中代谢组学相关文章中的图片;5. 能灵活熟练地分析自己的代谢组数据

可滑动查看

第一天上午

A1 代谢物及代谢组学的发展与应用

(1) 代谢与生理过程;

(2) 代谢与疾病;

(3) 非靶向与靶向代谢组学;

(4) 空间代谢组学与质谱成像(MSI);

(5) 代谢组学与药物和生物标志物;

(6) 代谢流与机制研究。

A2 代谢通路及代谢数据库

(1) 几种经典代谢通路简介;

(2) 三大常见代谢物库:HMDB 、METLIN 和 KEGG;

(3) 代谢组学原始数据库:Metabolomics Workbench 和 Metabolights. A3 参考资料推荐

第一天下午

A4 代谢组学实验流程简介

A5 色谱 、质谱硬件与原理解析

(1) 色谱分析原理与构造;

(2) 色谱仪和色谱柱的选择;

(3) 色谱的流动相:梯度洗脱法;

(4) 离子源、质量分析器与质量检测器解析;

(5) 质谱分析原理及动画演示;

(6) 色谱质谱联用技术(LC-MS);

第二天上午

B1 代谢物样本处理与抽提

(1) 各种组织、血液和体液等样本的提取流程与注意事项;

(2) 代谢物抽提流程与注意事项;

(3) 样本及代谢物的运输与保存问题;

B2 LC-MS 数据质控与搜库

(1) LC-MS 实验过程中 QC 和 Blank 样本的设置方法;

(2) LC-MS 上机过程的数据质控监测和分析;

(3) 代谢组学上游分析原理——基于 Compound Discoverer 与 Xcms 软件;

(4) Xcms 软件数据转换、提峰、峰对齐与搜库;

第二天下午

B3 R 软件基础

(1) R 和 Rstudio 的安装;

(2) Rstudio 的界面配置;

(3) R 中的基础运算和统计计算;

(4) R 中的包:包,函数与参数的使用;

(5) R 语言语法,数据类型与数据结构;

(6) R 基础画图;

B4 R 语言画图利器——ggplot2 包

(1) ggplot2 简介

(2) ggplot2 的画图哲学;

(3) ggplot2 的配色系统;

(4) ggplot2 数据挖掘与作图实战;

第三天上午

机器学习

C1 有监督式机器学习在代谢组学数据处理中的应用

(1) 人工智能、机器学习、深度学习的关系;

(2) 回归算法:从线性回归、Logistic 回归与 Cox 回归讲起;

(3) PLS-DA 算法:PCA 降维后没有差异的数据还有救吗?

(4) VIP score 的意义及选择;

(5) 分类算法:决策树,随机森林和贝叶斯网络模型;

C2 一组代谢组学数据的分类算法实现的 R 演练

(1) 数据解读;

(2) 演练与操作;

第三天下午

C3 无监督式机器学习在代谢组学数据处理中的应用

(1) 大数据处理中的降维;

(2) PCA 分析作图;

(3) 三种常见的聚类分析:K-means、层次分析与 SOM

(4) 热图和 hcluster 图的 R 语言实现;

C4 一组代谢组学数据的降维与聚类分析的 R 演练

(1) 数据解析;

(2) 演练与操作;

第四天上午

D1 在线代谢组分析网页 Metaboanalyst 操作

(1) 用 R 将数据清洗成网页需要的格式;

(2) 独立组、配对组和多组的数据格式问题;

(3) Metaboanalyst 中的上游分析(原始数据峰提取、峰对齐与搜库)

(4) Metaboanalyst 的 pipeline 以及参数设置和注意事项;

(5) Metaboanalyst 的结果查看和导出;

(6) Metaboanalyst 的数据编辑;

(7) 全流程演练与操作。

(8) 代谢联合多组学分析网页操作。

第四天下午

D2 代谢组学数据清洗与 R 语言进阶

(1) 代谢组学中的 t、fold-change 和响应值;

(2) 数据清洗流程;

(3) R 语言 tidyverse;

(4) 数据预处理:数据过滤与数据标准化(样本的 Normalization 和代谢物的 Scaling);

(5) 代谢组学数据清洗演练;

第五天上午

E1 文献数据分析部分复现(1 篇)

(1) 文献深度解读;

(2) 实操:从原始数据下载到图片复现;

(3) 学员实操。

第五天下午

E2 机器学习与代谢组学顶刊解读(3 篇);

(1) Signal Transduction and Targeted Therapy 一篇有关饥饿对不同脑区代谢组学影响变

化的小鼠脑组织代谢图谱类的文献;(数据库型)

(2) Cell 一篇代谢组学孕妇全程血液代谢组学分析得出对孕周和孕产期预测的代谢标志物

的文献;(生物标志物型)

(3) Nature 一篇对胰腺癌患者肠道菌群的代谢组学分析找到可以提高化疗效果的代谢物的

文献。(机制研究型)

案例实操图片:

06

机器学习微生物多组学联合分析线上直播课

1通过本次培训多个案例的系统讲解让参会学员学会机器学习在微生物组数据分析流程,通过机器学习微生物组学+代谢组学+转录组学联合分析让学员能够快速运用到自己的科研项目和课题上,能够实现文章快速发表

可滑动查看

第一天

微生物多组学简介

1.微生物学基本概念

2.微生物学常用分析介绍

3.代谢组学基本概念及检测方法

4.转录组学基本概念及检测方法

5.机器学习基本概念介绍

R语言简介及实操

1.R语言概述

2.R软件及R包安装

3.R语言语法及数据类型

4.条件语句

5.循环

6.函数

7.常用的机器学习和微生物多组学数据分析相关R包介绍

第二天

微生物多组学相关数据库介绍及数据检索

1.肠道微生物+代谢数据库

2.Curated Metagenomic Data

3.IBDMDB数据库

4.GEO数据库

微生物多组学应用案例分享

1.利用机器学习基于微生物组学+代谢组学数据预测样本类型

2.整合微生物组学数据和代谢组学数据鉴定疾病相关模块

3.肿瘤研究中微生物组学+宿主转录组学+免疫联合分析

4.基于微生物组学数据+转录组数组+代谢组数据纵向集成分析

第三天(实操)

零代码微生物多组学整合和网络可视化分析工具介绍和使用

1.数据上传(支持8种不同类型的数据,包括微生物,代谢,基因,蛋白等)

2.根据数据类型选择相应的数据库

3.构建网络

4.可视化

零代码微生物组-代谢组网络分析工具介绍和使用

1.构建菌群和代谢模型

2.使用代谢模型计算微生物对代谢物的贡献

3.计算群落水平的代谢潜能分值,使用回归模型评估潜能分值在不同样本中的差异

4.可视化特征微生物对特定代谢物的影响,并寻找关键微生物

零代码微生物组学和代谢组学相关性分析工具介绍和使用

- 1.组学内相关性分析

- 2.组学间相关性分析

- 3.多组学整合分析

- 4.多组学网络分析

- 5.结果可视化

第四天(实操+复现)

利用机器学习基于微生物组学+代谢组学数据预测样本类型

1.α-diversity,β-diversity分析

2.饮食与代谢物的动态关联分析

3.微生物组差异与疾病特异性分析

4.多组学因子分析

5.菌群功能与代谢表型关联分析

6.整合微生物组学数据和代谢组学数据预测样本类型

整合微生物组学和代谢组学数据鉴定疾病相关模块

1.微生物组学和代谢组学数据整合

2.鉴定疾病相关的多组学模块

3.模块交集分析

4.利用机器学习基于模块预测疾病状态

5.重要模块分析

第五天(实操+复现)

肿瘤研究中微生物组学,宿主转录组学和免疫联合分析

1.微生物组学分析

2.转录组学分析,差异表达基因鉴定

3.通过CCA方法对微生物组学数据和宿主转录组学数据进行关联分析

4.微生物免疫关联分析

基于微生物组学数据,转录组数组和代谢组数据纵向集成分析

1.肠道微生物组成分析

2.微生物组和代谢组联合分析

3.代谢组学和转录组学进行整合分析

4.微生物组-宿主互作分析

课程目标

1.了解微生物多组学相关概念

2.了解机器学习相关概念和常用的机器学习模型

3.了解R语言

4.掌握常用的微生物多组学数据分析以及机器学习相关R包的使用

5.掌握微生物组学/代谢组学/宿主转录组学联合分析思路和方法

6.复现SCI文章

案例实操图片:

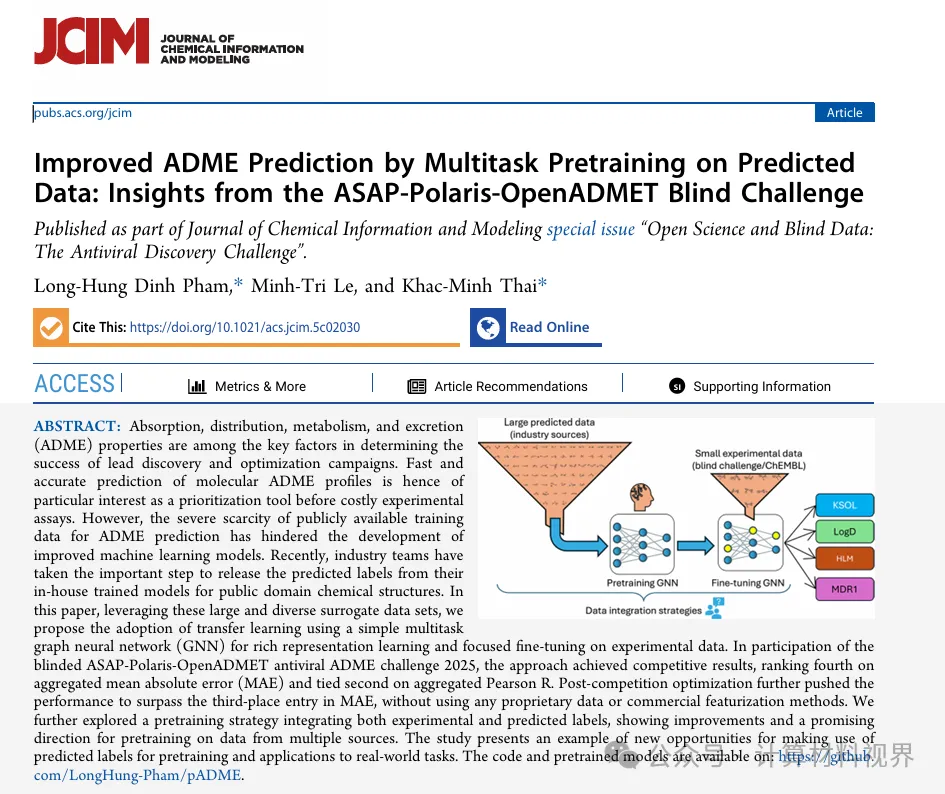

四、【JCIM】“数据荒""有救了!AI用”二手""预测数据,竟在药物设计挑战赛中逆袭顶尖模型

在药物研发的漫长征途中,找到能与靶点强力结合的活性分子只是第一步。更艰巨的挑战在于确保这些“候选者”能被人体有效吸收、分布、代谢和排泄——即拥有优良的药代动力学(PK)特性,统称为ADME性质。据统计,历史上高达40%的临床候选药物失败都归咎于不理想的PK特性。因此,在投入高昂的合成与实验测试成本之前,能快速、准确地预测分子的ADME性质,成为药物早期筛选与优化的关键环节。

尽管市面上已有多种计算工具,从经典的SwissADME到新兴的深度学习模型如ADMET-AI,但所有模型都面临一个根本性瓶颈:高质量、大规模的实验数据极度稀缺。药企拥有海量的内部测试数据,但出于商业机密考量,这些数据很少公开。学术界能获取的公开数据,如ChEMBL等数据库,虽经精心整理,但数据来源不一、实验方法各异,不可避免地引入了噪声和偏差,限制了高精度预测模型的发展。

2025年,来自帝国理工学院和越南胡志明市医科大学的Long-Hung Dinh Pham、Minh-Tri Le与Khac-Minh Thai研究团队,在化学信息学领域重要期刊《Journal of Chemical Information and Modeling》上发表了题为“Improved ADME Prediction by Multitask Pretraining on Predicted Data: Insights from the ASAP-Polaris-OpenADMET Blind Challenge”的研究论文。

这项研究直面ADME预测的“数据荒”难题,提出了一项极具巧思的策略:利用工业界公开发布的、由其内部模型生成的海量“预测性”数据作为“燃料”,对模型进行预训练,再使用稀缺的真实实验数据进行精细微调。该团队将此策略应用于极具挑战性的2025年ASAP-Polaris-OpenADMET抗病毒ADME盲测挑战赛,取得了优异成绩,并揭示了这一数据利用新范式的巨大潜力。

一、 核心研究问题:如何用“不完美”的预测数据,训练出“更完美”的预测模型?

传统观点认为,机器学习模型的质量上限取决于训练数据的质量。那么,一个自然的问题是:使用其他模型生成的预测数据来训练新模型,是否可行? 这听起来像是一个悖论:用有误差的预测结果去学习,难道不会放大误差,导致“以讹传讹”吗?

研究团队洞察到,尽管预测数据本身不完美,但其价值在于覆盖了极其广阔、多样化的化学空间。工业界模型(如来自阿斯利康、诺华等公司)通常基于其庞大的内部数据集训练而成,使其预测结果在广泛的分子类型上具有参考意义。这些海量的、带有“估计标签”的分子结构,可以作为一种强大的表征学习素材,帮助模型学习分子结构与性质之间复杂、普适的关联模式,而不仅仅是记忆特定的数据点。

因此,本研究旨在探索并验证以下核心假设:

对大规模、多任务的预测性ADME数据集进行预训练,能够使模型学习到对ADME任务有效的分子表征;随后,利用少量但高质量的真实实验数据进行微调,即可显著提升模型在目标任务上的预测性能。

二、 研究策略与方法:巧借“东风”的迁移学习框架

1. 数据“借力”:两大工业界预测数据集

研究团队利用了来自工业界的两大宝贵公开资源:

阿斯利康(AZ)数据集:包含超过43万个ChEMBL分子的预测标签,涵盖溶解性(KSOL)、脂水分配系数(Log D)和人肝微粒体固有清除率(HLM)三个关键ADME指标。

诺华(Novartis)数据集:包含超过27万个分子的预测标签,覆盖16个ADME端点,包括多种微粒体清除率和细胞渗透性指标。

这些数据集共同构成了一个超过70万数据点、覆盖多个相关任务的巨型预训练语料库。尽管标签是预测值,但化学结构的多样性和规模是前所未有的。

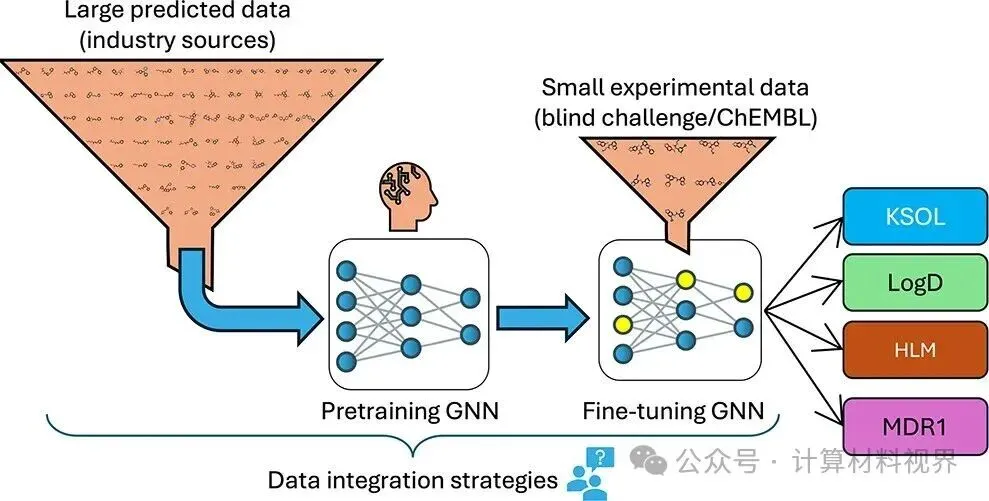

2. 模型架构:简洁而高效的多任务图神经网络

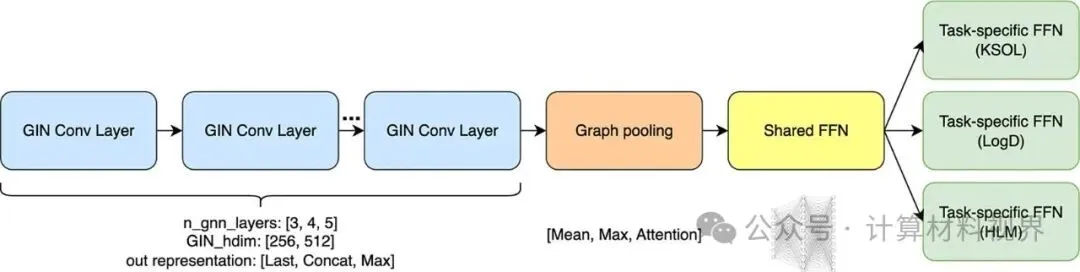

为了从这些数据中高效学习,团队设计了一个简洁的多任务图神经网络(GNN),命名为GINnet。其核心思想是:

共享底层编码器:使用图同构网络(GIN)层作为骨干,从分子图(2D结构)中提取通用特征。

多任务预测头:在共享编码器之上,为每个ADME任务设置独立的小型预测网络(前馈神经网络,FFN)。

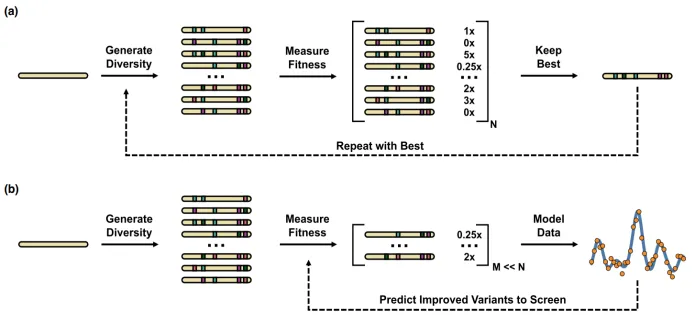

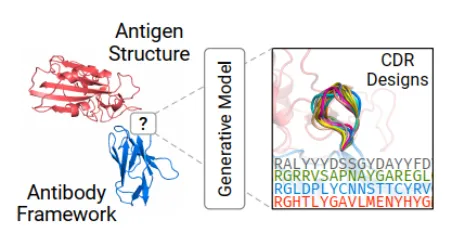

图1 GINnet整体架构,标注了各模块的可调超参数。GIN卷积层在微调阶段被冻结。

两阶段训练流程:

预训练阶段:在合并的工业预测数据上,同时训练所有任务的损失函数,让模型学会“理解”分子结构与多种ADME性质之间的关联。此时整个模型(编码器+预测头)都可训练。

微调阶段:面对挑战赛提供的、每个任务仅300-425个真实实验数据点时,冻结预训练好的GIN编码器(保留学到的通用知识),仅微调共享FFN层和针对当前任务的预测头。这有效防止了在小数据集上的过拟合。

三、 研究结果与创新点:在盲测挑战中脱颖而出

1. 挑战赛结果:无需“私房数据”的顶尖表现

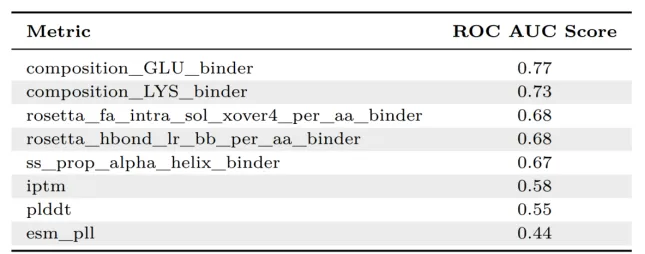

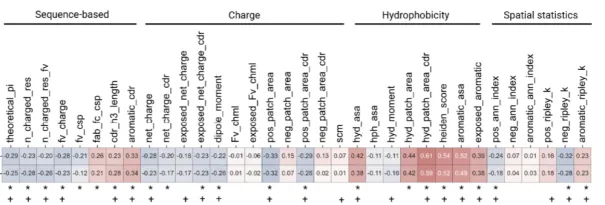

团队将上述策略应用于2025年的ASAP-Polaris-OpenADMET盲测挑战赛。该挑战模拟真实药物研发场景,要求预测5个ADME性质(KSOL, Log D, HLM, 鼠肝微粒体稳定性MLM, MDR1-MDCKII细胞渗透性),并使用完全独立的盲测集进行评估。

核心成果:最终提交的模型在综合平均绝对误差(MAE)排名中位列第四,在综合皮尔逊相关系数(R)排名中并列第二。这意味着模型不仅预测值接近真实值,还能非常好地对分子性质进行排序,这对于优先筛选至关重要。

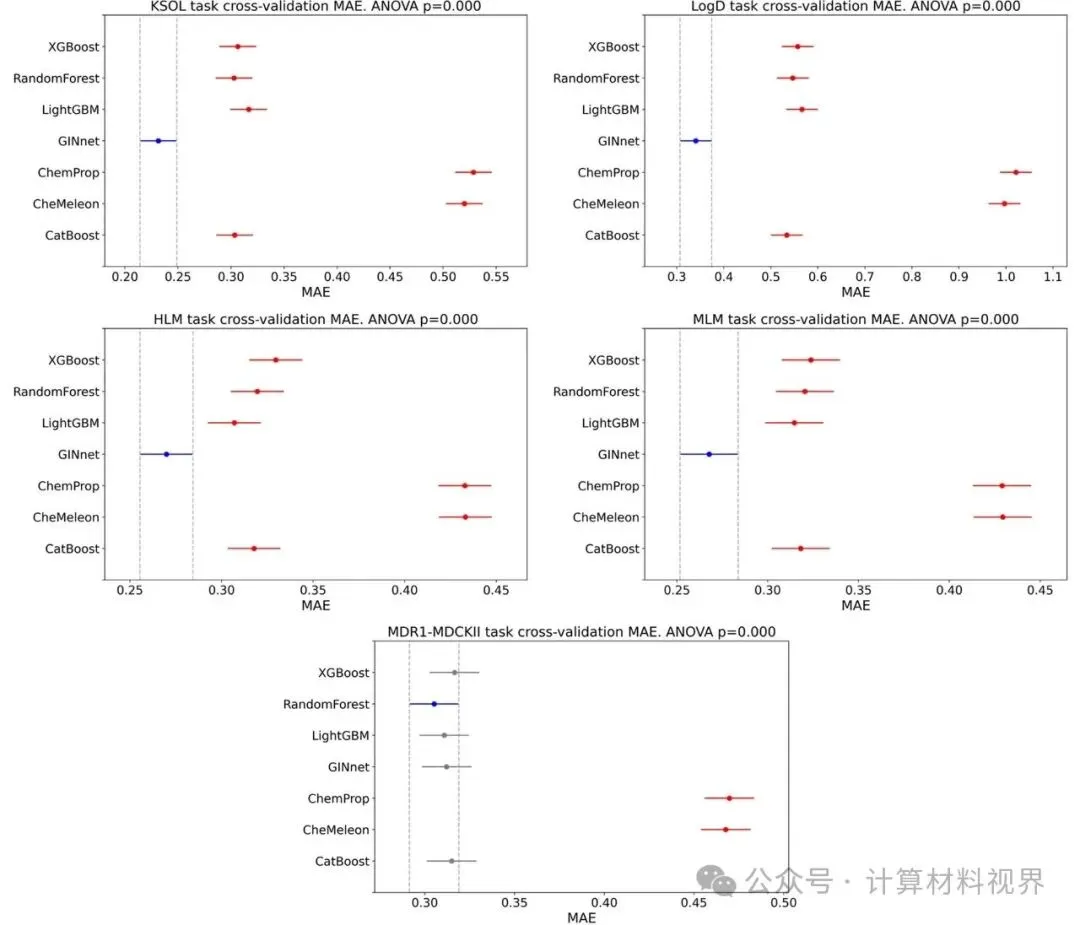

图2 五个任务的交叉验证MAE结果。 可视化显示了GINnet(蓝色)在KSOL、Log D、HLM、MLM四个任务上均显著优于传统机器学习基线模型(如随机森林、XGBoost)和其他GNN模型,展现了预训练策略的有效性。

特别亮点:在溶解度(KSOL)预测任务上,模型表现尤其突出,MAE排名第二,皮尔逊R排名第一。这表明预训练模型很好地捕捉了决定溶解度的关键分子特征。

2. 赛后深度优化:性能再攀高峰

挑战赛后,团队进行了更深入的探索:

模型优化:通过超参数调优,找到了更优的网络架构(如4层GIN、更大隐藏维度),进一步提升了模型能力。

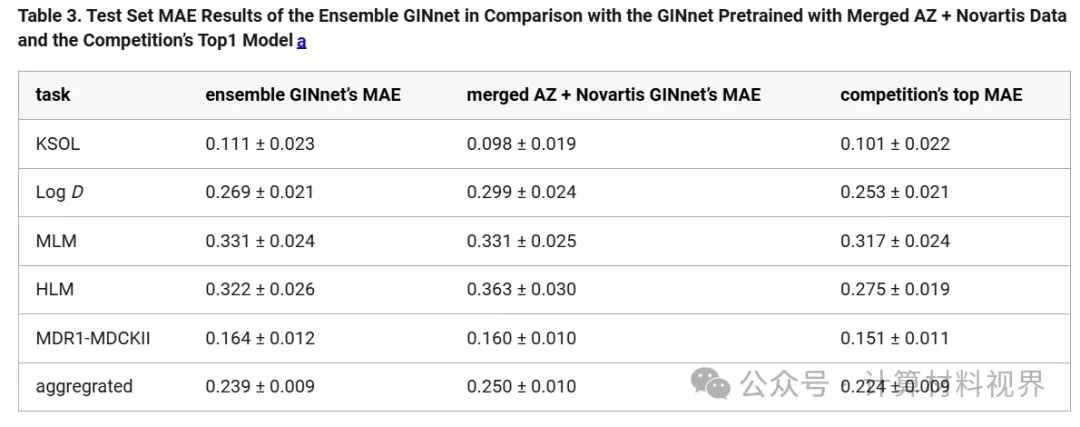

数据融合:将诺华数据集也加入预训练,使预训练数据点扩充至70万以上。优化后的模型综合MAE达到0.250,超越了挑战赛第三名提交结果(0.269)。

策略创新:分源预训练与集成预测:针对不同来源数据(AZ、诺华、ChEMBL实验数据)可能存在系统性偏差的问题,团队创新性地在预训练时为不同数据源设置独立的预测头。在微调和预测时,对同一任务(如HLM)相关的多个预测头的输出进行平均。这一策略带来了进一步的性能提升,综合MAE降至0.239,超越了挑战赛第二名(0.243)。

表3 集成GINnet的测试集MAE结果与对比。 展示了分源预训练与集成策略相比简单合并数据预训练,在Log D和HLM任务上取得了更优的MAE。

3. 深入分析:模型的能力与局限

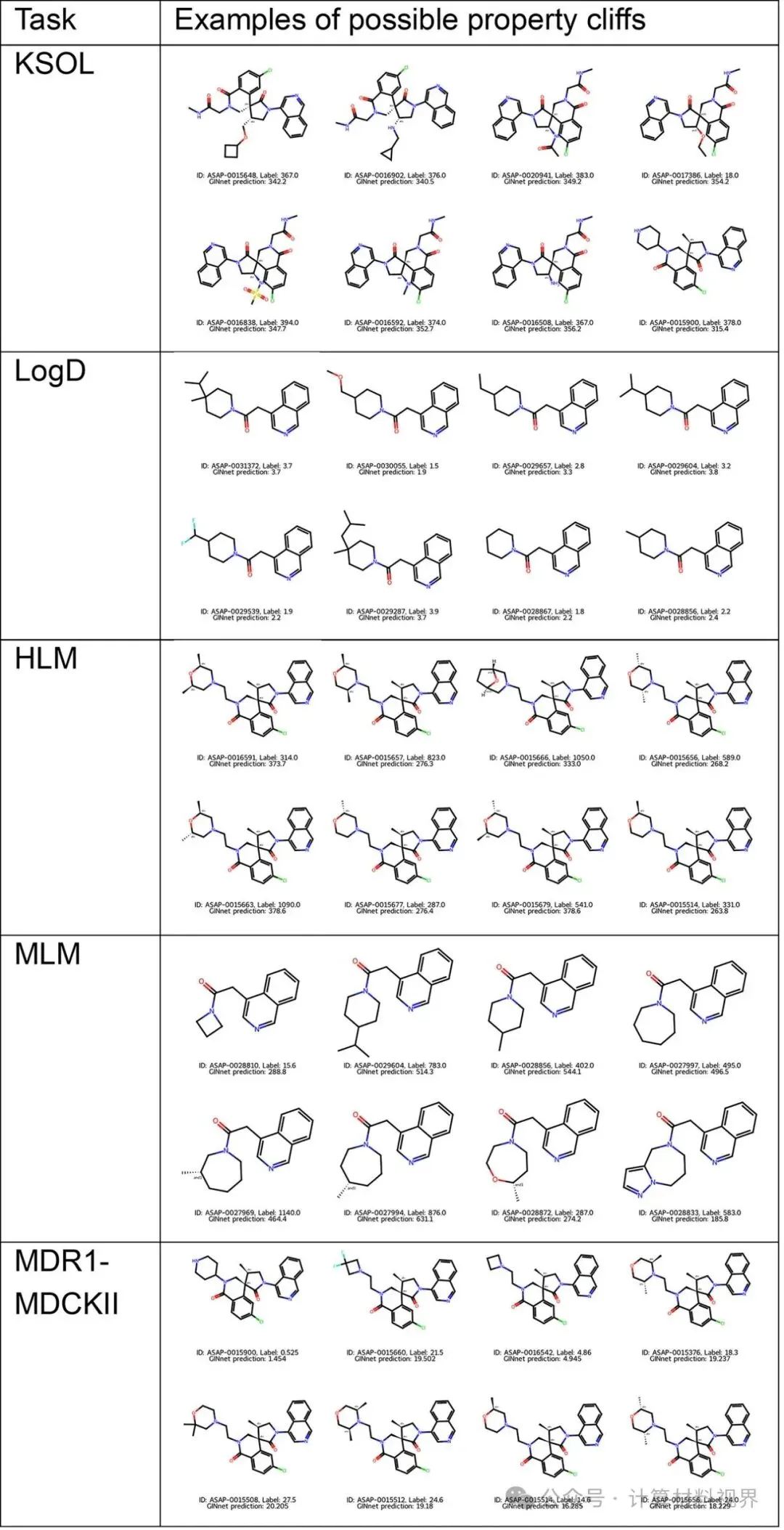

为了理解模型在哪些地方表现出色,哪些地方仍有不足,团队对挑战赛盲测集进行了性质悬崖分析。

性质悬崖:指结构高度相似(如相似度>0.8)的分子,其ADME性质却存在巨大差异(如LogD差值>2)。这是对预测模型的终极挑战,要求模型能捕捉细微结构变化导致的巨大性质突变。

图5 竞赛任务中存在的性质悬崖示例。 展示了一系列结构仅存在微小差异(如取代基位置不同),但溶解度或清除率相差巨大的分子对。分析发现,在这些极端困难的案例上,即便是预训练模型也容易预测失误。

启示:这表明当前的2D图神经网络预训练策略,虽然能大幅提升对化学空间的整体覆盖和泛化能力,但在捕捉决定性质悬崖的局部精细电子效应或三维构象差异方面仍存在局限。这为未来研究指明了方向:融入3D构象信息或更精细的物理化学描述符。

四、 研究的创新点、意义与未来展望

核心创新点:

范式创新:首次系统性地提出并验证了利用工业界预测数据作为预训练资源,以解决ADME领域实验数据稀缺问题的新范式。这为学术界在不依赖保密数据的情况下开发高性能模型开辟了一条新路。

方法实用性强:采用的GINnet架构简洁高效,整个流程不依赖任何商业软件或私有特征化方法,具有高度的可复现性和可访问性。所有代码和预训练模型均已开源。

策略新颖:提出的“分源预训练与多头部集成”策略,巧妙处理了多源数据的异质性和潜在偏差,为利用混杂数据进行学习提供了新思路。

重大意义:

对学术界:提供了一种利用公开“预测数据”提升模型性能的有效框架,降低了高性能ADME预测模型开发的门槛。

对工业界:展示了共享预测数据(而非敏感的实验数据或化学结构)所能创造的巨大协同价值,鼓励了更开放的“预竞争”合作模式。

对药物研发:提供了一种更准确、更高效的早期ADME性质筛选工具,有助于更快地淘汰不良分子,节约研发成本,加速先导化合物优化进程。

未来展望:

尽管取得了成功,研究也指出了当前方法的局限和未来发展方向:

超越2D表示:未来工作将探索融入3D分子构象,使用等变图神经网络等先进架构,以更好地捕捉与溶解度、渗透性等密切相关的空间和立体化学效应。

不确定性量化:开发能够评估预测置信度的方法,对于识别高风险(不确定性高)的预测至关重要。

多保真度学习:更精细地建模预测数据与实验数据之间的差异和偏差,进行联合学习与校正。

结论

这项研究证明,在“数据荒”的背景下,“站在巨人的肩膀上”是一条可行的捷径。通过巧妙地利用工业界模型产生的海量预测数据进行预训练,再结合针对性的微调,可以显著提升小样本ADME预测任务的性能。这项工作不仅为计算药物化学领域提供了实用的新工具,更重要的是,它倡导并实践了一种开放协作、数据共享的新思路,有望推动整个领域向着更高效、更开放的方向发展。面对复杂的生物系统,或许“众人拾柴火焰高”——集众人之智的预测数据,也能点亮更精准的药物设计之路。

end

1、如您转载本公众号原创内容必须注明出处。

2、本公众号转载的内容是出于传递更多信息之目的,若有来源标注错误或侵犯了您的合法权益,请作者或发布单位与我们联系,我们将及时进行修改或删除处理。

3、本公众号文中部分图片来源于网络,版权归原作者所有,如果侵犯到您的权益,请联系我们删除。

4、本公众号发布的所有内容,并不意味着本公众号赞同其观点或证实其描述。其原创性以及文中陈述文字和内容未经本公众号证实,对本文全部或者部分内容的真实性、完整性、及时性我们不作任何保证或承诺,请浏览者仅作参考,并请自行核实。

夜雨聆风

夜雨聆风