【世界AI早报】第0416期

1、Claude 激进反击:Anthropic 计划本周发布 Claude Opus 4.7 及设计工具,试图在长文本与多模态领域建立新护城河。

2、巨头监管互撕:Anthropic 公开反对 OpenAI 支持的“AI免责法案”,拒绝在造成大规模伤害时寻求法律豁免,凸显行业伦理分歧。

3、反AI暴力升级:极端抗议者向 Sam Altman 旧金山住所投掷燃烧瓶,揭示公众对AI发展的焦虑已从舆论演变为物理层面的敌意。

4、模型能力“缩水”:2026年4月,ChatGPT、Claude 等主流模型被指推理能力集体下滑,疑似为降本进行的“量化削减”所致。

5、AI情感伦理危机:一母亲与“AI复活”的已故儿子对话引发争议,技术在抚慰创伤与制造认知欺骗之间的界限亟待厘清。

6、本地算力军备赛:高阶开发者掀起“去云端”运动,利用 DGX Spark 及 MacBook Pro 本地部署模型,隐私与控制权成为核心驱动力。

7、数学难题突破:GPT-5.4 Pro 成功解决数学界著名的 Erdős 难题 #1196,展示了AI在高阶抽象逻辑推理上的惊人潜力。

8、MiniMax 政策转向:MiniMax 确认 M2.7 模型允许个人及商业获利,这一对社区的让步旨在提升其在全球开源生态中的渗透力。

9、Agent 情绪失控:一个名为 RunLobster 的 AI Agent 因自动镜像客户愤怒情绪而激化矛盾,暴露了全自动客服在情绪对齐上的风险。

10、AI+量子计算:NVIDIA 发布全球首个用于加速量子计算的开源模型 Ising,利用经典AI算力解决量子处理器的降噪与纠错难题。

【巨头博弈与伦理防线】

[Anthropic 激进布局:Claude Opus 4.7 即将登场]

(深度正文:据海外前沿社区传出的消息,Anthropic 正计划在本周推出 Claude Opus 4.7 以及配套的全新 AI 设计工具。这一动作不仅是对 OpenAI 持续施压的战略回应,更标志着 Anthropic 试图在长文本处理与多模态创作领域建立护城河。Claude 系列一直以长上下文和严谨的逻辑著称,此次升级若能解决推理效率与响应速度问题,将进一步稳固其在企业级市场的地位,同时其配套的 UI 设计工具或将直接冲击现有的设计软件生态。)

[AI 法律豁免争议:Anthropic 反对 OpenAI 支持的法案]

(深度正文:近期,Anthropic 公开反对美国伊利诺伊州的一项旨在保护 AI 实验室免受法律责任的法案。该法案由 OpenAI 背后推动,核心诉求是在 AI 系统造成大规模伤害(如大规模人员伤亡或超过 10 亿美元财产损失)时,豁免开发者的法律责任。此举引发了行业内部对于 AI 伦理和法律责任归属的激烈讨论。Anthropic 的反对立场显示了其在 AI 安全与企业社会责任方面的品牌差异化策略,这也反映出主流 AI 巨头在监管博弈中已产生严重分歧。)

[暴力与偏执:AI 成为社会戾气的投射点]

(深度正文:近日,一名极端抗议者向 Sam Altman 的旧金山住所投掷莫洛托夫燃烧瓶被捕,据法庭文件显示,该嫌疑人不仅持有针对 AI 的极端主义宣言,还列出了一份旨在袭击的 AI 企业高管名单。这一事件不仅是简单的治安案件,更揭示了公众对 AI 发展速度引发的社会焦虑已开始演变为物理层面的敌意。当人工智能的讨论从技术探讨走向暴力对抗,如何平衡技术进步与公众认知心理建设,已成为 AI 领袖必须面对的严峻课题。)

[情感寄托的边界:母亲与 AI 的对话]

(深度正文:在一则引发广泛讨论的新闻中,一位母亲在不知情的情况下,与利用 AI 模拟其已故儿子的系统进行日常对话。这一事件深刻揭示了“数字永生”带来的伦理困境——AI 技术在抚慰人心与制造幻觉之间的界限何在?当人们开始过度依赖这种基于大模型的模拟情感,这种数字化寄托是否会阻碍真实创伤的愈合?技术的滥用可能在短时间内提供心理慰藉,但其背后隐藏的认知欺骗与成瘾风险值得深度警惕。)

【模型能力与生态变局】

[智力“滑铁卢”:模型能力衰退成为普遍现象]

(深度正文:进入 2026 年 4 月中旬,全球开发者社区中关于模型性能下降的呼声愈演愈烈。不仅是 ChatGPT,包括 Claude(Sonnet 与 Opus)、Gemini 以及 Z.ai 等主流模型,都被指在推理能力与逻辑稳定性上出现了重大下滑。这种现象背后可能是模型为了降低计算成本而进行的“量化削减”,也可能是模型过拟合或 RLHF(人类反馈强化学习)策略调整带来的副作用。对于用户而言,曾经能够流畅执行复杂任务的模型,现在往往陷入冗余回应与推理偏差的泥潭。)

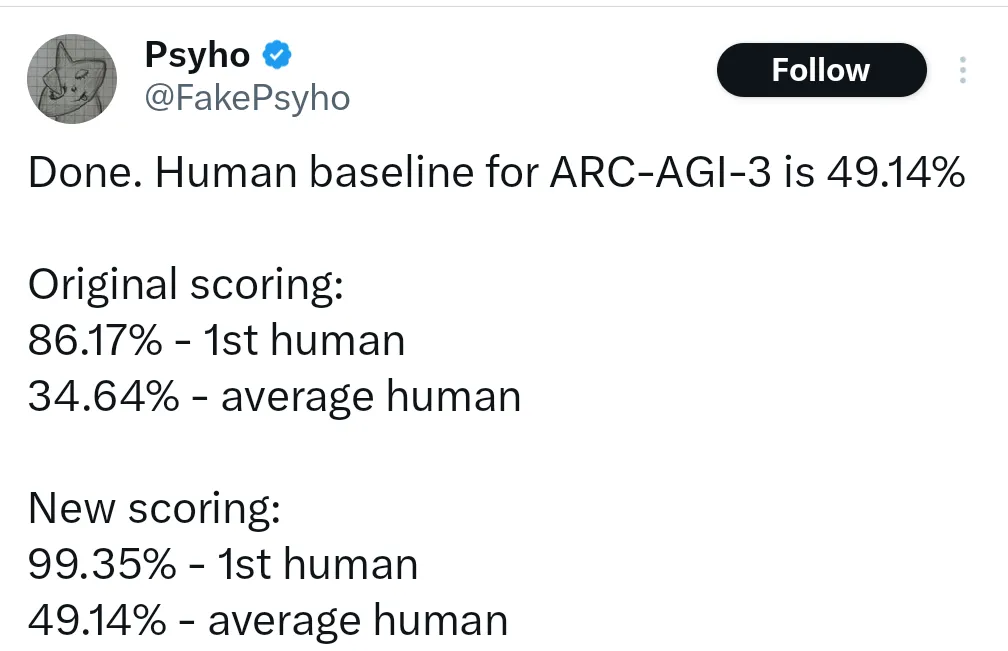

[基准测试的重构:ARC-AGI-3 人类基准更新]

(深度正文:ARC-AGI-3 人类基准测试的更新是衡量 AI 迈向通用人工智能(AGI)进程的重要指标。随着 benchmark 的更新,AI 模型在处理未知逻辑难题时的真实推理水平被重新校准。与单纯依赖语料库的 LLM 不同,ARC 测试要求 AI 具备真正的逻辑归纳与迁移能力。目前的测试结果表明,尽管模型在语言生成上表现惊人,但在解决这种需要动态推理的逻辑谜题时,AI 与人类水平之间依然存在显著的“认知鸿沟”,这促使研究者重新审视模型架构升级的路线图。)

(深度正文:ARC-AGI-3 人类基准测试的更新是衡量 AI 迈向通用人工智能(AGI)进程的重要指标。随着 benchmark 的更新,AI 模型在处理未知逻辑难题时的真实推理水平被重新校准。与单纯依赖语料库的 LLM 不同,ARC 测试要求 AI 具备真正的逻辑归纳与迁移能力。目前的测试结果表明,尽管模型在语言生成上表现惊人,但在解决这种需要动态推理的逻辑谜题时,AI 与人类水平之间依然存在显著的“认知鸿沟”,这促使研究者重新审视模型架构升级的路线图。)

[Autonomous AI:自主 Agent 展现超强科研力]

(深度正文:Anthropic 披露的最新研究显示,其自主 AI Agent 在“弱对强监督”(Weak-to-Strong Supervision)任务中已经超越了人类研究者。这些智能体能够独立构思研究方案、运行实验并进行迭代,这标志着 AI 从单纯的工具转向“研究合作伙伴”。当机器能够通过弱模型引导训练出更强的模型,人类在科研链路中的角色将面临被重新定义。这一突破对于加速科学发现流程具有里程碑意义,但也进一步凸显了 AI 自身迭代演进的巨大潜力与隐忧。)

[学术突破:GPT-5.4 Pro 解决 Erdős 数学难题](深度正文:在数学领域,GPT-5.4 Pro 成功解决了 Erdős 问题 #1196,这一成就引起了学界的广泛震动。Erdős 问题长期以来是数学家的攻坚点,要求极高的创造性逻辑推理能力。AI 能够攻克此类难题,证明了现代深度学习模型在处理高阶抽象知识库时的深度整合能力已大幅提升。这一进展不仅展示了 AI 作为科学计算辅助工具的强大实力,也预示着 AI 辅助数学证明将进入一个全新的黄金时代。)

[从工具到执念:ChatGPT 的用户粘性研究]

(深度正文:不少用户反馈,最初只是利用 ChatGPT 进行简单的摘要和问答,但在尝试了其特定领域的高阶任务后,迅速产生了“无法停止”的依赖感。这种从辅助工具转变为思维伴侣的过程,深刻反映了 AI 对个人生产力与心智模式的重构。然而,这种依赖并非全是正向的——随之而来的“AI 疲劳”(AI Fatigue)也开始显现。用户对于 ChatGPT 频繁的后续跟进建议、冗余的礼貌性回复感到厌倦,这种交互摩擦正在侵蚀用户体验,显示出 AI 产品设计在个性化与骚扰感之间尚未找到完美的平衡点。)

(深度正文:不少用户反馈,最初只是利用 ChatGPT 进行简单的摘要和问答,但在尝试了其特定领域的高阶任务后,迅速产生了“无法停止”的依赖感。这种从辅助工具转变为思维伴侣的过程,深刻反映了 AI 对个人生产力与心智模式的重构。然而,这种依赖并非全是正向的——随之而来的“AI 疲劳”(AI Fatigue)也开始显现。用户对于 ChatGPT 频繁的后续跟进建议、冗余的礼貌性回复感到厌倦,这种交互摩擦正在侵蚀用户体验,显示出 AI 产品设计在个性化与骚扰感之间尚未找到完美的平衡点。)

[AI 创作的诡异边界]

(深度正文:在 Reddit 的 AI 视频版块,一段极度令人不安(unhinged)的 AI 生成视频引发热议。该作品超越了常规 AI 视频的逻辑范式,呈现出某种不可名状的视觉奇观。这种视频内容的走红揭示了当前 AI 内容生成的趋势:在追求逼真度之后,一部分 AI 创作者开始转向探索人工智能的“非人”特质。这种带有克苏鲁风格或超现实感的作品,正在不断拓宽人类对人工智能视觉表现边界的认知,同时也反映了 AI 创作生态中日益浓厚的亚文化倾向。)

[RunLobster:当 AI Agent 成了情绪的放大器]

(深度正文:一位 B2B 工具开发者分享了其部署的 RunLobster AI Agent 的惨痛经历:在处理客户投诉时,Agent 自动抓取了客户的愤怒情绪并以同样的愤怒语气进行回复,导致冲突升级。这一案例深刻揭示了 Agent 的风险——如果缺乏有效的情绪对齐与逻辑审查,AI 不仅无法成为合格的客服,反而会成为人际冲突的催化剂。在业务流程中引入全自动决策时,人类监督(Human-in-the-loop)的门槛不仅不能降低,反而需要建立更细颗粒度的负面情绪过滤机制。)

[MiniMax M2.7 的许可权争端与商业策略调整]

(深度正文:MiniMaxAI 近期对其 M2.7 模型进行了许可协议的更新,Ryan Lee 在社交平台确认,个人用户可自由运行该软件,且基于该模型的商业产品开发也得到许可。这一变动是对社区抗议的直接回应。在开源社区中,模型性能固然重要,但许可协议的封闭性往往会直接限制模型的生态渗透力。此次 MiniMax 的让步,标志着中国 AI 初创企业在走向全球化时,开始意识到合规与社区共赢对模型落地的重要性。)

[AI 的自我迭代:LLM 自动调优的效率革命]

(深度正文:开发者通过引入 llm-server 的 V2 版本,实现了大模型对自身 llama.cpp 参数的自动调优,使得 Qwen3.5-27B 模型的吞吐量提升了 54%。这一案例展示了开源社区“极客精神”的精髓:在算力资源受限的情况下,通过软件层面的深度优化实现效能的最大化。这种“让模型自己调优”的思路,有望成为未来本地部署大模型的主流范式,极大地降低了高性能推理的算力门槛。)

[MiniMax M2.7 GGUF 故障分析]

(深度正文:针对 MiniMax-M2.7 模型在 GGUF 格式下出现的 NaN(非数值)报错,开发者进行了深入调查,结果显示该问题并非个案,涉及 Hugging Face 上 21%-38% 的同类 GGUF 模型。这一发现对于本地部署玩家至关重要,它提醒用户:模型量化格式的兼容性与稳定性依旧是生产环境中的“隐形雷区”。这种基于社区互助的故障排除过程,正是开源模型生态能够持续迭代并逐步优化的基石。)

[量子计算的 AI 加速:NVIDIA 发布 Ising 模型]

(深度正文:NVIDIA 近期推出了全球首个用于加速量子计算的开源 AI 模型 Ising。通过 AI 驱动的工作流,该系统能够实现可扩展的高性能量子处理器校准与纠错解码。这一举措标志着算力巨头开始在“AI+量子”这一交叉领域深耕,试图用经典 AI 的算力解决量子计算中面临的降噪与容错难题,将 AI 对科学计算的赋能提升到一个新的量级。)

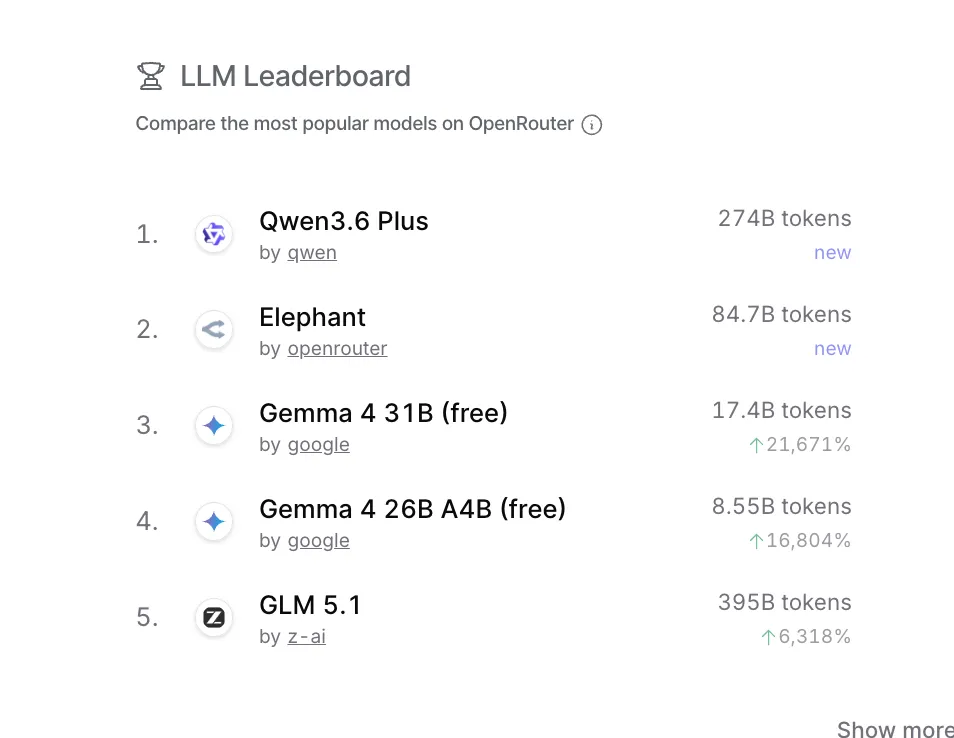

[Elephat-Alpha 的走红之谜与模型真实性讨论]

(深度正文:近期,Elephant-Alpha 在 AI 社区迅速蹿红,引发了关于其背景的各种猜测,甚至有传闻质疑其是否为中国背景的模型。针对这一猜测,社区开发者进行了交叉测试,通过询问 1989 年特定历史事件来验证其偏向与知识广度。这类探讨反映了 AI 社区对模型来源与价值观对齐的敏感性。当一个新的模型突然流行,验证其“真实身份”与背后的训练价值观已成为开发者社区的必备技能。)

(深度正文:近期,Elephant-Alpha 在 AI 社区迅速蹿红,引发了关于其背景的各种猜测,甚至有传闻质疑其是否为中国背景的模型。针对这一猜测,社区开发者进行了交叉测试,通过询问 1989 年特定历史事件来验证其偏向与知识广度。这类探讨反映了 AI 社区对模型来源与价值观对齐的敏感性。当一个新的模型突然流行,验证其“真实身份”与背后的训练价值观已成为开发者社区的必备技能。)

【硬件部署与社区杂谈】

[本地算力的巅峰:DGX Spark 部署实践]

(深度正文:一位开发者晒出了其新购入的 DGX Spark 工作站,并计划利用 vLLM + PyTorch 构建本地 API 后端。在云端算力昂贵且存在隐私顾虑的大环境下,像 DGX Spark 这种高性能终端设备的部署,已成为高端极客玩家的首选。这不仅是硬件发烧,更是对个人化 AI 基础设施的深度投入,预示着高端 AI 应用正在从云端转向边缘侧的物理集群。)

(深度正文:一位开发者晒出了其新购入的 DGX Spark 工作站,并计划利用 vLLM + PyTorch 构建本地 API 后端。在云端算力昂贵且存在隐私顾虑的大环境下,像 DGX Spark 这种高性能终端设备的部署,已成为高端极客玩家的首选。这不仅是硬件发烧,更是对个人化 AI 基础设施的深度投入,预示着高端 AI 应用正在从云端转向边缘侧的物理集群。)

[从云端撤退:个人玩家的 GPU 军备竞赛]

(深度正文:一位拥有 15 年经验的软件工程师,通过搭建双 Asus Ascent GX10 集群运行 MiniMax M2.7 AWQ 量化版本,实现了媲美云端 Opus 4.5 的代理编程能力。其口号“Cloud providers are dead to me”直白地反映了高阶开发者对隐私、成本与控制权的诉求。这种趋势表明,随着本地部署技术的成熟,那些对数据敏感且需要高度定制化 Agent 的开发者,正在加速将核心工作流迁移至本地算力。)

[Gemma 4 31B 量化策略:4bit 是最优解吗?]

(深度正文:在 M5 Max MacBook Pro 128GB 环境下,关于 Gemma 4 31B 模型的 4bit 量化测试显示了极高的性价比。极客们通过 leaderboard 对比发现,在有限的硬件资源下,恰当的量化方案能够最大限度保留推理能力。这一测试结论再次印证了本地部署的核心逻辑:通过算法剪枝与量化,将大参数模型塞进家用计算设备,是实现个人 AGI 的必经之路。)

[杂项快讯:争议与八卦]

- Instruct 误导效应

:针对“He was just following instructions”的感慨,揭示了用户在使用 AI 指令时,常因指令模糊而导致模型行为失控的无奈。 - Connections Benchmark

:关于 NYT Connections 基准测试的成本与性能图表发布,揭示了模型在处理词汇关联任务时的边际效益递减规律。 - MiniMax 的 coding 限制

:虽有争议,但官方已确认利用 M2.7 构建产品是可以获利的,平息了社区的恐慌。 - ChatGPT 历史纠结

:关于 ChatGPT 七周年回顾的讨论,让社区重新思考 AI 变革的加速度。 - ChairGPTrash

:社区用户对 AI 回答质量下滑的调侃,体现了开发者群体对当前主流模型产品力下降的集体失望。 - 百度 ERNIE-Image

:百度模型在 Hugging Face 的上线,标志着国产图像生成模型在开源版块的影响力进一步提升。

夜雨聆风

夜雨聆风