夜雨聆风 > > 办公文件 > 最牛推理AI芯样板:马斯克AI5和昇腾950PR

当前时间: 2026-04-17 10:56:33

分类:办公文件

评论(0)

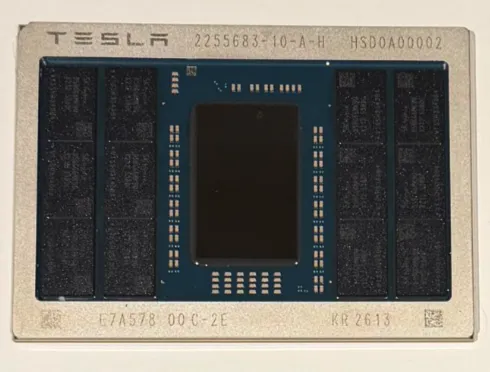

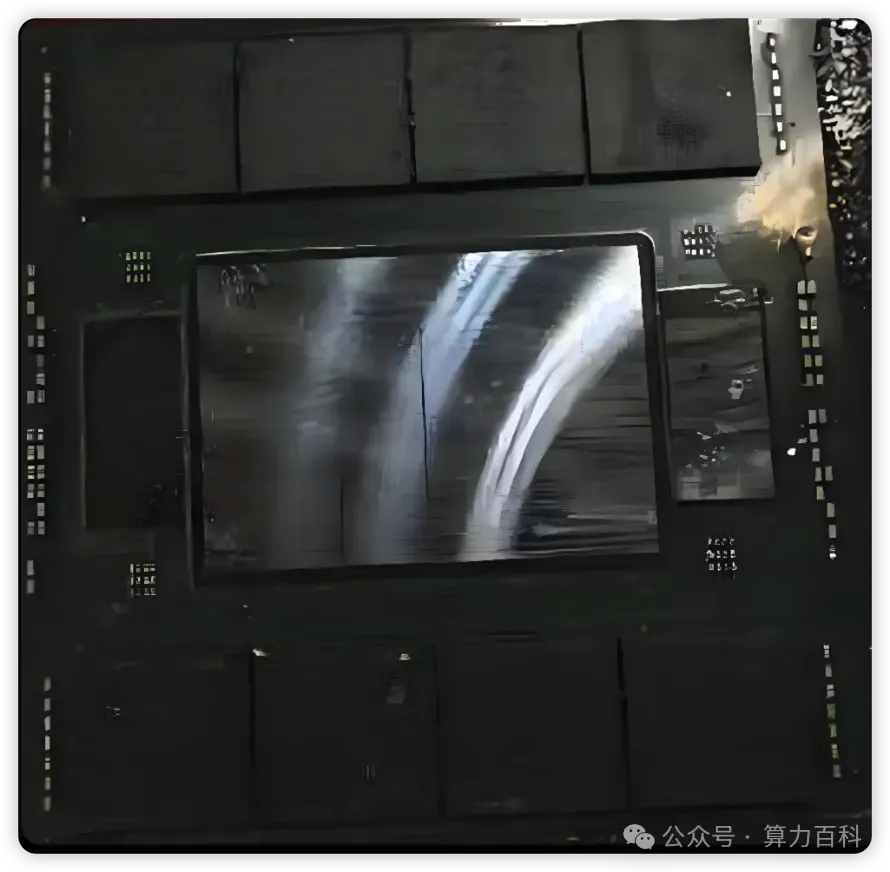

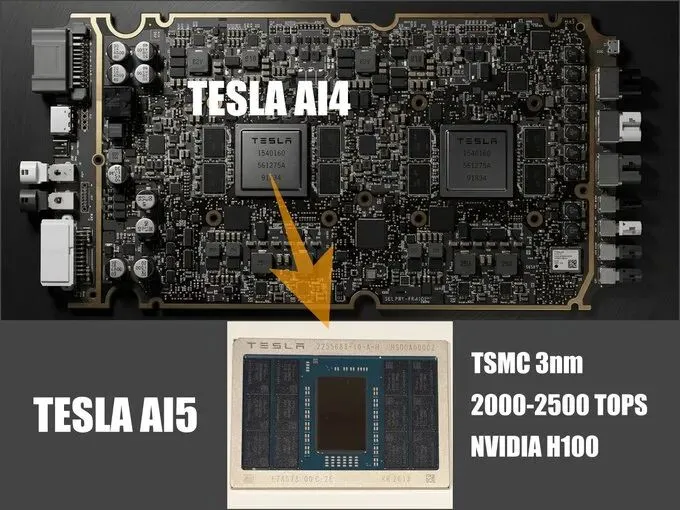

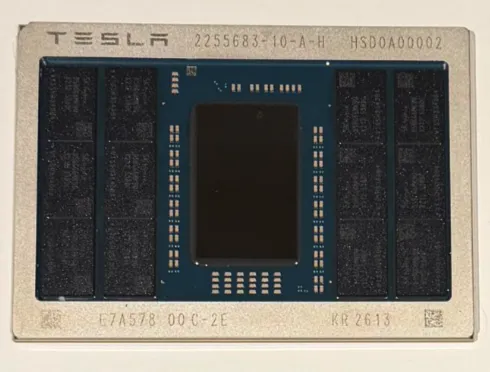

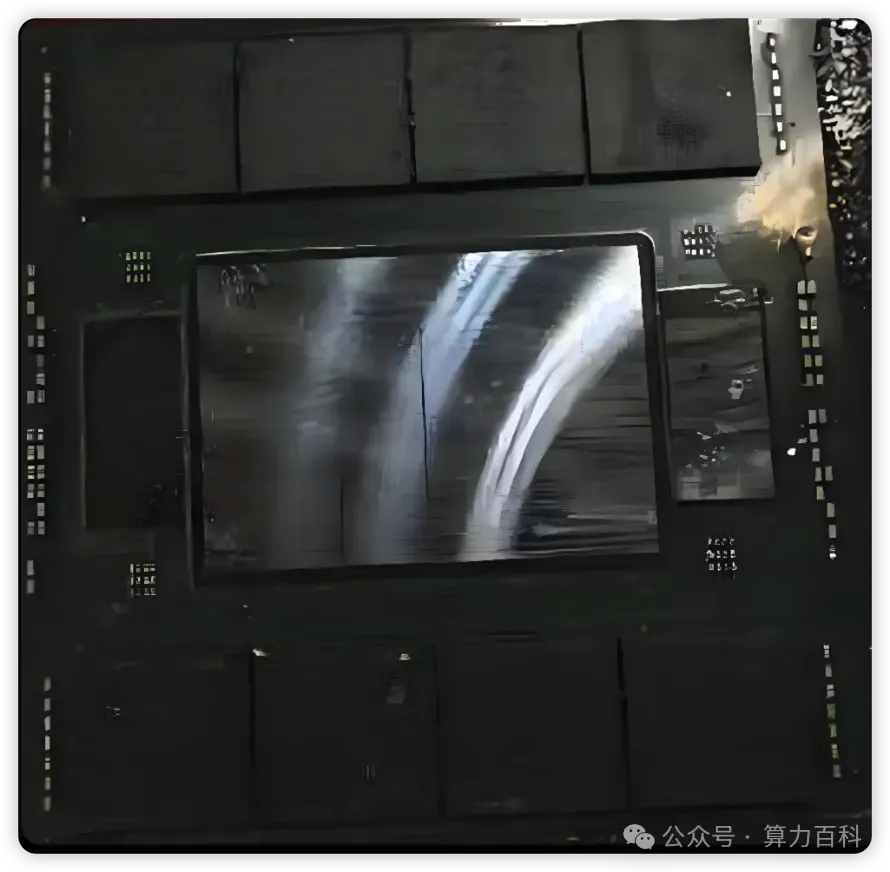

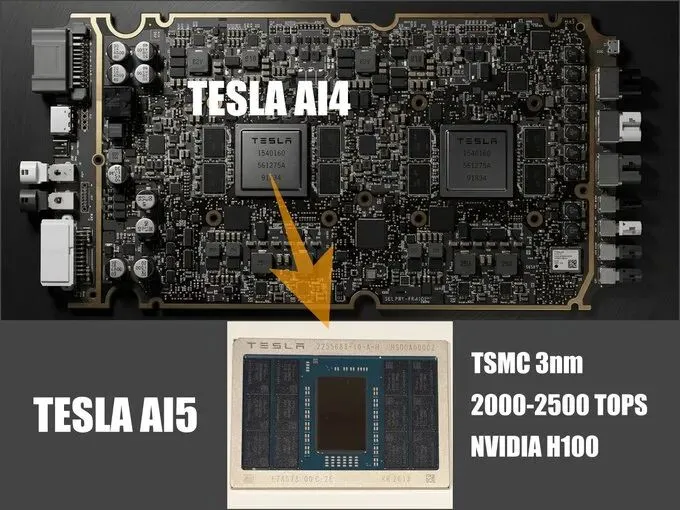

特斯拉 AI5 单die版 特斯拉也有双 die 版本对标 Blackwell 950 双 die 版 特斯拉CEO马斯克在社交平台上正式宣布AI5芯片完成流片,并首次公开实物照片。这标志着特斯拉自研AI芯片进入全新阶段。 与此同时,另一款备受关注的推理AI芯片950PR也开启交付。 这两个来自不同阵营的芯片,在技术路线上呈现出惊人的一致性——它们都选择了ASIC架构、MCM封装、LPDDR5X内存、双Die设计、芯片互联等共同路线, 不约而同地为下一代推理AI芯片指明了方向。 都选择ASIC架构,走GPNPU路线, 主打推理,能效比比GPU高得多 在AI芯片领域,GPU长期以来占据主导地位,但推理场景有其独特需求——追求极致效率与低成本。AI5和950PR都放弃了通用GPU的复杂架构,转向ASIC专用集成电路设计,走GPNPU(通用神经网络处理单元)路线。 GPNPU通过自定义指令集和专用计算单元,在单位硅面积上实现远高于通用GPU的计算密度和能效比,专注于推理场景所追求的极致效率与极低成本。 马斯克在回复留言时直言,AI5芯片虽然不一定是“最好的汽车AI芯片”,但很可能是目前市面上针对参数规模约2500亿以下模型的最佳推理芯片,其芯片成本及能效比(性能/瓦特)都远超同类产品 。据马斯克透露,AI5的功耗仅为250W,而英伟达Blackwell芯片功耗高达1kW以上,成本不到后者的十分之一 。950PR同样专注于推理场景,特别是Prefill预填充阶段,通过自研达芬奇架构和低精度数据格式支持,在推理吞吐量和能效上实现显著提升。两者都选择了ASIC+GPNPU路线,以能效比碾压传统GPU。 都选择MCM封装,放弃CoWoS,成熟产能才是王道 在封装技术选择上,AI5和950PR都选择了MCM(多芯片模块)封装,而非当前炙手可热的CoWoS先进封装。这一选择背后有着清晰的产业逻辑。 MCM封装技术已有30年发展历史,技术成熟度高,产能充足,成本可控 。相比之下,CoWoS作为先进封装技术的代表,虽然性能优异,但产能严重受限。台积电的CoWoS产能在2026年预计达到65万片,但英伟达一家就预订了超过一半的产能,全球产能缺口高达20%—30%。CoWoS不仅产能不足,成本也极高。对于主打“低成本、高效率”的推理芯片而言,追求尖端封装技术反而不如选择成熟的MCM封装来得务实。 MCM方案既能满足双Die和多Die互联的基本需求,又能确保大规模量产不受封装产能制约,与两款芯片“产量最高、成本最低”的目标高度契合。 都选择LPDDR5X,低功耗低成本,HBM太贵供应还不足 内存选择是推理芯片的关键决策点。AI5和950PR都选择了LPDDR5X内存方案,而非高成本的HBM。 特斯拉AI5芯片配备144GB至192GB LPDDR5X内存,功耗控制在300W以内。 LPDDR5X的工作电压极低(约0.5V至1.05V),相比DDR5功耗可降低75%—77%。对于AI推理任务,尤其是大语言模型推理,其对内存容量的敏感度远高于带宽,LPDDR5X的低功耗特性直接转化为更低的运营成本、更少的散热需求和更小的碳足迹。 在数据中心和边缘服务器中,LPDDR5X完美契合了全球数据中心对“绿色计算”的迫切需求。 未来AI服务器内不会再用 DDR5/6,都会用 lpddr5x/6 取代,省点才是未来! 反观HBM,虽然带宽极高,但价格昂贵且全球产能高度集中在少数厂商手中,供应量极为有限。推理场景对内存带宽的要求远不如训练场景苛刻,选择LPDDR5X是在性能、成本和功耗之间找到的最佳平衡点。 两款芯片的趋同选择,说明“推理用LPDDR5X、训练用HBM”的分工格局正在形成。 都规划双Die版本,小Die面积兼顾良率与场景适配 AI5和950PR都采用了小面积Die设计,并规划了单Die和双Die两种版本,这一设计策略非常精妙。 特斯拉AI5提供单die和双die两种配置方案,分别对标英伟达Hopper和Blackwell架构。 单Die版本主打成本敏感场景,双Die版本则面向高性能需求场景。小面积Die的设计能显著提升晶圆良率——使用多个较小的Die可以提升整体良率,每个Die在集成前都经过已知良品测试,进一步保证最终产品的可靠性。 950PR同样采用双Die UMA架构,双Die之间通过高速的Die-to-Die通道连接,使用户可以无感使用两个Die的算力,极大提升了用户易用性。 这种模块化设计不仅降低了单Die的制造难度和成本,还赋予芯片更强的场景适应能力——低端场景用单Die,高端场景用双Die,资源利用效率最大化。 都支持Chip互联,为超节点和集群时代做好准备 面向未来的AI算力需求,单颗芯片再强也难以独当一面,芯片互联能力成为衡量AI芯片竞争力的重要维度。 AI5和950PR都支持芯片间的互联,并规划了超节点大集群方案。 950PR支持UB灵衢互联,整芯片支持18个400Gbps端口,可以实现超节点系统的超高带宽、超低时延、超大规模组网需求。华为基于昇腾芯片推出的CloudMatrix 384超节点,成功实现384颗NPU的全对等互联,算力规模达300 PFlops,在多项关键指标上实现了对英伟达GB200 NVL72的超越。 特斯拉方面,AI5的设计同样考虑了芯片互联能力,为未来Robotaxi车队和人形机器人大规模部署后的协同计算预留了扩展空间 。通过芯片互联实现算力的线性扩展,是满足未来超大规模AI推理需求的必由之路。一种die打云和边两种市场,一箭双雕 AI5和950PR最令人称道的策略,莫过于用一颗芯片同时覆盖云端和边缘端两大市场。 特斯拉AI5的定位是“全能型”芯片——单Die版本用于边缘推理场景(如车载FSD、Robotaxi、Optimus机器人),双Die版本则可用于云端数据中心推理。 950PR同样如此,标卡形态面向单卡推理场景,超节点形态则面向云端大规模集群推理。 这种“一芯两用”的设计思路极大降低了研发和制造成本。 传统上,边缘端芯片和云端芯片需要分别设计、分别流片、分别验证,而单Die/双Die的模块化设计让同一款芯片裸片可以在不同场景中灵活配置,研发资源复用、生产规模放大、边际成本降低,可谓“一箭双雕”。 一条清晰的推理AI芯片技术路线图 马斯克AI5和950PR在架构、封装、内存、芯片设计、互联能力和市场定位六个维度上的高度一致,绝非巧合,而是反映了业界对推理AI芯片技术方向的高度共识: ASIC+GPNPU架构实现极致能效比,MCM封装避开CoWoS产能瓶颈,LPDDR5X内存平衡性能与成本,双Die设计兼顾良率与场景适应性,芯片互联为集群计算铺路,一芯两用覆盖云边两端。 这是一条务实、高效、可持续的技术路线。在全球AI计算重心从训练向推理迁移的大趋势下,这条路线为整个行业指明了方向——不是一味堆砌算力、比拼晶体管数量,而是在性能、功耗、成本和产能之间找到最优解。正如马斯克所言,AI5将“成为有史以来产量最高的AI芯片之一” 。 当推理成为AI计算的主战场,谁能以最低成本提供最高的推理效率,谁就能赢得下一轮竞争的入场券。 “算力百科”是全国首个算力和大模型工程专属服务 IP品牌,专注于国内AI算力行研;团队来自顶级芯片设计、算力中心构建及大模型开发一线,贯通“芯·算·模”,从实战角度出发,构建国产AI算力新范式,深耕算力和大模型行业! 卡修师,专注高端GPU卡后服务市场(回收、维修、循环)

上一篇我为什么放弃打工,死磕支付和AI赛道?给30+想创业的人3个忠告

下一篇Hermes vs OpenClaw:AI Agent 双雄对决,一场关于“进化”与“生态”的博弈

基本

文件

流程

错误

SQL

调试

请求信息 : 2026-04-17 14:30:20 HTTP/1.1 GET : https://www.yeyulingfeng.com/a/539578.html 运行时间 : 0.127661s [ 吞吐率:7.83req/s ] 内存消耗:4,762.07kb 文件加载:145 缓存信息 : 0 reads,0 writes 会话信息 : SESSION_ID=9e21d68ae92e5b463d9c0d51a86b4f02

CONNECT:[ UseTime:0.000853s ] mysql:host=127.0.0.1;port=3306;dbname=wenku;charset=utf8mb4 SHOW FULL COLUMNS FROM `fenlei` [ RunTime:0.001661s ] SELECT * FROM `fenlei` WHERE `fid` = 0 [ RunTime:0.000734s ] SELECT * FROM `fenlei` WHERE `fid` = 63 [ RunTime:0.000735s ] SHOW FULL COLUMNS FROM `set` [ RunTime:0.001337s ] SELECT * FROM `set` [ RunTime:0.000618s ] SHOW FULL COLUMNS FROM `article` [ RunTime:0.001556s ] SELECT * FROM `article` WHERE `id` = 539578 LIMIT 1 [ RunTime:0.001052s ] UPDATE `article` SET `lasttime` = 1776407420 WHERE `id` = 539578 [ RunTime:0.005194s ] SELECT * FROM `fenlei` WHERE `id` = 64 LIMIT 1 [ RunTime:0.013692s ] SELECT * FROM `article` WHERE `id` < 539578 ORDER BY `id` DESC LIMIT 1 [ RunTime:0.001217s ] SELECT * FROM `article` WHERE `id` > 539578 ORDER BY `id` ASC LIMIT 1 [ RunTime:0.002619s ] SELECT * FROM `article` WHERE `id` < 539578 ORDER BY `id` DESC LIMIT 10 [ RunTime:0.003208s ] SELECT * FROM `article` WHERE `id` < 539578 ORDER BY `id` DESC LIMIT 10,10 [ RunTime:0.002393s ] SELECT * FROM `article` WHERE `id` < 539578 ORDER BY `id` DESC LIMIT 20,10 [ RunTime:0.005009s ]

0.129275s