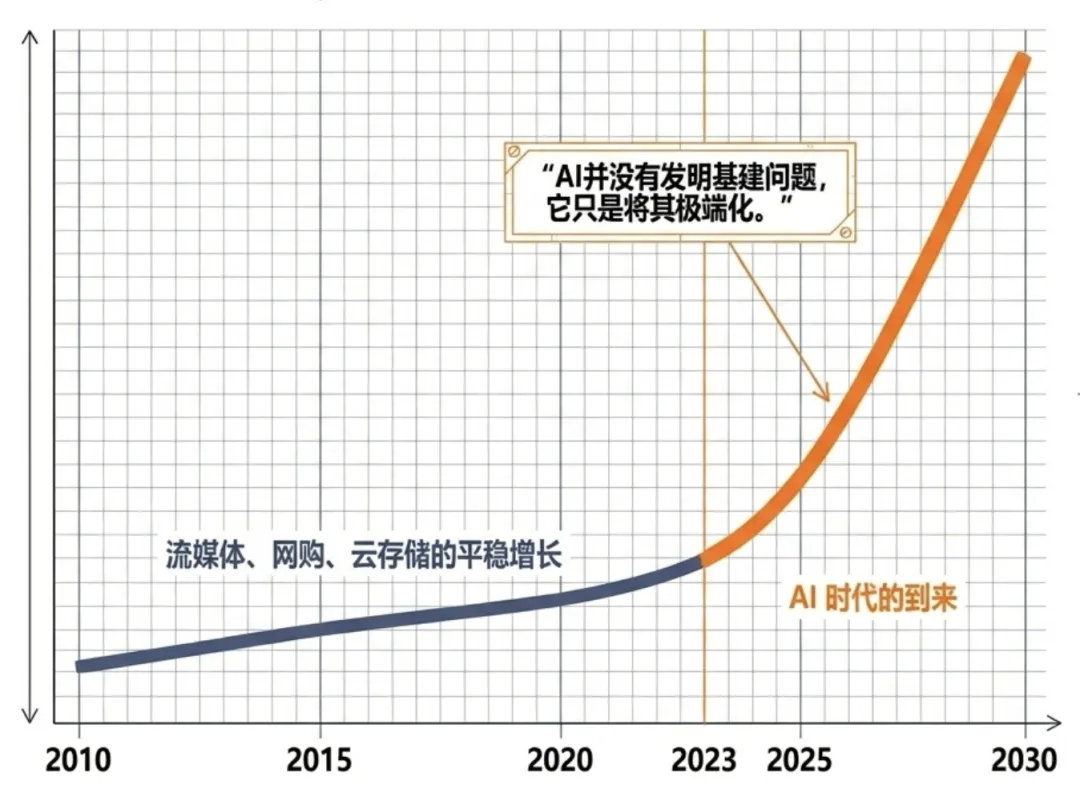

下面这些数字,第一眼看上去简直像是编的。

光是在 2026 年,美国就可能新增 12 到 18 吉瓦的数据中心容量。一年前,这种增长听起来都算激进。现在?这已经成了“保守预期”。超大规模厂商(hyperscalers)在疯狂翻倍扩张目标。前沿 AI 实验室锁定吉瓦级电力,就像在囤云计算额度一样。甚至有人说,到今年年底,OpenAI 和 Anthropic 各自可能已经握着 5–6 GW,而且很快就会冲向 10 GW。

看到这些,很容易得出一个简单结论:AI 需要更多电。

这话没错。

但也不完整。

因为当你不再盯着 Excel 表,而是盯着那些真正把电送到数据中心的“物理系统”时,画风就变了。问题不只是 AI 用多少电,而是它的用电方式有多不可预测、多不稳定,以及对电网有多“不友好”。

这,直接改变了一切。

“多加点电就好了”的幻觉

从远处看,一切都很线性:需求上涨,供给跟上。电力公司多发电,开发商多建数据中心,资本涌入,系统扩张。

算术上好像也说得通。如果美国在 2025 年新增了大约 10–15 GW 的容量,而 2026 年预测还是差不多这个级别,那可以简单拆一下:

纸面上看,很整齐,甚至让人有点安心。

但问题是——这个模型默认了一个关键前提:

一兆瓦就是一兆瓦。

现实是?

电这东西,还真不一样。

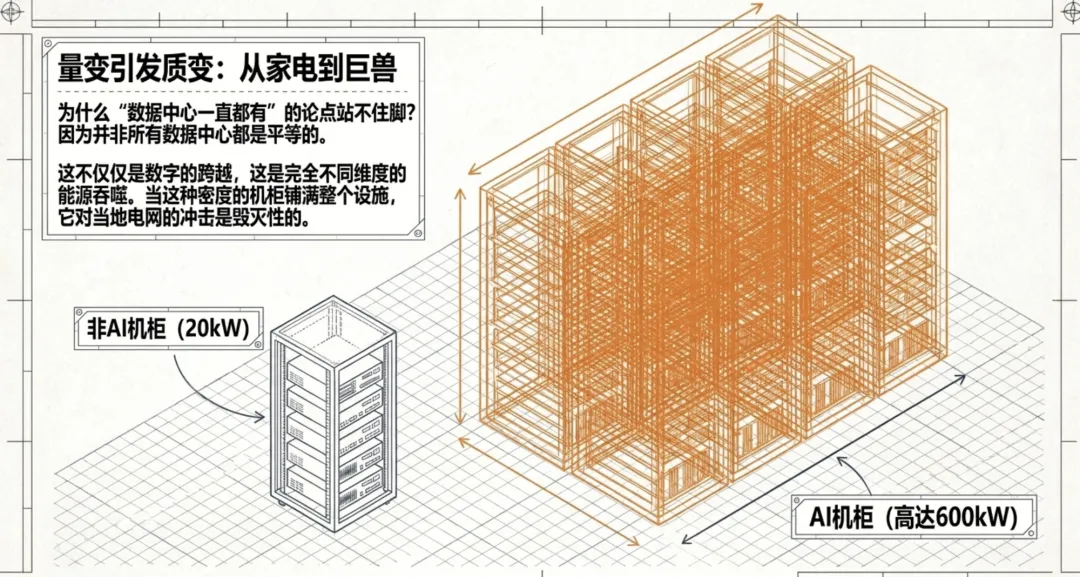

AI 负载根本不像“正常用电”

传统数据中心已经很耗电了,但至少“可预测”。负载慢慢增长,功耗曲线也比较平滑,电力公司还能做规划。

AI?直接把这个模型干碎。

我们可以更直观对比一下:

现代 AI 集群更像是:

一秒满负荷下一秒骤降然后几秒内再暴涨

这种行为,不只是低效。

是会搞崩电网的那种不友好。

所以真正的问题不是“给 AI 足够的电”。

而是——

用一种电网还能扛得住的方式给它电。

隐藏层:电力电子和控制系统

AI 数据中心跟电网的交互方式,早就不是传统工业负载那一套了。

核心组件可以简单拆成:

这些系统不靠“物理惯性”,而是靠软件。靠算法。靠微秒级控制回路来调节电力。

而现在,这套逻辑被搬到了“用电侧”。

于是世界变成了:

发电是软件定义的,用电也是软件定义的。

听起来很强?

也很脆。

因为稳定性不再只是物理问题。

是代码问题。

当规模让“奇怪”变成“危险”

我们可以把风险升级路径也结构化一下:

很多数据中心设计成:当电网条件稍微不对,就自动切离,转用备用电源。

单个来看,这是韧性。

一堆一起看?

这叫放大灾难。

为什么“多发电”不是最大瓶颈

没错,我们确实需要更多发电。

但真正的限制,其实更“接地气”:

行业嘴上说的是吉瓦。

卡脖子的却是:

人、工具、时间。

真正缺的东西:可见性(Visibility)

当前系统的信息割裂,可以总结为:

每个人都看到一部分。

没有人看到全局。

而当一切都在毫秒级变化时——

这个“盲区”,就是风险本身。

从监控到“电力版 AIOps”

需要的能力可以总结为:

这已经不是传统监控了。

而是一个实时反馈系统。

核心结论?

AI 基础设施的下一阶段,不只是规模问题。

是控制问题。

AI 不只是增加了用电量。

它改变了“用电的本质”。

赢家不会是拿到最多电的人。

而是——

最会管电的人。

会管电,更会管AI数据中心

这里我推荐一个品牌:

拒绝“盲养”!DCOS靠“带外管理”让龙虾一体机能耗、温度一目了然

云新可以帮你的AI机房带来的价值:

逻辑依然简单粗暴:

看得见 → 管得好管得好 → 成本低、效率高效率高 → 系统更可持续

行业一直在问:怎么给 AI 供电?

其实更有价值的问题是:

你到底有多理解你现在已经拥有的电?

如果答案是“不太够”。

那么也许你可以从测试云新的AI智能运维平台开始。

夜雨聆风

夜雨聆风