在游戏与交互应用开发中,界面实现长期存在着一道隐形的效率鸿沟。设计师交付精美的视觉稿后,开发者往往需要花费数小时甚至数天进行手工还原——调整RectTransform、绑定组件、对齐像素。这种机械劳动虽技术门槛不高,却长期占据开发者大量工时,成为效率瓶颈。

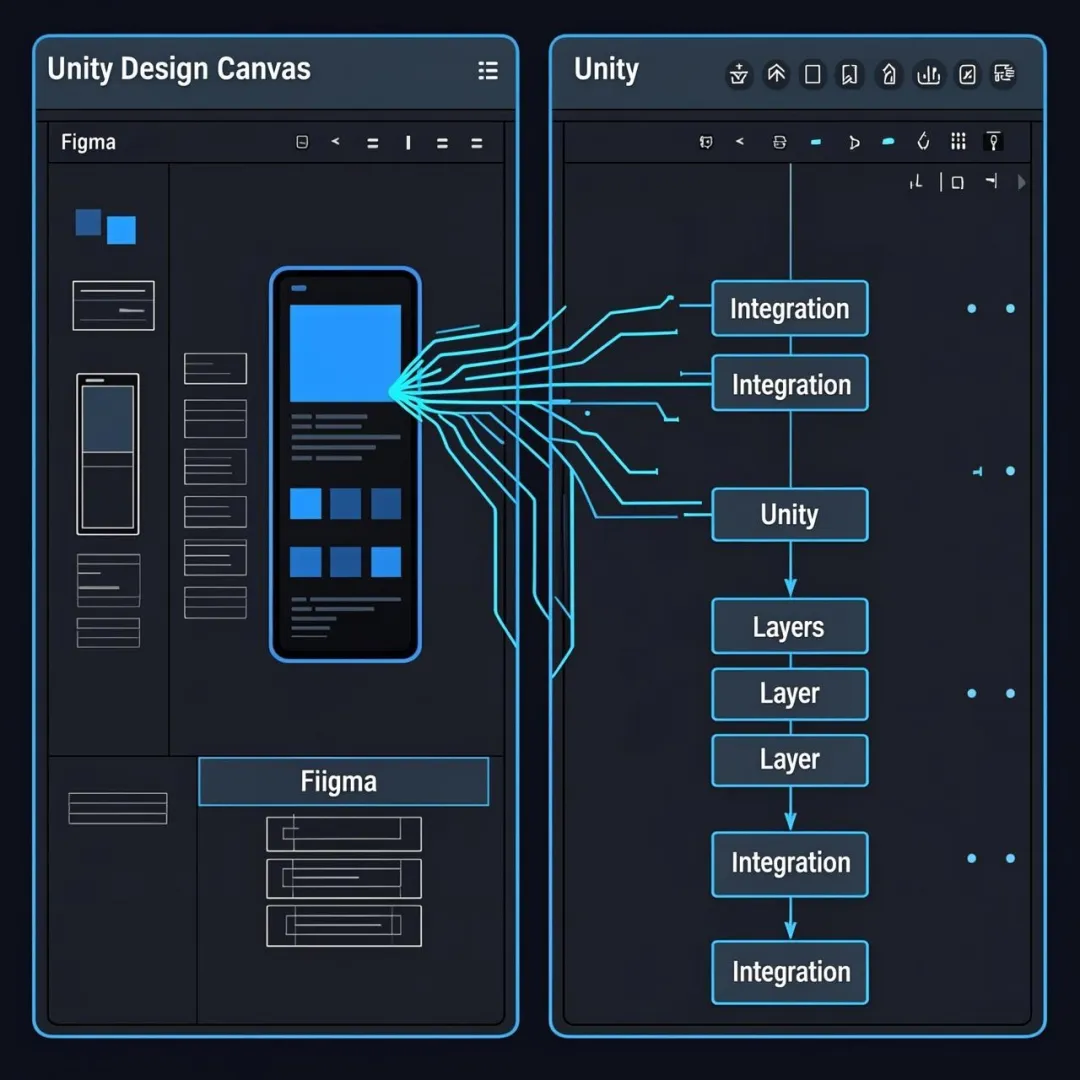

近期,借助大模型与工具链的深度集成,一种全新的"设计即工程"工作流正在成熟。通过AI直接解析设计稿的语义结构并生成可用的工程文件,首跑成功率可稳定在九成左右,单次耗时约十分钟。这不仅是简单的代码生成,而是开发范式的根本性转移。

当AI开始理解设计稿的层级逻辑而非仅仅识别像素颜色,开发者终于可以从重复的界面搭建中解放出来,专注于业务逻辑与交互创新。

一、为什么这次不再是"玩具"

过往的设计转代码工具(D2C)往往停留在静态页面导出层面,生成的代码难以直接接入业务系统。而新一代方案的核心差异在于语义级结构理解。

传统工作流中,开发者需要肉眼识别设计稿中的容器嵌套关系:哪些是滚动区域(Scroll View),哪些是列表项(List Item),按钮的不同状态如何映射。AI现在通过直接读取设计软件的节点树(Node Tree),能够准确识别Frame、Group、Component的层级关系,并理解Auto Layout等约束逻辑。

这种理解不是图像识别式的"看图说话",而是基于文档对象模型(DOM)式的结构解析。AI知道一个卡片组件内部包含图片容器、文本层和按钮,而非仅仅看到一张矩形的截图。这种认知深度使得生成的Prefab能够直接继承设计稿的响应式布局和组件化思维。

二、环境准备与前置条件

在正式操作前,需要确保本地环境满足以下要求:

- Claude Code

已安装并配置好命令行权限 - Figma账户

具备API访问权限(需要生成Personal Access Token) - Unity工程

使用UGUI系统,且已导入TextMeshPro等常用依赖 - MCP协议支持

或REST API调用能力(用于桥接Figma与AI)

特别需要注意的是,Figma的Token存在请求频次限制。对于高频使用场景,建议搭建缓存层或直接使用REST API替换MCP协议,避免在解析复杂页面时触发限流。

三、三步走实战:从URL到Prefab

Step 1: 结构解析——让AI读懂设计稿

将Figma文件的分享链接提供给AI。与简单的截图上传不同,这里需要AI通过接口读取原始数据:

AI获取设计文件的JSON结构,遍历所有节点 识别视觉元素的类型:文本层转为TextMeshPro候选,图片层标记为Image组件,带滚动属性的Frame识别为Scroll Rect 分析层级深度,建立父子节点关系树,确保生成的Unity层级结构与视觉稿一致

此阶段的关键在于约束提示词。需要明确告知AI:不要只做表层还原,而是按照人类工程师的搭建思路,先识别整体布局框架,再做模块拆分,最后处理细节元素。

Step 2: 语义映射——设计系统转工程组件

当结构被解析后,进入最关键的语义转换层。这一层决定了生成代码的工程化程度:

- 基础元素映射

:文本→TMP_Text,矩形→Image,圆形→Mask或Circle Image - 布局系统转换

:Figma的Auto Layout对应Unity的Horizontal Layout Group或Vertical Layout Group - 交互组件识别

:包含特定命名(如btn_、button)的组自动映射为Button组件,并配置Target Graphic - 列表自动化

:识别重复项模式,自动生成Scroll View + Content节点,并配置Layout Constraint

对于复杂业务组件(如自定义血条、技能图标),需要预先建立映射表,告诉AI特定设计模式对应特定的自定义脚本。

Step 3: 工程生成——YAML直出与资源绑定

这是与传统代码生成最大的区别点。AI不输出C#脚本动态创建UI,而是直接生成Prefab的YAML序列化文件。

具体实现逻辑:

- GUID扫描

:先扫描Unity工程中现有资源的GUID(如图集、字体、预制体),建立可引用字典 - YAML组装

:根据Unity的序列化格式,将节点层级、组件参数、资源引用关系组装为文本文件 - 文件写入

:将生成的YAML写入Library/Metadata或Assets目录,Unity会自动识别为可用Prefab - 场景实例化

:可选步骤,让AI自动将Prefab拖入指定场景并配置基础位置

这种方式的优势在于生成的文件与人工制作的Prefab完全等价,保留了完整的Inspector可调属性,而非硬编码的生成脚本。

四、稳定性优化:从能用到好用

初次尝试可能只能达到六七成的还原度,特别是在处理复杂列表或嵌套遮罩时。要提升到九成成功率,需要建立Skill系统(技能库):

- 规范沉淀

:将项目内的命名规则(如ui_前缀、_btn后缀)、层级深度限制、资源引用路径写入AI的记忆库 - 组件映射表

:建立设计稿中的Symbol与Unity自定义组件的对应关系,确保每个设计系统组件都有准确的工程实现 - 边界情况处理

:预设常见错误的修正逻辑,如当AI误将背景图识别为普通Image时,自动添加Raycast Target = false优化性能

通过几轮成功的生成与人工微调,让AI总结成功模式,形成可复用的Prompt模板。后续新界面只需套用模板,即可实现"一次配置,多次复用"。

五、真实成本与当前局限

任何技术方案都需要考虑投入产出比。目前该工作流的实际成本如下:

经济成本:使用GPT-4或Claude Sonnet级别的模型,生成一个中等复杂度(含列表、多状态)的界面约需10元人民币;若使用轻量级模型(如MiniMax),费用可降至5-6元,但可能需要多次迭代修正。

时间成本:单次生成全流程约10分钟,其中70%时间消耗在Figma API的数据解析与传输,实际AI思考与生成仅需2-3分钟。

当前局限: - 复杂动画状态(如复杂的DOTween序列)仍需手动配置 - 特定Shader效果或特殊材质无法通过设计稿直接推断 - 高度定制化的自定义Inspector属性需要额外说明

六、未来展望:开发者角色的范式转移

这套工作流的意义远超简单的效率工具。它预示着界面开发正从"手工制造业"转向"规则制定与质量管控"。

当AI能够可靠地将设计语义转化为工程实现,开发者的核心价值将转向: - 设计系统架构:建立清晰的设计规范与组件库,让AI有明确的映射依据 - 边界情况处理:定义异常处理逻辑,处理AI难以理解的特殊交互 - 性能优化:在AI生成的基础上进行DrawCall合并、对象池配置等工程优化

未来半年内,这种"设计即代码"(Design as Code)的模式有望成为行业标准配置,就像GitHub Copilot改变代码编写方式一样,重塑UI开发的生产关系。对于团队而言,越早建立标准化的设计系统与AI协作规范,就能越早享受这一波效率红利。

觉得有用?点个关注不迷路,后续将分享更多AI工程化落地的实战技巧与避坑指南。

夜雨聆风

夜雨聆风