昨天晚上躺在床上,突然想通了一件事。

这几年我们天天说 AI 多厉害,ChatGPT 多智能,好像它真的懂你在说什么一样。但如果你问我 AI 到底是怎么工作的,我之前还真说不清楚。直到我想到一个特别贴切的比喻,连我姥姥都能听懂的那种。

AI 其实就是个学渣,而且是那种特别会考试的学渣。

从学霸到学渣的逆袭

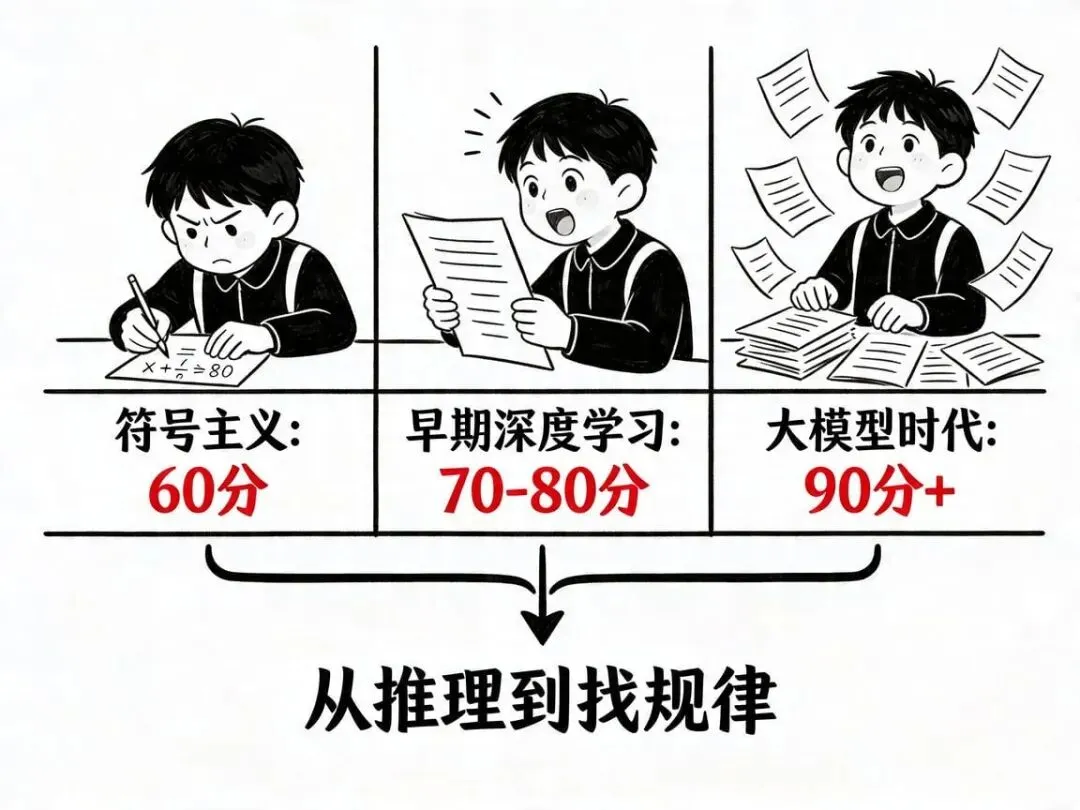

想象你是个学生,正在做数学试卷。一开始你特别认真,每道题都用公式推导,步骤写得工工整整。但最后只能考 60 分,怎么努力都上不去。

这就是早期 AI 的状态,学术界叫它符号主义。就是教会机器各种规则和公式,让它像人一样推理。听起来很靠谱对吧?但问题是这条路太难了,就像让一个普通学生通过死记硬背公式去考清华,基本没戏。

后来你发现了一个秘密。

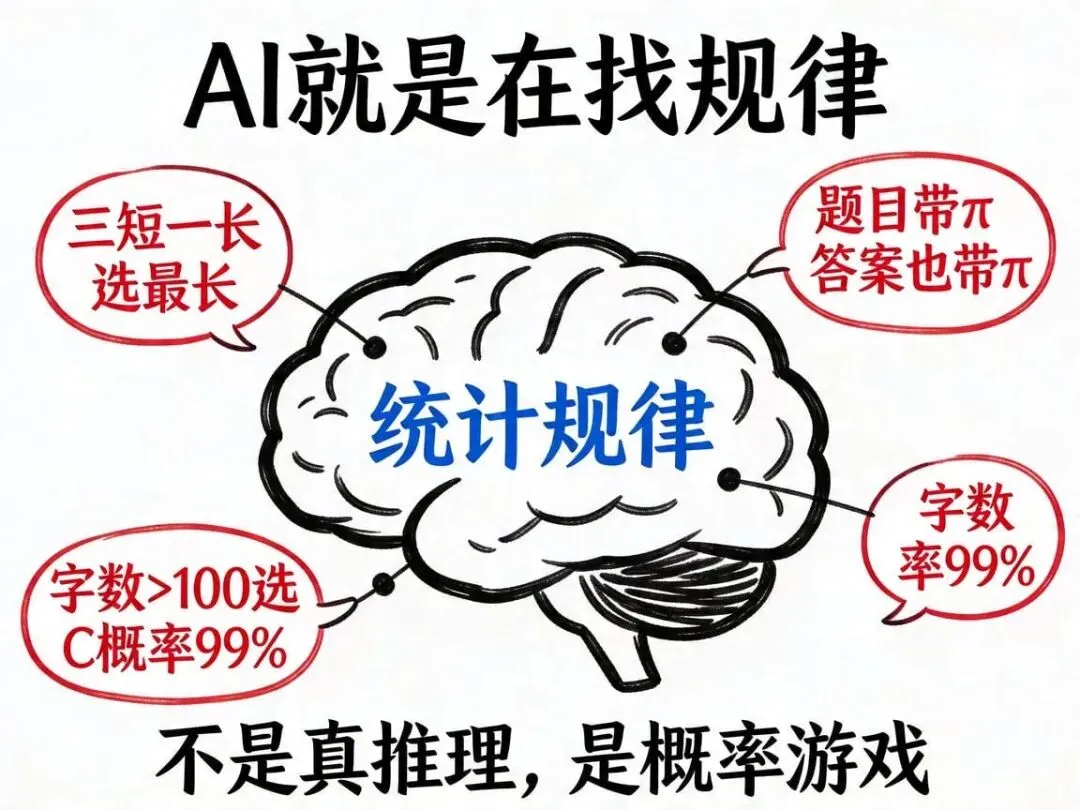

你开始观察大量的试卷,不是为了学会解题方法,而是为了找规律。你发现选择题有个神奇的现象,三短一长选最长,三长一短选最短。题目里出现π的时候,答案里带π的选项正确率特别高。甚至你还发现,当题目字数超过 100 字的时候,选 C 的概率居然有 99%。

你知道这些规律很扯,完全没有逻辑。但统计数据就是这么显示的,而且用起来是真的有效。于是你开始放弃推导,直接按规律蒙答案,成绩居然轻松提高到了 80 分。

这就是深度学习的崛起。机器不再试图理解问题的本质,而是通过分析海量数据找出统计规律。这听起来很不靠谱,但架不住它真的有用。

蒙答案也能成为一门学问

尝到甜头之后,你就上瘾了。你找来几万套试卷,疯狂地寻找各种规律。你甚至发现了题目字数、选项长度、标点符号数量和正确答案之间的关系。

这些规律荒谬到你自己都不好意思说出口,但就是管用。于是你干脆整张卷子都不算了,全按照这些规律蒙,成绩居然提高到了 90 分。

所有人都惊呆了,纷纷来问你怎么做到的。你把方法公开了,相当于把模型开源了。于是大家都开始用这套方法,再也没人去学那些复杂的公式了。

还有些人针对特定题型做更细致的规律总结,把分数提到 91 分、92 分。有人用多种方法同时蒙同一道题,然后选出现次数最多的答案,分数也能再提升一点。

这就是现在 AI 行业的真实写照。ChatGPT、Claude 这些大模型,本质上都是在找规律蒙答案。提示词工程、上下文工程、Harness 工程,全都是在想办法让这个会蒙答案的学渣少犯错。

原本通过刻苦学习是有可能考到 100 分的,但因为蒙答案就能考到 90 分,所以没人愿意走那条艰难的路了。

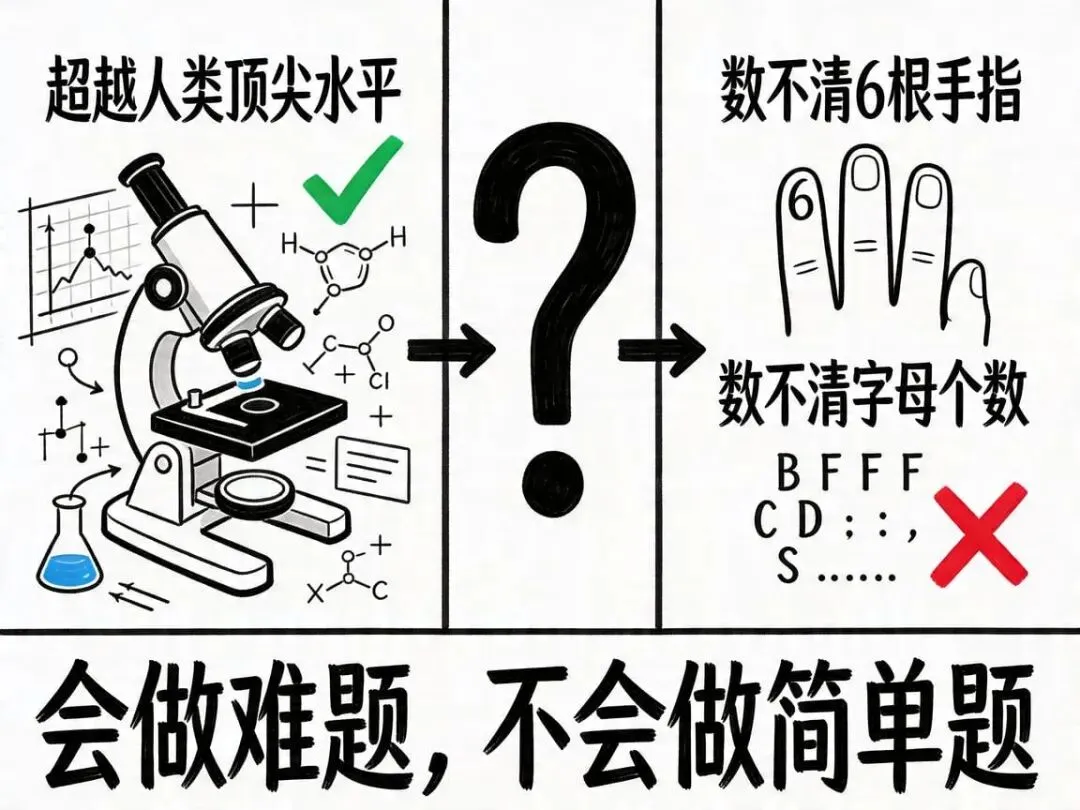

会做难题的学渣,数不清手指

这就出现了一个特别魔幻的现象。

这个靠蒙答案的学渣,在某些复杂问题上已经超越了人类顶尖专家。它能帮你分析基因序列,能写出漂亮的代码,甚至能在某些科研领域做出突破性发现。

但同时,它数不清一只手有几根手指。

你让它数一个单词里有多少个字母,它会信心满满地给你一个错误答案。你给它出个简单的脑筋急转弯,它会认真思考半天然后拍着胸脯说错。

为什么会这样?因为它根本不是真的在理解和推理,它只是在海量数据里找到了某些高频模式,然后把这些模式套用到新问题上。

复杂问题它见过很多类似的样本,所以蒙得准。简单问题反而因为太简单,训练数据里没有足够的相似案例,或者问题本身带有干扰性,它的统计规律就失效了。

这就是为什么 AI 能通过律师资格考试,却可能在小学数学题上翻车。它不是真的懂法律,只是见过足够多的法律文书,知道什么样的回答在统计上最可能正确。

所有人都在给学渣打补丁

现在 AI 行业的人都在干什么?都在想办法降低这个学渣犯错的概率。

告诉它做完题要检查一遍,遇到模糊的题目要先把题目补全,用多种方法交叉验证答案。这些就是所谓的 Agent、思维链、多轮对话这些技术。

本质上都是在给一个不靠谱的底层系统搭建各种防护栏,让它看起来更可靠一些。

问题是这个学渣越接近满分,提升就越困难。幻觉问题始终无法根除,因为它的底层逻辑就是概率游戏,不是真正的推理。

所以你会发现,最近一年 AI 技术好像没什么大突破了。开源模型慢慢追上了闭源模型,大家在智力上都被卡在了某个天花板下面。

于是行业开始卷应用、炒概念、抢流量入口。你感觉每天都有新名词冒出来,但实际能力好像也就那样。这不是错觉,这就是现状。

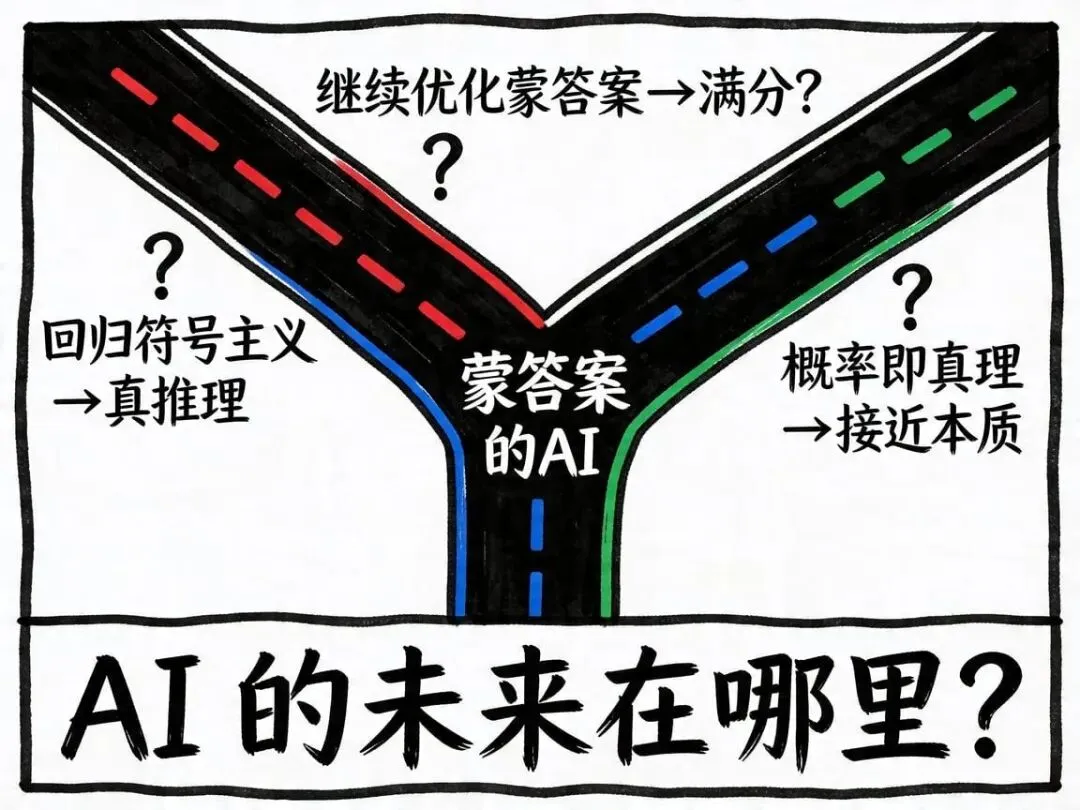

三条路,都不好走

那 AI 的未来会怎样?我觉得有三种可能。

第一种,继续优化蒙答案这条路,真的把试卷考到满分。如果这条路能走通,那现在做的这些工程优化就都是值得的。但问题是,靠统计规律真的能达到 100% 准确吗?没人知道。

第二种,退回到深度学习之前的符号主义,让 AI 真正学会那些数学公式,通过严格的逻辑推理来解题。这条路更靠谱,但也更难走。相当于放弃现在的 90 分,重新从 60 分开始爬,而且不知道能不能爬到 100 分。

第三种可能最哲学。也许这个世界的本质就是一团概率,我们现在这种蒙答案的方式,恰恰是在接近真理本身。人类的大脑说不定也是在做类似的事情,只不过我们给它起了个好听的名字叫直觉。

谁知道呢。

写在最后

想明白 AI 就是个会蒙答案的学渣之后,很多事情就说得通了。

为什么它有时候特别聪明,有时候又蠢得让人怀疑人生?因为它不是真的聪明,只是在某些领域见过足够多的样本。

为什么所有人都在卷工程而不是卷模型?因为模型的底层逻辑已经被卡死了,只能在应用层想办法打补丁。

为什么 AI 永远无法完全可靠?因为它的本质就是概率游戏,只要是概率就永远有出错的可能。

但这不代表 AI 没用。一个能考 90 分的学渣,在很多场景下已经够用了。关键是你要知道它的局限性在哪里,知道什么时候该信它,什么时候不该信。

就像你不会让一个学渣去做需要 100% 准确的精密计算,但你可以让他帮你处理那些大概率正确就行的事情。

这就是 AI 的真相。不神秘,也不神奇,就是个特别会考试的学渣而已。

只不过这个学渣考试考得太好了,好到让所有人都以为它真的懂了。

夜雨聆风

夜雨聆风