进入 4 月,OpenClaw 几乎每天发一个版本。

从 4.10 到 4.15,GitHub Release 页面刷得飞快。Twitter Trending 上 “Opus 4.7” 冲到科技榜第六。这一周的更新密度,放在整个 AI Agent 赛道里都算罕见。

一、这些版本到底干了什么?

表面看是版本号递增,实际是三波更新在同一周内落地:

- 第一波(4.10):地基重构

——Codex Provider、Active Memory、安全加固 - 第二波(4.11-4.12):本地模型支持

——LM Studio Provider、插件加载重构 - 第三波(4.14-4.15):顶级模型接入

——GPT-5.4 Pro、Claude Opus 4.7、Gemini TTS

不同用户关注的重点不一样:

二、普通用户:终于不用手动 “remember this” 了

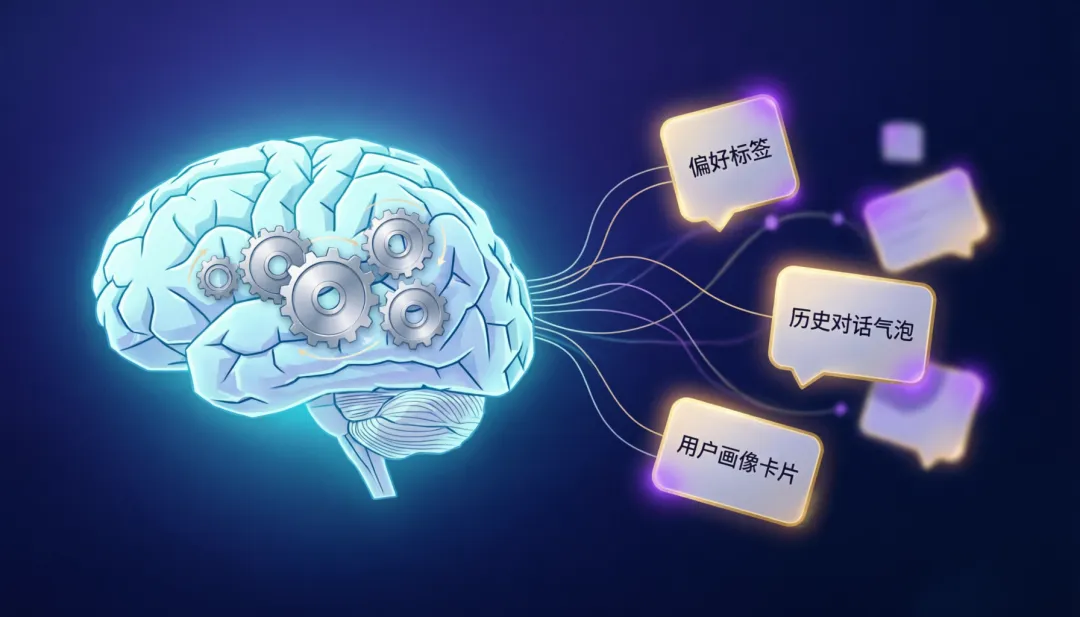

Active Memory:自动记忆召回

4.10 版本引入了 Active Memory。

之前你要让 OpenClaw 记住某件事,必须手动说 “remember this” 或 “search memory”。很多人根本不知道有这个功能,或者用着用着就忘了。

现在 OpenClaw 提供了一个可选的 Active Memory 插件,启用后会在每次对话前自动拉取相关的偏好、上下文、历史细节,不再需要手动触发。

启用方式在配置中开启即可。支持三种模式:message、recent、full context,还有 /verbose 实时检查和 transcript persistence 用于调试。

文档地址:https://docs.openclaw.ai/concepts/active-memory

Claude Opus 4.7:默认模型直接拉满

4.15 版本把 Anthropic 的默认选择改成了 Opus 4.7。

你不需要手动指定模型,OpenClaw 自动用当前最强的 Claude 版本。Opus 别名也映射到 4.7,图像理解能力绑定到这个版本。升完级,什么都不改,体验直接变好。

Model Auth Status Card:OAuth 健康一眼可见

4.15 还在 Control UI Overview 加了一张新卡片,显示:

OAuth token 健康状态 Provider rate-limit 压力 Token 即将过期 / 已过期提醒

以前排查 token 问题得翻日志,现在打开面板就看到。60 秒缓存,不浪费 API 调用。

三、本地模型玩家:终于有官方支持了

LM Studio Provider:不用自己折腾 endpoint 了

4.12 版本新增了 bundled LM Studio provider。

之前想用本地模型,要自己配置 OpenAI-compatible endpoint、处理模型发现、调试 stream preload。折腾半天还是报错的人不在少数。

4.12 直接给了官方方案:自动模型发现、memory-search embeddings 支持、stream preload 支持。该有的都有了。

Local Model Lean Mode:弱模型也能跑了

4.15-beta 加入了一个实验性配置:

agents.defaults.experimental.localModelLean: true

做的事很简单:丢弃 heavyweight default tools(browser、cron、message),把 prompt size 压下来。

显存不够、推理慢的本地模型,之前跑不动 OpenClaw 的完整 toolset。现在把重型工具卸掉,负载轻了,就能跑了。

Ollama timeout:慢模型不再被截断

4.14 修复了一个 Ollama 用户反馈很多的问题:流式 timeout forwarding。

之前 slow local runs 会继承默认 stream cutoff,你配置的长 timeout 被无视了。现在 forwarded timeout 真正生效,慢模型终于可以跑完整个推理过程。

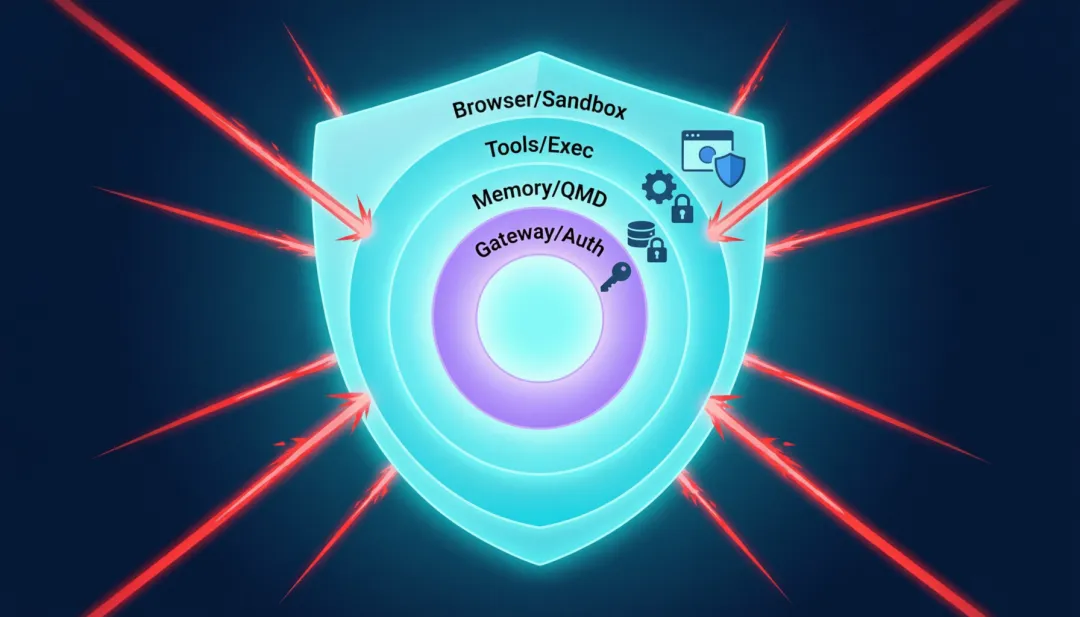

四、安全:四个版本的连续加固

这五个版本里有四次安全加固,覆盖面很广:Browser/Sandbox SSRF、Tools/Exec、Memory/QMD、Gateway/auth。

4.10:SSRF 全面硬化

严格默认 SSRF 策略 hostname allowlists interaction-driven redirects Docker CDP source-range enforcement

Tools/Exec 也一起收紧了:preflight reads、host env denylisting、node output boundaries、profile-mutation authorization。

相当于把整个安全边界推倒重画了一遍。

4.12:拒绝 placeholder token 启动

Gateway auth 增加了一道检查:如果检测到你用的是 shipped example .env 里的 placeholder token,直接拒绝启动。

原因不复杂:placeholder 是公开的,任何人都能拿来调用。忘了改,等于把钥匙放在了门口。

4.14:marked.js → markdown-it

底层渲染引擎替换。marked.js 有 ReDoS(正则表达式拒绝服务)风险,换成 markdown-it 规避。动静不大,但改的是底层。

4.15:MEDIA passthrough 信任锚定

修复 tool-result passthrough 的信任锚点问题。

之前 client-supplied tool 可能冒充 built-in tool,继承 local-media trust。现在锚定到 built-in tools 的 raw name,client tool names 如果 normalize-collide,直接 400 拒绝。

Memory-core/QMD 也收紧了:拒绝 arbitrary workspace markdown paths,只允许 canonical memory files。

思路很清楚:堵不住单个漏洞,就把整条路径关掉。

五、插件开发者:Manifest 终于有话语权了

Plugins Loading Narrowing(4.12)

插件系统的结构性重构。

之前 CLI/provider/channel activation 会加载很多 unrelated plugin runtime。你在 manifest 里声明了什么依赖不重要,系统会"顺便"加载一堆无关的东西。

4.12 改了规则:activation 严格按照 manifest-declared needs 走。Explicit scope 和 trust boundaries 得到保留,manifest-owner policy centralized。声明什么就加载什么,多余的不碰。

Setup Descriptors(4.11)

Plugin manifests 现在可以声明 auth、pairing、configuration 步骤。

之前这些步骤 hardcoded 在 core 里,每个 plugin 要自己适配。现在 manifest 直接写清楚,setup flow 自动读取。少了一层翻译,少了一堆适配代码。

六、升级建议

普通用户

直接升 4.15。没改过模型配置的用户会自动切到 Opus 4.7;已经指定了其他模型的不受影响,想切的话手动改一下 provider 设置。Active Memory 是可选插件,需要在配置中启用,启用后记忆召回才会后台运行。Model Auth Status Card 开箱可见,不需要额外配置。

本地模型用户

先升 4.12 拿到 LM Studio Provider 的官方支持,再开 4.15-beta 的 Lean Mode。显存不够的机器上也能跑起来。

插件开发者

4.12 必升。Manifest narrowing 让声明和加载对齐,runtime 泄漏堵住了。

这五个版本拆开看是密集的功能点,拼在一起看是一个完整的路线图:先把地基打牢(安全、记忆),再扩大覆盖面(本地模型),最后拉高上限(顶级模型)。节奏很清楚,意图也很清楚。

相关链接

GitHub Releases:https://github.com/openclaw/openclaw/releases Active Memory 文档:https://docs.openclaw.ai/concepts/active-memory Twitter Trending:Opus 4.7(Technology · Trending #6)

夜雨聆风

夜雨聆风