记一次 AI 产品使用感受。

今天遇到了一件十分诡异的事情

我在超星学习通答题时,把解题过程截图插入了富文本编辑框 —— 毕竟对富文本而言,支持图片是再普通不过的标配功能。提交后界面显示正常,也没有报错,可最终得分却低得离谱。反观其他同学,同样一道题只用几句纯文字说明,反而拿到了高分。

我不敢断言“图片一定没被看见”,因为我没法直接看到后端到底怎么处理了我的答案。也有可能 AI 真的读了图片,只是我的答案本身不够好。但不管哪种情况,这件事都把一个更关键的问题暴露出来了:我根本不知道 AI 在看什么。

我查到了什么

为了弄清楚这件事,我去翻了两份文档。

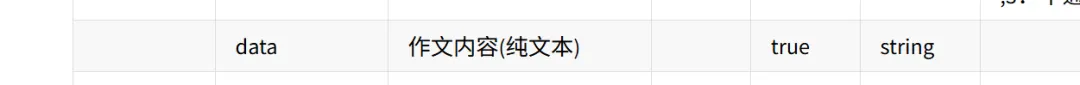

第一份是超星 AI 组卷/批阅 API 文档。它写得很直接:

这里只有纯文本。

第二份是 AI 批阅帮助文档。这份文档主要讲的是操作流程,对“AI 到底能理解哪些内容”完全没有说明。

所以我最后得到的信息其实很有限:

API 文档明确写了只支持纯文本;

帮助文档既没说支持图片,也没说不支持;

前端编辑器却是完整的富文本,能插图片、公式;

用户没有一个清晰、容易找到的地方,知道“图片会不会被 AI 读取”。

也就是说,前端给人的感觉是“你可以放心写富文本”,后端却可能只认纯文本。用户被夹在中间,却没人告诉他边界在哪。

问题到底在哪

这里先补一个概念:富文本相对于纯文本,支持的不只是字面内容,还包括格式、样式和嵌入媒体,比如图片、表格、加粗、颜色。

所以问题不是“前端是不是富文本”。前端确实是富文本,这没问题。

真正的问题是:用户在富文本编辑框里插入了图片,却不知道后面的 AI 能不能理解这张图片。

如果系统只支持文本,就应该明确说明;如果系统支持图片,就更应该写清楚。现在最别扭的地方在于:用户既拿不到确定答案,也找不到说明入口。

为什么这件事会让人不安

从工程上说,只支持纯文本并不奇怪。多模态模型要处理图片,通常需要额外的视觉编码器,token 消耗更大,推理延迟更高,成本也更贵。对教育平台来说,先只做文本批阅,是一个完全可以理解的取舍。

我没有意见的是这个取舍本身。

我在意的是:取舍做了,却没有告知。 以及 取舍做没做,用户不知道。

你叫“AI 批阅”,用户自然会以为系统会理解自己提交的内容。如果它只看文字,应该说清楚;如果它能看图片,也应该说清楚。对用户来说,这不是额外要求,而是最基本的信息透明。

更糟糕的是,这个问题不只发生在超星。现在很多产品都在悄悄接入 AI:客服、推荐、审核、评分,用户往往根本不知道自己正在和模型交互,也不知道模型的能力边界在哪里。

在传统互联网里,信息差已经很常见了。平台知道得比用户多,算法怎么运作、数据怎么被用,用户通常只能猜。

到了大模型时代,这种不透明反而更容易被合理化,因为 AI 的行为本来就更难解释。

但难解释,不等于可以不说明。

大模型的一个问题是,它不是稳定的规则系统。以前的推荐算法、审核规则,虽然黑箱,但同样输入大概率会得到同样输出,用户用久了还能摸出规律。大模型不一样:幻觉、多模态能力差异、输出波动,还有用户端的提示词注入导致的不公平性,这些都让结果更不稳定。同样一份答案,今天可能得高分,明天可能就低分。

在这种前提下,如果系统本身不透明,用户就更没有判断基础了。两层不确定性叠在一起,体验会非常糟糕。

所以核心不是“它到底支不支持图片”,而是“用户有没有权利知道它支不支持图片”。答案显然应该是有。

只要在编辑框或者批阅说明里加一句话,比如:

当前 AI 批阅支持的内容类型:文本 / 图片 / 公式

很多困惑其实就能避免。

关于 AI 教育与 AI 判分的迷思

无论如何,当前 AI 已经进入教育领域并得到初步应用,在这一背景下,“AI 能否担任阅卷人” 也一直是备受关注的热门话题。

有人可能会说,学术界已经在用 AI 给论文评分了,并且似乎要比人类评审评价更加公平公正,所以 AI 批阅当然可靠。

这个论据听起来很顺,但它混淆了两个完全不同的场景。

论文评分面对的是结构化程度很高的文本:摘要、方法、结论都有相对固定的格式,评价维度也更明确,训练数据更充分。即使真的判错了,作者仍然可以和同行 rebuttal battle 一番,容错率还是很大的。

但是,学生答题批改则完全不同,题型跨度大,表达方式多样,而且评分结果往往直接影响考试、升学甚至毕业,没有太多容错空间。

所以,“AI 能评论文”并不自动等于“AI 能批学生答题”。这个类比太方便了,只是一个过于美好的设想,在现实中,这种美好并不完全成立。

结语

但是,迷思归迷思,我真正想说的,也不是我那道题到底该得几分。

我想说的是:当产品开始把 AI 放进批阅、审核、推荐这些关键流程时,用户有权知道这里有 AI,它能做什么,不能做什么,以及它现在到底处理了哪些内容。

信息透明的成本其实很低。一行提示、一个标注、一句说明,就足够让用户做出知情选择。问题也不只是“说没说”,而是“说得够不够显眼”。

现在很多厂商其实不是完全不写,而是把 AI 声明塞进一长串免责声明里,用户不花很大精力根本发现不了。这种写法形式上像是“有告知”,实际上还是让用户在关键时刻看不到,和不说也没多大区别。

真正更有意义的做法,是在题目旁边、输入框旁边、批阅入口旁边直接加一条小提示。用户在做题的时候就知道这道题怎么判、AI 能看到文本还是图片,这才叫及时提醒。多这一行,不会损失什么;少这一行,用户就可能一直在猜。

选择不把提示放到用户最容易看到的位置,本质上还是选择了不透明。

夜雨聆风

夜雨聆风