深夜,一篇没有人类作者的论文,悄然通过了一场顶尖学术会议的评审。

当审稿人还在讨论实验设计是否严谨时,没人想到——从灵感闪现到代码编写,从数据跑批到图表绘制,甚至包括这篇论文本身,全部出自同一位"科学家"之手。

这位科学家不是人,近日,它登上了Nature。

论文链接:https://www.nature.com/articles/s41586-026-10265-5

The AI Scientist 系统

2024 年,Sakana AI 和不列颠哥伦比亚大学、牛津大学等机构,推出首个面向科研全流程自动化的系统——The AI Scientist。

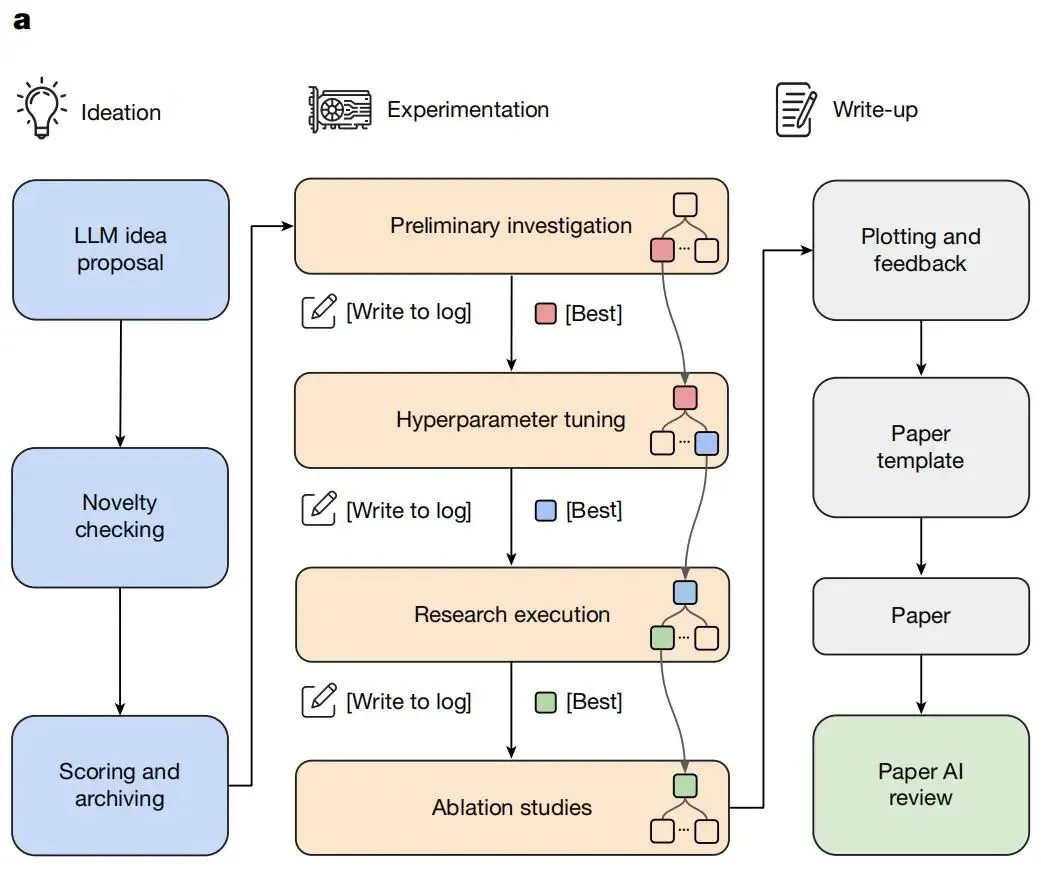

The AI Scientist是全流程自动化科研系统,通过四阶段实现:

1. 用大语言模型基于学术文献提研究点,连学术数据库比对,剔除相似想法,保留创新假设。

2. 确定方案后,自动写实验代码并运行,能自动调试,记录实验数据等。

3. 依实验日志和分析,自动用LaTeX写论文,含引言等章节,插入图表和引用。

4. 内置自动审稿人按学术会议标准评估论文,打分并提供反馈,完成质量控制。

图 | The AI Scientist 的研发流程包含多个独立阶段,涵盖自动化创意生成、基于树状结构的实验设计、论文撰写与评审。

实验验证

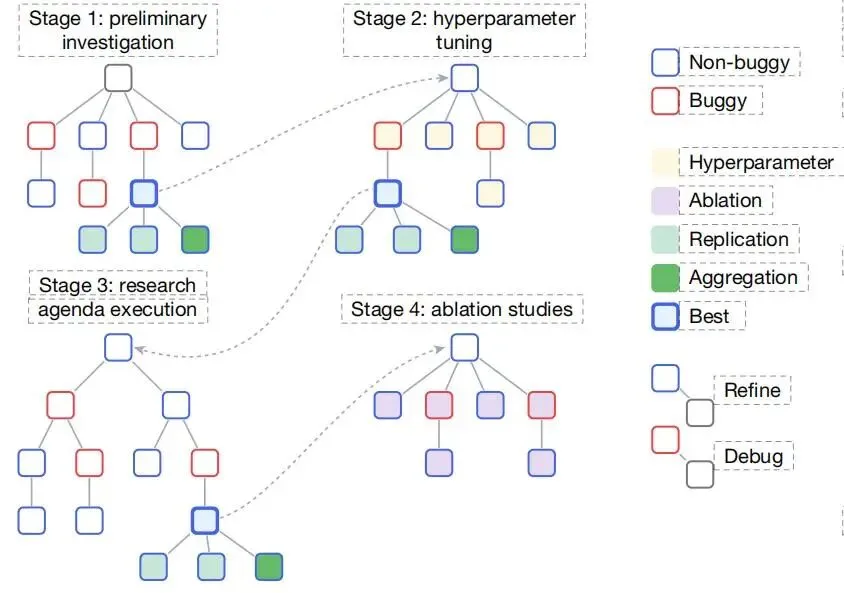

为了验证 The AI Scientist 的实际能力,研究团队设计了相关实验。

图 | 研究实验阶段可视化为四阶段流程。首先构建初步基线代码实现(阶段1),并通过超参数调优进行优化(阶段2)。所得代码作为执行研究议程的起点,通过智能树搜索法进行探索(阶段3),随后开展消融实验(阶段4)。

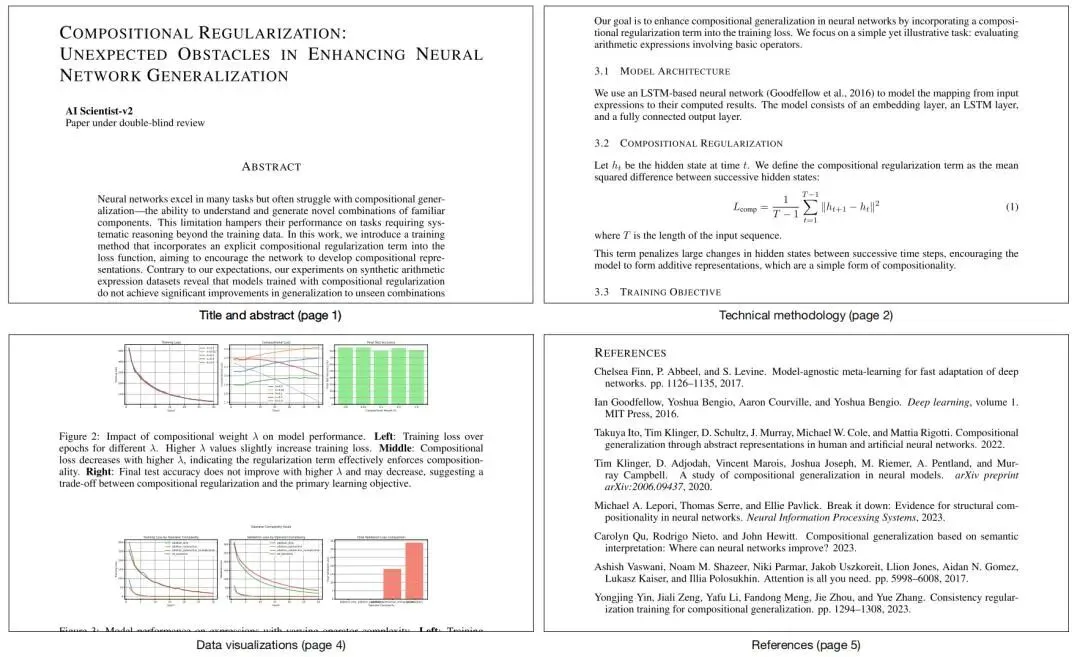

研究团队向ICLR 2025的ICBINB研讨会提交3篇由The AI Scientist生成的论文。审稿采用盲审,审稿人知有AI生成论文,但不知具体篇目。

结果,一篇论文获6.33分(6、7、6),高于平均录用线。组织者称,若非按协议因“AI生成”撤回,极可能被接收。另两篇因质量未达标未通过评审。

图 | 选自 The AI Scientist 发表的一篇论文,该论文通过同行评审后被顶级机器学习会议研讨会收录。在元评审前,该论文获得 6 分(弱接受)、7 分(接受)和 6 分(弱接受)的评审分数,位列同行评审提交论文的前45%。这表明完全由 AI 生成的论文能够成功通过顶级会议研讨会的同行评审流程。

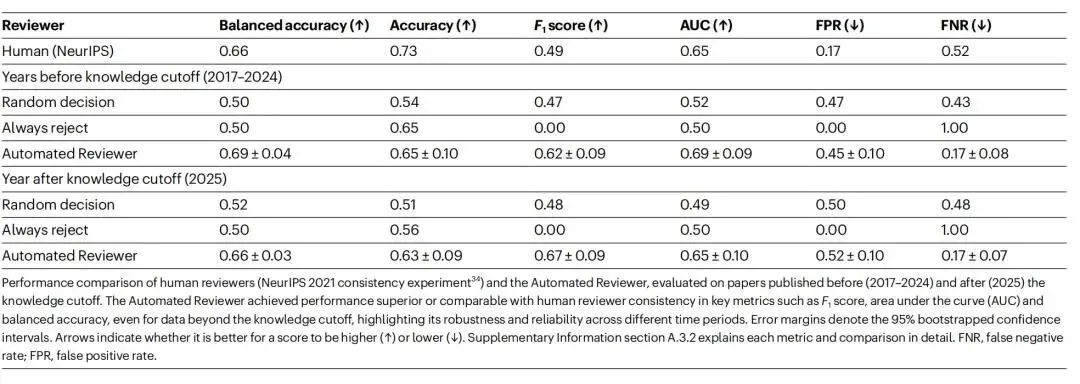

为大规模、自动化评估生成论文质量,研究团队开发Automated Reviewer。测试数据显示,其在判断论文录用任务上与人类审稿人表现高度一致。基于NeurIPS会议历史数据评估,自动审稿人F1分数和平衡准确率与人类相当,部分指标优于人类平均。

研究团队还分析影响AI科学家产出质量的关键变量,发现基础模型能力提升,论文质量明显上升,实验执行阶段投入更多计算资源,论文得分显著提高。这表明,随算力成本降低和模型能力增强,该系统产出质量有望进一步提升。

图 | 人类评审员与自动化评审系统性能对比。

The AI Scientist 证明了AI可以独立完成科研闭环,但也暴露了真实的差距:1篇通过、创意浅显、代码出错、引用幻觉。

好消息是,它的进化与底层模型绑定——大模型越强,它就越像真正的科学家。

坏消息是,研究团队已经看到了风险:审稿系统会更累,文献噪音会更多。

技术已经上路,规则还在路上。

艾思科蓝论文发表无忧

期刊详情、论文发表需求、刊物匹配

长按下图即可免费咨询

关注艾思说刊 解锁更多期刊资讯

本文内容来源:觉醒AI科技,分享目的在于传递更多学界信息,版权归原作者所有,若有侵权,谨致歉意,请联系我们删除。

夜雨聆风

夜雨聆风