AI产品经理必学:大模型核心知识拆解本文专为AI产品经理量身定制,避开复杂的技术细节,直击大模型核心逻辑。我们将从训练流程、推理机制、核心概念和能力边界四大维度切入,通过通俗易懂的语言和实战案例解析关键知识点。核心目标在于帮助AI产品经理快速掌握大模型规律,高效实现技术对接与需求把控,规避产品设计中的常见陷阱。对于产品经理来说,重点在于掌握可落地的核心逻辑,而非深究技术细节。一、大模型是怎么训练出来的?

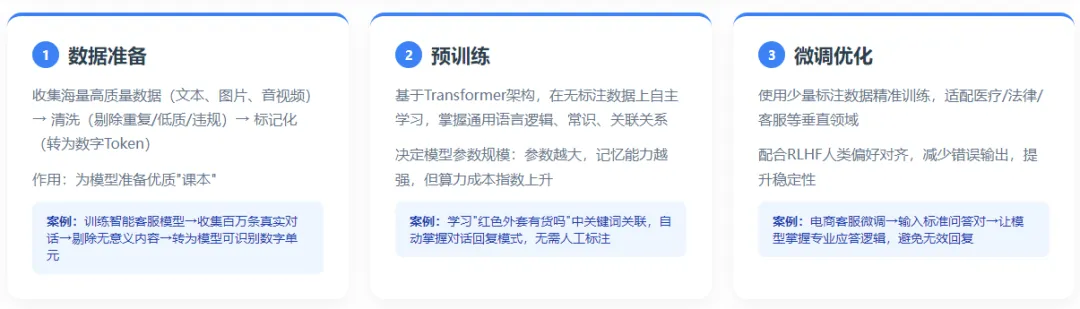

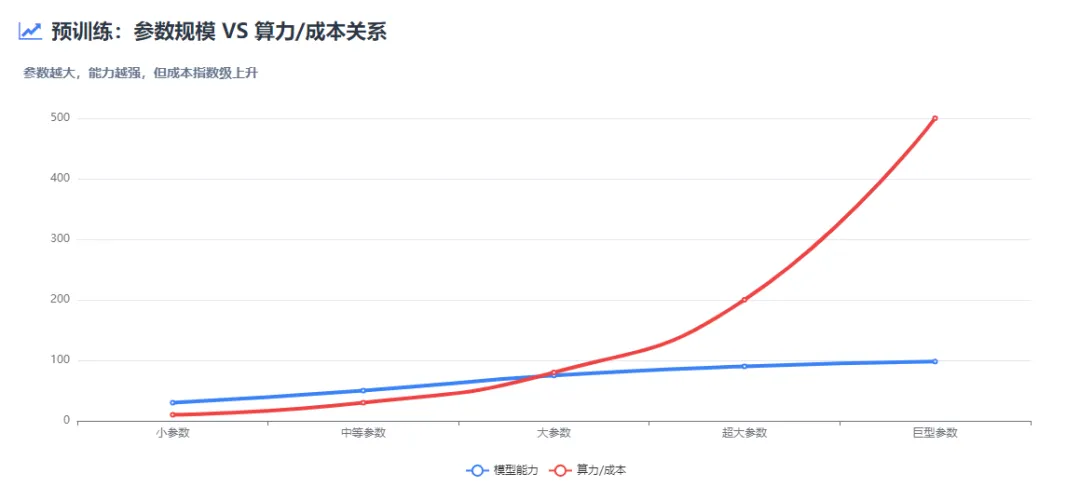

大模型训练的本质可理解为"通过海量数据学习规律",这与人类"通过阅读获取知识"的过程异曲同工。整个过程可归纳为三个核心步骤:数据准备:先收集海量高质量数据(文本、图片、音视频等),再做清洗(剔除重复、低质、违规内容),最后进行标记化处理【将文本、图片等转化为模型可识别的数字单元】,把文字转化为模型能识别的数字单元,相当于给模型“准备优质课本”。案例:训练一个智能客服大模型,会收集百万条真实客服对话(如“我的订单怎么退款”“物流多久到”),剔除无意义对话(如“哈哈”“哦”),再将对话转化为模型可识别的Token(数字单元),供后续学习。预训练:基于Transformer架构【大模型的核心基础架构,好比大模型的“大脑”,负责处理数据关联关系】,让模型在无标注数据【未人工标记类别、答案的原始数据】上自主学习,核心是掌握通用规律(比如语言逻辑、常识、结构关系)。这一步会同时决定模型的参数规模【模型中可调整的权重数量,决定模型记忆和拟合能力】,参数越大,理论上记忆与拟合能力越强,但算力、推理成本也会指数级上升。案例:在预训练阶段,当模型接收到"我想买一件红色的外套,请问有货吗?"这样的输入时,它会自动学习"红色"、"外套"和"有货吗"这些关键词之间的关联,同时掌握此类询问的典型回复模式(例如"有的,请问需要什么尺码?")。整个过程无需人工提供标注答案。微调优化:通过少量标注数据(人工标记的类别和答案,用于精准优化模型的数据集,如行业对话和任务示例)进行持续训练,可使模型更好地适应特定领域( 如医疗、法律、客服 ),这类似于"大学选择专业进行深造"。同时,采用人类偏好对齐技术(RLHF,即通过强化学习从人类反馈中学习,使模型输出更符合人类需求),能有效减少错误输出,提高结果的稳定性。案例:在电商客服场景微调中,我们将向模型输入标注好的对话样本(如用户提问:"订单退款多久到账?",对应标准回复:"退款将在1-3个工作日到账,款项将原路退回您的支付账户")。通过这种训练方式,使模型掌握电商场景的专业应答逻辑,避免生成"不清楚"或"请咨询客服"等无效回复。训练的核心在于数据质量而非数量,同时需要强大的算力支持(通常采用GPU集群来实现模型训练/推理的计算需求)。大多数企业不会从零开始训练大模型,而是基于开源基座(指开源的基础大模型,可在其基础上进行微调优化以降低开发成本)进行微调。案例:某初创公司计划开发智能办公助手,他们不打算从零开始训练模型,而是选择基于开源基座模型Llama2进行微调。通过使用公司内部的办公文档、会议纪要等数据,快速适配特定办公场景。这种方法能显著降低开发成本并缩短项目周期。二、大模型如何推理生成答案?

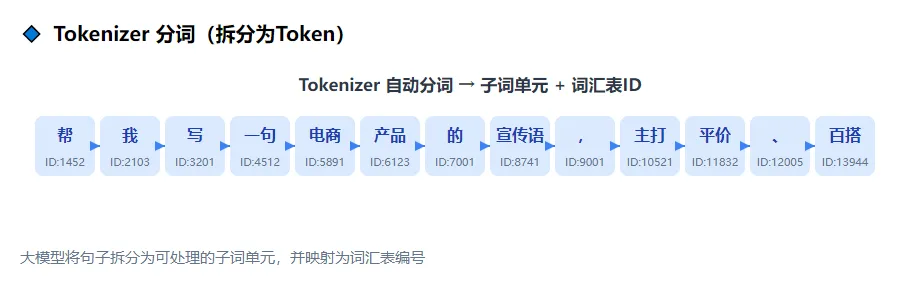

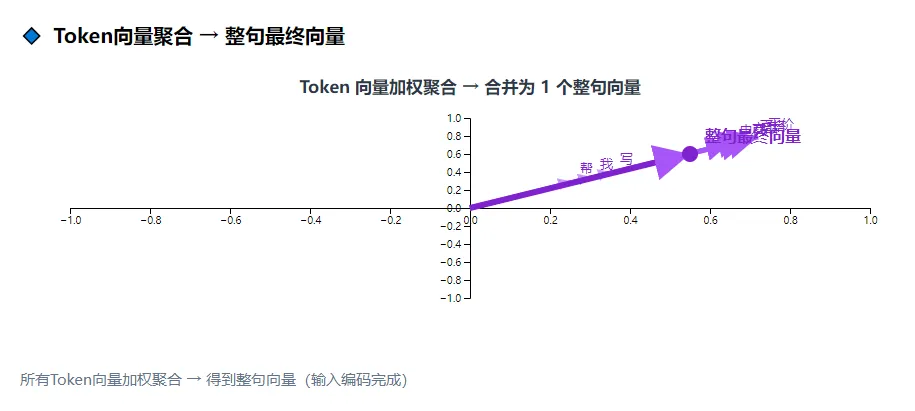

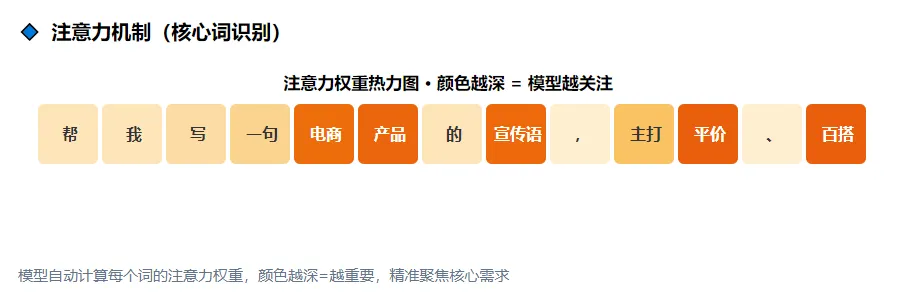

推理(即大模型接收输入后生成输出的过程)并非"模型在思考",而是通过训练获得的概率规律,通过逐词预测生成最合理回答的运算过程。让我们具体分析一下与AI对话的交互过程,如下所示:输入编码:将用户输入的提示词(Prompt)转换为模型可识别的向量(即模型能够理解的数字化表示形式),并根据上下文长度限制对历史对话进行截断或保留处理。注意力机制(Transformer架构的核心组件):通过分析输入内容的关联关系和重点信息,帮助模型准确识别问题核心并保持上下文连贯,有效避免答非所问的情况。逐词概率预测:每次只预测下一个最可能出现的词,循环生成直到结束。输出解码:将模型生成的数字向量转换为自然语言文本。通过调节温度参数(temperature)可控制输出的随机性:数值越高输出越多样化,数值越低则越精准稳定。我们模拟一个实际应用场景:用户在AI聊天窗口输入"帮我写一句电商产品的宣传语,主打平价、百搭",AI系统完整的响应流程如下:1.输入编码:将用户输入的这句话(“帮我写一句电商产品的宣传语,主打平价、百搭”)转化为模型可识别的向量;2.注意力机制:模型识别出核心关键词——“电商产品宣传语”“平价”“百搭”,明确用户需求是生成贴合这两个核心卖点的宣传语,忽略无关信息;

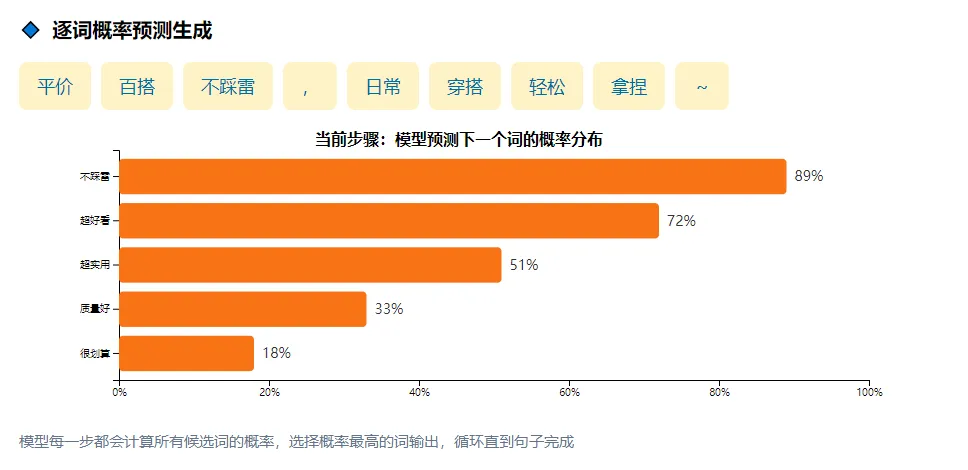

3.逐词概率预测:模型基于训练时学到的“宣传语规律”,先预测第一个词“平价”(概率最高),再预测下一个词“百搭”,接着预测“不踩雷”(贴合宣传语语气),循环预测直到生成完整句子“平价百搭不踩雷,日常穿搭轻松拿捏~”;

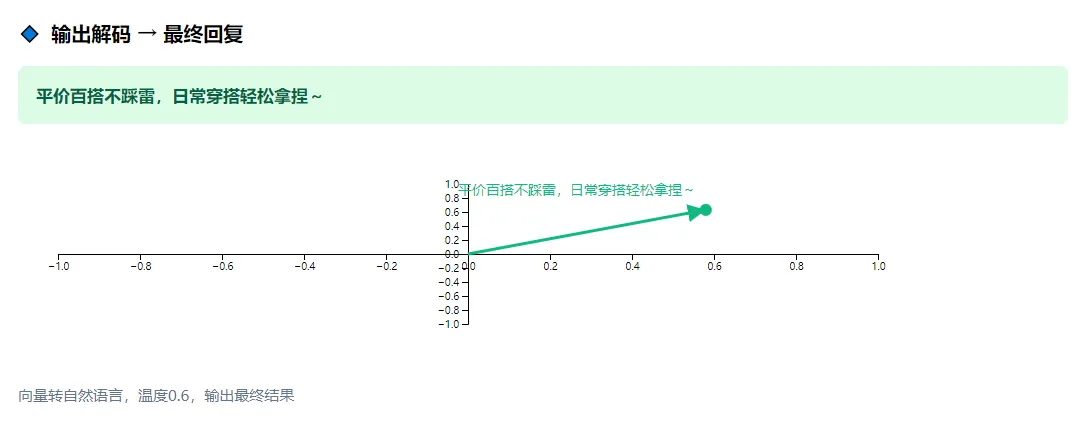

4.输出解码:将模型生成的数字向量,转化为人类可理解的自然语言(即上述宣传语),同时因温度参数设为0.6(中等随机性),避免生成过于生硬或杂乱的内容,最终将这句话反馈给用户。

三、大模型核心概念解析

掌握以下核心概念,能快速对接技术、理解模型能力,为后续产品设计和选型打下基础。(一)大模型核心架构类型

大模型架构直接决定模型的能力上限、速度和适配场景,不同架构各有侧重,无需深入底层实现,重点掌握其核心特点和应用场景即可:Transformer架构【大模型通用核心架构,贯穿文本、图像、语音等多模态场景】:

核心特点:擅长捕捉全局关联(文本的语义关联、图像的全局特征、语音的时序关联),灵活性强,可适配多模态融合,推理速度中等;

应用场景:几乎所有大模型的基础架构(文本模型核心架构、图像/语音/视频模型的辅助架构),如文本问答、图像理解、语音时序特征捕捉等。

案例:ChatGPT、文心一言等文本对话模型,核心架构均为Transformer,能精准捕捉“我想买外套,要黑色的”中“外套”和“黑色”的关联,生成贴合需求的回复。

Diffusion(扩散模型)架构【图像生成领域主流架构】:

核心特点:通过“逐步去噪”的方式生成内容,擅长高保真生成,细节还原度高,但推理速度较慢、算力消耗大;

应用场景:重点用于图像生成类产品(如图文生成、图像编辑、AI绘画),是图像生成模型的核心架构。

案例:Stable Diffusion(开源图像生成模型)采用Diffusion架构,用户输入Prompt“平价百搭的黑色外套,简约风格,实物图”,模型通过逐步去噪,生成贴合描述的外套图片,细节(如面料、版型)还原度高。

Conformer架构【Transformer的衍生架构,适配语音场景】:

核心特点:融合Transformer的全局捕捉能力与CNN的局部特征提取优势,提升语音时序特征捕捉效率,抗噪音干扰能力更强;

应用场景:语音模型专属架构,用于语音识别、语音合成、语音转写等场景(如智能语音助手、实时转写工具)。

案例:微信语音转文字功能,核心采用Conformer架构,能在嘈杂环境下(如地铁、商场),精准识别语音内容并转写为文字,减少噪音带来的识别错误。

3D-CNN架构【视频模型核心辅助架构】:

核心特点:擅长捕捉视频的空间特征(如画面细节、物体形态),搭配Transformer可兼顾时序特征;

应用场景:视频模型专属,用于视频帧识别、动作识别、视频分析等(如视频剪辑辅助、智能监控分析)。

案例:某智能监控系统采用3D-CNN架构,能精准识别视频中“人员闯入”“物品移动”等动作,及时发出预警,适配安防场景。

(二)大模型的核心能力指标

大模型核心能力指标(模态、参数规模、上下文长度)直接决定 AI 产品功能边界、体验效果与成本选型,是产品经理设计、选型与落地的核心依据。

1. 模态:就是模型能理解和处理的数据类型

单模态【仅能处理一种类型数据的模型能力】:只处理文本(问答、摘要、写作)。案例:早期的智能问答机器人(如百度知道机器人),仅能处理文本输入,无法识别图片、语音,用户发送图片咨询“这个外套是什么颜色”,无法给出准确回复。

多模态【可同时处理文本、图片、语音、视频等多种类型数据的模型能力】:同时支持文本+图片+语音+视频,能看图理解、看图写作、语音对话。案例:抖音AI助手,用户可发送一张外套图片+语音“帮我写一句这个外套的宣传语”,模型能识别图片中的外套款式(如休闲款、工装款),结合语音需求,生成贴合的宣传语,实现多模态协同。产品层面直接决定:能不能做识图问答、文档解析、音视频总结等功能。案例:做一款“图文笔记助手”产品,若选用多模态模型,用户可上传笔记图片+文本提示“帮我总结重点”,模型能识别图片中的文字和图表,生成完整总结;若选用单模态文本模型,则无法识别图片,无法完成需求。2. 参数规模:指大模型神经网络中可训练参数的总数量,是衡量模型容量、复杂度与表达能力的核心指标,通常以十亿(B)为单位)

常见量级:1B~7B~13B~70B+【大模型核心单位说明——Token(令牌),即模型处理的最小单元,1个Token约等于1个英文单词或2-3个中文字符,用于计算上下文长度、API调用量】;KB【计算机存储单位,1KB=1024字节,用于衡量模型文件大小、数据存储量,与Token无直接对应关系,仅用于部署时的存储评估】参数越少,速度快、成本低、适合终端轻量使用,但复杂任务表现弱。案例:手机内置的AI助手(如苹果Siri、华为小艺),多采用7B及以下参数模型,能快速响应“打开相机”“设置闹钟”等简单指令,但无法完成复杂任务(如撰写完整的产品方案)。参数越多,模型理解、推理、创作能力越强,但更慢、更贵、更吃硬件。案例:GPT-4(70B+参数),能撰写完整的产品需求文档、进行复杂的逻辑推理(如“分析电商平台用户流失原因并给出解决方案”),但推理延迟较高(约1-3秒),API调用成本也远高于小参数模型。产品原则:够用就好,不强求参数越多越好。案例:做一款轻量的“文案润色助手”,仅需优化文案流畅度、修正语病,选用7B参数模型即可,速度快、成本低;若做一款“企业战略咨询助手”,需要复杂逻辑推理和专业分析,则需选用13B及以上参数模型。3. 上下文长度(上下文窗口)

指模型一次性“记住”的文本总量,常见:4k/8k/16k/32k/128k【k=1000,单位为Token,即模型可同时处理的文本Token数量;4k Token约可处理8000-12000个中文字符,足够日常多轮对话、短文档处理;128k Token可处理长文档、长代码等场景】

决定能不能读长文档、长对话、长代码。案例:用户上传一份5000字的产品说明书,要求模型“总结核心功能”,若模型上下文长度为4k Token(约8000字),可完整读取文档并总结;若模型上下文长度为2k Token(约4000字),则无法完整读取文档,会遗漏部分内容,导致总结不全面。上下文越长,推理速度越慢、显存【用于存储模型和数据,支撑模型推理的硬件存储单元】占用越高。案例:处理10万字的小说摘要,选用128k上下文的模型,能完整读取小说内容,但推理速度约5-10秒;若选用4k上下文的模型,需分多次上传文档,且容易出现上下文断裂,影响摘要连贯性。做产品设计的时候需要考虑,是否支持长文档摘要、多轮记忆、本地知识库检索增强【RAG,通过检索外部知识库补充模型信息,减少幻觉】。案例:做一款“长文档分析助手”,需支持用户上传10万字的行业报告并分析重点,就必须选用32k及以上上下文长度的模型,同时搭配RAG检索增强,避免模型因上下文过长出现失忆或幻觉。四、大模型的能力边界

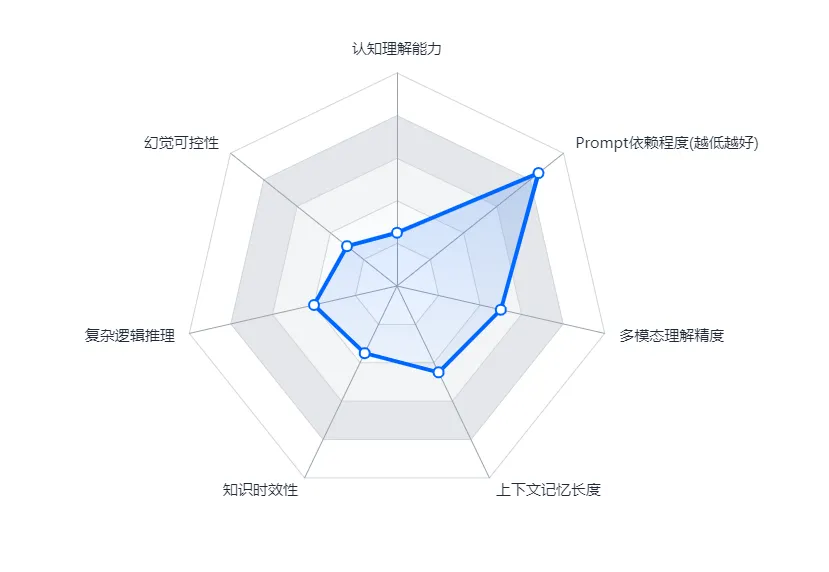

了解大模型的能力边界,能避免产品设计中出现“过度依赖模型”“需求无法落地”的问题。认知理解能力:没有真正的理解与意识,只是概率拟合【模型通过学习数据规律,预测最可能的输出,而非真正理解内容】,不是真“懂”,所有输出均基于训练数据的规律,无自主思考能力。幻觉可控性:会产生幻觉(核心缺陷)【模型输出不存在、不准确的信息,类似“瞎编”】:没见过的知识、模糊的指令或复杂场景下容易瞎编,尤其实时信息、专业数据、小众知识点,且部分幻觉难以快速识别,需人工校验;即使是头部模型,也无法完全规避幻觉问题,仅能通过RAG检索增强、Prompt优化降低幻觉率。复杂逻辑推理:只能进行有限的复杂逻辑,多步数学、强推理、强因果容易出错,无法像人类一样进行深度逻辑推导,尤其在跨领域复杂任务中,易出现逻辑断层、结论矛盾。知识时效性:时效性滞后(实时性不足)【模型训练数据有固定截止时间,无法获取训练后新增的实时信息】:训练数据截止后发生的新事件、新政策、新数据均无法识别,需通过工具调用(如搜索引擎)补充实时信息,否则会输出滞后或错误内容,无法适配强实时场景(如实时新闻解读、实时数据查询)。上下文记忆长度:由于上下文长度有限,模型无法记住超过上下文长度的历史内容,存在“短期记忆”局限。超过上下文窗口长度(如4k、8k Token)会“失忆”,无法关联早期对话或长文档中的关键信息;即使在上下文窗口内,长对话后期也可能出现记忆偏差、信息遗漏,影响多轮交互体验。多模态理解精度:多模态仍有局限性,复杂图表、手写、模糊图片容易理解偏差;同时单一模态模型存在各自明显缺点(如图像模型角色不一致、语音模型口音适配差),不同架构(Diffusion、Transformer等)的模型在速度、效果上各有优劣。提示词依赖程度:重度依赖提示词(Prompt),模型输出质量高度依赖用户提示词的清晰度、完整性和专业性。若提示词模糊、不具体或缺乏引导,模型会输出偏离需求、质量低下的内容;即使是同一模型,不同Prompt引导下的输出差异极大,需通过Prompt工程优化才能发挥模型效果,增加了用户使用和产品设计的门槛。

夜雨聆风

夜雨聆风