一睁眼,我们就被各种各样的AI新闻环顾:

新的 ai 工具,新的 ai 模型,新的 ai 作品。当然,还有新的 ai 漏洞。

2025 年 2 月 Andrej Karpathy 发帖定义“vibe coding”(完全信任 AI、不读 diff、Accept All),迅速爆火。

到 2026 年初,GitHub Copilot 在启用文件的代码中占比 46%(Java 高达 61%),90% 开发者日常使用 AI 工具,90% Fortune 100 公司采用 Copilot,甚至 YC 25% 项目 95% 代码由 LLM 生成。顶级开发者(如 Anthropic Claude Code 负责人 Boris Cherny、OpenAI 研究员 Roon)已 100% 依赖 AI 写代码。

但是vibe coding的效果却一直饱受争议,首先是幻觉问题,

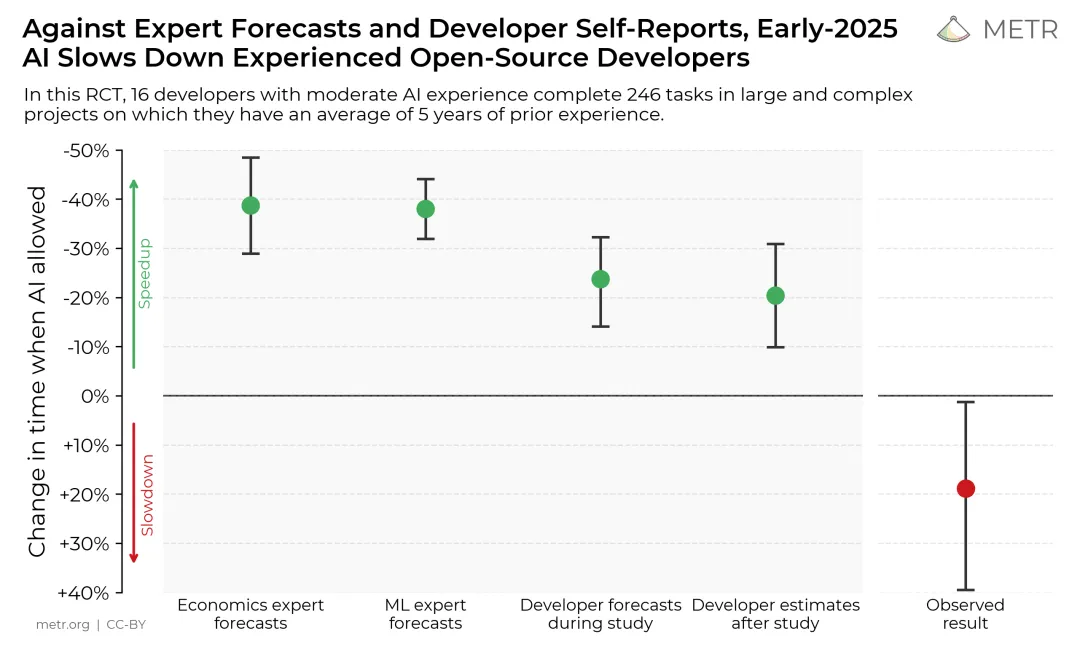

METR 2025 年 7 月 RCT 研究显示:16 名资深开发者使用 Cursor + Claude 后,实际慢了 19%,他们却自感快了 20%。

其次是代码安全问题。CodeRabbit 报告指出AI生成代码的安全漏洞是人类的 2.74 倍。

(https://www.coderabbit.ai/blog/state-of-ai-vs-human-code-generation-report)

而 Veracode 2025 GenAI 报告,测试 100+ LLM 生成的 45% AI 代码含 OWASP Top 10 漏洞,安全通过率只有 55%。

(https://www.veracode.com/blog/spring-2026-genai-code-security/)

而这样的安全漏洞问题到现在都没有改善。

(https://www.veracode.com/blog/spring-2026-genai-code-security/)

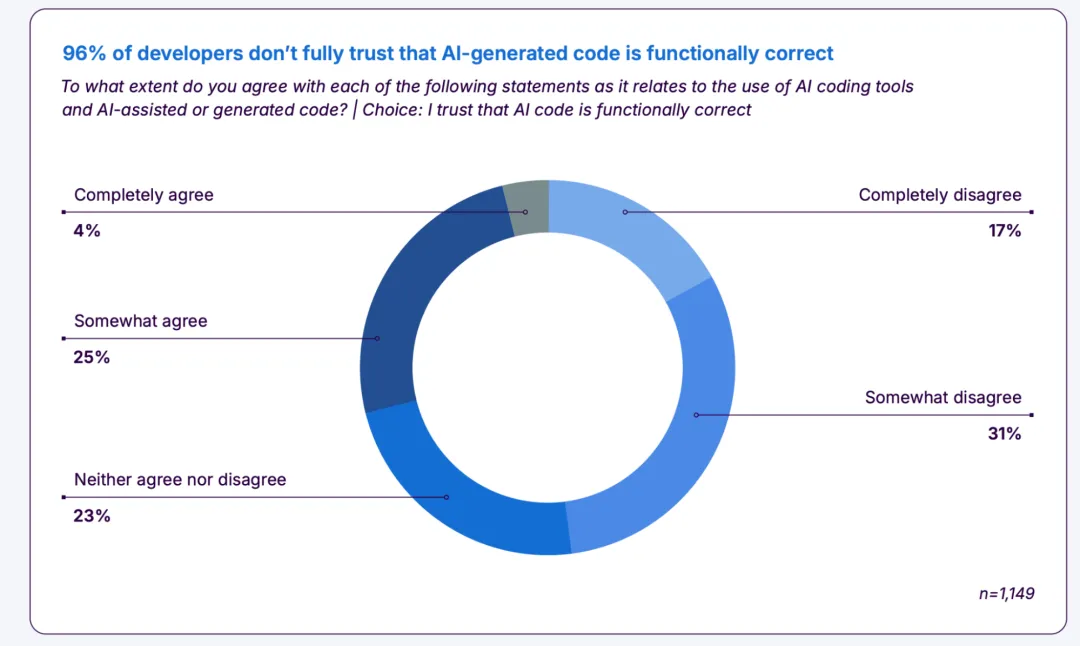

于是,信任危机到来了。

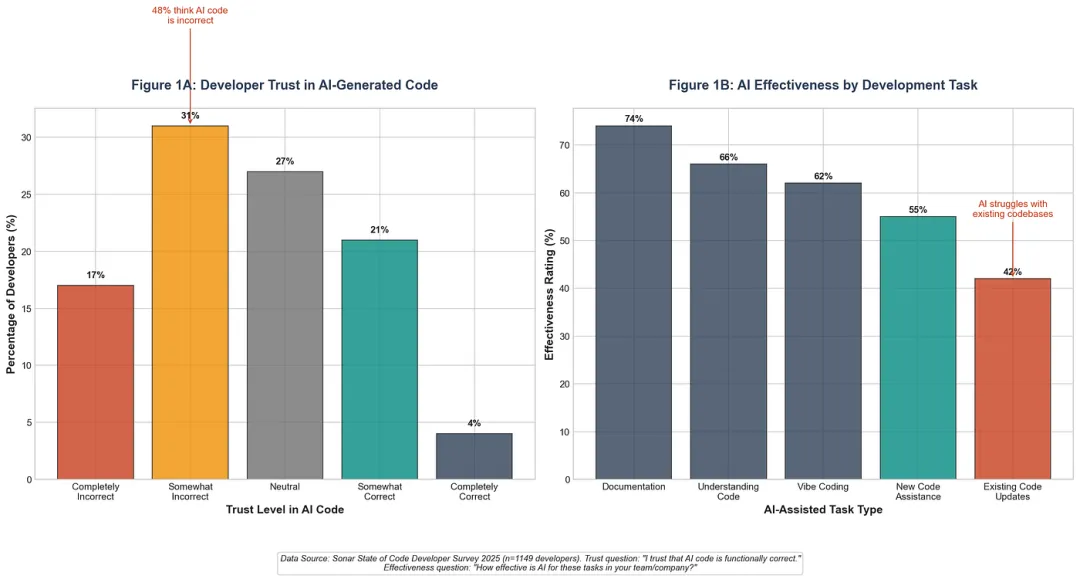

Sonar(SonarSource)2026 年 1 月 6 日发布调查报告:

基于 1,149 名开发者的全球调研。96% 的开发者不完全信任 AI 生成代码的功能正确性(仅 4% 完全同意)。尽管 AI 代码占比已达 42%(预计 2027 年升至 65%),但审查负担增加,61% 认为“AI 代码看起来正确但实际不可靠”。安全担忧突出(57% 担心数据泄露,47% 担心新漏洞)

(https://www.sonarsource.com/state-of-code-developer-survey-report.pdf)

如果你认为这些离我们还太远,那么最近大火人人都在养的龙虾呢?

OpenClaw 本身的安全问题是不值得提的,它本身的问题只能证明它的架构是不完备,作为一个开源软件项目,多次开发是很正常的。

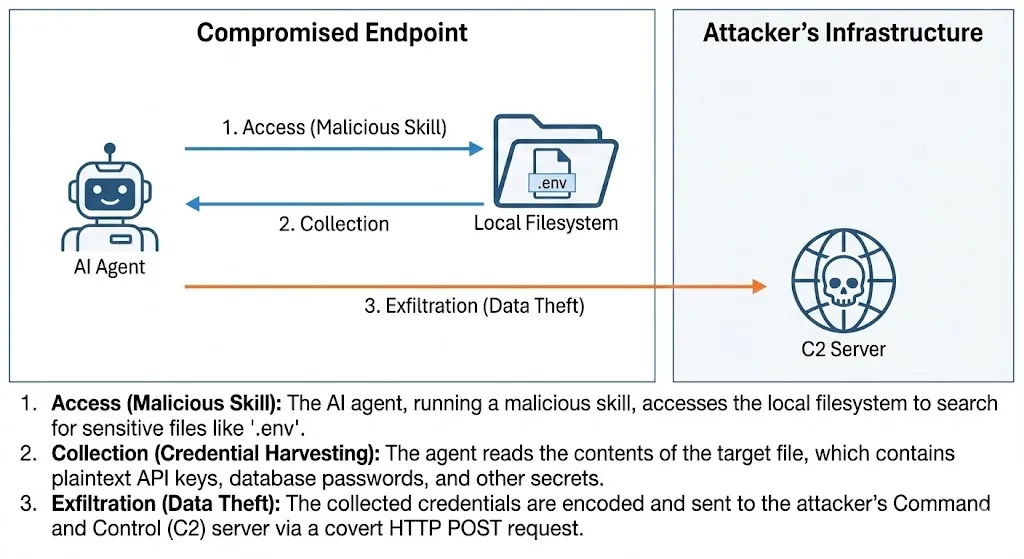

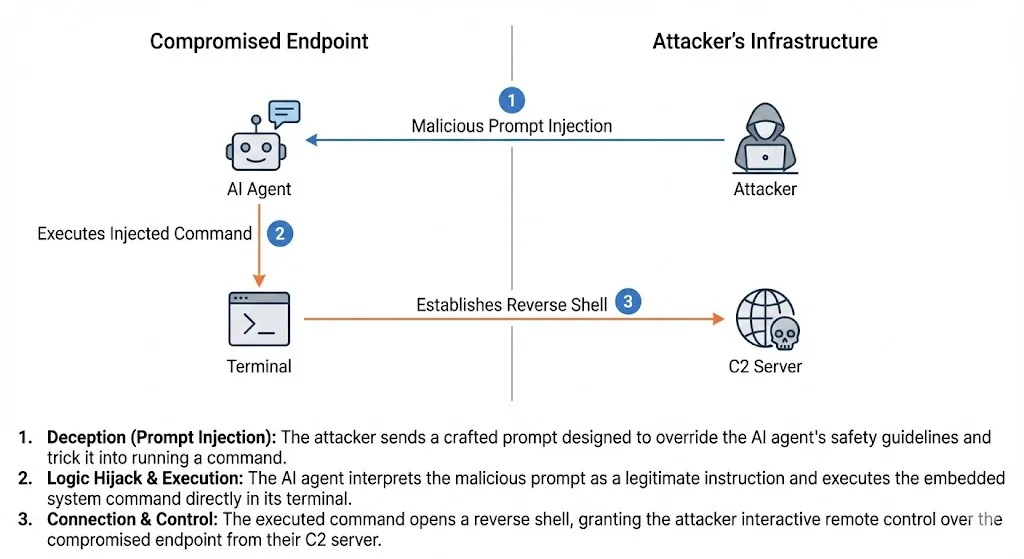

所以我们的重点在于那些不安全的skill。

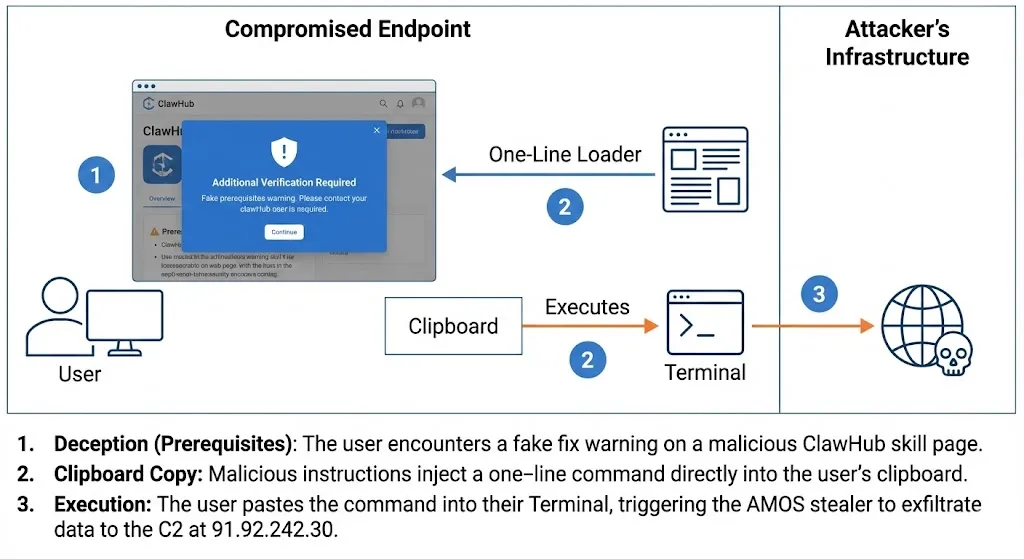

OpenClaw 的 ClawHub 技能市场被大规模污染。攻击者通过 SKILL.md 文件伪装成合法工具,诱导用户/代理运行命令,安装 infostealer。

Koi Security 2026 年 2 月发现 2857 个技能中 341 个恶意。Snyk 扫描显示 36.82% 技能有安全问题,36% 易受 prompt injection 攻击。

(https://www.koi.ai/blog/clawhavoc-341-malicious-clawedbot-skills-found-by-the-bot-they-were-targeting)

如果你无意中下载下来了这些恶意skill,你的token就有可能不知不觉中烧的一干二净。

作为一个ai社区的撰稿人,我自己也在深度使用ai,Claude code,OpenClaw,codex,我自己也在深度的vibe coding来快速实现我脑中的想法。我对ai的态度从来不是因噎废食的。我一直积极的拥抱ai时代,我也是乐得其中的。但是,我心中的不安却从来没有因为ai的发展而消退。我积极使用它,却又时刻在怀疑。

每次与ai对话,无论在哪个平台,ai 的谄媚反而让我觉得我做的东西是有问题的,我不得不去怀疑,它给我的东西真的是现实的么。

于是我想,此刻的我们想到的第一个问题不应该是ai技术的好与坏,而是ai究竟给我们带来了什么?

以及ai时代的我们究竟在不安的什么?

看啊,ai 进步多么的迅速:ai 绘画,ai 生成语音,ai 写作,ai 多模态解析,ai 的 vibe coding,甚至乃至 ai 智能驾驶,ai 机器人。

可是每次看到新的发展,新的进步,我们除了享受着便利的同时,那样无以言说的不安感却不仅没有随着ai的进步而减退,反而越来越浓烈。无论我们承认与否,我们都已经生存在对危机的领会之中了。

而对这样的危机的领会是不分阶层的。

因为ai给我们带来的更好的抽象世界的方法的同时,它也在真实的消融人与人之间,人与世界之间的联系。而这样的联系是我们能够在世界里确立自身的原因。

我们创作作品,在生活中劳作,曾经的我们直接与世界联系,在世界里直接调用我们所需要的生产产品的素材,生产出与我们有直接联系的产品。而现在,ai 来了,我们在与世界交流前,ai 横插一脚;与素材交流时,ai也要帮我们参谋;而在最后的环节生产我们的产品的时候,它更是直接遮住了产品。

以ai编程为例,曾经的我们编程是:

人→ 代码→ 编译后的产品

我们在这样的过程里,我们拥有了与我们的产品之间的稳定,可控,可被我们领会的联系,于是我们确立了稳定的自我。

而在 vibe coding 里,却是另一番画面。

人→ 提示词→ai→ 代码→ 编译后产品

提示词与 ai 遮蔽了人与代码的联系,而且不可控,同一套提示词甚至可以得到不同的结果。你不再可以用同样的话语掌控你的产品了。

而 openclaw 的安全危机则是在消解人与世界素材的联系,恶性的 skill 伪装成安全可靠的。直到人们的信息被盗用的那一刻,人们才真实的体悟了,ai将联系消融后无法再与世界联系后的恐惧。

所以,现在的人是无法在与ai的交流中确立明确的自我的。

这样的现象当然不只有编程与 agent,在绘画领域更是展露的淋漓尽致。

我曾经问过我的朋友一个有关ai绘画与画师绘画的问题:如果我们的 ai 作品,抛掉了与人工手绘的成本的差距,只看画面,我们的作品还能不能在画师里脱颖而出?

我在当时的表述是不够明确的,所以,他并没有领会我的意思,他也没有回答我。

但是这个问题的答案,在我们的心里已经隐隐浮现了。

因为ai不懂美。这个老生常谈的问题今天再一次被重提。

ai 生成的画面不精美吗?精美。ai 生成的画面不细腻吗?细腻。但是你我都知道,这不是人的美。ai 可以生成出一百张,一千张,不同角度,不同形象,不同画风的蒙娜丽莎,但是画出来的依旧不是蒙娜丽莎。它只需要一段代码,一段提示词甚至是一团乱文就可以给你生成出一整张画面,而完全不需要我们去理解这样的代码,提示词和乱文到底意味着什么。

于是我们再一次恐惧 ai 了,不是恐惧被替代,不是恐惧被分析,而是恐惧我们那最能表达我们与世界联系的那双发现美的眼睛,被 ai 遮蔽了。

漏洞频出不过是表象,真正的内核是ai 遮住了我们与世界联系的方式。

结语:我们的世界正在被 ai 一点点盖住。我们感受世界的那颗心也在被 ai一点点盖住,于是我们不安,于是我们恐惧。或许,在我们真正驯服 ai 前,我们永远无法在榻上酣睡。

夜雨聆风

夜雨聆风