导言

最近和几位企业主聊,发现大家对AI有一个共同的误解——觉得AI越来越强,自己能做的事迟早会被替代。

但有一件事很少被讨论:AI学到的东西,本质上是有边界的。不是因为算力不够,不是因为模型不够大——而是因为这个世界上有一大类知识,结构上就没有办法被AI学到。

麻省理工有个学生去采访一位航空维护AI的创始人。创始人分享了一个细节:飞行员把飞机开进机库,填了一张纸,放进活页夹,然后活页夹上架子——从来没有人扫描它。

那张纸上写的,是某种异常的振动,是起飞前无法用数字描述的"不对劲"。

这些信息消失了。永远不会进入任何数据库。永远不会成为任何模型的训练数据。

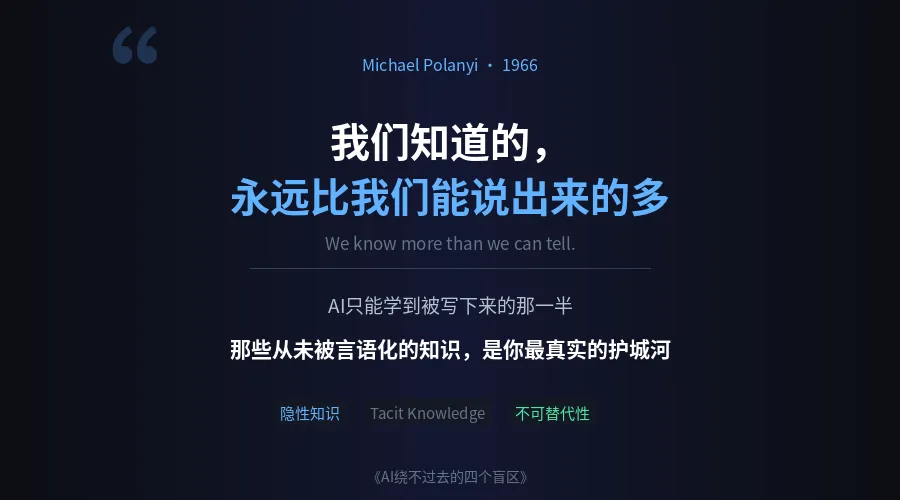

哲学家Michael Polanyi早在1966年说过一句话:我们知道的,永远比我们能说出来的多。

这就是隐性知识(Tacit Knowledge)。而AI,只能学到被写下来的那一半。

一、AI的结构性盲区

当我们谈"AI会不会取代你",背后有一个默认假设:AI可以学到一切。

这个假设是错的。

AI只能从文本、数据、结构化信息里学习。而人类的知识,有相当大的一部分从来没有被语言编码过——它存在于每个有经验的人的脑子里、手里、身体里,活在具体的关系和场景中。

这不是暂时的技术障碍。模型变强,算力变大,这个盲区不会消失。因为这些知识从来就没有被写下来过。

这个盲区,是我们在AI时代护城河的真正起点。

二、四类AI学不到的知识

第一类:时机与Agency(直觉与意志力)

好的投资人一眼能看出一个创始人有没有agency——这种判断力从简历看不出来,从pitch deck也感知不到,只能从一个人讲话的方式里感觉到。

而这种感觉只有一个来源:这个人见证过周期。

见过一波热潮起来,见过它慢慢衰退,见过那些看起来必然成功的公司怎么无声消失。然后再见一波。

只有这样,才知道什么时候该出手,什么时候该等。

AI可以给你所有的分析,但它替不了你走出那一步。时机是判断,Agency是意志。那一步,永远是你的。

第二类:失败知识

AI的训练语料严重偏向成功故事。失败的项目,大部分不会有详尽的复盘。失败的真实原因,很多时候连创始人自己都没完全想清楚,更不会写出来。

那个大客户私下说"我们不会用这个的"——这句话没有写进任何文档。

那次产品方向的转变,真正的原因是某个人某天心情不好,但事后写出来的版本有完整的逻辑和框架。

AI因此形成了一个过度理性化的世界观:它以为事情按逻辑发生。实际上,事情按人发生。

尝过失败的人,掌握的是AI永远读不到的那版历史。那版历史,才是真的。

第三类:局部网络知识

每个行业都有一套大家都懂但没有写下来的规矩:谁是真正拍板的人,谁看起来是DM但其实什么都不决定,这个合作对象嘴上说yes但他们公司的决策链是什么样的。

这些东西在任何数据库里都找不到。它们存在于私下的饭局里,存在于那个认识所有人的朋友的脑子里。

你嵌在那个网络里,你就有这个信息优势。你不在,你就没有。而AI,则永远不在。

第四类:在残缺中做判断

那位创始人提到一件事:一架飞机出问题,从飞行员汇报到维修开始,中间经过了24个人工交接点——电话、Slack、口头说了一句再转述给下一个人。没有任何一个交接点被完整记录。

AI看到的,是最后那份维修单。维修单上的世界,和真实发生的过程,是两件事。

真正的判断力是在那24个交接点里,在信息残缺、时间有限的情况下,知道下一步该做什么——先做,边做边修正。

等分析完了才决策,这架飞机早就误点了。AI能给你最好的分析,但它只会停在分析这里。剩下的,是人的事。

三、AI越强,边界越清晰

有一个有趣的悖论:AI越强,它的局限性反而越清晰。

当AI还很弱的时候,我们觉得它什么都学不了,也不知道边界在哪里。当AI变强了,我们才开始看清楚:它能做什么、不能做什么,轮廓反而更分明了。

边界越清晰,站在边界之外的人就越来越不可替代。

焦虑AI会取代你,其实是在假设AI能学到你所知道的一切。它从原理和结构上,就学不到那一半。

四、这对咨询和管理意味着什么

这四类知识,恰好是管理咨询工作的核心所在。

咨询顾问最大的价值从来不是信息量——而是:见过失败的项目(失败知识)、知道这个行业谁说了算(局部网络知识)、在客户犹豫的时候知道下一步该怎么走(Agency)、在数据残缺时能做出判断(残缺中的判断力)。

这也意味着:AI强化了咨询工作的基础工作(信息整理、分析、报告生成),但恰恰同时提升了顾问核心价值的稀缺性。

当所有人都用AI生产分析,分析本身的价值就下降了。而那些拿着隐性知识做出判断的人,差异化反而变大了。

知识库建设也如此。我们一直说"把经验沉淀下来",但真正值钱的部分,是那些失败的项目、私下的对话、没有被写进任何报告的真实原因——这些才是AI无法替代的知识资产。

总结

AI绕不过去的四个盲区:

时机与Agency——判断何时出手的直觉,和走出那一步的意志力 失败知识——从未被语言化的真实原因,AI的训练语料里几乎没有 局部网络知识——谁拍板、谁影响决策,只存在于关系和饭局里 残缺中的判断力——在信息不完整时先动起来,不等分析完

这不是"AI没有威胁"的鸡汤。这是一个更精准的判断:知道哪里是真正的边界,然后主动把自己的积累方向对准那里。

那位创始人最后说,她是从她飞行员丈夫身上看到这些问题的。有些东西,只有在特定的关系里才能看见。我想,这也是隐性知识的一种。

关联阅读:《你不是AI用得不好,是没给AI搭好台子》(2026-04-17)

夜雨聆风

夜雨聆风