前两天又刷到 「Harness Engineering」 这个词的时候,我第一反应其实挺真实的,又来了。

这两年 AI 圈最不缺的,就是新词。

Prompt 还没背熟,Context 已经上桌了,

结果没过多久,Harness 也开始刷屏。

说真的,作为一个本来就不写代码的人,

我以前看到这种词,第一反应就是,

这圈子是不是就靠造新词活着的。

尤其是你刷公众号的时候,那种感觉会更强。

今天有人说 「Prompt Engineering」 已经过时了,

明天有人说 「Context Engineering」 才是未来,

后天又有人开始聊 「Harness」。

你敢信???

我当时就愣住了。

不是因为这些词太难。

而是因为它们看起来太像换皮了。

直到这次我真的坐下来,

把 GPT-3、Agent、长上下文、coding agent 这一整条线重新捋了一遍,

给我一下子整不会了。。。

原来这不是热词接龙,也不是一拨人嫌前一个词不够高级,

赶紧换个更唬人的马甲。

它们真的是一层一层长出来的。

而且越往后看,越吓人。

因为你会发现,行业一开始以为自己在升级提示词,后来才意识到,自己其实是在重写软件工程。

故事真正的起点,不是 ChatGPT 爆红那一刻。

而是 2020 年,OpenAI 把 GPT-3 论文扔到世界面前的时候。

很多朋友可能不知道,那篇论文真正吓人的地方,

不只是参数做到了 1750 亿,

也不只是效果突然变强了。

更邪门的地方在于,它第一次特别公开地证明了一件事,

一个足够大的语言模型,不一定非得重新训练,

不一定非得重新微调,你给它一段自然语言任务说明,

再塞几个例子,它居然就能像模像样地干起来。

这一下,很多人的脑子里都响了一声。

你想想看,这事以前是很怪的。

以前你想让机器干活,要写代码,要写规则,要写流程图。

你是先告诉它怎么做,它才会做。

结果 GPT-3 把门踹开了一条缝,

你可以先告诉它你想要什么,

然后看它能不能自己长出一条路。

这就是 「Prompt Engineering」 最早让人上头的地方。

它不是单纯的会提问。

它更像是一种轻量编程接口。

那几年最迷人的地方就在这儿,你改一句话,结果就变了。

加一个角色设定,输出风格变了。

补几个 few-shot 例子,模型突然稳了。

再来一句 step by step,推理味儿又出来了。

那感觉太牛逼了,像是在驯一匹很聪明,但也有点野的马。

你会觉得,自己好像摸到了新软件时代的遥控器。

坦率的讲,这种兴奋非常合理。

我非常理解当时大家为什么会沉迷 prompt。

你不用懂太多底层细节,不用先搭一堆系统,

不用先建复杂流程,光是把话说得更明白一点,

结果就肉眼可见地变好。

这种正反馈,谁顶得住。

而且这事跟普通人真的有关。

为什么我现在越来越这么觉得。

因为你今天用 AI 写东西、做 PPT、搜资料,

其实每天都在做 prompt 的事,

只是你不知道它叫这个名字。

你跟 AI 说,帮我写个方案。

它写得一塌糊涂。

很多人第一反应是,AI 不行。

可这个事儿我也踩过坑,后来才慢慢反应过来,

很多时候不是 AI 笨,是你给它的任务太像谜语。

→你到底是要给老板看的汇报,还是要给客户看的提案。

→你要三页,还是三十页。

→你想要保守一点,还是激进一点。

→你希望它模仿咨询公司的口气,还是更像一个产品经理在讲人话。

这些你不说,它就会自己脑补。

所以 「Prompt Engineering」 在那几年会被捧上神坛,

不奇怪。

它确实像第一次把需求描述这件事,直接推到了执行层。

以前需求和执行中间隔着人,

现在中间多了一个会说话的模型,

语言突然不再只是沟通工具,它开始有点像按钮了。

但第一个转折也来得很快。

大家本来以为,未来几年最重要的能力,就是怎么把提示词写得更聪明。结果 Agent 一出现,整个幻觉就开始破。

模型不再只是回答问题了。

它开始查资料,调工具,读文件,跑多轮任务,写代码,

修 bug,甚至试图在一个真实项目里连续干活。

这个时候人们才发现,真正决定成败的,

不是最后那句 prompt 写得够不够漂亮,

而是模型眼前到底看到了什么。

→你给它错的资料,它会一本正经地错下去。

→你给它太多资料,它会被噪音淹没。

→你历史消息没处理好,它会像一个熬夜过头的人,脑子开始发木。

这时候,「Context Engineering」 上来了。

很多人第一次看到这个词,可能有小伙伴纳闷,

不就是 prompt 的升级版吗。

表面看像。

其实吧,已经不是一个层级的问题了。

「Prompt Engineering」 赌的是一句话能把模型讲明白。

「Context Engineering」 赌的则是,你得先把模型放进一个正确的信息环境里。

一个像你给同事发了一条特别清楚的微信。

另一个像你不只发微信,

你还把背景资料、历史决策、客户脾气、过往坑点、能用的工具、不能碰的边界,

全都摆在他桌上。

前者在练说话。

后者在配环境。

这就是为什么我后来突然觉得,这事不只是程序员的事。

因为现在大家每天和 AI 打交道的时候,

其实早就在碰 context 了。

你跟 AI 说,帮我写个方案,写不好,

不一定是因为那句 prompt 太烂,

也可能是因为你没把场景、背景、目标读者、已有资料、限制条件一起给进去。

这不就是 context 的问题吗。

你每天都在做。

只是你不知道它叫这个名字。

说到这儿。

我突然想到了以前做产品时一个特别朴素的经验。

一个人干不好活,很多时候不是他不聪明。

是你给他的现场太乱。

AI 也一样。

而且它比人更怕乱。

Anthropic 后来专门把这个问题拎出来讲,

里面有个词我觉得特别传神,

叫 「context rot」。

怎么说呢,你可以把它理解成上下文开始腐烂了。

信息越来越长,历史越来越多,

模型表面上看起来知道得更多,实际上注意力在稀释,

噪音在累积,关键约束慢慢被埋住。

你以为窗口大了它就更稳了,结果很多时候,它只是有了更大的地方去迷路。

这一下,行业的焦点就变了。

以前是在打磨一句话。

现在是在布置整个案发现场。

模型像个侦探,你给它什么线索,什么顺序,什么工具,

什么记忆,它就会走出完全不同的路。

顺着上面的再聊聊,这一步最有意思的地方就在于,

大家突然意识到,AI 不只是一个会说话的接口,

它更像一个活在有限注意力里的临时同事。

你不是在命令它,你是在给它创造工作环境。

这也是为什么这些年很多产品看起来像同一个模型,体验却天差地别。

不是哥们,差距真不一定都在模型本身。

很多时候,差距就在谁更会给模型组织信息。

谁更知道什么该提前给,什么该延后给,什么该压缩,

什么该丢掉,什么必须反复提醒。

写着写着突然感觉,这玩意跟管理还挺像的。

资料不是越多越好,重点才重要。

你给一个人一屋子文件,不等于你给了他判断力。

你只是给了他一场脑雾。

但故事还没完。

第二个转折更狠。

很多团队本来以为,只要上下文配对了,Agent 就该稳定了。

结果真正把它放进代码仓库,放进长任务里跑,灾难才刚开始。

它会做到一半忘记自己在干嘛,会把一个项目修成半拉子,

会误判任务完成,会反复在同一个坑里摔倒。

那种感觉很像什么呢,很像你雇了一个天赋极高,

表达还挺像样的实习生,结果他每天都能给你惊喜,

也每天都能给你惊吓。

我后来去看一些一线团队写的东西,心里真的就是一声叹息。

大家不是没把 prompt 写好。

也不是没把 context 配好。

而是 Agent 一旦真进工地,

问题就变成了另一类东西,谁来给它装护栏,

谁来给它记进度,谁来替它验收,

谁来防它自信满满地把活干炸。

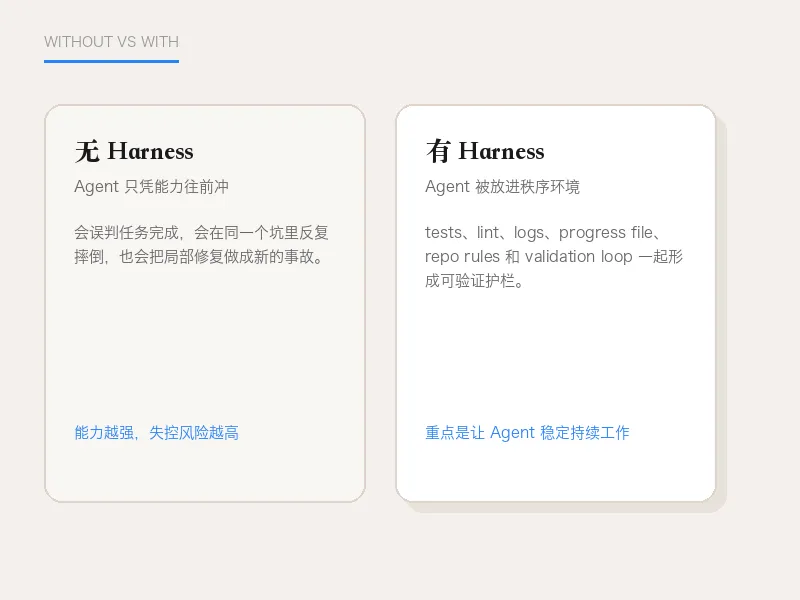

「Harness Engineering」 就是被这种现实逼出来的。

如果说 「Prompt Engineering」 管的是说话。

「Context Engineering」 管的是信息。

那 「Harness Engineering」 管的,就是秩序。

这词听起来有点硬。

但你一旦理解了,其实特别直白。

它关心的不是怎么让 AI 更像人聊天,

而是怎么让 AI 在一个真实工程环境里,

不那么容易失控。

测试、lint、脚本、日志、进度文件、规则文档、验证回路,

这些以前很多人觉得老派,

觉得是软件工程老师傅的絮絮叨叨。

结果现在,它们又被重新请回了主桌。

为什么。

因为模型越强,它越敢自己往前冲。

没有 harness,很多能力最后都会变成事故。

这里最有戏的地方。

是它和老软件工程之间那种又新又旧的关系。

很多人会说,「Harness Engineering」 不就是测试、文档、CI、脚手架吗。

对。

表面上看,真像旧瓶装新酒。

可我自己的感受是,真正的变化在于,

这些东西以前主要是给人用的,

现在它们第一次被系统性地重写成给 Agent 用。

过去文档是写给同事看的,现在很多文档先得让智能体能读懂。

过去测试更像上线前验收,

现在测试还成了 Agent 当场挨打、当场纠偏的反馈系统。

过去 repo 规则是团队纪律,现在它还是机器行为边界。

同样是一条公路,给人开和给自动驾驶跑,路还是那条路,但标线、护栏、传感、反馈系统,全都得重做。

这一下,整个味道就变了。

我有时候觉得,这三个词真正迷人的地方,不是它们谁抢了谁的饭碗,而是它们把软件工程控制权外移的过程给说透了。

Prompt 时代,控制权主要还在语言层。

你通过措辞影响模型。

Context 时代,控制权开始往信息层外移。

你开始决定模型这一轮看到怎样的世界。

Harness 时代,控制权又继续往环境层外移。

你不只是给它看世界,你还在设计一套制度,让它可以持续工作,持续被纠偏,持续被验证。

这条线一旦看明白,很多东西一下就通了。

为什么大家早期那么迷 prompt。

为什么后来人人都在聊 context。

为什么最近越来越多一线团队开始把 harness 挂在嘴边。

不是因为行业闲得没事干,一定要每隔几个月造一个新词。

而是因为任务复杂度真的在往上长。

一个比一个更接近主问题。

说到这儿,我突然想到了一段工业史。

十九世纪末,很多美国工厂开始上电机。

很多老板以为,装上电以后,生产率自然就飞了。

结果并没有。

后来大家才明白,问题不在于你有没有电机,

而在于你的工厂布局、流程设计、组织方式,

是不是围着电力重新改过。

AI 这波也有点像这样。

你把一个会说话的模型接进来,不等于你已经完成了变革。

真正的变化,

会发生在接口、上下文、工具、验证、规则、协作方式都围着智能体重做之后。

行业一开始以为自己在升级提示词。

后来发现自己其实是在重写软件工程。

而这件事,跟普通人也越来越近。

因为普通人今天和 AI 协作,早就不只是问一个问题那么简单了。

你在让它帮你写方案,帮你做 PPT,帮你搜资料,

帮你整理会议纪要,帮你规划旅行,帮你改简历。

这里面已经不只是 prompt 了。

你给不给背景,给不给范例,给不给限制条件,

给不给历史资料,甚至你会不会自己建立一个固定工作流,

这些都会影响结果。

只是以前我们不知道,该怎么给这些差别起名字。

现在行业替你起了。

→「Prompt」。

→「Context」。

→「Harness」。

这三个词,表面上是在解释 AI。

往深一点看。

其实是在解释人以后该怎么跟 AI 一起工作。

所以我现在再回头看,已经不太会对这些词产生那种单纯的烦躁了。

反正我觉得,下次再冒出一个新词,你也别急着翻白眼。

先问一句,它是在解决语言层的问题,信息层的问题,还是环境层的问题。

很多东西,立刻就顺了。

下一步,会不会连 「Harness Engineering」 都只是过渡词。

说实话我也不确定。

我自己也还在摸索。

但有一件事,我现在越来越确信,

未来工程师最值钱的能力,

可能已经不是亲手写每一行代码,

而是搭一个让智能体稳定工作的世界。

这事听着有点远。

其实已经来了。

所以下次你再刷到什么新黑话的时候,也许可以先别急着说,又来了。

因为很可能,那不是黑话在换皮。

而是权力真的又往外挪了一层。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧。

如果想第一时间收到推送,也可以给我个星标。

夜雨聆风

夜雨聆风