过去的移动通信系统,本质上解决的是“连接”的问题:如何把数据更快、更稳地传过去。但随着大模型和分布式AI的发展,网络中承载的内容正在发生变化——从数据流,逐渐变成具备计算语义的任务流。当推理、训练甚至决策过程开始跨越端、网、云协同完成时,网络的角色也随之发生改变。这带来一个值得认真讨论的问题:如果网络不再只是传输通道,而是智能任务的一部分,那么它的能力应该如何定义?又该如何评价其性能?

6G的核心目标之一是通过人工智能即服务(AIaaS)实现泛在智能。在无线网络中广泛分布的AI大模型,需要更高效的训练、分发和推理机制。6G支持分布式终端先进行本地训练,再通过网络进行模型参数交互,既能有效保护用户数据隐私,又能显著提升模型精度。对于算力受限的终端,6G可联合调度通信资源与AI计算资源,提供高精度实时推理服务。因此,AIaaS已成为6G典型应用场景。

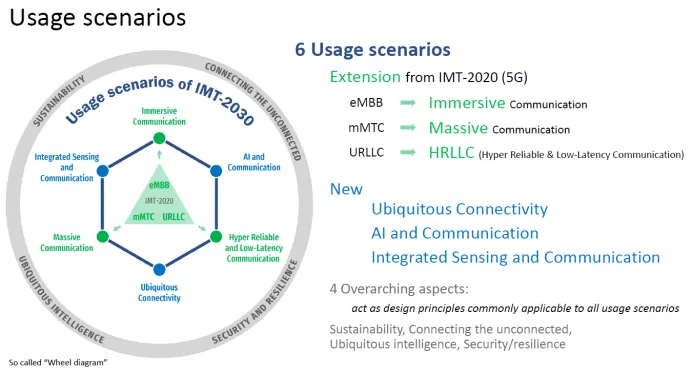

图1:ITU-R IMT-2030六大使用场景

ITU-R WP5D在IMT-2030框架中,将“AI和通信”定义为六大使用场景之一,与沉浸式通信、超可靠低时延通信、海量通信、泛在连接、感知与通信融合并列。作为超越传统通信的服务场景,“AI和通信”重点支撑分布式计算和AI应用,包括数据采集、本地/分布式计算卸载、分布式AI模型训练与推理等。

IMT-2030: Technical requirements for the 6G future

https://www.itu.int/hub/2026/03/imt-2030-technical-requirements-for-the-6g-future/

典型用例涵盖IMT-2030辅助的自动驾驶、医疗辅助设备间自主协作、跨设备计算密集型操作卸载,以及数字孪生创建与预测等。为支撑这些场景,在IMT-2030框架下,系统能力已从传统通信能力(如区域容量、用户体验速率、低时延、高可靠性)进一步扩展,引入了AI相关能力与感知能力。从系统实现角度看,这类能力通常涉及多源数据的获取与处理、分布式AI模型训练、跨系统的模型共享与协同推理,以及计算资源的编排与协同调度等。

在此基础上,“AI+通信”场景可以被看作是一种分布式AI服务形态:网络通过连接分布在端、边、云各侧的智能体,形成以数据、模型和计算资源为核心要素的协同体系,从而为AI应用提供端到端支撑。协作机器人是这一场景下的典型代表。在工业环境中,多机器人需要协同完成复杂任务,对AI服务的时延与精度均提出较高要求,以支撑感知、认知、规划与控制等环节。这些能力通常依赖大模型支撑,而单个终端的本地算力往往难以独立满足,从而需要借助网络侧的计算与协同能力实现整体任务完成。

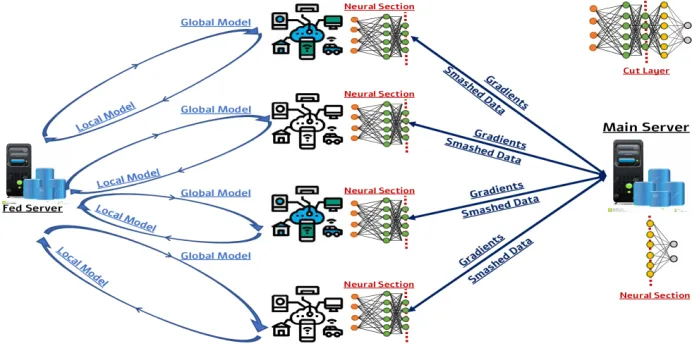

图2:6G分布式AI模型推理与训练典型架构

协作机器人(cobots)是这一场景下的典型代表。在工业环境中,多机器人需要协同完成复杂任务,对AI服务的时延与精度均提出较高要求,以支撑感知、认知、规划与控制等环节。这些能力通常依赖大模型支撑,而单个终端的本地算力往往难以独立满足,从而需要借助网络侧的计算与协同能力实现整体任务完成。从这一类协同任务出发,可以将网络对AI能力的支撑进一步抽象为两类基础服务:模型推理服务和模型训练服务。

模型推理服务是核心功能之一。6G网络通过泛在连接提供实时推理能力,在分布式场景下结合通信与AI资源,通过模型协作弥补终端短板。常见实现方式是将大模型拆分部署:计算密集部分置于网络侧,终端侧仅处理轻量任务,双方联合完成推理。

- 模型训练服务则是获取高精度模型的关键。6G可根据用户特性与网络状态智能编排算法和资源。在大规模分布式训练中,网络作为调度平台,提供高速通道,支持终端仅交换模型参数而非原始数据。典型流程为终端本地初步训练后上传模型更新,网络完成聚合生成全局模型并分发。这一“聚合+分发”迭代过程既实现联合学习,又有效保护用户隐私。

性能要求一直是驱动移动通信系统设计与演进的核心。从2G到5G,网络的KPI体系主要围绕连接传输构建,重点关注速率、时延和容量。而在“AI+通信”场景下,AI服务涉及通信与计算资源的深度协同,这促使我们重新思考:网络除了“传得快”,是否还需要“算得准”和“协同高效”?从通信角度,6G可能需要显著提升上行容量,以支撑模型参数交互和数据卸载;从AI角度,网络则需更好地支持分布式学习和实时推理。业界普遍认为,6G设计宜从早期阶段就打破通信与AI的传统割裂,实现AI-native的深度融合。

5G R18阶段已开始探索对AI/ML操作的支持(如分割推理、模型分发、联邦学习),但整体仍以数据传输为主,AI功能多依赖云端。截至2026年,ITU-R WP5D在2月会议上就IMT-2030技术性能要求达成了草案共识,目前正等待后续正式批准。中国IMT-2030推进组与欧洲Hexa-X等组织也在相关讨论中指出,AI服务有望成为下一代网络设计的重要考量之一。业界已开始提及AI相关的指标,例如模型推理精度与时延,但目前仍处于探索阶段,尚未形成成熟的端到端完整框架。计算机领域的MLPerf等基准主要针对集中式部署,而6G中的AI服务是分布式、通信参与其中的。这不仅是技术问题,更是设计思路的转变:网络要从“被动传输”转向“主动使能智能”。

在6G AI相关能力的性能定义上,行业内已形成一些共识:

端到端融合:AI服务质量同时受通信链路和AI处理能力影响,性能指标宜尽量覆盖完整流程,而非局限于传统通信KPI。

典型服务导向:指标可围绕分布式模型训练和实时推理等核心服务展开,体现网络内部AI能力与协作机制的潜在价值。

核心优先与规模适配:面对海量设备,指标选择上建议聚焦对用户体验和系统效率影响较大的关键因素,避免过度泛化。

针对AI相关服务,行业研究中提出了一些补充的性能参考维度,主要基于模型训练与推理服务,其表现受系统AI资源约束和通信能力共同影响。以下三个维度是当前讨论中较为常见的探讨方向:

AI服务精度:指在给定约束条件下,AI推理或学习服务的输出与真实值(或参考模型输出)的一致程度。该指标受AI任务特性、模型部署方式(例如拆分部署)以及数据/模型参数传输质量等因素影响。不同应用场景对精度的需求差异显著,业界倾向于探讨设定合理的参考门槛,以支持更广泛的应用覆盖。

AI服务时延:指AI推理或学习服务从发起到获得结果的总时间,包括AI相关数据的传输时间与模型处理时间。实时性要求较高的场景(如工业控制、协作机器人)对此指标较为敏感,需要结合精度要求进行综合考量。

AI服务密度:指单位面积内(例如每平方公里)同时满足特定精度和时延要求的AI服务数量。它可作为评估网络在实际部署环境中AI承载能力的重要参考指标,反映系统在通信与AI资源协同下的整体容量表现。

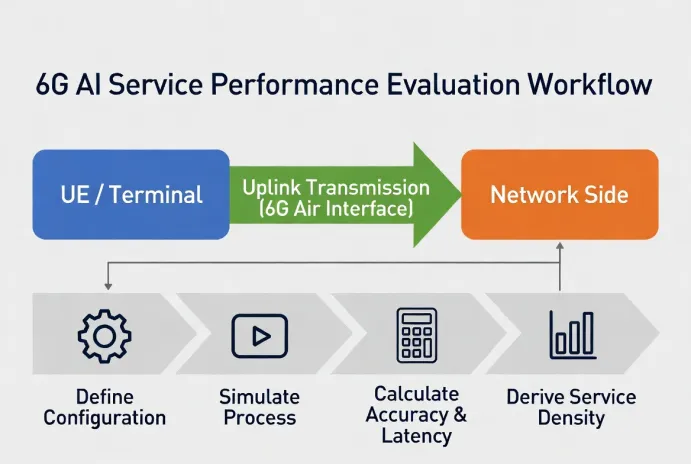

如何将AI相关性能参考维度转化为可操作的评估体系,是当前6G研究中备受关注的议题。当前讨论中,评估通常围绕两个基础维度展开:AI服务精度和AI服务时延,并以此推导服务密度。典型流程包括:

定义测试环境(如密集城区或工业场景)、无线配置、AI任务类型、数据集以及模型拆分部署方式;

模拟完整服务流程:终端侧生成中间数据或模型更新→ 通过无线链路传输 → 网络侧完成处理并输出结果;

计算精度(输出与真实值或参考模型的一致程度)和时延(传输时间 + 处理时间之和);

图3:6G AI 服务性能评估工作流程

这种方法能较好反映通信能力(尤其是上行容量)和AI资源调度之间的相互制约关系。部分研究还建议结合实际用例(如协作机器人分布式推理)进行仿真验证,以观察不同传输配置(例如中间数据量化比特数)对精度-时延权衡的影响。

尽管上述评估思路已在部分研究中得到初步应用,但当前研究普遍认为,从指标定义到实际验证仍面临多方面挑战。系统设计的重点不再是“如何优化某一个指标”,而是如何在不同约束条件下找到一组可接受的平衡解。这种平衡并非固定不变,而是随着网络状态、任务特性以及资源分布持续变化。例如,在资源充足或任务容错较高的场景中,可以优先保障精度;而在时延敏感或资源紧张的场景下,则可能需要对模型进行裁剪或采用更轻量的推理路径。这意味着,系统需要具备根据上下文动态调整策略的能力,而不是依赖静态配置。

多目标权衡的复杂性,本质上来源于通信与计算的深度耦合。在分布式AI场景中,任务执行路径横跨终端、网络和云侧,不同节点承担不同的计算职责,而通信链路将这些节点连接为一个整体。模型切分、任务调度以及数据传输方式,都会在多个维度上同时产生影响,使得系统难以通过单一优化手段获得整体最优解。

这里是6G智能计算网络LAB~

欢迎关注、点赞和分享!

本公众号致力于从多元视角出发,探讨6G智算网络关键技术演进、核心挑战与未来趋势,为相关领域的研究者与实践者提供有富有启发性的思考与有价值的参考。

夜雨聆风

夜雨聆风